¿Por qué un automóvil automático clásico es imposible y no tiene perspectivas comerciales?

Aquellos que siguen las innovaciones automotrices al menos un poco saben bien que un automóvil automático completo debe conducir por las carreteras durante mucho tiempo. Pero su apariencia cada 5 años, se transfiere constantemente por otros 5 años. Obviamente, algo va mal, e incluso los optimistas más obstinados están atormentados por vagas dudas, y aquellos que recuerdan el "invierno de la inteligencia artificial", por lo general caen en una penumbra.

La inteligencia artificial se topó con una barrera de comprensión . Es obvio que si Google (Weimo) con sus capacidades ilimitadas no hizo nada además de los costosos juguetes en 10 años, entonces es hora de reconocer que con las tecnologías actuales de inteligencia artificial, un automóvil automático comercial de quinto nivel (AA) completo. imposible de hacer Indirectamente, esto se reconoció incluso en Weimo, y en las últimas pruebas en diciembre de 2018

(Waymo lanzó un servicio de taxi no tripulado pagado en los EE. UU.), El conductor

fue devuelto al volante (en cada automóvil, por si acaso, los conductores se pondrán al volante para que puedan responder a la fuerza - una situación importante o una falla de un sistema no tripulado). Y artículos que en 2019 un AA de pleno derecho se alejó de nosotros, y no más cerca, ya no gana un montón de desventajas

(el 5to nivel va más lejos, no más cerca) .

En este artículo, analizaremos los obstáculos insuperables que han surgido durante numerosos y largos intentos de crear un AA clásico. Es decir, hablaremos sobre el estado actual de las cosas hoy, y no sobre las promesas publicitarias de un futuro más brillante en N años.

¿Y qué es un automóvil automático (AA) en general?

En opinión del lego, este es un automóvil controlado por una computadora, es decir, una cierta Inteligencia Artificial (IA). De ahí la solución obvia: hacemos una IA

normal , la conectamos a una cámara estéreo rotativa, la ponemos en cualquier automóvil, la enviamos a cursos de capacitación de manejo ordinarios y conseguimos un conductor calificado. Sin embargo, no vemos nada parecido a esta decisión. Es decir, la IA existente no puede competir con el conductor humano. Por lo tanto, los desarrolladores de AA se ven obligados a hacer trampa, ofreciendo una especie de sustituto (un montón de sensores caros, redes neuronales que no entienden qué y cómo hacer, etc.). Tenga en cuenta que todo esto es una solución

temporal hasta que aparezca una IA completa (fuerte). Con el advenimiento de los cuales, todos estos raros y lidares caros serán descartados como innecesarios (una persona prescinde de ellos). Es decir, el enfoque clásico para crear AA en sí huele a algún tipo de engaño. Averigüemos por qué.

Comencemos con lo que definimos, ¿y qué queremos decir con AA de pleno derecho del quinto nivel? Con esto queremos decir un cierto complejo automatizado (ACS) capaz de conducir un automóvil en condiciones reales de la carretera con las características de un conductor humano promedio. El problema surge de inmediato: ¿qué tipo de bestia es un "conductor promedio"? ¿Es esta la temperatura promedio en un hospital? Pero propongo dejar la solución a este problema a los gerentes de relaciones públicas, y simplificando enormemente la tarea, compare AA con el nivel de un

conductor novato que solo recibió una licencia de conducir y, en consecuencia, el acceso a la vía pública.

Es decir, compararemos el controlador novato y el piloto automático más avanzado, ni siquiera uno específico, sino el más potencialmente posible en el nivel actual de desarrollo tecnológico. Para hacer esto, debe crear una tabla comparativa de todas las características de conducir un conductor humano novato y el piloto automático más perfecto.

Y que vemos Que de acuerdo con un criterio (responsabilidad), AA, en principio, no podrá alcanzar el nivel de incluso un conductor novato. Es decir, estrictamente hablando, el AA clásico

nunca puede alcanzar el nivel de un conductor novato, incluso teóricamente.

O tal vez ella, esta responsabilidad? Vamos a hacerlo bien. Vemos que incluso las características potenciales del piloto automático son "buenas", pero no "excelentes". Porque en todas partes hay restricciones

insuperables . Brevemente:

La precisión del control depende de la información sobre la superficie de la carretera. Y en el caso general, esta información no está completa.

La evaluación de la situación del camino en el caso general se basa en información incompleta y, en consecuencia, no puede ser precisa.

Tomar una decisión con una falta de información generalmente inevitable es de naturaleza probabilística y no se puede garantizar que sea correcto, incluso teóricamente.

Como resultado, es obvio que incluso un piloto automático ideal no puede garantizar la ausencia de un accidente, incluso teóricamente.

Entonces, ¿quién será responsable de las inevitables víctimas de un accidente de tráfico?

Por lo tanto, cuando los próximos especialistas en relaciones públicas le digan que un AA completo ya está completamente listo, pero estos son solo problemas con las leyes arcaicas, no lo crea.

Si los fabricantes asumieran la responsabilidad a nivel de un conductor humano, las leyes cambiarían instantáneamente . Pero la realidad es que todavía no hay un AA real, y ya hay cadáveres de sus "falsificaciones", y nadie quiere responder por ellos. Musk dijo que no tenía nada que ver con eso, pero este imbécil era el culpable, quien no se dio cuenta de que el "piloto automático" de Tesla no era un piloto automático, sino un "piloto automático TM", es decir, solo una

mentira publicitaria llamada el nombre de un asistente de conductor común. Y era necesario creer no en Ilon Mask y el anuncio, sino en lo que estaba escrito en letra pequeña al final (

toda la responsabilidad recae en el conductor humano ).

Por lo tanto, el problema de responsabilidad del AA clásico no puede resolverse ni siquiera teóricamente. Por lo tanto, un

AA clásico completo

es imposible, incluso teóricamente .

Esto, por cierto, no significa que no se pueda fabricar o incluso vender, significa que

primero , tendrá que resolver de alguna manera el problema de la responsabilidad, o vender la forma de deshacerse de esta responsabilidad.

Y aquí entendemos que es muy difícil hacer esto de manera natural (sin directivas estatales directas).

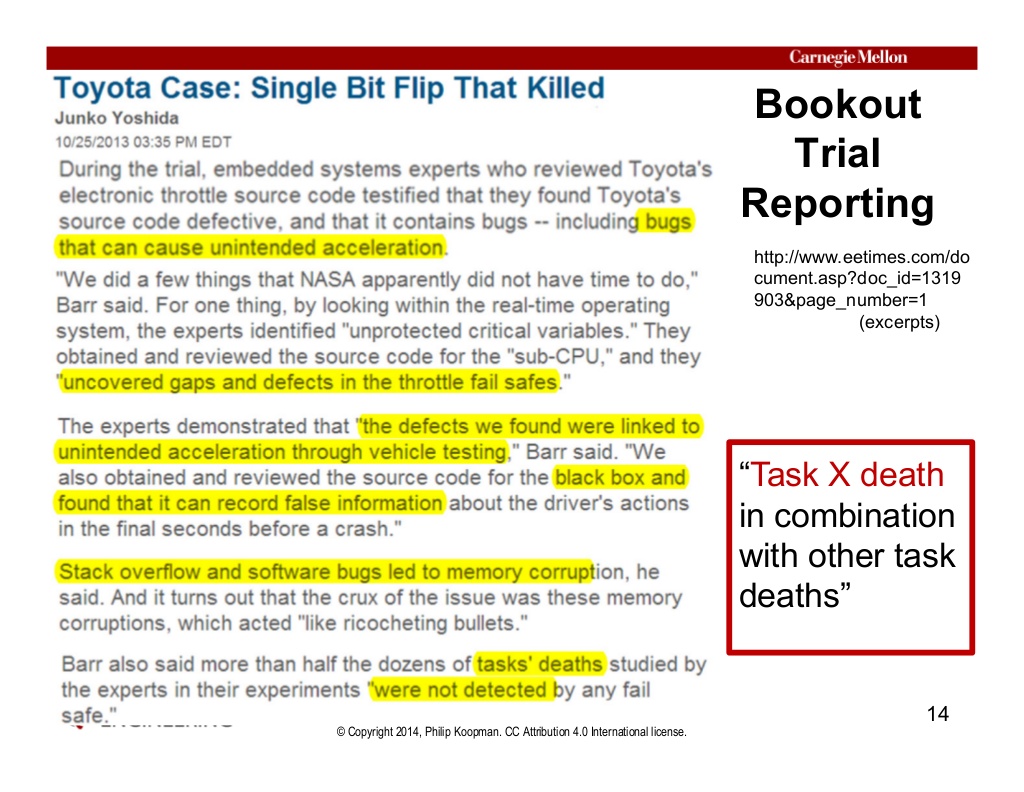

Además, el problema es aún peor. Responsabilidad, esto es una consecuencia del establecimiento de la culpa. Pero este es un gran problema ahora. Por un lado, la presencia de una caja negra en AA simplifica esta tarea y, por otro lado, la complica, ya que

toda la información del fabricante de AA es información de la parte

interesada . No tiene que ir muy lejos por ejemplos: naturalmente, cambiar el automóvil al modo diesel no se reflejó en los registros. Y quizás aún peor, se puede escribir información falsa a sabiendas en los registros. Aquí está la página del informe de la investigación de pegado del acelerador:

Diapositiva 14 del informe: puede aparecer un cuadro negro sobre lo que hizo clic el controlador.

Y luego, los fabricantes de AA son compañías de estados específicos, de qué manera los estados apoyarán, en el último turno prestando atención a la verdad. Por ejemplo, en casos muy similares, Toyota y GM, las autoridades estadounidenses toman decisiones significativamente diferentes.

Permíteme recordarte brevemente que hubo un error técnico allí y allí, ellos sabían de él, lo escondieron durante mucho tiempo, y los que hablaron de esto fueron despedidos.

Cómo se resolverá este problema, los especialistas en relaciones públicas no nos lo dicen.

Pero supongamos que todavía encontramos a AA culpable. ¿Qué hacer a continuación? Necesitamos averiguar la razón, pero aquí entendemos que el pseudo III actual, es decir, las redes neuronales, en principio, no puede explicar por qué se tomó la decisión incorrecta, lo que condujo al accidente.

Una pequeña digresión sobre las redes neuronales. Sus problemas son bien conocidos por los especialistas en el

"Renacimiento de la IA": nada más que hardware costoso y publicidad lanzada para implementar la vieja idea . Y muchos ya están comenzando a hablar abiertamente sobre el segundo invierno de la IA. Si explica con los dedos, entonces necesita saber una cosa sobre las redes neuronales: que estas son solo estadísticas multidimensionales. No menos, pero no más. Por lo tanto, sus capacidades y limitaciones son obvias:

- Al igual que cualquier estadística, dependen mucho de los datos de entrada, es decir, incluso pequeños cambios en los datos de entrada pueden cambiar seriamente el resultado final.

- Como esto es empírico, y no analítico, además multidimensional, los desarrolladores, en principio, no entienden cómo funciona una red neuronal y qué elementos afectan qué. Esto puede ilustrarse con cualquier fórmula empírica compleja, que es un polinomio con muchos coeficientes. En general, es imposible entender de qué es responsable un coeficiente particular y cómo, de lo contrario, sería posible escribir una fórmula analítica simple.

- De los dos primeros puntos, se deduce que cualquier cambio en los datos de entrada requiere una prueba completa de todo el sistema. De lo contrario, resulta que al corregir un error, podemos agregar otros errores que no existían antes. Es decir, los resultados de pruebas anteriores pierden su significado.

- La recopilación adecuada de datos primarios es insoportable organizativamente y económicamente.

Como resultado, el enfoque clásico para la resolución de problemas no funciona. Y como resultado, cada nueva versión del software no es un hecho que será mejor que la anterior. ¿Cómo, entonces, certificar AA?

Pero todos consideramos la situación bajo el supuesto de que, desde un punto de vista técnico, el AA ideal ya existe. Pero esto está lejos del caso. Aquí hay algunas razones, cada una de las cuales, si no pone fin al enfoque clásico,

al menos pospone la decisión y aumenta el costo del AA final . Y ahora es muy caro.

Imposible ver todo desde el auto

El problema en la forma clásica no tiene solución en absoluto, ya que simplemente no existen tales sensores por dinero. Por lo tanto, en el caso general, AA debe tomar decisiones en condiciones de falta de información, es decir, pensar en lo que está a la vuelta de la esquina. ¿Una persona es responsable de estos pensamientos y una computadora? Tenga en cuenta que, dependiendo de la responsabilidad real, la misma persona con la misma experiencia y calificaciones

toma decisiones fundamentalmente diferentes en la carretera real y en el simulador de automóviles. Y si el conductor todavía se ve obligado a responder por una gran cantidad de pasajeros, entonces debe obtener una categoría adicional de licencia de conducir. Por lo tanto, la

responsabilidad es un criterio de gestión fundamental, del que dependen directamente otras características de gestión . Y AA clásico está completamente desprovisto de este criterio crucial.

Es imposible tomar decisiones sin siquiera una IA completa, pero una conciencia artificial completa

Y en situaciones peligrosas esto a menudo se requiere. Por ejemplo, seguir reglas escritas (frenamos directamente) y reglas no escritas (dejamos de lado) conduciría a un accidente. Y un desvío a la izquierda con una salida al carril que se aproxima permitió evitar un accidente. Obviamente, el problema sin una conciencia artificial completa no tiene solución, ya que requiere una decisión sobre la violación

intencional de las normas de tráfico en ausencia de información. ¿Quién será responsable de las consecuencias, dada la falta real de información y pronósticos probabilísticos?

No hay camino correcto

Es fácil adivinar que el problema de resolver situaciones de conflicto entre AA y un conductor humano no puede resolverse sin ambigüedades (una persona siempre afirmará que estaría de acuerdo en interactuar con otra persona). La solución de este problema en la corte es muy problemática, ya que es poco probable que el juez sea objetivo. Dado que el juez puede estar en el lugar del conductor de la persona, pero nunca en el lugar de la computadora del conductor.

Resultará toda la amante que no se adapta al propietario

El AA real

solo puede programarse

para el cumplimiento estricto de las reglas de tráfico , que, desafortunadamente, no difieren en rigor y falta de ambigüedad. Por lo tanto, AA hará hipertrofia para cumplir con la regla "dar el camino al tonto". Y, por supuesto, los tontos-conductores usarán esto, cortando a AA con impunidad. Y se frenará, dejando que

todos avancen. ¿Qué tan rápido se aburrirá el dueño de AA?

No se puede garantizar la seguridad (que no se estrellarán contigo)

El problema del carro, que no tiene una solución segura,

garantiza a las víctimas por culpa de AA. Naturalmente, los conductores profesionales que se queden sin trabajo utilizarán cualquier accidente por presión política sobre las autoridades para prohibir AA. Pero estos son votantes reales.

Inaceptablemente baja confiabilidad e inmunidad al ruido

Absolutamente todos los sensores AA se atascan o engañan fácilmente. Por lo tanto, deshabilitar todos los AA en cualquier parte del camino es muy simple y económico. Les damos a los niños "reflectores láser" para la bicicleta y les pedimos que vayan por la carretera. Dispersamos WiFi, GPS, ruido blanco para el radar de un quadrocopter en los árboles. Dibujamos las marcas viales "originales". Modificamos levemente las señales de tráfico, confundiendo las cámaras de video ordinarias.

Tesla puede engañar a un kit de $ 40 de Arduino y un transmisor ultrasónico que genera ondas de sonido: el automóvil no podrá encontrar un espacio de estacionamiento gratuito ni perder obstáculos reales . Barato y efectivo. ¡Y no consideramos hackers en absoluto! Estos son solo neoluditas.

Los conductores humanos profesionales están categóricamente en contra y desalentarán

Por lo tanto, mediante una interferencia simple y barata (una guerra electrónica tan simple), puede garantizar la detención de cualquier AA. Que en tales condiciones no podrá funcionar ni siquiera teóricamente, pero un conductor humano

sí . Trate de encontrar al menos una razón por la cual las personas que se quedan sin trabajo no usen este método. Pero nadie necesita transporte que pueda detenerse en cualquier momento por tiempo indefinido. Y los taxistas, personas que han elevado los precios en este momento, reducirán rápidamente a cero la cantidad de personas que desean ahorrar en taxis AA.

Hackers

Incluso ahora, cientos de compañías de docenas de países hacen AA. ¿Cómo verificar, certificar y dar servicio a todo esto? Pero, ¿cómo certifica el software que se actualiza constantemente por aire? ¿Cómo garantizar que el próximo empleado ofendido no haya filtrado los códigos de acceso? En el futuro, todos los pilotos automáticos serán reparados en los servicios provinciales de automóviles. ¿Cómo controlar qué firmware se instalará allí? ¿Quién será responsable de este firmware? El conductor dirá que lo pusieron en el servicio y no sabía nada sobre el modo activado de Dios, pensé que este es el caso con todos. Es decir, una gran cantidad de problemas de seguridad, y lo que sea que uno diga, ¡el AA clásico es solo el sueño de un hacker!

Un buen objetivo para los piratas informáticos: cómo engañar a la IA y hacer que tome decisiones peligrosasEn pocas palabras: para AA clásico, hay muchos problemas técnicos y legales que hoy no tienen una solución aceptable . Teóricamente, por supuesto, todo se puede resolver o "suavizar", pero requerirá mucho tiempo y dinero.

Y aquí caemos al suelo. Es decir, de "¡guau! AA "a" y a expensas de quién es el banquete "? En realidad, hay muchos costos adicionales significativos que no están incluidos en el precio de AA:

- AA en sí. Es caro, pero al menos honestamente.

- Mapas precisos de alta resolución. ¿Y cómo mantener su relevancia? Hay dos formas y ambas son malas. Primero, reunir a la propia empresa con el fabricante de AA. ¿Pero cuántos autos necesitas para esto? La segunda forma, deja que los autos se monten. Pero cómo determinar la fiabilidad de estos datos (y no los piratas informáticos o los competidores están tratando de enseñarle a su red neuronal lo malo). Es decir, estos datos deberán verificarse seriamente, y todos los cheques requieren dinero. Pero la cuestión de la relevancia real de estas tarjetas en el caso general no tiene solución alguna para ningún dinero .

- Estas tarjetas precisas deben cargarse a través de redes inalámbricas, de lo contrario, en principio, no pueden ser relevantes. Entonces, resulta que todavía necesitamos Internet de banda ancha en todas partes, e incluso en las carreteras federales no tenemos comunicaciones celulares en todas partes. ¿A expensas de quién? Tenga en cuenta que incluso las raras actualizaciones de Tesla solo se pueden hacer a través de WiFi gratuito. Esto no quiere decir que esto no se dice en absoluto. Pero en el mejor de los casos, aquí y allá en letra pequeña y siempre sin especificar un precio.

- 4) seguro de accidentes. Por alguna razón, se cree que el seguro puede resolver el problema de la responsabilidad. Pero esto no es así, el seguro solo distribuye la responsabilidad a un gran número de personas inocentes. Naturalmente, los propietarios de Tesla no querrán ser responsables de los errores del Kamaz no tripulado y viceversa. Es difícil decir cómo van las cosas, pero en la etapa inicial el seguro será prohibitivo (millones de dólares por auto para pruebas en California). Y luego el clásico círculo vicioso (pequeño AA, seguro costoso, seguro costoso, pequeño AA). Además, la misma afirmación de que el AA clásico es más seguro que una persona no se basa en ningún hecho, ya que no pueden estar a la vista de la ausencia de AA real .

¿Y de dónde viene el mito sobre la eficiencia económica de AA?

A primera vista, obviamente, tiramos al conductor, ahorrando en su salario. Pero en realidad, no todo es tan simple. Después de todo, no solo tiramos al conductor, tiramos a la persona. Y para el camión, la

única persona en el auto. ¡Pero este es un sueño de ladrones! Silenciamos la comunicación, simulamos un accidente, detenemos un vagón no tripulado en una carretera vacía. Cargamos carga, eliminamos lidares, radares, etc. Prendimos fuego y nos vamos. Y todo esto se puede clasificar como ni siquiera el robo, sino el vandalismo. No hay hombre allí, así que no hay robo.

Nos quitamos los lidars para jugar para experimentos. Y la carga fue robada por personas al azar. Y contrarrestar tal escenario es muy difícil. Dado que los atacantes bloquearán la conexión regularmente y en muchos lugares, es físicamente imposible enviar una policía antidisturbios para cada caso.

Poner equipo de defensa en el automóvil tampoco es una opción, ya que usted será responsable de los niños muertos, especialmente enmarcados por los atacantes.

Por lo tanto, una persona en cualquier caso debería ser. Sí, puede que no sea un conductor, sino un promotor. Pero la presencia de una persona inevitablemente requiere un régimen de trabajo y descanso. Es decir, la principal ventaja de AA es que el trabajo las 24 horas desaparece .Pero, ¿qué pasaría si varios vagones se aferraran firmemente a los piratas informáticos y bloquearan completamente el camino durante mucho tiempo, por ejemplo, una ambulancia? Es decir, en el futuro previsible en cada automóvil debería . , , , . , , , . , , . , .

: ,

. , ? . , , . !

( ) .

: , . , , , .

Un automóvil automático clásico aumentará los atascos y complicará su regulación:

Pero supongamos que todos los problemas anteriores se resolvieron milagrosamente de alguna manera y tenemos una autonomía completa de AA de quinto nivel sin volante ni pedales. Wow! Wow! ¿Pero quién lo necesita, quién paga por él? Naturalmente, el proceso no sucederá instantáneamente y alguien seguramente se encontrará con estas timideces de un lado a otro, pero la lógica de introducir AA clásico se presenta de la siguiente manera:- La tecnología es más efectiva en un taxi automático.

- La falta de salario para el conductor reducirá drásticamente el precio del viaje.

- Esto aumentará dramáticamente la demanda de pasajeros de transporte público. Uber ha demostrado que un taxi barato no se transfiere desde automóviles privados, sino desde el transporte público.

- De acuerdo con el modelo de Uber, la demanda satisfactoria, las empresas y los propietarios privados aumentarán drásticamente la cantidad de taxis automáticos.

- , ( 80% , ).

- , , ( ). , , ( , ).

- ( Vision Zero). , ! , , .

- ( , , , ). , .

, :

- , « ». , - - . , , - . , . , , .

- , « ». «» , , .

- , . , , , .

- , .

« », , . , . , .

, Vision Zero .

,

_ ,

, LSE Cities_ — , , ,

, , . , . « », , ,

. .

: , , , , . , , . , .

, :

- ?

- , ?

. ,

,

.

PS « »,

.

.