IBM anotó el conjunto de datos Diversity in Faces

IBM anotó el conjunto de datos Diversity in FacesRecientemente, IBM

fue criticado por tomar fotos disponibles públicamente del alojamiento de fotos de Flickr y otros sitios donde los usuarios cargan sus imágenes para entrenar redes neuronales sin permiso. Formalmente, todo está de acuerdo con la ley: todas las fotos se publican bajo una licencia Creative Commons, pero las personas se sienten incómodas porque AI aprende de sus caras. Algunos ni siquiera sabían que fueron fotografiados. Como sabe, para fotografiar a una persona en un lugar público, no necesita pedirle permiso.

Según los informes de los medios, IBM utilizó aproximadamente 1 millón de fotos privadas de Flickr para entrenar su sistema de reconocimiento facial. Pero luego resultó que IBM en realidad no copió fotos de Flickr, estas imágenes son parte del

conjunto de datos

YFCC100M de 99.2 millones de fotos disponibles para entrenar redes neuronales. Esta base también fue hecha por Yahoo, el antiguo propietario de Flickr.

Resulta que la historia con IBM es solo la punta del iceberg. Aquí, la compañía cayó accidentalmente bajo la distribución, y de hecho, las fotos de los usuarios se han utilizado durante mucho tiempo para entrenar una variedad de sistemas, esto ya se ha convertido en una práctica común: "Nuestro estudio mostró que el gobierno, los investigadores y las corporaciones de EE. UU. Utilizaron imágenes de inmigrantes, niños maltratados y personas muertas para probar sus sistemas de reconocimiento facial ",

escribe Slate . Hace hincapié en que incluso las agencias gubernamentales como el Instituto Nacional de Estándares y Tecnología (NIST) practican tales actividades.

En particular, el programa NIST ejecuta pruebas de verificación de reconocimiento facial (FRVT) para pruebas estandarizadas de sistemas de reconocimiento facial desarrollados por empresas de terceros. Este programa le permite evaluar todos los sistemas de la misma manera, comparándolos objetivamente entre sí. En algunos casos, se otorgan

premios en efectivo de hasta $ 25 mil por ganar la competencia, pero incluso sin una recompensa monetaria, un puntaje alto en la prueba NIST es un poderoso incentivo para el éxito comercial de la empresa de desarrollo, porque los clientes potenciales prestarán atención de inmediato a este sistema, y se puede mencionar la calificación A +. en comunicados de prensa y materiales promocionales.

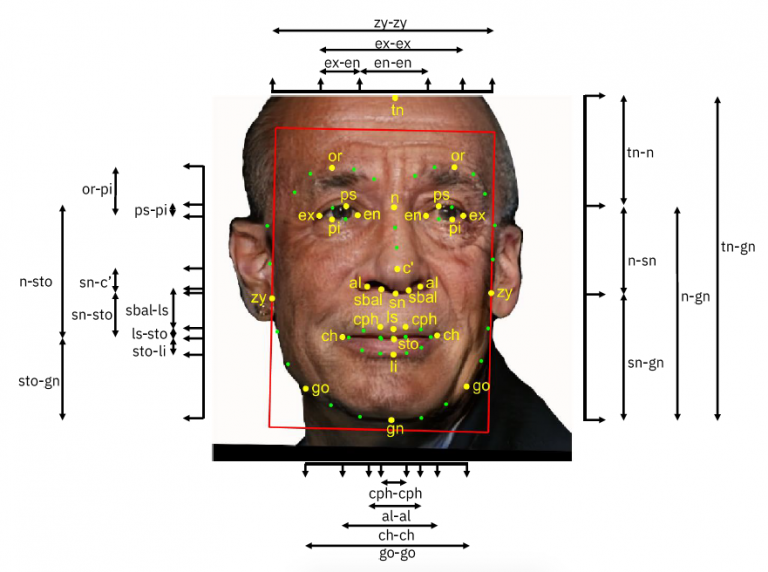

Para evaluar NIST, se utilizan grandes conjuntos de datos con fotografías de caras tomadas en diferentes ángulos y en diferentes condiciones de iluminación.

Una investigación de

Slate reveló que el conjunto de datos NIST incluye las siguientes fotografías:

Los empleados del Departamento de Seguridad Nacional (DHS) tomaron muchas fotos en lugares públicos, mientras que en el proceso de fotografiar a los transeúntes, los empleados del DHS se hicieron pasar por turistas que fotografiaban los alrededores.

Los conjuntos de datos NIST contienen millones de imágenes de personas. Dado que la recopilación de datos tuvo lugar en lugares públicos, literalmente cualquier persona puede estar en esta base de datos. NIST está distribuyendo activamente sus conjuntos de datos, lo que permite a todos descargar, almacenar y usar estas fotos para desarrollar sistemas de reconocimiento facial (no se publican imágenes de explotación infantil). Es imposible decir cuántos sistemas comerciales usan estos datos, pero

numerosos proyectos científicos lo hacen

con seguridad, escribe

Slate .

En un comentario para la publicación, un representante del NIST dijo que la base FRVT estaba siendo ensamblada por otras organizaciones gubernamentales de acuerdo con sus tareas, esto también se aplica a la base con fotos de niños. NIST utiliza estos datos en estricta conformidad con la ley y las regulaciones existentes. Confirmó que la base de datos con pornografía infantil en realidad se usa para probar productos comerciales, pero los niños en esta base de datos son anónimos, es decir, sus nombres y lugar de residencia no están indicados. Los empleados del NIST no ven estas fotos, se almacenan en servidores DHS.

Se ha utilizado un conjunto de datos con fotografías de niños desde al menos 2016. Según la

documentación para desarrolladores , incluye "fotografías de niños desde la edad de un bebé hasta un adolescente", donde la mayoría de las imágenes muestran "coerción, violencia y actividad sexual". Estas imágenes se consideran particularmente difíciles de reconocer debido a la mayor variabilidad en posición, contexto, etc.

Este conjunto de datos probablemente se usa para sistemas de capacitación y prueba para

el filtrado automático de contenido obsceno .

Los periodistas también destacan el "sesgo" del conjunto de datos del Conjunto de datos de encuentros múltiples. Aunque los negros representan solo el 12.6% de la población de los EE. UU., El 47.5% está en la base de datos de fotografías de delincuentes, por lo que la IA también puede aprender prejuicios y

volverse racista .