En los últimos años, ha aumentado el interés en los modelos de aprendizaje automático, incluido el reconocimiento de imágenes y caras visuales. Aunque la tecnología está lejos de ser perfecta, ya le permite calcular delincuentes, encontrar perfiles en redes sociales, rastrear cambios y mucho más. Simen Thys y Wiebe Van Ranst demostraron que al realizar solo cambios menores en la información de entrada de la red neuronal convolucional, el resultado final puede ser reemplazado. En este artículo, veremos parches visuales para realizar ataques de reconocimiento.

Los primeros ataques a los sistemas de reconocimiento fueron pequeños cambios en los píxeles de la imagen de entrada para engañar al clasificador y derivar la clase incorrecta.

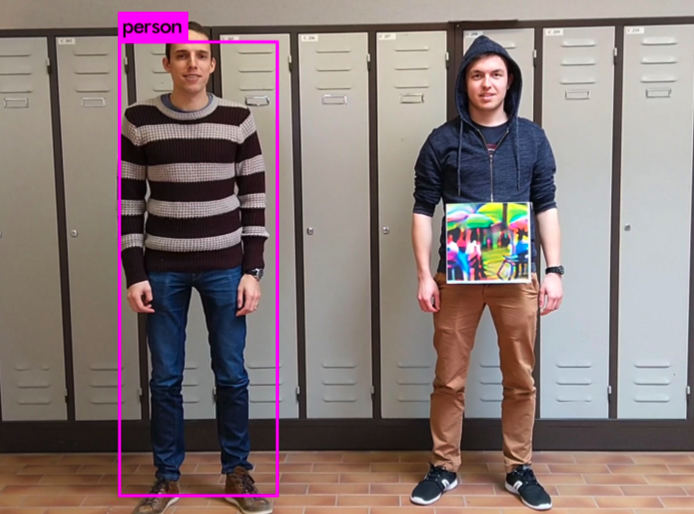

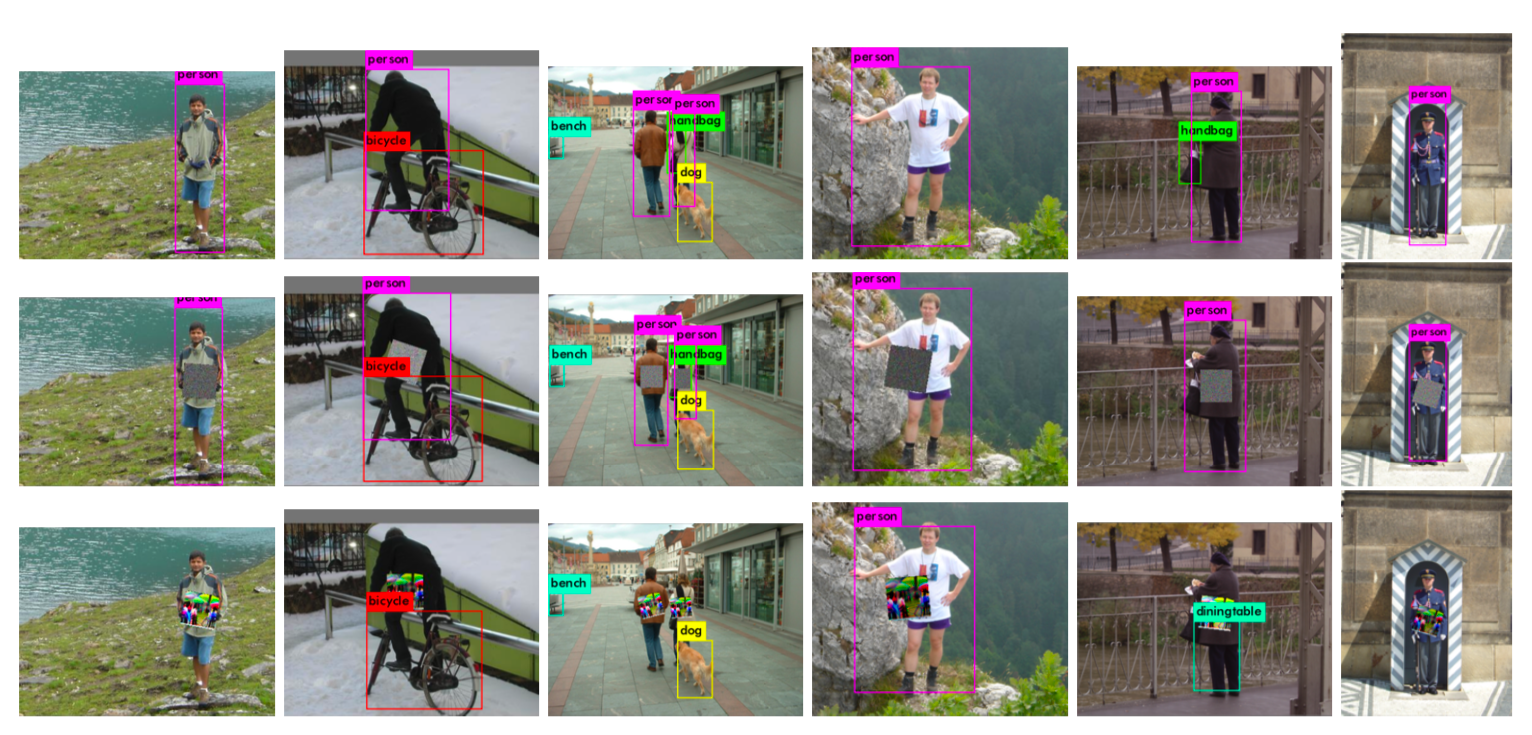

El objetivo era crear un parche que pudiera ocultar con éxito a una persona del detector. El resultado fue un esquema de ataque que podría usarse, por ejemplo, para evitar los sistemas de vigilancia. Los atacantes pueden colarse imperceptiblemente, sosteniendo frente a sí mismos una pequeña tableta de cartón con un "parche", dirigido a la cámara de vigilancia.

El desarrollo de

redes neuronales convolucionales (SNA) ha llevado a un enorme éxito en el campo de la visión por computadora. Un transportador de extremo a extremo basado en datos en el que los SNA se capacitan en imágenes ha mostrado los mejores resultados en una amplia gama de tareas de visión por computadora. Debido a la profundidad de estas arquitecturas, las redes neuronales pueden estudiar los filtros más básicos en la parte inferior de la red (donde entran los datos) para lograr funciones abstractas de alto nivel en la parte superior. Para esto, un SNA típico contiene millones de parámetros estudiados. Aunque este enfoque conduce a modelos muy precisos, la interpretabilidad se reduce drásticamente.

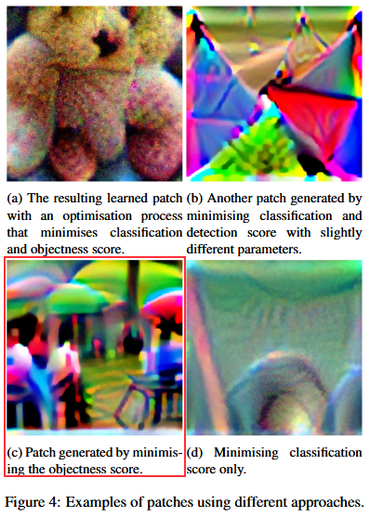

En la investigación, se utilizaron una variedad de imágenes para engañar a los sistemas de vigilancia, incluido el "ruido" abstracto y el desenfoque.

Para crear un parche, se utilizó la imagen original, que experimentó las siguientes transformaciones:

- rotación de 20 grados;

- superposición de ruido;

- difuminar

- modificación de brillo;

- modificación de contraste.

Los investigadores han realizado muchas

pruebas de Inria para determinar la mejor "ocultación" de una persona.

Para lograr el efecto deseado, una imagen de 40x40 centímetros (que se indica mediante el parche de palabras en el informe experto) debe ubicarse en el centro del cuadro de detección de la cámara y constantemente en su campo de visión. Por supuesto, este método no ayudará a una persona a ocultar su rostro, sin embargo, el algoritmo para detectar personas en principio no podrá detectar a una persona en el marco, lo que significa que el reconocimiento posterior de las características faciales tampoco se lanzará.

Como demostración, los investigadores publicaron una demostración en video de las capacidades de los parches visuales:

Código del proyecto

GitHub .

Investigación .