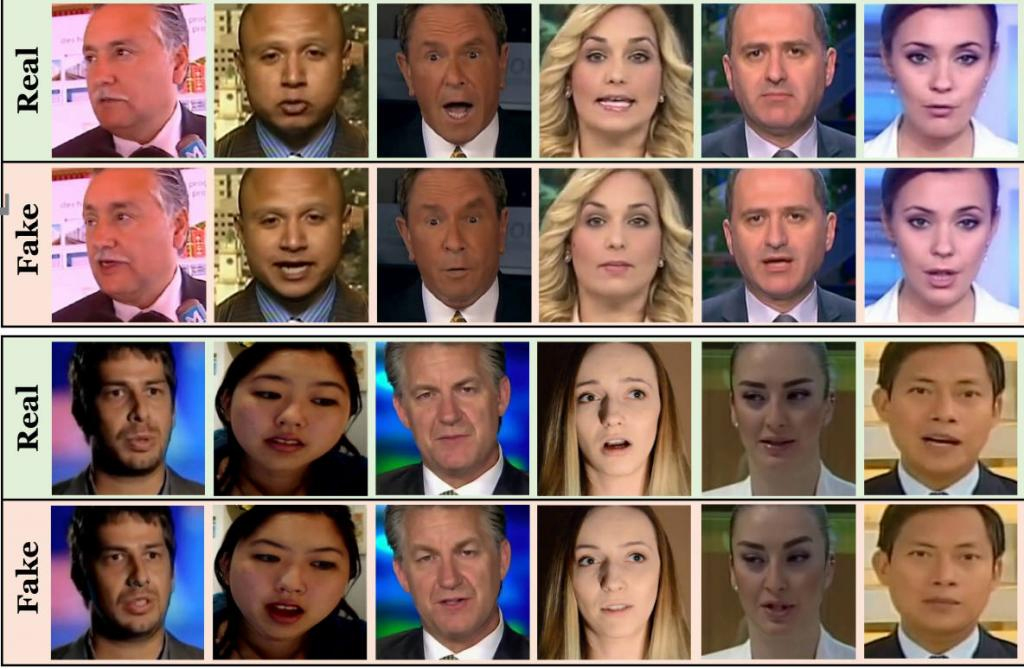

Desde el momento de su aparición en diciembre de 2017, dipfeyki, videos con un reemplazo facial casi perfecto creado por una red neuronal, causó pánico entre los expertos. Muchos, por ejemplo, tenían miedo de que la "venganza del porno" sería aún más fácil cuando un ex novio con una PC lo suficientemente potente podría hacer porno sucio con una novia. Pero Natalie Portman y Scarlett Johansson, quienes filmaron porno especialmente falso, maldecían públicamente Internet.

Para combatir la amenaza inminente, Facebook y Microsoft recientemente formaron una coalición para hacer frente a los ataques diplomáticos, anunciando un premio de $ 10 millones para aquellos desarrolladores que encuentren los mejores algoritmos para detectarlos. Esto se suma a DARPA, la gestión de investigación del Departamento de Defensa de los Estados Unidos, que ha asignado $ 68 millones en los últimos dos años para este propósito.

Bueno, ya es muy tarde. El primer crimen falso profundo ya ha tenido lugar.

Según el Wall Street Journal, en marzo de este año, el director gerente de una compañía energética británica fue robado de € 220,000 (alrededor de $ 240,000). Envió el dinero a una empresa proveedora de Hungría porque su jefe, el jefe de la empresa matriz en Alemania, le confirmó estas instrucciones varias veces. Pero, de hecho, un atacante astuto simplemente usó software con tecnologías de inteligencia artificial para reemplazar la cara y la voz del líder en tiempo real, y exigió que le pagara dentro de una hora.

El programa que utilizó el ladrón fue capaz de imitar completamente la voz de una persona: tono, puntuación, incluso un acento alemán. El mensaje provino de la dirección del jefe en Alemania, se envió un correo electrónico con contactos al director británico como confirmación. Suponiendo que algo iba mal, solo podría ser que, a pedido del jefe, llevara a cabo todo el trato lo más rápido posible, pero este no es el primer problema que sucedió en su negocio.

Como resultado, todo el dinero se había ido. Desde la cuenta húngara fueron transferidos a México y luego dispersados por todo el mundo. Pero los ladrones no se detuvieron allí. Pidieron una segunda traducción urgente para que "los suministros de Hungría" "vayan aún más rápido". Entonces el director británico sintió que algo andaba mal y llamó a su verdadero jefe. Resultó una especie de sur: se turnaba para recibir llamadas de un falso o ahora un verdadero líder, hablando en las mismas voces. El nombre de la empresa y sus empleados no fueron revelados, ya que se está llevando a cabo una investigación en este caso, y todavía no se han encontrado ladrones.

Quizás este ni siquiera sea el primer robo con Deepfake AI (o sus seguidores avanzados). Symantec informa que ha detectado al menos tres casos en los que un reemplazo de voz ha ayudado a los ladrones a burlar a las empresas y obligarlas a enviarles dinero. En uno de estos casos, el daño ascendió a millones de dólares. Además, a juzgar por la evidencia indirecta, este truco fue realizado por otros atacantes, no por aquellos que robaron al CEO británico. Es decir, los crímenes falsos se están convirtiendo gradualmente en propiedad común, esta no es la noción de ningún hacker ingenioso.

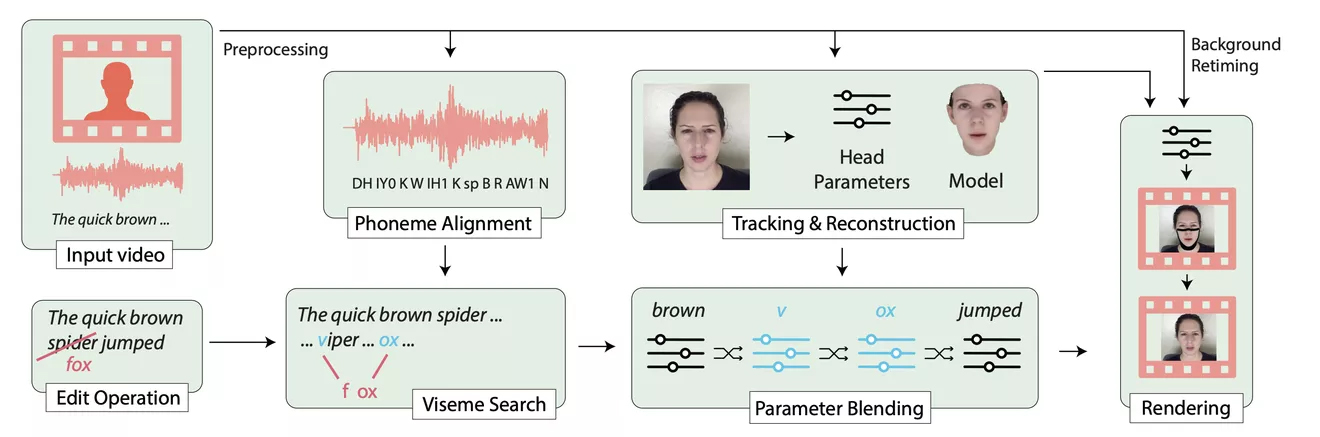

De hecho, pronto cualquier estudiante podrá hacer este procedimiento. Lo principal es encontrar una víctima que confíe lo suficiente y recolectar la cantidad correcta de muestras de video / audio para hacerse pasar por quien necesita. Google Duplex ya está imitando con éxito la voz de una persona real para hacer llamadas en su nombre. Muchas pequeñas empresas nuevas, principalmente de China, están trabajando para ofrecer servicios similares a deepfake de forma gratuita. Diferentes programas de diphey incluso compiten entre sí, que pueden generar videos bastante convincentes con una persona que utiliza la cantidad mínima de datos. Algunos afirman que pronto una de tus fotos será suficiente para ellos.

En julio, la Agencia Nacional de Protección contra Amenazas Cibernéticas de Israel emitió una advertencia sobre un tipo de ataque cibernético fundamentalmente nuevo, que podría dirigirse al liderazgo de empresas, altos funcionarios e incluso altos funcionarios. Esta es la primera y, por el momento, la amenaza de IA más real. Dicen que ahora hay programas que pueden transmitir perfectamente tu voz y acento después de escucharte durante 20 minutos. Si en algún lugar de la red hay una grabación con su discurso durante media hora, o si alguien se sentó a su lado en un café con una grabadora de voz, su voz ahora se puede usar para decirle algo a cualquiera.

Hasta ahora, no hay herramientas para combatir esto. Solo una opción para defender. Si alguien lo llama y le pide que transfiera una cantidad considerable de dinero, no será superfluo confirmar que él es la misma persona a través de otro canal. A través de mensajeros, Skype, correo electrónico, canales corporativos o redes sociales. E idealmente, por supuesto, cara a cara.

Bueno, si tienes un conocimiento profundo en aprendizaje automático y no te molesta obtener una parte de un pastel de $ 10 millones, puedes probarlo en el concurso de Microsoft y Facebook. O inicie su propia startup, ofreciendo a las empresas estatales y de renombre una solución comercial para determinar los diphakes por imagen o por voz. No podremos prescindir de él pronto.

PS Pochtoy.com puede entregar cualquier producto de los EE. UU. Ahora, no solo a Rusia, sino también a Ucrania , gracias a la cooperación con New Mail. El costo de enviar 0.5 kg desde $ 11.99 (para Ucrania - desde $ 8.00). Para nuevos registros con el código de promoción HABR: 7% de descuento en la primera entrega, más canje gratuito de tiendas estadounidenses por parte de nuestros operadores.