En Microsoft, nuestra misión es capacitar a todas las personas y organizaciones del planeta para que logren más. La industria de los medios ejemplifica esta misión. Vivimos en una época en la que se crea y consume más contenido de más formas y en más dispositivos que nunca. En IBC 2019, estuvimos encantados de compartir las últimas innovaciones en las que hemos estado trabajando y cómo pueden ayudar a transformar sus flujos de trabajo de medios. Sigue leyendo para aprender más.

Este artículo

en nuestro blog .

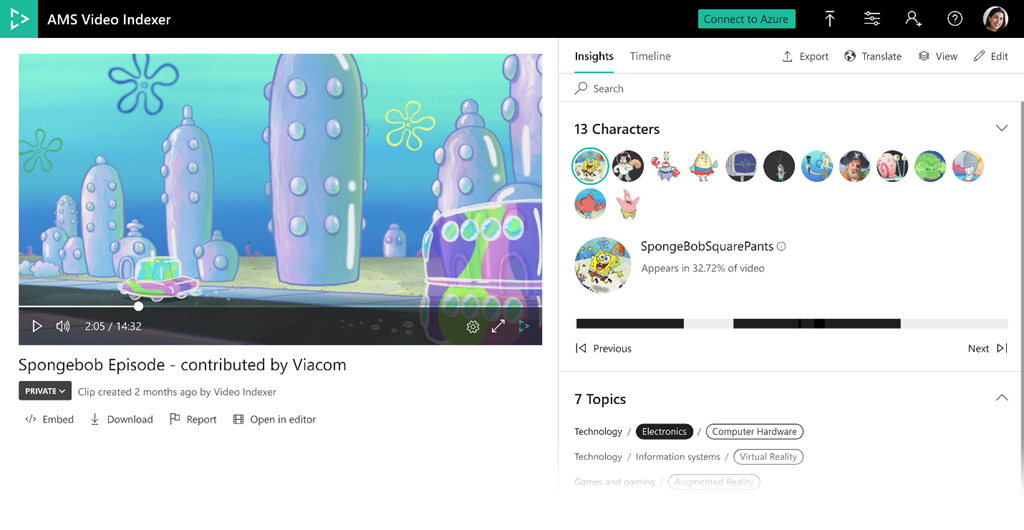

Video Indexer agrega soporte para animación y contenido multilingüe

Hacemos que nuestro galardonado

Indexador de video de Azure Media Services esté disponible en general en IBC el año pasado, y este año está mejorando aún más. Video Indexer extrae automáticamente información y metadatos como palabras habladas, rostros, emociones, temas y marcas de archivos multimedia, sin necesidad de ser un experto en aprendizaje automático. Nuestros últimos anuncios incluyen vistas previas de dos capacidades altamente solicitadas y diferenciadas para el reconocimiento de caracteres animados y la transcripción de voz multilingüe, así como varias adiciones a los modelos existentes disponibles hoy en Video Indexer.

Reconocimiento de personajes animados

El contenido animado o los dibujos animados son uno de los tipos de contenido más populares, pero los modelos de visión AI estándar creados para rostros humanos no funcionan bien con ellos, especialmente si el contenido tiene caracteres sin características humanas. En esta nueva solución de vista previa, Video Indexer une fuerzas con el servicio Azure Custom Vision de Microsoft para proporcionar un nuevo conjunto de modelos que detectan y agrupan automáticamente los personajes animados y permiten a los clientes etiquetarlos y reconocerlos fácilmente a través de modelos de visión personalizados integrados. Estos modelos están integrados en una sola tubería, lo que permite a cualquiera usar el servicio sin ninguna habilidad previa de aprendizaje automático. Los resultados están disponibles a través del portal Video Indexer sin código o la API REST para una fácil integración en sus propias aplicaciones.

Creamos estos modelos de personajes animados en colaboración con clientes seleccionados que contribuyeron con contenido animado real para capacitación y pruebas. El valor de la nueva funcionalidad está bien articulado por Andy Gutteridge, Director Senior, Estudio y Tecnología de Postproducción en Viacom International Media Networks, que fue uno de los contribuyentes de datos: "La adición de detección animada confiable basada en IA nos permitirá descubra y catalogue metadatos de caracteres de nuestra biblioteca de contenido de manera rápida y eficiente. Lo que es más importante, les dará a nuestros equipos creativos el poder de encontrar el contenido que desean al instante, minimizar el tiempo dedicado a la gestión de medios y les permitirá centrarse en la creatividad ".

Para comenzar con el reconocimiento de personajes animados,

visite nuestra página de documentación .

Identificación y transcripción multilingües

Algunos medios de comunicación como noticias, asuntos de actualidad y entrevistas contienen audio con hablantes que usan diferentes idiomas. La mayoría de las capacidades existentes de voz a texto requieren que se especifique previamente el idioma de reconocimiento de audio, lo cual es un obstáculo para la transcripción de videos multilingües. Nuestra nueva identificación automática del idioma hablado para la función de contenido múltiple aprovecha la tecnología de aprendizaje automático para identificar los diferentes idiomas utilizados en un activo de medios. Una vez detectado, cada segmento de idioma se somete a un proceso de transcripción automática en el idioma identificado, y todos los segmentos se integran nuevamente en un archivo de transcripción que consta de varios idiomas.

La transcripción resultante está disponible como parte de la salida JSON de Video Indexer y como archivos de subtítulos. La transcripción de salida también está integrada con Azure Search, lo que le permite buscar inmediatamente en los videos los diferentes segmentos de idioma. Además, la transcripción en varios idiomas está disponible como parte de la experiencia del portal de Video Indexer para que pueda ver la transcripción y el idioma identificado por tiempo, o saltar a los lugares específicos del video para cada idioma y ver la transcripción en varios idiomas como subtítulos como se reproduce un video También puede traducir el resultado de ida y vuelta a 54 idiomas diferentes a través del portal y la API.

Lea más sobre la nueva opción multilingüe y cómo usarla en Video Indexer

en nuestra documentación .

Modelos adicionales actualizados y mejorados

También estamos agregando modelos nuevos y mejorados dentro de Video Indexer, que incluyen:

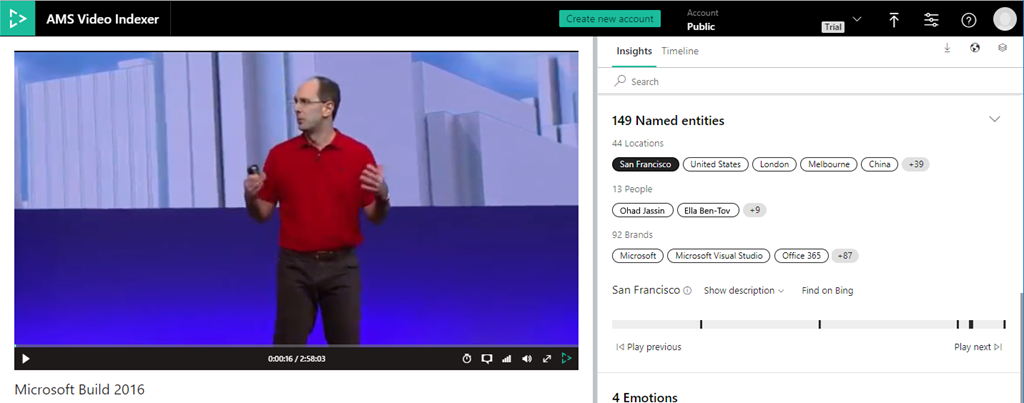

Extracción de personas y entidades de ubicaciones.

Hemos ampliado nuestras capacidades actuales de detección de marcas para incorporar también nombres y ubicaciones conocidas, como la Torre Eiffel en París o el Big Ben en Londres. Cuando estos aparecen en la transcripción generada o en la pantalla a través del reconocimiento óptico de caracteres (OCR), se crea una visión específica. Con esta nueva capacidad, puede revisar y buscar por todas las personas, ubicaciones y marcas que aparecieron en el video, junto con sus plazos, descripción y un enlace a nuestro motor de búsqueda Bing para obtener más información.

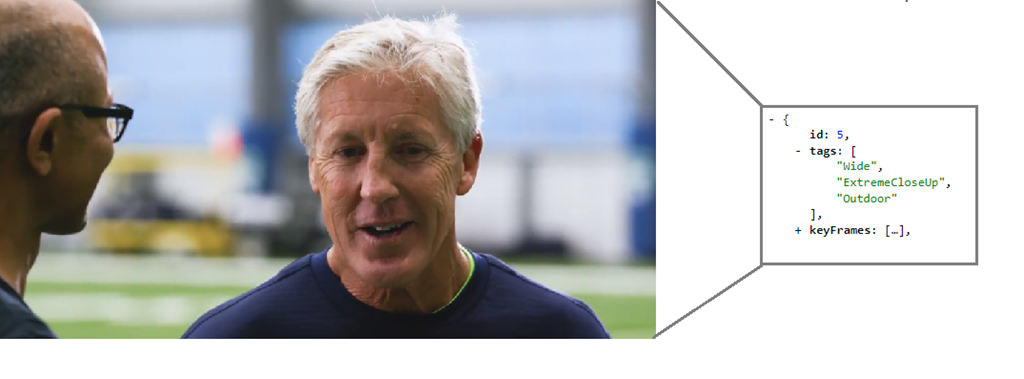

Modelo editorial de detección de disparos

Esta nueva característica agrega un conjunto de "etiquetas" en los metadatos adjuntos a una toma individual en la información JSON para representar su tipo editorial (como toma amplia, toma media, primer plano, primer plano extremo, dos disparos, varias personas, al aire libre e interiores, etc.). Estas características de tipo de toma son útiles al editar videos en clips y trailers, así como al buscar un estilo específico de tomas con fines artísticos.

Explore y lea más

Explore y lea más sobre la detección del tipo de toma editorial en Video Indexer.

Granularidad ampliada de mapeo IPTC

Nuestro modelo de inferencia de temas determina el tema de los videos en función de la transcripción, el reconocimiento óptico de caracteres (OCR) y las celebridades detectadas, incluso si el tema no se menciona explícitamente. Mapeamos estos temas inferidos a cuatro taxonomías diferentes: Wikipedia, Bing, IPTC e IAB. Con esta mejora, ahora incluimos la taxonomía IPTC de nivel 2.

La ventaja de estas mejoras es tan fácil como volver a indexar su biblioteca actual de Video Indexer.

Nueva funcionalidad de transmisión en vivo

También presentamos dos nuevas capacidades de transmisión en vivo en la vista previa de Azure Media Services.

La transcripción en vivo sobrealimenta tus eventos en vivo con AI

Al usar Azure Media Services para transmitir un evento en vivo, ahora puede obtener una transmisión de salida que incluye una pista de texto generada automáticamente además del contenido de video y audio. Esta pista de texto se crea utilizando la transcripción en vivo basada en AI del audio de la fuente de contribución. Los métodos personalizados se aplican antes y después de la conversión de voz a texto para mejorar la experiencia del usuario final. La pista de texto está empaquetada en IMSC1, TTML o WebVTT, dependiendo de si está entregando en DASH, HLS CMAF o HLS TS.

Codificación lineal en vivo para canales over-the-top (OTT) 24/7

Con nuestras API v3, puede crear, administrar y transmitir canales en vivo para servicios OTT y aprovechar todas las otras características de Azure Media Services, como video en vivo a pedido (VOD), empaquetado y administración de derechos digitales (DRM).

Para probar estas características de vista previa, visite la página de la

comunidad de Azure Media Services .

Nuevas características de empaque

Soporte para pistas de audiodescripción

El contenido de transmisión con frecuencia tiene una pista de audio que contiene explicaciones verbales de la acción en pantalla además del audio normal del programa. Esto hace que la programación sea más accesible para los espectadores con discapacidad visual, especialmente si el contenido es muy visual. La nueva

función de descripción de audio permite al cliente anotar una de las pistas de audio para que sea la pista de descripción de audio (AD), que a su vez puede ser utilizada por los jugadores para que los espectadores puedan descubrir la pista de AD.

Inserción de metadatos ID3

Para indicar la inserción de anuncios o eventos de metadatos personalizados en un reproductor cliente, los organismos de radiodifusión a menudo utilizan metadatos cronometrados incrustados en el video. Además de los modos de señalización SCTE-35,

ahora también admitimos ID3v2 u otros esquemas personalizados definidos por un desarrollador de aplicaciones para uso de la aplicación cliente.

Los socios de Microsoft Azure demuestran soluciones integrales

Bitmovin está presentando su Bitmovin Video Encoding y Bitmovin Video Player en Microsoft Azure. Los clientes ahora pueden usar estas soluciones de codificación y reproducción en Azure y aprovechar la funcionalidad avanzada, como codificación de 3 pasadas, soporte de códec AV1 / VVC, subtítulos en varios idiomas y análisis de video preintegrados para QoS, anuncios y seguimiento de videos.

Evergent está mostrando su plataforma de gestión del ciclo de vida del usuario en Azure. Como proveedor líder de ingresos y soluciones de gestión del ciclo de vida del cliente, Evergent aprovecha la IA de Azure para permitir que los proveedores de servicios de entretenimiento premium mejoren la adquisición y retención de clientes al generar paquetes y ofertas específicos en puntos críticos del ciclo de vida del cliente.

Haivision mostrará su servicio inteligente de enrutamiento de medios en la nube, SRT Hub, que ayuda a los clientes a transformar los flujos de trabajo de principio a fin comenzando con la ingesta usando

Azure Data Box Edge y la transformación del flujo de trabajo de medios usando Hublets de Avid, Telestream, Wowza y Cinegy, y Make.tv .

SES ha desarrollado un conjunto de servicios de medios de difusión en Azure para sus clientes de servicios de medios administrados y conectividad satelital. SES mostrará soluciones para servicios de reproducción totalmente administrados, que incluyen reproducción maestra, reproducción localizada y detección y reemplazo de anuncios, y codificación en vivo multicanal de alta calidad 24x7 en Azure.

SyncWords está haciendo que su tecnología de automatización de subtítulos y herramientas fáciles de usar basadas en la nube estén disponibles en Azure. Estas ofertas facilitarán que las organizaciones de medios agreguen subtítulos automáticos y capacidades de subtitulación de idiomas extranjeros a sus flujos de trabajo de procesamiento de video en tiempo real y sin conexión en Azure.

La empresa global de servicios de diseño y tecnología

Tata Elxsi ha integrado TEPlay, su plataforma OTT SaaS, con Azure Media Services para entregar contenido OTT desde la nube. Tata Elxsi también trajo FalconEye, su solución de monitoreo de calidad de experiencia (QoE) que se enfoca en métricas y análisis procesables, a Microsoft Azure.

Verizon Media está haciendo que su plataforma de transmisión esté disponible en versión beta en Azure. Verizon Media Platform es una solución OTT administrada de nivel empresarial que incluye DRM, inserción de anuncios, sesiones personalizadas individuales, reemplazo de contenido dinámico y entrega de video. La integración ofrece flujos de trabajo simplificados, soporte y escala global, y acceso a una gama de capacidades únicas disponibles en Azure.