Cuando desarrollan una infraestructura de red, generalmente consideran la informática local o la informática en la nube. Pero estas dos opciones y sus combinaciones son pocas. Por ejemplo, ¿qué debo hacer si no puedo rechazar la computación en la nube, pero no tengo suficiente ancho de banda o el tráfico es demasiado caro?

Agregue un enlace intermedio que realizará parte de los cálculos en el límite de la red local o el proceso de producción. Este concepto periférico se llama Edge Computing. El concepto complementa el modelo actual de uso de datos en la nube, y en este artículo consideraremos el equipo necesario y ejemplos de tareas para ello.

Niveles de computación de borde

Suponga que tiene un montón de sensores instalados en su hogar: un termómetro, un higrómetro, un sensor de luz, fugas y más. El controlador lógico procesa la información recibida de ellos, implementa escenarios de automatización, emite telemetría procesada al servicio en la nube y recibe scripts de automatización actualizados y firmware nuevo. Por lo tanto, los cálculos locales se realizan directamente en la instalación, pero el equipo se controla desde un nodo que combina muchos de estos dispositivos.

Este es un ejemplo de un sistema muy simple de computación de límites, pero los tres niveles de computación de borde ya son visibles en él:

- Dispositivos IoT: generan "datos en bruto" y los transmiten a través de varios protocolos.

- Nodos periféricos: procesan datos en las inmediaciones de fuentes de información y actúan como almacenes de datos temporales.

- Servicios en la nube: ofrecen funciones de gestión para dispositivos periféricos e IoT, realizan análisis y almacenamiento de datos a largo plazo. Además, admiten la integración con otros sistemas empresariales.

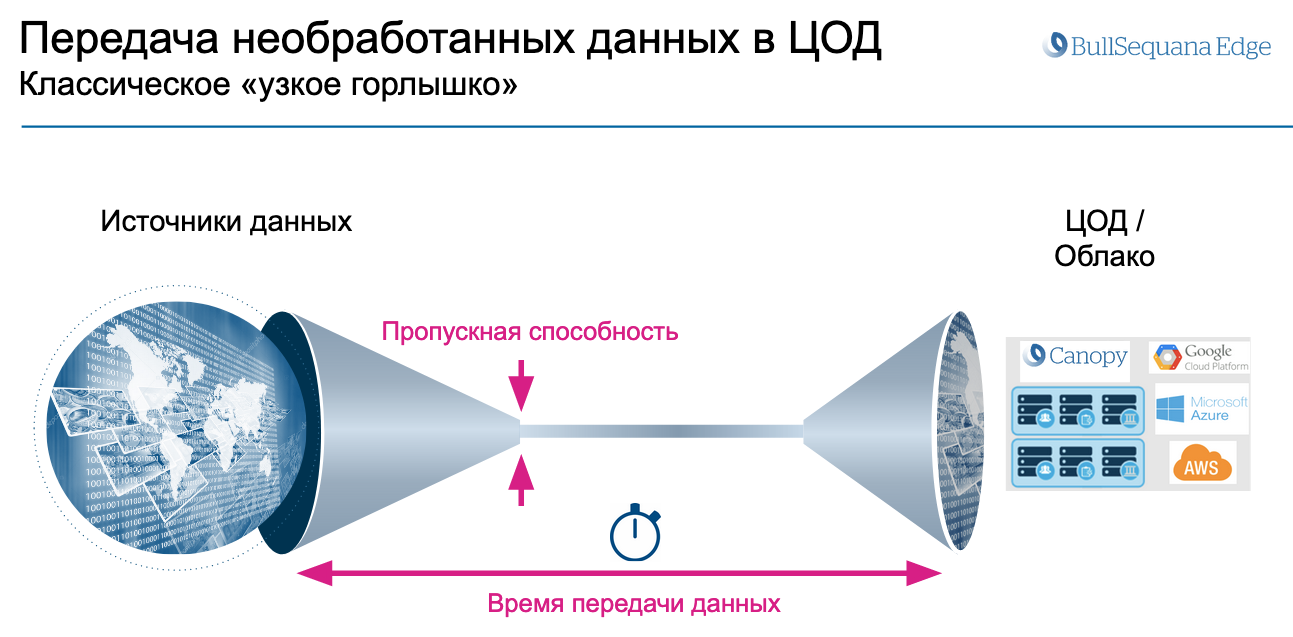

El concepto de computación Edge en sí mismo es parte de un gran ecosistema de optimización de procesos. Incluye tanto hardware (servidores rack y edge) como partes de red y software (por ejemplo, la plataforma

Codex AI Suite para desarrollar algoritmos de AI). Dado que el "cuello de botella" se puede formar durante la creación, transferencia y procesamiento de "big data" y limitar el rendimiento de todo el sistema, estas partes deben ser compatibles entre sí.

Características del servidor perimetral

A nivel de nodo periférico, Edge Computing utiliza servidores perimetrales, que se instalan directamente donde se produce la información. Por lo general, se trata de salas de producción o técnicas en las que no puede instalar un rack de servidores y garantizar la limpieza. Por lo tanto, los servidores de límites se ejecutan en recintos compactos a prueba de polvo y humedad con un rango de temperatura extendido; no se pueden montar en rack. Sí, dicho servidor puede colgar fácilmente en anclajes de

cinta adhesiva de

doble cara en algún lugar debajo de las escaleras o en la habitación trasera.

Dado que los servidores perimetrales se ubican fuera de los centros de datos seguros, tienen mayores requisitos de seguridad física. Se proporcionan contenedores protectores para ellos:

Al nivel de trabajar con datos en los servidores de límites, se proporcionan cifrado de disco y carga segura. El cifrado en sí ocupa del 2% al 3% de la potencia de procesamiento, pero los servidores perimetrales suelen utilizar procesadores Xeon D con un módulo de aceleración AES integrado que minimiza la pérdida de energía.

Cuando se usan servidores perimetrales

Con Edge Computing, solo los datos que son imposibles o procesados de manera irracional se envían al centro de datos para su procesamiento. Por lo tanto, los servidores perimetrales se usan cuando es necesario:

- Un enfoque flexible para la seguridad, ya que en el caso de Edge Computing, puede configurar la transferencia al centro de datos central de información preprocesada y preparada;

- Protección contra la pérdida de información, ya que en caso de pérdida de comunicación con el centro, los nodos locales acumularán información;

- Ahorrando en tráfico, se logra procesando la mayor parte de la información en el lugar.

Edge computing para ahorrar tráfico

La compañía danesa Maersk, uno de los principales transportistas de carga del mundo, ha decidido reducir el consumo de combustible de sus embarcaciones y reducir la contaminación del aire.

Para resolver este problema, se utilizó la tecnología

Siemens EcoMain Suite , sensores en los motores y componentes principales del barco, así como un servidor local BullSequana Edge para la computación en el sitio.

Gracias a los sensores, el sistema EcoMain Suite monitorea constantemente el estado de los nodos críticos del barco y su desviación de la norma previamente calculada. Esto le permite diagnosticar rápidamente una falla y localizarla en el nodo del problema. Dado que la telemetría se transmite constantemente "al centro", el técnico de servicio puede realizar el análisis de forma remota y hacer recomendaciones a la tripulación a bordo. Y la pregunta principal aquí es cuántos datos y cuánto transmitir al centro de datos central.

Dado que conectar un Internet por cable barato a un barco de contenedores marítimos es muy problemático, transferir una gran cantidad de datos en bruto a un servidor central es demasiado costoso. En el servidor central del BullSequana S200, se calcula el modelo lógico general del barco, y el procesamiento de datos y el control directo se transfieren al servidor local. Como resultado, la implementación de este sistema valió la pena en tres meses.

Edge computing para ahorrar recursos

Otro ejemplo de computación límite es la analítica de video. Por lo tanto, una de las tareas locales del ciclo de producción en el fabricante de equipos para gases técnicos Air Liquide es el control de calidad de pintar cilindros de gas. Se realizó manualmente y fue de aproximadamente 7 minutos por cilindro.

Para acelerar este proceso, la persona fue reemplazada por un bloque de 7 cámaras de alta resolución. Las cámaras toman el globo desde varios lados, generando aproximadamente 1 GB de video por minuto. El video se envía al servidor fronterizo BullSequana Edge con Nvidia T4 a bordo, en el que la red neuronal, capacitada para buscar defectos, analiza la transmisión en línea. Como resultado, el tiempo de inspección promedio se redujo de unos pocos minutos a unos pocos segundos.

Edge computing en analítica

Las atracciones de Disneyland no solo son divertidas, sino también un objeto técnico complejo. Entonces, en la "Montaña Rusa" se instalaron unos 800 sensores diferentes. Envían constantemente datos sobre el funcionamiento de la atracción al servidor, y el servidor local procesa estos datos, calcula la probabilidad de que la atracción falle y lo envía al centro de datos central.

En base a estos datos, se determina la probabilidad de una falla técnica y se inicia la reparación preventiva. La atracción continúa funcionando hasta el final de la jornada laboral, y mientras tanto, ya se ha emitido una orden de reparación, y los trabajadores reparan rápidamente la atracción por la noche.

BullSequana Edge

Los servidores BullSequana Edge son parte de una gran infraestructura para trabajar con "big data", ya están probados con Microsoft Azure y Siemens MindSphere, VMware WSX y tienen certificados NVidia NGC / EGX. Estos servidores están diseñados específicamente para la computación límite y están disponibles en gabinetes de factor de forma U2 para su instalación en un rack estándar, en un riel DIN, en una pared y en una versión montada en el piso.

BullSequana Edge está construido sobre una placa base patentada y un procesador Intel Xeon D-2187NT. Admiten la instalación de hasta 512 GB de RAM, 2 SSD de 960 GB o 2 HDD de 8 o 14 TB. También en ellos puedes instalar 2 GPU Nvidia T4 de 16 GB para trabajar con video; Wi-fi, LoRaWAN y módulos 4G; hasta 2 módulos SFP de 10 gigabits. En los propios servidores, ya está instalado un sensor de tapa abierta, que está conectado al BMC, que controla el módulo IPMI. Se puede configurar para apagar automáticamente la alimentación cuando se activa el sensor.

Las especificaciones técnicas completas de los servidores BullSequana Edge se pueden encontrar

aquí . Si está interesado en los detalles, estaremos encantados de responder nuestras preguntas en los comentarios.