El aprendizaje automático y las redes neuronales profundas son capaces de reconocer y analizar el "lenguaje de comportamiento" de los animales en formas que están más allá de las capacidades humanas.

Para rastrear los movimientos de los animales en el entorno natural, los científicos recurren cada vez más a los métodos de aprendizaje automático (MO). En este video, el algoritmo DeepPoseKit rastrea el movimiento y la orientación de una langosta del desierto en un espacio confinado para proporcionar a los investigadores datos sobre el comportamiento conjunto de los insectos.

Para rastrear los movimientos de los animales en el entorno natural, los científicos recurren cada vez más a los métodos de aprendizaje automático (MO). En este video, el algoritmo DeepPoseKit rastrea el movimiento y la orientación de una langosta del desierto en un espacio confinado para proporcionar a los investigadores datos sobre el comportamiento conjunto de los insectos.En un intento por comprender lo que está sucediendo en las cabezas de los animales, los neurocientíficos fueron enviados de maneras inesperadas: desde espiar directamente en el cerebro vivo hasta controlar las neuronas usando destellos de luz, creando dispositivos complejos y entornos virtuales.

En 2013, esto llevó al neurocientífico

Bob Dattu, junto con colegas de la Escuela de Medicina de Harvard, al supermercado Best Buy, ubicado en la misma calle que su laboratorio.

En la tienda de electrónica de consumo, encontraron lo que estaban buscando: Xbox Kinect, un dispositivo de juego que detecta los movimientos de los jugadores. Los científicos tuvieron que observar los detalles más pequeños de los movimientos de los ratones que estudiaron, pero ninguna de las tecnologías de laboratorio tradicionales podía manejarlo. Por lo tanto, el grupo de Datta recurrió al juguete para usar su información tridimensional sobre los movimientos de los cuerpos de los animales para estudiar su comportamiento en el medio ambiente. El dispositivo, de hecho, les dio una nube de puntos en el espacio tridimensional, y el equipo luego analizó los movimientos rítmicos de estos puntos.

La decisión de Datta puede haber sido poco ortodoxa para su época, pero se ha convertido en un símbolo de la ola actual de enfoque automático que transforma la ciencia del comportamiento. Al estudiar el comportamiento de los animales de manera más exhaustiva y cuantitativa, los investigadores esperan comprender mejor los estados internos no observables responsables de ello. "No sabemos en qué condiciones potenciales puede estar el animal", escribió

Adam Calhoun , un postdoctorado que estudia el comportamiento animal en la Universidad de Princeton.

Otro obstáculo surge cuando se trata de comparar estos estados internos de una actividad específica en los complejos circuitos neuronales del cerebro. Aunque los instrumentos sofisticados pueden registrar el trabajo de miles de neuronas al mismo tiempo, "no entendemos la salida del cerebro", dijo Dutta. "Para comprender esta densa codificación neural, necesita acceso a una comprensión más amplia del comportamiento".

Esta vasta comprensión puede sucumbir pronto a nuestros intentos de comprenderla. Basado en el éxito del aprendizaje automático, los científicos están creando algoritmos que rastrean automáticamente los movimientos de los animales hasta pequeños cambios en el ángulo de las alas de una mosca o doblando la parte posterior de un mouse. También crean herramientas que pueden encontrar patrones al analizar y clasificar automáticamente estos datos para obtener pistas sobre las condiciones internas de los animales.

La ventaja clave de estos métodos es que pueden buscar patrones invisibles para las personas. En un

artículo publicado el mes pasado en la revista Nature Neuroscience, Calhoun, junto con los neurocientíficos de Princeton

Malaya Murty y

Jonathan Pillow , crearon un modelo de aprendizaje automático que utiliza solo observaciones de comportamiento para determinar los tres estados internos que determinan los hábitos de apareamiento de las moscas de la fruta. Al manipular la actividad cerebral de las moscas, los investigadores pudieron determinar el conjunto de neuronas que controlaban estas afecciones.

El trabajo sobre el seguimiento del movimiento y el análisis del comportamiento que hizo posible estos descubrimientos representa una revolución tecnológica en el estudio del comportamiento. También se deduce que este es el primero de muchos éxitos futuros. Los científicos ahora usan estos métodos para encontrar respuestas a preguntas en neurobiología, genética, evolución y medicina, que hasta ahora parecían insolubles.

Registros y directorios

Durante décadas, los científicos han cuantificado el comportamiento de los animales en laboratorios y en el entorno natural, armados con un bolígrafo, papel y un cronómetro. Vieron a sus sujetos experimentales dormir, jugar, adquirir comida y aparearse. Evaluaron las observaciones, bosquejaron patrones de patrones, idearon plataformas organizacionales para sistematizar y explicar estas tendencias. Los biólogos Nikolaas Tinbergen, Konrad Lorenz y Karl von Frisch recibieron el

Premio Nobel de 1973 por realizar de forma independiente experimentos similares con peces, pájaros e insectos.

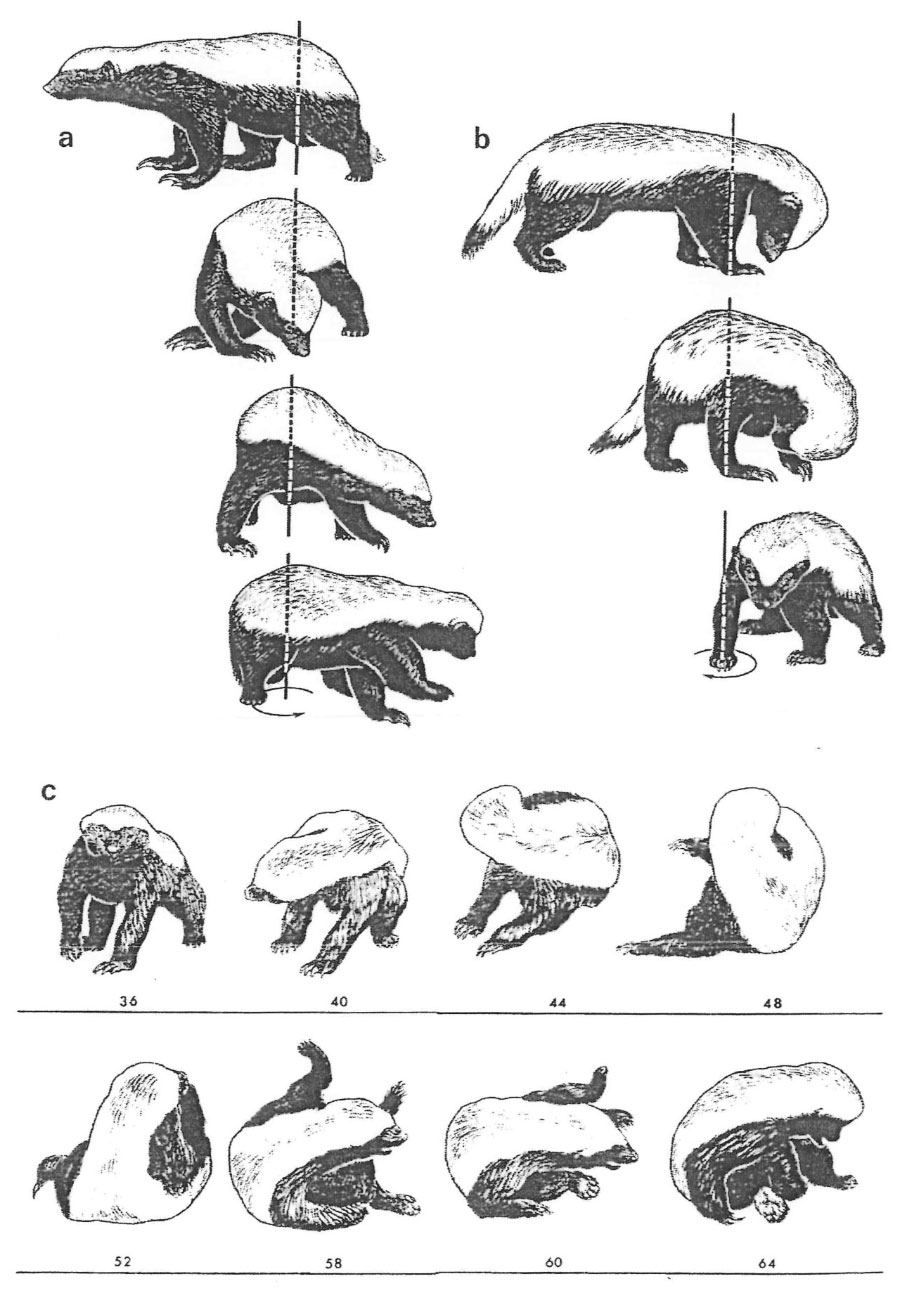

El zoólogo Ilan Golani bosquejó manualmente el movimiento y el comportamiento de varias especies para describir cuantitativamente las reglas que rigen el comportamiento de los animales. Estas figuras muestran la rotación de todo el cuerpo por el tejón de miel.

El zoólogo Ilan Golani bosquejó manualmente el movimiento y el comportamiento de varias especies para describir cuantitativamente las reglas que rigen el comportamiento de los animales. Estas figuras muestran la rotación de todo el cuerpo por el tejón de miel.Tales catálogos de comportamiento pueden ser

extremadamente detallados . En una descripción de 1973 de lavar un ratón, Nature describió el "movimiento quisquilloso de las patas delanteras debajo del hocico" y los "movimientos amplios, sincrónicos pero asimétricos de las patas delanteras por encima de la cabeza", y evaluó la probabilidad de tales gestos en diferentes situaciones. Los investigadores necesitaban describir todo con tanto detalle, porque no sabían qué aspecto del comportamiento observado podría ser importante.

Algunos científicos abordaron este asunto desde el lado opuesto, limitando al mínimo la variedad del comportamiento de los animales, colocándolos en condiciones controladas de laboratorio y permitiéndoles tomar solo las decisiones más simples con dos opciones, como elegir el giro a la derecha o izquierda en el laberinto. Tales simplificaciones a veces han sido útiles e informativas, pero las restricciones artificiales también desacreditan la comprensión de los científicos sobre el comportamiento natural y pueden conducir a la pérdida de señales importantes. "La necesidad de comprender el comportamiento limita perfectamente el alcance de estos estudios", dijo

Ann Kennedy , una estudiante postdoctoral en neurociencia teórica en el Instituto de Tecnología de California.

Por lo tanto, los científicos decidieron renovar esta área, "cambiando su pensamiento hacia un enfoque cuantitativo", dijo

Talmo Pereira , un estudiante graduado en los laboratorios de Princeton en Merti y

Joshua Shevitz . Y un paso importante en este cambio fue la automatización de la recopilación y el análisis de datos.

Seguir el hocico, la columna vertebral y la cola

La tecnología de captura de imágenes siempre ha sido importante para rastrear las posturas de los animales en movimiento. En el siglo XIX,

Edward Maybridge utilizó la crono-fotografía para analizar la mecánica de la carrera de caballos y el baile de las personas. Las fotografías facilitaron el análisis de la posición de, por ejemplo, las extremidades o la cabeza del animal, e hicieron que este proceso fuera más preciso. Con el advenimiento de la tecnología de grabación de video, los investigadores pudieron hacer mediciones más precisas; sin embargo, todavía tenían que basarse en estimaciones aproximadas de la velocidad o la posición del animal. El seguimiento de cada movimiento en tres dimensiones era imposible. Y aún así, se tuvo que hacer mucho trabajo para catalogar manualmente todas las notas para el video e ingresarlas en la computadora; este proceso no ha mejorado mucho en comparación con el método anterior de dibujar en los cuadernos.

Edward Maybridge usó fotografías de lapso de tiempo para estudiar la marcha de un caballo y otros animales en movimiento. Su cámara podría capturar y capturar detalles inaccesibles para el ojo humano.

Edward Maybridge usó fotografías de lapso de tiempo para estudiar la marcha de un caballo y otros animales en movimiento. Su cámara podría capturar y capturar detalles inaccesibles para el ojo humano.En la década de 1980, los investigadores comenzaron a adaptar los algoritmos de visión por computadora para sus propósitos, que ya se usaban para buscar rostros y contornos en las imágenes, para resolver problemas como el seguimiento de los contornos de las moscas en la superficie. En las siguientes décadas, se desarrollaron sistemas que señalaron la ubicación del animal en cada cuadro del video, encontraron un animal específico en un grupo de varios e incluso comenzaron a

determinar ciertas partes del cuerpo y su orientación.

Sin embargo, la efectividad de estos programas dejó mucho que desear. "Entre ellos había indicios de lo que podría suceder en el futuro", dijo

Ian Cousin , director del Instituto para el Estudio del Comportamiento Animal que lleva su nombre. Max Planck en Alemania. "Sin embargo, los programas realmente complejos solo pudieron aparecer recientemente, gracias al desarrollo del aprendizaje profundo".

Utilizando el aprendizaje profundo (GO), los investigadores comenzaron a entrenar redes neuronales para rastrear la posición de las articulaciones y grandes partes del cuerpo de casi cualquier animal (insectos, ratones, murciélagos, peces) en cada cuadro del video. Solo es necesario hacer algunos marcos etiquetados (diez fueron suficientes para algunos algoritmos). Como resultado, el programa dibuja puntos de colores en la parte superior del cuerpo del animal, determinando la posición de su nariz, cola, orejas, piernas, pies, alas, columna vertebral, etc.

En los últimos años, el número de programas que pueden hacer esto ha aumentado dramáticamente, gracias no solo al progreso en el aprendizaje automático, sino también al trabajo paralelo de marcar movimientos humanos con cineastas, animadores y expertos en la industria de los juegos.

Los nuevos métodos pueden rastrear las posturas de varios animales durante su interacción. El video muestra cómo el algoritmo SLEAP marca y rastrea automáticamente partes de los cuerpos de un par de moscas durante el cortejo (izquierda) y dos ratones que estudian el medio ambiente.Por supuesto, si el movimiento se registra para las necesidades de Hollywood o Silicon Valley, es fácil para las personas usar trajes especiales que están colgados con marcadores, que el sistema puede seguir fácilmente. Estos datos pueden usarse para construir modelos detallados de posturas y movimientos. Sin embargo, la opción de vestuario no es adecuada para el estudio de animales.

Hace cinco años, Jonathan Whitlock, neurocientífico de la Universidad Noruega de Ciencia y Tecnología, comenzó a buscar activamente otra forma de rastrear los ratones que estudió. Intentó todo lo que se le ocurrió: él y sus colegas afeitaron ratones y los marcaron con tinta que reflejaba la luz infrarroja. Aplicaron una suspensión de cuentas de vidrio en la espalda de los animales, que a menudo se usa en las marcas reflectantes de las carreteras. Pintaron juntas de animales con tinta luminosa y barniz. Intentaron muchas cosas, pero no funcionó como deberían: a veces los marcadores no eran lo suficientemente brillantes como para rastrear, a veces molestaban a los ratones e interrumpían su comportamiento.

Como resultado, el equipo de Whitlock decidió colocar pequeños trozos de cinta reflectante en tres puntos en la parte posterior del animal para recrear los movimientos de la columna y ponerse un pequeño casco con cuatro trozos adicionales de cinta para rastrear los movimientos de la cabeza. "Incluso eso fue suficiente para abrirnos un mundo completamente nuevo", dijo Whitlock.

www.youtube.com/watch?v=3RaHuybwtFI&feature=youtu.beAl activar ciertas neuronas en la mosca, los investigadores la obligaron a retroceder a lo largo de un carrusel esférico. El método de aprendizaje profundo midió el cambio en los ángulos en las articulaciones de las patas de una mosca y mostró el movimiento de las piernas, el abdomen y las antenas en un espacio tridimensional.

Pero muchos investigadores querían deshacerse de todo tipo de marcadores y rastrear más de siete puntos en el cuerpo de los animales. Al combinar las ideas de trabajos anteriores con animales y humanos, varios laboratorios han creado sistemas fáciles de usar que se usan ampliamente en la actualidad.

El primero de estos sistemas funcionó el año pasado.

DeepLabCut fue desarrollado por los neurocientíficos de Harvard

Mackenzie Matis y

Alexander Matis , habiendo rehecho para esto una red neuronal entrenada para clasificar miles de objetos. Pronto, otros proyectos aparecieron rápidamente:

LEAP (Leap Estimates Animal Pose), desarrollado por Pereira y otros en los laboratorios de Murty y Shevits; SLEAP, la próxima versión del mismo equipo, que rastrea la posición de las partes del cuerpo de varios animales que interactúan;

DeepPoseKit de Kozin, publicado hace unos meses.

"Ella puede aprender muy rápido", describe Morty el sistema LEAP. "En 10-15 minutos, puedes entrenarla para que trabaje automáticamente con todos los videos". Otros grupos están trabajando en modelos de poses en un espacio tridimensional en lugar de bidimensional, calibrando los mismos modelos con múltiples cámaras.

"En el interior, estas tecnologías pueden ser increíblemente complejas", dijo Kuzin, "pero hasta ahora son sorprendentemente fáciles de aplicar a una amplia gama de tareas, desde el seguimiento de los movimientos de los bigotes del ratón hasta el comportamiento de una hormiga o la formación de bancos de peces".

Whitlock descubrió que en los ratones que estudió, ciertos movimientos y posiciones estaban codificados en partes de la corteza, que participa en movimientos coordinados y, posiblemente, en otras actividades. "Estas áreas del cerebro son muy activas en cómo el animal sostiene su cabeza", dijo. "Simplemente no tomamos este aspecto del procesamiento de información en la corteza antes", porque los investigadores no pudieron rastrear los movimientos de los animales que se mueven libremente.

Representando esquemáticamente la postura del animal, el algoritmo ayuda a comprender mejor su comportamiento. De hecho, todos los aspectos mensurables del comportamiento son "cambios en la postura con el tiempo", dijo Whitlock. "Y aprendimos a leer la pose".

Debido a que el software de seguimiento de la postura facilitó la recopilación de datos, "ahora podemos cambiar a otras tareas", dijo

Benjamin de Beavort , biólogo conductual de la Universidad de Harvard. Por ejemplo: ¿cómo definir los componentes básicos del comportamiento y cómo interpretarlos?

Lenguaje oculto

Los intentos de responder a estas preguntas durante mucho tiempo dependieron de la intuición del observador, de la "percepción impecable", como bromean los

etólogos (expertos en comportamiento animal). Sin embargo, la intuición está sujeta a prejuicios, problemas de reproducibilidad y dificultades para generalizar.

La

zoóloga Ilyan Golani, de la Universidad de Tel Aviv, ha pasado la mayor parte de las últimas seis décadas buscando una forma menos aleatoria de describir y analizar el comportamiento, que utilizaría unidades fundamentales de comportamiento, algo así como átomos en química. No quería describir el comportamiento como "cortejo" o "alimentación". Quería que esta caracterización apareciera naturalmente, a partir de un conjunto general de reglas derivadas de la anatomía animal. Golani tiene su propio modelo de cómo deberían verse estas unidades y reglas, pero cree que esta área aún está lejos de llegar a un consenso al respecto.

Otros investigadores, por el contrario, confían en que MO y GO tienen más probabilidades de llevar a esta área al consenso. Pero DeepLabCut, LEAP y otros algoritmos avanzados de seguimiento de la postura dependen de la capacitación de los maestros: están capacitados para reconocer partes del cuerpo en función de datos etiquetados manualmente. Los científicos esperan encontrar y analizar los componentes básicos del comportamiento a través del aprendizaje sin un maestro. Tal enfoque, tal vez, podrá revelar independientemente la estructura de comportamiento invisible para nosotros, de modo que las personas no tengan que imponer cada paso siguiente en el sistema, introduciendo errores resultantes de sesgos ocultos.

Un ejemplo interesante de este enfoque apareció en 2008, cuando los investigadores identificaron cuatro unidades básicas de movimiento de gusanos que se pueden combinar, recibiendo casi todos los movimientos disponibles para este animal. Esta representación compacta, llamada "eigenworm" [de "eigen", es decir "Propio" / aprox. transl.], ofrece un método cuantitativo para evaluar la dinámica del comportamiento.

El algoritmo de secuenciación de movimiento creado en el laboratorio de Bob Dutta en la Facultad de medicina de Harvard define pequeñas unidades, o "sílabas", en la dinámica conductual de los ratones. Los científicos sugieren que el comportamiento de los ratones consiste en tales sílabas, que se siguen de acuerdo con ciertas reglas "gramaticales".

El video muestra seis ejemplos de tales unidades de comportamiento ("inclinarse y sacudirse", "correr hacia adelante", "lavar", "arrugar la cara", "agresión", "intentar escapar"). Cada uno de ellos se basa en rastrear diferentes ratones; Los puntos que aparecen indican el mismo comportamiento simple.

Datta llevó este enfoque a un nivel completamente nuevo en 2013, adoptando un truco de Xbox Kinect, y rápidamente logró el éxito con él. Cuando él y sus colegas observaron los datos recopilados que describen los movimientos de los ratones, se sorprendieron de lo rápido que pudieron ver la estructura en ellos. La dinámica del comportamiento tridimensional de los animales se descompone naturalmente en pequeños segmentos, con una duración promedio de aproximadamente 300 ms. “Y son solo datos. Te estoy mostrando los datos en bruto ", dijo Datta. "Esto es solo una propiedad fundamental del comportamiento del mouse".

Decidió que estos segmentos eran muy similares a cómo las unidades de comportamiento deberían verse como sílabas compuestas juntas por un conjunto de reglas o gramática. Él y el equipo crearon una red neuronal profunda que define estas sílabas. Estaba buscando una manera de dividir la actividad del animal en segmentos para que pudieran ser la mejor manera de predecir el comportamiento futuro. Este algoritmo, llamado Secuencia de movimiento (MoSeq), produjo "sílabas", que los investigadores luego dieron nombres como "correr hacia adelante" o "agacharse y sacudirse" o "intentar escapar". En un experimento típico, el ratón usó 40-50 de esas sílabas, y solo unas pocas correspondieron a lo que la gente tenía un nombre."Su algoritmo puede aislar el comportamiento para el cual ni siquiera tenemos un nombre", dijo Whitlock.Los investigadores ahora están tratando de determinar la importancia biológica o ambiental de estos comportamientos no vistos previamente. Estudian cómo estos elementos de comportamiento difieren entre los diferentes individuos, sexos o especies, cómo comienzan a descomponerse con la edad o como resultado de una enfermedad, cómo se producen durante el entrenamiento o durante la evolución. Utilizan esta clasificación automática para estudiar cómo las diferentes mutaciones en los genes y la medicación afectan el comportamiento, y para describir las interacciones sociales.Y ya están comenzando a hacer las primeras conexiones con el cerebro y sus estados internos.

Predecir afecciones y comportamientos cerebrales

Datta y sus colegas descubrieron que en el cuerpo estriado , el área del cerebro responsable de planificar las habilidades motoras y otras funciones, se activan diferentes conjuntos de neuronas para activar las diversas "sílabas" de comportamiento encontradas por el programa MoSeq. Por lo tanto, "sabemos que esta gramática está directamente controlada por el cerebro", dijo Datta. "Esto no es solo un epifenómeno , es un fenómeno real controlado por el cerebro".Curiosamente, la representación neuronal de una sílaba particular no siempre fue la misma. Cambió, reflejando la secuencia en la que se encontraba esta sílaba. Al estudiar la actividad de las neuronas, Dutta podría determinar si una sílaba particular era parte de una secuencia fija o variable. "Al más alto nivel", dijo, "esto sugiere que el cuerpo estriado no solo codifica el comportamiento deseado". También proporciona información sobre su contexto ".Además apoyó esta hipótesis al verificar lo que sucedería cuando el cuerpo estriado dejara de funcionar correctamente. Las sílabas se mantuvieron igual, pero la gramática se rompió, la secuencia de acciones se volvió más aleatoria y menos adaptativa.Otros investigadores observan lo que sucede en el cerebro durante períodos de tiempo más largos. Gordon BermanEl biofísico de la Universidad de Emory utiliza Motion Mapper, una técnica de análisis sin maestros, para modelar el comportamiento. Este modelo, que tiene elementos de comportamiento en una determinada jerarquía, puede predecir la actividad neuronal jerárquica del cerebro, como se mostró en un artículo publicado por un equipo de investigadores de la Universidad de Viena. Berman dice que el "objetivo inspirador" de estos estudios es utilizar algún día el Motion Mapper para predecir la interacción social de los animales.Y ahí está Murty con su equipo, y su búsqueda de estados internos ocultos. Ya han creado un modelo que utiliza medidas de movimiento de la mosca para predecir cómo y cuándo una mosca macho comenzará a cantar. Descubrieron que, por ejemplo, con una disminución en la distancia entre el hombre y la mujer, aumentaba la probabilidad de que el hombre lanzara una canción de cierto tipo.En un artículo reciente publicado en Nature Neuroscience, los científicos ampliaron este modelo para incluir posibles estados internos ocultos de las moscas macho que podrían mejorar la calidad de las predicciones sobre las canciones que emitirá el macho. El equipo descubrió tres condiciones que llamaron "intimidad", "persecución" e "indiferencia". Al activar varias neuronas y estudiar los resultados de esto con la ayuda de un modelo, descubrieron que el conjunto de neuronas, que, como se pensaba anteriormente, controla la entrega de canciones, en realidad controla el estado de la mosca. "Esta es una interpretación diferente de las tareas de las neuronas que realizan como parte del control del comportamiento de las moscas", dijo Murty.Ahora están desarrollando sus conocimientos con SLEAP. "Será muy interesante ver qué estados ocultos este modelo ayudará a abrir cuando incluyamos el seguimiento de poses de mayor resolución", dijo Pereira.Los científicos señalan con precaución que estas técnicas deberían mejorar y complementar la investigación conductual tradicional, y no reemplazarlas por completo. También están de acuerdo en que se debe hacer mucho trabajo antes de comenzar a descubrir los principios universales clave del comportamiento. Por ejemplo, se necesitarán modelos adicionales de aprendizaje automático para asociar datos de comportamiento con otros tipos complejos de información."Este es esencialmente el primer paso para investigar este problema", dijo Datta. No tiene dudas de que "algún tipo encontrará una forma mucho mejor de hacer esto". Y, sin embargo, “la ventaja de este enfoque es que nos alejamos de la práctica de los etólogos, cuando las personas discutían entre sí hasta gritar, hasta la ronquera, sobre la descripción de la conducta que es mejor. Ahora tenemos una medida "."Llegamos al punto en que los métodos pueden seguir nuestras preguntas", dijo Murty. "Acabamos de desbloquear este camino". Y eliminó todas las restricciones. La gente puede hacer lo que quiera ".