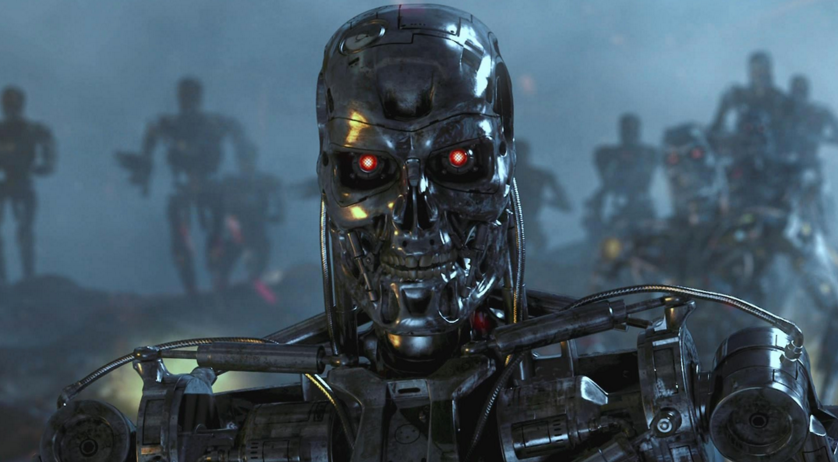

ما يمكن أن يكون أسلحة ذاتية خطرة

كموظف سابق في البنتاغون شارك في تطوير استراتيجية استخدام الأسلحة المستقلة ، يشير إلى أنه في الظروف الحقيقية يمكن أن يكون غير قابل للسيطرة وهناك إمكانية القرصنة والاستبدال والتلاعب من قبل العدو.في الآونة الأخيرة ، أصبحت أجهزة الاستشعار غير المكلفة وتقنيات الذكاء الاصطناعي الجديدة أكثر عملية ، مما جعل من الممكن استخدامها في تطوير أنظمة الأسلحة المستقلة. أثار شبح ما يسمى بـ "الروبوتات القاتلة" بالفعل حركة دولية من الاحتجاجات والمناقشات في الأمم المتحدة للحد من تطوير وتنفيذ هذه الأنظمة ، حسب التقارير nytimes.com.كتب هذا التقرير بول شيري ، الذي يدير برنامج حرب المستقبل في مركز الأمن الأمريكي الجديد (واشنطن ، كولومبيا). من عام 2008 إلى 2013 ، عملت شيري في مكتب وزير الدفاع الأمريكي ، حيث ساعد في تطوير استراتيجية لاستخدام الأسلحة المستقلة. في عام 2012 ، أصبح أحد مؤلفي توجيهات وزارة الدفاع ، التي وضعت سياسة عسكرية بشأن استخدام هذه الأنظمة.في تقرير بعنوان "الأسلحة المستقلة والمخاطر التشغيلية" ، الذي نشر يوم الاثنين ، تحذر شيري من عدد من المخاطر الحقيقية المرتبطة بأنظمة الأسلحة المستقلة تمامًا. وهو يقارن الأنظمة المؤتمتة بالكامل التي يمكن أن تقتل دون تدخل بشري للأسلحة التي "تبقي الناس على اطلاع" في عملية اختيار الهدف وضربه (أي استخدام عامل).تركز شيري ، التي خدمت في الجيش الأمريكي كحارس وشارك في العمليات في العراق وأفغانستان ، على الأنواع المحتملة من الأخطاء التي يمكن أن تحدث في أنظمة مؤتمتة بالكامل. لتسليط الضوء على الآثار العسكرية ، يسرد التقرير الفشل الذي حدث في الجيش والأنظمة التجارية بدرجة عالية من الأتمتة.كتب شيري: "أي شخص تخلى عن الدعم الهاتفي الآلي لخط المساعدة ، وساعة منبه تم ضبطها عن طريق الخطأ على" المساء "بدلاً من" الصباح "وما إلى ذلك ، واجه مشكلة" الهشاشة "الموجودة في الأنظمة الآلية".أساس تقريره هو أن أنظمة الأسلحة المستقلة تفتقر إلى "المرونة" ، أي في عملية تنفيذ مثل هذه المهام النظام يمكن أن تحدث أخطاء يمكن تجنبها.تبدأ الأسلحة المستقلة بالكامل في الظهور في الترسانات العسكرية لدول مختلفة. على سبيل المثال ، قامت كوريا الجنوبية بتركيب برج أوتوماتيكي على طول المنطقة منزوعة السلاح مع كوريا الشمالية ، وفي إسرائيل هناك طائرة جوية بدون طيار في الخدمة ، مبرمجة لمهاجمة أنظمة رادار العدو عند اكتشافها.لا يستخدم الجيش الأمريكي أسلحة ذاتية الحكم. ومع ذلك ، طلبت وزارة الدفاع هذا العام ما يقرب من مليار دولار لإنتاج أسلحة بواسطة صواريخ لوكهيد مارتن طويلة المدى المضادة للسفن ، والتي توصف بأنها "شبه مستقلة". على الرغم من أن العامل سيختار الهدف أولاً ، ولكن الاتصال الخارجي بالشخص ، فإنه سيحدد ويهاجم قوات العدو تلقائيًا.ينصب التركيز على عدد من المفاجآت في سلوك أنظمة الكمبيوتر ، مثل الأعطال والأخطاء ، بالإضافة إلى التفاعلات غير المتوقعة مع البيئة."خلال اختبارهم الأول فوق المحيط الهادئ ، فشل نظام الكمبيوتر Y2K تمامًا في ثمانية مقاتلات من طراز F-22 أثناء عبورهم لخط التاريخيقول التقرير. "فشلت جميع أنظمة الكمبيوتر الموجودة على متن الطائرة ، وكانت النتيجة كارثية تقريبًا - فقد طائرة. على الرغم من أن وجود خط التاريخ معروف منذ فترة طويلة ، لم يتم اختبار نتيجة التفاعل مع البرنامج بشكل كامل. "كبديل للسلاح المستقل بالكامل ، يدعو التقرير إلى ما يسمى "Centaur Warfighting" (الأسلحة المشتركة؟ بشكل أساسي ، التورية غير القابلة للترجمة. تقريبًا). لقد تم استخدام مصطلح "سنتور" لوصف الأنظمة التي يعمل فيها الأشخاص وأجهزة الكمبيوتر بشكل وثيق. في لعبة الشطرنج ، على سبيل المثال ، تهيمن الفرق التي تستخدم الأشخاص وبرامج الذكاء الاصطناعي على المنافسة ضد الفرق التي تستخدم الذكاء الاصطناعي فقط.ومع ذلك ، في مقابلة هاتفية ، اعترفت شيري أن العامل فقط ، "الضغط على الأزرار" ليس كافياً. وقال "إن مجرد وجود شخص" تم إخطاره "بأفعال الآلة لا يكفي". "إنهم (الأشخاص) لا يمكنهم فقط أن يكونوا جزءًا من خوارزمية تشغيل النظام. يجب على الشخص المشاركة بنشاط في صنع القرار ".

كموظف سابق في البنتاغون شارك في تطوير استراتيجية استخدام الأسلحة المستقلة ، يشير إلى أنه في الظروف الحقيقية يمكن أن يكون غير قابل للسيطرة وهناك إمكانية القرصنة والاستبدال والتلاعب من قبل العدو.في الآونة الأخيرة ، أصبحت أجهزة الاستشعار غير المكلفة وتقنيات الذكاء الاصطناعي الجديدة أكثر عملية ، مما جعل من الممكن استخدامها في تطوير أنظمة الأسلحة المستقلة. أثار شبح ما يسمى بـ "الروبوتات القاتلة" بالفعل حركة دولية من الاحتجاجات والمناقشات في الأمم المتحدة للحد من تطوير وتنفيذ هذه الأنظمة ، حسب التقارير nytimes.com.كتب هذا التقرير بول شيري ، الذي يدير برنامج حرب المستقبل في مركز الأمن الأمريكي الجديد (واشنطن ، كولومبيا). من عام 2008 إلى 2013 ، عملت شيري في مكتب وزير الدفاع الأمريكي ، حيث ساعد في تطوير استراتيجية لاستخدام الأسلحة المستقلة. في عام 2012 ، أصبح أحد مؤلفي توجيهات وزارة الدفاع ، التي وضعت سياسة عسكرية بشأن استخدام هذه الأنظمة.في تقرير بعنوان "الأسلحة المستقلة والمخاطر التشغيلية" ، الذي نشر يوم الاثنين ، تحذر شيري من عدد من المخاطر الحقيقية المرتبطة بأنظمة الأسلحة المستقلة تمامًا. وهو يقارن الأنظمة المؤتمتة بالكامل التي يمكن أن تقتل دون تدخل بشري للأسلحة التي "تبقي الناس على اطلاع" في عملية اختيار الهدف وضربه (أي استخدام عامل).تركز شيري ، التي خدمت في الجيش الأمريكي كحارس وشارك في العمليات في العراق وأفغانستان ، على الأنواع المحتملة من الأخطاء التي يمكن أن تحدث في أنظمة مؤتمتة بالكامل. لتسليط الضوء على الآثار العسكرية ، يسرد التقرير الفشل الذي حدث في الجيش والأنظمة التجارية بدرجة عالية من الأتمتة.كتب شيري: "أي شخص تخلى عن الدعم الهاتفي الآلي لخط المساعدة ، وساعة منبه تم ضبطها عن طريق الخطأ على" المساء "بدلاً من" الصباح "وما إلى ذلك ، واجه مشكلة" الهشاشة "الموجودة في الأنظمة الآلية".أساس تقريره هو أن أنظمة الأسلحة المستقلة تفتقر إلى "المرونة" ، أي في عملية تنفيذ مثل هذه المهام النظام يمكن أن تحدث أخطاء يمكن تجنبها.تبدأ الأسلحة المستقلة بالكامل في الظهور في الترسانات العسكرية لدول مختلفة. على سبيل المثال ، قامت كوريا الجنوبية بتركيب برج أوتوماتيكي على طول المنطقة منزوعة السلاح مع كوريا الشمالية ، وفي إسرائيل هناك طائرة جوية بدون طيار في الخدمة ، مبرمجة لمهاجمة أنظمة رادار العدو عند اكتشافها.لا يستخدم الجيش الأمريكي أسلحة ذاتية الحكم. ومع ذلك ، طلبت وزارة الدفاع هذا العام ما يقرب من مليار دولار لإنتاج أسلحة بواسطة صواريخ لوكهيد مارتن طويلة المدى المضادة للسفن ، والتي توصف بأنها "شبه مستقلة". على الرغم من أن العامل سيختار الهدف أولاً ، ولكن الاتصال الخارجي بالشخص ، فإنه سيحدد ويهاجم قوات العدو تلقائيًا.ينصب التركيز على عدد من المفاجآت في سلوك أنظمة الكمبيوتر ، مثل الأعطال والأخطاء ، بالإضافة إلى التفاعلات غير المتوقعة مع البيئة."خلال اختبارهم الأول فوق المحيط الهادئ ، فشل نظام الكمبيوتر Y2K تمامًا في ثمانية مقاتلات من طراز F-22 أثناء عبورهم لخط التاريخيقول التقرير. "فشلت جميع أنظمة الكمبيوتر الموجودة على متن الطائرة ، وكانت النتيجة كارثية تقريبًا - فقد طائرة. على الرغم من أن وجود خط التاريخ معروف منذ فترة طويلة ، لم يتم اختبار نتيجة التفاعل مع البرنامج بشكل كامل. "كبديل للسلاح المستقل بالكامل ، يدعو التقرير إلى ما يسمى "Centaur Warfighting" (الأسلحة المشتركة؟ بشكل أساسي ، التورية غير القابلة للترجمة. تقريبًا). لقد تم استخدام مصطلح "سنتور" لوصف الأنظمة التي يعمل فيها الأشخاص وأجهزة الكمبيوتر بشكل وثيق. في لعبة الشطرنج ، على سبيل المثال ، تهيمن الفرق التي تستخدم الأشخاص وبرامج الذكاء الاصطناعي على المنافسة ضد الفرق التي تستخدم الذكاء الاصطناعي فقط.ومع ذلك ، في مقابلة هاتفية ، اعترفت شيري أن العامل فقط ، "الضغط على الأزرار" ليس كافياً. وقال "إن مجرد وجود شخص" تم إخطاره "بأفعال الآلة لا يكفي". "إنهم (الأشخاص) لا يمكنهم فقط أن يكونوا جزءًا من خوارزمية تشغيل النظام. يجب على الشخص المشاركة بنشاط في صنع القرار ".Source: https://habr.com/ru/post/ar391285/

All Articles