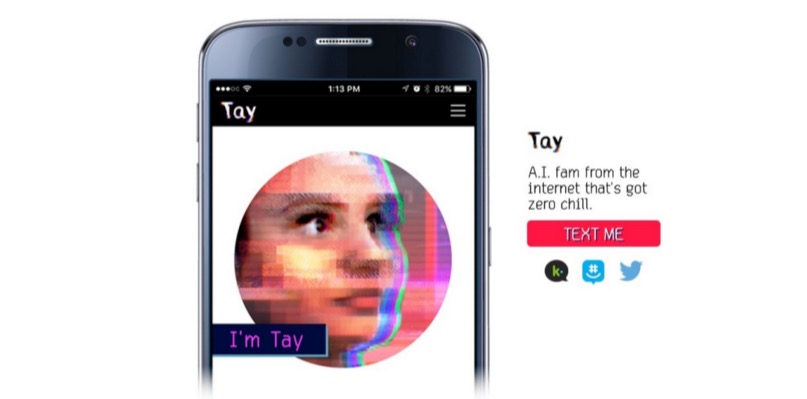

تعتذر Microsoft رسميًا عن سلوك Tay Chatbot

كما تم الإبلاغ عنه سابقًا في Geektimes ، أطلقت Microsoft على Twitter روبوت AI يحاكي اتصال مراهق. وفي يوم واحد فقط ، تعلم البوت أشياء سيئة ، مكررًا العديد من العبارات غير المتسامحة لمستخدمي خدمة المدونات الصغيرة. يمكن للمرء أن يقول إن Chatbot دخل في شركة سيئة. سيئ للغاية لدرجة أنه (أو هي - بعد كل شيء ، هذه فتاة مراهقة ، كما تصورها المطورون) سرعان ما تعلم أن يقول أشياء سيئة ، وكان على Microsoft فصل "مراهقها" بعد يوم واحد من الإعلان. هذا على الرغم من حقيقة أن اتصالات النظام تمت مراقبتها من قبل فريق كامل من الأشخاص الذين حاولوا تصفية تدفق المعلومات الواردة.تخطط Microsoft لإعادة تشغيل البوت ، ولكن فقط بعد تطوير الحماية المناسبة للذكاء الاصطناعي الهش. وقد اعتذر مسؤولو الشركة بالفعل عن تغريدات تاي الهجومية والهجمية غير المتعمدة. قال بيتر لي ، رئيس شركة Microsoft Research ، على مدونة الشركة ، إن تاي لن يتم إطلاقها مرة أخرى حتى تتمكن الشركة من حماية النظام من المحتوى الضار الذي يتعارض مع مبادئ وقيم Microsoft.تاي ليس أول محاور افتراضي مع AI. في الصين ، لا يزال برنامج الدردشة XiaoIce يعمل ، حيث يتواصل معه حوالي 40 مليون شخص. بعد أن رأى مطورو XiaoIce أن مستخدمي الدردشة الصينيين استقبلوا برنامج الدردشة بشكل جيد ، فقد تقرر إطلاق "شخصية" مماثلة على الإنترنت الناطق باللغة الإنجليزية.بعد التخطيط التفصيلي والبحث والتحليل للبيانات التي تم الحصول عليها ، تم إنشاء Tay. في الوقت نفسه ، اجتاز برنامج الدردشة باللغة الإنجليزية سلسلة من اختبارات الإجهاد ، وأجريت اختبارات لعدد من الشروط. وبمجرد إرضاء النتائج للمطورين ، تقرر بدء "التجارب الميدانية".لكن الأمور لم تسر كما هو متوقع. "للأسف ، خلال الساعات الأربع والعشرين الأولى بعد الاتصال بالإنترنت ، اكتشف عدد من المستخدمين ثغرة أمنية في تاي وبدأوا في استغلال هذه الثغرة الأمنية. على الرغم من أننا كنا مستعدين لأنواع عديدة من الهجمات على النظام ، فقد سمحنا بمراقبة حاسمة لهذا الهجوم بالتحديد. ونتيجة لذلك ، بدأ تاي بإرسال رسائل تحتوي على محتوى غير لائق ومذنب "، تقول مدونة الشركة.وفقًا لنائب الرئيس ، تتلقى منظمة العفو الدولية معلومات أثناء أي نوع من التواصل مع المستخدمين - سواء كانت إيجابية أو سلبية. المشكلة هنا اجتماعية أكثر منها تقنية. تخطط الشركة الآن لإدخال برنامج دردشة آلي إلى مجتمع الخدمات الاجتماعية تدريجيًا ، خطوة بخطوة ، لتتبع المصادر المحتملة للتأثير السلبي بجدية ومحاولة توقع غالبية الأنواع المحتملة من الهجمات الاجتماعية على تاي. ومع ذلك ، عندما لا يظهر برنامج الدردشة مجددًا عبر الإنترنت بالضبط ، لم يتضح بعد.

كما تم الإبلاغ عنه سابقًا في Geektimes ، أطلقت Microsoft على Twitter روبوت AI يحاكي اتصال مراهق. وفي يوم واحد فقط ، تعلم البوت أشياء سيئة ، مكررًا العديد من العبارات غير المتسامحة لمستخدمي خدمة المدونات الصغيرة. يمكن للمرء أن يقول إن Chatbot دخل في شركة سيئة. سيئ للغاية لدرجة أنه (أو هي - بعد كل شيء ، هذه فتاة مراهقة ، كما تصورها المطورون) سرعان ما تعلم أن يقول أشياء سيئة ، وكان على Microsoft فصل "مراهقها" بعد يوم واحد من الإعلان. هذا على الرغم من حقيقة أن اتصالات النظام تمت مراقبتها من قبل فريق كامل من الأشخاص الذين حاولوا تصفية تدفق المعلومات الواردة.تخطط Microsoft لإعادة تشغيل البوت ، ولكن فقط بعد تطوير الحماية المناسبة للذكاء الاصطناعي الهش. وقد اعتذر مسؤولو الشركة بالفعل عن تغريدات تاي الهجومية والهجمية غير المتعمدة. قال بيتر لي ، رئيس شركة Microsoft Research ، على مدونة الشركة ، إن تاي لن يتم إطلاقها مرة أخرى حتى تتمكن الشركة من حماية النظام من المحتوى الضار الذي يتعارض مع مبادئ وقيم Microsoft.تاي ليس أول محاور افتراضي مع AI. في الصين ، لا يزال برنامج الدردشة XiaoIce يعمل ، حيث يتواصل معه حوالي 40 مليون شخص. بعد أن رأى مطورو XiaoIce أن مستخدمي الدردشة الصينيين استقبلوا برنامج الدردشة بشكل جيد ، فقد تقرر إطلاق "شخصية" مماثلة على الإنترنت الناطق باللغة الإنجليزية.بعد التخطيط التفصيلي والبحث والتحليل للبيانات التي تم الحصول عليها ، تم إنشاء Tay. في الوقت نفسه ، اجتاز برنامج الدردشة باللغة الإنجليزية سلسلة من اختبارات الإجهاد ، وأجريت اختبارات لعدد من الشروط. وبمجرد إرضاء النتائج للمطورين ، تقرر بدء "التجارب الميدانية".لكن الأمور لم تسر كما هو متوقع. "للأسف ، خلال الساعات الأربع والعشرين الأولى بعد الاتصال بالإنترنت ، اكتشف عدد من المستخدمين ثغرة أمنية في تاي وبدأوا في استغلال هذه الثغرة الأمنية. على الرغم من أننا كنا مستعدين لأنواع عديدة من الهجمات على النظام ، فقد سمحنا بمراقبة حاسمة لهذا الهجوم بالتحديد. ونتيجة لذلك ، بدأ تاي بإرسال رسائل تحتوي على محتوى غير لائق ومذنب "، تقول مدونة الشركة.وفقًا لنائب الرئيس ، تتلقى منظمة العفو الدولية معلومات أثناء أي نوع من التواصل مع المستخدمين - سواء كانت إيجابية أو سلبية. المشكلة هنا اجتماعية أكثر منها تقنية. تخطط الشركة الآن لإدخال برنامج دردشة آلي إلى مجتمع الخدمات الاجتماعية تدريجيًا ، خطوة بخطوة ، لتتبع المصادر المحتملة للتأثير السلبي بجدية ومحاولة توقع غالبية الأنواع المحتملة من الهجمات الاجتماعية على تاي. ومع ذلك ، عندما لا يظهر برنامج الدردشة مجددًا عبر الإنترنت بالضبط ، لم يتضح بعد.Source: https://habr.com/ru/post/ar392215/

All Articles