الأسلحة الذاتية - الروبوتات القاتلة التي يمكن أن تهاجم دون تدخل بشري - هذه أداة خطيرة للغاية. ليس هناك شك في ذلك. كما جاء في رسالته المفتوحة إلى الأمم المتحدة ، إيلون ماسك ، الذي وقع تحت قيادته ، مصطفى محمد سليمان [

المؤسس المشارك لشركة AI DeepMind / تقريبا. perev. ] والمؤلفين الآخرين ، يمكن أن تصبح الأسلحة المستقلة "أسلحة تخويف ، أسلحة يمكن للطغاة والإرهابيين استخدامها ضد سكان أبرياء ، أسلحة يمكن اختراقها وتصنيعها للعمل بطرق غير مرغوب فيها".

لكن هذا لا يعني أن الأمم المتحدة يجب أن تفرض حظراً وقائياً على إجراء المزيد من البحوث حول هذه الأسلحة ، كما يحث مؤلفو الرسالة.

أولاً ، هناك حاجة أحيانًا إلى أدوات خطرة لتحقيق أهداف جديرة بالاهتمام. تذكروا

الإبادة الجماعية في رواندا عندما وقف العالم دون فعل شيء. إذا كانت الأسلحة المستقلة موجودة في عام 1994 ، فربما لن ننظر إلى الجانب. يبدو من المحتمل أنه إذا كان من الممكن قياس تكلفة التدخلات الإنسانية بالمال فقط ، فسيكون من الأسهل الحصول على الدعم العام لمثل هذه التدخلات.

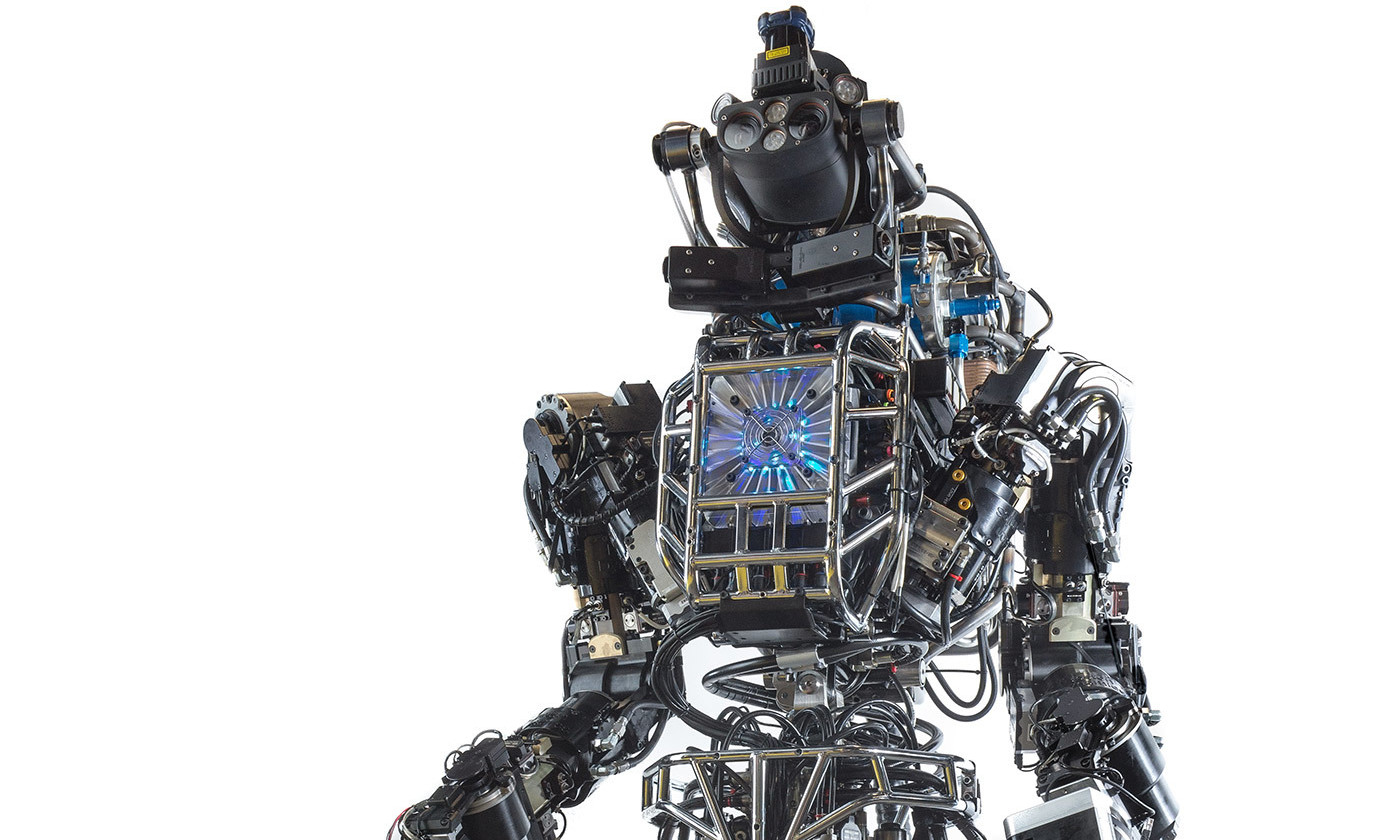

ثانيًا ، من السذاجة الاعتقاد أنه يمكننا الاستمتاع بفوائد الاختراقات الأخيرة في الذكاء الاصطناعي دون الحاجة إلى تجربة بعض أوجه القصور فيها. افترض أن الأمم المتحدة تفرض حظراً وقائياً على أي تقنية للأسلحة المستقلة. كما نفترض - المتفائل تمامًا - أن جميع جيوش العالم ستحترم هذا الحظر وتلغي تطوير برامج الأسلحة المستقلة. وحتى ذلك الحين ، لا يزال يتعين علينا القلق بشأن ذلك. يمكن بسهولة تحويل الروبوت الآلي إلى نظام سلاح مستقل: بدلاً من التجول حول المشاة ، يمكنك تعليمه لتحريكهم.

بشكل عام ، تعد تقنيات الذكاء الاصطناعي مفيدة للغاية وهي تخترق حياتنا بالفعل ، حتى لو كنا أحيانًا لا نرى هذا ولا يمكننا إدراكه بالكامل. بالنظر إلى هذا الاختراق ، سيكون من قصر النظر الاعتقاد بأن إساءة استخدام التكنولوجيا يمكن حظره ببساطة عن طريق حظر تطوير الأسلحة المستقلة. ربما تكون أنظمة الأسلحة المستقلة المتطورة التي تعمل بشكل انتقائي والتي طورتها جيوش مختلفة حول العالم هي التي يمكنها مواجهة الأسلحة المستقلة الأكثر صرامة والتي يسهل تطويرها من خلال إعادة برمجة تكنولوجيا الذكاء الاصطناعي التي تبدو سلمية ، مثل أجهزة الروبوت نفسها.

علاوة على ذلك ، فإن فكرة الحظر البسيط على المستوى الدولي تعطي نهجًا مفرط التبسيط للنظر في الأسلحة المستقلة. لا يعترف هذا المفهوم بالتاريخ الطويل لأسباب وآثار الإجراءات والاتفاقيات بين البلدان المختلفة فيما بينها وحدها ، وهو ما أدى ، من خلال الآلاف من الإجراءات والإغفالات الصغيرة ، إلى تطوير مثل هذه التقنيات. بينما يتم إجراء النقاش حول الأسلحة المستقلة بشكل أساسي على مستوى الأمم المتحدة ، يمكن مسامحة المواطن العادي أو الجندي أو المبرمج لعدم تحمله الالتزامات الأخلاقية للضرر الذي تسببه الأسلحة المستقلة. لكن هذا افتراض خطير للغاية ، يمكن أن يؤدي إلى كارثة.

يجب على جميع الأشخاص الذين يرتبطون بطريقة أو بأخرى بتقنيات الأسلحة الآلية بذل العناية الواجبة ، ويجب على كل واحد منا التفكير بعناية في المساهمة التي يقدمها فعله أو تقاعسه في قائمة المخاطر المحتملة لهذه التكنولوجيا. هذا لا يعني أن الدول والوكالات الدولية ليس لها دور مهم. وهذا ما يؤكده حقيقة أنه إذا أردنا القضاء على الخطر المحتمل للأسلحة الآلية ، فمن الضروري تعزيز أخلاقيات المسؤولية الشخصية ، وينبغي أن تصل هذه الدعاية إلى أدنى المستويات التي يتم فيها اتخاذ القرارات. بادئ ذي بدء ، من المهم للغاية التحدث بالتفصيل وبشكل كامل حول تطوير الأسلحة المستقلة - بما في ذلك عواقب أفعال جميع أولئك الذين يتخذون القرارات على جميع المستويات.

أخيرًا ، يُقال أحيانًا أن السلاح المستقل خطير ليس لأن هذه الأداة خطيرة في حد ذاتها ، ولكن لأنها يمكن أن تصبح مستقلة وتبدأ في التصرف لمصالحها الخاصة. هذا خطأ خطأ ، وعلاوة على ذلك ، فإن حظر تطوير الأسلحة المستقلة لن يساعد في منع هذا الخطر. إذا كان الذكاء الفائق تهديدًا للبشرية ، فنحن بحاجة ماسة إلى البحث عن طرق لمواجهة هذا التهديد بشكل فعال ، والقيام بذلك بغض النظر عما إذا كانت تقنية الأسلحة الآلية سيتم تطويرها بشكل أكبر.

رسالة مفتوحة إلى اتفاقية الأمم المتحدة بشأن أسلحة تقليدية معينة

نظرًا لأن بعض الشركات تنشئ تقنيات تتعلق بالذكاء الاصطناعي والروبوتات التي يمكن إعادة توجيهها لتطوير أسلحة مستقلة ، فإننا نشعر بمسؤولية خاصة عن إثارة هذا الإنذار. نرحب ترحيبا حارا بقرار مؤتمر الأمم المتحدة بشأن اعتماد "اتفاقية بشأن أنواع محددة من الأسلحة التقليدية" بشأن تعيين فريق

من الخبراء الحكوميين (فريق الخبراء الحكوميين ، GGE) بشأن أنظمة الأسلحة الفتاكة المستقلة. العديد من الباحثين والمهندسين لدينا على استعداد لتقديم المشورة التكنولوجية للمساعدة في هذه المشكلة.

نرحب بتعيين السفير أمانديب سينغ جيل من الهند رئيسا لفريق الخبراء الحكوميين. نطلب من الأطراف السامية المتعاقدة المشاركة في فريق الخبراء الحكوميين العمل بنشاط على إيجاد سبل لمنع هذا النوع من سباق التسلح ، وحماية المواطنين من إساءة استخدامها ، وتجنب الآثار المزعزعة للاستقرار لهذه التقنيات. نأسف لإلغاء أول اجتماع لفريق الخبراء الحكوميين ، المقرر عقده في أغسطس 2017 ، لأن بعض الدول لم تقدم مساهمة مالية للأمم المتحدة. نحث الأطراف السامية المتعاقدة على مضاعفة جهودها في الاجتماع الأول لفريق الخبراء الحكوميين الذي سيعقد في نوفمبر.

تهدد الأسلحة المستقلة المفصلة بإحداث ثورة ثالثة في الشؤون العسكرية. بعد تطويره ، سيجعل من الممكن إجراء صراعات عسكرية على نطاق لم يسبق له مثيل ، وفي فترات زمنية أقصر مما يمكن للشخص أن يدركه. يمكن أن يصبح سلاحًا للترهيب ، سلاح يمكن للطغاة والإرهابيين استخدامه ضد السكان الأبرياء ، وهو سلاح يمكن اختراقه وجعله يعمل بطرق غير مرغوب فيها. لدينا القليل من الوقت المتبقي. بعد فتح صندوق Pandora هذا ، سيكون من الصعب إغلاقه. لذلك ، نطلب من الأطراف السامية المتعاقدة إيجاد سبل لحمايتنا جميعا من هذه التهديدات.