يتم دمج رؤية الكمبيوتر بشكل متزايد في حياتنا. في الوقت نفسه ، لا نلاحظ كل هذه الملاحظة لنا. سنتحدث اليوم عن نظام يساعد على تحليل عواطف الزوار في المؤتمرات ، وفي العملية التعليمية ، ودور السينما ، وأكثر من ذلك بكثير. بالمناسبة ، سنعرض الرمز ونتحدث عن الحالات العملية. انظر تحت القط!

أعطي الكلمة للمؤلف.

أعطي الكلمة للمؤلف.هل تريد دائمًا أن تعرف شخصيًا الجمهور في القاعة ، والفصول الدراسية ، والمكتب وإدارته؟ السؤال ليس خاملا على الإطلاق. إنها عن جمهور غير متصل بالإنترنت. لتحسين أداء الأعمال ، يعد الحصول على معلومات حول سلوك عميلك وردود فعله ورغباته ضرورة حيوية. كيف تجمع هذه الإحصائيات؟

مع الجمهور عبر الإنترنت ، كل شيء أسهل. إذا كان النشاط التجاري موجودًا على الإنترنت ، فإن التسويق مبسط إلى حد كبير وجمع البيانات على الملف الشخصي لعملائك ، ثم "اللحاق بها" لفترة غير محدودة - أمر بسيط للغاية. هناك الكثير من الأدوات - خذها واستخدمها ، فإن التكلفة ترتفع.

في وضع عدم الاتصال ، يتم تطبيق نفس الأساليب التي تم تطبيقها قبل 50 عامًا: الاستبيانات والاستبيانات والمراقبون الخارجيون مع جهاز كمبيوتر محمول ، وما إلى ذلك. جودة هذه الأساليب رديئة. الموثوقية أمر مشكوك فيه. حول الراحة ، يمكنك أن تكون صامتًا بشكل عام.

في هذه المقالة ، نريد التحدث عن الحل الجديد لـ CVizi ، الذي يجمع إحصائيات مثيرة للاهتمام وفريدة من نوعها ويساعد على تحليل المعلومات حول عملائك / زوارك باستخدام رؤية الكمبيوتر.

تحليلات الفيديو ودور السينما

في البداية ، تم تطوير المنتج كأداة لحساب مشاهدي السينما ومقارنة عددهم مع التذاكر التي تم شراؤها من أجل التحكم التأديبي لموظفي الخدمة ومنع الانتهاكات. ولكن كما يقولون ، تأتي الشهية مع الأكل.

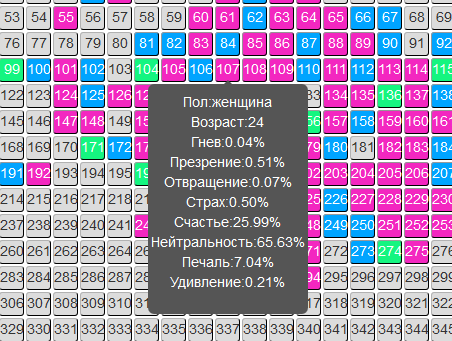

سمحت التكنولوجيا المتطورة بتوسيع قدرات الحل. أصبح من الممكن تحديد خصائص العمر والجنس لزوار السينما ، وكذلك تحديد الخلفية العاطفية لكل شخص خلال الجلسة.

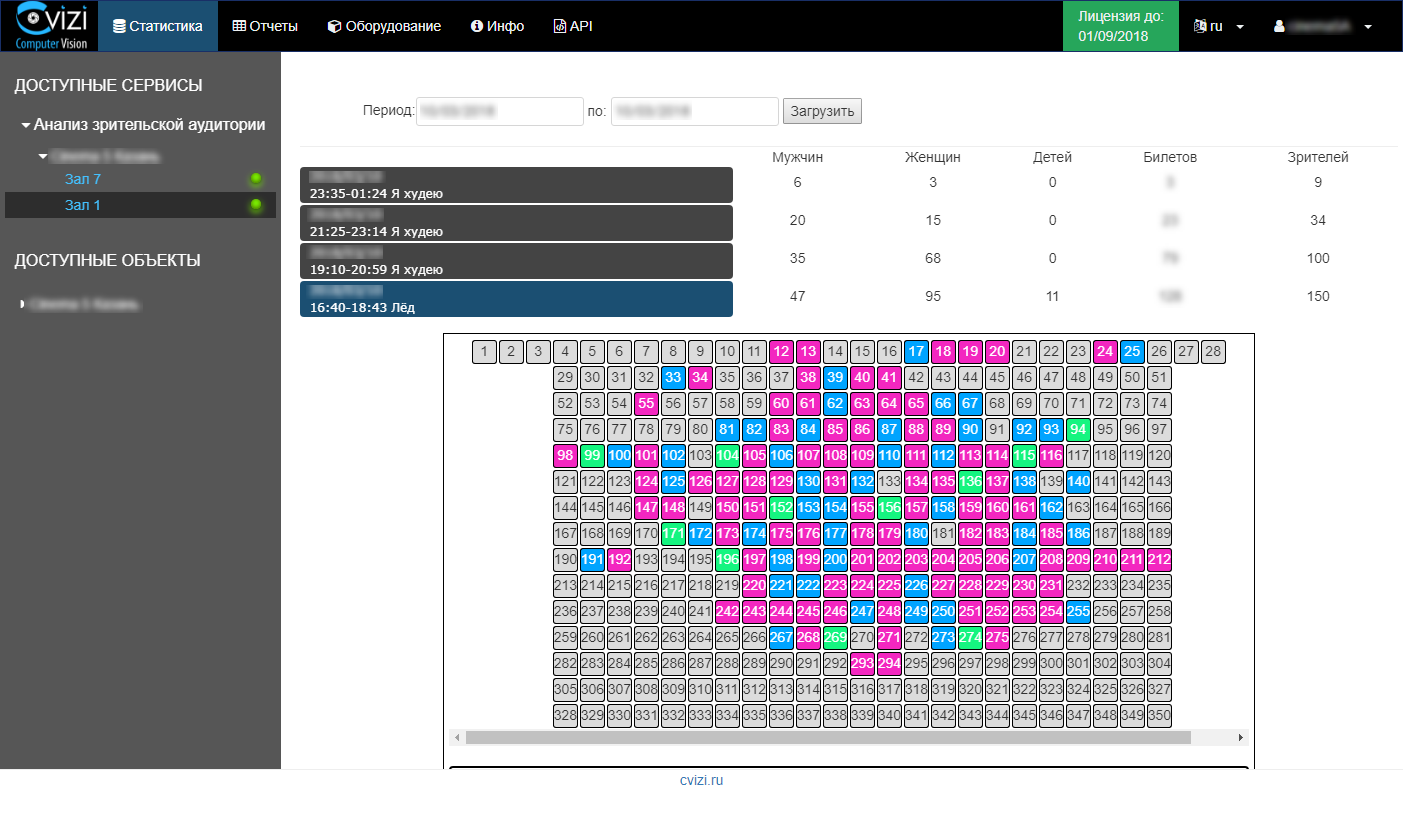

يتم تحديث المعلومات على الفور ويحتاج المستخدم فقط إلى الدخول إلى حسابك الشخصي وعرض الإحصائيات حول جلسة الاهتمام أو تقرير تحليلي عن الجمهور.

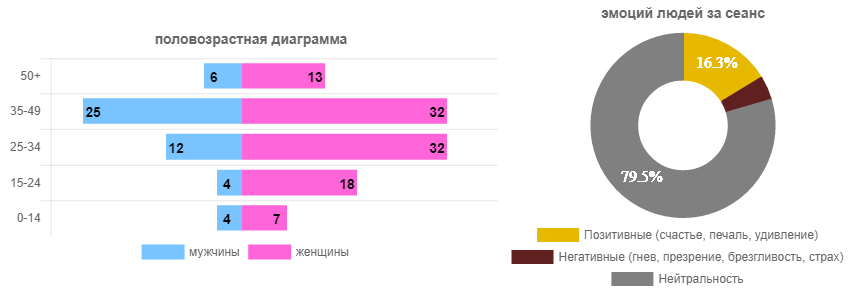

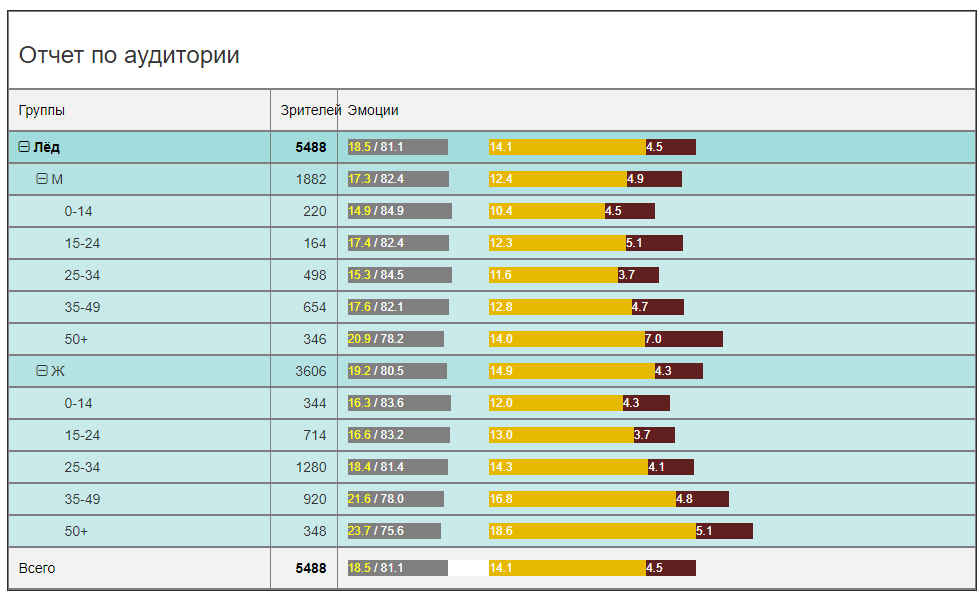

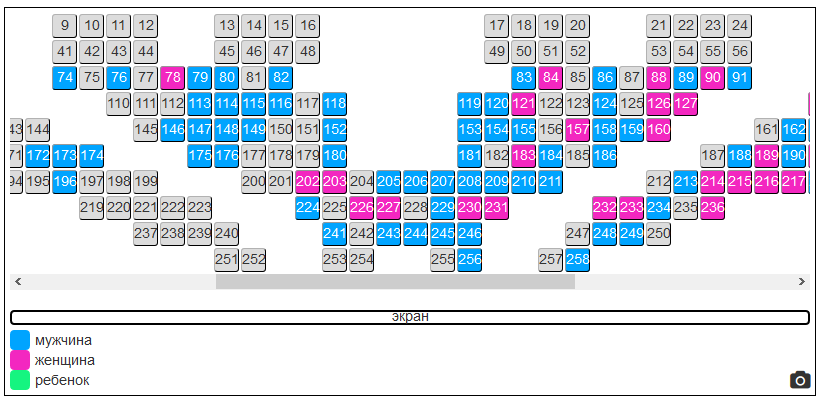

على سبيل المثال ، نفتح جلسة مع فيلم "Ice" ونرى على realogram من القاعة الهيمنة الواضحة للمتفرجين الإناث (من حيث المبدأ ، بشكل متوقع). ثم ننظر إلى تلك المشاعر التي مر بها الناس (يمكن للجميع رؤيتها).

كانت هذه بيانات لجلسة واحدة محددة. الآن دعونا نلقي نظرة على نفس البيانات بشكل عام طوال فترة تأجير الفيلم (في سينما واحدة) ونحصل على صورة أكثر صلة.

من حيث الحضور ، هناك هيمنة واضحة للمشاهدين الإناث الذين تتراوح أعمارهم بين 25-34 سنة. الرجال هم 2.5-3 مرات أقل. على سبيل المثال الإعلان في سيارة دفع رباعي جديدة في وحدة إعلانية ليس ذكيًا مثل وضع ماسكارا جديدة. على الرغم من أن هذه هي نقطة خلافية. ولكن على أي حال ، بعد يومين من التأجير ، يمكنك أن تضمن للمعلن بأمان الجمهور المستهدف ، وحتى من الناحية الكمية.

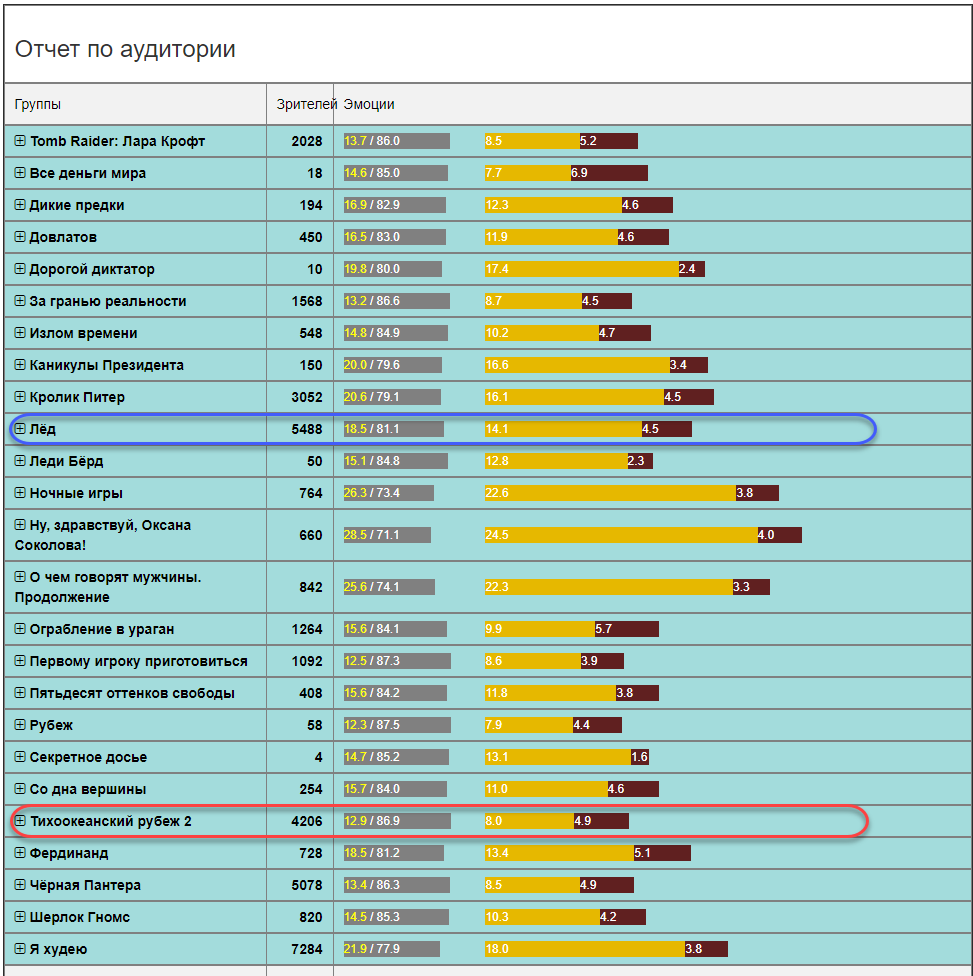

من وجهة نظر الخلفية العاطفية ، ستكون الصورة ذات أهمية في المقام الأول للموزعين والموزعين. لمن يشاء الفيلم ومن يزعج؟ هل يجب أن أصور تتمة؟ صدق آراء حول الروبوتات أو احصل على إحصاءات موثوقة؟ في هذه الحالة (فيلم "Ice") ، يكون الفيلم مشرقًا جدًا في العواطف. مجموع المشاعر الإيجابية والسلبية هو 18.5 من أصل 100 ببغاوات والباقي محايد. هذا مؤشر جيد. للمقارنة ، قد لا تكون الخلفية العاطفية في الأفلام الأخرى وردية للغاية (في المتوسط في المستشفى لجميع الأعمار والأجناس).

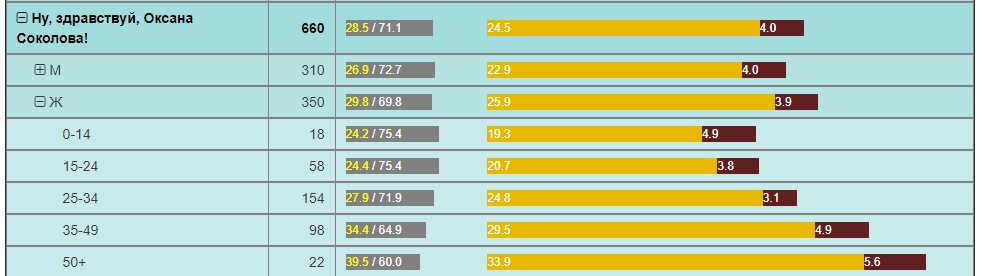

على سبيل المثال ، المحيط الهادئ ، مع عدد مماثل من المشاهدين خلال نفس الفترة ، لديه مشاعر أقل إيجابية مرتين. وفيلم "Hello، Oksana Sokolova" هو مجرد اكتشاف للنساء "50+".

كل هذه بعض الأمثلة على التحليل التي يمكن استخدامها في شبكات الأفلام. ببساطة لم يكن لديهم هذه المعلومات ، وقليل من الناس يعرفون أنه يمكن الحصول عليها على الإطلاق ، وأكثر من ذلك لاستخدامهم الخاص.

بالنسبة لشبكات الأفلام ، تفتح فرص رائعة لتحليل أعمق لما يحدث في القاعة وفقًا لتكوين الجمهور ورد فعلهم على الأفلام في مناطق مختلفة.

يمكنك على الفور إبراز ما يلي :

- القدرة على اختبار أي فرضية تسويقية هي تلقي ردود فعل في الوقت الحقيقي وتقييم تغييرات الجمهور بشكل موضوعي وتأثير أنشطة التسويق.

- القدرة على تزويد المعلنين بمعلومات دقيقة عن الجمهور الذي شاهد الإعلان. والأكثر من ذلك أنه من الممكن للمعلن أن يضمن عرض الإعلانات من قبل مجموعات جمهور معينة.

- القدرة على إنشاء عروض تسويقية فريدة في السوق (خصومات) للزوار من سن وجنس معين ، مع عدم كسر مخطط العمل الحالي وعدم الحد من المؤشرات المالية الحالية.

هذه والعديد من الفرص الأخرى التي نشأت بفضل هذا القرار قادرة على تحويل سوق شبكة السينما ، وزيادة الإيرادات وتحسين كفاءة كل من دور السينما الفردية والشبكة بأكملها.

مع الأخذ في الاعتبار أن الحل "سهل" (لا خوادم ، ولا يوجد تدفق إلى الإنترنت) ، يستخدم بنشاط سحابة Microsoft Azure وبأسعار معقولة للسوق (في شكل اشتراكات دورية للخدمة) ، شبكات السينما في روسيا والخارج تعمل بنشاط على تنفيذه.

علاوة على ذلك ، تنعكس التكنولوجيا التي تم إنشاؤها في حلول أخرى في مناطق متوازية.

تحليلات وأحداث الفيديو

أحداث ، أحداث ، منتديات ، مؤتمرات ، مؤتمرات ، ندوات ... ماذا يعرف المنظمون عن الجمهور الجديد؟ X من الأشخاص المسجلين ، جاء Y ، ملأت Z الاستبيانات. هذا كل شيء تقريبًا.

السؤال هو ألم منفصل: "لذا ، أعرف أن هذا الرفيق جيدًا ، سأعطيه 5 نقاط ، على الرغم من أن التقرير كان مملاً" نحن نؤدي إلى حقيقة أن موثوقية الاستبيانات منخفضة.

لفهم فعالية المؤتمر ، من الضروري ببساطة الحصول على تعليقات المشاركين إلى المنظم والجهات الراعية.

تنتقل خدمة تحليل الجمهور في دور السينما بشكل مثالي إلى مكان المؤتمر. اختبرت CVizi أيضًا هذه الحالة من خلال إجراء تجربتين: في قاعة Matrex في Skolkovo في أحد المؤتمرات وفي قاعة أكتوبر الرقمية خلال المباراة النهائية الروسية لمسابقة Imagine Cup 2018 لمشاريع تكنولوجيا الطلاب.

التجربة 1. قاعة ماتركس في سكولكوفو

في Matrex ، لم يتم تثبيت الكاميرا فوق الشاشة ، كما هو الحال في السينما ، ولكن على حامل تلسكوبي خلف مكبرات الصوت. وبالتالي ، اتضح أن الحل متنقل. مطلوب فقط قبل ساعات قليلة من بدء تثبيت الكاميرا ، وإعداد مخطط القاعة وإدخال جدول مكبرات الصوت. ثم يقوم النظام بكل شيء بنفسه.

الآن يمكن للمنظم جمع البيانات حول جودة التقارير من خلال عدد المشاركين في القاعة وعواطفهم في كل جلسة / تقرير. وفي المرة القادمة يمكنك التخطيط لحدث بناءً على حقائق موضوعية. هناك تقارير ، وبعد ذلك يغادر المشاركون الغرفة ببساطة ، ويعمل المتحدث التالي مع أولئك الذين بقوا أو لم يكن لديهم الوقت للمغادرة. هذا خطأ ، ويمكن لمثل هذه التوقعات تغيير التأثير بشكل كبير عن طريق إعادة ترتيب التقارير.

التجربة 2. كأس روسيا النهائي

هنا كان الهدف مختلفًا إلى حد ما ، لكن النهج هو نفسه. أحد ترشيحات المسابقة هي جائزة الجمهور. هؤلاء المشاهدون هم الذين يجلسون في القاعة ، وليس المشاهدين عبر الإنترنت. وللمرة الأولى في كأس التخيل ، تم منح جائزة اختيار الجمهور لفريق اختاره الذكاء الاصطناعي. فاز الفريق ، الذي كان رد فعل الجمهور عليه إيجابياً للغاية عندما كان الرجال على المسرح. لهذا ، تم استخدام كاميرتين بالفعل ، كل منهما يسيطر باستمرار على قطاعه الخاص في القاعة ويجمع الخصائص العاطفية لكل مشاهد.

في هذه الحالة ، يمكن تعليق الكاميرات على سارية إضاءة فوق المسرح ، مما يضمن استقرارها وعدم ثباتها. كما كنا مقتنعين مرة أخرى بأن خدمة الإنترنت 4G كافية للعمل. تبين أن النظام مستقل بقدر الإمكان. من المنظمين كانت هناك حاجة إلى 220 فولت فقط ، وهذا مهم حقًا لأن في أحداث هذا المقياس ، تكون قنوات الاتصال دائمًا عنق الزجاجة ، وتعتمد جودة الخدمة بشكل مباشر على استقرار قناة الإنترنت.

ونتيجة لذلك ، تم منح جائزة الجمهور إلى الفريق الذي سجل أكبر عدد من المشاعر الإيجابية لأدائهم - Last Day Development من NNSU im. Lobachevsky.

تحليلات الفيديو والتعلم

لا يزال مجال التعليم من حيث أتمتة عملياته وراء بقية الصناعات. على سبيل المثال ، لا يزال يمارس الحضور في شكل وحدة تحكم خارجية مع مجلة في العديد من الجامعات: دخل شخص ، أحسب الطلاب في المحاضرات ، أدخل عددًا في المجلة (أي سؤال؟) ومضى.

إن تقنية تحليل الجمهور من خلال طرق رؤية الكمبيوتر تتناسب تمامًا مع مجال التعليم وتفتح مجالًا كبيرًا للتجربة والتحليل. المهام المحتملة التي يتعين حلها:

- مراقبة الحضور في الصف

- تحديد الطالب

- تقييم جودة التدريس

- التعرف على المشاعر السلبية للطالب وتبني الإجراءات الوقائية.

- تقييم مشاركة الطالب أو الطالب في المدرسة.

التخطيط السليم للعملية التعليمية ، بما في ذلك الجدول الزمني واختيار المحاضرين - هذا هو أساس نجاح التعليم. ولكن في الواقع ، إذا انتقلنا إلى المجال الاقتصادي ، فهذه هي تكلفة التعليم في سياق كل طالب.

تحليلات الفيديو في الصناعات الأخرى

لا تقتصر تكنولوجيا CVizi على الحلول المقدمة ، فهناك حلول للبيع بالتجزئة والإنتاج.

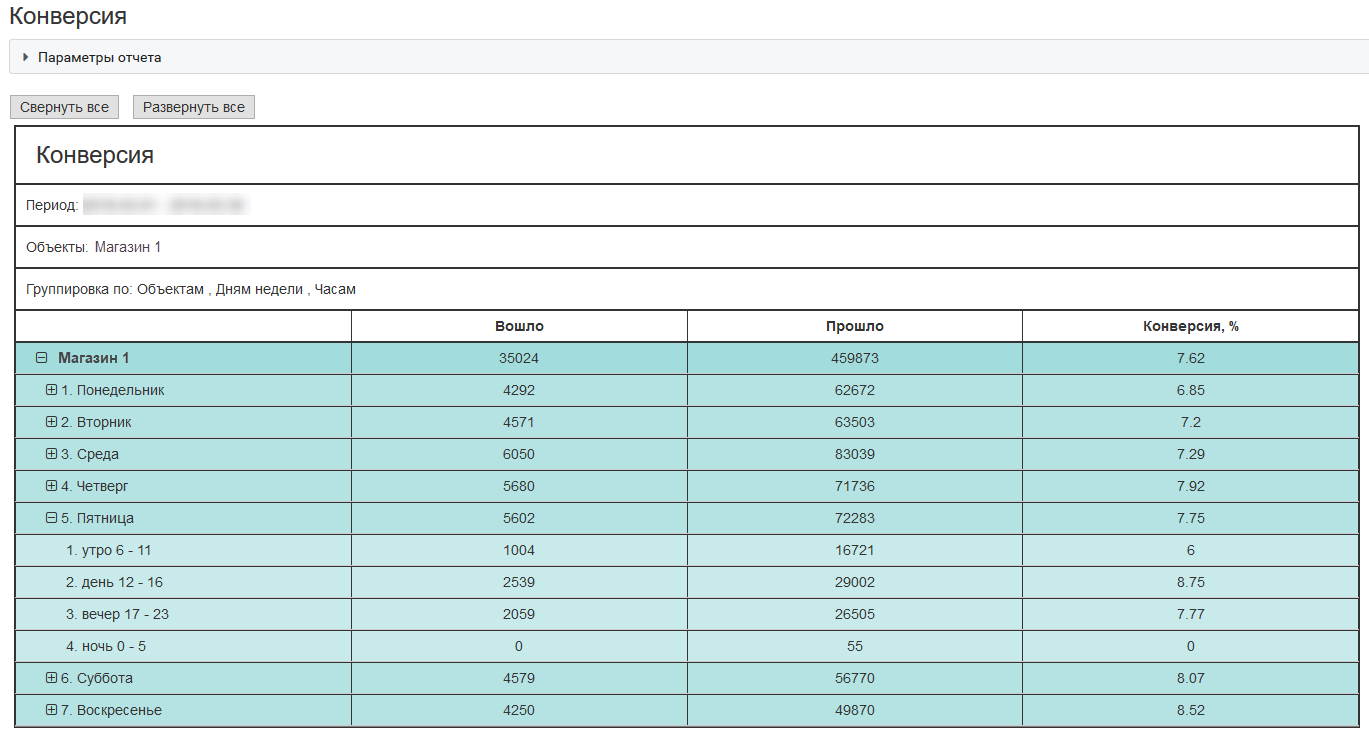

على سبيل المثال ، الحل المثير للاهتمام هو الحصول على معلومات حول التحويل الخارجي والداخلي للمخزن. يتيح لك هذان المؤشران إنشاء مسار تحويل المبيعات دون اتصال:

- كم عدد الأشخاص بالقرب من متجرك ؛

- كم عدد الأشخاص الذين دخلوا.

- كم عدد الأشخاص الذين وصلوا إلى السجل النقدي.

فيما يلي مثال على تحويل خارجي لمتجر نموذجي يقع في مركز تسوق في موسكو:

باستخدام هذه المؤشرات ، يمكن للأعمال أن تنفق الأموال بشكل أكثر فاعلية على جذب العملاء ، وعلى اختبار الفرضيات التسويقية ، وعلى جودة الخدمة.

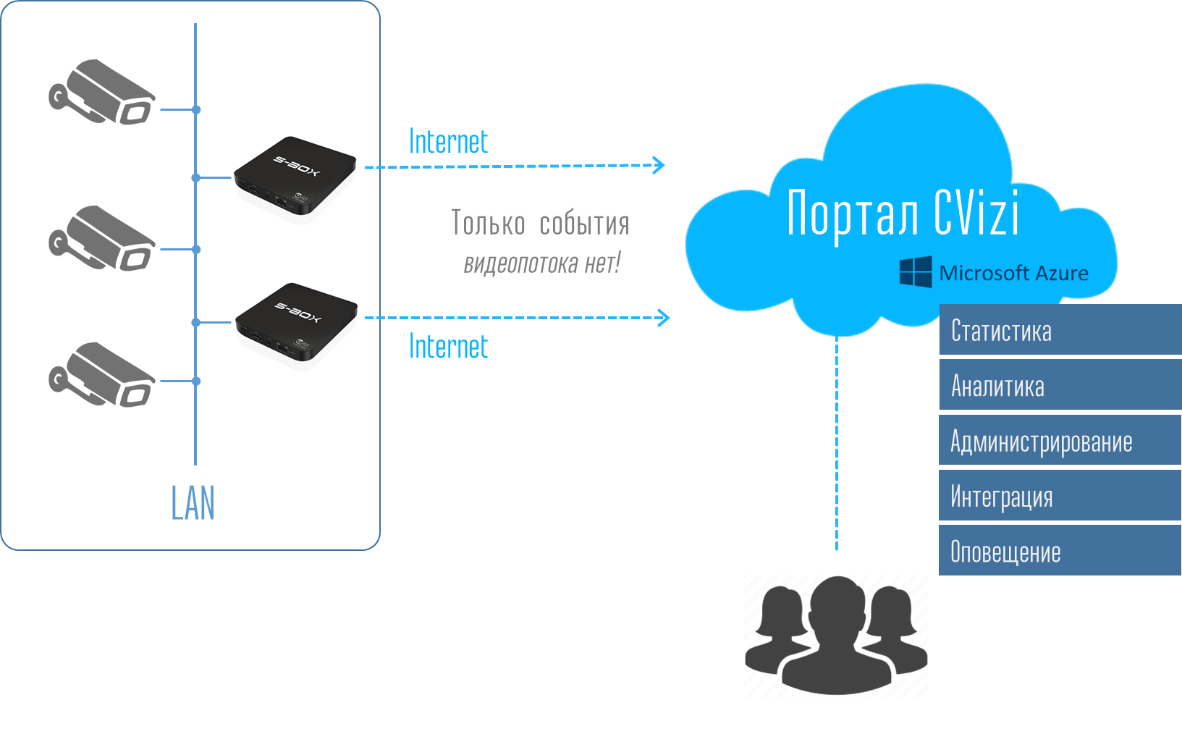

كيف يعمل؟

الآن أريد التحدث قليلاً عن التكنولوجيا. لماذا نقول أن الحل "سهل"؟ كل شيء عن العمارة. من العبء دائمًا على أي عميل شراء حل باهظ الثمن ، بالإضافة إلى أسطول من المعدات في شكل خوادم مختلفة ومسجلين وأشياء أخرى. ثم إعداد كل شيء ، للاقتران ببعضهما البعض ومرافقتهما. إذا عُرض على العميل صندوق على شكل كمبيوتر صغير بحجم هاتف محمول ، فيمكن لأي شخص على الأقل إلى حد ما على دراية بهذه التقنية تثبيته على شبكته المحلية وتعليق كاميرا فيديو IP. يشير التشابه مع جهاز توجيه Wi-Fi في المنزل إلى نفسه - لقد قمت بتوصيله بمأخذ طاقة ، وربطت الإنترنت ، وجعلت أبسط الإعدادات. هذا كل شيء. لا حاجة لخدمة ما بعد البيع. كل شيء يتم بسهولة بشكل مستقل.

ثم في الحساب الشخصي يرى المستخدم النظام بأكمله ويمكنه تلقي البيانات في شكل تقارير وسجلات إحصائيات ، وباستخدام واجهة برمجة التطبيقات ، خذ هذه البيانات إلى نظام تكنولوجيا المعلومات الخاص بشركته.

وبالتالي ، لا يحتاج المستخدم إلى التفكير والاهتمام بالبنية التحتية. من السهل جدًا توصيل أجهزة حوسبة S-Box. من السهل أيضًا تكرار الحل بنقاط أخرى - قم بتعليق الكاميرات وربط العدد المطلوب من S-Box ورؤية الكائن على البوابة في حسابك على الفور.

تحت البوابة والحساب الشخصي يوجد نظام كامل من التحليلات ومخازن قاعدة البيانات ومراقبة المعدات والإخطار ، يتم نشره في السحب Azure. النظام مرن ويتم تخصيص جميع موارد الحوسبة اللازمة تلقائيًا للمستخدم. لذلك ، يتم إزالة الصداع بأكمله على المعدات ودعمه من المستخدم. يشتري فقط خدمة تحليل الفيديو. مريح للغاية.

ما الكاميرات التي يمكن استخدامها لتحليل الفيديو للجمهور؟

بالنظر إلى أنه في النهاية تحتاج إلى الحصول على وجه المشاهد بجودة مقبولة ، يجب أن تكون الكاميرا ، أولاً ، بصريات جيدة والتكبير ، وثانيًا ، يتم التحكم فيها - PTZ.

اختبرنا أكثر من اثنتي عشرة كاميرا من ماركات مختلفة. لن نذكر طرازات كاميرات معينة ، ولكن يمكن التعبير عن الخصائص.

بالنسبة إلى القاعات التي تتسع لـ 150-200 شخصًا ، تكفي كاميرا 20 × مع مصفوفة 2 ميجابكسل. بالنسبة للقاعات التي تضم أكثر من 200 شخص ، من الأفضل استخدام الكاميرات 25x وما فوق. إنها بالتأكيد أغلى ثمناً ، لكن هذه هي الطريقة الصحيحة. على الرغم من أنه بالطبع يمكنك أيضًا التلاعب بحجم المصفوفة ، ولكن يجب أن تفهم أنه في طيف الأشعة تحت الحمراء ، ستحدث المصفوفة ضوضاء وستكون الزوم البصري أفضل دائمًا من الرقمي.

دقة الاعتراف

كلما وضعنا أنفسنا على وجه أقرب ، كلما كان أكثر وضوحا. يبدو أن كل شيء واضح ، ويفهم الطفل. ولكن إذا كان كل شيء جيدًا مع التعرف على الجنس ، فإن دقة تحديد العمر يمكن أن تكون بسهولة ± 5 سنوات أو أكثر ، بغض النظر عن قرب الكاميرا. والنقطة هنا ليست في جودة الخوارزميات والشبكات العصبية ، بل في حقيقة أن كل شخص بالغ يحاول أن ينظر بقدر ما استثمر في مظهره.

لذلك ، ستعطي الكاميرا العمر الذي يبدو فيه الشخص أو يحاول النظر. على سبيل المثال العمر البيولوجي والعمر وفقًا للصورة - يمكن أن يكون هناك اختلافان كبيران. بعد كل شيء ، يمكن لكل واحد منا أن يتذكر الحالات عندما كان مخطئًا في تصنيف عمر المحاور. في الوقت نفسه ، يعد الدماغ البشري شبكة عصبية قوية جدًا ومدربة جيدًا.

أزور وخدماتها

في قلب كل هذا ، الخدمة المعرفية لـ Microsoft Face API. هذه خدمة مريحة للغاية ويمكن الوصول إلى API من أي بيئة تطوير مشتركة تقريبًا. نستخدم معظم خدماتنا باستخدام Python - وهذا على الجانب السحابي.

يبدو التسلسل العام كما يلي:1) ينقل S-Box الصور إلى السحابة

2) تقوم الخدمة السحابية بتجميعها وفرزها وإطعامها في الخدمات المعرفية لاكتشاف الوجه. لتحميل الصور المجمعة إلى السحابة ، استخدم Python:

def upload_file(file_path, upload_file_type):

""" Uploading file """

...

if authData == '' or authData == 'undefined':

...

try:

r = requests.post(param_web_service_url_auth, headers={'authentication': base64string})

if r.status_code == 200:

authData = json.loads(r.text)['token']

result = upload_file(file_path, upload_file_type)

return result

logging.error("Upload_file(%s) - UNEXPECTED AUTH RESULT CODE %d", file_path, r.status_code)

except Exception as e:

logging.error('Upload_file(%s) error', file_path)

logging.exception('Upload exception ' + str(e))

return False

try:

base_name = os.path.basename(file_path)

txt_part, file_extension = os.path.splitext(base_name)

files = {'file': open(file_path, 'rb')}

...

if upload_file_type == 1: # for upload full view

...

payload = {'camid': cam_id, 'dt': dt, 'mac': mac}

z = requests.post(uploaddatalinkhall, headers={'authentication': authData}, files=files, data=payload)

if z.status_code == 200:

return True

logging.debug('post result -> %d', int(repr(z.status_code)))

if upload_file_type == 0:

...

payload = {'camid': cam_id, 'dt': dt, 'json_str': json_str, 'mac': mac}

...

z = requests.post(param_web_service_url, headers={'authentication': authData}, files=files, data=payload)

myfile.close()

if z.status_code == 200:

...

if len(debug_path) > 0:

# move

fnn = debug_path + os.sep + json_file

shutil.move(upload_folder + os.sep + json_file, fnn)

else:

# delete

os.remove(upload_folder + os.sep + json_file)

return True

result = "UNEXPECTED STATUS CODE " + repr(z.status_code)

logging.error('upload_file(%s) - ERROR. Res=%s, text: %s',

json_file, result, z.text)

...

except Exception, e:

...

logging.exception('Upload exception: ' + str(e))

return False

3) Python

CF.face.detect , , MS Face detection Cognitive Service API, :

def faceapi_face_detect(url):

…

# API call

image_url = url

need_face_id = False

need_landmarks = False

attributes = 'age,gender,smile,facialHair,headPose,glasses,emotion,hair,makeup,accessory,occlusion,blur,exposure,noise'

watcher = elapser_mod.Elapser()

try:

api_res = CF.face.detect(image_url, need_face_id, need_landmarks, attributes)

# callback(url, need_face_id, need_landmarks, attributes, e.elapsed(), api_res)

text = 'CF.face.detect image_url {}, need_face_id {}, need_landmarks {}, attributes {}, completed in {} s.'. \

format(image_url, need_face_id, need_landmarks, attributes, watcher.elapsed())

printlog(text)

text2 = 'Detected {} faces.'.format(len(api_res))

printlog(text2)

text3 = '{}'.format(api_res)

printlog(text3)

except CF.CognitiveFaceException as exp:

text = '[Error] CF.face.detect image_url {}, need_face_id {}, need_landmarks {}, attributes {}, failed in {} s.'. \

format(image_url, need_face_id, need_landmarks, attributes, watcher.elapsed())

printlog(text)

text2 = 'Code: {}, Message: {}'.format(exp.code, exp.msg)

printlog(text2)

message = exp.msg

…

return api_res, message

. () . . , . . – .

? ! . API. – , , . , () .., «» . . .

.

— CVizi. : 'aosipov @ cvizi.com'.

FB .