في عام 2017 ، نشر جيفري هينتون (أحد مؤسسي نهج الانتشار الخلفي للخطأ) مقالًا يصف الشبكات العصبية المحفظة ويقترح خوارزمية للتوجيه الديناميكي بين الكبسولات لتعليم العمارة المقترحة.

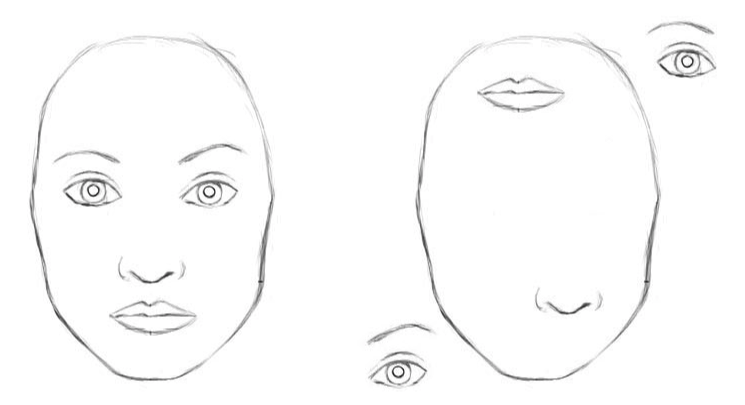

الشبكات العصبية التلافيفية التقليدية لها عيوب. لا يأخذ التمثيل الداخلي لبيانات الشبكة العصبية التلافيفية في الاعتبار التسلسل الهرمي المكاني بين الأشياء البسيطة والمعقدة. لذلك ، إذا تم عرض العيون والأنف والشفاه لشبكة عصبية تلافيفية بشكل عشوائي في الصورة ، فهذه علامة واضحة على وجود وجه. ويؤثر دوران الجسم على جودة التعرف ، بينما يحل دماغ الإنسان هذه المشكلة بسهولة.

بالنسبة للشبكة العصبية التلافيفية ، تتشابه صورتان [2]

ستكون هناك حاجة إلى آلاف الأمثلة لتدريب التعرف على الأشياء من زوايا CNN المختلفة.

تقلل شبكات الكبسولة من خطأ التعرف على كائن من زاوية أخرى بنسبة 45٪.

كبسولات وصفة طبية

تقوم الكبسولات بتغليف المعلومات حول حالة الوظيفة ، والتي توجد في شكل متجه. تشفر الكبسولات احتمالية اكتشاف كائن كطول متجه الإخراج. يتم ترميز حالة الوظيفة المكتشفة على أنها الاتجاه الذي يشير فيه المتجه ("معلمات إنشاء المثيل"). لذلك ، عندما تنتقل الوظيفة المكتشفة عبر الصورة أو تتغير حالة الصورة ، يبقى الاحتمال دون تغيير (لا يتغير طول المتجه) ، ولكن يتغير الاتجاه.

تخيل أن الكبسولة تكتشف وجهًا في صورة وتنتج متجهًا ثلاثي الأبعاد بطول 0.99. ثم حرك الوجه في الصورة. سوف يدور الناقل في فراغه ، مما يمثل حالة متغيرة ، لكن طوله سيظل ثابتًا لأن الكبسولة واثقة من أنها اكتشفت وجهًا.

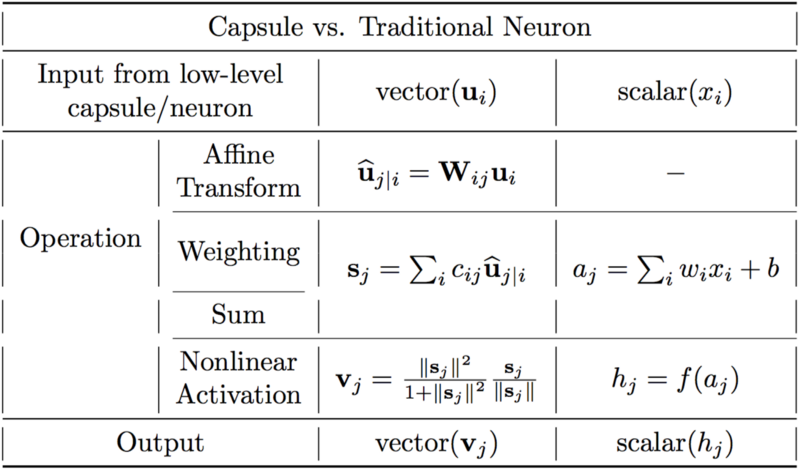

الاختلافات بين الكبسولات والخلايا العصبية. [2]

يمكن وصف العصبون الاصطناعي في ثلاث خطوات:

1. الترجيح القياسي لعددي المدخلات

2. مجموع مقاييس المدخلات المرجحة

3. التحول العددي غير الخطي.

تحتوي الكبسولة على أشكال متجهة للخطوات الثلاث المذكورة أعلاه ، بالإضافة إلى المرحلة الجديدة من تحويل المدخلات:

1. الضرب مصفوفة من ناقلات الإدخال

2. الترجيح القياسي لناقلات المدخلات

3. مجموع ناقلات المدخلات المرجحة

4. ناقلات اللاخطية.

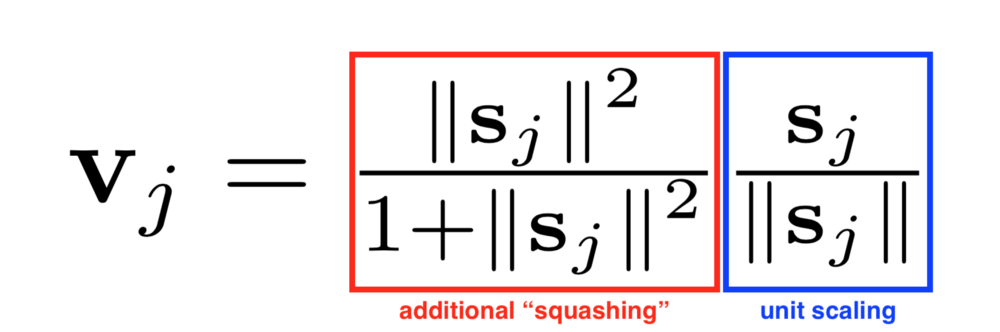

هناك ابتكار آخر تم تقديمه في CapsNet هو وظيفة تنشيط غير خطية جديدة تأخذ ناقلًا ثم "تعطي" طولها لا يزيد عن 1 ، ولكنها لا تغير الاتجاه.

يقوم الجانب الأيمن من المعادلة (مستطيل أزرق) بقياس متجه الإدخال بحيث يكون للمتجه طول كتلة ، ويقوم الجانب الأيسر (مستطيل أحمر) بتحجيم إضافي.

يعتمد تصميم الكبسولة على بناء عصبون اصطناعي ، ولكنه يمتد إلى شكل ناقل لتوفير قدرات تمثيلية أكثر قوة. يتم أيضًا إدخال أوزان المصفوفة لتشفير العلاقات الهرمية بين ميزات الطبقات المختلفة. يتم تحقيق توازن النشاط العصبي فيما يتعلق بالتغيرات في بيانات الإدخال والثبات في احتمالات الكشف عن العلامات.

التوجيه الديناميكي بين الكبسولات

خوارزمية التوجيه الديناميكي [1].

يقول السطر الأول أن هذا الإجراء يأخذ كبسولات في المستوى الأدنى l ومخرجاتها u_hat ، بالإضافة إلى عدد تكرارات التوجيه r. يقول السطر الأخير أن الخوارزمية ستنتج ناتج كبسولة أعلى مستوى v_j.

يحتوي السطر الثاني على معامل b_ij جديد لم نره من قبل. هذا المعامل هو قيمة مؤقتة سيتم تحديثها بشكل متكرر ، وبعد اكتمال الإجراء ، سيتم تخزين قيمته في c_ij. في بداية التدريب ، تتم تهيئة قيمة b_ij على الصفر.

يقول السطر 3 سيتم تكرار الخطوات 4-7 r مرة.

تحسب الخطوة في السطر 4 قيمة المتجه c_i ، وهو كل أوزان التوجيه للكبسولة السفلية i.

بعد حساب الأوزان c_ij لكبسولات المستوى الأدنى ، انتقل إلى السطر 5 ، حيث ننظر إلى الكبسولات ذات المستوى الأعلى. تحسب هذه الخطوة مجموعة خطية من متجهات الإدخال المرجحة باستخدام معاملات التوجيه c_ij المحددة في الخطوة السابقة.

بعد ذلك ، في السطر 6 ، تمر ناقلات الخطوة الأخيرة من خلال تحويل غير خطي ، والذي يضمن اتجاه المتجه ، ولكن يجب ألا يتجاوز طوله 1. تخلق هذه الخطوة متجه الإخراج v_j لجميع المستويات الأعلى من الكبسولة. [2]

الفكرة الأساسية هي أن التشابه بين المدخلات والمخرجات يقاس على أنه المنتج القياسي بين مدخلات ومخرجات الكبسولة ، ثم يتغير معامل التوجيه. أفضل ممارسة هي استخدام ثلاثة تكرارات توجيه.

الخلاصة

الشبكات العصبية المحفظة هي بنية واعدة للشبكات العصبية التي تعمل على تحسين التعرف على الصور مع تغيير الزوايا والبنية الهرمية. يتم تدريب الشبكات العصبية المحفظة باستخدام التوجيه الديناميكي بين الكبسولات. تقلل شبكات الكبسولة من خطأ التعرف على كائن من زاوية مختلفة بنسبة 45٪ مقارنة بشبكة CNN.

الروابط[1] كبسولات ماتريكس مع مسار EM. جيفري هينتون ، سارة صابور ، نيكولاس فروست. 2017.

[2] فهم شبكات كبسولات هينتون. ماكس بيشيونكين