Lidars والكاميرات عنصران للتكوين القياسي لأي جهاز robomobile تقريبًا. كل من العمل الأول والثاني مع الضوء المنعكس. في الوقت نفسه ، تعمل الكاميرات في الوضع السلبي ، أي أنها تلتقط انعكاسات مصادر الضوء من طرف ثالث ، لكن lidars تولد نبضات ليزر ، ثم تقيس "الاستجابة" المنعكسة من الأشياء القريبة. تشكل الكاميرات صورة ثنائية الأبعاد ، وتشكل الأغطية صورة ثلاثية الأبعاد ، مثل "سحابة نقطية".

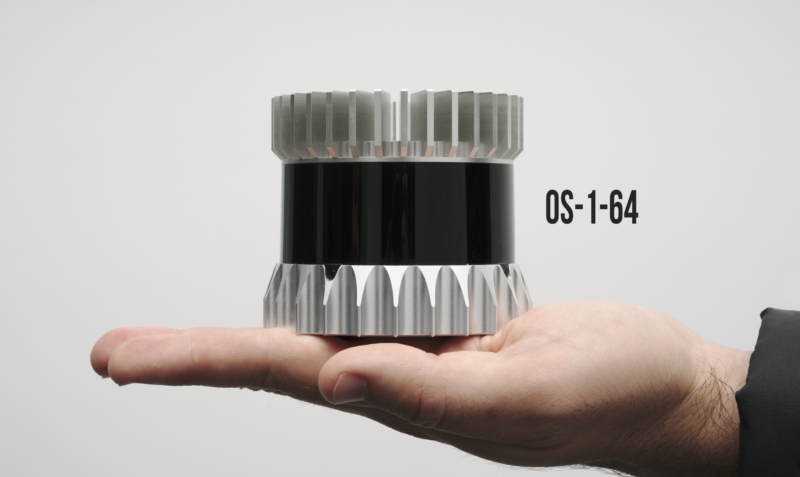

طور Ouster

جهازًا هجينًا يعمل ككاميرا وكليدار. يسمى هذا النظام OS-1. يحتوي هذا الجهاز على فتحة أكبر من معظم كاميرات DSLR ، والمستشعر الذي أنشأته الشركة حساس للغاية.

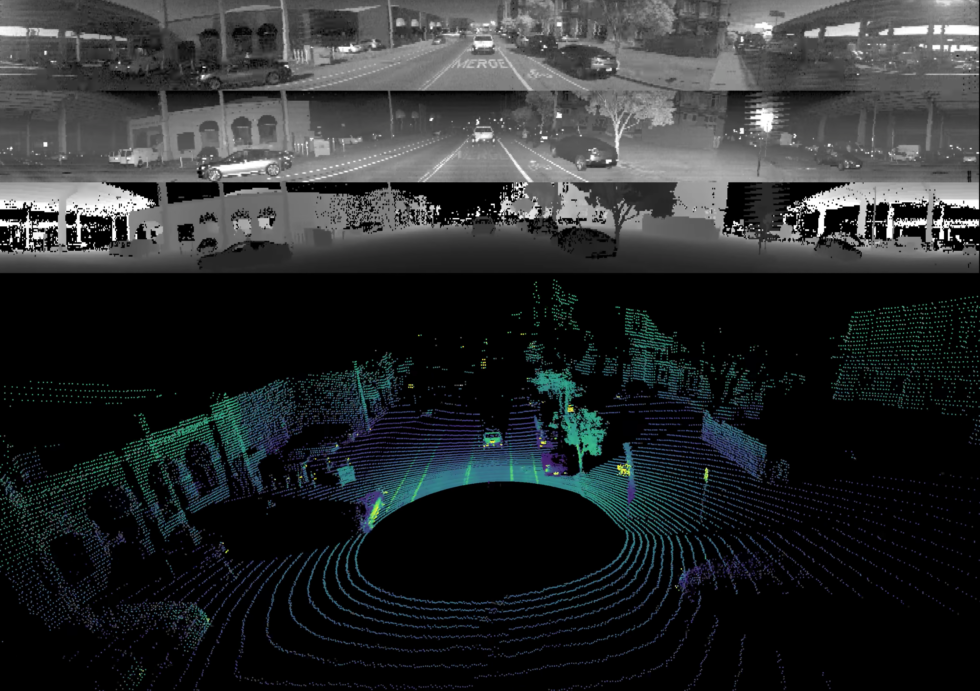

تتكون الصور التي حصل عليها النظام من ثلاث طبقات. الأول هو الصورة التي تم الحصول عليها كما لو كانت بواسطة كاميرا عادية. والثاني هو طبقة "ليزر" تم الحصول عليها باستخدام انعكاس شعاع الليزر. والثالثة هي الطبقة "العميقة" ، والتي تتيح لك تقدير المسافة بين وحدات البكسل الفردية للطبقتين الأوليين.

تجدر الإشارة إلى أن الصور لا تزال لديها قيود كبيرة. أولاً ، هذه صور منخفضة الدقة. ثانيًا ، هم أبيض وأسود ، وليس لونًا. ثالثًا ، لا يعمل الليدار مع مصدر ضوء مرئي ؛ فهو يتعامل مع طيف قريب من الأشعة تحت الحمراء.

في الوقت الحالي ، تكلفة الليدار مرتفعة جدًا - حوالي 12000 دولار. للوهلة الأولى ، لا يوجد أي نقطة في نظام يتلقى صورًا أقل دقة من الكاميرات القياسية ، ولكن التكاليف مثل جسر من الحديد الزهر. لكن المطورين يدعون أنه يتم استخدام مبدأ عمل مختلف هنا عن الحالة المعتادة.

هذه هي المواد الرسومية المقدمة من أوستر. تظهر هنا ثلاث طبقات من الصور و "صورة" عامة ناتجة عن

هذه هي المواد الرسومية المقدمة من أوستر. تظهر هنا ثلاث طبقات من الصور و "صورة" عامة ناتجة عنفي حالة نموذجية ، تجمع أجهزة الروبوت بين البيانات من عدة مصادر مختلفة ، الأمر الذي يستغرق وقتًا. تعمل الكاميرات والأغطية في أوضاع مختلفة ، والنتيجة مختلفة أيضًا. بالإضافة إلى ذلك ، عادة ما يتم تركيبها في أماكن مختلفة في جسم السيارة ، لذلك يجب على الكمبيوتر أيضًا التعامل مع ارتباط الصورة بحيث تكون متوافقة. علاوة على ذلك ، تتطلب أجهزة الاستشعار إعادة المعايرة بشكل منتظم ، وهو ليس بهذه البساطة.

لقد حاول بعض مطوري lidar بالفعل دمج الكاميرا مع lidar. لكن النتائج لم تكن جيدة للغاية. كان نظام "كاميرا قياسية + ليدار" ، والذي لم يختلف كثيرًا عن المخططات الحالية.

يستخدم Ouster بدلاً من ذلك نظامًا يسمح لـ OS-1 بجمع جميع البيانات في معيار واحد ومن موقع واحد. ترتبط جميع طبقات الصورة الثلاث بشكل مثالي ، في الوقت والمكان. في هذه الحالة ، يفهم الكمبيوتر المسافة بين وحدات البكسل الفردية للصورة النهائية.

وفقًا لمؤلفي المشروع ، فإن مثل هذا المخطط مثالي تقريبًا لتعلم الآلة. بالنسبة لأنظمة الكمبيوتر ، فإن معالجة هذا النوع من الصور ليست صعبة. بعد "تغذية" النظام بعدة مئات من الصور ، يمكن تدريبه على فهم ما يظهر بالضبط في "الصورة" النهائية.

تم تصميم بعض أنواع الشبكات العصبية بطريقة تعمل مع طبقات متعددة من خرائط البكسل دون مشاكل. بالإضافة إلى ذلك ، قد تحتوي الصور على طبقة حمراء وزرقاء وخضراء. ليس من الصعب تدريب هذه الأنظمة على العمل مع نتيجة OS-1. لقد حقق أوستر هذا بالفعل.

كمواد المصدر ، أخذوا العديد من الشبكات العصبية التي تم تصميمها للتعرف على صور RGB ، وتعديلها لتناسب احتياجاتهم ، وتعليمهم كيفية العمل مع طبقات مختلفة من صورهم. تتم معالجة البيانات على المعدات باستخدام Nvidia GTX 1060. باستخدام الشبكات العصبية ، تم تعليم كمبيوتر السيارة "رسم" الطريق باللون الأصفر ، والعقبات المحتملة - السيارات الأخرى - باللون الأحمر.

وفقًا للمطورين ، فإن نظامهم بالإضافة إلى الأنظمة الحالية ، وليس بديلاً. من الأفضل الجمع بين جميع أنواع المستشعرات والمستشعرات والكاميرات والأغطية والأنظمة الهجينة لتكوين صورة واضحة للبيئة تساعد السيارة على التنقل.