في الجزء الأول ، تعرفنا على طرق تكييف المجال من خلال التعلم العميق. تحدثنا عن مجموعات البيانات الرئيسية ، وكذلك المناهج غير التوليدية القائمة على التناقض والقائمة على الخصومة. تعمل هذه الأساليب بشكل جيد لبعض المهام. وهذه المرة سوف نحلل الطرق الأكثر تعقيدًا والواعدة القائمة على الخصومة: النماذج التوليدية ، بالإضافة إلى الخوارزميات التي تُظهر أفضل النتائج في مجموعة بيانات VisDA (التعديلات من البيانات الاصطناعية إلى الصور الحقيقية).

نماذج مولدة

أساس هذا النهج هو قدرة GAN على توليد البيانات من التوزيع الضروري. بفضل هذه الخاصية ، يمكنك الحصول على الكمية الصحيحة من البيانات الاصطناعية واستخدامها للتدريب. الفكرة الرئيسية للطرق من عائلة النماذج التوليدية هي توليد البيانات باستخدام مجال المصدر مشابه قدر الإمكان لممثلي المجال المستهدف. وبالتالي ، فإن البيانات الاصطناعية الجديدة سيكون لها نفس التسميات مثل ممثلي المجال الأصلي على أساسها. ثم يتم ببساطة تدريب نموذج المجال الهدف على هذه البيانات التي تم إنشاؤها.

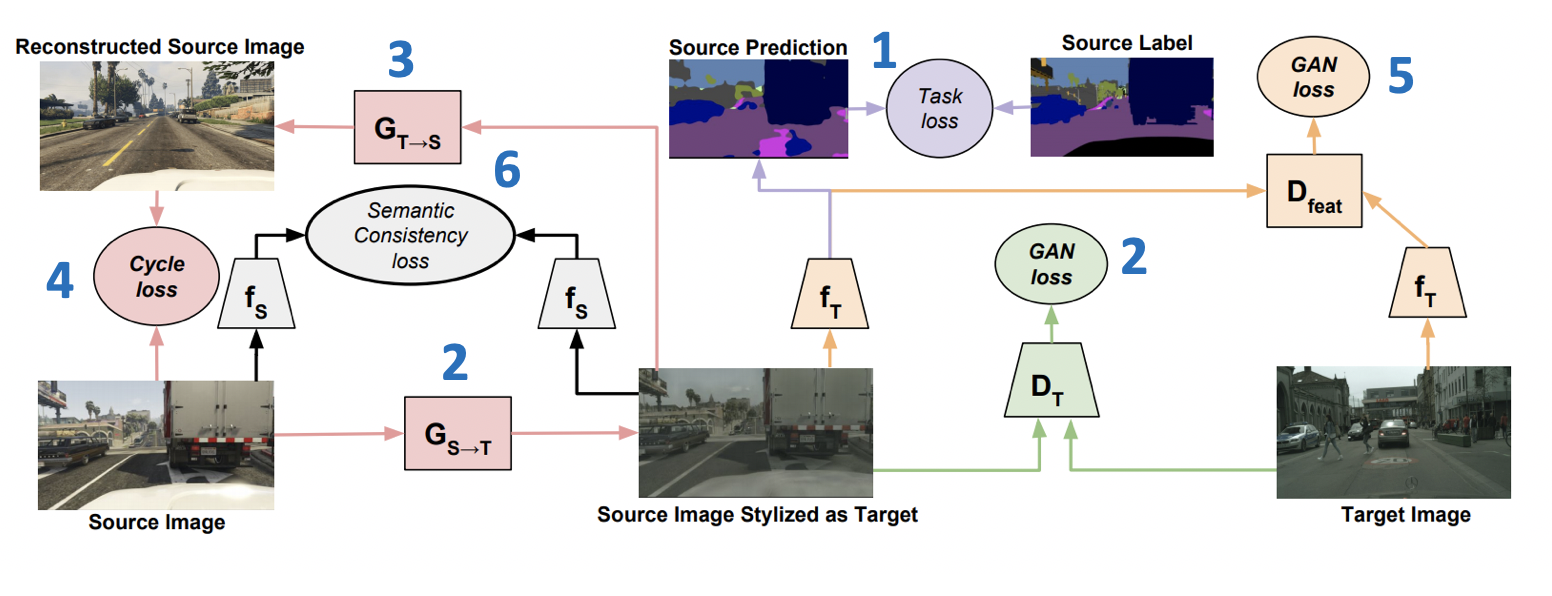

تم تقديم طريقة CyCADA في ICML-2018 : تكييف المجال ( الكود ) المتوافق مع الدورات المتوافقة مع الدورة هو عضو تمثيلي لعائلة النماذج التوليدية. يجمع بين العديد من الأساليب الناجحة من GANs وتكييف المجال. جزء مهم من هذا هو استخدام فقدان تناسق الدورة ، الذي تم تقديمه لأول مرة في مقالة عن CycleGAN . إن فكرة فقدان تناسق الدورة هي أن الصورة التي تم الحصول عليها من المصدر إلى المجال الهدف ، متبوعة بالتحويل العكسي ، يجب أن تكون قريبة من الصورة الأولية. بالإضافة إلى ذلك ، يتضمن CyCADA التكيف على مستوى البكسل وعلى مستوى تمثيلات المتجهات ، بالإضافة إلى الخسارة الدلالية لحفظ الهيكل في الصورة التي تم إنشاؤها.

دع fT و fS - شبكات للنطاق المستهدف ومجال المصدر ، على التوالي ، XT و XS - مجالات الهدف والمصدر ، YS - الترميز على المجال المصدر ، GS−>T و GT−>S - مولدات من المصدر إلى المجال المستهدف والعكس بالعكس ، DT و DS - تمييز الانتماء إلى المجال المستهدف والمصدر ، على التوالي. ثم وظيفة الخسارة ، التي تم تصغيرها في CyCADA ، هي مجموع ست وظائف للخسارة (يتم عرض مخطط التدريب مع أرقام الخسارة أدناه):

- Ltask(fT،GS−>T(XS)،YS) - تصنيف النموذج fT على البيانات التي تم إنشاؤها والعلامات الزائفة من المجال المصدر.

- LGAN(GS−>T،DT،XT،XS) - خسارة الخصومة لتدريب المولدات GS−>T .

- LGAN(GT−>S،DS،XS،XT) - خسارة الخصومة لتدريب المولدات GT−>S .

- Lcyc(GS−>T،GT−>S،XS،XT) (خسارة تناسق الدورة) - L1 -فقدان ، ضمان أن الصور التي تم الحصول عليها من GS−>T و GT−>S سيتم إغلاق.

- LGAN(fT،Dfeat،fS(GS−>T(XS))،XT) - خسارة الخصومة لتمثيلات ناقلات fT و fS على البيانات التي تم إنشاؤها (على غرار ما يتم استخدامه في ADDA).

- Lsem(GS−>T،GT−>S،XS،XT،fS) (خسارة الاتساق الدلالي) - L1 الخسارة ، المسؤولة عن حقيقة ذلك fS وبالمثل ستعمل على الصور التي تم الحصول عليها من GS−>T كلاهما من GT−>S .

نتائج سيكادا:

- على زوج من المجالات الرقمية USPS -> MNIST: 95.7٪.

- حول مهمة التجزئة GTA 5 -> مناظر المدينة: يعني IoU = 39.5٪.

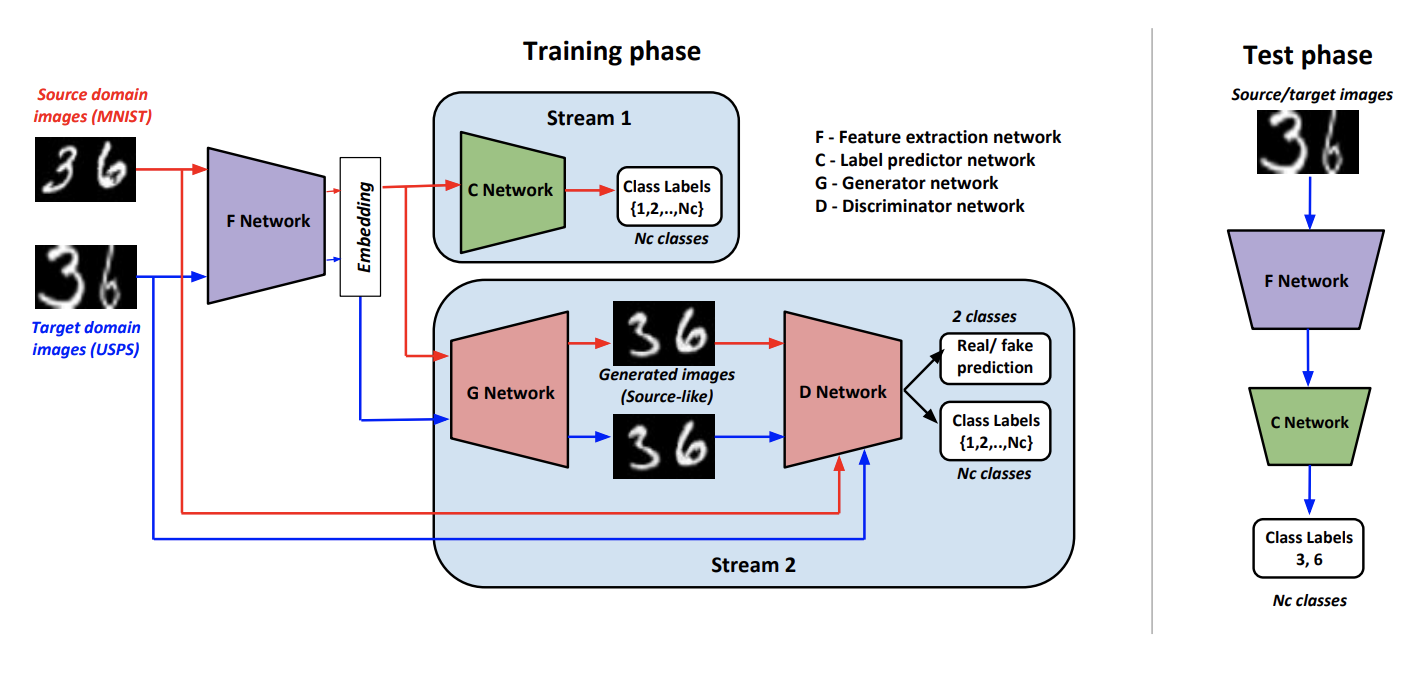

كجزء من النهج ، Generate To Adapt: Aligning Domains باستخدام Genersative Adversarial Networks ( Code ) تدريب مثل هذا المولد G بحيث ينتج عند الإخراج صورًا قريبة من المجال الأصلي. مثل G يسمح لك بتحويل البيانات من المجال المستهدف وتطبيق المصنف المدرب على البيانات المرمزة للمجال المصدر عليهم.

لتدريب مثل هذا المولد ، يستخدم المؤلفون أداة تمييز معدلة D من المادة AC-GAN . ميزة هذا D يتألف من حقيقة أنه لا يجيب فقط 1 إذا كان المدخل من مصدر المصدر ، و 0 خلاف ذلك ، ولكن أيضًا في حالة إجابة إيجابية يصنف بيانات الإدخال وفقًا لفئات المجال المصدر.

نشير F مثل شبكة تلافيفية تنتج تمثيل متجه للصورة ، C - مصنف يعمل على ناقل مشتق من F . خوارزميات التعلم والاستدلال:

تتكون إجراءات التدريب من عدة مكونات:

- المميّز D يتعلم تحديد المجال لجميع وردت من G البيانات ، وبالنسبة للمجال المصدر ، لا تزال تتم إضافة خسارة التصنيف ، كما هو موضح أعلاه.

- على البيانات من المجال المصدر G باستخدام مزيج من خسارة الخصومة وخسارة التصنيف ، يتم تدريبها على توليد نتيجة مشابهة لمجال المصدر ، وتصنيفها بشكل صحيح D .

- F و C تعلم كيفية تصنيف البيانات من المجال المصدر. أيضا F بمساعدة فقدان تصنيف آخر ، يتم تغييره لزيادة جودة التصنيف D .

- باستخدام خسارة الخصومة F يتعلم "الغش" D على البيانات من المجال المستهدف.

- استنتج المؤلفون تجريبيا ذلك قبل الخضوع G من المنطقي تسلسل ناقل من F مع الضوضاء العادية وناقلات الدرجة الأولى ( K+1 للبيانات المستهدفة).

نتائج الطريقة على المعايير:

- في المجالات الرقمية USPS -> MNIST: 90.8٪.

- في مجموعة بيانات Office ، يبلغ متوسط جودة التكيف لأزواج Amazon و Webcam 86.5٪.

- في مجموعة بيانات VisDA ، يبلغ متوسط قيمة الجودة لـ 12 فئة بدون فئة غير معروفة 76.7٪.

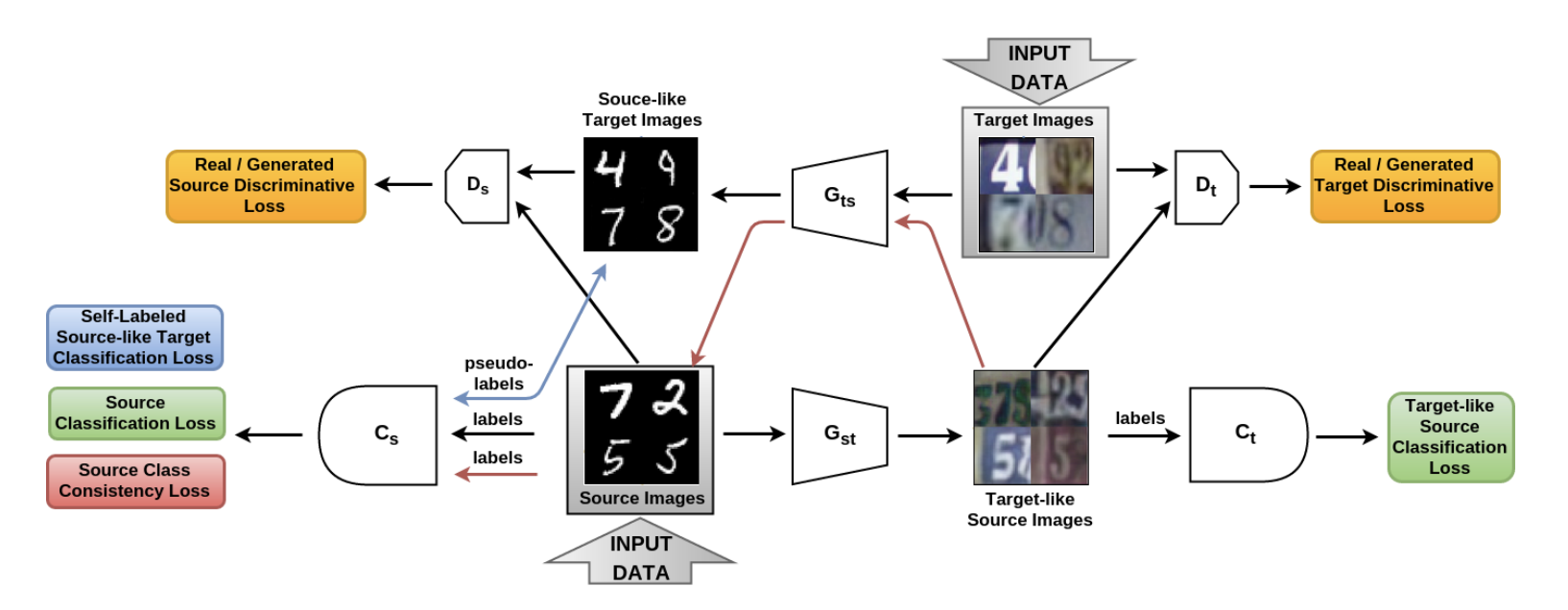

في المقالة من المصدر إلى الهدف والعكس: GAN التكيفي المتماثل ثنائي الاتجاه ، تم تقديم نموذج SBADA-GAN ، والذي يشبه إلى حد كبير CyCADA والذي تتكون وظيفته المستهدفة ، مثل CyCADA ، من 6 مكونات. في تدوين المؤلفين Gst و Gts - مولدات من المجال المصدر إلى الهدف والعكس بالعكس ، Ds و Dt - التمييز الذي يميز البيانات الحقيقية عن البيانات المتولدة في المجال المصدر والهدف ، على التوالي ، Cs و Ct - المصنفات التي يتم تدريبها على البيانات من المجال المصدر وعلى نسخها المحولة إلى المجال المستهدف.

يستخدم SBADA-GAN ، مثل CyCADA ، فكرة CycleGAN وفقدان الاتساق والعلامات الزائفة للبيانات التي تم إنشاؤها في المجال الهدف ، وتأليف الوظيفة المستهدفة من المصطلحات المقابلة. تتضمن ميزات SBADA-GAN ما يلي:

- يتم تغذية الصورة + الضجيج لإدخال المولدات.

- يستخدم الاختبار مجموعة خطية من تنبؤات النموذج المستهدف والنموذج المصدر بناءً على التحول Gst .

خطة التدريب SBADA-GAN:

أجرى مؤلفو SBADA-GAN تجارب أكثر من مؤلفي CyCADA ، وحصلوا على النتائج التالية:

- على USPS -> مجالات MNIST: 95.0٪.

- على MNIST -> مجالات SVHN: 61.1٪.

- على لافتات الطرق لافتات موالفة -> GTSRB: 97.7٪.

من عائلة النماذج التوليدية ، من المنطقي النظر في المقالات الهامة التالية:

تحدي التكيف مع المجال البصري

كجزء من ورشة العمل ، تستضيف مؤتمرات ECCV و ICCV مسابقة تكيف مجال تحدي المجال المرئي . في ذلك ، يتم دعوة المشاركين لتدريب المصنف على البيانات الاصطناعية وتكييفها مع البيانات غير المخصصة من ImageNet.

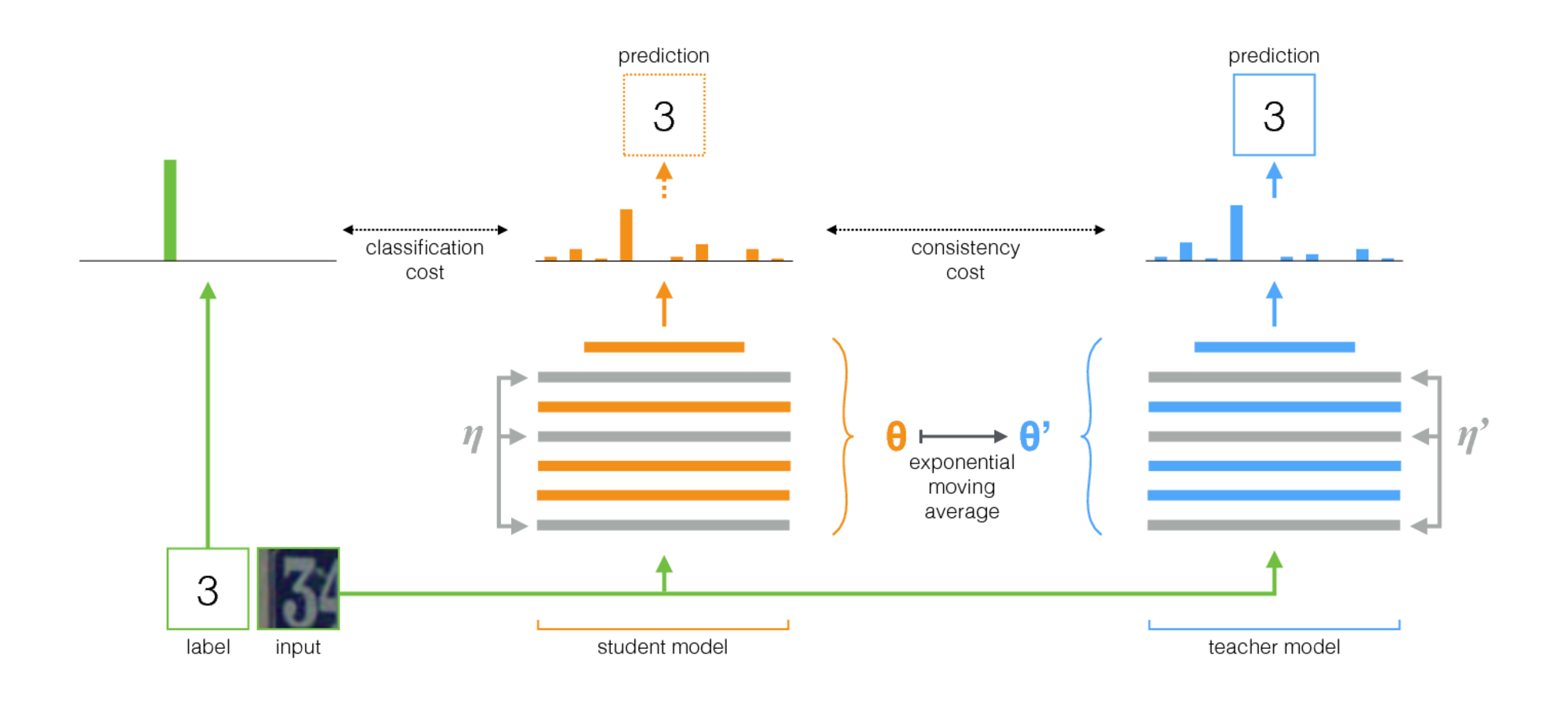

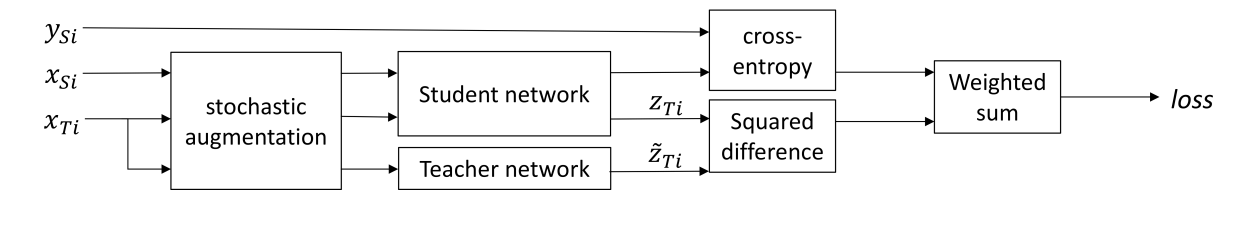

فازت الخوارزمية المقدمة في التجميع الذاتي لتكيف المجال البصري ( الكود ) في VisDA-2017. تعتمد هذه الطريقة على فكرة التجميع الذاتي: هناك شبكة المعلمين (نموذج المعلم) وشبكة الطلاب. عند كل تكرار ، يتم تشغيل صورة الإدخال عبر كلتا الشبكتين. يتم تدريب الطالب باستخدام مجموع خسارة التصنيف وفقدان الاتساق ، حيث يكون فقدان التصنيف هو الإنتروبيا المعتادة مع تسمية فئة معروفة ، وفقدان الاتساق هو متوسط الفرق التربيعي بين توقعات المعلم والطالب (الفرق التربيعي). يتم حساب أوزان شبكة المعلمين كمتوسط متحرك أسي لأوزان شبكة الطلاب. هذا الإجراء التدريبي موضح أدناه.

الميزات الهامة لتطبيق هذه الطريقة لتكييف المجال هي:

- في مجموعة التدريب ، يتم خلط البيانات من مجال المصدر xSi مع تصنيفات الفصل ySi والبيانات من المجال الهدف xTi بدون علامات.

- قبل إدخال الصور إلى الشبكات العصبية ، يتم تطبيق العديد من التعزيزات القوية: الضوضاء الغوسية ، والتحولات الألفة ، وما إلى ذلك.

- استخدمت كلتا الشبكتين أساليب تسوية قوية (مثل التسرب).

- zTi - مخرجات شبكة الطلاب ، widetildezTi - مدرسو الشبكات. إذا كان الإدخال من المجال الهدف ، فعندئذٍ فقط فقدان الاتساق بين zTi و widetildezTi ، خسارة الإنتروبيا = 0.

- من أجل استدامة التعلم ، يتم استخدام عتبة الثقة: إذا كان توقع المعلم أقل من العتبة (0.9) ، عندئذٍ فقدان فقدان الاتساق = 0.

مخطط الإجراء الموصوف:

على مجموعات البيانات الرئيسية ، حققت الخوارزمية أداءً عاليًا. صحيح ، اختار المؤلفون بشكل منفصل مجموعة من التعزيزات لكل مهمة.

- USPS -> MNIST: 99.54٪.

- MNIST -> SVHN: 97.0٪.

- أرقام المركب -> SVHN: 97.11٪.

- على لافتات الطرق لافتات موالفة -> GTSRB: 99.37٪.

- في مجموعة بيانات VisDA ، يبلغ متوسط جودة الجودة لـ 12 فئة بدون فئة غير معروفة 92.8٪. من المهم ملاحظة أن هذه النتيجة تم الحصول عليها باستخدام مجموعة مكونة من 5 نماذج واستخدام زيادة وقت الاختبار.

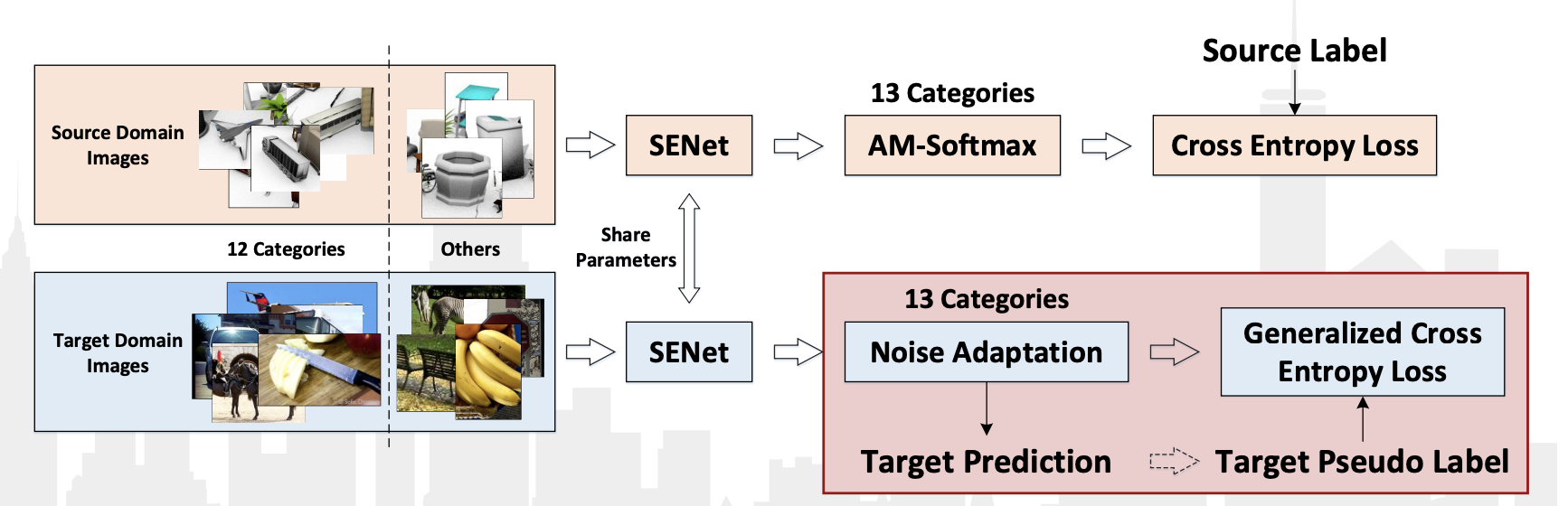

أقيمت مسابقة VisDA-2018 هذا العام كجزء من مؤتمر ECCV-2018. هذه المرة أضافوا الفصل الثالث عشر: غير معروف ، والذي حصل على كل ما لم يندرج في 12 صفًا. بالإضافة إلى ذلك ، عقدت مسابقة منفصلة للكشف عن الأشياء التي تنتمي إلى هذه الفئات 12. في كلتا الفئتين ، فاز الفريق الصيني JD JD Research . في مسابقة التصنيف ، حققوا نتيجة 92.3٪ (متوسط قيمة الجودة في 13 فئة). لا توجد منشورات مع وصف مفصل لطريقتهم ، لا يوجد سوى عرض تقديمي من ورشة العمل .

من ميزات الخوارزمية الخاصة بهم يمكن ملاحظتها:

- استخدام العلامات الزائفة للبيانات من المجال المستهدف وإعادة تدريب المصنف عليها مع البيانات من المجال المصدر.

- باستخدام شبكة الالتفاف SE-ResNeXt-101 و AM-Softmax وطبقة التكيف مع الضوضاء ، فقد الانتروبيا المتقاطعة المعمم للبيانات من المجال المستهدف.

مخطط الخوارزمية من العرض التقديمي:

الخلاصة

لقد ناقشنا في الغالب طرق التكيف القائمة على النهج القائم على الخصومة. ومع ذلك ، في آخر مسابقتين لـ VisDA ، فازت الخوارزميات التي لم تكن مرتبطة بها واستخدام التدريب على العلامات الزائفة وتعديلات طرق التعلم العميق الأكثر كلاسيكية. في رأيي ، هذا يرجع إلى حقيقة أن الأساليب القائمة على GANs لا تزال فقط في بداية تطورها وغير مستقرة للغاية. ولكن كل عام نحصل على المزيد والمزيد من النتائج الجديدة التي تحسن عمل GANs. بالإضافة إلى ذلك ، يركز اهتمام المجتمع العلمي في مجال تكييف المجال بشكل أساسي على الأساليب القائمة على الخصومة ، وتدرس المقالات الجديدة هذا النهج بشكل أساسي. لذلك ، من المحتمل أن تأتي الخوارزميات المرتبطة بشبكات GAN تدريجيًا في المقدمة في قضايا التكيف.

لكن البحث في المناهج غير العدائية مستمر أيضًا. فيما يلي بعض المقالات المثيرة للاهتمام من هذا المجال:

يمكن تصنيف الطرق القائمة على التناقض على أنها "تاريخية" ، ولكن العديد من الأفكار المستخدمة في أحدث الأساليب: MMD ، والعلامات الزائفة ، والتعلم المتري ، إلخ. بالإضافة إلى ذلك ، في بعض الأحيان في مشاكل التكيف البسيطة ، من المنطقي تطبيق هذه الأساليب بسبب سهولة التدريب النسبية وتفسير النتائج بشكل أفضل.

في الختام ، أود أن أشير إلى أن طرق تكييف المجال لا تزال تبحث عن تطبيقها في المجالات التطبيقية ، ولكن هناك المزيد والمزيد من المهام الواعدة التي تتطلب استخدام التكيف. على سبيل المثال ، يتم استخدام تكيف المجال بنشاط في تدريب وحدات السيارات المستقلة : نظرًا لأنها مكلفة وتستغرق وقتًا طويلاً لجمع بيانات حقيقية في شوارع المدينة لتدريب الطيار الآلي ، تستخدم السيارات المستقلة البيانات الاصطناعية (قواعد بيانات SYNTHIA و GTA 5 بمثابة أمثلة لها) ، على وجه الخصوص. لحل مشكلة تجزئة ما "ترى" الكاميرا من السيارة.

يعتمد الحصول على نماذج عالية الجودة استنادًا إلى التدريب المتعمق في Computer Vision إلى حد كبير على توافر مجموعات البيانات الكبيرة المسمى للتدريب. يتطلب الترميز دائمًا الكثير من الوقت والمال ، مما يزيد بشكل كبير من دورة تطوير النماذج ، ونتيجة لذلك ، المنتجات المعتمدة عليها.

تهدف طرق تكييف المجال إلى حل هذه المشكلة ويمكن أن تسهم في تحقيق اختراق في العديد من المشكلات التطبيقية وفي الذكاء الاصطناعي بشكل عام. يعد نقل المعرفة من مجال إلى آخر مهمة صعبة ومثيرة للاهتمام حقًا ، والتي تجري دراستها حاليًا بنشاط. إذا كنت تعاني من نقص البيانات في مهامك ، ويمكنك محاكاة البيانات أو العثور على نطاقات مماثلة ، فإنني أوصي بتجربة طرق تكيف المجال!