تتكون المقالة من جزأين:

- وصف موجز لبعض أبنية الشبكات لاكتشاف الكائنات في تجزئة الصورة والصورة مع روابط لمصادر أكثر قابلية للفهم بالنسبة لي. حاولت اختيار توضيحات الفيديو ويفضل باللغة الروسية.

- الجزء الثاني هو محاولة لفهم اتجاه تطوير أبنية الشبكة العصبية. والتقنيات القائمة عليها.

الشكل 1 - فهم بنية الشبكات العصبية ليس بالأمر السهل

بدأ كل شيء بحقيقة أنه قدم تطبيقين تجريبيين لتصنيف الكائنات واكتشافها على هاتف Android:

- العرض التوضيحي الخلفي ، عندما تتم معالجة البيانات على الخادم ونقلها إلى الهاتف. تصنيف الصورة من ثلاثة أنواع من الدببة: البني والأسود و تيدي.

- عرض توضيحي للجهة الأمامية عند معالجة البيانات على الهاتف نفسه. كائن الكشف عن ثلاثة أنواع: البندق والتين والتمر.

هناك فرق بين مهام تصنيف الصور ، وكشف الكائنات في صورة ، وتقسيم الصور . لذلك ، كانت هناك حاجة لمعرفة أي بنيات الشبكة العصبية تكتشف الكائنات الموجودة في الصور وتلك التي يمكن تقسيمها. لقد وجدت الأمثلة التالية للهندسة المعمارية التي بها أكثر الروابط مفهومة للموارد بالنسبة لي:

- سلسلة من البنيات القائمة على R-CNN (مثل R مع ميزات C onvolution N etural N etworks): R-CNN ، Fast R-CNN ، Faster R-CNN ، Mask R-CNN . لاكتشاف كائن في صورة ما باستخدام آلية Region Proposal Network (RPN) ، يتم تخصيص مربعات ربط. في البداية ، تم استخدام آلية البحث الانتقائي الأبطأ بدلاً من RPN. بعد ذلك ، يتم تغذية المناطق المحدودة المحددة لمدخلات الشبكة العصبية العادية للتصنيف. في بنية R-CNN توجد دورات تعداد "واضحة" صريحة على مناطق محدودة ، يصل إجماليها إلى 2000 عبر شبكة AlexNet الداخلية. نظرًا للحلقات الصريحة "لـ" ، يتم إبطاء سرعة معالجة الصور. يتناقص عدد الدورات الصريحة ، التي تمر عبر الشبكة العصبية الداخلية ، مع كل إصدار جديد من البنية ، ويتم إجراء عشرات التغييرات الأخرى لزيادة السرعة واستبدال مهمة اكتشاف الكائنات بتجزئة الكائنات في Mask R-CNN.

- YOLO ( Y ou O nly L ook O nce) هي أول شبكة عصبية تتعرف على الكائنات في الوقت الفعلي على الأجهزة المحمولة. ميزة مميزة: تمييز الأشياء في تشغيل واحد (انظر مرة واحدة فقط). وهذا يعني أنه لا توجد حلقات "ل" صريحة في بنية YOLO ، وهذا هو السبب في أن الشبكة سريعة. على سبيل المثال ، هذا تشبيه: في NumPy ، لا توجد حلقات "واضحة" صريحة في العمليات مع المصفوفات ، والتي يتم تنفيذها في NumPy بمستويات أقل من الهندسة المعمارية من خلال لغة البرمجة C. تستخدم YOLO شبكة من الإطارات المعرفة مسبقًا. لمنع اكتشاف نفس الكائن عدة مرات ، يتم استخدام معامل تداخل النافذة (IoU ، Intersection o ver Union). تعمل هذه البنية في مجموعة واسعة ومتانة عالية: يمكن تدريب النموذج على الصور الفوتوغرافية ، ولكن في نفس الوقت يعمل بشكل جيد في اللوحات المرسومة.

- يتم استخدام SSD ( S ingle S hot MultiBox D etector) - "الخارقة" الأكثر نجاحًا في بنية YOLO (على سبيل المثال ، الكبت غير الأقصى) وإضافة أخرى جديدة لجعل الشبكة العصبية أسرع وأكثر دقة. الميزة المميزة: تمييز الأشياء في تشغيل واحد باستخدام شبكة معينة من النوافذ (المربع الافتراضي) على هرم الصور. يتم تشفير هرم الصور في توترات الالتواء أثناء عمليات الالتفاف والتجميع المتتالية (مع عملية التجميع القصوى ، البعد المكاني يتناقص). بهذه الطريقة ، يتم تحديد الكائنات الكبيرة والصغيرة في تشغيل شبكة واحدة.

- MobileSSD ( Mobile NetV2 + SSD ) هو مزيج من تصميمين للشبكة العصبية. أول شبكة MobileNetV2 سريعة وتزيد من دقة الاعتراف. يتم استخدام MobileNetV2 بدلاً من VGG-16 ، والذي تم استخدامه أصلاً في المقالة الأصلية . تحدد شبكة SSD الثانية موقع الكائنات في الصورة.

- SqueezeNet هي شبكة عصبية صغيرة للغاية ولكنها دقيقة. في حد ذاته ، فإنه لا يحل مشكلة اكتشاف الأشياء. ومع ذلك ، يمكن استخدامه مع مجموعة من الهياكل المختلفة. ويمكن استخدامها على الأجهزة المحمولة. الميزة المميزة هي أنه أولاً يتم ضغط البيانات إلى أربعة مرشحات تلافيفية 1 × 1 ، ثم يتم توسيعها إلى أربعة مرشحات تلافيفية 1 × 1 وأربعة 3 × 3. يسمى هذا التكرار لتوسيع ضغط البيانات "وحدة النار".

- DeepLab (تجزئة الصور الدلالية مع شبكات تلافيفية عميقة) - تجزئة الكائنات في الصورة. السمة المميزة للعمارة هي الإلتواء المخفف ، الذي يحافظ على الدقة المكانية. يتبع ذلك مرحلة مرحلة ما بعد معالجة النتائج باستخدام نموذج احتمالي بياني (حقل عشوائي مشروط) ، والذي يسمح لك بإزالة ضوضاء صغيرة في التقسيم وتحسين جودة الصورة المقسمة. خلف الاسم الهائل "النموذج الاحتمالي الرسومي" يوجد المرشح الغوسي المعتاد ، والذي يتم تقريبه بخمس نقاط.

- حاولت فهم جهاز RefineDet (Single-Shot Refine ment Network Neural Network for Object Object) ، لكنني فهمت القليل جدًا.

- نظرت أيضًا إلى كيفية عمل تقنية الانتباه: video1 ، video2 ، video3 . تتمثل الميزة المميزة لهندسة "الاهتمام" في التخصيص التلقائي للمناطق ذات الاهتمام المتزايد بالصورة (RoI ، R egions o f Iterest) باستخدام شبكة عصبية تسمى Attention Unit. تتشابه المناطق ذات الاهتمام المتزايد مع المناطق المحدودة (الصناديق المحيطة) ، ولكن على عكسها ، فهي غير مثبتة على الصورة وقد تكون لها حدود ضبابية. ثم ، من المناطق التي تحظى باهتمام متزايد ، يتم تمييز الميزات (الميزات) التي يتم تغذيتها على الشبكات العصبية المتكررة مع بنى LSDM أو GRU أو Vanilla RNN . الشبكات العصبية العودية قادرة على تحليل العلاقة بين العلامات في تسلسل. تم استخدام الشبكات العصبية التكرارية في الأصل لترجمة النص إلى لغات أخرى ، والآن لترجمة الصور إلى نص ونص إلى صور .

عندما درست هذه البنى ، أدركت أنني لم أفهم شيئًا . وهذه النقطة ليست أن شبكتي العصبية لديها مشاكل مع آلية الاهتمام. يبدو إنشاء كل هذه البنى وكأنه نوع من الاختراقات الضخمة حيث يتنافس المؤلفون في الاختراقات. هاك هو حل سريع لمهمة البرنامج الصعب. أي أنه لا يوجد اتصال منطقي واضح ومفهوم بين كل هذه البنيات. كل ما يوحدهم هو مجموعة من أكثر المتطفلين نجاحًا والتي يستعيرونها من بعضهم البعض ، بالإضافة إلى عملية تشويش شائعة مع ردود الفعل (الانتشار العكسي للخطأ ، backpropagation). لا تفكير منهجي ! ليس من الواضح ما الذي يجب تغييره وكيفية تحسين الإنجازات الحالية.

نتيجة لعدم وجود اتصال منطقي بين المتسللين ، من الصعب للغاية تذكرهم ووضعهم موضع التنفيذ. هذه هي المعرفة مجزأة. في أفضل الأحوال ، يتم تذكر عدة لحظات مثيرة للاهتمام وغير متوقعة ، ولكن معظم ما هو مفهوم وغير مفهوم يختفي من الذاكرة في غضون بضعة أيام. سيكون من الجيد أن أتذكر في الأسبوع اسم العمارة على الأقل. لكن الأمر استغرق عدة ساعات وحتى أيام من وقت العمل لقراءة المقالات ومشاهدة مقاطع الفيديو المراجعة!

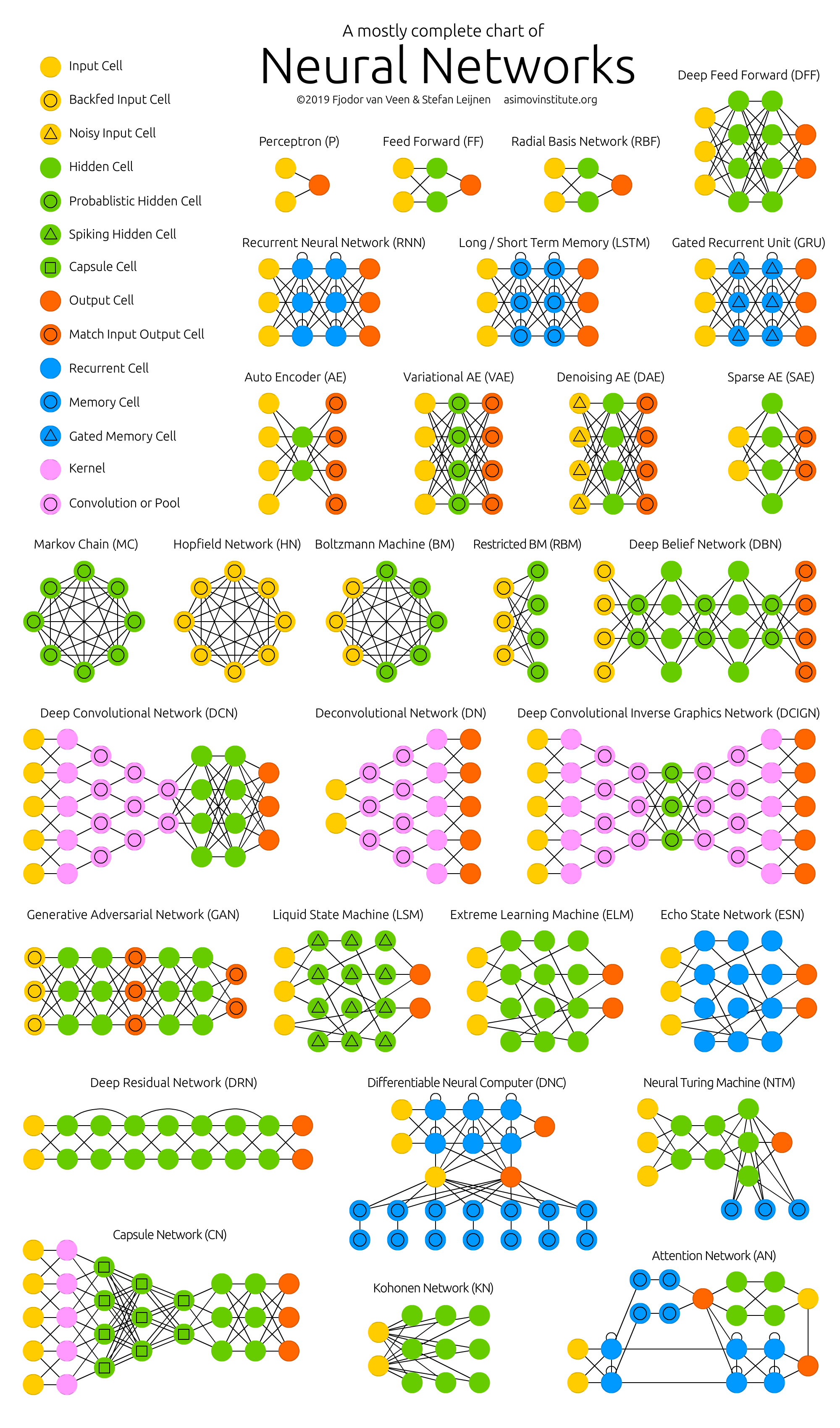

الشكل 2 - حديقة الحيوان من الشبكات العصبية

معظم مؤلفي المقالات العلمية ، في رأيي الشخصي ، يبذلون قصارى جهدهم حتى لا يفهم القارئ هذه المعرفة المجزأة. لكن المشاركين في عشر جمل سطر مع الصيغ التي اتخذت "من السقف" هو موضوع لمقال منفصل (مشكلة النشر أو الهلاك ).

لهذا السبب ، أصبح من الضروري تنظيم المعلومات على الشبكات العصبية ، وبالتالي زيادة جودة الفهم والحفظ. لذلك ، كان الموضوع الرئيسي لتحليل التقنيات الفردية وهندسة الشبكات العصبية الاصطناعية المهمة التالية: لمعرفة أين يتحرك كل هذا ، وليس جهاز أي شبكة عصبية معينة بشكل منفصل.

أين هو كل هذا يحدث. النتائج الرئيسية:

- انخفض عدد الشركات الناشئة في مجال التعلم الآلي انخفاضًا حادًا في العامين الماضيين. السبب المحتمل: "الشبكات العصبية لم تعد شيئًا جديدًا".

- سيكون الجميع قادرين على إنشاء شبكة عصبية تعمل على حل مشكلة بسيطة. للقيام بذلك ، خذ النموذج النهائي من "حديقة الحيوان النموذجية" وقم بتدريب الطبقة الأخيرة من الشبكة العصبية ( نقل التعلم ) على البيانات النهائية من Google Dataset Search أو من 25 ألف مجموعة بيانات Kaggle في سحابة Jupyter Notebook المجانية.

- بدأت الشركات المصنعة الكبرى للشبكات العصبية لإنشاء "حدائق الحيوان النموذجية" (حديقة الحيوان النموذجية). باستخدامها ، يمكنك إنشاء تطبيق تجاري بسرعة: TF Hub لـ TensorFlow ، و MMDetection for PyTorch ، و Detectron for Caffe2 ، و chainer-modelzoo لـ Chainer وغيرها .

- الشبكات العصبية في الوقت الحقيقي على الأجهزة المحمولة. 10 إلى 50 لقطة في الثانية.

- استخدام الشبكات العصبية في الهواتف (TF Lite) ، وفي المتصفحات (TF.js) وفي الأدوات المنزلية (إنترنت الأشياء ، الإنترنت و T hings). خاصة في الهواتف التي تدعم بالفعل الشبكات العصبية على مستوى الأجهزة (مسرع الأعصاب).

- "سيكون لكل جهاز وملابس وربما حتى طعام عنوان IP-v6 والتواصل مع بعضهم البعض" - سيباستيان ترون .

- بدأت الزيادة في منشورات التعلم الآلي تتجاوز قانون مور (يتضاعف كل عامين) منذ عام 2015. من الواضح ، هناك حاجة إلى تحليل المادة الشبكات العصبية.

- التقنيات التالية تكتسب شعبية:

- PyTorch - شعبية ينمو بسرعة ويبدو أنه تجاوز TensorFlow.

- التحديد التلقائي لمقاييس AutoML - شعبية تتزايد بسلاسة.

- انخفاض تدريجي في الدقة والزيادة في سرعة الحساب: المنطق الغامض ، وتعزيز الخوارزميات ، والحسابات غير الدقيقة (التقريبية) ، والكمي (عندما يتم تحويل أوزان الشبكة العصبية إلى أعداد صحيحة وقياسها كميًا) ، المسرع العصبي.

- ترجمة الصورة إلى نص ونص إلى صورة .

- إنشاء كائنات ثلاثية الأبعاد على الفيديو ، الآن في الوقت الحقيقي.

- الشيء الرئيسي في DL هو الكثير من البيانات ، لكن جمعها ووضع علامات عليها ليس بالأمر السهل. لذلك ، يتم تطوير التعليق التوضيحي التلقائي للشبكات العصبية باستخدام الشبكات العصبية.

- مع الشبكات العصبية ، أصبح علم الحاسوب فجأة علمًا تجريبيًا وظهرت أزمة استنساخ .

- نشأت أموال تكنولوجيا المعلومات وشعبية الشبكات العصبية في وقت واحد عندما أصبحت الحوسبة قيمة سوقية. أصبح اقتصاد الذهب والعملات الأجنبية حوسبة للذهب . انظر مقالتي عن الفيزياء الإيكولوجية والسبب في ظهور أموال تكنولوجيا المعلومات.

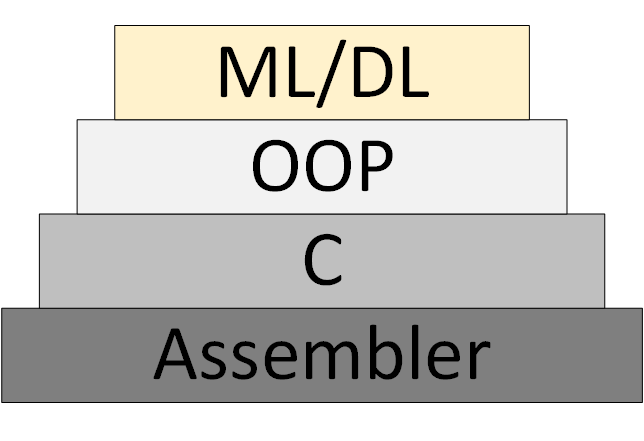

تدريجيا ، تظهر منهجية برمجة ML / DL جديدة (التعلم الآلي والتعلم العميق) ، والتي تستند إلى عرض البرنامج كمجموعة من نماذج الشبكات العصبية المدربة.

الشكل 3 - ML / DL كمنهجية برمجة جديدة

ومع ذلك ، فإن "نظرية الشبكات العصبية" لم تظهر ، في إطارها يمكن للمرء أن يفكر ويعمل بشكل منهجي. ما يسمى الآن "نظرية" هو في الواقع خوارزميات تجريبية ، مجريات الأمور.

روابط إلى مواردي وليس فقط:

- نشرة علوم البيانات. معظمها معالجة الصور. من يريد أن يستلمه ، دعه يرسل بريدًا إلكترونيًا (foobar167 <gaff-gaf> gmail <dot> com). أرسل روابط إلى المقالات ومقاطع الفيديو عندما تتراكم المواد.

- قائمة عامة بالمقررات والمقالات التي أخذتها وأود الحصول عليها.

- الدورات ومقاطع الفيديو للمبتدئين ، والتي تستحق البدء في دراسة الشبكات العصبية. بالإضافة إلى الكتيب "مقدمة في التعلم الآلي والشبكات العصبية الاصطناعية" .

- أدوات مفيدة حيث سيجد الجميع شيئًا مثيرًا للاهتمام لأنفسهم.

- تبين أن قنوات الفيديو لتحليل المقالات العلمية حول علوم البيانات مفيدة للغاية. ابحث عنها واشترك فيها وأرسل روابط إلى زملائك وأنا أيضًا. الأمثلة على ذلك:

شكرا لاهتمامكم!