Dean Pomerleau erinnert sich noch an das erste Mal, als er sich mit dem Black-Box-Problem befassen musste. 1991 unternahm er einen der ersten Versuche auf diesem Gebiet, der derzeit von allen untersucht wird, die versuchen, ein Roboterauto zu entwickeln: das Erlernen des Fahrens eines Computers.Und das bedeutete, dass Sie ein speziell vorbereitetes Humvee (Armee-Geländewagen) fahren und durch die Straßen der Stadt fahren müssen. So erzählt Pomelo, damals ein ehemaliger Doktorand der Robotik an der Carnegie Mellon University. Ein Computer, der so programmiert ist, dass er durch die Kamera folgt, das Geschehen auf der Straße interpretiert und sich daran erinnert, dass alle Bewegungen des Fahrers mitgefahren sind. Pomelo hoffte, dass das Auto irgendwann genug Assoziationen für unabhängiges Fahren aufbauen würde.Bei jeder Fahrt trainierte Pomelo das System einige Minuten lang und ließ es dann selbst steuern. Alles schien gut zu laufen - bis Humvee sich einmal der Brücke näherte und sich plötzlich zur Seite drehte. Einem Mann gelang es, einen Unfall zu vermeiden, indem er nur schnell das Lenkrad ergriff und die Kontrolle zurückgab.

Dean Pomerleau erinnert sich noch an das erste Mal, als er sich mit dem Black-Box-Problem befassen musste. 1991 unternahm er einen der ersten Versuche auf diesem Gebiet, der derzeit von allen untersucht wird, die versuchen, ein Roboterauto zu entwickeln: das Erlernen des Fahrens eines Computers.Und das bedeutete, dass Sie ein speziell vorbereitetes Humvee (Armee-Geländewagen) fahren und durch die Straßen der Stadt fahren müssen. So erzählt Pomelo, damals ein ehemaliger Doktorand der Robotik an der Carnegie Mellon University. Ein Computer, der so programmiert ist, dass er durch die Kamera folgt, das Geschehen auf der Straße interpretiert und sich daran erinnert, dass alle Bewegungen des Fahrers mitgefahren sind. Pomelo hoffte, dass das Auto irgendwann genug Assoziationen für unabhängiges Fahren aufbauen würde.Bei jeder Fahrt trainierte Pomelo das System einige Minuten lang und ließ es dann selbst steuern. Alles schien gut zu laufen - bis Humvee sich einmal der Brücke näherte und sich plötzlich zur Seite drehte. Einem Mann gelang es, einen Unfall zu vermeiden, indem er nur schnell das Lenkrad ergriff und die Kontrolle zurückgab.. « ' ' , »,- . ? «» – , , , . , , . , , . , : , .

25 , . . , -, « »,

, . (), « », , , .

. ,

. . . , . « , »,- - [Jean-Roch Vlimant], .

Aber solche Durchbrüche werden das Black-Box-Problem noch akuter machen. Wie genau findet die Maschine signifikante Signale? Wie können Sie sicher sein, dass ihre Schlussfolgerungen richtig sind? Wie sehr sollten Menschen tiefem Lernen vertrauen? "Ich denke, wir müssen mit diesen Algorithmen nachgeben", sagt Robotikspezialist Hod Lipson von der Columbia University in New York. Er vergleicht die Situation mit einem Treffen mit intelligenten Außerirdischen, deren Augen nicht nur Rot, Grün und Blau sehen, sondern auch die vierte Farbe. Ihm zufolge wird es für die Menschen sehr schwierig sein zu verstehen, wie diese Außerirdischen die Welt sehen, und für sie, es uns zu erklären. Computer werden die gleichen Probleme haben, ihre Entscheidungen zu erklären, sagt er. "Irgendwann wird es versuchen, dem Hund Shakespeare zu erklären."Nachdem KI-Forscher auf solche Probleme gestoßen sind, reagieren sie genauso wie Pomelo - sie öffnen eine Black Box und führen neurologische Aktionen durch, um die Funktionsweise von Netzwerken zu verstehen. Die Antworten sind nicht intuitiv, sagt Vincenzo Innocente, ein CERN-Physiker, der als erster KI auf seinem Gebiet einsetzte. „Als Wissenschaftler bin ich nicht zufrieden mit der einfachen Fähigkeit, Hunde von Katzen zu unterscheiden. Ein Wissenschaftler sollte sagen können: Der Unterschied ist das und das. “Schöne Fahrt

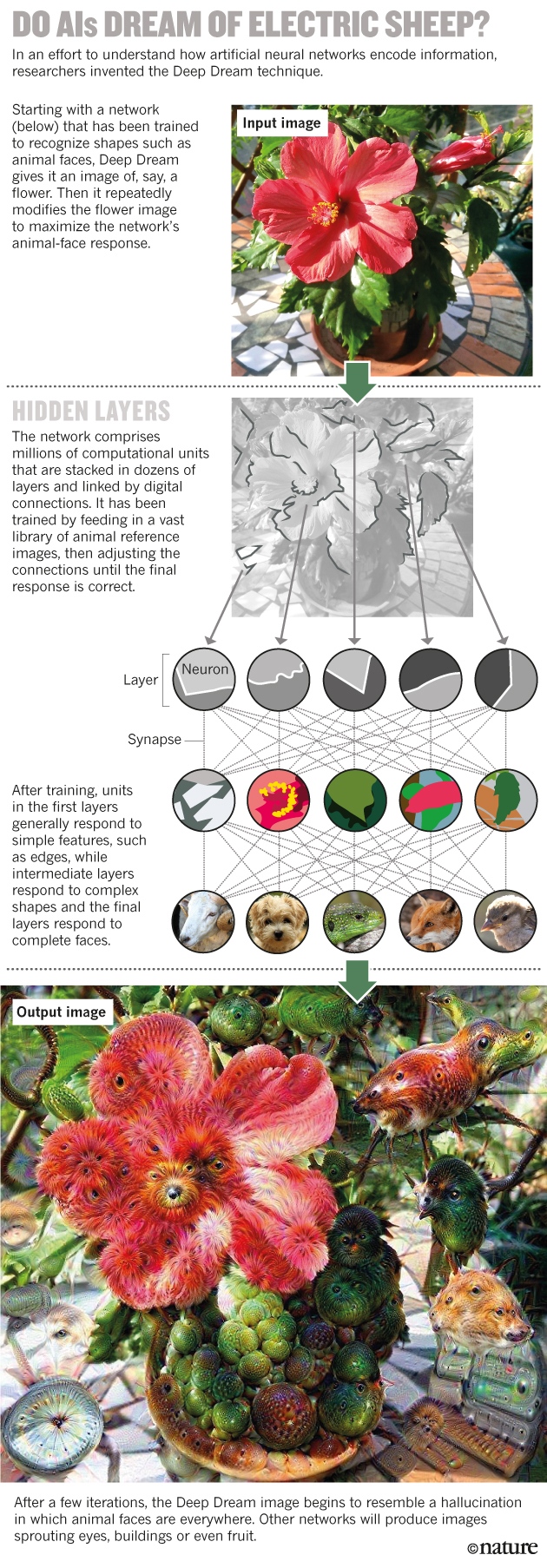

Das erste neuronale Netzwerk wurde in den frühen 1950er Jahren geschaffen, fast unmittelbar nach dem Aufkommen von Computern, die in der Lage sind, nach den erforderlichen Algorithmen zu arbeiten. Die Idee ist, den Betrieb kleiner zählbarer Module - Neuronen - zu emulieren, die in Schichten angeordnet und mit digitalen „Synapsen“ verbunden sind. Jedes Modul in der unteren Schicht empfängt externe Daten, z. B. Pixel des Bildes, und verteilt diese Informationen dann auf einige der Module in der nächsten Schicht. Jedes Modul in der zweiten Schicht integriert Eingaben aus der ersten Schicht nach einer einfachen mathematischen Regel und gibt das Ergebnis weiter. Infolgedessen gibt die oberste Ebene eine Antwort - weist beispielsweise das Originalbild „Katzen“ oder „Hunden“ zu. ? « » (Deep Dream) , , , , – , .

? « » (Deep Dream) , , , , – , .

, – , .

Deep Dream .. , , , . , , , , .

1990- , . , .

, : , , , . « ? , , , »,- [Pierre Baldi], () . , . , [Jeff Clune] , « , , ».

Für Wissenschaftler, die mit Big Data arbeiten, bedeutet dies, dass GO sorgfältig verwendet werden sollte. Andrea Vedaldi, Informatikspezialistin an der Universität Oxford, erklärt: Stellen Sie sich vor, dass das neuronale Netzwerk in Zukunft auf Mammographien trainiert wird, um anzuzeigen, ob Brustkrebs bei den untersuchten Frauen untersucht wird. Nehmen wir danach an, dass das Gewebe einer gesunden Frau anfällig für Krankheiten zu sein scheint. "Das neuronale Netzwerk kann lernen, Tumormarker zu erkennen - solche, die wir nicht kennen, die aber Krebs vorhersagen können."Wenn die Maschine jedoch nicht erklären kann, wie sie es bestimmt, wird dies laut Vedaldi ein ernstes Dilemma für Ärzte und Patienten sein. Es ist für eine Frau nicht einfach, sich einer vorbeugenden Entfernung der Brust zu unterziehen, da genetische Merkmale vorhanden sind, die zu Krebs führen können. Und eine solche Wahl zu treffen wird noch schwieriger sein, da nicht einmal bekannt ist, was dieser Faktor ist - selbst wenn sich die Vorhersagen der Maschine als genau herausstellen."Das Problem ist, dass Wissen in das Netzwerk eingebettet ist, nicht in uns", sagt Michael Tyka, Biophysiker und Google-Programmierer. „Haben wir etwas verstanden? Nein - das ist das Netzwerk, das verstanden wird. “2012 . [Geoffrey Hinton], , , , , 1,2 , .

, , , , . , , . , – , , , « ?».

Google . , Deep Dream, , , , , . , , , . LSD, , . «, »,- , . , . .

Mit Techniken, die die Leistung eines Neurons maximieren und nicht nur eines der besten, stellte Kluns Team 2014 fest, dass das Black-Box-Problem komplizierter sein könnte, als es zuvor schien. Neuronale Netze lassen sich mit Hilfe von Bildern, die von Menschen als zufälliges Rauschen oder abstrakte Muster wahrgenommen werden, sehr leicht täuschen. Zum Beispiel kann ein Netzwerk Wellenlinien nehmen und entscheiden, dass es sich um einen Seestern handelt, oder schwarze und weiße Streifen mit einem Schulbus verwechseln. Darüber hinaus traten die gleichen Trends in Netzwerken auf, die auf anderen Datensätzen trainiert wurden.Forscher haben verschiedene Lösungen für das Problem des Narrens von Netzwerken vorgeschlagen, aber es wurde noch keine allgemeine Lösung gefunden. In realen Anwendungen kann dies gefährlich sein. Laut Clun ist eines der beängstigenden Szenarien, dass Hacker lernen, diese Netzwerkfehler auszunutzen. Sie können das Robomobile auf eine Werbetafel schicken, die es für die Straße benötigt, oder den Retina-Scanner am Eingang zum Weißen Haus austricksen. „Wir müssen die Ärmel hochkrempeln und gründliche wissenschaftliche Forschungen durchführen, um das MO zuverlässiger und intelligenter zu machen“, schließt Klyun., . [Zoubin Ghahramani], , , , , « , ». 2009 [Michael Schmidt], . Eureqa – – .

Ausgehend von einer zufälligen Kombination von mathematischen Steinen wie +, -, Sinus und Cosinus ändert Eureqa diese durch Versuch und Irrtum, ähnlich wie bei der Darwinschen Evolution, bis es zu den Formeln kommt, die diese Daten beschreiben. Sie bietet dann Experimente an, um Modelle zu testen. Einer seiner Vorteile ist die Einfachheit, sagt Lipson. „Ein von Eureqa entwickeltes Modell hat normalerweise ein Dutzend Parameter. Das neuronale Netz hat Millionen von ihnen. “Auf Autopilot

, . Automatic Statistician, , . , , « » , . , , , – .

, [Ellie Dobson], Arundo Analytics . , , - - , « - ».

Trotz all dieser Befürchtungen sagen Informatiker, dass Versuche, eine transparente KI zu schaffen, eine Ergänzung des Zivilschutzes und kein Ersatz für diese Technologie sein sollten. Einige transparente Techniken funktionieren möglicherweise gut in Bereichen, die bereits als Satz abstrakter Daten beschrieben wurden, bewältigen jedoch nicht die Wahrnehmung - den Prozess des Extrahierens von Fakten aus Rohdaten.Demnach sollten die komplexen Antworten, die das Verteidigungsministerium erhalten hat, Teil der Werkzeuge der Wissenschaft sein, da die reale Welt komplex ist. Für Phänomene wie Wetter oder Finanzmarkt gibt es möglicherweise keine reduktionistischen, synthetischen Beschreibungen. "Es gibt Dinge, die nicht mit Worten beschrieben werden können", sagt Stephane Mallat, angewandter Mathematiker am Pariser Polytechnikum. "Wenn Sie einen Arzt fragen, warum er eine solche Diagnose gestellt hat, wird er die Gründe für Sie beschreiben", sagt er. - Aber warum brauchen Sie dann 20 Jahre, um ein guter Arzt zu werden? Weil Informationen nicht nur aus Büchern stammen. “Laut Baldi sollte der Wissenschaftler GO akzeptieren und sich nicht über Black Boxes freuen. Sie haben so eine Black Box im Kopf. "Du benutzt ständig das Gehirn, vertraust ihm immer und verstehst nicht, wie es funktioniert."