FlyAI-Projekt: Künstliche Intelligenz ermöglicht Koloniefliegen

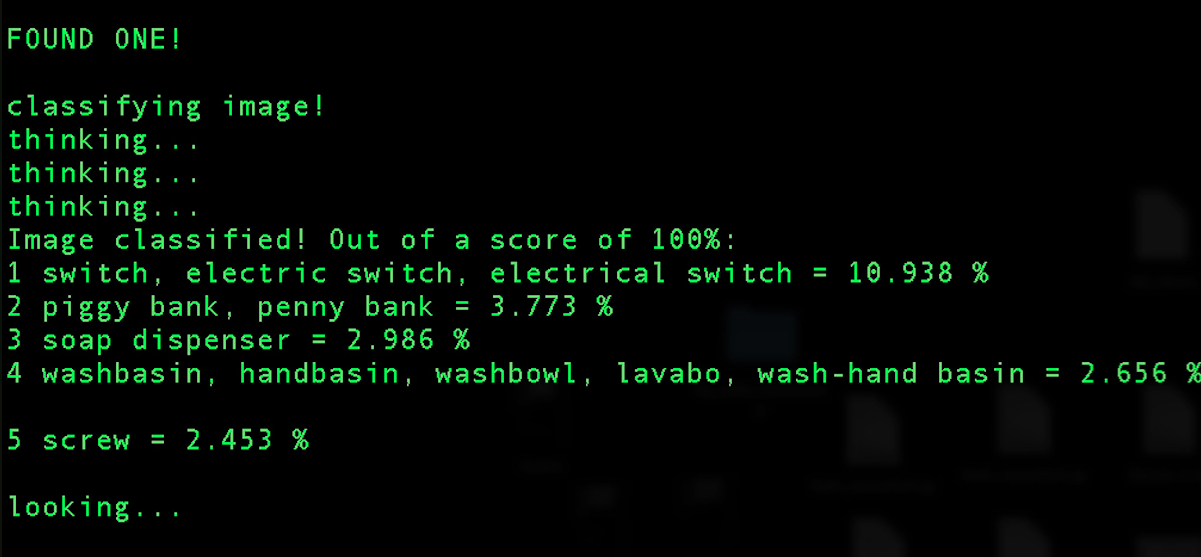

Im vergangenen Monat war das Leben einer Fliegenkolonie in Duluth, Minnesota, USA, vollständig vom Betrieb der Software abhängig. Dies ist eine selbstlernende schwache Form der KI, die das Leben von Insekten in einem speziellen Gefäß vollständig und vollständig sicherstellt. Insbesondere versorgt AI Fliegen mit Futter (Milchpulver mit Zucker) und Wasser.Das Leben von Insekten hängt davon ab, wie korrekt der Computer das Objekt vor den Kameras identifiziert. Wenn das System dieses Objekt als Fliege bestimmt und entscheidet, dass Insekten aufgeladen werden müssen, erhalten sie es. Im Fehlerfall erhalten die Fliegen weder Futter noch Wasser und leiden (soweit für die Fliegen möglich) lange Zeit unter Hunger und Durst. Das Projekt selbst hieß FlyAI, eine Art Parodie auf eine computergesteuerte Ansiedlung von Menschen. In jedem Fall sieht der Autor des Projekts alles so.„Wir von der Tatsache bewusst , geben müssen, was aus der künstlichen Intelligenz zu erwarten, da in jedem Fall wird es sein“, - sagte David Bowen ( von David Bowen ist ) von der University of Minnesota in Duluth. Er glaubt, dass es jetzt notwendig ist, darüber nachzudenken, was eine echte künstliche Intelligenz sein wird, damit es später keine Probleme geben wird. Laut dem Professor werden die Menschen trotz der Probleme in der Lage sein, die KI für die Person nützlich zu machen und ihr keinen Schaden zuzufügen.Ein zentrales Element des FlyAI-Projekts ist ein selbstlernendes neuronales Netzwerk. Es ist klar, dass dies, wie die meisten modernen KI-Systeme, kein ideales Projekt ist. FlyAI fehlt eine Bilddatenbank für effektives Lernen. Daher irrt das System regelmäßig, indem es Fliegen als Schalter oder andere Objekte identifiziert. Im Falle einer falschen Identifizierung „startet“ der Computer das Lebenserhaltungssystem nicht und die Fliegen hungern und leiden unter Durst, wie oben erwähnt. Aber auf jeden Fall, während die Kolonie lebt, ist es ein Monat her und Fliegen fühlen sich gut an. Wenn etwas völlig schief geht, rettet der Systemdesigner die Insekten, indem er ihren Massentod nicht zulässt. "Sie sterben, denke ich, aus natürlichen Gründen", sagt Bowen. "Sie haben die Möglichkeit, hier alt zu werden."Das Projekt sei eine stilisierte Verkörperung der Gedanken des KI-Spezialisten Nick Bostrom, der in Oxford arbeitet. Bostrom glaubt, dass die Offenheit der Forschung durch Spezialisten, die an der Schaffung künstlicher Intelligenz arbeiten, ein Problem sein kann. Insbesondere handelt es sich um das Projekt öffnen AI, das bereits veröffentlichte Informationen über Geektimes. "Wenn Sie die Schaltfläche" Alle fühlen sich schlecht "haben, möchten Sie diese wahrscheinlich nicht mit allen teilen", sagt Bostrom. Bei OpenAI steht diese Schaltfläche jedoch allen zur Verfügung.

Im vergangenen Monat war das Leben einer Fliegenkolonie in Duluth, Minnesota, USA, vollständig vom Betrieb der Software abhängig. Dies ist eine selbstlernende schwache Form der KI, die das Leben von Insekten in einem speziellen Gefäß vollständig und vollständig sicherstellt. Insbesondere versorgt AI Fliegen mit Futter (Milchpulver mit Zucker) und Wasser.Das Leben von Insekten hängt davon ab, wie korrekt der Computer das Objekt vor den Kameras identifiziert. Wenn das System dieses Objekt als Fliege bestimmt und entscheidet, dass Insekten aufgeladen werden müssen, erhalten sie es. Im Fehlerfall erhalten die Fliegen weder Futter noch Wasser und leiden (soweit für die Fliegen möglich) lange Zeit unter Hunger und Durst. Das Projekt selbst hieß FlyAI, eine Art Parodie auf eine computergesteuerte Ansiedlung von Menschen. In jedem Fall sieht der Autor des Projekts alles so.„Wir von der Tatsache bewusst , geben müssen, was aus der künstlichen Intelligenz zu erwarten, da in jedem Fall wird es sein“, - sagte David Bowen ( von David Bowen ist ) von der University of Minnesota in Duluth. Er glaubt, dass es jetzt notwendig ist, darüber nachzudenken, was eine echte künstliche Intelligenz sein wird, damit es später keine Probleme geben wird. Laut dem Professor werden die Menschen trotz der Probleme in der Lage sein, die KI für die Person nützlich zu machen und ihr keinen Schaden zuzufügen.Ein zentrales Element des FlyAI-Projekts ist ein selbstlernendes neuronales Netzwerk. Es ist klar, dass dies, wie die meisten modernen KI-Systeme, kein ideales Projekt ist. FlyAI fehlt eine Bilddatenbank für effektives Lernen. Daher irrt das System regelmäßig, indem es Fliegen als Schalter oder andere Objekte identifiziert. Im Falle einer falschen Identifizierung „startet“ der Computer das Lebenserhaltungssystem nicht und die Fliegen hungern und leiden unter Durst, wie oben erwähnt. Aber auf jeden Fall, während die Kolonie lebt, ist es ein Monat her und Fliegen fühlen sich gut an. Wenn etwas völlig schief geht, rettet der Systemdesigner die Insekten, indem er ihren Massentod nicht zulässt. "Sie sterben, denke ich, aus natürlichen Gründen", sagt Bowen. "Sie haben die Möglichkeit, hier alt zu werden."Das Projekt sei eine stilisierte Verkörperung der Gedanken des KI-Spezialisten Nick Bostrom, der in Oxford arbeitet. Bostrom glaubt, dass die Offenheit der Forschung durch Spezialisten, die an der Schaffung künstlicher Intelligenz arbeiten, ein Problem sein kann. Insbesondere handelt es sich um das Projekt öffnen AI, das bereits veröffentlichte Informationen über Geektimes. "Wenn Sie die Schaltfläche" Alle fühlen sich schlecht "haben, möchten Sie diese wahrscheinlich nicht mit allen teilen", sagt Bostrom. Bei OpenAI steht diese Schaltfläche jedoch allen zur Verfügung. Bostrom glaubt jedoch, dass künstliche Intelligenz ein Segen für den Menschen sein sollte. „Für uns ist es wichtig, künstliche Intelligenz zu schaffen, die klug genug ist, um aus unseren Fehlern zu lernen. Er wird sich endlos perfektionieren können. Die erste Version wird in der Lage sein, eine zweite zu erstellen, die besser ist, und die zweite, die schlauer als das Original ist, wird eine noch fortgeschrittenere dritte erstellen und so weiter. Unter bestimmten Umständen kann ein solcher Prozess der Selbstverbesserung wiederholt werden, bis eine intellektuelle Explosion erreicht ist - der Moment, in dem die intellektuelle Ebene des Systems in kurzer Zeit von einer relativ bescheidenen Ebene auf die Ebene der Superintelligenz springt “ , sagte er .Und Bowen argumentiert, dass das Risiko für die Menschheit nicht die unbegrenzten Möglichkeiten der zukünftigen starken Form der KI sind, sondern die Software, von der das menschliche Leben abhängen wird (daran zweifelt er nicht). "Eines der Probleme ist, dass wir nicht einmal vollständig verstehen, was künstliche Intelligenz ist", sagt Bowen. "Und es sieht einschüchternd aus."Eine starke Form der KI wird sich natürlich völlig von den modernen Sprachsuchmaschinen und digitalen Assistenten unterscheiden. Die Möglichkeiten der künstlichen Intelligenz sind wahrscheinlich groß, aber es gibt Risiken. Der gleiche Stephen Hawking glaubt, dass KI der größte Fehler der Menschheit ist. Bill Gates behauptet, dass künstliche Intelligenz in einigen Jahrzehnten bereits ausreichend entwickelt sein wird, um Anlass zur Sorge des Menschen zu geben. Und Elon Musk nannte KI "die Hauptbedrohung für die menschliche Existenz".

Bostrom glaubt jedoch, dass künstliche Intelligenz ein Segen für den Menschen sein sollte. „Für uns ist es wichtig, künstliche Intelligenz zu schaffen, die klug genug ist, um aus unseren Fehlern zu lernen. Er wird sich endlos perfektionieren können. Die erste Version wird in der Lage sein, eine zweite zu erstellen, die besser ist, und die zweite, die schlauer als das Original ist, wird eine noch fortgeschrittenere dritte erstellen und so weiter. Unter bestimmten Umständen kann ein solcher Prozess der Selbstverbesserung wiederholt werden, bis eine intellektuelle Explosion erreicht ist - der Moment, in dem die intellektuelle Ebene des Systems in kurzer Zeit von einer relativ bescheidenen Ebene auf die Ebene der Superintelligenz springt “ , sagte er .Und Bowen argumentiert, dass das Risiko für die Menschheit nicht die unbegrenzten Möglichkeiten der zukünftigen starken Form der KI sind, sondern die Software, von der das menschliche Leben abhängen wird (daran zweifelt er nicht). "Eines der Probleme ist, dass wir nicht einmal vollständig verstehen, was künstliche Intelligenz ist", sagt Bowen. "Und es sieht einschüchternd aus."Eine starke Form der KI wird sich natürlich völlig von den modernen Sprachsuchmaschinen und digitalen Assistenten unterscheiden. Die Möglichkeiten der künstlichen Intelligenz sind wahrscheinlich groß, aber es gibt Risiken. Der gleiche Stephen Hawking glaubt, dass KI der größte Fehler der Menschheit ist. Bill Gates behauptet, dass künstliche Intelligenz in einigen Jahrzehnten bereits ausreichend entwickelt sein wird, um Anlass zur Sorge des Menschen zu geben. Und Elon Musk nannte KI "die Hauptbedrohung für die menschliche Existenz". Die Softwareplattform, die das Zentrum von FlyAI darstellt, macht häufig einen FehlerNatürlich mag das Projekt selbst ein wenig lächerlich erscheinen, aber der Autor glaubt es nicht. Eigentlich wollte er nur die Öffentlichkeit auf sein Projekt und das Problem der KI aufmerksam machen. Wir können sagen, dass es ihm gelungen ist. Auf jeden Fall wissen wir noch nicht, wann eine vollwertige KI erscheinen wird und ob sie überhaupt erscheinen wird. Dies kann morgen oder in einigen Jahrzehnten geschehen. Um für den Menschen sicher zu sein, muss sich die maschinelle Intelligenz des Wertes des menschlichen Lebens bewusst sein. Doch der Mensch ist keine Fliege.

Die Softwareplattform, die das Zentrum von FlyAI darstellt, macht häufig einen FehlerNatürlich mag das Projekt selbst ein wenig lächerlich erscheinen, aber der Autor glaubt es nicht. Eigentlich wollte er nur die Öffentlichkeit auf sein Projekt und das Problem der KI aufmerksam machen. Wir können sagen, dass es ihm gelungen ist. Auf jeden Fall wissen wir noch nicht, wann eine vollwertige KI erscheinen wird und ob sie überhaupt erscheinen wird. Dies kann morgen oder in einigen Jahrzehnten geschehen. Um für den Menschen sicher zu sein, muss sich die maschinelle Intelligenz des Wertes des menschlichen Lebens bewusst sein. Doch der Mensch ist keine Fliege.Source: https://habr.com/ru/post/de400045/

All Articles