Es ist an der Zeit, Computer zu erstellen, die von der Struktur des Gehirns inspiriert sind. Algorithmen, die neuronale Netze und tiefes Lernen verwenden und einige Aspekte des menschlichen Gehirns imitieren, ermöglichen es digitalen Computern, unglaubliche Höhen in der Sprachübersetzung zu erreichen, nach schwer fassbaren Mustern in riesigen Datenmengen zu suchen und Menschen in Go zu schlagen.

Während die Ingenieure diese vielfach rechnerische Rechenstrategie aktiv weiterentwickeln, stößt die Energieeffizienz des Digital Computing an ihre Grenzen. Unsere Rechenzentren und Supercomputer verbrauchen bereits Megawatt - 2% des gesamten in den USA verbrauchten Stroms gehen an Rechenzentren. Und das menschliche Gehirn ist 20 Watt wert, und dies ist ein kleiner Teil der Energie, die in der täglichen Nahrung enthalten ist. Wenn wir Computersysteme verbessern wollen, müssen wir Computer wie Gehirne aussehen lassen.

Mit dieser Idee ist ein Anstieg des Interesses an neuromorphen Technologien verbunden, der verspricht, Computer über einfache neuronale Netze hinaus zu Schaltkreisen zu bewegen, die als Neuronen und Synapsen fungieren. Die Entwicklung von hirnähnlichen physischen Schaltkreisen ist bereits recht gut entwickelt. Die Arbeit, die ich in den letzten 35 Jahren in meinem Labor und in anderen Einrichtungen auf der ganzen Welt geleistet habe, hat zur Entstehung künstlicher Nervenkomponenten geführt, ähnlich wie Synapsen und Dendriten, die ähnlich wie echte reagieren und elektrische Signale erzeugen.

Was ist also erforderlich, um diese Bausteine in ein vollwertiges Computergehirn zu integrieren? Im Jahr 2013 half mir Bo Marr, mein ehemaliger Doktorand am Georgia Institute of Technology,

die besten modernen Fortschritte in den Bereichen Ingenieurwesen und Neurobiologie zu bewerten . Wir kamen zu dem Schluss, dass es möglich ist, mithilfe von Transistoren eine Siliziumversion des Kortex des menschlichen Gehirns zu erstellen. Darüber hinaus würde die endgültige Maschine weniger als einen Kubikmeter Platz beanspruchen und weniger als 100 Watt verbrauchen, was sich nicht so stark vom menschlichen Gehirn unterscheidet.

Ich möchte nicht sagen, dass das Erstellen eines solchen Computers einfach sein wird. Das System, das wir erfunden haben, wird mehrere Milliarden Dollar für Entwicklung und Bau benötigen, und um es kompakt zu machen, wird es mehrere innovative Innovationen enthalten. Es stellt sich auch die Frage, wie wir einen solchen Computer programmieren und trainieren werden. Forscher des Neuromorphismus haben immer noch Schwierigkeiten zu verstehen, wie Tausende künstlicher Neuronen zusammenarbeiten können und wie nützliche Anwendungen für die Pseudo-Gehirn-Aktivität gefunden werden können.

Die Tatsache, dass wir ein solches System entwickeln können, legt jedoch nahe, dass wir nicht lange vor dem Erscheinen kleinerer Chips standen, die für den Einsatz in tragbaren und tragbaren Elektronikgeräten geeignet waren. Solche Geräte verbrauchen wenig Energie, so dass ein neuromorpher Chip mit hoher Energieeffizienz - selbst wenn er nur einen Teil der Berechnungen übernimmt, beispielsweise die Signalverarbeitung - revolutionär werden kann. Bestehende Funktionen wie die Spracherkennung können in lauten Umgebungen funktionieren. Sie können sich sogar vorstellen, dass die Smartphones der Zukunft in einem Gespräch zwischen zwei Personen eine Sprachübersetzung in Echtzeit durchführen. Denken Sie darüber nach: In den 40 Jahren seit dem Aufkommen integrierter Schaltkreise für die Signalverarbeitung hat das Gesetz von Moore die Energieeffizienz um das 1000-fache verbessert. Sehr gehirnähnliche neuromorphe Chips können diese Verbesserungen leicht übertreffen und den Energieverbrauch um weitere 100 Millionen Mal senken. Daher passen Berechnungen, für die zuvor ein Rechenzentrum erforderlich war, in Ihre Handfläche.

In einer idealen Maschine, die sich dem Gehirn nähert, müssen Analoga aller Hauptfunktionskomponenten des Gehirns wiederhergestellt werden: Synapsen, die Neuronen verbinden und es ihnen ermöglichen, Signale zu empfangen und darauf zu reagieren; Dendriten, die lokale Berechnungen basierend auf eingehenden Signalen kombinieren und durchführen; Der Kern oder Soma ist die Region jedes Neutrons, die die Eingabe von Dendriten kombiniert und die Ausgabe an das Axon überträgt.

Die einfachsten Versionen dieser Grundkomponenten sind bereits in Silizium implementiert. Der Beginn dieser Arbeit wurde von demselben Metalloxid-Halbleiter oder MOSFET gegeben, von dem Milliarden Kopien zum Aufbau von Logikschaltungen in modernen digitalen Prozessoren verwendet werden.

Diese Geräte haben viel mit Neuronen gemeinsam. Neuronen arbeiten mit spannungsgesteuerten Barrieren, und ihre elektrische und chemische Aktivität hängt hauptsächlich von den Kanälen ab, in denen sich Ionen zwischen dem Innen- und dem Außenraum der Zelle bewegen. Dies ist ein reibungsloser, analoger Prozess, bei dem das Signal anstelle einfacher Ein- / Ausschaltvorgänge ständig akkumuliert oder reduziert wird.

MOSFETs sind auch spannungsgesteuert und arbeiten durch die Bewegungen einzelner Ladeeinheiten. Und wenn die MOSFETs im Subthreshold-Modus arbeiten, ohne die Spannungsschwelle zu erreichen und den Ein- und Ausschaltmodus umzuschalten, ist die durch das Gerät fließende Strommenge sehr gering - weniger als ein Tausendstel des Stroms, der in typischen Schaltern oder digitalen Gates zu finden ist.

Die Idee, dass die Physik von Subthreshold-Transistoren zur Erzeugung hirnähnlicher Schaltkreise verwendet werden kann, wurde von Carver Mead von Caltech zum Ausdruck gebracht, der in den 1970er Jahren zur Revolution auf dem Gebiet der supergroßen integrierten Schaltkreise beitrug. Mil wies darauf hin, dass Chipdesigner nicht viele interessante Aspekte ihres Verhaltens verwendeten und Transistoren ausschließlich für die digitale Logik verwendeten. Dieser Prozess, wie

er 1990 schrieb , ähnelt der Tatsache, dass "die gesamte schöne Physik, die in Transistoren existiert, in Nullen und Einsen zerquetscht wird und dann die UND- und ODER-Gatter auf dieser Basis schmerzhaft aufgebaut werden, um die Multiplikation neu zu erfinden". Ein „physischerer“ oder physikbasierter Computer könnte mehr Berechnungen pro Energieeinheit durchführen als ein herkömmlicher digitaler Computer. Mead sagte voraus, dass ein solcher Computer weniger Platz beanspruchen würde.

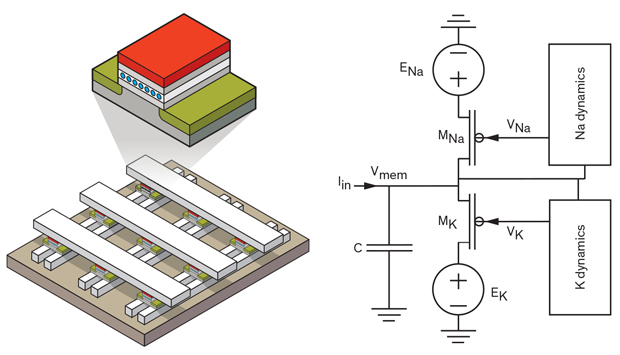

In den folgenden Jahren haben Ingenieure neuromorpher Systeme alle Grundblöcke des Gehirns aus Silizium mit hoher biologischer Genauigkeit hergestellt. Dendriten, Axone und Neuronensoma können aus Standardtransistoren und anderen Elementen hergestellt werden. Zum Beispiel haben Ethan Farquhar und ich

2005 eine neuronale Schaltung aus einem Satz von sechs MOSFETs und einer Reihe von Kondensatoren erstellt. Unser Modell strahlte elektrische Impulse aus, die denen sehr ähnlich sind, die Welsneuronen-Tintenfische aussenden - ein langjähriges Objekt von Experimenten. Darüber hinaus hat unser Programm solche Indikatoren mit Strom- und Energieverbrauchsniveaus erreicht, die denen im Tintenfischhirn nahe kommen. Wenn wir analoge Schaltungen verwenden wollten, um die von Neurowissenschaftlern abgeleiteten Gleichungen zur Beschreibung dieses Verhaltens zu modellieren, müssten wir zehnmal mehr Transistoren verwenden. Das Durchführen solcher Berechnungen auf einem digitalen Computer würde noch mehr Platz erfordern.

Synapsen und Wels: Mit einem Floating-Gate-Transistor (oben links), der eine andere Ladungsmenge speichern kann, kann ein Koordinatenarray künstlicher Synapsen (unten links) erstellt werden. Elektronische Versionen anderer Komponenten des Neurons, wie z. B. des Welses (rechts), können aus Standardtransistoren und anderen Komponenten hergestellt werden.

Synapsen sind etwas schwieriger zu emulieren. Ein Gerät, das sich wie eine Synapse verhält, sollte sich daran erinnern können, in welchem Zustand es sich befindet, auf bestimmte Weise auf das eingehende Signal reagieren und seine Reaktionen im Laufe der Zeit anpassen können.

Es gibt verschiedene mögliche Ansätze zum Erstellen von Synapsen. Die am weitesten entwickelte ist eine

Single-Transistor- Lernsynapse (STLS), an der meine Kollegen von Kaltech und ich in den 1990er Jahren als Doktorand bei Mead gearbeitet haben.

Wir haben STLS erstmals 1994 eingeführt und es ist zu einem wichtigen Werkzeug für Ingenieure geworden, die moderne analoge Schaltungen erstellen - zum Beispiel physikalische neuronale Netze. In neuronalen Netzen ist jedem Knoten im Netzwerk eine Gewichtung zugeordnet, und diese Gewichte bestimmen, wie Daten von verschiedenen Knoten kombiniert werden. STLS war das erste Gerät, das in der Lage war, verschiedene Gewichte aufzunehmen und im laufenden Betrieb neu zu programmieren. Darüber hinaus ist das Gerät nicht flüchtig, dh es merkt sich seinen Zustand, auch wenn es nicht verwendet wird - dieser Umstand reduziert den Energiebedarf erheblich.

STLS ist eine Art Floating-Gate-Transistor, eine Vorrichtung zum Erstellen von Zellen im Flash-Speicher. In einem herkömmlichen MOSFET steuert das Gate den Strom, der durch den Kanal fließt. Der Floating-Gate-Transistor hat ein zweites Gate zwischen dem elektrischen Gate und dem Kanal. Dieser Verschluss ist nicht direkt mit der Erde oder einer anderen Komponente verbunden. Dank dieser elektrischen Isolation, die mit hochwertigen Siliziumisolatoren verstärkt ist, wird die Ladung lange in einem Floating Gate gespeichert. Dieser Verschluss kann eine andere Ladungsmenge aufnehmen und daher auf vielen Ebenen eine elektrische Reaktion auslösen - und dies ist erforderlich, um eine künstliche Synapse zu erzeugen, die ihre Reaktion auf den Reiz variieren kann.

Meine Kollegen und ich haben STLS verwendet, um das erste Koordinatennetzwerk zu demonstrieren, ein Rechenmodell, das bei Forschern von Nanogeräten beliebt ist. In einem zweidimensionalen Array befinden sich Geräte am Schnittpunkt von Eingangsleitungen von oben nach unten und Ausgangsleitungen von links nach rechts. Eine solche Konfiguration ist insofern nützlich, als Sie die Verbindungskraft jeder „Synapse“ separat programmieren können, ohne andere Elemente des Arrays zu beeinträchtigen.

Insbesondere dank des kürzlich durchgeführten DARPA-Programms

SyNAPSE hat das Engineering Neuromorphing die Forschung an künstlichen Synapsen vorangetrieben, die aus Nanogeräten wie Memristoren, Widerstandsspeicher und Phasenspeicher sowie Floating-Gate-Bauelementen hergestellt wurden. Aber diese neuen künstlichen Synapsen werden auf der Basis von Arrays mit einem schwebenden Verschluss vor zwanzig Jahren schwer zu verbessern sein. Memristoren und andere Arten von neuem Speicher sind schwer zu programmieren. Die Architektur einiger von ihnen ist so, dass es ziemlich schwierig ist, auf ein bestimmtes Gerät in einem Koordinatenarray zuzugreifen. Andere benötigen einen dedizierten Transistor zum Programmieren, was ihre Größe erheblich erhöht. Da der Speicher mit einem schwebenden Verschluss für einen weiten Wertebereich programmiert werden kann, ist es einfacher, Produktionsabweichungen von Gerät zu Gerät im Vergleich zu anderen Nanogeräten auszugleichen. Mehrere Forschungsgruppen, die neuromorphe Geräte untersuchten, versuchten, Nanogeräte in ihre Entwürfe einzubeziehen, und begannen daher, Floating-Shutter-Geräte zu verwenden.

Und wie kombinieren wir all diese gehirnähnlichen Komponenten? Im menschlichen Gehirn sind Neuronen und Synapsen miteinander verflochten. Entwickler von neuromorphen Chips müssen auch einen integrierten Ansatz wählen, bei dem alle Komponenten auf einem Chip platziert werden. In vielen Labors werden Sie dies jedoch nicht finden: Um die Arbeit mit Forschungsprojekten zu vereinfachen, befinden sich einzelne Basiseinheiten an verschiedenen Orten. Synapsen können in einem Array außerhalb des Chips platziert werden. Verbindungen können über einen anderen Chip erfolgen, ein vom Benutzer programmierbares Gate-Array (FPGA).

Bei der Skalierung neuromorpher Systeme müssen Sie jedoch sicherstellen, dass wir nicht die Struktur moderner Computer kopieren, die eine erhebliche Menge an Energie verlieren, um Bits zwischen Logik, Speicher und Speicher hin und her zu übertragen. Heutzutage kann ein Computer zum Verschieben von Daten leicht zehnmal mehr Energie verbrauchen als zum Rechnen.

Im Gegensatz dazu minimiert das Gehirn den Energieverbrauch der Kommunikation aufgrund der hohen Lokalisierung von Operationen. Gehirnspeicherelemente wie die Synapsenleistung werden mit signalübertragenden Komponenten gemischt. Und die „Drähte“ des Gehirns - Dendriten und Axone, die eingehende Signale und ausgehende Impulse übertragen - sind im Vergleich zur Größe des Gehirns normalerweise kurz und benötigen nicht viel Energie, um das Signal aufrechtzuerhalten. Aus der Anatomie wissen wir, dass mehr als 90% der Neuronen nur mit 1.000 benachbarten Neuronen verbunden sind.

Eine weitere große Frage für die Entwickler von gehirnähnlichen Chips und Computern sind die Algorithmen, die daran arbeiten müssen. Selbst ein leicht gehirnähnliches System kann einen großen Vorteil gegenüber einem herkömmlichen digitalen System bieten. Zum Beispiel verwendete meine Gruppe im Jahr 2004 Floating-Gate-Geräte, um die Multiplikation in der Signalverarbeitung durchzuführen, und es benötigte 1.000-mal weniger Energie und 100-mal weniger Platz als ein digitales System. Im Laufe der Jahre haben Forscher erfolgreich neuromorphe Ansätze für andere Arten von Computern zur Signalverarbeitung demonstriert.

Aber das Gehirn ist immer noch 100.000 Mal effizienter als diese Systeme. Dies liegt daran, dass unsere derzeitigen neuromorphen Technologien zwar die neuronale Physik von Transistoren nutzen, jedoch keine Algorithmen verwenden, wie sie das Gehirn für seine Arbeit verwendet.

Heute fangen wir gerade erst an, diese physikalischen Algorithmen zu entdecken - Prozesse, die es gehirnähnlichen Chips ermöglichen, mit hirnnaher Effizienz zu arbeiten. Vor vier Jahren verwendete meine Gruppe Siliziumwels, Synapsen und Dendriten, um einen Wortsuchalgorithmus auszuführen, der Wörter in Audioaufnahmen erkennt. Dieser Algorithmus zeigte eine tausendfache Verbesserung der Energieeffizienz im Vergleich zur analogen Signalverarbeitung. Infolgedessen müssen Forscher durch Reduzieren der an die Chips angelegten Spannung und Verwenden kleinerer Transistoren Chips erzeugen, deren Leistung bei vielen Arten von Computern mit der Leistung des Gehirns vergleichbar ist.

Als ich vor 30 Jahren mit der Erforschung des Neuromorphismus begann, glaubten alle, dass die Entwicklung von Systemen, die dem Gehirn ähnlich sind, uns erstaunliche Möglichkeiten bieten würde. In der Tat sind jetzt ganze Branchen auf KI und gründliches Lernen ausgerichtet, und diese Anwendungen versprechen, unsere mobilen Geräte, Finanzinstitute und die Interaktion von Menschen an öffentlichen Orten vollständig zu verändern.

Diese Anwendungen beruhen jedoch nur sehr wenig auf unserem Wissen über die Gehirnfunktion. In den nächsten 30 Jahren werden wir zweifellos sehen können, wie dieses Wissen zunehmend genutzt wird. Wir haben bereits viele grundlegende Hardwareblöcke, die benötigt werden, um die Neurobiologie in einen Computer umzuwandeln. Wir müssen jedoch noch besser verstehen, wie diese Geräte funktionieren sollten - und welche Rechenschemata die besten Ergebnisse liefern.

Betrachten Sie dies als Aufruf zum Handeln. Mit einem sehr ungefähren Modell des Gehirns haben wir viel erreicht. Aber die Neurowissenschaften können dazu führen, dass wir komplexere gehirnähnliche Computer entwickeln. Und was könnte besser sein, als unser Gehirn zu benutzen, um zu verstehen, wie man diese neuen Computer herstellt?