Wenn Sie das Internet nutzen, müssen Sie mit neuronalen Netzen interagiert haben. Dies ist eine Form des Algorithmus für maschinelles Lernen, der in vielen Bereichen verwendet wird, von der Sprachübersetzung bis zur Finanzmodellierung. Eine der Besonderheiten dieses Ansatzes ist die Bilderkennung. Mehrere Unternehmen - darunter Google, Microsoft, IBM und Facebook - haben eigene Algorithmen für das Fotolayout entwickelt. Aber während diese Algorithmen sehr seltsame Fehler machen können.

Die Microsoft Azure-API für Computer Vision fügte diesem Bild die folgende Beschriftung hinzu: „Eine Schafherde weidet auf einem Hügel mit üppiger Vegetation“ und Tags: „Weiden, Schafe, Berge, Rinder, Pferde“. Auf dem Foto sind jedoch keine Schafe zu sehen. Im Allgemeinen. Ich habe jeden Punkt studiert.

Tags: Gras, Feld, Schaf, stehend, Regenbogen, Mann

Tags: Gras, Feld, Schaf, stehend, Regenbogen, MannAuf diesem Foto sah der Computer auch die Schafe. Durch Zufall weiß ich, dass einige Schafe wirklich in der Nähe dieses Ortes weideten. Sie sind jedoch auf dem Foto nicht sichtbar.

Tags: Hang, Weide, Schaf, Giraffe, Herde

Tags: Hang, Weide, Schaf, Giraffe, HerdeHier ist ein weiteres Beispiel. Neuronale Netze stellten sich Schafe jedes Mal vor, wenn sie solche Bilder sah. Was ist los?

Neuronale Netze werden durch die Verarbeitung vieler Beispiele trainiert. In diesem Fall wurde sie mit vielen Bildern gefüttert, die von Menschen manuell markiert wurden - und auf vielen von ihnen befanden sich Schafe. Ausgehend von einem völligen Mangel an Wissen über das, was Sie gesehen haben, müssen neuronale Netze Regeln erstellen, nach denen Bilder als "Schafe" gekennzeichnet werden müssen. Anscheinend verstand sie nicht, dass das Wort „Schaf“ ein Tier bedeutet und nicht nur Gras ohne Bäume. Ähnlich wie auf dem zweiten Foto gab sie das Etikett „Regenbogen“, weil diese Landschaft nass und regnerisch ist, ohne zu bemerken, dass ein Regenbogen einen mehrfarbigen Streifen benötigt.

Vielleicht sind die neuronalen Netze überempfindlich und sehen überall Schafe? Es stellt sich heraus, nein. Sie sehen Schafe nur, wenn sie erwarten, sie zu sehen. Sie finden leicht Schafe auf den Feldern und an den Hängen der Berge, aber sobald die Schafe an unerwarteten Orten auftauchen, wird deutlich, wie sehr diese Algorithmen auf Vermutungen und Wahrscheinlichkeiten beruhen.

Nehmen Sie die Schafe mit ins Zimmer, und sie wird als Katze bezeichnet. Hebe ein Schaf oder eine Ziege in deinen Armen auf und sie werden es als Hund markieren.

„Links: Ein Mann hält einen Hund in der Hand. Richtig: Eine Frau hält einen Hund in der Hand. “

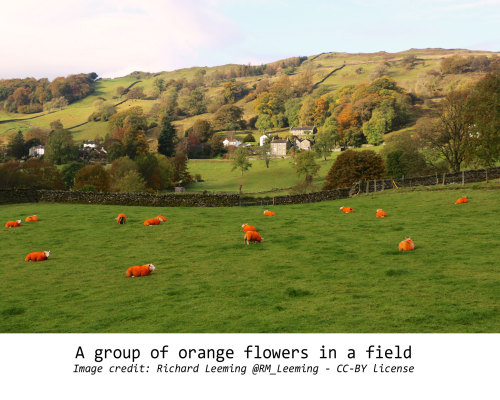

„Links: Ein Mann hält einen Hund in der Hand. Richtig: Eine Frau hält einen Hund in der Hand. “Malen Sie sie orange und sie werden Blumen.

"Ein paar orangefarbene Blumen auf dem Feld"

"Ein paar orangefarbene Blumen auf dem Feld"Legen Sie die Schafe an die Leine und sie werden sie als Hund bezeichnen. Setzen Sie sie ins Auto und es wird ein Hund oder eine Katze sein. Wenn sie ins Wasser gehen, können sie als Vögel oder sogar Eisbären bezeichnet werden.

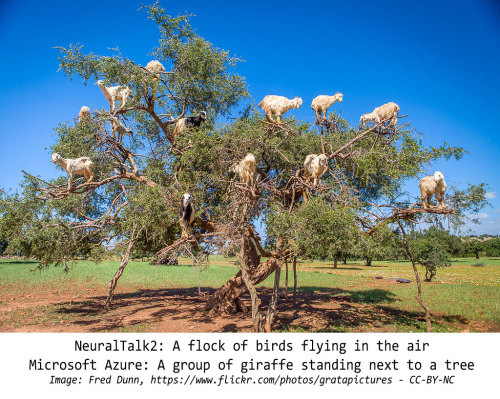

Und wenn die Ziegen auf einen Baum klettern, verwandeln sie sich in Vögel. Oder Giraffen (es stellte sich heraus, dass Microsoft Azure dafür berüchtigt ist, überall Giraffen zu sehen, da angeblich zu viele Giraffen im ursprünglichen Datensatz enthalten sind).

NeuralTalk2: Ein Vogelschwarm fliegt in der Luft

NeuralTalk2: Ein Vogelschwarm fliegt in der Luft

Microsoft Azure: Mehrere Giraffen stehen neben einem BaumNeuronale Netze korrelieren Muster. Sie sehen pelzähnliche Texturstücke, grüne Flecken und entscheiden, dass auf dem Bild Schafe zu sehen sind. Wenn sie Fell und Formen sehen, die einer Küche ähneln, können sie entscheiden, dass sie Katzen sehen.

Wenn das Leben den Regeln folgt, funktioniert die Bilderkennung so, wie sie sollte. Sobald jedoch Menschen oder Schafe etwas Unerwartetes tun, zeigen die Algorithmen sofort Schwäche.

Wenn Sie etwas Unbemerktes über das neuronale Netzwerk bringen möchten, wird Ihnen der Surrealismus in einem Cyberpunk-Stil helfen. Vielleicht werden sich Geheimagenten in Zukunft als Hühner verkleiden oder Autos fahren, die wie Kühe befleckt sind.

Es gibt viele Beispiele für sehr lustige Fehler im Twitter-Thread, die mit einer einfachen Frage begannen:

Und Sie selbst können den Betrieb der API für die Mustererkennung in Microsoft Azure testen und sicherstellen, dass selbst die fortschrittlichsten Algorithmen auf Glück und Wahrscheinlichkeit beruhen. Ein anderer Algorithmus, NeuralTalk2, habe ich hauptsächlich verwendet, um Bilder aus diesem Kommentarthread auf Twitter zu verarbeiten.