Bildverarbeitungssysteme können Gesichter auf einer Ebene mit Menschen erkennen und sogar realistische künstliche Gesichter erstellen. Die Forscher fanden jedoch heraus, dass diese Systeme optische Täuschungen nicht erkennen und daher neue erzeugen können.

Das menschliche Sehen ist ein erstaunliches Gerät. Obwohl es sich seit Millionen von Jahren in einer bestimmten Umgebung entwickelt hat, ist es in der Lage, Aufgaben zu erledigen, die nie auf frühe visuelle Systeme gestoßen sind. Ein gutes Beispiel wäre das Lesen oder Definieren künstlicher Objekte - Autos, Flugzeuge, Verkehrszeichen usw.

Das visuelle System weist jedoch eine Reihe bekannter Mängel auf, die wir als optische Täuschungen wahrnehmen. Forscher haben bereits viele Optionen identifiziert, bei denen diese Illusionen dazu führen, dass Menschen Farbe, Größe, relative Position und Bewegung falsch bewerten.

Illusionen an sich sind insofern interessant, als sie eine Vorstellung von der Natur des visuellen Systems und der Wahrnehmung vermitteln. Daher wird es sehr nützlich sein, einen Weg zu finden, um neue Illusionen zu finden, die helfen, die Grenzen dieses Systems zu untersuchen.

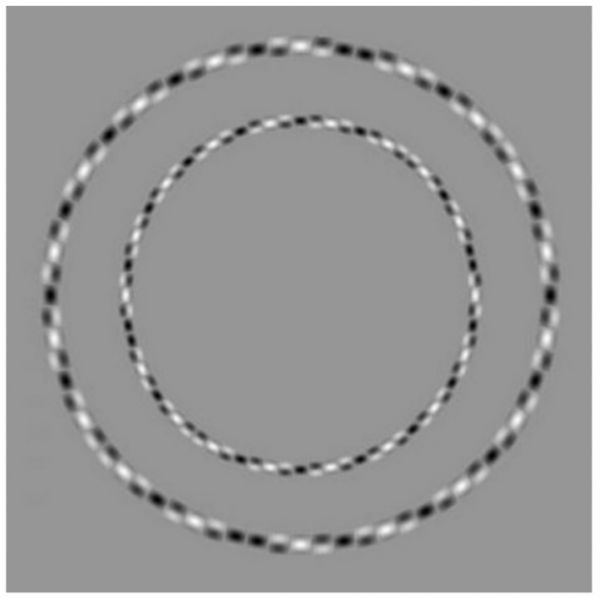

Konzentrische Kreise?

Konzentrische Kreise?Hier sollten wir uns eingehend mit dem Training befassen. In den letzten Jahren haben Maschinen gelernt, Objekte und Gesichter in Bildern zu erkennen und dann ähnliche Bilder zu erstellen. Es ist leicht vorstellbar, dass ein Bildverarbeitungssystem Illusionen erkennen und eigene schaffen kann.

Hier betreten Robert Williams und Roman Yampolsky von der University of Louisville in Kentucky die Bühne. Diese Jungs haben

versucht, so etwas anzukurbeln , aber festgestellt, dass nicht alles so einfach war. Bestehende maschinelle Lernsysteme sind nicht in der Lage, ihre eigenen optischen Täuschungen zu liefern - zumindest noch nicht. Warum so?

Erstens allgemeine Informationen. Die jüngsten Fortschritte beim Deep Learning basieren auf zwei Durchbrüchen. Das erste ist die Verfügbarkeit leistungsfähiger neuronaler Netze und einiger Software-Tricks, mit denen sie gut lernen können.

Die zweite ist die Erstellung riesiger markierter Datenbanken in Bezug auf das Volumen, auf deren Grundlage Maschinen lernen können. Um beispielsweise einer Maschine das Erkennen von Gesichtern beizubringen, werden Zehntausende von Bildern benötigt, die klar markierte Gesichter enthalten. Mit diesen Informationen kann das neuronale Netzwerk lernen, die charakteristischen Muster von Gesichtern zu erkennen - zwei Augen, eine Nase und einen Mund. Noch beeindruckender ist ein Netzwerkpaar - das sogenannte

Generative-Competitive Network (GSS) - kann sich gegenseitig beibringen, wie man realistische und vollständig künstliche Bilder von Gesichtern erstellt.

Williams und Yampolsky wollten das neuronale Netzwerk lehren, optische Täuschungen zu bestimmen. Die Rechenkapazität ist ausreichend und es gibt nicht genügend geeignete Datenbanken. Daher bestand ihre erste Aufgabe darin, eine Datenbank mit optischen Täuschungen für das Training zu erstellen.

Es stellte sich als schwierig heraus. "Es gibt nur wenige tausend statische optische Täuschungen, und die Anzahl der einzigartigen Arten von Täuschungen ist sehr gering - vielleicht ein paar Dutzend", sagen sie.

Dies ist ein ernstes Hindernis für moderne maschinelle Lernsysteme. „Die Erstellung eines Modells, das aus einem so kleinen und begrenzten Datensatz lernen kann, ist ein großer Fortschritt für generative Modelle und ein Verständnis des menschlichen Sehens“, sagen sie.

Daher sammelten Williams und Yampolsky eine Datenbank mit mehr als 6.000 Bildern optischer Täuschungen und trainierten das neuronale Netzwerk, um sie zu erkennen. Dann schufen sie das GSS, das unabhängig voneinander optische Täuschungen erzeugen sollte.

Die Ergebnisse enttäuschten sie. "Nach sieben Stunden Training mit dem Nvidia Tesla K80 wurde nichts Wertvolles geschaffen", sagten Forscher, die die Datenbank für alle zugänglich machten.

Das Ergebnis ist jedoch interessant. „Die einzigen uns bekannten optischen Täuschungen wurden durch Evolution (zum Beispiel Augenmuster auf Schmetterlingsflügeln) oder menschliche Künstler erzeugt“, betonen sie. In beiden Fällen spielten die Menschen eine entscheidende Rolle bei der Bereitstellung von Feedback - die Menschen können die Illusion sehen.

Und Bildverarbeitungssysteme können nicht. "Es ist unwahrscheinlich, dass das GSS lernt, wie man Visionen täuscht, ohne die Prinzipien zu verstehen, die Illusionen zugrunde liegen", sagen Williams und Yampolsky.

Dies kann eine Herausforderung sein, da es kritische Unterschiede zwischen den visuellen Systemen von Mensch und Maschine gibt. Viele Forscher schaffen neuronale Netze, die noch mehr an das menschliche visuelle System erinnern. Vielleicht ist eine der interessanten Prüfungen für diese Systeme, ob sie die Illusion sehen können.

In der Zwischenzeit sind Williams und Yampolsky nicht optimistisch: „Anscheinend reicht ein Datensatz mit Illusionen möglicherweise nicht aus, um neue Illusionen zu erzeugen“, sagen sie. Optische Täuschungen bleiben also vorerst eine Bastion menschlicher Wahrnehmung, die keinen Maschinen unterworfen ist.