Die Welt um uns herum ist voller Informationen, die unser Gehirn kontinuierlich verarbeitet. Er erhält diese Informationen über die Sinne, die jeweils für den Anteil der Signale verantwortlich sind: Augen (Vision), Zunge (Geschmack), Nase (Geruch), Haut (Berührung), Vestibularapparat (Gleichgewicht, räumliche Position und Gewichtssinn) und Ohren (Ton). Durch die Zusammenstellung von Signalen aus all diesen Organen kann unser Gehirn ein genaues Bild der Umwelt erstellen. Es sind uns jedoch nicht alle Aspekte der externen Signalverarbeitung bekannt. Eines dieser Geheimnisse ist der Lokalisierungsmechanismus der Schallquelle.

Wissenschaftler des Neuroengineering-Labors für Sprache und Hören (New Jersey Institute of Technology) haben ein neues Modell des neuronalen Prozesses der Schalllokalisierung vorgeschlagen. Welche Prozesse genau bei der Wahrnehmung von Schall im Gehirn ablaufen, wie unser Gehirn die Position der Schallquelle versteht und wie diese Studie im Kampf gegen Gehörschäden helfen kann. Dies erfahren wir aus dem Bericht der Forschergruppe. Lass uns gehen.

Studienbasis

Die Informationen, die unser Gehirn von den Sinnen erhält, unterscheiden sich sowohl in der Quelle als auch in der Verarbeitung. Einige Signale erscheinen unmittelbar vor unserem Gehirn in Form genauer Informationen, während andere zusätzliche Rechenprozesse benötigen. Grob gesagt spüren wir die Berührung sofort, aber wenn wir den Klang hören, müssen wir immer noch herausfinden, woher er kommt.

Die Grundlage für die Lokalisierung von Tönen in der horizontalen Ebene ist der Zeitunterschied zwischen den Ohren

* (ITD aus dem

Zeitunterschied zwischen den Ohren) der Töne, die die Ohren des Hörers erreichen.

Interaurale Basis * - der Abstand zwischen den Ohren.

Es gibt einen bestimmten Bereich im Gehirn (Medial Superior Olive oder MBO), der für diesen Prozess verantwortlich ist. Zum Zeitpunkt des Empfangs des Schallsignals im MBO werden die interauralen Zeitunterschiede in die Reaktionsrate der Neuronen umgewandelt. Die Form der Ausgangsgeschwindigkeitskurven des MBO als ITD-Funktion ähnelt der Form der Kreuzkorrelationsfunktion der Eingangssignale für jedes Ohr.

Die Art und Weise, wie Informationen im MBO verarbeitet und interpretiert werden, ist nach wie vor unklar, weshalb es mehrere sehr widersprüchliche Theorien gibt. Die bekannteste und in der Tat klassische Theorie der Schalllokalisierung ist das Jeffress-Modell (

Lloyd A. Jeffress ). Es basiert auf einer

markierten Reihe * von Neuronendetektoren, die für die binaurale Synchronisation neuronaler Eingangssignale von jedem Ohr empfindlich sind, und jedes Neuron reagiert am empfindlichsten auf einen bestimmten ITD-Wert (

1A ).

Das Prinzip der markierten Linie * ist eine Hypothese, die erklärt, wie verschiedene Nerven, die alle dieselben physiologischen Prinzipien verwenden, um Impulse entlang ihrer Axone zu übertragen, unterschiedliche Empfindungen erzeugen können. Strukturell ähnliche Nerven können unterschiedliche sensorische Wahrnehmungen erzeugen, wenn sie mit einzigartigen Neuronen im Zentralnervensystem assoziiert sind, die in der Lage sind, ähnliche Nervensignale auf verschiedene Arten zu decodieren.

Bild Nr. 1

Bild Nr. 1Dieses Modell ähnelt rechnerisch der neuronalen Kodierung, die auf unbegrenzten Kreuzkorrelationen von Geräuschen basiert, die beide Ohren erreichen.

Es gibt auch ein Modell, bei dem angenommen wird, dass die Lokalisierung von Schall auf der Grundlage von Unterschieden in der Reaktionsrate bestimmter Populationen von Neuronen aus verschiedenen Hemisphären des Gehirns modelliert werden kann, d. H. Modell der interhemisphärischen Asymmetrie (

1B ).

Bisher war es schwierig, eindeutig festzustellen, welche der beiden Theorien (Modelle) richtig ist, da jedes von ihnen unterschiedliche Abhängigkeiten der Schalllokalisierung von der Schallintensität vorhersagt.

In der Studie, die wir heute betrachten, haben Wissenschaftler beschlossen, beide Modelle zu kombinieren, um zu verstehen, ob die Wahrnehmung von Geräuschen auf neuronaler Kodierung oder auf dem Unterschied in der Reaktion einzelner neuronaler Populationen beruht. Es wurden mehrere Experimente durchgeführt, an denen Personen im Alter von 18 bis 27 Jahren (5 Frauen und 7 Männer) teilnahmen. Die Audiometrie (Messung der Hörschärfe) der Teilnehmer betrug 25 dB oder mehr bei einer Frequenz von 250 bis 8000 Hz. Der Versuchsteilnehmer wurde in einen schalldichten Raum gebracht, in dem spezielle Geräte mit hoher Genauigkeit kalibriert wurden. Teilnehmer sollten, nachdem sie ein Tonsignal gehört haben, die Richtung angeben, aus der es kommt.

Forschungsergebnisse

Um die Abhängigkeit der

Lateralisierung * der Gehirnaktivität von der Schallintensität als Reaktion auf markierte Neuronen zu bestimmen, verwendeten wir Daten zur Reaktionsrate von Neuronen im laminaren Kern des Schleiereulengehirns.

Lateralität * - Asymmetrie der linken und rechten Körperhälfte.

Um die Abhängigkeit der Lateralisierung der Hirnaktivität von der Reaktionsgeschwindigkeit bestimmter Neuronenpopulationen zu bestimmen, haben wir die Aktivitätsdaten des unteren Zweihirns des Rhesusaffen herangezogen. Anschließend wurden Unterschiede in der Geschwindigkeit von Neuronen aus verschiedenen Hemisphären berechnet.

Das Modell der markierten Reihe von Neuronendetektoren legt nahe, dass die Lateralität der wahrgenommenen Quelle mit abnehmender Schallintensität in Durchschnittswerten konvergiert, die dem Verhältnis von leisen und lauten Geräuschen (

1C ) ähnlich sind.

Das interhemisphärische Asymmetriemodell legt wiederum nahe, dass sich die wahrgenommene Lateralität bei einer Abnahme der Schallintensität auf fast die Schwelle zur Mittellinie (

1D ) verlagert.

Bei einer höheren Gesamtschallintensität wird angenommen, dass die Lateralisierung in der Intensität unveränderlich ist (Einfügungen bei

1C und

1D ).

Aus diesem Grund können Sie anhand einer Analyse der Auswirkungen der Schallintensität auf die wahrgenommene Schallrichtung genau bestimmen, welche Prozesse in diesem Moment ablaufen - Neuronen aus einem gemeinsamen Bereich oder Neuronen aus verschiedenen Hemisphären.

Offensichtlich kann die Fähigkeit einer Person, zwischen ITDs zu unterscheiden, mit der Schallintensität variieren. Wissenschaftler sagen jedoch, dass es schwierig ist, frühere Erkenntnisse in Bezug auf die Empfindlichkeit gegenüber ITD und die Beurteilung der Richtung der Schallquelle durch den Hörer als Funktion der Schallintensität zu interpretieren. Einige Studien besagen, dass die wahrgenommene Lateralität der Quelle abnimmt, wenn die Schallintensität die Grenzschwelle erreicht. Andere Studien legen nahe, dass die Intensität der Wahrnehmung überhaupt nicht beeinflusst wird.

Mit anderen Worten, die Wissenschaftler deuten "sanft" an, dass es in der Literatur nicht genügend Informationen über die Beziehung von ITD, Schallintensität und die Bestimmung der Richtung seiner Quelle gibt. Es gibt Theorien, die als eine Art von Axiomen existieren, die von der wissenschaftlichen Gemeinschaft allgemein akzeptiert werden. Daher wurde beschlossen, alle Theorien, Modelle und möglichen Mechanismen der Hörwahrnehmung in der Praxis im Detail zu testen.

Das erste Experiment wurde unter Verwendung des psychophysischen Paradigmas durchgeführt, das es uns ermöglichte, die ITD-basierte Lateralisierung als Funktion der Schallintensität in einer Gruppe von zehn normal hörenden Versuchsteilnehmern zu untersuchen.

Bild Nr. 2

Bild Nr. 2Schallquellen wurden speziell abgestimmt, um den größten Teil des Frequenzbereichs abzudecken, in dem Menschen ITD erkennen können, d. H. 300 bis 1200 Hz (

2A ).

In jedem der Tests musste der Hörer die erwartete Lateralität, gemessen als Funktion des Empfindungsniveaus, im Bereich von ITD-Werten von 375 bis 375 ms angeben. Um den Effekt der Schallintensität zu bestimmen, wurde das nichtlineare Mixed-Effect-Modell (NMLE) verwendet, das sowohl feste als auch zufällige Schallintensitäten umfasste.

Die Grafik

2B zeigt die geschätzte Lateralisierung mit spektral flachem Rauschen bei zwei Schallintensitäten für einen repräsentativen Hörer. Ein Graph

2C zeigt die Rohdaten (Kreise) und ist auf das NMLE-Modell (Linien) aller Zuhörer zugeschnitten.

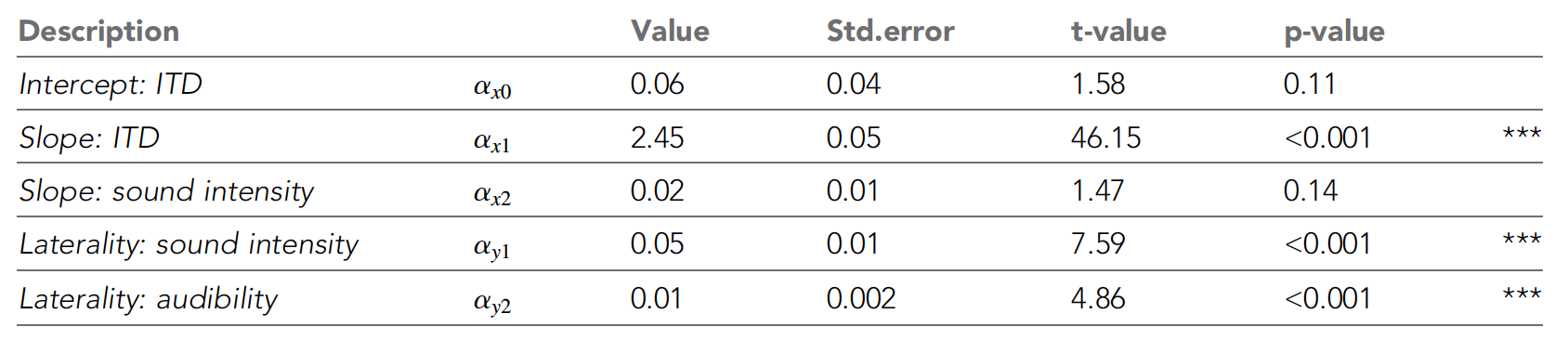

Tischnummer 1

Tischnummer 1Die obige Tabelle zeigt alle NLME-Parameter. Es ist ersichtlich, dass die wahrgenommene Lateralität mit zunehmender ITD zunahm, wie Wissenschaftler erwartet hatten. Mit abnehmender Schallintensität verlagerte sich die Wahrnehmung immer mehr in Richtung Mittellinie (Einfügung im

2C- Diagramm).

Diese Trends wurden durch das NLME-Modell verstärkt, das einen signifikanten Einfluss von ITD und Schallintensität auf den maximalen Lateralitätsgrad zeigte und das Modell der interhemisphärischen Unterschiede bestätigte.

Darüber hinaus wirkten sich die durchschnittlichen audiometrischen Schwellenwerte für reine Töne nur unwesentlich auf die wahrgenommene Lateralität aus. Die Schallintensität hatte jedoch keinen signifikanten Einfluss auf die Leistung psychometrischer Funktionen.

Das Hauptziel des zweiten Experiments war es zu bestimmen, wie sich die im vorherigen Experiment erhaltenen Ergebnisse ändern, wenn die spektralen Merkmale von Reizen (Geräuschen) berücksichtigt werden. Die Notwendigkeit, spektral flaches Rauschen bei niedriger Schallintensität zu testen, besteht darin, dass Teile des Spektrums möglicherweise nicht gehört werden und dies die Bestimmung der Schallrichtung beeinträchtigen kann. Daher kann die Tatsache, dass die Breite des hörbaren Teils des Spektrums mit abnehmender Schallintensität abnehmen kann, mit den Ergebnissen des ersten Experiments verwechselt werden.

Aus diesem Grund wurde beschlossen, ein weiteres Experiment durchzuführen, bei dem jedoch bereits

A-bewertetes Rauschen verwendet wurde.

Eine A-Gewichtung * wird auf Schallpegel angewendet, um die relative Lautstärke zu berücksichtigen, die vom menschlichen Ohr wahrgenommen wird, da das Ohr für niedrige Schallfrequenzen weniger empfindlich ist. Eine A-Gewichtung wird durch arithmetisches Hinzufügen einer in Oktavbändern aufgelisteten Wertetabelle zu den gemessenen Schalldruckpegeln in dB implementiert.

Das

2D- Diagramm zeigt die auf das NMLE-Modell zugeschnittenen Rohdaten (Kreise) und Daten (Linien) für alle Versuchsteilnehmer.

Eine Analyse der Daten ergab, dass, wenn alle Teile des Schalls ungefähr gleich hörbar sind (sowohl im ersten als auch im zweiten Experiment), die wahrgenommene Lateralität und Steigung in der Grafik, die die Änderung der Lateralität mit der ITD erklären, mit abnehmender Schallintensität abnimmt.

Somit bestätigten die Ergebnisse des zweiten Experiments die Ergebnisse des ersten. Das heißt, in der Praxis hat sich gezeigt, dass das 1948 von Jeffress vorgeschlagene Modell nicht korrekt ist.

Es stellt sich heraus, dass sich die Lokalisierung von Geräuschen mit abnehmender Geräuschintensität verschlechtert, und Jeffress glaubte, dass Geräusche von einer Person unabhängig von ihrer Intensität gleichermaßen wahrgenommen und verarbeitet werden.

Um die Nuancen der Studie genauer kennenzulernen, empfehle ich Ihnen, in den

Bericht der Wissenschaftler zu schauen.

Nachwort

Theoretische Annahmen und praktische Experimente, die diese bestätigten, zeigten, dass Gehirnneuronen von Säugetieren in Abhängigkeit von der Richtung des Schallsignals mit unterschiedlichen Geschwindigkeiten aktiviert werden. Anschließend vergleicht das Gehirn diese Geschwindigkeiten zwischen allen am Prozess beteiligten Neuronen, um die Klangumgebung dynamisch abzubilden.

Das Jeffresson-Modell ist tatsächlich nicht 100% ig fehlerhaft, da es dazu verwendet werden kann, die Position einer Schallquelle in einer Schleiereule perfekt zu beschreiben. Ja, für Schleiereulen spielt die Intensität des Geräusches keine Rolle, sie bestimmen auf jeden Fall die Position ihrer Quelle. Dieses Modell funktioniert jedoch nicht mit Rhesusaffen, wie aus früheren Experimenten hervorgeht. Daher kann dieses Jeffresson-Modell die Lokalisierung von Geräuschen für alle Lebewesen nicht beschreiben.

Experimente mit Menschen haben erneut bestätigt, dass die Lokalisierung von Geräuschen in verschiedenen Organismen auf unterschiedliche Weise erfolgt. Viele der Teilnehmer konnten die Position der Quelle der Tonsignale aufgrund der geringen Intensität der Töne nicht richtig bestimmen.

Wissenschaftler glauben, dass ihre Arbeit eine gewisse Ähnlichkeit zwischen der Art und Weise zeigt, wie wir sehen und wie wir hören. Beide Vorgänge hängen mit der Geschwindigkeit der Neuronen in verschiedenen Teilen des Gehirns sowie mit der Bewertung dieses Unterschieds zusammen, um sowohl die Position der Objekte im Raum als auch die Position der Schallquelle zu bestimmen, die wir hören.

In Zukunft werden Forscher eine Reihe von Experimenten durchführen, um die Beziehung zwischen menschlichem Hören und Sehen genauer zu untersuchen. Auf diese Weise können wir besser verstehen, wie unser Gehirn dynamisch eine Karte der Welt um uns herum erstellt.

Vielen Dank für Ihre Aufmerksamkeit, bleiben Sie neugierig und haben Sie eine gute Arbeitswoche, Jungs! :)

Vielen Dank für Ihren Aufenthalt bei uns. Mögen Sie unsere Artikel? Möchten Sie weitere interessante Materialien sehen? Unterstützen Sie uns, indem Sie eine Bestellung aufgeben oder Ihren Freunden empfehlen,

Cloud-VPS für Entwickler ab 4,99 US-Dollar , ein

30-prozentiger Rabatt für Habr-Benutzer auf ein einzigartiges Analogon von Einstiegsservern, das wir für Sie erfunden haben: Die ganze Wahrheit über VPS (KVM) E5-2650 v4 (6 Kerne) 10 GB DDR4 240 GB SSD 1 Gbit / s ab 20 US-Dollar oder wie man einen Server freigibt? (Optionen sind mit RAID1 und RAID10, bis zu 24 Kernen und bis zu 40 GB DDR4 verfügbar).

Dell R730xd 2 mal günstiger? Nur wir haben

2 x Intel TetraDeca-Core Xeon 2 x E5-2697v3 2,6 GHz 14C 64 GB DDR4 4 x 960 GB SSD 1 Gbit / s 100 TV ab 199 US-Dollar in den Niederlanden! Dell R420 - 2x E5-2430 2,2 GHz 6C 128 GB DDR3 2x960 GB SSD 1 Gbit / s 100 TB - ab 99 US-Dollar! Lesen Sie mehr über

das Erstellen von Infrastruktur-Bldg. Klasse mit Dell R730xd E5-2650 v4 Servern für 9.000 Euro für einen Cent?