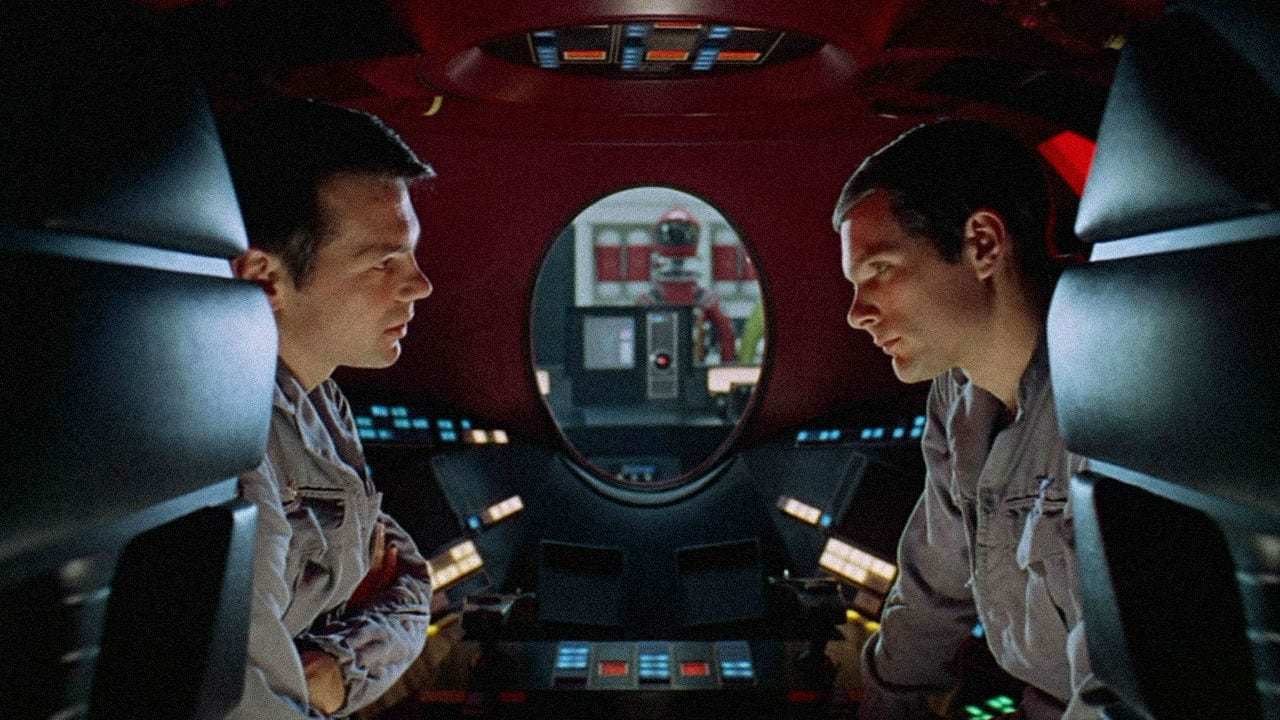

Hal 9000 hat die Lippen perfekt gelesen, allerdings auf Englisch

Hal 9000 hat die Lippen perfekt gelesen, allerdings auf EnglischNeuronale Netze können jetzt viel, und nach und nach werden ihnen immer mehr Fähigkeiten beigebracht. Neulich wurde bekannt, dass ein gemeinsames Team von Forschern aus den USA und China das neuronale Netz so trainieren konnte, dass es Sprache mit hoher Genauigkeit an den Lippen erkennt.

Dies wurde durch ein zusätzliches Element erreicht -

den Spracherkennungsalgorithmus für Audioaufnahmen . Ferner wurde der Algorithmus als Trainingssystem für den zweiten Algorithmus verwendet, der Sprache durch Videoaufnahmen erkannte.

Nach Ansicht der Wissenschaftler können mit dieser Methode zusätzliche Lippenlesetechniken beherrscht werden, die ein mit herkömmlichen Methoden trainiertes neuronales Netzwerk nicht „lernen“ kann. Eine einfache Folge von Bildern ermöglicht es, nur grundlegende Lippenlesetechniken zu beherrschen.

Darüber hinaus verwendeten die Entwickler eine Methode zum Trainieren neuronaler Netze, die als "Destillation von Wissen" bezeichnet wird. Damit können Sie die geringe Größe eines Modells speichern, das eine komplexe Aufgabe ausführt. Unter normalen Umständen hat ein neuronales Netzwerk, das Lippen lesen kann, eine beträchtliche Größe, was die Verwendung auf Smartphones oder anderen Mobilgeräten erschwert.

Ein Modell namens Wissensdestillation ermöglicht es jedoch, diese Einschränkungen zu beseitigen. Während der Arbeit mit diesem Modell muss der Entwickler ein grundlegendes neuronales Netzwerk verwenden, das bereits trainiert ist, und auf seiner Basis ein viel kleineres Modell erstellen, das auf der Basis des ersten „trainiert“ wird. Beide Netzwerke empfangen fast die gleichen Quelldaten. Das kleinere Netzwerk versucht jedoch, die Ergebnisse des größeren Netzwerks sowohl auf der Ausgabeschicht als auch auf allen dazwischen liegenden zu wiederholen. Die Idee wurde erstmals von Caruana im Jahr 2006 eingeführt.

Wissenschaftler unter der Leitung von Mingli Song von der Zhejiang-Universität haben mithilfe der „Destillation“ dem neuronalen Netzwerk das Lesen von Lippen beigebracht. Wie oben erwähnt, ist der Lehrer hier der Spracherkennungsalgorithmus für Audioaufnahmen. Es bietet ausreichend Gelegenheit, eine Reihe subtiler Lippenbewegungen und Sprachmuster zu studieren.

Die resultierende Schaltung ist symmetrisch, wobei zwei wiederkehrende neuronale Netze parallel zueinander angeordnet sind. Ein neuronales Faltungsnetz verarbeitet Videorahmen und liefert Daten für ein anderes. Der Forscher kann sich die Destillation von Wissen nur in Form von mehreren Blöcken vorstellen, von denen jeder für eine bestimmte Aufgabe verantwortlich war. Einer von ihnen ist pro Frame, der zweite ist für eine Datensequenz, der dritte ist für die größte Gesamtsequenz.

Natürlich erfordert ein solches neuronales Netzwerk für den normalen Betrieb ein sorgfältiges Training von Zehntausenden von Elementen. Wissenschaftler haben den LRS2-Datensatz verwendet, der etwa 50.000 einzelne Sätze der BBC-Sprecher enthält, sowie den CMLR-Datensatz, den umfassendsten Satz, um neuronalen Netzen das Lesen von Lippen in Mandarin beizubringen. Die Datenbank der letzteren enthält etwa 100 Tausend Angebote von CNTV.

Die Erkennungsgenauigkeit des resultierenden Systems ist

ungefähr 8% höher als die von anderen neuronalen Netzen, die auf CMLR trainiert haben, und 3% besser als die von neuronalen Netzen, die auf LRS2 trainiert haben.