Die moralische Seite der Entwicklung von Roboterfahrzeugen ist sehr komplex. Die Entwickler sind der festen Überzeugung, dass Tests auf öffentlichen Straßen durchgeführt werden sollten, obwohl sie wissen, dass dies für ahnungslose Verkehrsteilnehmer nur ein geringes Risiko darstellt. Autos, die nach den Tests hergestellt wurden, werden mit Sicherheit (auch tödliche) Unfälle erleiden, und dieser Zustand ist beängstigend und entmutigend. Gleichzeitig verspricht uns der Erfolg enorme Verbesserungen bei der Verkehrssicherheit und die Rettung der Leben einer großen Anzahl von Menschen, die sterben würden, wenn es keine Gelegenheit gäbe, gefährlicheres menschliches Fahren durch eine Drohne zu ersetzen.

Wir werden solche Aspekte berücksichtigen wie:

- Verständnis für unterschiedliche Herangehensweisen an das moralische Denken von Menschen in unterschiedlichen (oder gleichen) Situationen

- Wie Recht, Gesellschaft und Versicherung mit riskantem Fahren, Unfällen und Unfällen zusammenhängen.

- Risiken und Verluste während des Fahrens (oder Fahrtrainings), die wir offenbar für kleine Vorteile akzeptieren.

- Wie ändert sich unsere Ansicht, dass „der Zweck das Mittel rechtfertigt“, je nachdem, worum es geht: absichtliche Gräueltaten oder kleine absichtliche Risiken.

- Die großen Vorteile, die sich ergeben, wenn eine kleine Flotte autonomer Autos sicherer fahren lernt. Danach wird ihre Software auf Millionen anderer Autos kopiert - eine Situation, die für menschliche Fahrer unmöglich ist.

- Risiken und Prinzipien moderner Ansätze zum Testen und Entwickeln autonomer Autos und wie Uber sie verletzt hat.

- Ein großer Vorteil, wenn wir den richtigen Ansatz finden.

Die Tatsache, dass kürzlich in Tempe, Arizona, ein tödlicher Unfall mit einem Uber-Fahrzeug entdeckt wurde, erhöht die Notwendigkeit, dieses Problem zu verstehen. Es wurden viele Texte verfasst und viele Meinungen geäußert, wie die Risiken und Grundsätze der Moral in unbemannten Fahrzeugen erörtert werden können. Ich hoffe, dass ich in diesem Artikel sowohl eine klare Sicht auf dieses Problem als auch einen Leitfaden für die Diskussion darüber präsentieren kann.

Die meisten Abstürze sind Einzelmaschinen und können verhindert werden. Trotzdem haben wir dieses schreckliche Risiko ohne nachzudenken gemeistert.

Die meisten Abstürze sind Einzelmaschinen und können verhindert werden. Trotzdem haben wir dieses schreckliche Risiko ohne nachzudenken gemeistert.Es stellt sich heraus, dass eine Kombination der Lehren, die wir aus dem Wagenproblem ziehen (nämlich aus dem Wagen, nicht aus dem unbemannten Fahrzeug) und der Messung der Maßnahmen, die zu Risiken anstelle von Tragödien führen, uns dabei helfen kann, ein besseres Verständnis und Rechtssystem für die Lösung komplexer Fragen zu Robotern zu entwickeln, die und können Menschenleben retten und bedrohen. Wir können Millionen von Menschenleben retten, wenn wir bereit sind, die gleichen Risiken einzugehen wie beim Unterrichten von Teenagern, bevor diese mit dem Autofahren beginnen (anstelle von Teenagern können Sie sich vorstellen, Pizzaboten zu beeilen). Fast jeder, der an Robotern arbeitet, möchte, dass sie Leben retten und dies so bald wie möglich tun. Dafür muss die Öffentlichkeit jedoch die Arbeitsmethoden in diesem Bereich verstehen und sogar anwenden. Dazu müssen wir sowohl unsere moralischen Instinkte als auch unsere interne Mathematik und den Unterschied zwischen Risiko und Tragödie verstehen.

Ich erkannte die Schwierigkeit, diese Probleme vor einem Jahr zu verstehen, als ich zu Hause mit meinem Freund beim Abendessen sprach. Ein Freund war sehr besorgt über die Risiken, die frühe Prototypen bergen. Ich fragte ihn: Wäre es vernünftig, 100 Menschen beim Testen sterben zu lassen, aber wenn Sie das Endprodukt verwenden, werden Millionen von Menschenleben gerettet? Es schien ihm offensichtlich, dass dies falsch war, und er war mit dieser Meinung nicht allein.

Die menschliche Moral ist komplex und listig und kann je nach Situation auf unterschiedliche Weise funktionieren. Nur wenige von uns sind in ihren Grundsätzen glasklar, und diese Grundsätze, die wir in unseren subjektiven Entscheidungen anwenden, können sich von denen unterscheiden, die in kollektiven Entscheidungen in der Gesellschaft oder vor Gericht verwendet werden. Um dieses Problem zu verstehen und zu einer besseren Lösung zu gelangen, müssen wir verstehen, wie die Menschen über eine solche Moral denken, und möglicherweise dieses Denken ändern, um ein Ergebnis zu erzielen, das in der Mehrheitsmeinung besser ist.

Die Antwort könnte in der Tatsache liegen, dass wir, obwohl wir nicht der Meinung sind, dass große Ziele unmoralische Mittel rechtfertigen können, zugeben möchten, dass auch bescheidene profitable Ziele Mittel mit geringen unmoralischen Risiken rechtfertigen können.

Arten von Moral

Grob gesagt unterscheiden Philosophen zwei breite Klassen von Moralsystemen. Der erste setzt einen Kodex von Regeln und Prinzipien voraus und definiert einen Fehler als Verstoß gegen dieselben Regeln und Prinzipien, unabhängig vom Ergebnis. Der komplexe Name solcher Systeme ist "deontologisch", aber wir werden sie als regelbasiert bezeichnen. Auf der anderen Seite haben wir Systeme, die auf Ergebnissen basieren, die richtig und falsch mit dem messen, womit wir enden. Sie sind auch als Konsequentialisten bekannt. Eine bestimmte Untergruppe solcher Systeme ist utilitaristisch und folgt der Regel, das größte Wohl für die größte Anzahl von Menschen zu erzielen oder der geringsten Anzahl von Menschen den geringsten Schaden zuzufügen.

Manchmal lieben wir utilitaristische Moralsysteme, besonders als Gesellschaft. Als Individuen neigen wir jedoch dazu, ihnen zu misstrauen, weil sie mit der gefährlichen Idee verbunden sind, dass „der Zweck die Mittel rechtfertigt“, und diese Idee hat im Laufe der Geschichte zu einer Menge moralischer Schrecken geführt. Die meisten von uns gehören keiner der Schulen an. Wie bereits erwähnt, ändert sich unser Ansatz in Abhängigkeit davon, ob wir uns als Einzelperson oder als Gesellschaft betrachten, und wir ändern unseren Denkansatz auf der Grundlage unserer persönlichen Ansichten mehr, als wir zugeben möchten.

Ein reiner Anhänger des utilitaristischen Ansatzes wird leicht zustimmen, dass Autos 100 Menschen töten werden, um eine Million zu retten - im Falle der utilitaristischen Moral gibt es nicht einmal eine Frage. Gleichzeitig wird es für viele nicht leicht sein, das zu akzeptieren. Ich vermute, die Antwort ist zu verstehen, wie wir als Individuen Vorfällen und Tragödien besondere Aufmerksamkeit schenken, während wir in der Rolle der Gesellschaft auf Risikobewertung und öffentliche Güter achten.

Diejenigen, die meine Texte lesen, wissen, dass

ich die Standardanwendung des „Trolley-Problems“ auf unbemannte Fahrzeuge hasse . In dieser Anwendung stellen sich die Leute die Software im Auto vor, die entscheiden soll, welche von zwei verschiedenen Personengruppen bei einem Unfall getötet werden soll. Die Vorstellung, dass Maschinen jetzt entscheiden, wer sterben soll, erfüllt uns schmerzlich, obwohl dies zuvor ein Tätigkeitsfeld der Götter war. In der Tat ist dies eine äußerst seltene Situation, und ihre Lösung ist in keiner Prioritätsliste enthalten. Programmierer und Unternehmen möchten auch keine Algorithmen schreiben, die sich auf moralische Entscheidungen beziehen. Sie würden es vorziehen, dass Politiker solche Fragen beantworten und Gesetze schreiben, denen sie gerne folgen.

Das ursprüngliche Wagenproblem hatte jedoch eine echte Funktion, die in dieser Situation nützlich sein könnte. Es wurde geschaffen, um uns dabei zu helfen, unser eigenes Denken zu verstehen und den Unterschied zwischen regelbasierten und ergebnisorientierten Moralsystemen zu verstehen, das heißt, wir sollten mit Hilfe des Trolley-Problems ein besseres Verständnis der Philosophie erlangen. Und sie kann uns helfen, diese Situation besser zu verstehen.

Wie Sie sich vielleicht erinnern, rast der Wagen in der ursprünglichen Aufgabe auf Schienen mit kaputten Bremsen. Jemand (in dieser Situation wirklich unmoralisch) band 5 Personen an die Hauptstraße und eine Person an den Zweig. Sie können den Schalter ziehen, um eine Person zu töten, aber fünf sparen. Bis zu 90% der Menschen wählen einen zweckmäßigen (ergebnisorientierten) Ansatz und ziehen es vor, den Hebel zu ziehen, einige lehnen jedoch ab. (In der Tat ist es wahrscheinlicher, dass sich diese Personen in der Unterrichtsübung so verhalten. In der

Mind Field- Show auf YouTube wurde ein Experiment durchgeführt, bei dem die Menschen zu der Annahme gezwungen wurden, dass sie sich wirklich in einer Situation mit einem rauschenden Wagen und angehängten Personen befinden. Achtung, Spoiler : die meisten Themen erstarrten einfach vor Entsetzen)

Ich möchte sagen, dass die technische Lösung für dieses Problem einfacher ist -

Sie müssen die Wagenbremsen reparieren . Unbemannte Fahrzeugingenieure werden in erster Linie dafür sorgen, dass ihre Autos niemals in solche Situationen geraten, auch wenn sie sehr selten vorkommen.

Variationen des von Philosophen erfundenen Trolley-Problems sind viel interessanter als der ursprüngliche Wortlaut. Bei einer der Optionen müssen Sie nicht den Schalter ziehen, sondern den dicken Mann auf die Schienen drücken, um den Wagen anzuhalten - nur wenige werden es tun, da es sich um einen vorsätzlichen Mord handelt. In der extremsten Version haben Sie keinen Wagen, aber es gibt 5 Patienten, die dringend eine Organtransplantation benötigen. Sie können sich einen Mann schnappen, der die Straße entlanggeht, ihn schneiden und fünf Menschen retten - fast niemand ist damit einverstanden, obwohl dies das gleiche Problem unter dem Gesichtspunkt eines utilitaristischen Ansatzes ist.

Fast niemand wird dies tun, denn unter uns gibt es nur wenige, die einer bestimmten moralischen Schule streng angehören. Es ist schwieriger für uns, unser Denken zu ändern. Um Probleme auf dem Gebiet des Testens und der Herstellung unbemannter Fahrzeuge zu verstehen und zu lösen, müssen wir den natürlichen und individuellen Instinkt überwinden, verschiedene Fälle als „nur“ einzelne Tragödien wahrnehmen, die sie darstellen, und darüber nachdenken, welche Risiken akzeptabel sind und sein können als Gesellschaft erlaubt.

Darüber hinaus werden wir von den Tragödien, die externen Passanten passieren, viel mehr abgelehnt, obwohl es uns weniger ausmacht, diese Menschen geringeren Risiken auszusetzen. Schließlich haben wir mehr Angst, dass uns unabhängige Maschinen und nicht Menschen Schaden zufügen.

Die Leute sind komisch, dass wir, obwohl die meisten Angst haben, an Robotern zu sterben, eher von einem betrunkenen Verbrecher getötet werden.

Grundsätzlich denken die Leute, dass Töten, um Leben zu retten, falsch ist, es ist unbestreitbar. Die eigentliche Frage ist, was es eigentlich heißt, unbemannte Fahrzeuge auf der Straße zu testen und freizugeben - töten, um Leben zu retten, oder Risiken für denselben Zweck einzugehen. Tatsächlich sind wir uns in den meisten Fällen einig, das Risiko einzugehen, um Leben zu retten, sofern ein gutes Ergebnis erzielt wird.

Moralische Aspekte des Fahrens

Wie ist also die Beziehung zwischen Moralphilosophie und Autos? Um dies herauszufinden, müssen wir über den moralischen Aspekt von Verkehrsunfällen nachdenken. Individuen und die Gesellschaft insgesamt stehen diesem Problem unterschiedlich gegenüber. Gesellschaften im Allgemeinen und das Gesetz im Besonderen ziehen es vor, nichts als unmoralisch oder böse zu bezeichnen, es sei denn, es gab eine böswillige Absicht, die in der Rechtsprechung als Mens Rea bezeichnet wird. Fast alle Straftaten beinhalten böswillige Absichten, und wenn dies nicht der Fall ist, wird die Bestrafung (in den meisten Fällen) gemildert. Aus diesem Grund sind Situationen keine Seltenheit, in denen jemand eine Person in einem Auto zu Tode stößt und dafür nicht strafrechtlich haftbar gemacht wird. Der Fahrer wird finanziell bestraft, ist aber versichert. Der Täter wird aus dieser Situation nur mit einem Gefühl der Schuld für das, was passiert ist, herauskommen. Dies alles ist jedoch nur dann der Fall, wenn das Töten einer Person völlig unbeabsichtigt war und tatsächlich den Absichten des Fahrers völlig zuwiderlief.

Es kann keinen (auch nicht unbeabsichtigten) Mord geben, ohne dass eine klare Absicht oder grobe und vorsätzliche Fahrlässigkeit vorliegt .

Gleichzeitig arbeiten wir hart daran, festzustellen, ob Vorsatz oder Fahrlässigkeit vorliegt, da uns die Tatsache sehr beunruhigt, dass etwas so Tragisches wie der Tod möglicherweise unbeantwortet bleibt. Aber wenn wir über die Situation sprechen, in der der Unfall tatsächlich passiert ist (womit ich meine, dass er sich im Rahmen der üblichen Risiken eines vorsichtigen Fahrens ereignet hat), gibt es keine rechtlichen Konsequenzen. Das Schlimmste, was passieren kann, sind die finanziellen Konsequenzen, die vollständig von der Versicherung bezahlt werden.

Auf der anderen Seite sollten Sie überlegen, zu beschleunigen. Geschwindigkeitsüberschreitungen sind illegal, auch wenn sie häufig begangen werden, werden jedoch an einigen Stellen nur selten bestraft. Wenn Sie beschleunigen, wissen Sie (oder sollten Sie wissen), ob Sie überschreiten oder nicht. Auf diese Weise setzen Sie andere Personen einem zusätzlichen Risiko aus, obwohl glücklicherweise in der Regel nichts Schlimmes passiert. Trotz der Tatsache, dass Sie mit Sicherheit eine Geldstrafe für Geschwindigkeitsüberschreitungen erhalten, werden die meisten Geldstrafen für Überschreitungen verhängt, die niemandem geschadet haben. Fast alle von uns überschreiten regelmäßig die Geschwindigkeit, und dies aus dem offensichtlichen Grund - wir möchten etwas schneller ankommen. Dies mag der Intuition widersprechen, aber absichtliches Beschleunigen in unserem System ist unmoralischer und illegaler als zufälliges Töten, obwohl wir als Individuen viel toleranter gegenüber Geschwindigkeitsüberschreitungen sind.

Ich glaube, dass das eigentliche moralische Problem beim Fahren darin besteht, dass wir andere Menschen absichtlich in Gefahr bringen. Oder genauer gesagt ein unannehmbar hohes Risiko. Jedes Fahren bedeutet, dass andere Personen gefährdet sind. In der Tat ist es wahrscheinlich, dass wir beim Fahren am häufigsten andere Menschen dem größten Risiko aussetzen. Wir alle kennen eine erstaunliche Anzahl von Todesfällen, Verletzungen und Sachschäden durch das Fahren - mehr Menschen starben bei Unfällen als in allen Kriegen und infolge von Terroranschlägen in der Geschichte der Vereinigten Staaten seit dem Unabhängigkeitskrieg. All dies ist erschreckend riskant, aber für uns ist es so wichtig, dass wir beschlossen haben, dieses relativ hohe Risiko für uns und die Menschen um uns herum in Kauf zu nehmen. Wir tun dies mit Absicht, obwohl wir es oft vergessen, und wir erinnern uns sicherlich nicht gut an das mathematische Wesen dieser Phänomene. Wir betrachten dieses Grundrisiko als „akzeptabel“ in unseren Gesetzen und in unserem Leben.

Die Gesellschaft entschied, dass Unrecht und Illegalität nicht bei bestimmten Opfern, sondern bei vorsätzlicher und unachtsamer Gefährdung anderer Menschen zu suchen sind.Wir haben Gesetze erlassen, die es Ihnen untersagen, andere Personen einem außergewöhnlichen Risiko auszusetzen, und Sie erhalten Geldstrafen für Geschwindigkeitsüberschreitungen, falsche Spurwechsel und unachtsames Fahren. Wir halten solche Handlungen für unmoralisch, da sie vorsätzlich oder fahrlässig begangen werden, obwohl wir einen nicht wirklich unbeabsichtigten Tod nicht für unmoralisch halten. Dies hält diejenigen nicht auf, die dies als große Tragödie ansehen, und dies ist eine absolut natürliche Reaktion. Aber als Gesellschaft, die Gesetze schreibt und durchsetzt, nehmen wir alles anders wahr.

Wir finden eine überraschende Anzahl von Fahrrisiken akzeptabel:

- Schweres Fahren

- Fahren bei Regen, Schnee und Nacht

- Fahren an Orten mit vielen Fußgängern und Radfahrern

- Autofahren mit leichten mechanischen Problemen

- Fahren ohne automatische Notbremsung und andere fortschrittliche Technologien

- Fahren in einem schläfrigen Zustand, auch wenn wir einschlafen (zwei Staaten haben Gesetze, die schläfriges Fahren verbieten)

- Unbeschwertes Fahren für Jugendliche, die erst kürzlich eine Lizenz erhalten haben

- Erwachsene, die Studenten fahren

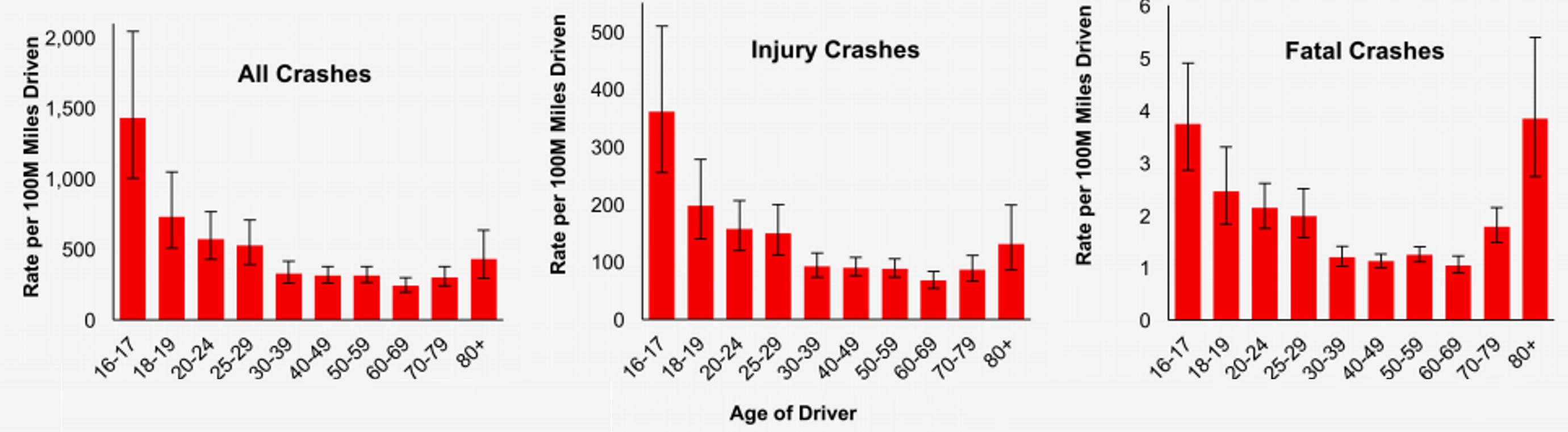

- Fahren älterer Menschen mit reduzierter Wahrnehmung und längeren Reaktionszeiten

- Fahren mit knapp unter dem zulässigen Blutalkoholspiegel

- Fahren in einem kranken Zustand (obwohl es illegal ist)

- Verwenden von Geräten und Schreiben von Nachrichten während der Fahrt (obwohl dies illegal ist)

- In den USA ist das Schnellfahren sehr verbreitet, oft mit einem großen Abstand zu anderen Autos

Schauen wir uns einen unbemannten Fahrzeug-Prototyp an. Wenn ein Entwicklerteam ein solches Auto auf die Straße bringt, gefährdet es bewusst andere Verkehrsteilnehmer. Natürlich wollen sie keinen Unfall verursachen, sondern ihn verhindern.

Momentan arbeiten Testdrohnen bis auf wenige Ausnahmen immer unter der Kontrolle eines menschlichen Fahrers, der bereit ist, bei Problemen zur Arbeit zu kommen. Fast immer gibt es eine zweite Person, die die Systeme überwacht und gelegentlich einen Blick auf die Straße wirft. Dies kann mit der Situation verglichen werden, in der ein jugendlicher Fahrer mit einem Studentenausweis von einem Ausbilder begleitet wird. Der Ausbilder hat sein eigenes Bremspedal und kann das Rad abfangen, wie der Fahrer in einer Drohne. Jugendliche Fahrer, begleitet von Ausbildern, haben tatsächlich ziemlich gute Sicherheitswerte, wie fast alle unbemannten Fahrzeugteams - mit Ausnahme von Uber, über das ich später sprechen werde.

Diese jugendlichen Fahrer, die nach bestandener Mindestprüfung einen Führerschein erhalten haben, werden zu den gefährlichsten Fahrern auf der Straße. Wir lassen sie auf der Straße frei, um ihnen Mobilität zu ermöglichen, auch weil dies der einzige Weg ist, sie vorsichtiger zu machen, was sie schließlich werden. Wir gehen die Risiken ein, die mit dem Fahren eines Fahrers im Teenageralter verbunden sind, in der Hoffnung, in Zukunft einen vorsichtigen Fahrer zu finden. Von jedem riskanten Teenager auf der Straße wächst ein Erwachsener auf, ein vorsichtigerer Erwachsener (tatsächlich etwas weniger als einer, weil nicht alle Teenager dieses sicherste Alter erreichen).

Wie bereits erwähnt, setzt das Drohnen-Entwicklungsteam die Menschen in ihrer Umgebung einem gewissen Risiko aus, doch der Nutzen dieses Risikos ist enorm. Eine kurze Studienreise wird die Sicherheit aller nachfolgenden Autos verbessern, die später erstellt werden, was letztendlich Millionen von verbesserten Autos bedeutet. Indem wir die Hauptrisiken des Testens und Entwickelns akzeptieren, profitieren wir von einer signifikanten Reduzierung der Risiken in der Zukunft. Risikominderung wird eintreten, wenn Autos sicherer als Menschen zu fahren beginnen, und Menschen aufhören, andere in Gefahr zu bringen, indem sie sich für eine Fahrt mit einem unbemannten Auto entscheiden, anstatt selbstständig zu fahren. Dies gilt insbesondere für Personen, die einen der oben aufgeführten Artikel getrunken haben oder mit diesen in Verbindung stehen.

Einige argumentieren, dass wir nicht nur außergewöhnliche, sondern auch notwendige Risiken berücksichtigen müssen. Weil es falsch sein kann, Menschen einem normalen Risiko auszusetzen, wenn dies nicht notwendig ist. Insbesondere argumentieren einige, dass derzeitige Teams mehr Tests als nötig durchführen und dass dies falsch ist. Vielleicht ist dies der richtige Ansatz (obwohl natürlich die erforderliche Anzahl von Tests umstritten bleibt). Berücksichtigt man jedoch die Gründe, warum Menschen auf der Straße riskante Entscheidungen treffen - von der Lieferung von Lebensmitteln bis zur Rückkehr eine Minute früher nach Hause -, erfüllen sie kaum das notwendige Maß, obwohl wir diese Risiken tolerieren.

Hier müssen wir ausgehend von den Ergebnissen argumentieren. , , , . - , . -, . – , – . .

, . , 0.1 . – , 1 . – 0.013 . , , . – , , , 1/250 . , , . , . , . , ,

( ) , . 1.5 , . ( 1.7 ), .

, « », ? – , , . , , .

, . , ( ), 100 000 . 1.5 . . 100 000 – , 10 2-3 .

, . , , , , , . . , , , «» , . , -, . , , .

?

? Waymo. 7 , Google. 10 . , , , – , , , . , Waymo, , – , , . , .

Tesla , Tesla . 4.3 2.7 . Tesla , , , , . , , ( ) , , . , , - , , , . , Tesla , , . , Uber.

Uber

2018 Uber , , , . , .

, , , , 99.9% . Uber , , - , , . , , , , , Uber, , , , - , . , . , . , — , , — . Uber 18 , .

, , , , . , . , Uber , . , , . - , , , Uber - , . Uber .

, , . , . , , . , , , , , . 0,07% , , , .

. , . , Uber ( ), , , , . , . , – . , , . , , . 3 .

Fazit

, – , . , , , , . , , , .

, , 100 , . , , , , ., . , , , — , — . , , , , - , , . , , .

, , . . , , .

Über ITELMAWir sind ein großes

Automobilzulieferunternehmen . Das Unternehmen beschäftigt rund 2.500 Mitarbeiter, darunter 650 Ingenieure.

Wir sind vielleicht das leistungsstärkste Kompetenzzentrum in Russland für die Entwicklung der Automobilelektronik in Russland. Jetzt sind wir aktiv am Wachsen und haben viele offene Stellen (etwa 30, einschließlich in den Regionen) geöffnet, wie z. B. einen Software-Ingenieur, einen Konstrukteur, einen leitenden Entwicklungsingenieur (DSP-Programmierer) usw.

Wir haben viele interessante Herausforderungen von Autoherstellern und Sorgen, die die Branche antreiben. Wenn Sie als Spezialist wachsen und von den Besten lernen möchten, freuen wir uns, Sie in unserem Team zu sehen. Wir sind auch bereit, Know-how zu teilen, das wichtigste, was in der Automobilindustrie passiert. Stellen Sie uns Fragen, wir werden antworten, wir werden diskutieren.

Lesen Sie weitere nützliche Artikel: