NVIDIA está buscando formas de optimizar las imágenes de BP

La compañía planea aumentar la comodidad de BP y reducir la carga de potencia informática mediante la simulación de visión periférica.

El ojo humano es complejo. Nosotros, como omnívoros, tenemos un ángulo de visión bastante amplio, pero aún vemos claramente en qué están enfocados nuestros ojos. El resto del área nos permite distinguir entre objetos, pero los vemos borrosos, borrosos. Esto es lo que llamamos visión periférica.Inicialmente, los fabricantes de cascos de realidad virtual persiguieron la claridad de la imagen en las pantallas, la frecuencia de actualización del marco y la calidad general de la imagen. Ahora que los productos HTC, Oculus y Sony están entrando en un amplio mercado, es hora de pensar en la optimización, porque no todos pueden permitirse una PC de escritorio con un valor de $ 1,500 a $ 2,500 para probar un nuevo producto. Y esto es sin el costo de los auriculares en sí.La principal carga financiera está formada por las tarjetas de video que muestran imágenes en dos transmisiones en las pantallas de los cascos VR. Y NVidia, como el jugador principal en el mercado y el proveedor, pensó en optimizar y mejorar la comodidad del proceso de inmersión en el mundo de la realidad virtual.Ahora, la imagen completa de los auriculares VR se dibuja con el mismo grado de calidad. Al mirar cualquier parte de la pantalla, el usuario verá la misma calidad de imagen. Pero en realidad, el ojo humano claramente ve solo en un área estrecha de enfoque, y todo lo demás recae en la visión periférica, la imagen desde la cual nuestro cerebro procesa y se suaviza.NVidia concluyó que simular el comportamiento del ojo real al renderizar imágenes en las pantallas de los auriculares BP sería una buena solución, porque, en primer lugar, reducirá la carga en la potencia informática de la PC a la que está conectado el casco y, en segundo lugar, aumentará el realismo comportamiento de la imagen y, en consecuencia, aumentan la comodidad del juego.Pero, dado que nuestros ojos son móviles, es imposible hacer un claro "desenfoque" de enfoque en el centro de la pantalla. Para simular el comportamiento de la visión real, los ingenieros de NVIDIA recurrieron a un sistema de seguimiento ocular para determinar claramente dónde está mirando el usuario. Como resultado, lograron desarrollar un sistema que simula el comportamiento de la visión humana de manera bastante realista y al mismo tiempo guarda los recursos informáticos del sistema:

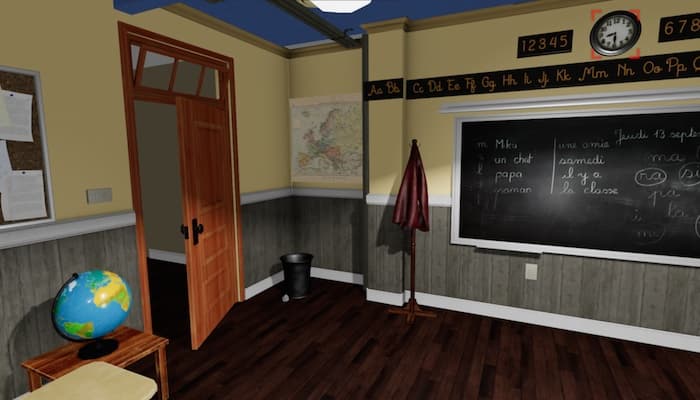

El ojo humano es complejo. Nosotros, como omnívoros, tenemos un ángulo de visión bastante amplio, pero aún vemos claramente en qué están enfocados nuestros ojos. El resto del área nos permite distinguir entre objetos, pero los vemos borrosos, borrosos. Esto es lo que llamamos visión periférica.Inicialmente, los fabricantes de cascos de realidad virtual persiguieron la claridad de la imagen en las pantallas, la frecuencia de actualización del marco y la calidad general de la imagen. Ahora que los productos HTC, Oculus y Sony están entrando en un amplio mercado, es hora de pensar en la optimización, porque no todos pueden permitirse una PC de escritorio con un valor de $ 1,500 a $ 2,500 para probar un nuevo producto. Y esto es sin el costo de los auriculares en sí.La principal carga financiera está formada por las tarjetas de video que muestran imágenes en dos transmisiones en las pantallas de los cascos VR. Y NVidia, como el jugador principal en el mercado y el proveedor, pensó en optimizar y mejorar la comodidad del proceso de inmersión en el mundo de la realidad virtual.Ahora, la imagen completa de los auriculares VR se dibuja con el mismo grado de calidad. Al mirar cualquier parte de la pantalla, el usuario verá la misma calidad de imagen. Pero en realidad, el ojo humano claramente ve solo en un área estrecha de enfoque, y todo lo demás recae en la visión periférica, la imagen desde la cual nuestro cerebro procesa y se suaviza.NVidia concluyó que simular el comportamiento del ojo real al renderizar imágenes en las pantallas de los auriculares BP sería una buena solución, porque, en primer lugar, reducirá la carga en la potencia informática de la PC a la que está conectado el casco y, en segundo lugar, aumentará el realismo comportamiento de la imagen y, en consecuencia, aumentan la comodidad del juego.Pero, dado que nuestros ojos son móviles, es imposible hacer un claro "desenfoque" de enfoque en el centro de la pantalla. Para simular el comportamiento de la visión real, los ingenieros de NVIDIA recurrieron a un sistema de seguimiento ocular para determinar claramente dónde está mirando el usuario. Como resultado, lograron desarrollar un sistema que simula el comportamiento de la visión humana de manera bastante realista y al mismo tiempo guarda los recursos informáticos del sistema: imagen completamente representada para BP, foco en el reloj

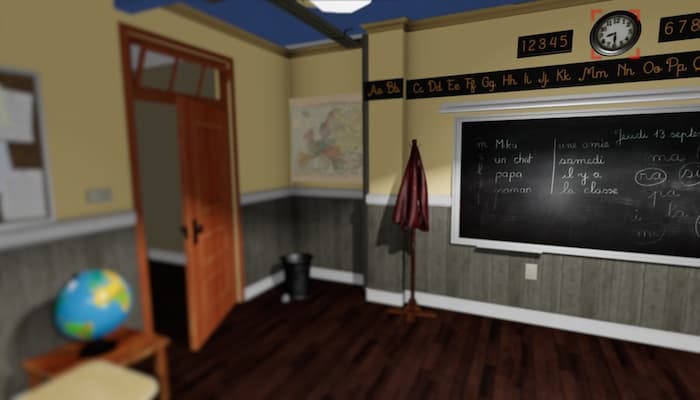

imagen completamente representada para BP, foco en el reloj Solo la periferia "borrosa" de la imagen para BP, el foco en el reloj

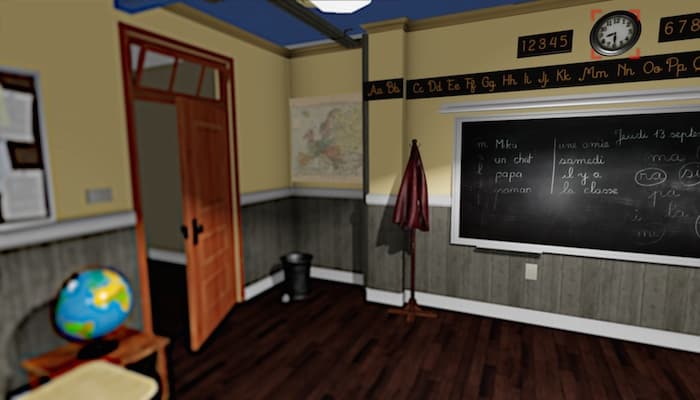

Solo la periferia "borrosa" de la imagen para BP, el foco en el reloj Periferia "borrosa" de la imagen para BP con el mantenimiento del nivel de contraste necesario, imitación de visión real, enfoque en el relojIncluso ahora, con solo mirar la imagen, puede reconocer que los ingenieros de NVIDIA están en el camino correcto. Centrándose en el reloj incluso en la pantalla del monitor, la diferencia entre la primera y la tercera imagen, a primera vista, está prácticamente ausente. El desarrollo se basa en la tecnología SMI existente (SensoMotoric Instruments), que se introdujo para Oculus Rift DK2 en noviembre de 2014.Si cree que los ingenieros de NVIDIA simplemente "hacen espuma" con todo lo que está fuera de foco, está equivocado. En el curso del trabajo, se descubrió que durante la representación tradicional de la imagen en el campo de la visión periférica, se forman inmersiones y parpadeos, lo que provoca una sensación de incomodidad. Solo el "desenfoque" de la imagen reduce el contraste, lo que provoca una sensación de "túnel" de la visión.Es por eso que los ingenieros crearon un algoritmo completo que evalúa la forma, el color y el contraste, así como el movimiento del objeto. Gracias a esto, el "azul" para el usuario pasa de manera cómoda y casi imperceptible, sin efectos secundarios.Video de demostración de las etapas de las imágenes "borrosas" para BP de NVIDIA

Periferia "borrosa" de la imagen para BP con el mantenimiento del nivel de contraste necesario, imitación de visión real, enfoque en el relojIncluso ahora, con solo mirar la imagen, puede reconocer que los ingenieros de NVIDIA están en el camino correcto. Centrándose en el reloj incluso en la pantalla del monitor, la diferencia entre la primera y la tercera imagen, a primera vista, está prácticamente ausente. El desarrollo se basa en la tecnología SMI existente (SensoMotoric Instruments), que se introdujo para Oculus Rift DK2 en noviembre de 2014.Si cree que los ingenieros de NVIDIA simplemente "hacen espuma" con todo lo que está fuera de foco, está equivocado. En el curso del trabajo, se descubrió que durante la representación tradicional de la imagen en el campo de la visión periférica, se forman inmersiones y parpadeos, lo que provoca una sensación de incomodidad. Solo el "desenfoque" de la imagen reduce el contraste, lo que provoca una sensación de "túnel" de la visión.Es por eso que los ingenieros crearon un algoritmo completo que evalúa la forma, el color y el contraste, así como el movimiento del objeto. Gracias a esto, el "azul" para el usuario pasa de manera cómoda y casi imperceptible, sin efectos secundarios.Video de demostración de las etapas de las imágenes "borrosas" para BP de NVIDIASource: https://habr.com/ru/post/es396385/

All Articles