Cómo los granjeros japoneses clasificaron los pepinos con aprendizaje profundo y TensorFlow

Las capacidades de los sistemas cognitivos modernos siguen siendo limitadas, pero con el tiempo se desarrollan y se vuelven más perfectas. Ya se utilizan en muchas áreas, incluida la agricultura. Un ejemplo sorprendente de esto es un sistema creado por un ingeniero japonés. Hace aproximadamente un año, un hombre japonés llamado Makoto Koike decidió ayudar a sus padres a cultivar pepinos. En Japón, los pepinos grandes y directos se consideran productos de clase extra, por lo que todos los agricultores buscan cultivar estos vegetales de esta forma.Es bastante difícil hacer esto, y Koike estaba convencido de esto por su propia experiencia. "Cada pepino es diferente de los demás, todos vienen en diferentes formas, cualidades y frescura", dice el ingeniero. Para que el producto final vaya a las tiendas, las verduras deben clasificarse. En Japón, hay nueve clases de pepinos. La clasificación se realiza de acuerdo con la forma, el tamaño y una serie de otras propiedades. Cuanto más alta es la clase, más caro es el pepino.

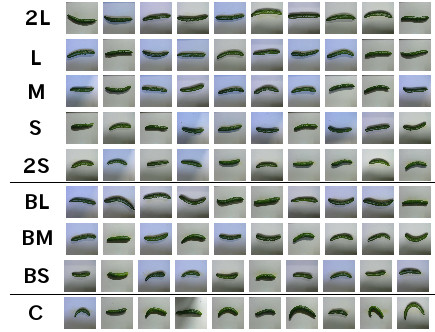

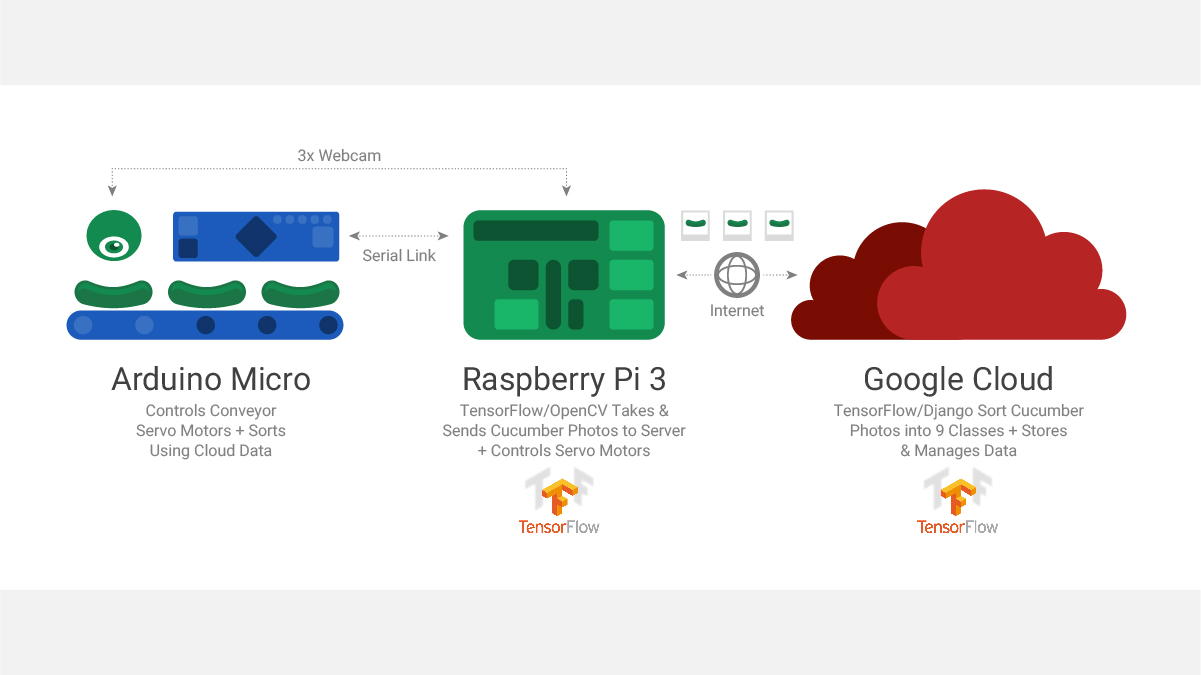

Las capacidades de los sistemas cognitivos modernos siguen siendo limitadas, pero con el tiempo se desarrollan y se vuelven más perfectas. Ya se utilizan en muchas áreas, incluida la agricultura. Un ejemplo sorprendente de esto es un sistema creado por un ingeniero japonés. Hace aproximadamente un año, un hombre japonés llamado Makoto Koike decidió ayudar a sus padres a cultivar pepinos. En Japón, los pepinos grandes y directos se consideran productos de clase extra, por lo que todos los agricultores buscan cultivar estos vegetales de esta forma.Es bastante difícil hacer esto, y Koike estaba convencido de esto por su propia experiencia. "Cada pepino es diferente de los demás, todos vienen en diferentes formas, cualidades y frescura", dice el ingeniero. Para que el producto final vaya a las tiendas, las verduras deben clasificarse. En Japón, hay nueve clases de pepinos. La clasificación se realiza de acuerdo con la forma, el tamaño y una serie de otras propiedades. Cuanto más alta es la clase, más caro es el pepino. Clases de pepinos según los estándares japoneses Laclasificación es un negocio complicado. Y aunque existen máquinas de clasificación automática en Japón, no son muy populares, porque son bastante caras y no funcionan perfectamente. El ingeniero decidió ayudar a los padres a lograr la clasificación automática perfecta de vegetales creando su propio clasificador. Para mejorar la calidad y la eficiencia de dicho sistema, decidió involucrar redes neuronales en la clasificación. Ahora pueden reconocer y clasificar imágenes con un alto grado de precisión, superando las capacidades humanas. Esto se aplica tanto a la velocidad como a la precisión.El hijo cariñoso decidió tomar el desarrollo de Google, TensorFlow, como la base de su algoritmo de código abierto de clasificación de pepino. Hace un año, la compañía acaba de abrir el código fuente de este producto para todos. TensorFlow permite al desarrollador usar código listo y las capacidades de las redes neuronales, en lugar de crear todo desde cero. Para crear su propio proyecto, debe descargar el código, leer las instrucciones y comenzar a trabajar.Además del código, también necesita hardware. Los japoneses decidieron usar Arduino Micro y Raspberry Pi 3. La electrónica se usó como el controlador principal para trabajar con la cámara y enviar imágenes a Google Cloud, donde se analizó la información. Los tableros también controlan los servos del clasificador.

Clases de pepinos según los estándares japoneses Laclasificación es un negocio complicado. Y aunque existen máquinas de clasificación automática en Japón, no son muy populares, porque son bastante caras y no funcionan perfectamente. El ingeniero decidió ayudar a los padres a lograr la clasificación automática perfecta de vegetales creando su propio clasificador. Para mejorar la calidad y la eficiencia de dicho sistema, decidió involucrar redes neuronales en la clasificación. Ahora pueden reconocer y clasificar imágenes con un alto grado de precisión, superando las capacidades humanas. Esto se aplica tanto a la velocidad como a la precisión.El hijo cariñoso decidió tomar el desarrollo de Google, TensorFlow, como la base de su algoritmo de código abierto de clasificación de pepino. Hace un año, la compañía acaba de abrir el código fuente de este producto para todos. TensorFlow permite al desarrollador usar código listo y las capacidades de las redes neuronales, en lugar de crear todo desde cero. Para crear su propio proyecto, debe descargar el código, leer las instrucciones y comenzar a trabajar.Además del código, también necesita hardware. Los japoneses decidieron usar Arduino Micro y Raspberry Pi 3. La electrónica se usó como el controlador principal para trabajar con la cámara y enviar imágenes a Google Cloud, donde se analizó la información. Los tableros también controlan los servos del clasificador. En la primera etapa, el ingeniero entrenó al sistema para reconocer imágenes y determinar si en la fotografía se representa un pepino u otra cosa. Después de verificar la operatividad del sistema, se creó un algoritmo más complejo, que ya ha clasificado a los pepinos de acuerdo con los estándares adoptados en Japón.Después de eso, se desarrolló un sistema de transporte y clasificación. La cámara tomó imágenes de pepinos que pasaban por el transportador, la red neuronal los clasificó. Solo quedaba distribuir pepinos en cajas, según la clase de cada verdura. Para esto, Koike creó un brazo robótico, que se dedicaba al "trabajo físico".Para obtener fotografías de pepinos de diferentes clases ordenados por su madre, los japoneses pasaron unos tres meses. Tuvo que hacer y subir al sistema más de 7000 imágenes de pepinos. Y eso no fue suficiente. Cuando la prueba se realizó solo con imágenes, el sistema funcionó con una precisión del 95%. Pero cuando se trataba de fotografiar pepinos reales, la precisión se redujo al 70%. Al final resultó que, el problema es que una base de datos de varios miles de fotografías no es suficiente para una formación de alta calidad del sistema.El segundo problema es que el sistema consume muchos recursos, tiempo y energía. El clasificador actual es una PC de escritorio normal de Windows que se usa para entrenar una red neuronal. Y aunque la computadora convierte las imágenes recibidas por las cámaras en imágenes con una resolución de 80 * 80 píxeles, el aprendizaje de un sistema basado en ellas lleva 2-3 días. El hecho es que se requieren varios miles de estas imágenes. Y dado que las fotos tienen baja resolución, ese clasificador opera con propiedades tales como la forma, la longitud y el nivel de error. Color, textura, rasguños: todo esto pasa desapercibido y no se puede usar en esta etapa. Si aumenta la resolución de las fotos, esto aumentará la precisión del sistema. Pero al mismo tiempo, el tiempo requerido para entrenar la red neuronal también aumentará.Los japoneses planean resolver su problema con la ayuda de otro servicio de Google. Ahora la corporación ofrece a bajo precio la plataforma en la nube Cloud Machine Learning (Cloud ML). Miles de servidores potentes están involucrados aquí. Procesan eficientemente la información y ayudan a entrenar el sistema neural basado en TensorFlow.Ahora Makoto Koike planea usar Google ML para sus propios fines. “Puedo usar el servicio para crear un sistema de capacitación basado en imágenes mucho mejores. También puedo usar diferentes configuraciones, parámetros y algoritmos del sistema neural, que pueden ayudar a encontrar una opción en la que el sistema sea más preciso ".Hasta ahora, los resultados del trabajo de Koyke con Google ML no están disponibles, continúa experimentando. Pero es posible que en unos pocos meses, la granja de pepinos de los padres japoneses suministre verduras que se clasifican exclusivamente. Los japoneses siguen siendo perfeccionistas.

En la primera etapa, el ingeniero entrenó al sistema para reconocer imágenes y determinar si en la fotografía se representa un pepino u otra cosa. Después de verificar la operatividad del sistema, se creó un algoritmo más complejo, que ya ha clasificado a los pepinos de acuerdo con los estándares adoptados en Japón.Después de eso, se desarrolló un sistema de transporte y clasificación. La cámara tomó imágenes de pepinos que pasaban por el transportador, la red neuronal los clasificó. Solo quedaba distribuir pepinos en cajas, según la clase de cada verdura. Para esto, Koike creó un brazo robótico, que se dedicaba al "trabajo físico".Para obtener fotografías de pepinos de diferentes clases ordenados por su madre, los japoneses pasaron unos tres meses. Tuvo que hacer y subir al sistema más de 7000 imágenes de pepinos. Y eso no fue suficiente. Cuando la prueba se realizó solo con imágenes, el sistema funcionó con una precisión del 95%. Pero cuando se trataba de fotografiar pepinos reales, la precisión se redujo al 70%. Al final resultó que, el problema es que una base de datos de varios miles de fotografías no es suficiente para una formación de alta calidad del sistema.El segundo problema es que el sistema consume muchos recursos, tiempo y energía. El clasificador actual es una PC de escritorio normal de Windows que se usa para entrenar una red neuronal. Y aunque la computadora convierte las imágenes recibidas por las cámaras en imágenes con una resolución de 80 * 80 píxeles, el aprendizaje de un sistema basado en ellas lleva 2-3 días. El hecho es que se requieren varios miles de estas imágenes. Y dado que las fotos tienen baja resolución, ese clasificador opera con propiedades tales como la forma, la longitud y el nivel de error. Color, textura, rasguños: todo esto pasa desapercibido y no se puede usar en esta etapa. Si aumenta la resolución de las fotos, esto aumentará la precisión del sistema. Pero al mismo tiempo, el tiempo requerido para entrenar la red neuronal también aumentará.Los japoneses planean resolver su problema con la ayuda de otro servicio de Google. Ahora la corporación ofrece a bajo precio la plataforma en la nube Cloud Machine Learning (Cloud ML). Miles de servidores potentes están involucrados aquí. Procesan eficientemente la información y ayudan a entrenar el sistema neural basado en TensorFlow.Ahora Makoto Koike planea usar Google ML para sus propios fines. “Puedo usar el servicio para crear un sistema de capacitación basado en imágenes mucho mejores. También puedo usar diferentes configuraciones, parámetros y algoritmos del sistema neural, que pueden ayudar a encontrar una opción en la que el sistema sea más preciso ".Hasta ahora, los resultados del trabajo de Koyke con Google ML no están disponibles, continúa experimentando. Pero es posible que en unos pocos meses, la granja de pepinos de los padres japoneses suministre verduras que se clasifican exclusivamente. Los japoneses siguen siendo perfeccionistas.Source: https://habr.com/ru/post/es397305/

All Articles