Proyecto FlyAI: la inteligencia artificial permite a las colonias de moscas

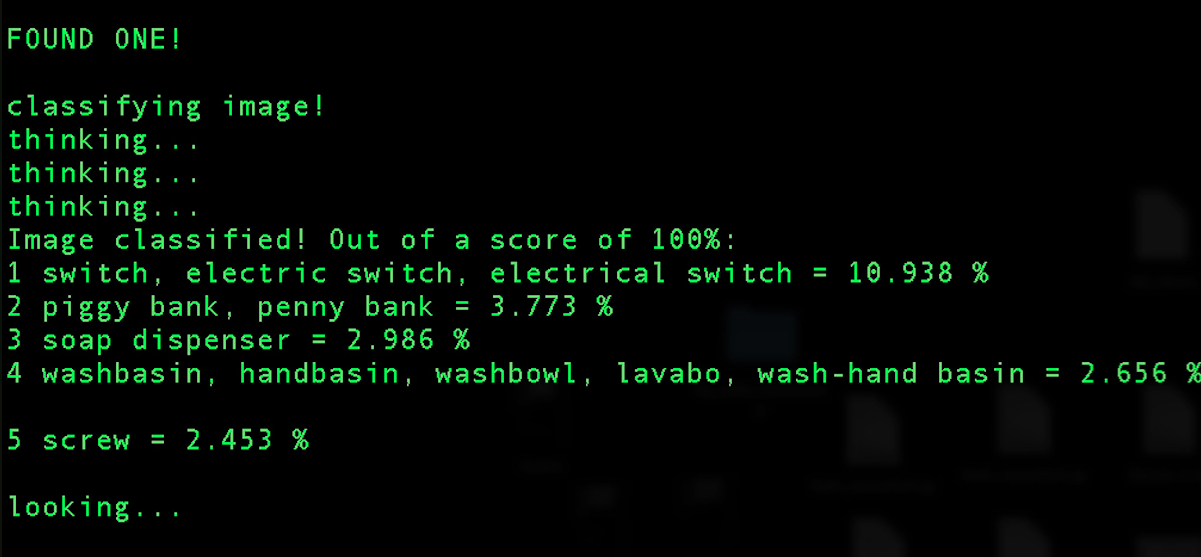

Durante el último mes, la vida de una colonia de moscas ubicada en la ciudad de Duluth, Minnesota, EE. UU., Depende completamente del funcionamiento del software. Esta es una forma débil de IA de autoaprendizaje, que asegura completa y completamente la vida de los insectos dentro de un recipiente especial. En particular, AI proporciona moscas con alimentos (leche en polvo con azúcar) y agua.La vida de los insectos depende de qué tan correctamente la computadora identifique el objeto frente a las cámaras. Si el sistema determina este objeto como una mosca y decide que los insectos necesitan recarga, lo recibirán. En caso de error, las moscas no recibirán comida ni agua y sufrirán (en la medida de lo posible) de hambre y sed durante mucho tiempo. El proyecto en sí se llamaba FlyAI, una especie de parodia de un asentamiento de personas controlado por computadora. En cualquier caso, así es como el autor del proyecto lo ve todo."Debemos dar cuenta del hecho, lo que se puede esperar de la inteligencia artificial, ya que en cualquier caso será", - dijo David Bowen ( por David Bowen es ) de la Universidad de Minnesota en Duluth. Él cree que ahora es necesario pensar en lo que será una verdadera inteligencia artificial, para que no haya problemas. Según el profesor, las personas, a pesar de los problemas, podrán hacer que la IA sea útil para la persona y no la dañarán.Un elemento central del proyecto FlyAI es una red neuronal de autoaprendizaje. Está claro que, como la mayoría de los sistemas modernos de inteligencia artificial, este no es un proyecto ideal. FlyAI carece de una base de datos de imágenes para un aprendizaje efectivo. Por lo tanto, el sistema se equivoca periódicamente al identificar las moscas como interruptores u otros objetos. En caso de identificación incorrecta, la computadora no "inicia" el sistema de soporte vital, y las moscas pasan hambre y sufren sed, como se mencionó anteriormente. Pero en cualquier caso, mientras la colonia vive, ha pasado un mes y las moscas se sienten bien. Si algo sale completamente mal, el diseñador del sistema salvará a los insectos al no permitir su muerte masiva. "Mueren, creo, por razones naturales", dice Bowen. "Tienen la oportunidad de envejecer aquí".El proyecto, dijo, es una encarnación estilizada de los pensamientos del especialista en IA Nick Bostrom, que trabaja en Oxford. Bostrom cree que la apertura de la investigación por parte de especialistas que trabajan en la creación de inteligencia artificial puede ser un problema. En particular, esto se refiere al proyecto Open AI, sobre el cual ya se ha publicado información en Geektimes. "Si tiene un botón" hacer que todos se sientan mal ", es poco probable que quiera compartirlo con todos", dice Bostrom. Pero en el caso de OpenAI, este botón estará disponible para todos.

Durante el último mes, la vida de una colonia de moscas ubicada en la ciudad de Duluth, Minnesota, EE. UU., Depende completamente del funcionamiento del software. Esta es una forma débil de IA de autoaprendizaje, que asegura completa y completamente la vida de los insectos dentro de un recipiente especial. En particular, AI proporciona moscas con alimentos (leche en polvo con azúcar) y agua.La vida de los insectos depende de qué tan correctamente la computadora identifique el objeto frente a las cámaras. Si el sistema determina este objeto como una mosca y decide que los insectos necesitan recarga, lo recibirán. En caso de error, las moscas no recibirán comida ni agua y sufrirán (en la medida de lo posible) de hambre y sed durante mucho tiempo. El proyecto en sí se llamaba FlyAI, una especie de parodia de un asentamiento de personas controlado por computadora. En cualquier caso, así es como el autor del proyecto lo ve todo."Debemos dar cuenta del hecho, lo que se puede esperar de la inteligencia artificial, ya que en cualquier caso será", - dijo David Bowen ( por David Bowen es ) de la Universidad de Minnesota en Duluth. Él cree que ahora es necesario pensar en lo que será una verdadera inteligencia artificial, para que no haya problemas. Según el profesor, las personas, a pesar de los problemas, podrán hacer que la IA sea útil para la persona y no la dañarán.Un elemento central del proyecto FlyAI es una red neuronal de autoaprendizaje. Está claro que, como la mayoría de los sistemas modernos de inteligencia artificial, este no es un proyecto ideal. FlyAI carece de una base de datos de imágenes para un aprendizaje efectivo. Por lo tanto, el sistema se equivoca periódicamente al identificar las moscas como interruptores u otros objetos. En caso de identificación incorrecta, la computadora no "inicia" el sistema de soporte vital, y las moscas pasan hambre y sufren sed, como se mencionó anteriormente. Pero en cualquier caso, mientras la colonia vive, ha pasado un mes y las moscas se sienten bien. Si algo sale completamente mal, el diseñador del sistema salvará a los insectos al no permitir su muerte masiva. "Mueren, creo, por razones naturales", dice Bowen. "Tienen la oportunidad de envejecer aquí".El proyecto, dijo, es una encarnación estilizada de los pensamientos del especialista en IA Nick Bostrom, que trabaja en Oxford. Bostrom cree que la apertura de la investigación por parte de especialistas que trabajan en la creación de inteligencia artificial puede ser un problema. En particular, esto se refiere al proyecto Open AI, sobre el cual ya se ha publicado información en Geektimes. "Si tiene un botón" hacer que todos se sientan mal ", es poco probable que quiera compartirlo con todos", dice Bostrom. Pero en el caso de OpenAI, este botón estará disponible para todos. Sin embargo, Bostrom cree que la inteligencia artificial debería ser una bendición para los humanos. “Para nosotros, es importante crear inteligencia artificial, que sea lo suficientemente inteligente como para aprender de nuestros errores. Podrá perfeccionarse sin cesar. La primera versión podrá crear una segunda, que será mejor, y la segunda, siendo más inteligente que la original, creará una tercera aún más avanzada y así sucesivamente. Bajo ciertas condiciones, este proceso de superación personal puede repetirse hasta que se logre una explosión intelectual, el momento en que el nivel intelectual del sistema salta en poco tiempo de un nivel relativamente modesto al nivel de superinteligencia ” , dijo .Y Bowen argumenta que el riesgo para la humanidad no son las posibilidades ilimitadas de la futura forma fuerte de IA, sino el software del que dependerá la vida humana (de esto no duda). "Uno de los problemas es que ni siquiera entendemos completamente qué es la inteligencia artificial", dice Bowen. "Y se ve intimidante".Una forma fuerte de IA, por supuesto, será completamente diferente de lo que son los buscadores de voz modernos y los asistentes digitales. Es probable que las posibilidades de la inteligencia artificial sean enormes, pero existen riesgos. El mismo Stephen Hawking cree que la IA es el mayor error de la humanidad. Bill Gates afirma que en unas pocas décadas, la inteligencia artificial ya estará suficientemente desarrollada para constituir una causa de preocupación humana. Y Elon Musk llamó a la IA "la principal amenaza para la existencia humana".

Sin embargo, Bostrom cree que la inteligencia artificial debería ser una bendición para los humanos. “Para nosotros, es importante crear inteligencia artificial, que sea lo suficientemente inteligente como para aprender de nuestros errores. Podrá perfeccionarse sin cesar. La primera versión podrá crear una segunda, que será mejor, y la segunda, siendo más inteligente que la original, creará una tercera aún más avanzada y así sucesivamente. Bajo ciertas condiciones, este proceso de superación personal puede repetirse hasta que se logre una explosión intelectual, el momento en que el nivel intelectual del sistema salta en poco tiempo de un nivel relativamente modesto al nivel de superinteligencia ” , dijo .Y Bowen argumenta que el riesgo para la humanidad no son las posibilidades ilimitadas de la futura forma fuerte de IA, sino el software del que dependerá la vida humana (de esto no duda). "Uno de los problemas es que ni siquiera entendemos completamente qué es la inteligencia artificial", dice Bowen. "Y se ve intimidante".Una forma fuerte de IA, por supuesto, será completamente diferente de lo que son los buscadores de voz modernos y los asistentes digitales. Es probable que las posibilidades de la inteligencia artificial sean enormes, pero existen riesgos. El mismo Stephen Hawking cree que la IA es el mayor error de la humanidad. Bill Gates afirma que en unas pocas décadas, la inteligencia artificial ya estará suficientemente desarrollada para constituir una causa de preocupación humana. Y Elon Musk llamó a la IA "la principal amenaza para la existencia humana". La plataforma de software, que es el centro de FlyAI, a menudo comete un error.Por supuesto, el proyecto en sí puede parecer un poco ridículo, pero su autor no lo cree así. En realidad, todo lo que quería era llamar la atención del público sobre su proyecto y el problema de la IA. Podemos decir que tuvo éxito. En cualquier caso, aún no sabemos cuándo aparecerá una IA completa y si aparecerá en absoluto. Esto puede suceder mañana, o tal vez en unas pocas décadas. Para ser seguro para los humanos, la inteligencia artificial debe ser consciente del valor de la vida humana. Sin embargo, el hombre no es una mosca.

La plataforma de software, que es el centro de FlyAI, a menudo comete un error.Por supuesto, el proyecto en sí puede parecer un poco ridículo, pero su autor no lo cree así. En realidad, todo lo que quería era llamar la atención del público sobre su proyecto y el problema de la IA. Podemos decir que tuvo éxito. En cualquier caso, aún no sabemos cuándo aparecerá una IA completa y si aparecerá en absoluto. Esto puede suceder mañana, o tal vez en unas pocas décadas. Para ser seguro para los humanos, la inteligencia artificial debe ser consciente del valor de la vida humana. Sin embargo, el hombre no es una mosca.Source: https://habr.com/ru/post/es400045/

All Articles