La compañía taiwanesa 42Ark y el fabricante estadounidense de alimentadores CatFi Box "inteligentes" utilizan cámaras de CCTV para reconocer las caras de los gatos.

La compañía taiwanesa 42Ark y el fabricante estadounidense de alimentadores CatFi Box "inteligentes" utilizan cámaras de CCTV para reconocer las caras de los gatos.En 1941, el ingeniero eléctrico alemán Walter Bruch instaló un sistema de circuito cerrado de televisión (circuito cerrado de televisión, un sistema de televisión de circuito cerrado) en el sitio de prueba donde se probaron los cohetes V-2. Este es el primer caso en la historia del uso de videovigilancia en la práctica. El operador tenía que sentarse frente al monitor todo el tiempo. Esto continuó hasta 1951, hasta que aparecieron los primeros dispositivos VTR (VideoTape Recorder) que grabaron imágenes en cinta magnética.

La grabación en los medios no salvó al operador de la necesidad de participar en el proceso. Reconocimiento de rostros, ubicación de objetos, incluso detección de movimiento: todas estas funciones fueron realizadas por una persona sentada frente al monitor en tiempo real o estudiando el archivo de video después del hecho.

La rueda del progreso sigue rodando. La videovigilancia recibió un análisis de video que cambió por completo el proceso de trabajo con el sistema. ¿Recuerdas la

historia sobre el gato y la red neuronal de aprendizaje profundo? Sí, esto también es parte del análisis de video, pero pequeño. Hoy hablaremos sobre tecnologías que están cambiando fundamentalmente el mundo de los sistemas de CCTV.

Detección de cola y prueba beta La primera cámara IP del mundo Neteye 200, creada en 1996 por Axis

La primera cámara IP del mundo Neteye 200, creada en 1996 por AxisLa videovigilancia nació como un sistema de seguridad cerrado, diseñado solo para abordar problemas de seguridad. Las limitaciones de la videovigilancia analógica no permitieron el uso de equipos de ninguna otra manera. La integración de la videovigilancia con sistemas digitales ha abierto la posibilidad de recibir automáticamente diversos datos mediante el análisis de la secuencia de imágenes.

La importancia es difícil de sobreestimar: en el caso habitual, después de 12 minutos de observación continua, el operador comienza a perder hasta el 45% de los eventos. Y hasta el 95% de los eventos potencialmente perturbadores se perderán después de 22 minutos de monitoreo continuo (según IMS Research, 2002).

Han aparecido complejos algoritmos de análisis de video: conteo de visitantes, conteo de conversiones, estadísticas de transacciones en efectivo y mucho más. El operador de observación desaparece en este sistema: dejamos a la computadora la capacidad de "mirar" y sacar conclusiones.

El ejemplo más simple de video vigilancia inteligente es la detección de movimiento. No es tan importante si hay un detector incorporado en la propia cámara; si instala, por ejemplo, el software

Ivideon Server en una computadora, entonces el detector de movimiento se utilizará con el software. Un detector puede reemplazar a varios operadores de videovigilancia a la vez. Y ya en la década de 2000, comenzaron a aparecer los primeros sistemas de análisis de video capaces de reconocer objetos y eventos en el marco.

Actualmente, Ivideon está desarrollando varios módulos de análisis de video: desde que lanzamos

OpenAPI , las cosas se han acelerado gracias a la integración con socios. Algunos de los proyectos aún están en pruebas cerradas, pero algo ya está listo. Esto es, en primer lugar,

integración con cajas registradoras para controlar las transacciones en efectivo (hasta ahora basadas en iiko y Shtrikh-M). En segundo lugar, se ha desarrollado un detector de cola.

Teníamos un

mostrador Ivideon , que determinaba el número de clientes en la habitación. El análisis nos permitió alejarnos de equipos especiales hacia la computación en la nube. Ahora no necesitamos una cámara específica: cualquier cámara de vigilancia con una resolución de 1080p + es adecuada. Ahora queremos no solo contar personas, sino también determinar las colas. Por lo tanto, están listos para cualquier tienda, centro comercial u oficina donde la gente va y se para, formando colas, para proporcionar una cámara gratuita para la prueba de detección de colas.

Envíenos un correo electrónico para participar en el proyecto.

Además, Ivideon trabaja con tecnología de reconocimiento facial.

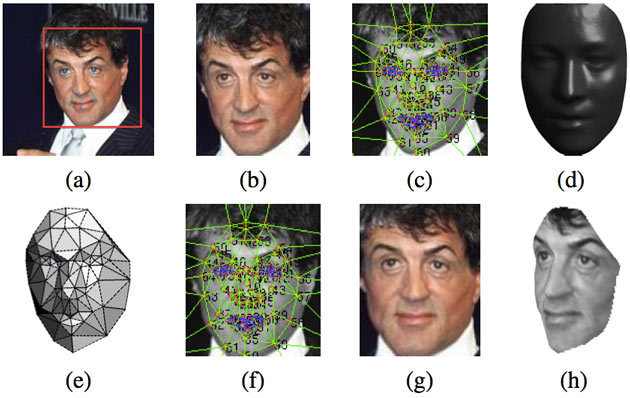

Quien reconoce como Facebook está probando la tecnología DeepFace con el ejemplo del reconocimiento de la cara emocional de Sylvester Stallone

Facebook está probando la tecnología DeepFace con el ejemplo del reconocimiento de la cara emocional de Sylvester StalloneApple, Facebook, Google, Intel, Microsoft y otros gigantes tecnológicos están trabajando en soluciones en esta área. Se instalan sistemas de video vigilancia con reconocimiento facial automático de pasajeros en 22 aeropuertos de EE. UU. En Australia, están desarrollando un sistema biométrico de reconocimiento facial y de huellas digitales como parte de un programa diseñado para automatizar el control de pasaportes y aduanas.

La mayor compañía china de Internet, Baidu, realizó un experimento exitoso sobre la cancelación de boletos utilizando tecnología de reconocimiento facial con una precisión del 99.77%, con un tiempo de disparo y reconocimiento de 0.6 segundos. En las entradas al parque se instalan gradas con tabletas y se instalan marcos especiales que conducen el rodaje. Cuando un turista llega al parque por primera vez, el sistema le toma una foto para usar la función de reconocimiento facial en la foto en el futuro. Las nuevas fotos se comparan con las fotos de la base de datos, de esta manera el sistema determina si una persona tiene derecho a visitarla.

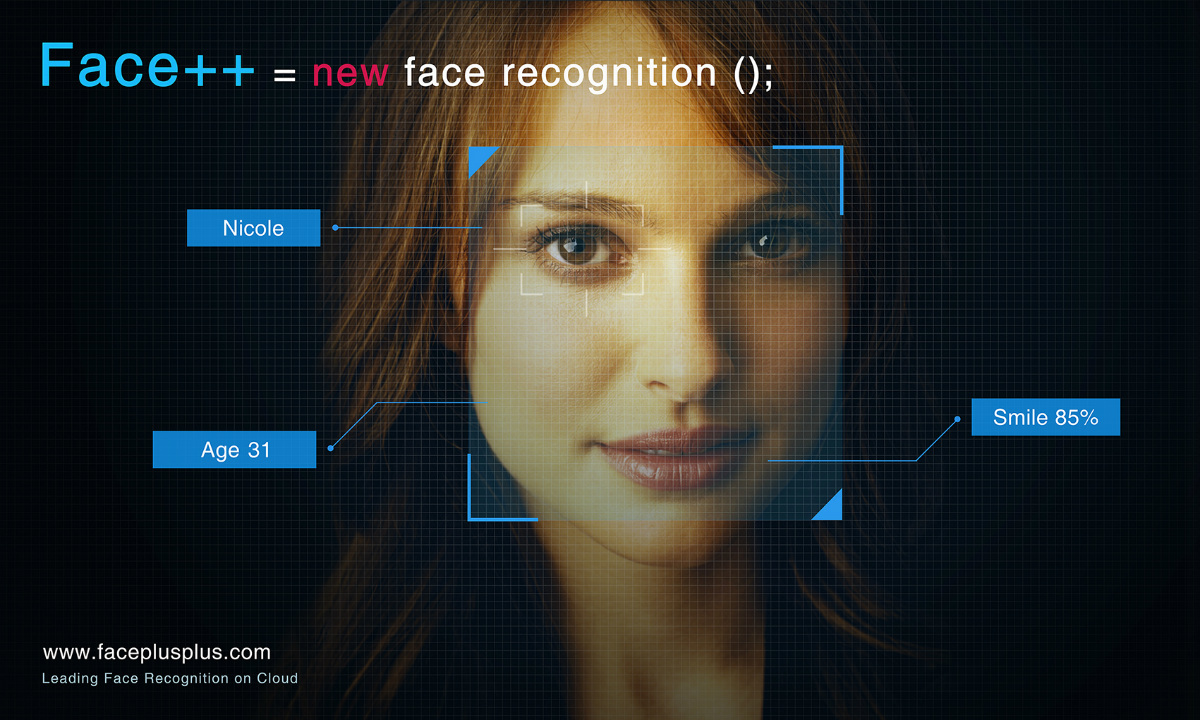

En China, la tecnología es generalmente muy buena. En 2015, Alipay, un operador de plataforma de pagos en línea que forma parte de Alibaba Holding, lanzó un sistema de verificación de pagos basado en Face ++, una plataforma de reconocimiento de rostros en la nube creada por la startup china Megvii. El sistema se llama Smile to Pay: permite a los usuarios de Alipay pagar las compras en línea al tomarse una selfie (Alipay determina al propietario con una sonrisa). UBER en China ha comenzado a

utilizar el sistema de reconocimiento de conductores basado en Face ++ para combatir el fraude, el robo de identidad y proporcionar seguridad adicional a los pasajeros.

Pero es más interesante observar no las soluciones extranjeras, sino los servicios creados en Rusia. Estas tecnologías están mucho más cerca del usuario final (si él es de nuestro país), puede familiarizarse con ellas y, en el futuro, unirse para usarlas en su propio producto. Hay muchas compañías de reconocimiento facial alrededor. Recordemos algunos que quedan de oído.

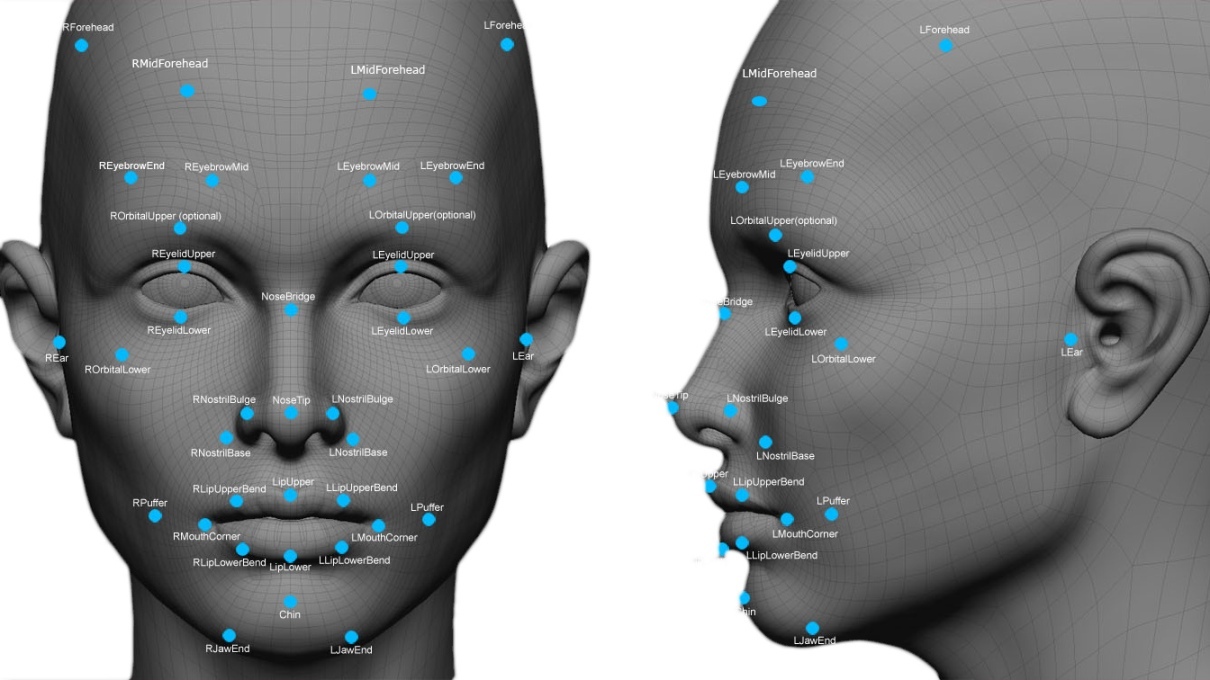

La empresa Vokord, fundada en 1999, utiliza FaceControl 3D para trabajar con imágenes sincrónicas de cámaras estéreo, crea un modelo 3D de la cara en el marco y busca automáticamente el modelo obtenido con los modelos en la base de datos existente. En 2016, Vokord

comenzó a usar su propio algoritmo matemático de reconocimiento facial, que se basa en redes neuronales convolucionales, por lo que sus algoritmos ahora funcionan con cualquier cámara de video vigilancia. La compañía afirma que pueden reconocer los rostros (en el tamaño de 128x128 píxeles) de las personas que siguen la transmisión. A finales de 2016, el algoritmo Vocord DeepVo1 mostró los mejores resultados en las pruebas de identificación global,

reconociendo correctamente el 75.127% de las personas.

Fundado en 2012, VisionLabs ganó el

concurso de empresas de tecnología más grande

GoTech en Rusia y Europa del Este, y fue incluido en la lista de finalistas del programa europeo "¡

Desafío! ”, Diseñado para acelerar el lanzamiento al mercado de soluciones y servicios basados en el concepto de Internet de las cosas, ha atraído inversiones multimillonarias y ya está introduciendo sus productos en el sector comercial. Recientemente, Otkritie Bank lanzó el sistema de reconocimiento facial VisionLabs para optimizar el servicio al cliente y los tiempos de espera en línea. Bueno, vale la pena leer una historia maravillosa sobre cómo los especialistas de CROC

atraparon a un gato usando VisionLabs.

VisionLabs, que ha mostrado uno de los mejores resultados en reconocimiento y tasas de error, también trabaja con redes neuronales que revelan características específicas de cada cara, como la forma de los ojos, la nariz, el alivio de las aurículas, etc. Su sistema Luna le permite encontrar todas estas características de la cara en la foto en los archivos. Otra decisión de la compañía, Face Is, al reconocer la cara del cliente en la tienda, encuentra su perfil en el sistema CRM, aprende del historial de compras y los intereses del comprador, y envía una notificación con una oferta personal sobre el descuento en su categoría favorita de productos al teléfono.

La automatización del proceso de contratación, el inicio de Skillaz y VisionLabs planean

introducir un sistema de reconocimiento informático a finales de 2017 que evaluará el comportamiento de los solicitantes de empleo. Después de analizar los datos, el sistema sacará conclusiones sobre las cualidades profesionales de una persona y la idoneidad para el puesto. La compañía no revela todas las características del sistema de "alquiler de vehículos". Solo se sabe que la sociabilidad del candidato se evaluará en función de sus respuestas a un conjunto específico de preguntas formuladas por el sistema de entrevistas en línea. La red neuronal buscará la relación entre el comportamiento del candidato en la imagen de la cámara de vigilancia y el grado de gravedad de una u otra competencia.

La cuadrícula, que es el Dr. Lightman y Sherlock Holmes en una persona, tendrá en cuenta las expresiones faciales del candidato, sus gestos y la fisonomía. Vale la pena señalar que el método para determinar el tipo de personalidad de la persona, sus cualidades espirituales, basado en el análisis de las características externas y su expresión, se considera un ejemplo moderno de pseudociencia en la ciencia psicológica moderna. Cómo hacer frente a esta contradicción en el nuevo producto aún no está claro.

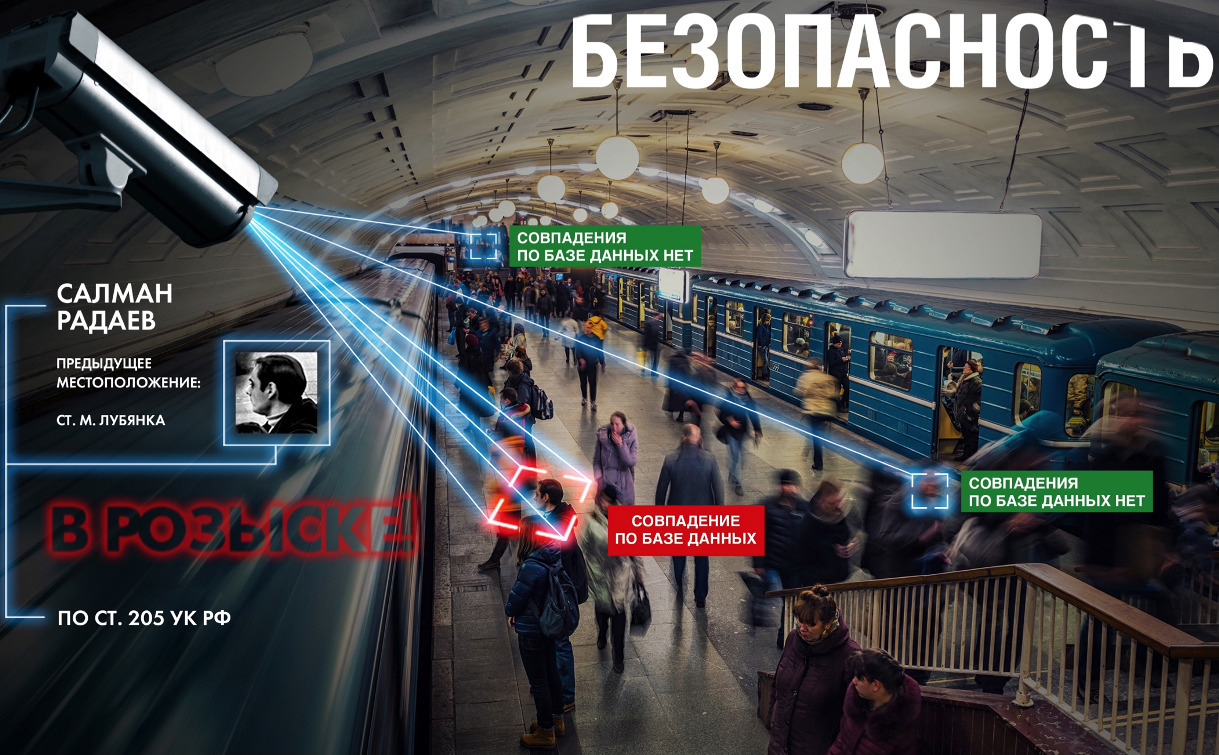

Presentación de NTechLab que deprime a Salman Radaev

Presentación de NTechLab que deprime a Salman RadaevNTechLab comenzó con una aplicación que determinó la raza de perros a partir de una fotografía. Más tarde escribieron el algoritmo FaceN, con el que en otoño de 2015 participaron en la competencia internacional

The MegaFace Benchmark . NTechLab ganó dos de las cuatro nominaciones, superando al equipo de Google (en un año, Vokord ganará en el mismo concurso y NTechLab pasará a la cuarta posición). El éxito les permitió implementar rápidamente el servicio

FindFace , buscando personas a partir de fotos en VKontakte. Pero esta no es la única forma de aplicar la tecnología. En el festival Alfa Future People, organizado por Alfa Bank, con FindFace, los visitantes pudieron encontrar sus fotos entre cientos de personas enviando una selfie a un chatbot.

Además, NTechLab

mostró un sistema capaz de reconocer en tiempo real el género, la edad y las emociones utilizando una imagen de una cámara de video. El sistema puede evaluar la reacción de la audiencia en tiempo real, por lo que puede determinar las emociones que experimentan los visitantes durante las presentaciones o transmisiones de mensajes publicitarios. Todos los proyectos NTechLab se basan en redes neuronales de autoaprendizaje.

El camino de Ivideon a la analítica de video

El reconocimiento facial es una de las tareas más difíciles en el campo de la analítica de video. Por un lado, todo parece estar claro y se ha utilizado durante mucho tiempo. Por otro lado, las soluciones de identificación en una multitud de personas siguen siendo muy caras y no proporcionan una precisión absoluta.

En 2012, Ivideon comenzó a trabajar con algoritmos de análisis de video. Ese año, lanzamos aplicaciones para iOS y Android, ingresamos a mercados extranjeros, lanzamos redes CDN descentralizadas con servidores en los EE. UU., Los Países Bajos, Alemania, Corea, Rusia, Ucrania, Kazajstán y nos convertimos en el único servicio internacional de videovigilancia que funciona igualmente bien en todo el mundo. En general, parecía que hacer su análisis con blackjack y reconocimiento sería simple y rápido ... éramos jóvenes, la hierba parecía más verde y el aire dulce y lánguido.

[

En ese momento, estábamos considerando algoritmos clásicos. Primero debe detectar y localizar las caras en la imagen: use cascadas Haar , busque regiones con una textura similar a la piel, etc. Supongamos que necesitamos encontrar a la primera persona que aparece y acompañarla solo en la transmisión de video. Aquí puede usar el algoritmo Lucas-Canadá . Encontramos la cara por el algoritmo y luego determinamos los puntos característicos en él. Acompañamos los puntos utilizando el algoritmo Lucas-Canadá; Después de su desaparición, creemos que la cara ha desaparecido de la vista. Habiendo recibido los rasgos característicos de la cara, podemos compararlo con los rasgos incrustados en la base de datos.

Para suavizar la trayectoria del objeto (cara), así como para predecir su posición en el siguiente cuadro, utilizamos el filtro de Kalman . Cabe señalar aquí que el filtro Kalman está diseñado para modelos de movimiento lineal. Para no lineal, se utiliza el algoritmo de filtro de partículas (como una variante del algoritmo de filtro de partículas + desplazamiento medio ).

También puede usar algoritmos de sustracción de fondo: una biblioteca con ejemplos de la implementación de algoritmos para restar el fondo + artículo sobre la implementación del algoritmo liviano para restar el fondo de ViBe. Además, no olvide uno de los métodos Viola-Jones más comunes implementados en la biblioteca de visión por computadora OpenCV. ]

El reconocimiento facial simple es bueno, pero no suficiente. También es necesario garantizar un seguimiento estable de varios objetos en el marco, incluso en caso de su intersección conjunta o "desaparición" temporal de un obstáculo. Cuente cualquier cantidad de objetos que crucen una determinada zona y tenga en cuenta las direcciones de intersección. Para saber cuándo aparece y desaparece un objeto / objeto en el marco: mueva el mouse sobre la taza sucia en la mesa y encuentre el momento en el archivo de video cuando apareció allí y quién lo dejó. En el proceso de seguimiento, un objeto puede cambiar con bastante fuerza (en términos de transformaciones). Pero de cuadro a cuadro, estos cambios serán tales que será posible identificar el objeto.

Además, queríamos que una solución de nube universal estuviera disponible para todos, desde los usuarios más exigentes. La solución tenía que ser flexible y escalable, ya que nosotros mismos no podíamos saber lo que el usuario quería monitorear y lo que el usuario quería considerar. Es muy posible que alguien haya sugerido hacer una transmisión de cucarachas basada en Ivideon con la determinación automática del ganador.

Solo cinco años después, comenzamos a probar componentes individuales de análisis de video: hablaremos más sobre estos proyectos en nuevos artículos.

PD: Entonces, estamos buscando voluntarios para las pruebas del detector de colas. Además de los usuarios del sistema SHTRIH-M para probar un nuevo sistema de gestión de efectivo. Escribe en el

correo o en los comentarios.