Lo que puede llamarse IA y lo que no puede ser, en cierto sentido, depende de la definición. No se puede negar que AlphaGo, una IA que juega, desarrollada por el equipo de Google DeepMind y derrotó al campeón mundial, así como sistemas similares con entrenamiento en profundidad en los últimos años han podido resolver problemas computacionales bastante complejos. ¿Pero nos llevarán a una IA real y completa, a una inteligencia generalizada u OI? Apenas, y he aquí por qué.

Una de las características clave de la OI con la que tiene que lidiar al crearla es que debe ser capaz de tratar independientemente con el mundo exterior y desarrollar su propia comprensión interna de todo lo que encuentra, escucha, dice o hace. De lo contrario, se encontrará en manos de los programas modernos de inteligencia artificial, cuyo significado fue establecido por el desarrollador de la aplicación. AI, de hecho, no entiende lo que está sucediendo y su área de especialización es muy limitada.

El problema del significado es quizás la más fundamental de las tareas de la IA, y aún no se ha resuelto. Una de las primeras personas en expresarlo fue el científico cognitivo Stevan Harnad, quien escribió en 1990 el trabajo "El problema de los símbolos coincidentes". Incluso si no cree que estamos manipulando símbolos, la tarea sigue siendo: comparar la representación existente dentro del sistema con el mundo real.

Para detalles, notamos que la tarea de comprensión nos lleva a cuatro subtareas:

1. ¿Cómo estructurar la información que una persona (persona o IA) recibe del mundo exterior?

2. ¿Cómo conectar esta información estructurada con el mundo, es decir, cómo construir una comprensión del mundo por parte de una persona?

3. ¿Cómo sincronizar esta comprensión con otras personalidades? (De lo contrario, la comunicación será imposible y el intelecto resultará inexplicable y aislado).

4. ¿Por qué una persona hace algo? ¿Cómo comenzar todo este movimiento?

El primer problema, la estructuración, está bien resuelto mediante el aprendizaje profundo y algoritmos de capacitación similares que no requieren supervisión; por ejemplo, se usa en AlphaGo. En esta área, hemos logrado éxitos significativos, en particular, gracias al reciente aumento en el poder de cómputo y el uso de GPU, que paralelan el procesamiento de la información particularmente bien. Estos sistemas funcionan tomando una señal excesivamente redundante, expresada en un espacio multidimensional, y la reducen a señales de dimensiones más pequeñas, mientras minimizan la pérdida de información. En otras palabras, capturan una parte importante de la señal desde el punto de vista del procesamiento de la información.

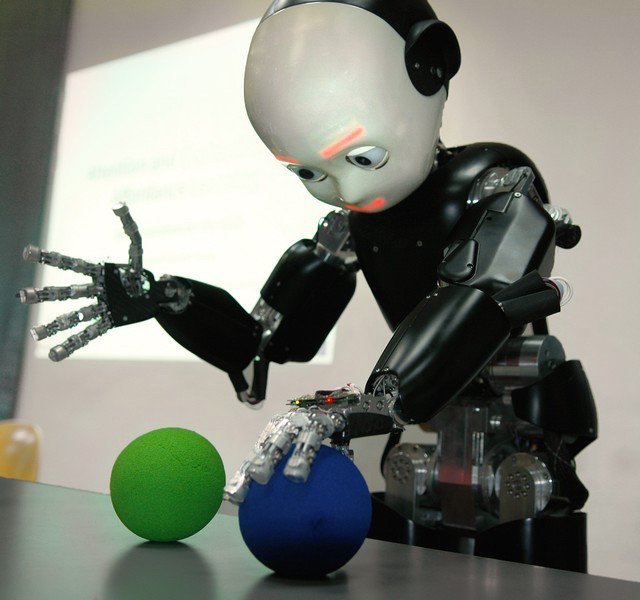

El segundo problema, el problema de la conexión de la información con el mundo real, es decir, la creación de "comprensión", está directamente relacionado con la robotización. Para interactuar con el mundo necesitas un cuerpo, y para construir esta conexión necesitas interactuar con el mundo. Por lo tanto, a menudo sostengo que sin robotización no hay IA (aunque hay excelentes robots sin IA, pero esa es otra historia). Esto a menudo se llama el "problema de la encarnación", y la mayoría de los investigadores de IA están de acuerdo en que la inteligencia y la encarnación están estrechamente relacionadas. Existen diferentes formas de inteligencia en diferentes cuerpos, que pueden verse fácilmente desde los animales.

Todo comienza con cosas tan simples como la búsqueda de significado en sus propias partes del cuerpo y cómo controlarlas para lograr el efecto deseado en el mundo visible, cómo la sensación de espacio, distancia, color, etc. En esta área, un científico como J. Kevin O'Regan, conocido por su "teoría sensoriomotora de la conciencia", realizó una investigación detallada. Pero este es solo el primer paso, ya que será necesario construir conceptos cada vez más abstractos sobre la base de estas estructuras sensoriales motoras mundanas. Todavía no hemos llegado a este punto, pero la investigación sobre este tema ya está en marcha.

El tercer problema es la cuestión del origen de la cultura. En algunos animales, se pueden rastrear las formas más simples de cultura e incluso transmitir habilidades de generación en generación, pero en un volumen muy limitado, y solo los humanos han alcanzado el umbral de crecimiento exponencial del conocimiento adquirido que llamamos cultura. La cultura es un catalizador para la inteligencia, y la IA que no tiene la capacidad de interactuar culturalmente será de solo interés académico.

Pero la cultura no puede ingresarse manualmente en la máquina como un código. Debería ser el resultado de un proceso de aprendizaje. La mejor manera de buscar formas de entender este proceso es la

psicología del desarrollo . El trabajo sobre este tema fue realizado por Jean Piaget y Michael Tomasello, quienes estudiaron el proceso de adquisición de conocimiento cultural por parte de los niños. Este enfoque generó una nueva disciplina de robótica, "desarrollo robótico", tomando a un niño como modelo (como es el caso con el robot iCub en la ilustración).

Además, esta pregunta está estrechamente relacionada con el estudio del proceso de aprendizaje de idiomas, y este es uno de los temas que yo mismo estudio. El trabajo de personas como Luc Steels y otros ha demostrado que el proceso de adquisición de un lenguaje puede compararse con la evolución: una persona crea nuevos conceptos al interactuar con el mundo, usarlos para comunicarse con otras personalidades y seleccionar estructuras que ayudan a comunicarse con más éxito que otros. (principalmente para lograr objetivos compartidos). Después de cientos de pruebas y errores, como en el caso de la evolución biológica, el sistema genera el mejor concepto y su traducción sintáctica / gramatical.

Este proceso ha sido probado experimentalmente y es sorprendentemente similar a cómo evolucionan y crecen los lenguajes naturales. También es responsable del aprendizaje instantáneo, cuando una persona percibe el concepto de inmediato, tales cosas no pueden explicar modelos basados en estadísticas como el aprendizaje profundo. Ahora, varios laboratorios de investigación que utilizan este enfoque están tratando de avanzar en el camino de percibir la gramática, los gestos y los fenómenos culturales más complejos. Específicamente, este es el Laboratorio AI, fundado por mí en la empresa francesa dedicada a la robótica Aldebarán. Ahora se ha convertido en parte del Grupo SoftBank: crearon los robots

Nao ,

Romeo y

Pepper (abajo).

Y finalmente, el cuarto problema se enfrenta con la "motivación intrínseca". ¿Por qué una persona hace algo, y no solo descansa? Los requisitos de supervivencia no son suficientes para explicar el comportamiento humano. Incluso si alimenta y garantiza la seguridad de una persona, no se sienta a esperar el regreso del hambre. Las personas estudian el medio ambiente, intentan hacer algo y se sienten impulsadas por alguna forma de curiosidad inherente. El investigador Pierre-Yves Oudeyer demostró que la expresión matemática más simple de curiosidad en forma del deseo de una persona de maximizar la velocidad de aprendizaje es suficiente para producir un comportamiento sorprendentemente complejo e inesperado (ver, por ejemplo, un experimento con un "patio de recreo" realizado en Sony CSL).

Aparentemente, es necesario algo similar para que el sistema induzca en él el deseo de seguir los tres pasos anteriores: estructurar la información sobre el mundo, combinarla con su cuerpo y crear conceptos significativos, y luego elegir el más efectivo desde el punto de vista de la comunicación para crear una articulación Una cultura en la que la cooperación es posible. Desde mi punto de vista, esto es exactamente lo que es el programa OI.

Repito que el rápido desarrollo del aprendizaje profundo y el reciente éxito de dicha IA en juegos como go son muy buenas noticias, ya que dicha IA encontrará muchos puntos de aplicación en investigación médica, industria, conservación del medio ambiente y otras áreas. Pero esta es solo una parte del problema, que traté de explicar aquí. No creo que el aprendizaje profundo sea una panacea que nos lleve a una IA real, en el sentido de una máquina que puede aprender a vivir en paz, interactuar naturalmente con nosotros, comprender la complejidad de nuestras emociones y distorsiones culturales, y finalmente ayudarnos a hacer del mundo un lugar mejor.