Escuché que en el futuro, la IA de la computadora se volverá más inteligente que nosotros que nos quitarán todos nuestros trabajos y recursos, y la gente morirá. Es asi?

Esta es la pregunta más común que me hacen en mis discursos sobre IA. Las personas que le preguntan están sinceramente preocupadas, y su preocupación proviene de otras personas, expertos que hacen la misma pregunta. Entre ellos puedes conocer a las personas más inteligentes que viven hoy, por ejemplo,

Stephen Hawking ,

Elon Musk ,

Max Tegmark ,

Sam Harris y

Bill Gates , y todos creen en la posibilidad de tal escenario. En una reciente conferencia sobre IA, un comité de las nueve personas con más conocimientos sobre IA acordó que no podríamos evitar el advenimiento de la IA sobrehumana.

Pero este escenario de conquistar el mundo de la IA incluye cinco suposiciones que, como resultado de un estudio cuidadoso, no se basan en evidencia. Estas declaraciones pueden estar justificadas en el futuro, pero ahora ninguna de ellas tiene evidencia. Estos son los supuestos:

1. La IA ya se está volviendo más inteligente que nosotros, y su poder está creciendo exponencialmente.

2. Crearemos una IA general similar a la nuestra.

3. Somos capaces de crear inteligencia humana basada en silicio.

4. El intelecto puede crecer sin límites.

5. Después de la explosión de la superinteligencia, nos ayudará a resolver todos nuestros problemas.

Como una objeción a este canon ortodoxo, daré cinco declaraciones heréticas que, a mi parecer, tienen más razones.

1. La inteligencia no es unidimensional, por lo que el concepto de "más inteligente que las personas" no tiene sentido.

2. Ni los humanos ni la IA tienen conciencia de propósito general.

3. La emulación del pensamiento humano en otros medios estará limitada por el costo de su creación.

4. Las dimensiones de la inteligencia no son infinitas.

5. La inteligencia es solo uno de los factores de progreso.

Si la expectativa de la aparición de IA sobrehumana (SII) se basa en cinco supuestos clave que no tienen evidencia, entonces esta idea es más como una creencia religiosa o un mito. A continuación, ampliaré cada uno de mis cinco supuestos contrarios, y demostraré que SII es en realidad un mito.

1)

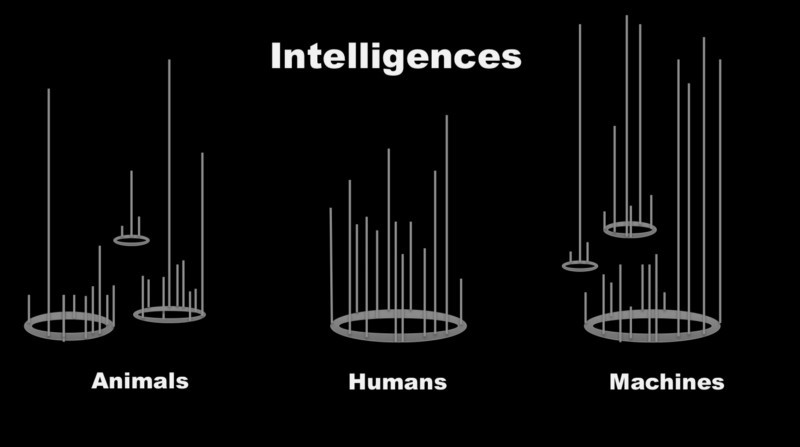

El concepto erróneo más común sobre la IA comienza con el concepto erróneo sobre la inteligencia natural. Consiste en el hecho de que la inteligencia es unidimensional. La mayoría de los técnicos tienden a retratar la inteligencia como lo hace

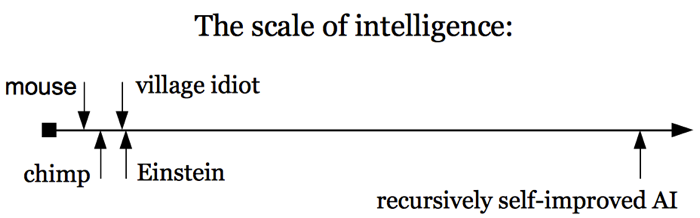

Nick Bostrom en Superinteligencia, como un gráfico lineal unidimensional con una amplitud creciente.

Por un lado, hay poca inteligencia, por ejemplo, un animal pequeño; por otro lado, un genio alto, por ejemplo, como si la inteligencia se pudiera representar como un nivel de sonido en decibelios. Por supuesto, en este caso es fácil imaginar que el volumen de inteligencia continúa creciendo y, como resultado, excede nuestro nivel altamente intelectual y se convierte en un intelecto ultra ruidoso: ¡un rugido! - inaccesible para nosotros y más allá del horario.

Este modelo es topológicamente equivalente a una escalera en la que cada paso posterior de inteligencia es un paso más alto que el anterior. Los animales más jóvenes están en los escalones inferiores, y la IA de alto nivel nos alcanzará y seguirá los pasos anteriores. La línea de tiempo de este evento no importa, solo importa el ranking: la métrica de la inteligencia creciente.

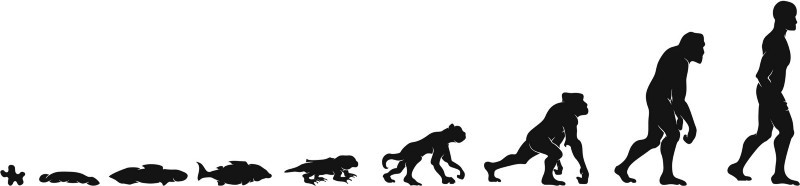

El problema con este modelo es que es tan mítico como la escalera de la evolución. Antes de Darwin, el mundo natural se consideraba una escalera en la que los animales más jóvenes se ubicaban debajo de la persona. Incluso después de Darwin, era costumbre pensar en la evolución como una "escalera", según la cual los peces se convirtieron en reptiles, luego en mamíferos, luego en primates, en humanos, y cada etapa está en una "etapa de evolución" ligeramente más alta, y por lo tanto considerado más inteligente que los anteriores. Entonces la escalera de la inteligencia es consistente con la escalera de la existencia. Pero estos modelos tienen un enfoque completamente no científico.

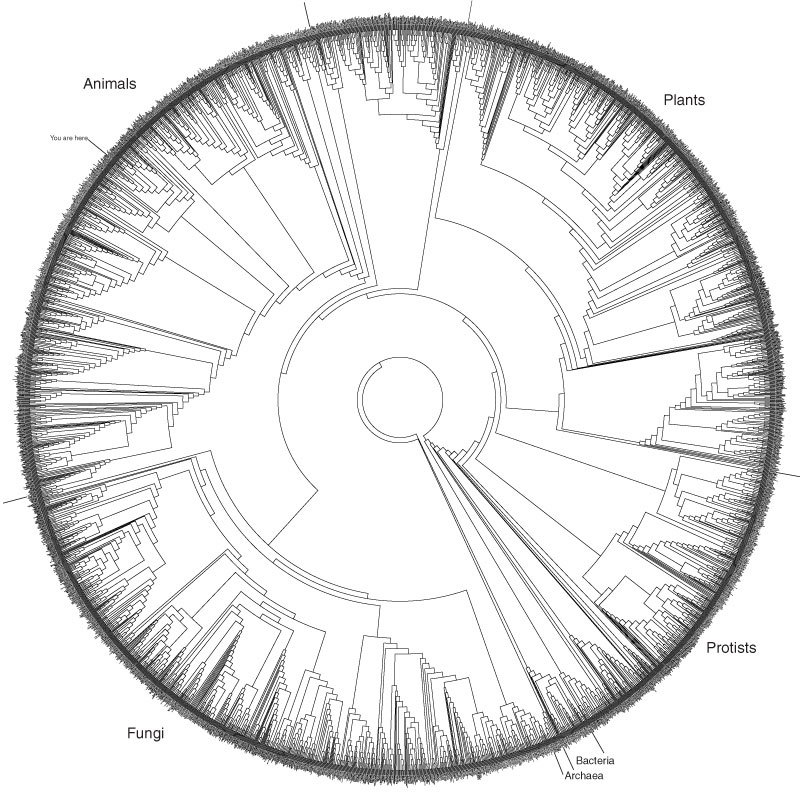

Una representación más precisa de la evolución natural de las especies es un disco en expansión, como en la imagen de arriba, propuesta por primera vez por

David Hillis de la Universidad de Texas y creada a partir del ADN. Este

mandala genealógico comienza en el centro con las formas de vida más primitivas, y luego se ramifica en el tiempo. El tiempo se mueve hacia afuera, por lo que los nuevos tipos de vida que habitan el planeta hoy están alrededor de la circunferencia. Esta imagen enfatiza el hecho de la evolución, que es difícil de aceptar: cada una de las especies que viven hoy está igualmente desarrollada evolutivamente. Existen personas en este anillo junto con cucarachas, moluscos, helechos, zorros y bacterias. Cada especie pasó por una cadena continua de tres mil millones de años de reproducción exitosa, lo que significa que las bacterias y cucarachas de hoy en día están tan evolucionadas como los humanos. No hay escalera

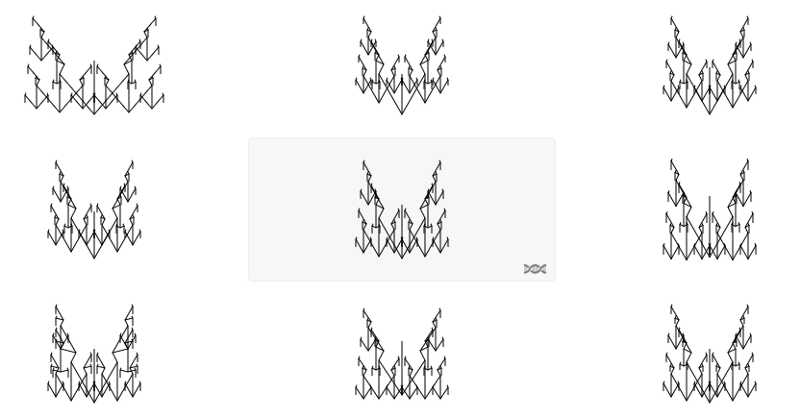

Del mismo modo, no hay escalera para la inteligencia. La inteligencia no es unidimensional. Este es un complejo de muchos tipos y modos de reconocimiento, cada uno de los cuales es un continuo. Tome la tarea más simple de medir la inteligencia animal. Si el intelecto fuera unidimensional, simplemente construiríamos los intelectos del loro, delfín, caballo, ardilla, pulpo, ballena azul, gato y gorila en el orden ascendente correcto. Pero hoy no tenemos evidencia científica de la existencia de tal línea. Una de las razones para esto podría ser la ausencia de una diferencia entre las inteligencias en los animales, pero tampoco vemos esto. La zoología está llena de ejemplos sorprendentes de diferencias en el pensamiento animal. ¿Pero tal vez todos tienen una relativa "inteligencia general"? Quizás, pero para él no tenemos forma de medir y medir. Tenemos muchas métricas diferentes para muchos tipos de cognición.

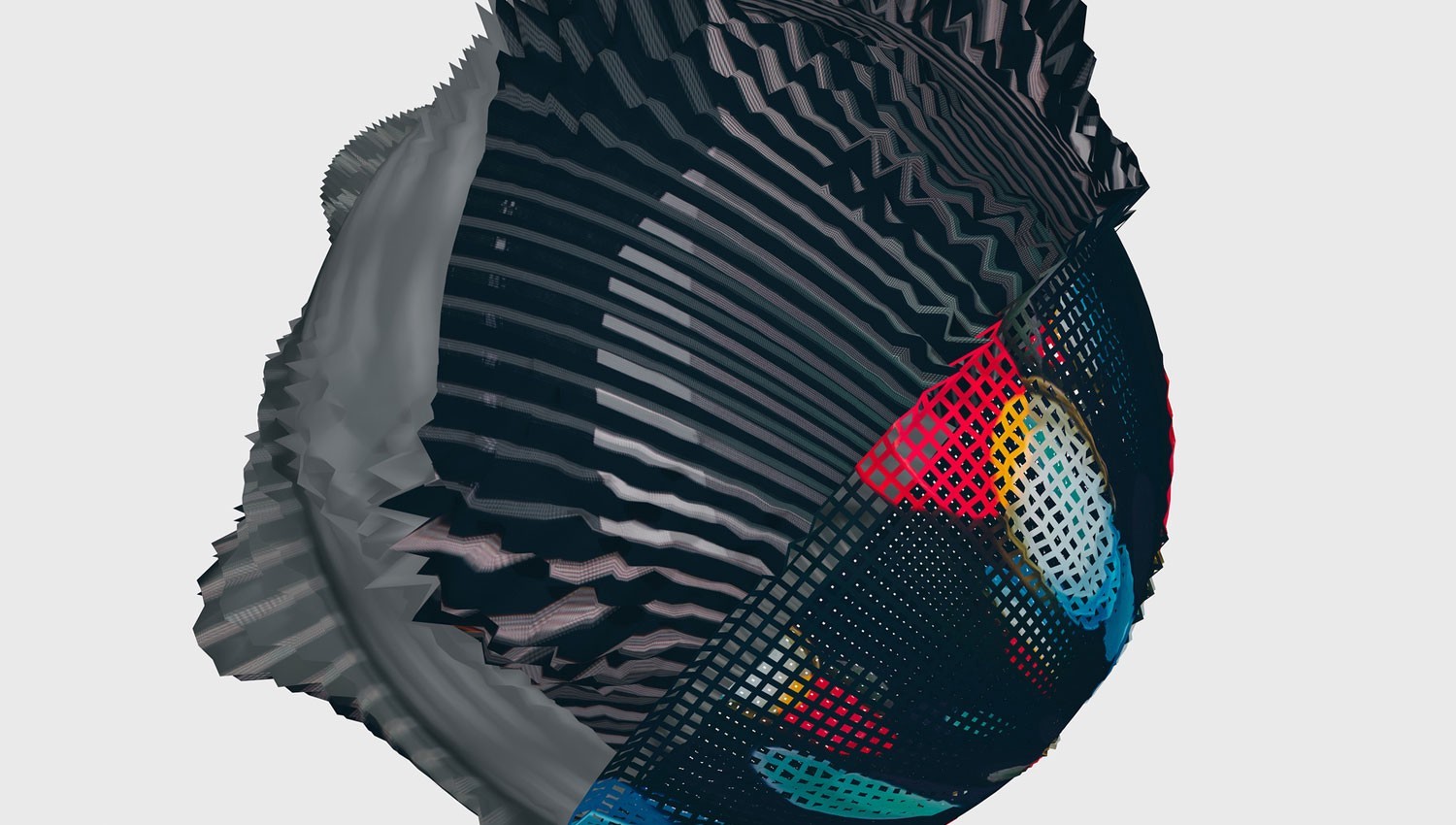

En lugar de una sola línea con decibelios, un modelo de inteligencia más preciso sería un gráfico de su espacio probabilístico, como, por ejemplo, la figura anterior, que representa formas posibles. La inteligencia es un continuo combinatorio. Muchos nodos, cada uno de los cuales es un continuo, crean estructuras complejas y diversas en dimensiones superiores. Algunos intelectos pueden ser muy complejos y tener muchos subnodos de pensamiento. Otros pueden ser más simples, pero se estiran más, tomando un ángulo en el espacio. Estos complejos, que llamamos intelectos, pueden considerarse sinfonías que involucran muchos tipos de instrumentos. Difieren no solo en volumen, sino también en tono, melodía, color, tempo, etc. Se pueden representar como ecosistemas. Y en este sentido, los diversos nodos-componentes del pensamiento dependen unos de otros y se crean juntos.

Como dijo

Marvin Minsky , las mentes humanas son comunidades de mentes. Trabajamos en ecosistemas de pensamiento. Tenemos muchos tipos de pensamiento dentro que se ocupan de muchos tipos de pensamiento: deducción, inducción, lógica simbólica, inteligencia emocional, lógica espacial, memoria a corto plazo y memoria a largo plazo. El sistema nervioso de nuestros intestinos también es un cerebro de cierto tipo con su propio modo de pensar. Pensamos no solo con un cerebro, pensamos con todo el cuerpo.

Estos conjuntos de pensamiento varían de individuo a individuo y de especie a especie. La ardilla puede recordar la ubicación exacta de varios miles de bellotas durante años, lo que afecta completamente la mente humana. Entonces, en este tipo de pensamiento, las proteínas son superiores a los humanos. Esta superpotencia está conectada con otros modos, desvaneciéndose en comparación con la nuestra, y esta conexión toma la decisión de la ardilla. En el reino animal hay muchos otros ejemplos de oportunidades que son superiores a los humanos, y también se incluyen en diferentes sistemas.

Lo mismo es cierto para la IA. Las mentes artificiales ya son superiores a los humanos en ciertas dimensiones. Su calculadora es un genio en matemáticas, la memoria de Google ya es superior a la nuestra en cierta dimensión. Creamos IA que se destacan en ciertos modos. Podemos hacer algunas de estas cosas nosotros mismos, pero lo hacen mejor, por ejemplo, en los campos de probabilidad o matemáticas. No tenemos otros modos de pensar: solo un motor de búsqueda puede recordar cada palabra en seis mil millones de páginas web. En el futuro, encontraremos tipos de pensamiento completamente nuevos que no tenemos, y de hecho, en la naturaleza viva. Al inventar el vuelo artificial, nos inspiramos en los regímenes de vuelo biológico, principalmente el aleteo de las alas. Pero inventamos tales vuelos, con hélices y alas fijas, que eran desconocidos para el mundo biológico. Este es el vuelo de otra persona. Del mismo modo, presentaremos nuevas formas de pensar que no existen en la naturaleza. En muchos casos, serán modos nuevos, específicos y pequeños diseñados para un trabajo específico, tal vez un tipo de razonamiento adecuado solo para estadísticas y teoría de la probabilidad.

En otros casos, la nueva mente será un conjunto complejo de los tipos de pensamiento que podemos usar para resolver problemas que no son susceptibles a nuestra inteligencia. Muchos de los problemas más complejos de los negocios y la ciencia pueden requerir una solución de dos etapas. Etapa uno: inventa un nuevo modo de pensar que pueda funcionar con nuestras mentes. Segundo: combinarlos para resolver el problema. Como resolvemos problemas que antes eran inaccesibles para nosotros, queremos llamar a este nuevo tipo de pensamiento "más inteligente" que nosotros, pero en realidad es simplemente diferente de nosotros. La principal ventaja de la IA es un pensamiento diferente. Creo que es útil pensar en la IA como un pensamiento extraterrestre (o extraterrestres artificiales). Su rareza será su principal virtud.

Al mismo tiempo, integraremos estos diferentes modos de pensamiento en comunidades más complejas de la mente. Algunos de estos complejos serán más complejos que los nuestros, porque pueden resolver problemas que son inaccesibles para nosotros, y luego alguien quiere llamarlos sobrehumanos. Pero no llamamos Google SII, aunque su memoria supera la nuestra, porque hay muchas cosas que podemos hacer mejor que él. Estos complejos de IA podrán superarnos en muchas dimensiones, pero nadie puede hacer todo lo que hacemos mejor que nosotros. Esto se puede comparar con las habilidades físicas de las personas. La Revolución Industrial ya tiene 200 años, y aunque en general las máquinas superan las habilidades físicas de una persona (velocidad de movimiento, levantamiento de pesas, corte preciso, etc.), no hay una máquina capaz de superar a la persona promedio en todo lo que hace.

Y aunque la comunidad de mentes de IA se está volviendo más compleja, esta complejidad aún es difícil de medir científicamente. No tenemos buenas métricas de complejidad que puedan determinar si el pepino de un Boeing 747 es más difícil o describir cómo difieren sus dificultades. Esta es una de las razones por las que no tenemos buenas métricas para la mente. Será muy difícil determinar si la mente A es más difícil que la mente B y, por lo tanto, es difícil entender cuál de ellos es más inteligente. Pronto llegaremos a comprender que la mente no es unidimensional, y de hecho estamos interesados en todas las formas en que el intelecto es capaz de funcionar, todos esos nodos de cognición que aún no hemos descubierto.

2)

El segundo error relacionado con la inteligencia humana es nuestra creencia de que nuestra mente es universal, es una mente de propósito general. Esta creencia ha llevado al surgimiento del objetivo a menudo declarado de los investigadores de IA de crear una IA generalizada, OII. Sin embargo, si consideramos la inteligencia como un mayor espacio de posibilidades, no tiene un estado generalizado. La inteligencia humana no está en una posición central alrededor de la cual giran otros intelectos especializados. La inteligencia humana es un tipo de inteligencia muy, muy especial que surgió como resultado de millones de años de evolución para que nuestra especie sobreviva en este planeta. Si lo coloca en el espacio de todas las inteligencias posibles, estará en algún lugar de la esquina, al igual que nuestro mundo está al borde de una gran galaxia.

Definitivamente podemos imaginar e incluso inventar un pensamiento que se asemeje a un cuchillo suizo universal. Hace un trabajo bastante bueno con muchas tareas, pero no le va muy bien con ninguna de ellas. La IA seguirá la misma

máxima de ingeniería que siguen todas las cosas creadas o nacidas: no puede optimizar cada dimensión. Solo los compromisos son posibles. No funcionará crear una unidad multifuncional generalizada superior a las especializadas. Una mente grande, "capaz de cualquier cosa", no podrá hacer todo esto tan bien como las especializadas. Como creemos en la generalización de nuestra mente, creemos que el pensamiento no tiene que seguir compromisos de ingeniería, que será posible crear una inteligencia que maximice todos los modos de pensamiento. Pero no hay evidencia de esto. Todavía no hemos inventado suficientes opciones para que la mente vea todo el espacio (y hasta ahora estamos barriendo las mentes de los animales, evaluándolos con amplitud unidimensional).

3)

Parte de esta creencia proviene del concepto de computación universal. Esta suposición, descrita formalmente en 1950 como la

tesis de Church-Turing , establece que todos los cálculos que alcanzan cierto umbral son equivalentes. Por lo tanto, para todos los cálculos hay un núcleo universal, y si se producen en una máquina con muchas partes rápidas o lentas, o en el cerebro biológico, todo esto es el mismo proceso lógico. Y esto significa que es posible emular cualquier proceso de computación (pensamiento) en cualquier máquina capaz de computación "universal". Los partidarios de la singularidad se basan en este principio, esperando que podamos crear cerebros de silicio que puedan acomodar la mente humana, y que podamos crear una mente artificial que piense que los humanos son mucho más inteligentes. Esta esperanza debería ser escéptica, porque se basa en un malentendido de la hipótesis de la Iglesia-Turing.

El punto de partida de esta hipótesis es el siguiente: "Si hay una película (memoria) y tiempo infinitos, todos los cálculos son equivalentes". El problema es que, en realidad, la computadora no tiene memoria y tiempo infinitos. En el mundo real, el tiempo real es crítico, a menudo incluso una cuestión de vida o muerte. Sí, todo pensamiento puede ser equivalente si se ignora el tiempo. Sí, puede emular el pensamiento humano en cualquier matriz, siempre que ignore el tiempo o las limitaciones reales del almacenamiento de datos y memoria. Sin embargo, al incluir el tiempo, será posible redefinir sustancialmente este principio: "Dos sistemas informáticos que se ejecutan en plataformas muy diferentes no serán equivalentes en el tiempo". O: "La única forma de obtener patrones de pensamiento similares es ejecutarlos en plataformas equivalentes". La materia física sobre la que funcionan los cálculos, especialmente cuando se vuelven más complejos, afecta dramáticamente el tipo de pensamiento que puede funcionar con éxito en tiempo real.

Continuaré con estos argumentos y diré que la única forma de lograr un proceso de pensamiento cercano al humano es realizar cálculos en tejidos blandos y húmedos similares al humano. Esto significa que las IA muy grandes y complejas que funcionan con silicio seco nos darán tipos de pensamiento grandes, complejos e inhumanos. Si es posible crear un cerebro húmedo artificial usando neuronas crecidas similares a las humanas, entonces diría que sus pensamientos serán muy similares a los nuestros. Los beneficios de un cerebro tan húmedo son proporcionales a cuán similares podemos hacer la base. El costo de crear tal "computadora humana" es enorme, y cuanto más cerca esté el tejido del tejido cerebral, más rentable será simplemente crear una persona. Al final, podemos hacer esto en nueve meses.

Además, como se indicó anteriormente, pensamos con la ayuda de todo el cuerpo, y no solo con un solo cerebro. Tenemos muchos datos que muestran que el sistema nervioso intestinal guía nuestro proceso de toma de decisiones "racional", que puede aprender y predecir eventos. Cuanto más modelamos el sistema del cuerpo humano, más nos acercamos a reproducirlo. La inteligencia que trabaja en un cuerpo muy diferente (silicio seco en lugar de carbono húmedo) pensará de manera diferente.

Me parece que esto no es un error, sino una característica. Como mencioné en el párrafo 2, la diferencia entre pensar y ser humano es la principal ventaja de la IA. Esta es otra razón por la cual es erróneo decir que él es "más inteligente que las personas".

4)

En el centro del concepto de inteligencia sobrehumana, en particular, la idea de que dicha inteligencia mejorará constantemente, yace en la creencia de que la escala de inteligencia es infinita. No veo evidencia de esto. Creer en esto ayuda a la idea errónea de la unidimensionalidad de la inteligencia, pero esto es solo fe. En el Universo, la ciencia no conoce de manera confiable dimensiones físicas infinitas. La temperatura no es infinita: hay frío

final y

calor final . El tiempo y el espacio son finitos. La velocidad final. Quizás la línea numérica en matemáticas es infinita, pero los atributos físicos tienen limitaciones. Será razonable decir que la mente misma es finita. Entonces la pregunta es, ¿dónde está el límite de la inteligencia? Tendemos a creer que está mucho más allá de nuestro alcance, es mucho más "alto" que nosotros, tanto como nosotros somos "más altos" que la hormiga. Si dejamos el problema que surge constantemente de la unidimensionalidad, ¿qué evidencia tenemos de que no hemos alcanzado este límite? ¿Por qué no podemos estar al máximo? , , ? , – , ?

,

. , – . , , - . «» [

The Inevitable ] , - . :

• , , ( ).

• , .

• , .

• , , .

• , , .

• , , - .

• , , .

• , , , .

• , .

• , , , ..

• , , .

• .

• , , .

• , .

• , .

• , , .

• , .

• , , .

• , .

• , .

• , .

• , .

• , .

• -.

• -.

• , , .

, .

, ( - ), , , , . , . , . ? . , , ? , , . . 10 .

, , , .

, , , , , . : « , … , , . , 2029 ».

, , , , . . , .

, « », , .

, . , , , . , «» .

5)

Otra, no refutada por nadie, la creencia en el advenimiento de FIS, no respaldada por evidencia, es que una superinteligencia de poder casi infinito resolverá rápidamente todos nuestros principales problemas no resueltos.

Muchos defensores de la explosión de inteligencia creen que conducirá a una explosión de progreso. Yo llamo a esta fe mítica "pensismo". Esta es una idea errónea de que las etapas futuras del progreso son inalcanzables solo debido a la falta de poder mental o inteligencia. Noto que la creencia de que pensar es una panacea mágica para todo es común entre muchas personas a las que les gusta pensar.

Tome la cura del cáncer o la extensión de la vida. No puedes resolver tales problemas con un solo pensamiento. Ningún pensamiento es suficiente para entender cómo envejecen las células o cómo desaparecen los telómeros. Ningún intelecto súper tonto puede entender cómo funciona el cuerpo humano simplemente leyendo toda la literatura científica conocida en el mundo y reflexionando. Ningún FIC puede, simplemente pensando en todos los experimentos con fusión nuclear, producir un esquema de fusión nuclear que funcione. Para superar el camino de no saber cómo funciona algo a comprender cómo funciona algo, se necesita mucho más que solo pensar. En el mundo real, se están haciendo montones de experimentos, cada uno de los cuales conduce a la aparición de montañas de datos conflictivos que requieren más experimentos para crear una hipótesis de trabajo. Pensar en datos potenciales no le dará los datos correctos.

Pensar es solo una parte de la ciencia, quizás incluso una pequeña parte de ella. Por ejemplo, no tenemos suficientes datos para acercarnos a resolver el problema de la muerte. Cuando se trabaja con organismos vivos, casi todos los experimentos llevan tiempo. El metabolismo celular lento no se puede dispersar. Obtener resultados lleva años, meses, al menos días. Si queremos saber qué sucede con las partículas subatómicas, no podemos pensar en ellas. Necesitamos construir estructuras físicas enormes, complejas y astutas para descubrirlo. Incluso si los físicos más inteligentes fueran 1000 veces más inteligentes que ahora, sin un colisionador no habrían aprendido nada nuevo.

No hay duda de que SRI puede acelerar el progreso de la ciencia. Podemos hacer simulaciones por computadora de átomos o células y acelerarlas muchas veces, pero dos problemas limitan la utilidad de las simulaciones. La primera es que las simulaciones y los modelos pueden ir más rápido que los procesos que se estudian solo porque no tenemos en cuenta algo. Esta es la esencia de un modelo o simulación. Además, probar, verificar y probar estos modelos también lleva mucho tiempo y debe ir a la velocidad de los procesos simulados. La verificación de la verdad no se puede acelerar.

Estas versiones simplificadas son útiles para filtrar los caminos más prometedores y acelerar el progreso. Pero en realidad no hay exceso; todo lo que es real ejerce su influencia hasta cierto punto; Esta es una de las definiciones de realidad. Si comienza a bombear modelos y simulaciones con más y más datos, pronto queda claro que la realidad es más rápida que su simulación al 100%. Esta es otra definición de realidad: la versión más rápida posible de todos los detalles y grados de libertad presentes. Si puede modelar todas las moléculas en células y todas las células del cuerpo humano, entonces la simulación no funcionará tan rápido como el cuerpo humano. No importa cuánto lo piense, necesitará tiempo para experimentar, ya sea un sistema real o una simulación.

Para ser útil, la IA necesita infiltrarse en el mundo real, y el mundo establecerá la velocidad de su innovación. Sin realizar experimentos, construir prototipos, errores y experimentos con la realidad, la inteligencia puede pensar, pero no producir resultados. No hay descubrimientos instantáneos por minuto, hora, día o año de ocurrencia de la llamada. No se espera "IA sobrehumana". Por supuesto, los éxitos en el desarrollo de la IA aumentarán significativamente el número de descubrimientos por unidad de tiempo, en particular, ya que la IA, a diferencia de las personas, hará preguntas que las personas no harían, pero incluso un intelecto extremadamente poderoso no garantiza un progreso instantáneo en comparación con nosotros. Para resolver problemas, se necesita mucho más que solo inteligencia.

La inteligencia por sí sola no podrá resolver no solo los problemas del cáncer y la longevidad, sino también los problemas del intelecto mismo. Un mantra típico de los partidarios de la singularidad es que tan pronto como haces una IA que es "más inteligente que una persona", de repente piensa e inventa una IA, "más inteligente que él", que, a su vez, piensa aún más adecuadamente e inventa aún más. inteligencia artificial inteligente, y como resultado, todo terminará con una explosión de poder intelectual a un nivel casi divino. No tenemos evidencia de que solo pensar en la inteligencia sea suficiente para crear nuevos niveles de inteligencia. Tal pensamiento es fe. Tenemos mucha evidencia de que, además de una gran cantidad de conocimiento, necesitamos experimentos, datos, pruebas y errores, preguntas inusualmente planteadas y todo lo demás más allá del simple ingenio para inventar nuevos tipos de mentes que operan con éxito.

En conclusión, diré que puedo estar equivocado con mis declaraciones. Estamos en las primeras etapas. Podemos descubrir una métrica universal para la inteligencia; Descubre su infinito en todas las direcciones. Dado que sabemos muy poco acerca de qué es la inteligencia (sin mencionar la conciencia), la probabilidad de algún tipo de singularidad AI excede cero. Me parece que toda la evidencia habla a favor de la baja probabilidad de tal escenario, pero esta probabilidad es distinta de cero.

Entonces, aunque no estoy de acuerdo con su probabilidad, estoy de acuerdo con los objetivos más amplios de

OpenAI y las personas inteligentes preocupadas por la IED: que debemos crear IA amigables y pensar cómo inculcarles valores que coincidan con los nuestros. Y aunque creo que la IED es una amenaza existencial muy distante (que vale la pena considerar), creo que su pequeña probabilidad (según la evidencia disponible) no debería gobernar nuestra ciencia, política y desarrollo. La colisión de un asteroide con la Tierra sería un desastre. Su probabilidad es mayor que cero (por lo que debemos apoyar

el fondo B612 ), pero no debemos dar la posibilidad de un ataque de asteroides para gestionar nuestras decisiones, por ejemplo, en el campo del cambio climático, o los viajes espaciales, o incluso en la planificación urbana.

De la misma manera, la evidencia hasta ahora sugiere que la IA probablemente no sea sobrehumana, sino extrahumana, serán cientos de nuevos tipos de pensamiento diferentes a los humanos, ninguno de los cuales resultará ser IA de propósito general, y ninguno de ellos se convertirá en un dios, resolviendo al instante todos nuestros problemas. En cambio, tendremos una galaxia de inteligencias limitadas, trabajando en dimensiones desconocidas, yendo más allá de nuestras capacidades en muchas de ellas, trabajando con nosotros para resolver problemas existentes y crear otros nuevos con el tiempo.

Entiendo el encanto y el atractivo de SII-god. Esto es algo así como Superman. Pero, como Superman, esta es una figura mítica. En algún lugar del universo, Superman puede existir, pero la probabilidad de su existencia es extremadamente pequeña. Pero los mitos pueden ser útiles y no desaparecer después de su invención. La idea de Superman no morirá. La idea de una singularidad de IA sobrehumana, una vez que se haya generado, tampoco morirá. Pero debemos entender que ahora es una idea religiosa, no científica. Si estudiamos los datos que tenemos hoy sobre inteligencia, artificial y natural, solo podemos concluir que nuestras discusiones sobre el mítico dios SII son solo mitos.

Muchas de las islas aisladas de

Micronesia entraron en contacto por primera vez con el resto del mundo durante la Segunda Guerra Mundial. Los dioses alienígenas volaron en sus cielos en pájaros ruidosos, arrojaron comida y bienes en sus islas, y no regresaron. Los cultos religiosos aparecieron en las islas, rezando para que los dioses regresaran y arrojaran más bienes. Incluso ahora, cincuenta años después, muchos todavía esperan la devolución de los bienes. Es posible que el SRI sea otro culto a la carga. Después de cien años, las personas podrán mirar hacia atrás, en nuestro tiempo, en el momento en que los creyentes comenzaron a esperar la aparición de FIC, lo que les traería beneficios inimaginables. Década tras década, esperan la llegada de la IED, confiando en que con sus beneficios debería aparecer muy pronto.

Pero la IA no sobrehumana ya es real aquí. Redefinimos constantemente este término, aumentamos su complejidad y, como resultado, lo mantenemos en el futuro, pero en el sentido amplio de la definición de intelectos extraños, en un espectro continuo de diferentes mentes, intelectos, pensamientos, lógicas, enseñanzas y conciencias, la IA ya existe en el planeta y continúa difundir, profundizar, diversificar e intensificar. Ningún invento anterior puede compararse con su poder sobre el mundo, y para fines de siglo la IA tocará y cambiará todos los aspectos de nuestras vidas. Pero el mito de la inteligencia artificial sobrehumana, listo para dotarnos de abundancia o conducirnos a la súper esclavitud (o ambas al mismo tiempo), aparentemente continuará viviendo; esta oportunidad es demasiado mítica para rechazarla.