Armas autónomas, robots asesinos que pueden atacar sin intervención humana, esta es una herramienta muy peligrosa. No hay duda sobre esto. Como se indica en su

carta abierta a la ONU, Ilon Musk, quien firmó con él, Mustava Suleiman [

cofundador de la compañía de inteligencia artificial DeepMind / aprox. perev. ] y otros autores, las armas autónomas pueden convertirse en "armas de intimidación, armas que los tiranos y terroristas pueden usar contra una población inocente, armas que pueden ser pirateadas y que funcionan de manera indeseable".

Pero esto no significa que la ONU deba introducir una prohibición preventiva de futuras investigaciones sobre tales armas, como lo exigen los autores de la carta.

En primer lugar, a veces se necesitan herramientas peligrosas para lograr objetivos dignos. Recuerde el

genocidio en Ruanda cuando el mundo se mantuvo al margen y no hizo nada. Si existieran armas autónomas en 1994, tal vez no miraríamos hacia un lado. Parece probable que si el costo de las intervenciones humanitarias solo se pudiera medir con dinero, sería más fácil obtener el apoyo público para tales intervenciones.

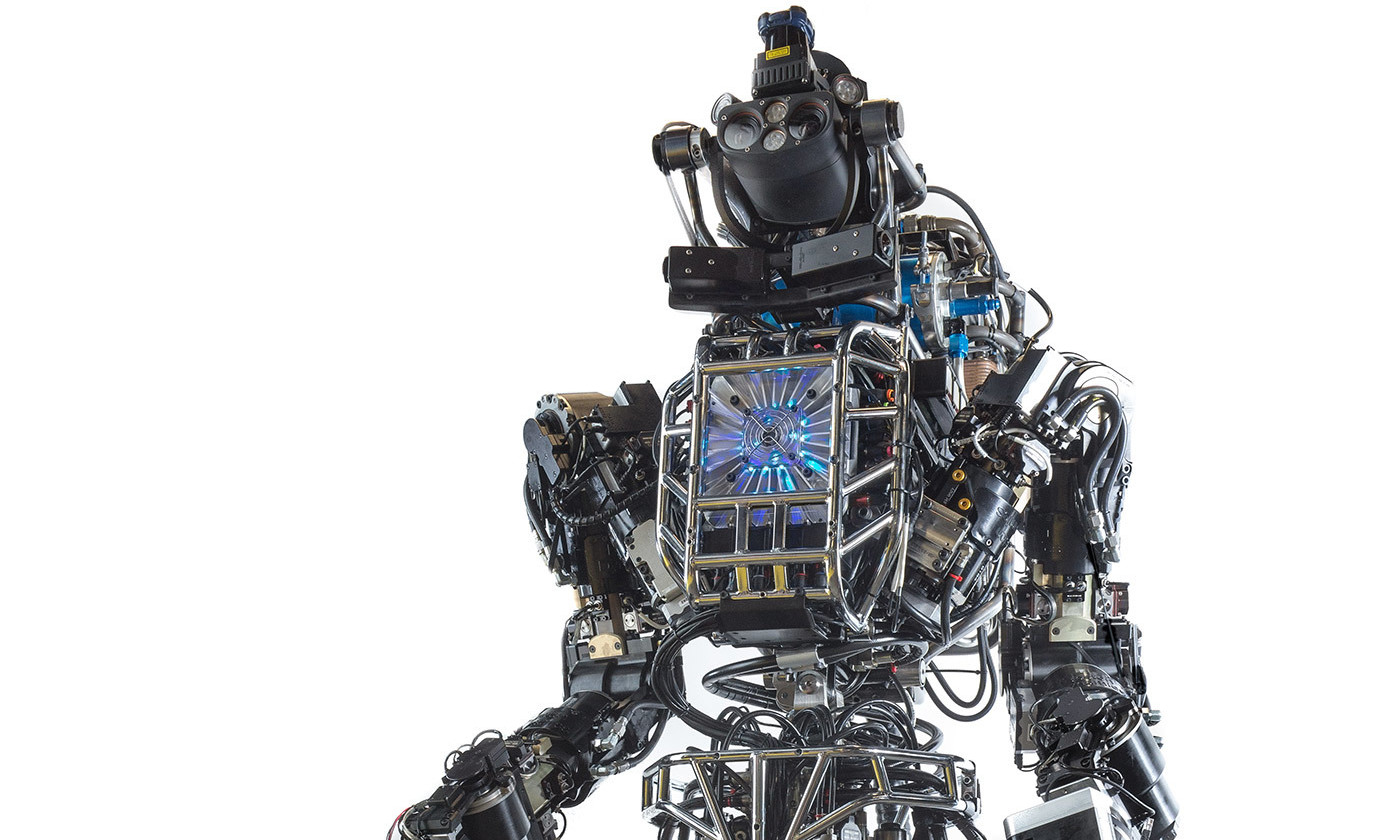

En segundo lugar, es ingenuo creer que podemos disfrutar de los beneficios de los recientes avances en inteligencia artificial sin tener que experimentar algunas de sus deficiencias. Supongamos que la ONU introduce una prohibición preventiva de cualquier tecnología de armas autónomas. También suponemos, ya bastante optimista, que todos los ejércitos del mundo respetarán esta prohibición y cancelarán el desarrollo de programas de armas autónomas. E incluso entonces, todavía tenemos que preocuparnos por esto. Un robot robótico puede convertirse fácilmente en un sistema de armas autónomo: en lugar de rodear a los peatones, puede enseñarle a moverlos.

En términos generales, las tecnologías de inteligencia artificial son extremadamente útiles y ya están penetrando nuestras vidas, incluso si a veces no vemos esto y no podemos darnos cuenta por completo. Dada esta penetración, sería miope pensar que el abuso de la tecnología podría prohibirse simplemente prohibiendo el desarrollo de armas autónomas. Quizás sean precisamente los sofisticados y selectivos sistemas autónomos de armas desarrollados por varios ejércitos de todo el mundo los que puedan contrarrestar efectivamente las armas autónomas más duras que son fáciles de desarrollar al reprogramar la tecnología de inteligencia artificial aparentemente pacífica, como los mismos robomóviles.

Además, la idea de una prohibición simple a nivel internacional ofrece un enfoque demasiado simplificado para la consideración de armas autónomas. Tal concepto no reconoce la larga historia de las causas y los efectos de las acciones y acuerdos de diferentes países entre sí y solo, lo que, a través de miles de pequeñas acciones y omisiones, condujo al desarrollo de tales tecnologías. Si bien el debate sobre las armas autónomas se lleva a cabo principalmente a nivel de la ONU, se puede perdonar al ciudadano promedio, soldado o programador por no implicar obligaciones morales por el daño causado por las armas autónomas. Pero esta es una suposición muy peligrosa, que puede conducir al desastre.

Todas las personas que de alguna manera están relacionadas con las tecnologías de armas automáticas deben tener cuidado debido a cada uno de nosotros, y cada uno de nosotros debe pensar cuidadosamente qué contribución hace su acción o inacción a la lista de peligros potenciales de esta tecnología. Esto no significa que los países y las agencias internacionales no tengan un papel importante. Esto se destaca por el hecho de que si queremos eliminar el peligro potencial de las armas automáticas, es necesario promover la ética de la responsabilidad personal, y esta propaganda debe alcanzar los niveles más bajos en los que se toman las decisiones. Para empezar, es extremadamente importante hablar en detalle y completamente sobre el desarrollo de armas autónomas, incluidas las consecuencias de las acciones de todos aquellos que toman decisiones en todos los niveles.

Finalmente, a veces se argumenta que un arma autónoma es peligrosa no porque esta herramienta sea peligrosa en sí misma, sino porque puede volverse independiente y comenzar a actuar en su propio interés. Este es un error equivocado y, además, la prohibición del desarrollo de armas autónomas no ayudará a prevenir este peligro. Si la superinteligencia es una amenaza para la humanidad, necesitamos buscar urgentemente formas de contrarrestar esta amenaza de manera efectiva, y hacerlo independientemente de si la tecnología de las armas automáticas se desarrollará aún más.

Carta abierta a la Convención de las Naciones Unidas sobre Ciertas Armas Convencionales

A medida que algunas empresas crean tecnologías relacionadas con la inteligencia artificial y la robótica que se pueden redirigir al desarrollo de armas autónomas, sentimos una responsabilidad especial por generar esta alarma. Acogemos con beneplácito la decisión de la conferencia de la ONU sobre la adopción de la "Convención sobre tipos específicos de armas convencionales" sobre el nombramiento de un

grupo de expertos gubernamentales (Grupo de Expertos Gubernamentales, GGE) sobre sistemas letales de armas autónomas. Muchos de nuestros investigadores e ingenieros están listos para brindar asesoramiento tecnológico para ayudar con este problema.

Agradecemos el nombramiento del Embajador Amandip Singh Gill de India como Presidente del GGE. Solicitamos a las Altas Partes Contratantes que participan en el GGE que trabajen activamente para encontrar formas de prevenir este tipo de carrera armamentista, proteger a los ciudadanos de su mal uso y evitar los efectos desestabilizadores de estas tecnologías. Lamentamos que la primera reunión de GGE, programada para agosto de 2017, se canceló debido al hecho de que algunos países no hicieron una contribución financiera a la ONU. Instamos a las Altas Partes Contratantes a redoblar sus esfuerzos en la primera reunión del GGE que se celebrará en noviembre.

Las armas autónomas detalladas amenazan con provocar una tercera revolución en los asuntos militares. Después de su desarrollo, permitirá conducir conflictos militares en una escala sin precedentes antes, y en períodos de tiempo más cortos de lo que una persona puede percibir. Puede convertirse en un arma de intimidación, un arma que los tiranos y los terroristas pueden usar contra una población inocente, un arma que puede ser pirateada y hacer que funcione de manera indeseable. Nos queda poco tiempo. Después de abrir esta caja de Pandora, será difícil cerrarla. Por lo tanto, pedimos a las Altas Partes Contratantes que encuentren formas de protegernos a todos de estas amenazas.