Sundar Pichai fue al Anfiteatro Shoreline en Mountain View ayer a las 8 pm hora de Moscú y abrió Google I / O 2018. La conferencia durará tres días del 8 al 10 de mayo, pero lo principal se anunció desde el escenario durante un discurso tradicional. Android P aprendió gestos como en iOS 11 en el iPhone X, el Asistente de Google ahora habla en seis voces diferentes y casi pasa la prueba de Turing, y los desarrolladores recibirán el Kit ML para implementar el aprendizaje automático en sus aplicaciones.

Asistente de Google

El asistente es lo más destacado del programa. En los dos años transcurridos desde el anuncio, se decidió por 500 millones de dispositivos diferentes. Además de los teléfonos inteligentes, estos son altavoces inteligentes, auriculares, televisores y relojes. Está integrado en automóviles de 40 fabricantes diferentes y admite trabajar con más de 5000 electrodomésticos, como lavavajillas y llamadas.

Ahora se le enseñó a hablar en seis voces diferentes y comprender varios comandos en una frase a la vez. A finales de año, el Asistente de Google funcionará en 80 países y admitirá 30 idiomas, incluido el ruso. Y sí, ya no necesita decir constantemente "OK Google". Es decir, puedes decir: "Ok Google, pon una alarma a las 7 de la mañana y recuérdame comprar yogurt cuando esté cerca del supermercado".

Anteriormente, del Asistente, esperábamos principalmente una respuesta verbal, por ejemplo, de un hablante inteligente. Pero en esta E / S, Google mostró varios dispositivos de la categoría de pantallas inteligentes: esta es esencialmente una columna inteligente, solo con una pantalla táctil. Tal columna con una pantalla puede decir "OK Google, enciende Jimmy Kimmel", y ella encontrará su programa en YouTube y lo lanzará. En el mismo dispositivo, según Google, es conveniente buscar recetas. Aún no está muy claro cuán fundamentalmente difieren las llamadas "pantallas inteligentes" de las tabletas convencionales.

En los EE. UU., También se le enseñó a Google Assistant a trabajar bajo el esquema de recogida y entrega y atado a redes populares: Starbucks, 7-Eleven, Dunkin 'Donuts y otros. Ahora en los Estados Unidos, puede hablar con el Asistente y pedir un café con leche con caramelo para recogerlo en un café conveniente.

Todo lo que le diga al Asistente, él lo recordará y gradualmente comenzará a dar consejos y crear una imagen del día que viene, como lo hizo Google Now, solo que con mayor precisión. Todos estos chips aparecerán en la nueva versión de Android en el verano de 2018.

Google duplex

En Google I / O, Sundar reveló lo que la compañía llama Google Duplex. Todos los logros de los últimos años se han combinado, y esto le ha permitido al Asistente llevar a cabo una conversación telefónica con una persona desprevenida. Al menos eso es lo que dijeron desde el escenario. Si todos estos "uh ...", "hmm" y otros matices del habla puramente humanos realmente dieron la red neuronal, entonces estamos cerca de que la computadora pase la prueba de Turing. Véalo usted mismo:

Le pides al Asistente que te reserve una mesa en el restaurante, y él llama al fondo y acepta todo. Voz Queda por esperar hasta que un asistente virtual también se planta en el otro extremo del cable.

Google está planeando un experimento completo con pequeñas empresas unas semanas más tarde. Los asistentes planean "ponerse el teléfono" para que responda las llamadas de los clientes.

Android P

La versión beta de Android P aparecerá el 8 de mayo y estará disponible en 11 teléfonos inteligentes:

- Sony Xperia XZ2

- Xiaomi Mi Mix 2S

- Nokia 7 Plus

- Oppo r15 pro

- Vivo x21

- OnePlus 6

- PH-1 esencial

- Google Pixel / XL

- Google Pixel 2/2 XL

La nueva versión del sistema operativo ha revisado el enfoque de navegación y gestos. En particular, implementaron una llamada a la lista de aplicaciones abiertas de la misma manera que en el iPhone X, con un deslizamiento de abajo hacia arriba. El botón de llamada de la aplicación del fondo se abandonó por completo y el botón Atrás solo aparece si hay una aplicación abierta. Además, el diseño de algunos elementos de la interfaz se actualizará de acuerdo con Material Design 2.

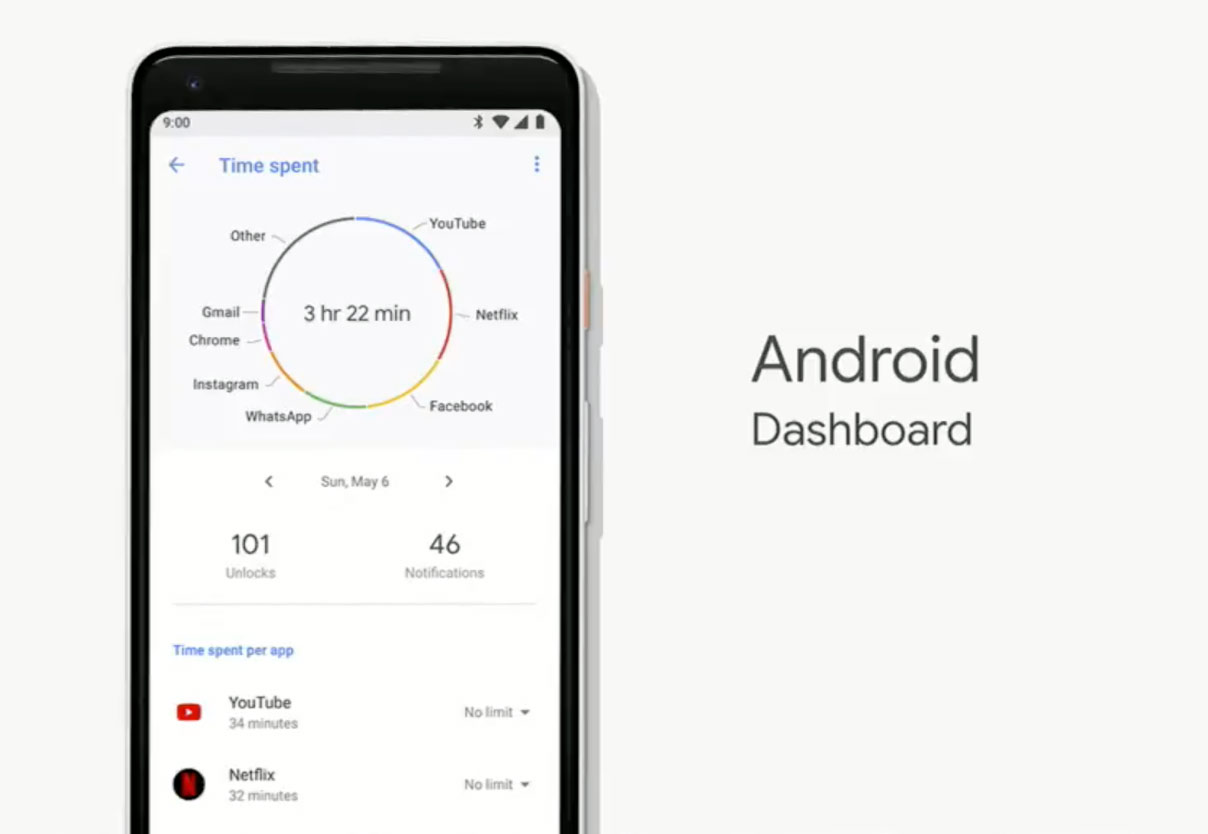

Pichai habló sobre varias características nuevas por separado. Por ejemplo, el "Panel" apareció en Android P, que muestra estadísticas de uso de teléfonos inteligentes: cuántas veces lo desbloqueó en un día, cuántas notificaciones leyó.

En la configuración de la aplicación de YouTube para Android, puede seleccionar un modo en el que de vez en cuando aparecerá un recordatorio de que es hora de pausar si ha estado viendo un video continuamente durante mucho tiempo. Además, las notificaciones de nuevos videos de los canales a los que está suscrito ahora se pueden recibir como un resumen diario, y no individualmente.

Family Link: un panel de control para los dispositivos de sus hijos que ayudará a limitar el tiempo que pasan frente a la pantalla.

Noticias de Google

En Google I / O, Sundar Pichai habló sobre el renacimiento de Google News. Ahora, "Noticias" es similar a Yandex.Zen: es un agregador inteligente de noticias que sabe lo que suele leer y en qué recursos confía. Filtra lo innecesario y muestra cinco historias importantes en las últimas horas en la pestaña "Para usted".

Aprendizaje automático

Con el aprendizaje automático, los nuevos dispositivos Android pueden ahorrar significativamente la energía de la batería al predecir qué aplicación lanzará a continuación, con una probabilidad de aproximadamente el 60%.

Pero lo principal: ahora la API para acceder a capacidades de teléfonos inteligentes como el reconocimiento de texto y rostro en fotos o, por ejemplo, el escaneo de códigos de barras ahora está disponible para todos los desarrolladores gracias al Kit de aprendizaje automático. Además, dijeron desde el escenario que los desarrolladores tendrán acceso a las redes neuronales en la nube de Google, pero no proporcionaron detalles.