Hola Habr! Les presento la traducción del artículo

"Síntesis de superficie facial y textura a través de GAN" .

Cuando los investigadores carecen de datos reales, a menudo recurren al aumento de datos, como una forma de expandir el conjunto de datos existente. La idea es modificar el conjunto de datos de entrenamiento existente de tal manera que las propiedades semánticas permanezcan intactas.

No es una tarea tan trivial cuando se trata de rostros humanos.El método de generación de caras debe tener en cuenta transformaciones de datos tan complejas como

- posar

- iluminacion

- deformaciones no rígidas

mientras crea imágenes realistas que son consistentes con las estadísticas de datos reales.

Considere cómo los métodos de vanguardia intentan resolver este problema.

Enfoques modernos para la generación de caras

Se ha demostrado que las redes neuronales adversas generativas (GAN) son más efectivas para dar más realismo a los datos sintéticos. Al aceptar datos sintetizados como entrada, la

GAN produce muestras que se parecen más a datos reales . Sin embargo, las propiedades semánticas se pueden cambiar, e incluso la función de pérdida, que castiga los parámetros cambiantes, no resuelve el problema hasta el final.

El modelo 3D Morphable (3DMM) es el método más común para representar y sintetizar geometría y texturas y se introdujo originalmente en el contexto de la generación de rostros humanos tridimensionales. Según este modelo, la estructura geométrica y las texturas de un rostro humano se pueden aproximar linealmente como una combinación de vectores raíz.

Recientemente, el

modelo 3DMM se ha combinado con redes

neuronales convolucionales para aumentar los datos. Sin embargo, las muestras resultantes son demasiado suaves y poco realistas, como se puede ver en la imagen a continuación:

Personas obtenidas con 3DMM

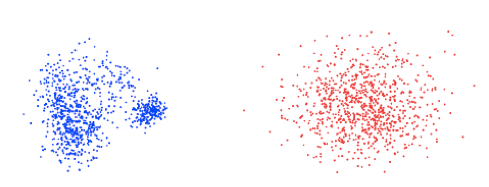

Además, los 3DMM generan datos basados en una distribución gaussiana, que rara vez refleja la distribución real de los datos. Por ejemplo, a continuación hay dos coeficientes PCA (análisis de componentes principales) construidos en caras reales y sintetizados usando 3DMM. La diferencia entre la distribución sintética y la real puede conducir fácilmente a la generación de datos incorrectos.

Los primeros dos coeficientes PCA para individuos reales (izquierda) y generados por 3DMM (derecha)

Idea de vanguardia

Slossberg, Shamai y Kimmel del Technion Israel Institute of Technology

ofrecen un nuevo enfoque para la síntesis de rostros humanos realistas utilizando una combinación de 3DMM y GAN.

En particular, los investigadores usan la GAN para simular el espacio de texturas humanas parametrizadas y crear las geometrías de caras correspondientes, calculando los mejores coeficientes 3DMM para cada textura. Las texturas generadas se asignan a la geometría apropiada para producir nuevas caras 3D de alta resolución.

Tal arquitectura genera imágenes realistas, mientras que:

- No sufre el control sobre atributos como la pose y la iluminación.

- cuantitativamente no limitado en la generación de nuevas caras.

Echemos un vistazo más de cerca al proceso de generación de datos.

Proceso de generación de datos

Preparación de datos

La canalización de generación de datos consta de cuatro pasos principales:

- Recolección de datos : los investigadores han recolectado más de 5,000 escaneos (escaneos faciales) de diferentes grupos étnicos, de género y de edad. Cada participante tuvo que representar 5 expresiones faciales diferentes, incluida la neutra.

- Marcado : se agregaron 43 puntos clave al mashi de forma semiautomática, renderizando el rostro y utilizando el detector de marcado facial previamente entrenado

- Alineación de mallas : implementada debido a la deformación de la caché de la cara de la plantilla de acuerdo con la geometría de cada escaneo, centrándose en el marcado marcado.

- Transferencia de textura : la textura se transfiere del escaneo a la plantilla utilizando la técnica de fundición de rayos integrada en la caja de herramientas de Blender. Después de eso, la textura se convierte de la plantilla en una tira bidimensional utilizando una transformación universal predefinida.

Texturas faciales planas

El siguiente paso es enseñarle a la GAN cómo crear simulaciones de texturas alineadas. Para esta tarea, los investigadores utilizaron una GAN progresiva con un generador y discriminador organizado como una red neuronal simétrica. En tal implementación, el generador aumenta progresivamente el tamaño del mapa de características hasta que alcanza el tamaño de la imagen de salida, mientras que el discriminador reduce gradualmente el tamaño a una sola salida.

Texturas de cara GAN

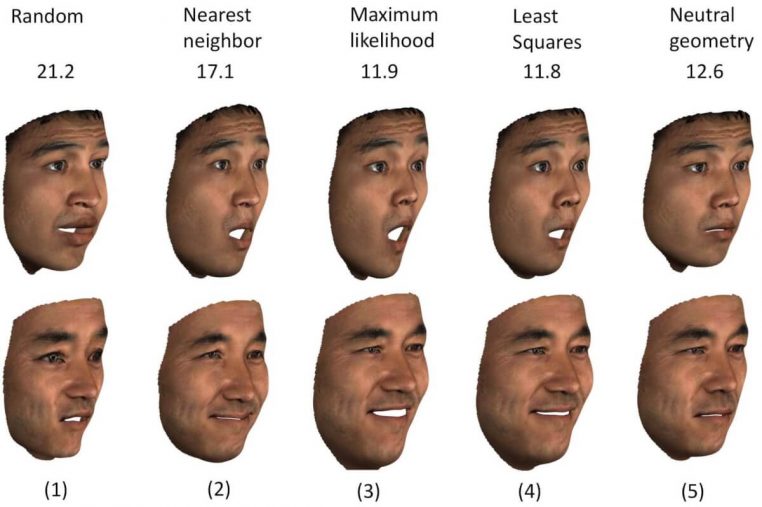

Texturas de cara GANEl último paso es crear geometría de la cara. Los investigadores probaron diferentes enfoques para encontrar los coeficientes de geometría correctos para la textura. Comparación cualitativa y cuantitativa de varios métodos a continuación (error geométrico L2):

Dos texturas sintetizadas superpuestas en diferentes geometrías.

Inesperadamente, el método de mínimos cuadrados muestra los mejores resultados. Teniendo en cuenta la simplicidad del método, se eligió para todos los experimentos.

Resultados

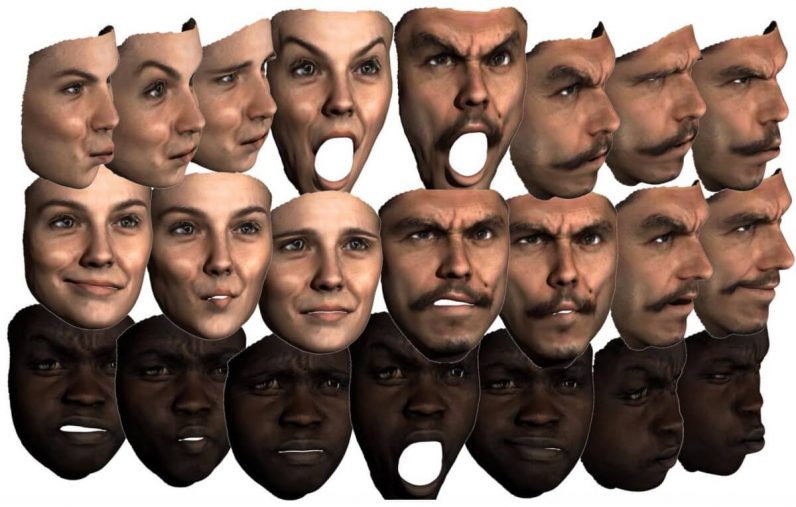

El método propuesto puede generar muchas caras nuevas, y cada una de ellas puede representarse en varias poses, con diferentes expresiones e iluminación. Se agregan varias expresiones faciales a la geometría neutra usando el modelo Blend Shape. Las imágenes resultantes se muestran a continuación:

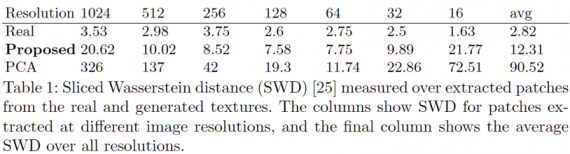

Para las evaluaciones cuantitativas, los investigadores utilizaron

la métrica truncada de Wasserstein (SWD) para medir la distancia entre las distribuciones de entrenamiento y las imágenes generadas.

La tabla demuestra que las texturas resultantes están estadísticamente más cercanas a los datos reales que las obtenidas con 3DMM.

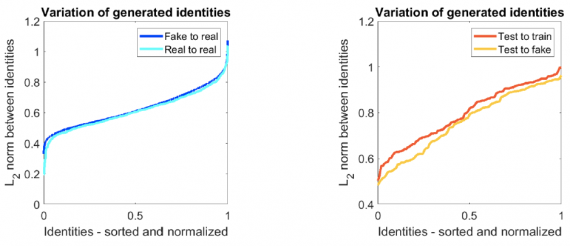

El siguiente experimento evalúa la capacidad de sintetizar imágenes, que son significativamente diferentes del conjunto de datos de entrenamiento, y obtener imágenes nunca antes vistas. Por lo tanto, el 5% de los individuos no fueron incluidos en la evaluación. Los investigadores midieron L2 la distancia entre cada persona real de los datos de entrenamiento y el más similar de los generados, y de manera similar para el real del conjunto de datos de entrenamiento.

Distancia entre caras sintetizadas y reales

Como se puede ver en los gráficos, los datos de la prueba están más cerca de las imágenes generadas que de las imágenes de entrenamiento. Además, la distancia "Prueba a falso" no es muy diferente de "Falso a real". Se deduce que las muestras obtenidas no son solo caras sintetizadas similares a un conjunto de entrenamiento, sino caras completamente nuevas.

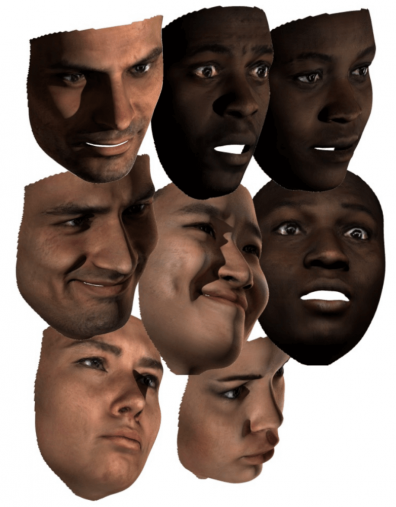

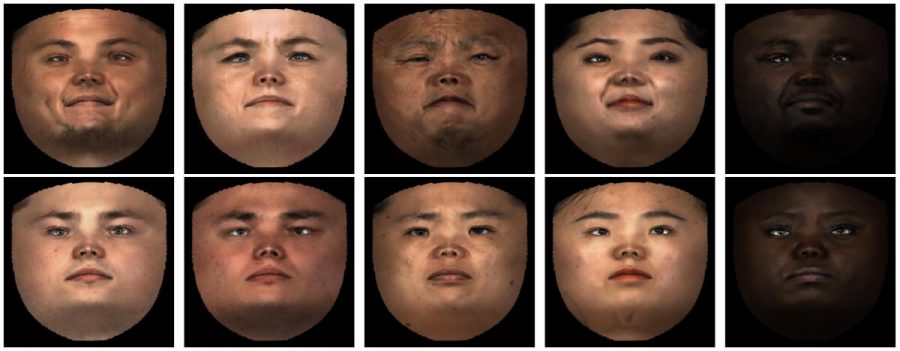

Finalmente, para verificar la posibilidad de generar el conjunto de datos inicial, se realizó una evaluación cualitativa: las texturas faciales obtenidas por este modelo se compararon con su vecino más cercano en la métrica L2.

Texturas sintetizadas (arriba) versus los "vecinos" reales más cercanos (abajo)

Como puede ver, las texturas reales más cercanas son bastante diferentes de las originales, lo que nos permite concluir sobre la capacidad de generar

nuevas caras.

Resumen

El modelo propuesto es probablemente el primero que es capaz de sintetizar de manera realista tanto la textura como la geometría de los rostros humanos. Esto puede ser útil para detectar y reconocer caras o modelos de reconstrucción de caras. Además, se puede usar en casos donde se requieren muchas caras realistas diferentes, por ejemplo, en la industria del cine o en los juegos de computadora. Además, esta estructura no se limita a la síntesis de rostros humanos, sino que se puede utilizar para otras clases de objetos donde es posible el aumento de datos.

El originalTraducido - Stanislav Litvinov.