Los investigadores de la visión por computadora han descubierto el mundo oculto de las señales visuales a nuestra disposición, donde hay movimientos imperceptibles que dan a conocer lo que se ha dicho e imágenes borrosas de lo que está a la vuelta de la esquina.

El especialista en visión artificial

Antonio Torralba , que descansaba en la costa de España en 2012, notó sombras aleatorias en la pared de su habitación de hotel que nada parecía proyectar. Al final, Torralba se dio cuenta de que los puntos descoloridos en la pared no eran sombras, sino imágenes apagadas e invertidas del patio exterior. La ventana funcionaba como un

agujero de alfiler : el tipo de cámara más simple en el que los rayos de luz atraviesan un pequeño agujero y forman una imagen invertida en el otro lado. En la pared iluminada por el sol, esta imagen apenas se podía discernir. Pero Torralba se dio cuenta de que nuestro mundo está lleno de información visual que nuestros ojos no perciben.

"Estas imágenes están ocultas para nosotros", dijo, "pero nos rodean constantemente".

La experiencia adquirida le permitió a él y a su colega,

Bill Freeman , también profesor del Instituto de Tecnología de Massachusetts, darse cuenta de que el mundo está lleno de "cámaras aleatorias", como las llaman: ventanas, esquinas, plantas domésticas y otros objetos comunes que crean imágenes ocultas de su entorno. Estas imágenes son 1000 veces menos vívidas que cualquier otra cosa, y por lo general no son visibles a simple vista. "Se nos ocurrieron formas de aislar estas imágenes y hacerlas visibles", explicó Freeman.

Aprendieron cuánta información visual se oculta frente a todos. En el

primer trabajo, mostraron que cuando se graba con un iPhone normal, los cambios en la luz en la pared de la habitación, desde el video recibido, pueden recrear la escena fuera de la ventana. El otoño pasado, ellos y sus colegas

informaron que se puede encontrar a una persona moviéndose en una esquina filmando una cámara cerca de la esquina. Este verano,

demostraron que pueden grabar una planta doméstica en video, y luego recrear una imagen tridimensional de toda la habitación basada en las sombras proyectadas por las hojas de la planta. O pueden convertir las hojas en un "

micrófono visual "

, aumentando sus vibraciones y reconociendo el habla.

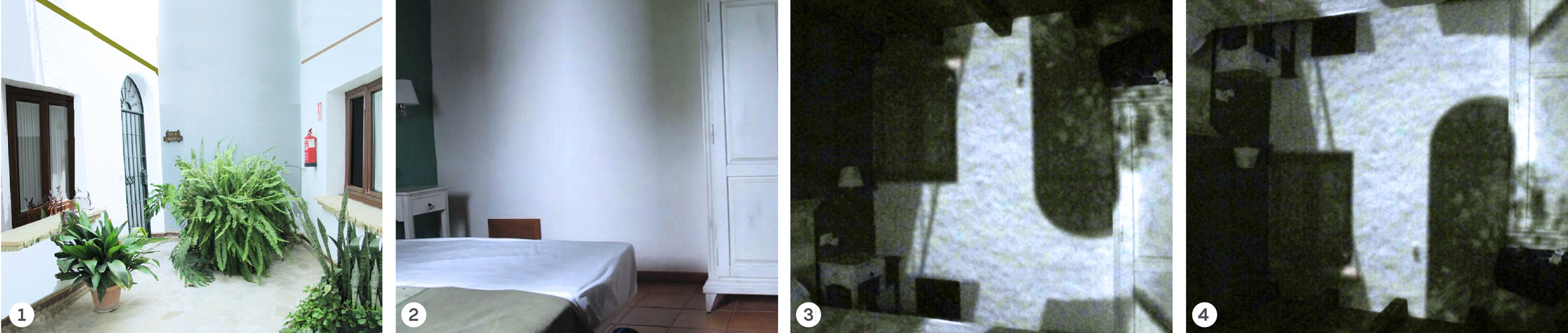

1) El patio afuera de la habitación del hotel donde Antonio Torralba notó que la ventana funciona como un agujero. 2) Imagen borrosa del patio en la pared; 3) se puede afilar cubriendo la mayor parte de la ventana con cartón para reducir el tamaño del agujero. 4) Si lo voltea, puede ver la escena desde afuera.

1) El patio afuera de la habitación del hotel donde Antonio Torralba notó que la ventana funciona como un agujero. 2) Imagen borrosa del patio en la pared; 3) se puede afilar cubriendo la mayor parte de la ventana con cartón para reducir el tamaño del agujero. 4) Si lo voltea, puede ver la escena desde afuera."Nuestro Mary tenía un carnero", dice el hombre de la grabación de audio, recreado a partir de los movimientos de una bolsa vacía de chips que los científicos dispararon a través de una ventana insonorizada en 2014 (estas son las primeras palabras escritas por Thomas Edison en 1877 en un fonógrafo).

La investigación sobre cómo mirar alrededor de las esquinas y hacer suposiciones sobre objetos que no son directamente visibles, o “construir imágenes que no están en línea de visión directa”, comenzó en 2012 con el trabajo de Torralba y Freeman en una cámara aleatoria, y con otro

trabajo crucial llevado a cabo por un grupo separado de científicos. del MIT dirigido por

Ramesh Raskar . En 2016, en particular, y gracias a sus resultados, la Agencia de Proyectos de Investigación Avanzada del Departamento de Defensa de los EE. UU. (DARPA) lanzó el programa REVEAL de $ 27 millones (Mejora revolucionaria de la visibilidad mediante la explotación de campos de luz activos: una mejora revolucionaria en la visibilidad usando campos de luz activos). El programa financia laboratorios emergentes en todo el país. Desde entonces, el flujo de nuevas ideas y trucos matemáticos hace que las imágenes sin línea de visión sean cada vez más potentes y prácticas.

Además del uso obvio para fines militares y de reconocimiento, los investigadores están estudiando la aplicación de tecnología en robomóviles, visión robótica, fotografía médica, astronomía, exploración espacial y misiones de rescate.

Torralba dijo que él y Freeman al comienzo del trabajo no tenían ideas sobre la aplicación práctica de la tecnología. Acaban de descubrir los conceptos básicos de la formación de imágenes y qué es una cámara, a partir de la cual se desarrolló naturalmente un estudio más completo del comportamiento de la luz y su interacción con objetos y superficies. Comenzaron a ver cosas en las que nadie podía pensar. La investigación psicológica, según Torralb, muestra que “las personas son terriblemente pobres para interpretar las sombras. Quizás una de las razones de esto es que muchas de las cosas que vemos no son sombras. Y al final, mis ojos lanzaron intentos de comprenderlos ".

Cámaras aleatorias

Los rayos de luz que llevan la imagen del mundo fuera de nuestro campo de visión caen constantemente sobre las paredes y otras superficies, después de lo cual se reflejan y caen en nuestros ojos. Pero, ¿por qué estos residuos visuales son tan débiles? Es solo que demasiados rayos van en demasiadas direcciones y las imágenes se vuelven borrosas.

Para formar una imagen, es necesario limitar seriamente los rayos incidentes en la superficie y ver solo un cierto conjunto de ellos. Esto es lo que hace la cámara estenopeica. La idea original de Torralba y Freeman en 2012 era que en nuestro entorno hay bastantes objetos y varias propiedades que limitan naturalmente los rayos de luz y forman imágenes débiles que la computadora puede reconocer.

Cuanto más pequeña sea la abertura del agujero de alfiler, más nítida será la imagen, ya que cada punto del objeto en estudio emitirá solo un haz de luz en el ángulo recto, que podrá pasar a través del agujero. La ventana en el Hotel Torralba era demasiado grande para que la imagen fuera nítida, y él y Freeman se dieron cuenta de que las cámaras al azar generalmente útiles eran bastante raras. Sin embargo, se dieron cuenta de que las cámaras anti-pinholes (cámaras de "punta"), que consisten en cualquier objeto pequeño que bloquea la luz, forman imágenes en abundancia.

Bill Freeman

Bill Freeman Antonio Torralba

Antonio TorralbaImagine que está eliminando la pared interior de una habitación a través de un espacio en las persianas. No verás mucho. De repente aparece una mano en su campo de visión. La comparación de la intensidad de la luz en la pared en presencia y ausencia de una mano proporciona información útil sobre la escena. Un conjunto de haces de luz incidentes en una pared en el primer cuadro queda momentáneamente bloqueado por la mano en el siguiente. Restando los datos del segundo cuadro de los datos del primero, como dice Freeman, "puedes calcular lo que bloqueó la mano": un conjunto de rayos de luz que representa la imagen de una parte de la habitación. "Si estudias qué bloquea la luz y qué la deja pasar", dijo, "puedes ampliar el rango de lugares donde puedes encontrar cámaras estenopeicas".

Junto con el estudio de cámaras aleatorias que perciben pequeños cambios en la intensidad, Freeman y sus colegas desarrollaron algoritmos que determinan y mejoran los pequeños cambios de color, como un cambio en el color de la cara de una persona cuando la sangre se apresura o disminuye, y pequeños movimientos, esta es la razón puedes grabar una conversación tomando una bolsa de papas fritas. Ahora pueden notar fácilmente el movimiento de una centésima de píxel, que en condiciones normales simplemente se ahogaría en ruido. Su método convierte matemáticamente imágenes en una configuración de onda sinusoidal. En el espacio resultante, el ruido no domina la señal, ya que las sinusoides representan los valores promedio tomados en muchos píxeles, por lo que el ruido se distribuye sobre ellos. Gracias a esto, los investigadores pueden determinar los cambios de las sinusoides de un cuadro del video a otro, amplificar estos cambios y luego volver a convertir los datos.

Ahora han comenzado a combinar todos estos trucos para extraer información visual oculta. Un estudio descrito en octubre pasado por

Katie Bowman (entonces estudiante dirigida por Freeman y ahora científica del Centro Astrofísico Harvard-Smithsonian) mostró que las esquinas de los edificios funcionan como cámaras, creando una imagen aproximada de lo que está a la vuelta de la esquina.

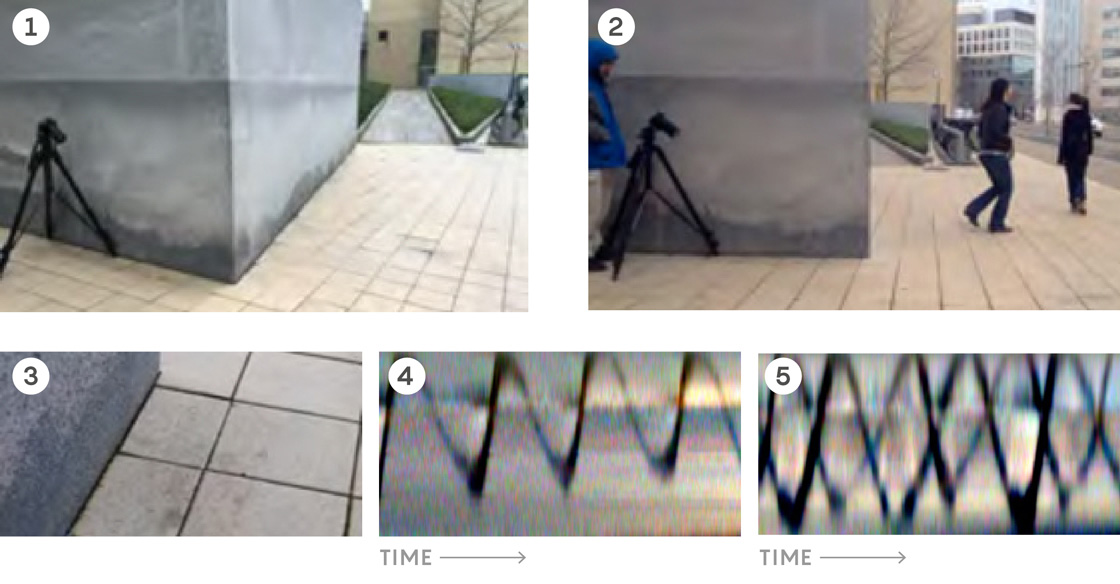

Tomando penumbra en el suelo cerca de la esquina (1), puede obtener información sobre los objetos ubicados a la vuelta de la esquina (2). Cuando los objetos invisibles comienzan a moverse, la luz y las sombras de ellos se mueven en diferentes ángulos con respecto a la pared. Los pequeños cambios en intensidad y color generalmente no se pueden distinguir a simple vista (3), pero se pueden mejorar utilizando algoritmos. Los videos primitivos con luz que se dirige en diferentes ángulos a la penumbra muestran la presencia de una persona en movimiento (4) y dos (5) a la vuelta de la esquina.

Tomando penumbra en el suelo cerca de la esquina (1), puede obtener información sobre los objetos ubicados a la vuelta de la esquina (2). Cuando los objetos invisibles comienzan a moverse, la luz y las sombras de ellos se mueven en diferentes ángulos con respecto a la pared. Los pequeños cambios en intensidad y color generalmente no se pueden distinguir a simple vista (3), pero se pueden mejorar utilizando algoritmos. Los videos primitivos con luz que se dirige en diferentes ángulos a la penumbra muestran la presencia de una persona en movimiento (4) y dos (5) a la vuelta de la esquina.Las facetas y esquinas, como agujeros de alfiler con cámaras puntuales, impiden el paso de la luz solar. Con cámaras comunes, el mismo iPhone, a la luz del día, Bowman y sus colegas tomaron una sombra parcial en la esquina del edificio, un área con sombras iluminadas por un subconjunto de los rayos de luz provenientes de un área oculta a la vuelta de la esquina. Si, por ejemplo, un hombre con una camisa roja pasa allí, esta camisa enviará una pequeña cantidad de luz roja a la penumbra, y esta luz se moverá a lo largo de la penumbra mientras la persona está caminando, invisible para el ojo común, pero detectada después del procesamiento posterior.

En un artículo revolucionario publicado en junio, Freeman y sus colegas recrearon el "campo de luz" de la habitación, una imagen de la intensidad y dirección de los rayos de luz en la habitación, desde las sombras proyectadas por una planta caducifolia al lado de la pared. Las hojas funcionaban como cámaras puntuales, cada una de las cuales bloqueaba su propio conjunto de rayos de luz. La comparación de la sombra de cada hoja con el resto de las sombras produjo este conjunto de rayos que faltaba y permitió obtener una imagen de una parte de la escena oculta. Dado el paralaje, los investigadores pudieron reunir todas estas imágenes.

Este enfoque proporciona imágenes mucho más nítidas que el trabajo anterior con cámaras aleatorias, ya que el algoritmo ha adquirido conocimientos previos sobre el mundo. Conociendo la forma de la planta, suponiendo que las imágenes naturales deberían ser suaves, y teniendo en cuenta varias otras suposiciones, los investigadores pudieron sacar ciertas conclusiones con respecto a las señales que contienen ruido, lo que ayudó a hacer que la imagen final sea más nítida. La tecnología de trabajar con un campo ligero "requiere el conocimiento del mundo circundante para crear la reconstrucción, pero también le brinda mucha información", dijo Torralba.

Luz dispersa

Mientras tanto, Freeman, Torralba y su protegido están revelando imágenes que estaban ocultas en otras partes del campus del MIT, Ramesh Raskar, un especialista en visión por computadora que habló en TED, tiene la intención de "cambiar el mundo" y elegir un enfoque llamado "imagen activa". Utiliza sistemas de cámara láser especializados y costosos para crear imágenes de alta resolución que muestran lo que está a la vuelta de la esquina.

Ramesh Raskar

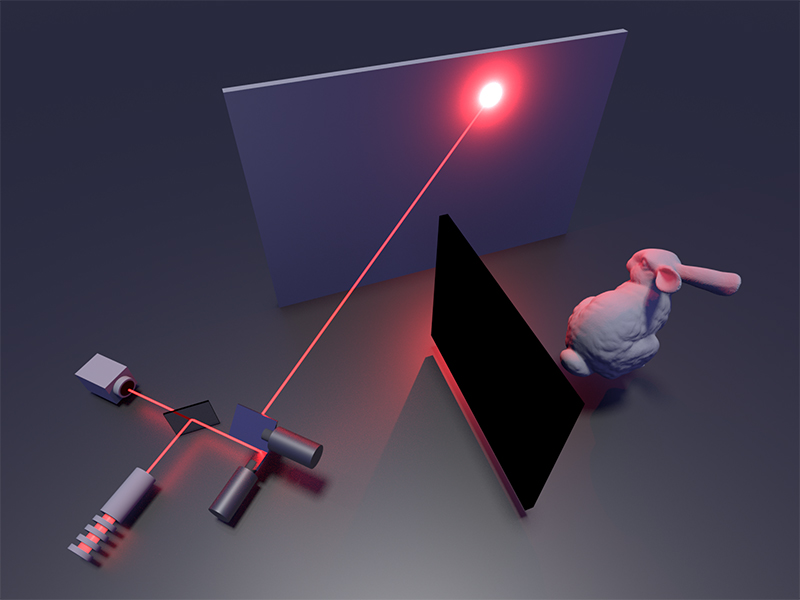

Ramesh RaskarEn 2012, como parte de la implementación de una idea que lo visitó hace cinco años, Raskar y su equipo crearon por primera vez una tecnología en la que es necesario liberar pulsos láser en la pared. Una pequeña parte de la luz dispersa podrá sortear el obstáculo. Y poco tiempo después de cada pulso, utilizan una "cámara flash" que graba fotones individuales a una velocidad de miles de millones de fotogramas por segundo para detectar los fotones que rebotan en la pared. Al medir el tiempo que pasan los fotones al regresar, los investigadores pueden descubrir qué tan lejos se alejaron y, en detalle, recrean la geometría tridimensional de los objetos ocultos detrás del obstáculo, en el que se dispersaron los fotones. Una de las dificultades es que para la formación de una imagen tridimensional, es necesario realizar un escaneo de trama de la pared con un láser. Digamos que una persona se esconde a la vuelta de la esquina. "Entonces la luz reflejada desde un cierto punto en la cabeza, desde un cierto punto en el hombro y desde un cierto punto en la rodilla puede llegar a la cámara al mismo tiempo", dijo Raskar. Pero si hace brillar el láser un poco en otro lugar, la luz de estos tres puntos ya no llegará a la cámara al mismo tiempo ". Es necesario combinar todas las señales y resolver el "problema inverso" para recrear la geometría tridimensional oculta.

El algoritmo original de Raskar para resolver el problema inverso requería demasiados recursos informáticos, y el dispositivo en sí costó medio millón de dólares. Pero se ha realizado un trabajo serio para simplificar las matemáticas y reducir los costos. En marzo, la revista Nature publicó un

trabajo que estableció un nuevo estándar para la construcción eficiente y económica de imágenes tridimensionales de un objeto: la figura de un conejo a la vuelta de la esquina se recreó en el trabajo. Los autores,

Matthew O'Toole ,

David Lindel y

Gordon Wetstein, de la Universidad de Stanford, han desarrollado un nuevo algoritmo poderoso para resolver el problema inverso y han utilizado

cámaras SPAD relativamente económicas, dispositivos semiconductores cuya velocidad de fotogramas es menor que la de las cámaras flash. Raskar, quien anteriormente trabajó como curador de dos autores de la obra, lo calificó de "muy ingenioso" y "uno de mis favoritos".

Los algoritmos anteriores se estaban hundiendo en detalle: los investigadores generalmente intentaron detectar los fotones que no se reflejaban desde el punto en la pared donde brillaba el láser, de modo que la cámara pudiera evitar recoger la luz láser dispersa. Pero al dirigir el láser y la cámara a casi el mismo punto, los investigadores pudieron mapear los fotones salientes y entrantes de un "

cono de luz ". Dispersándose desde la superficie, la luz forma una esfera de fotones en expansión, que forma un cono, que se propaga en el espacio-tiempo. O'Toole (quien desde entonces cambió su trabajo de Stanford a la Universidad Carnegie Mellon) tradujo la física de los conos de luz, desarrollada por el maestro de Albert Einstein, German Minkowski a principios del siglo XX, en una expresión lacónica que conecta el tiempo de vuelo del fotón con la ubicación de superficies dispersas. Llamó a su traducción "transformación del cono de luz".

Los Robomobiles ya están utilizando sistemas LIDAR para construir imágenes directas, y uno puede imaginar que algún día conseguirán que SPAD mire a la vuelta de la esquina. "En el futuro cercano, dichos sensores también estarán disponibles en formato portátil", predice

Andreas Welten , el primer autor del trabajo inicial de Raskar a partir de 2012, que ahora lidera el equipo dedicado a la construcción de imágenes activas en la Universidad de Wisconsin. El desafío ahora es "manejar escenas más complejas" y escenarios realistas, dijo Welten, "y no solo crear cuidadosamente una escena con un objeto blanco y un fondo negro. Necesitamos tecnología para dirigir el dispositivo y presionar el botón ".

Donde estan las cosas

Los investigadores del grupo Freeman comenzaron a combinar enfoques pasivos y activos. El trabajo, realizado bajo la guía del investigador Christos Trumpulidis, muestra que cuando se construyen activamente imágenes usando un láser, se puede usar una cámara en forma de punto de una forma conocida ubicada alrededor de un ángulo para recrear una escena oculta sin usar información sobre el tiempo de vuelo de los fotones. "Y esto debería funcionar para nosotros con la ayuda de una

matriz CCD convencional", dijo Trampulidis.

Las imágenes fuera de la línea de visión algún día ayudarán a los equipos de rescate y robots autónomos. Welten colabora con el Laboratorio de Propulsión a Chorro de la NASA, trabajando en un proyecto destinado a construir imágenes a distancia de objetos dentro de las cuevas de la luna. Pero Raskar y la compañía utilizan su enfoque para leer las primeras páginas de un libro cerrado y para ver en la niebla.

Además de las reconstrucciones de audio, el algoritmo de mejora del movimiento de Freeman puede ayudar a crear dispositivos médicos y sistemas de seguridad, así como pequeños detectores de movimiento astronómicos. Este algoritmo es "una muy buena idea", dijo David Hogg, astrónomo y científico de datos de la Universidad de Nueva York y el Instituto Flatiron. "Pensé, solo tenemos que usarlo en astronomía".

Con respecto a los problemas de privacidad planteados por los descubrimientos recientes, Freeman recurre a su experiencia. "He pensado mucho en este problema durante toda mi carrera", dice. Freeman, un hombre con gafas, entusiasta de la cámara que ha estado involucrado en la fotografía toda su vida, dijo que al comienzo de su carrera, no quería trabajar en nada que tuviera algún tipo de potencial militar o de espionaje. Pero con el tiempo, comenzó a pensar que “la tecnología es una herramienta que se puede usar de diferentes maneras. Si intentas evitar todo lo que pueda tener al menos algo de uso militar, entonces no puedes pensar en nada útil ". Él dice que incluso en el caso de los militares, "hay una amplia gama de posibilidades para usar cosas". Puedes ayudar a alguien a sobrevivir. Y, en principio, saber dónde están las cosas es útil ".

Pero estaba más satisfecho no con las capacidades tecnológicas, sino simplemente con el descubrimiento de un fenómeno que estaba oculto a la vista. "Me parece que el mundo está lleno de todo lo que queda por descubrir", dijo.