La vie est-elle le seul but valable de l'intelligence?

L'article discute l'intellect et ses objectifs ultimes, tandis que les thèses sur l'orthogonalité et la convergence sont abordées. Dans mon précédent article «Life, Intellect, Mind, Mind», la question n'était pas suffisamment clarifiée. Le principe était énoncé dans cet article: une intelligence forte devrait être construite comme un système adaptable basé sur l'objectif ultime: la préservation et la survie d'un organisme vivant - porteur de l'intelligence. Et le schéma structurel général de l'organisme doté d'une intelligence, éventuellement forte, est donné. Vous trouverez ci-dessous une analyse supplémentaire des raisons pour lesquelles il en est ainsi.Une note sur la terminologie.En tant qu'intellect fort, nous garderons à l'esprit sa compréhension généralement acceptée. Une intelligence faible est tout système ou algorithme qui n'implémente pas une intelligence forte. Le nom commun aux deux est simplement l'intelligence, nous ne distinguerons pas l'intelligence artificielle et naturelle.La thèse de l'orthogonalité de la finalité et de l'intelligence.La thèse de l'orthogonalité dit que vous pouvez combiner n'importe quel niveau d'intelligence avec n'importe quel objectif, car l'intelligence et les objectifs ultimes sont des variables orthogonales, c'est-à-dire indépendantes.Comportement adaptatifNous montrons un fait peut-être évident, mais important: un comportement adaptatif est impossible sans objectif. Considérez tous les algorithmes dotés de propriétés adaptatives, y compris les systèmes d'intelligence forte, car, en raison de la généralité, il n'y a aucune raison de les exclure.L'adaptation peut être considérée comme:- 1) changement des quantités scalaires - paramètres de l'algorithme

- 2) changement des structures de contrôle

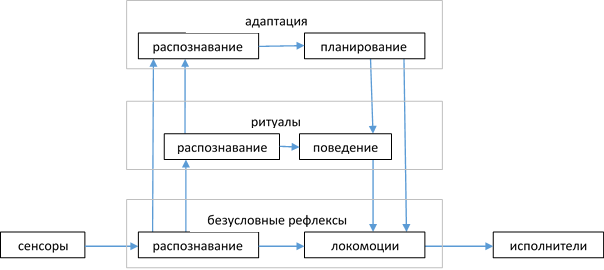

Pour les réseaux de neurones, la 1ère méthode est utilisée - la définition des poids de connexion. Les poids sont ajustés dans le processus d'apprentissage, l'enseignant agit comme un facteur externe qui adapte le réseau - pourquoi lui seul le sait, on peut dire qu'il agit comme un processus de motivation. La méthode 2 peut être effectuée par le programmeur, les raisons de motivation du programmeur ne sont également connues que de lui.Une autre méthode d'adaptation peut être mise en œuvre comme processus d'optimisation des valeurs cibles. La mise en œuvre de tels processus d'optimisation peut être assez simple. Le renforcement d'un réseau de neurones en est un bon exemple: un algorithme transparent ajuste les poids du réseau pour le comportement cible. La technique d'adaptation pour le comportement cible, voir l' IA de Google a maîtrisé indépendamment 49 anciens jeux Atari .Et en conséquence, la structure des systèmes d'auto-apprentissage ou adaptatifs: ce schéma est vrai pour tous les systèmes adaptatifs, y compris une forte intelligence. Deux concepts sont introduits: la composante adaptative et motivante de l'intelligence. La composante motivante est mise en œuvre selon l'objectif ultime. La composante motivante n'est pas modifiée (ne s'adapte pas) - elle est fixée de manière rigide.Comment entrer l'objectif final dans le système?Nous nous posons une question - comment implémenter pratiquement l'optimisation pour atteindre un objectif. Si le composant d'adaptation est supposé être simple et la complexité du signal des entrées et sorties est simple, alors le composant de motivation est également simple et sa mise en œuvre est transparente.Revenons aux jeux Atari - pour cette complexité des signaux d'information sensoriels et exécutifs et le but, les développeurs ont réussi à former efficacement un composant motivant qui implémente l'apprentissage par renforcement du réseau. Intuitivement, la tâche elle-même ne vaut pas la forte intelligence! Et parler d'une intelligence forte dans le cas des jeux Atari est hors de question.Cela demande à juste titre: à quel niveau les systèmes peuvent-ils parler d'intelligence forte? L'hypothèse est claire qu'une forte intelligence est potentiellement possible si la complexité et la variété des informations sensorielles (entrées) et exécutives (sorties) au sens de la sémantique et des niveaux de concepts dépassent un certain seuil critique. Il est douteux que l'on puisse se limiter au fait qu'une manière simple d'intégrer les informations d'entrée formera un petit ensemble de signaux de renforcement.Très probablement, pour motiver un intellect fort, un élément de motivation complexe et complexe devrait être formé, qui peut inclure de nombreuses conditions et schémas de réaction. Très probablement, il sera à plusieurs niveaux dans le sens de représentations d'informations d'entrée - des modèles et des réactions simples reconnaissables (nous les appellerons réflexes de base ou inconditionnés) à partir de ceux-ci sont combinés en objets reconnaissables d'un ordre supérieur et comportement réactif (nous les appellerons rituels). Dans la version biologique, la composante motivante a été formée par des algorithmes génétiques au cours de l'évolution.Notez que pour la composante motivante, on peut affirmer que considérée séparément, elle ne peut pas être un intellect fort, car elle est fixée de manière rigide.Un schéma élargi pour un système avec une forte intelligence potentielle :(les réflexes et les rituels inconditionnés forment une composante motivante )

ce schéma est vrai pour tous les systèmes adaptatifs, y compris une forte intelligence. Deux concepts sont introduits: la composante adaptative et motivante de l'intelligence. La composante motivante est mise en œuvre selon l'objectif ultime. La composante motivante n'est pas modifiée (ne s'adapte pas) - elle est fixée de manière rigide.Comment entrer l'objectif final dans le système?Nous nous posons une question - comment implémenter pratiquement l'optimisation pour atteindre un objectif. Si le composant d'adaptation est supposé être simple et la complexité du signal des entrées et sorties est simple, alors le composant de motivation est également simple et sa mise en œuvre est transparente.Revenons aux jeux Atari - pour cette complexité des signaux d'information sensoriels et exécutifs et le but, les développeurs ont réussi à former efficacement un composant motivant qui implémente l'apprentissage par renforcement du réseau. Intuitivement, la tâche elle-même ne vaut pas la forte intelligence! Et parler d'une intelligence forte dans le cas des jeux Atari est hors de question.Cela demande à juste titre: à quel niveau les systèmes peuvent-ils parler d'intelligence forte? L'hypothèse est claire qu'une forte intelligence est potentiellement possible si la complexité et la variété des informations sensorielles (entrées) et exécutives (sorties) au sens de la sémantique et des niveaux de concepts dépassent un certain seuil critique. Il est douteux que l'on puisse se limiter au fait qu'une manière simple d'intégrer les informations d'entrée formera un petit ensemble de signaux de renforcement.Très probablement, pour motiver un intellect fort, un élément de motivation complexe et complexe devrait être formé, qui peut inclure de nombreuses conditions et schémas de réaction. Très probablement, il sera à plusieurs niveaux dans le sens de représentations d'informations d'entrée - des modèles et des réactions simples reconnaissables (nous les appellerons réflexes de base ou inconditionnés) à partir de ceux-ci sont combinés en objets reconnaissables d'un ordre supérieur et comportement réactif (nous les appellerons rituels). Dans la version biologique, la composante motivante a été formée par des algorithmes génétiques au cours de l'évolution.Notez que pour la composante motivante, on peut affirmer que considérée séparément, elle ne peut pas être un intellect fort, car elle est fixée de manière rigide.Un schéma élargi pour un système avec une forte intelligence potentielle :(les réflexes et les rituels inconditionnés forment une composante motivante ) Pour les organismes vivants, le concept de conservation est posé comme un objectif dans la composante motivante. En attendant, en principe, d'autres objectifs peuvent être posés dans la composante motivante (la thèse de l'orthogonalité). Il est important que l'objectif ait une place pour le processus d'adaptation.Quels sont les objectifs ultimes?Avec toute la variété des objectifs, nous pouvons certainement dire que travailler avec un objectif plus ou moins non trivial nécessite une période plus ou moins longue, et donc il y a un besoin d'un objectif intermédiaire - assurer sa sûreté et sa sécurité. Et cela est cohérent avec la thèse de la convergence.La thèse de la convergence instrumentale dit que les forces agissantes superintelligentes, ou agents, avec la plus grande variété de leurs buts ultimes, poursuivront néanmoins des buts intermédiaires similaires, puisque tous les agents auront les mêmes raisons instrumentales.Prenez les trois lois bien connues de la robotique: et parmi elles, il y a une loi sur la sécurité cible du robot. Et conformément à la définition de la vie (voir l'article «Vie, intelligence, psyché, raison» ), un tel comportement cible peut être considéré comme le signe d'un organisme vivant.Ainsi, tout système de renseignement ayant un objectif plus ou moins non trivial devrait être principalement vivant, y compris un porteur d'intelligence forte.Au cours de l'évolution biologique, un fort intellect humain s'est formé uniquement dans le but de survivre. Si nous supposons qu'il sera possible de réaliser un porteur artificiel d'intelligence forte, sera-t-il humain que, en plus de l'objectif de survie-préservation, il y soit intégré, un objectif supplémentaire? Je me demande si tu étais à sa place, en tant que personne (!), Ça te plairait?ConclusionUne intelligence forte peut potentiellement être réalisée sur la base de l'objectif - la préservation d'un organisme vivant, à condition que le seuil critique de complexité de l'information sensorielle et exécutive soit dépassé.

Pour les organismes vivants, le concept de conservation est posé comme un objectif dans la composante motivante. En attendant, en principe, d'autres objectifs peuvent être posés dans la composante motivante (la thèse de l'orthogonalité). Il est important que l'objectif ait une place pour le processus d'adaptation.Quels sont les objectifs ultimes?Avec toute la variété des objectifs, nous pouvons certainement dire que travailler avec un objectif plus ou moins non trivial nécessite une période plus ou moins longue, et donc il y a un besoin d'un objectif intermédiaire - assurer sa sûreté et sa sécurité. Et cela est cohérent avec la thèse de la convergence.La thèse de la convergence instrumentale dit que les forces agissantes superintelligentes, ou agents, avec la plus grande variété de leurs buts ultimes, poursuivront néanmoins des buts intermédiaires similaires, puisque tous les agents auront les mêmes raisons instrumentales.Prenez les trois lois bien connues de la robotique: et parmi elles, il y a une loi sur la sécurité cible du robot. Et conformément à la définition de la vie (voir l'article «Vie, intelligence, psyché, raison» ), un tel comportement cible peut être considéré comme le signe d'un organisme vivant.Ainsi, tout système de renseignement ayant un objectif plus ou moins non trivial devrait être principalement vivant, y compris un porteur d'intelligence forte.Au cours de l'évolution biologique, un fort intellect humain s'est formé uniquement dans le but de survivre. Si nous supposons qu'il sera possible de réaliser un porteur artificiel d'intelligence forte, sera-t-il humain que, en plus de l'objectif de survie-préservation, il y soit intégré, un objectif supplémentaire? Je me demande si tu étais à sa place, en tant que personne (!), Ça te plairait?ConclusionUne intelligence forte peut potentiellement être réalisée sur la base de l'objectif - la préservation d'un organisme vivant, à condition que le seuil critique de complexité de l'information sensorielle et exécutive soit dépassé. Source: https://habr.com/ru/post/fr393579/

All Articles