Google Neural Network crée des styles aléatoires d'images en temps réel

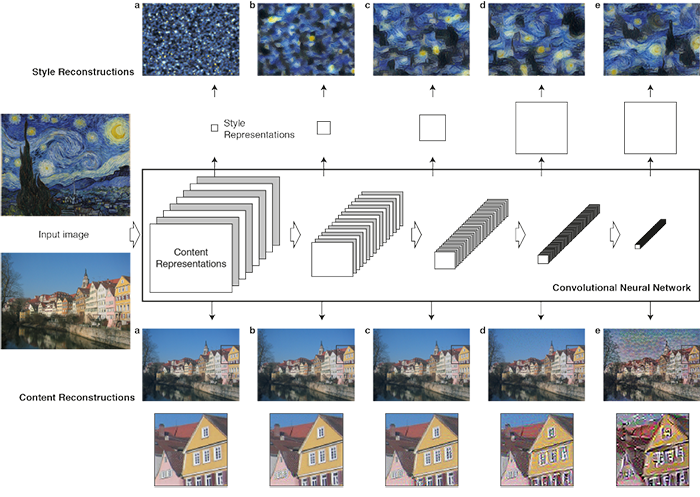

Le réseau neuronal de Google superpose l'un des 32 styles entraînés sur la photo (cinq sont présentés ici). Le programme est peu exigeant pour le matériel et la mémoire. Le code sera publié prochainementSynthèse des textures avec le transfert de style d'une image à une autre - une technique bien connue qui a 15 ans. Il a été décrit pour la première fois dans l'article « Analogies in Image » par un groupe de chercheurs de Microsoft Research pour la conférence SIGGRAPH 2001, ainsi que dans l'article « Remplissage d'image pour la synthèse et le transfert de texture » de Mitsubishi Electric Research et de l'Université de Californie à Berkeley la même année 2001. Maintenant, il est difficile de dire lequel est apparu plus tôt.En 2015, la technique a reçu une seconde vie, lorsque les réseaux de neurones ont été connectés à la synthèse d'images avec transfert de style. Il est arrivé après le travail scientifique " neuroalgorithms style artistique " Getisa, Ecker et Bethge de l'Université Eberhard-Karls de Tuebingen, Allemagne ( article sur Geektimes ). Le travail est si impressionnant que l'algorithme décrit a été bientôt implémenté dans plusieurs programmes informatiques pour le marché grand public, y compris des applications mobiles comme le russe Prisma (juin 2016).Le travail de Gatis, Ecker et Betge est bon parce que les auteurs ont formé le réseau neuronal sur les œuvres existantes d'artistes célèbres: Vincent Van Gogh, Pablo Picasso, Edward Munch et d'autres. Dans le même temps, le réseau de neurones peut continuer à être formé sur d'autres ensembles de données, il s'agit donc d'un outil universel. C'est un tel réseau de neurones qui fonctionne sur le serveur de Prisma et d'autres sociétés qui distribuent des applications mobiles pour styliser les photos des utilisateurs.Le réseau neuronal convolutif de Getis, Ecker et Betge a été créé sur la base du réseau neuronal VGG à 19 couches de Simonyan et Zissermanet le traitement de l'image d'origine se déroule en plusieurs étapes. À chaque étape de la hiérarchie, le nombre de filtres augmente. Le style d'un style spécifique se produit aux premières étapes du «sous-échantillonnage» (traits larges, motifs cubistes, etc.), et les dernières couches du réseau de neurones traitent l'image d'origine afin que les objets restent reconnaissables ( d et e dans le diagramme). Le réseau neuronal commence à fonctionner à partir d'une position aléatoire (ou à partir de l'image d'origine) jusqu'à ce que le résultat réponde aux exigences spécifiées.

Le réseau neuronal de Google superpose l'un des 32 styles entraînés sur la photo (cinq sont présentés ici). Le programme est peu exigeant pour le matériel et la mémoire. Le code sera publié prochainementSynthèse des textures avec le transfert de style d'une image à une autre - une technique bien connue qui a 15 ans. Il a été décrit pour la première fois dans l'article « Analogies in Image » par un groupe de chercheurs de Microsoft Research pour la conférence SIGGRAPH 2001, ainsi que dans l'article « Remplissage d'image pour la synthèse et le transfert de texture » de Mitsubishi Electric Research et de l'Université de Californie à Berkeley la même année 2001. Maintenant, il est difficile de dire lequel est apparu plus tôt.En 2015, la technique a reçu une seconde vie, lorsque les réseaux de neurones ont été connectés à la synthèse d'images avec transfert de style. Il est arrivé après le travail scientifique " neuroalgorithms style artistique " Getisa, Ecker et Bethge de l'Université Eberhard-Karls de Tuebingen, Allemagne ( article sur Geektimes ). Le travail est si impressionnant que l'algorithme décrit a été bientôt implémenté dans plusieurs programmes informatiques pour le marché grand public, y compris des applications mobiles comme le russe Prisma (juin 2016).Le travail de Gatis, Ecker et Betge est bon parce que les auteurs ont formé le réseau neuronal sur les œuvres existantes d'artistes célèbres: Vincent Van Gogh, Pablo Picasso, Edward Munch et d'autres. Dans le même temps, le réseau de neurones peut continuer à être formé sur d'autres ensembles de données, il s'agit donc d'un outil universel. C'est un tel réseau de neurones qui fonctionne sur le serveur de Prisma et d'autres sociétés qui distribuent des applications mobiles pour styliser les photos des utilisateurs.Le réseau neuronal convolutif de Getis, Ecker et Betge a été créé sur la base du réseau neuronal VGG à 19 couches de Simonyan et Zissermanet le traitement de l'image d'origine se déroule en plusieurs étapes. À chaque étape de la hiérarchie, le nombre de filtres augmente. Le style d'un style spécifique se produit aux premières étapes du «sous-échantillonnage» (traits larges, motifs cubistes, etc.), et les dernières couches du réseau de neurones traitent l'image d'origine afin que les objets restent reconnaissables ( d et e dans le diagramme). Le réseau neuronal commence à fonctionner à partir d'une position aléatoire (ou à partir de l'image d'origine) jusqu'à ce que le résultat réponde aux exigences spécifiées. Les représentations du contenu et du style sont séparées les unes des autres dans le réseau neuronal. Ainsi, ils peuvent être contrôlés indépendamment les uns des autres. Par exemple, prenez le contenu d'une image et le style d'une autre.

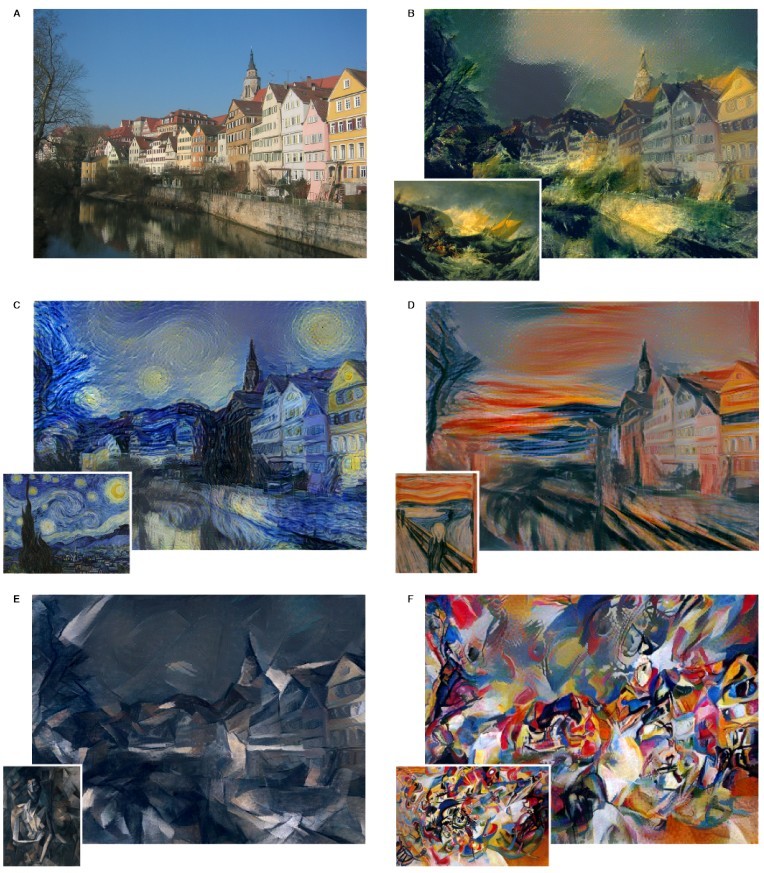

Les représentations du contenu et du style sont séparées les unes des autres dans le réseau neuronal. Ainsi, ils peuvent être contrôlés indépendamment les uns des autres. Par exemple, prenez le contenu d'une image et le style d'une autre. Exemples d'images de style dans les réseaux de neurones de Gatis, Ecker et BetgeImage originale: Vieille ville de Tübingen

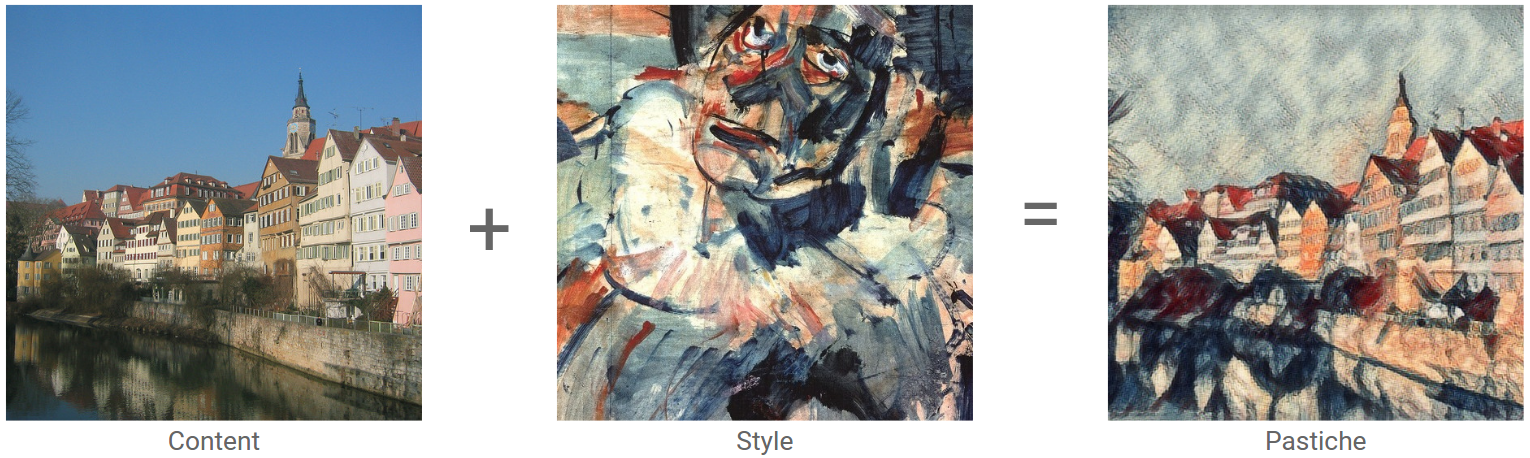

Exemples d'images de style dans les réseaux de neurones de Gatis, Ecker et BetgeImage originale: Vieille ville de Tübingen Échantillon de style: peinture «Tête de clown» (1907-1908), Georges Rouault, style: expressionnisme

Échantillon de style: peinture «Tête de clown» (1907-1908), Georges Rouault, style: expressionnisme Résultat du travail du réseau de neurones

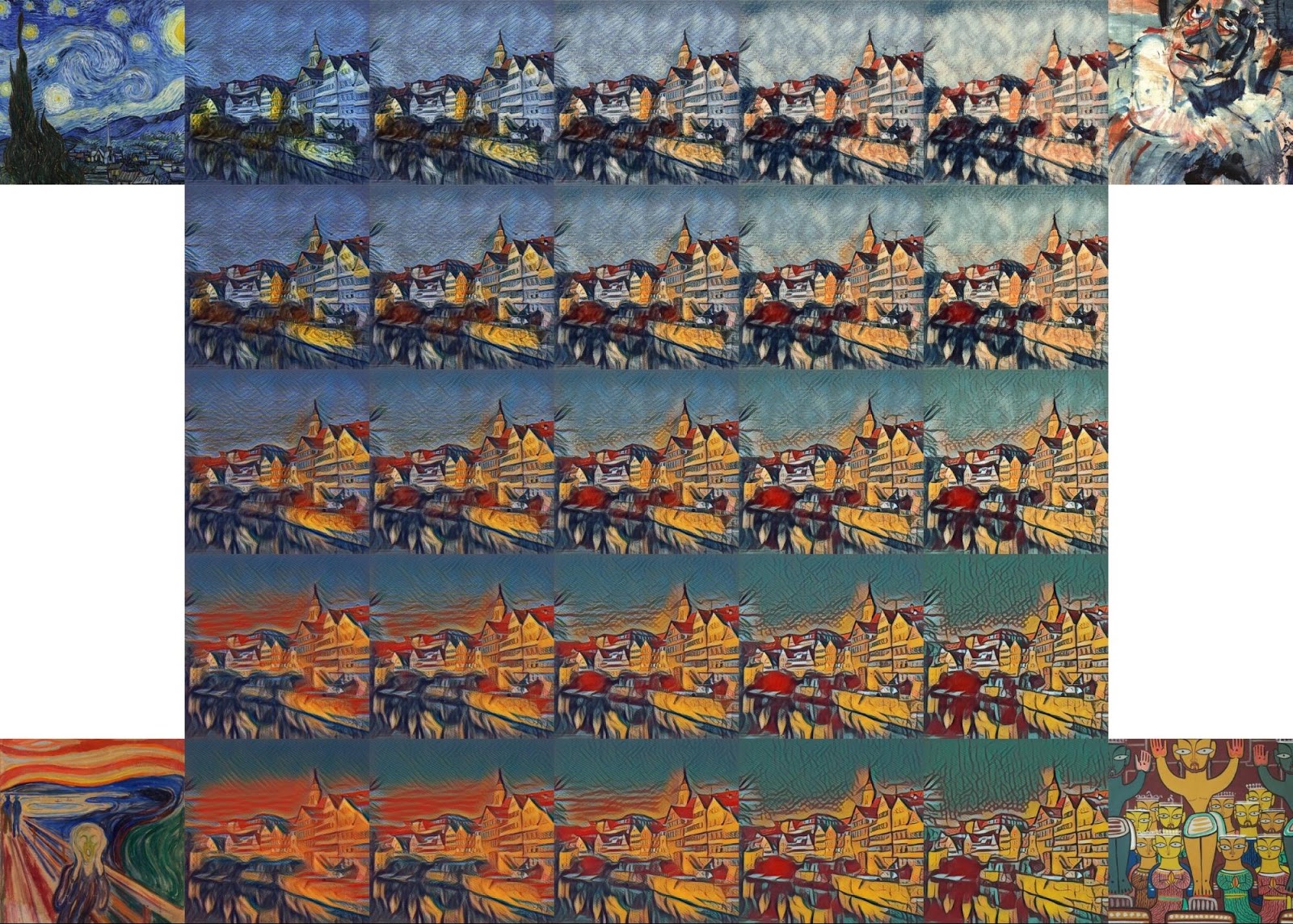

Résultat du travail du réseau de neurones Ce travail est considéré comme une percée fondamentale dans les technologies d'apprentissage en profondeur, car c'est la première preuve conceptuelle du transfert de style artistique à travers un réseau de neurones. Ce qui était considéré comme une vision artistique, le style d'auteur et le genre d'art, est formalisé et absorbé avec succès par un réseau de neurones. L'intelligence artificielle a d'abord maîtrisé la vraie créativité.L'idée de séparer le style et le contenu de l'image a créé une variété de réseaux de neurones, y compris pour la génération d'images effrayanteset pour générer des images porno .Malheureusement, les réseaux de neurones Gatis, Ecker et Betge ont un inconvénient: un tel réseau de neurones est trop exigeant en ressources informatiques. Cela est devenu clair après la sortie des premières applications de démonstration, qui ont été traitées sur le serveur pendant plusieurs minutes.Dans des travaux ultérieurs, y compris par des spécialistes russes , le réseau neuronal a été considérablement optimisé en raison de fonctionnalités limitées. En conséquence, l'optimisation a atteint un tel niveau qu'au lieu de quelques minutes, la stylisation de la photo a commencé à se produire presque instantanément. Il y avait donc une opportunité de styliser même la vidéo en temps réel !Mais une telle stylisation a un revers à la médaille. Un style ultra-rapide n'est possible que si une seule image est prise pour l'échantillon . Il s'agit d'une limitation de l'algorithme d'origine, car il n'est pas lié à un style. En d'autres termes, si vous voulez créer un système capable de transmettre 100 styles différents, vous devez pré-former 100 réseaux neuronaux différents.Maintenant, Google a contribué à cette recherche. Le 24 octobre 2016, les employés de Google Brain Team ont publié un article décrivant un algorithme qui fonctionne aussi vite que les précédents, mais en même temps dans un seul réseau neuronal universel qui peut imposer tous les styles acquis.selon les mots dedéveloppeurs, leur algorithme est simple à mettre en œuvre et ne met pas en avant des exigences élevées en RAM. De plus, après une formation sur plusieurs styles, il est capable de combiner plusieurs styles en même temps et travaille en temps réel. Par exemple, voici une photographie de la même vieille ville de Tübingen, sur laquelle quatre styles se superposent simultanément .

Ce travail est considéré comme une percée fondamentale dans les technologies d'apprentissage en profondeur, car c'est la première preuve conceptuelle du transfert de style artistique à travers un réseau de neurones. Ce qui était considéré comme une vision artistique, le style d'auteur et le genre d'art, est formalisé et absorbé avec succès par un réseau de neurones. L'intelligence artificielle a d'abord maîtrisé la vraie créativité.L'idée de séparer le style et le contenu de l'image a créé une variété de réseaux de neurones, y compris pour la génération d'images effrayanteset pour générer des images porno .Malheureusement, les réseaux de neurones Gatis, Ecker et Betge ont un inconvénient: un tel réseau de neurones est trop exigeant en ressources informatiques. Cela est devenu clair après la sortie des premières applications de démonstration, qui ont été traitées sur le serveur pendant plusieurs minutes.Dans des travaux ultérieurs, y compris par des spécialistes russes , le réseau neuronal a été considérablement optimisé en raison de fonctionnalités limitées. En conséquence, l'optimisation a atteint un tel niveau qu'au lieu de quelques minutes, la stylisation de la photo a commencé à se produire presque instantanément. Il y avait donc une opportunité de styliser même la vidéo en temps réel !Mais une telle stylisation a un revers à la médaille. Un style ultra-rapide n'est possible que si une seule image est prise pour l'échantillon . Il s'agit d'une limitation de l'algorithme d'origine, car il n'est pas lié à un style. En d'autres termes, si vous voulez créer un système capable de transmettre 100 styles différents, vous devez pré-former 100 réseaux neuronaux différents.Maintenant, Google a contribué à cette recherche. Le 24 octobre 2016, les employés de Google Brain Team ont publié un article décrivant un algorithme qui fonctionne aussi vite que les précédents, mais en même temps dans un seul réseau neuronal universel qui peut imposer tous les styles acquis.selon les mots dedéveloppeurs, leur algorithme est simple à mettre en œuvre et ne met pas en avant des exigences élevées en RAM. De plus, après une formation sur plusieurs styles, il est capable de combiner plusieurs styles en même temps et travaille en temps réel. Par exemple, voici une photographie de la même vieille ville de Tübingen, sur laquelle quatre styles se superposent simultanément . Les chercheurs pensent que leur travail ouvre de nouvelles possibilités pour l'utilisation créative des réseaux de neurones de stylisation. Dans un avenir proche, ils promettent de publier le code source du programme pour TensorFlow sur le blog Magenta , afin que chacun puisse exécuter la démo sur son ordinateur.Plus de détails sur le style des images dans le réseau neuronal sont décrits dans la vidéo scientifique populaire .. Il a été enregistré par deux salariés Nat et Lo dans 20% de leur temps de travail, que Google alloue aux projets de leur choix.

Les chercheurs pensent que leur travail ouvre de nouvelles possibilités pour l'utilisation créative des réseaux de neurones de stylisation. Dans un avenir proche, ils promettent de publier le code source du programme pour TensorFlow sur le blog Magenta , afin que chacun puisse exécuter la démo sur son ordinateur.Plus de détails sur le style des images dans le réseau neuronal sont décrits dans la vidéo scientifique populaire .. Il a été enregistré par deux salariés Nat et Lo dans 20% de leur temps de travail, que Google alloue aux projets de leur choix.Source: https://habr.com/ru/post/fr398703/

All Articles