Projet FlyAI: l'intelligence artificielle permet aux mouches des colonies

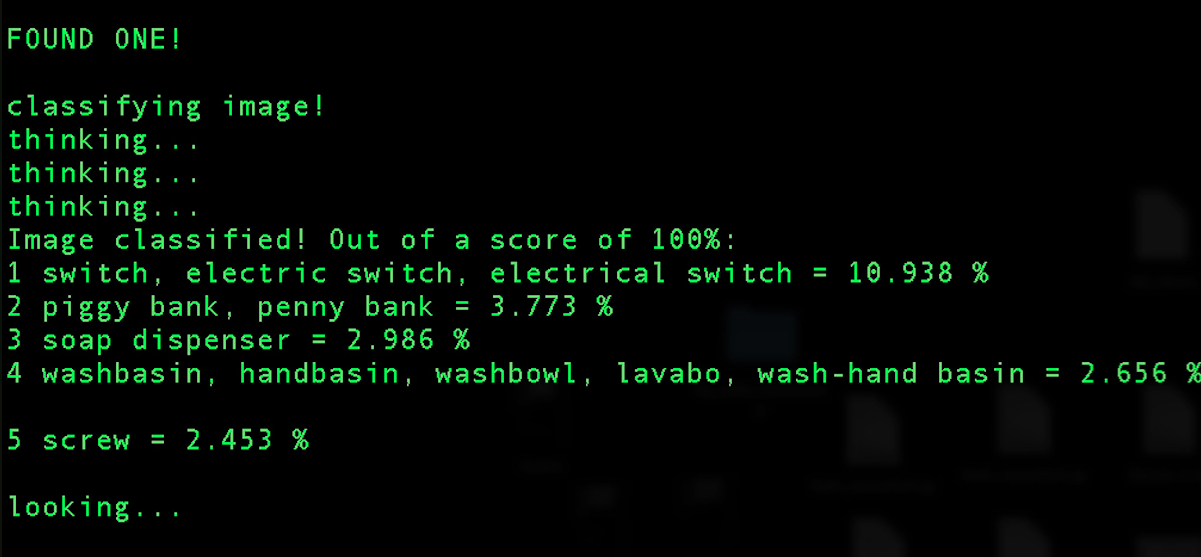

Depuis un mois, la vie d'une colonie de mouches située dans la ville de Duluth, Minnesota, USA, est totalement dépendante du fonctionnement du logiciel. Il s'agit d'une forme faible d'auto-apprentissage de l'IA, qui garantit complètement et complètement la vie des insectes à l'intérieur d'un vaisseau spécial. En particulier, l'IA fournit aux mouches de la nourriture (lait en poudre avec du sucre) et de l'eau.La durée de vie des insectes dépend de la façon dont l'ordinateur identifie correctement l'objet devant les caméras. Si le système détermine cet objet comme une mouche et décide que les insectes ont besoin d'être rechargés, ils le recevront. En cas d'erreur, les mouches ne recevront ni nourriture ni eau et souffriront (autant que possible pour les mouches) de faim et de soif pendant longtemps. Le projet lui-même s'appelait FlyAI, une sorte de parodie d'une colonie de personnes contrôlée par ordinateur. En tout cas, c'est ainsi que l'auteur du projet voit tout.« Nous devons donner au courant du fait, ce que l' on peut attendre de l'intelligence artificielle, puisque dans tous les cas , il sera », - dit David Bowen ( par David Bowen est ) de l'Université du Minnesota à Duluth. Il pense qu'il faut maintenant réfléchir à ce qui sera une véritable intelligence artificielle, pour que plus tard il n'y ait plus de problèmes. Selon le professeur, les gens, malgré les problèmes, pourront rendre l'IA utile à la personne et ne lui feront pas de mal.Un élément central du projet FlyAI est un réseau de neurones auto-apprenant. Il est clair que, comme la plupart des systèmes d'IA modernes, ce n'est pas un projet idéal. FlyAI n'a pas de base de données d'images pour un apprentissage efficace. Par conséquent, le système fait régulièrement des erreurs en identifiant les mouches comme commutateurs ou autres objets. En cas d'identification incorrecte, l'ordinateur ne «démarre» pas le système de survie et les mouches ont faim et souffrent de soif, comme mentionné ci-dessus. Mais en tout cas, tant que la colonie vit, cela fait un mois et les mouches se sentent bien. Si quelque chose tourne mal, le concepteur du système sauvera les insectes en ne permettant pas leur mort massive. «Ils meurent, je pense, pour des raisons naturelles», explique Bowen. "Ils ont l'occasion de vieillir ici."Le projet, a-t-il dit, est une incarnation stylisée des pensées du spécialiste de l'IA Nick Bostrom, qui travaille à Oxford. Bostrom estime que l'ouverture de la recherche par des spécialistes travaillant sur la création de l'intelligence artificielle peut être un problème. Cela concerne en particulier le projet Open AI, sur lequel des informations ont déjà été publiées sur Geektimes. «Si vous avez un bouton« faire en sorte que tout le monde se sente mal », il est peu probable que vous souhaitiez le partager avec tout le monde», explique Bostrom. Mais dans le cas d'OpenAI, ce bouton sera accessible à tous.

Depuis un mois, la vie d'une colonie de mouches située dans la ville de Duluth, Minnesota, USA, est totalement dépendante du fonctionnement du logiciel. Il s'agit d'une forme faible d'auto-apprentissage de l'IA, qui garantit complètement et complètement la vie des insectes à l'intérieur d'un vaisseau spécial. En particulier, l'IA fournit aux mouches de la nourriture (lait en poudre avec du sucre) et de l'eau.La durée de vie des insectes dépend de la façon dont l'ordinateur identifie correctement l'objet devant les caméras. Si le système détermine cet objet comme une mouche et décide que les insectes ont besoin d'être rechargés, ils le recevront. En cas d'erreur, les mouches ne recevront ni nourriture ni eau et souffriront (autant que possible pour les mouches) de faim et de soif pendant longtemps. Le projet lui-même s'appelait FlyAI, une sorte de parodie d'une colonie de personnes contrôlée par ordinateur. En tout cas, c'est ainsi que l'auteur du projet voit tout.« Nous devons donner au courant du fait, ce que l' on peut attendre de l'intelligence artificielle, puisque dans tous les cas , il sera », - dit David Bowen ( par David Bowen est ) de l'Université du Minnesota à Duluth. Il pense qu'il faut maintenant réfléchir à ce qui sera une véritable intelligence artificielle, pour que plus tard il n'y ait plus de problèmes. Selon le professeur, les gens, malgré les problèmes, pourront rendre l'IA utile à la personne et ne lui feront pas de mal.Un élément central du projet FlyAI est un réseau de neurones auto-apprenant. Il est clair que, comme la plupart des systèmes d'IA modernes, ce n'est pas un projet idéal. FlyAI n'a pas de base de données d'images pour un apprentissage efficace. Par conséquent, le système fait régulièrement des erreurs en identifiant les mouches comme commutateurs ou autres objets. En cas d'identification incorrecte, l'ordinateur ne «démarre» pas le système de survie et les mouches ont faim et souffrent de soif, comme mentionné ci-dessus. Mais en tout cas, tant que la colonie vit, cela fait un mois et les mouches se sentent bien. Si quelque chose tourne mal, le concepteur du système sauvera les insectes en ne permettant pas leur mort massive. «Ils meurent, je pense, pour des raisons naturelles», explique Bowen. "Ils ont l'occasion de vieillir ici."Le projet, a-t-il dit, est une incarnation stylisée des pensées du spécialiste de l'IA Nick Bostrom, qui travaille à Oxford. Bostrom estime que l'ouverture de la recherche par des spécialistes travaillant sur la création de l'intelligence artificielle peut être un problème. Cela concerne en particulier le projet Open AI, sur lequel des informations ont déjà été publiées sur Geektimes. «Si vous avez un bouton« faire en sorte que tout le monde se sente mal », il est peu probable que vous souhaitiez le partager avec tout le monde», explique Bostrom. Mais dans le cas d'OpenAI, ce bouton sera accessible à tous. Cependant, Bostrom estime que l'intelligence artificielle devrait être une aubaine pour les humains. «Pour nous, il est important de créer une intelligence artificielle, qui est suffisamment intelligente pour apprendre de nos erreurs. Il pourra se perfectionner sans cesse. La première version pourra en créer une seconde, qui sera meilleure, et la seconde, plus intelligente que l'original, créera une troisième encore plus avancée et ainsi de suite. Dans certaines conditions, un tel processus d'auto-amélioration peut être répété jusqu'à ce qu'une explosion intellectuelle soit réalisée - le moment où le niveau intellectuel du système passe en peu de temps d'un niveau relativement modeste au niveau de super-intelligence », a-t- il déclaré .Et Bowen affirme que le risque pour l'humanité n'est pas les possibilités illimitées de la future forme forte de l'IA, mais le logiciel dont dépendra la vie humaine (en cela, il n'en doute pas). «L'un des problèmes est que nous ne comprenons même pas complètement ce qu'est l'intelligence artificielle», explique Bowen. "Et ça a l'air intimidant."Une forme forte d'IA, bien sûr, sera complètement différente de ce que sont les moteurs de recherche vocale et les assistants numériques modernes. Les possibilités de l'intelligence artificielle sont probablement vastes, mais elles comportent des risques. Le même Stephen Hawking pense que l'IA est la plus grande erreur de l'humanité. Bill Gates affirme que dans quelques décennies, l'intelligence artificielle sera déjà suffisamment développée pour constituer une cause de préoccupation humaine. Et Elon Musk a qualifié l'IA de "principale menace pour l'existence humaine".

Cependant, Bostrom estime que l'intelligence artificielle devrait être une aubaine pour les humains. «Pour nous, il est important de créer une intelligence artificielle, qui est suffisamment intelligente pour apprendre de nos erreurs. Il pourra se perfectionner sans cesse. La première version pourra en créer une seconde, qui sera meilleure, et la seconde, plus intelligente que l'original, créera une troisième encore plus avancée et ainsi de suite. Dans certaines conditions, un tel processus d'auto-amélioration peut être répété jusqu'à ce qu'une explosion intellectuelle soit réalisée - le moment où le niveau intellectuel du système passe en peu de temps d'un niveau relativement modeste au niveau de super-intelligence », a-t- il déclaré .Et Bowen affirme que le risque pour l'humanité n'est pas les possibilités illimitées de la future forme forte de l'IA, mais le logiciel dont dépendra la vie humaine (en cela, il n'en doute pas). «L'un des problèmes est que nous ne comprenons même pas complètement ce qu'est l'intelligence artificielle», explique Bowen. "Et ça a l'air intimidant."Une forme forte d'IA, bien sûr, sera complètement différente de ce que sont les moteurs de recherche vocale et les assistants numériques modernes. Les possibilités de l'intelligence artificielle sont probablement vastes, mais elles comportent des risques. Le même Stephen Hawking pense que l'IA est la plus grande erreur de l'humanité. Bill Gates affirme que dans quelques décennies, l'intelligence artificielle sera déjà suffisamment développée pour constituer une cause de préoccupation humaine. Et Elon Musk a qualifié l'IA de "principale menace pour l'existence humaine". La plate-forme logicielle, qui est le centre de FlyAI, fait souvent une erreurBien sûr, le projet lui-même peut sembler un peu ridicule, mais son auteur ne le pense pas. En fait, tout ce qu'il voulait, c'était attirer l'attention du public sur son projet et le problème de l'IA. On peut dire qu'il a réussi. En tout cas, nous ne savons pas encore quand une IA à part entière apparaîtra et si elle apparaîtra du tout. Cela peut arriver demain, ou peut-être dans quelques décennies. Pour être sûre pour les humains, l'intelligence artificielle doit être consciente de la valeur de la vie humaine. Pourtant, l'homme n'est pas une mouche.

La plate-forme logicielle, qui est le centre de FlyAI, fait souvent une erreurBien sûr, le projet lui-même peut sembler un peu ridicule, mais son auteur ne le pense pas. En fait, tout ce qu'il voulait, c'était attirer l'attention du public sur son projet et le problème de l'IA. On peut dire qu'il a réussi. En tout cas, nous ne savons pas encore quand une IA à part entière apparaîtra et si elle apparaîtra du tout. Cela peut arriver demain, ou peut-être dans quelques décennies. Pour être sûre pour les humains, l'intelligence artificielle doit être consciente de la valeur de la vie humaine. Pourtant, l'homme n'est pas une mouche.Source: https://habr.com/ru/post/fr400045/

All Articles