Un jour, à l'avenir, nous pourrons mettre des lunettes - et nous promener dans la ville, qui est restituée en temps réel dans le style que nous aimons. La lumière du soleil ou la brume légère, le coucher du soleil du soir, peu importe. Peu importe à quel point l'architecture est terne, avec des lunettes, ce sera beau. De telles capacités de rendu avec le transfert de styles sont ouvertes par l'incroyable programme

Deep Photo Style Transfer , qui est publié dans le domaine public, ainsi que les

travaux scientifiques qui le sous-tendent (arXiv: 1703.07511).

Le transfert de style d'une image à une autre est un vieux problème que les développeurs ont essayé avec succès de résoudre par le passé. En choisissant le bon modèle pour transférer le style, vous pouvez magnifiquement transformer votre photo - comme si elle avait été prise à un autre moment de la journée, sous un éclairage différent, par temps différent ou d'une manière spéciale, traitée de manière artistique. Jusqu'à présent, les techniques de transfert de styles à l'aide de réseaux de neurones étaient relativement limitées - soit elles ne pouvaient fonctionner qu'avec certaines scènes, soit la plausibilité du transfert de styles en souffrait. Les auteurs du nouveau programme

Deep Photo Style Transfer ont essayé de résoudre tous ces problèmes.

Le réseau de neurones Deep Photo Style Transfer est construit conformément à la technique de transfert de style neuronal décrite par

Gatis , mais a été considérablement repensé et amélioré. La principale amélioration est le photoréalisme. Gatis même si l'image d'origine et l'échantillon sont des photographies, l'image finale ressemble toujours à une image où les lignes et les bordures claires deviennent floues et les textures se superposent aux objets voisins. C'est beau, mais pas très réel.

Espace colorimétrique uniquement

Le résultat de Deep Photo Style Transfer est strictement photoréaliste. "Effets de peinture" éliminés en raison de l'interdiction de la distorsion spatiale. Ici, le transfert de styles n'est limité que par l'espace colorimétrique. En d'autres termes, les formes des objets restent exactement les mêmes que dans l'original. C'est pour cette raison qu'à l'avenir, les «points» mentionnés au début de l'article deviendront possibles. Tous les objets dans la réalité environnante conserveront leur forme, ils auront juste l'air dans un style différent.

Les auteurs ont accompli cette tâche en utilisant une couche spécifique du réseau neuronal dans l'esprit de

la matrice de Kirchhoff (matrice laplacienne) - représentant le graphique sous la forme d'une matrice. Comme le montre la vérification sur les photographies avec différentes scènes, cette approche supprime avec succès la distorsion, tout en exerçant une influence minimale sur l'authenticité des photographies.

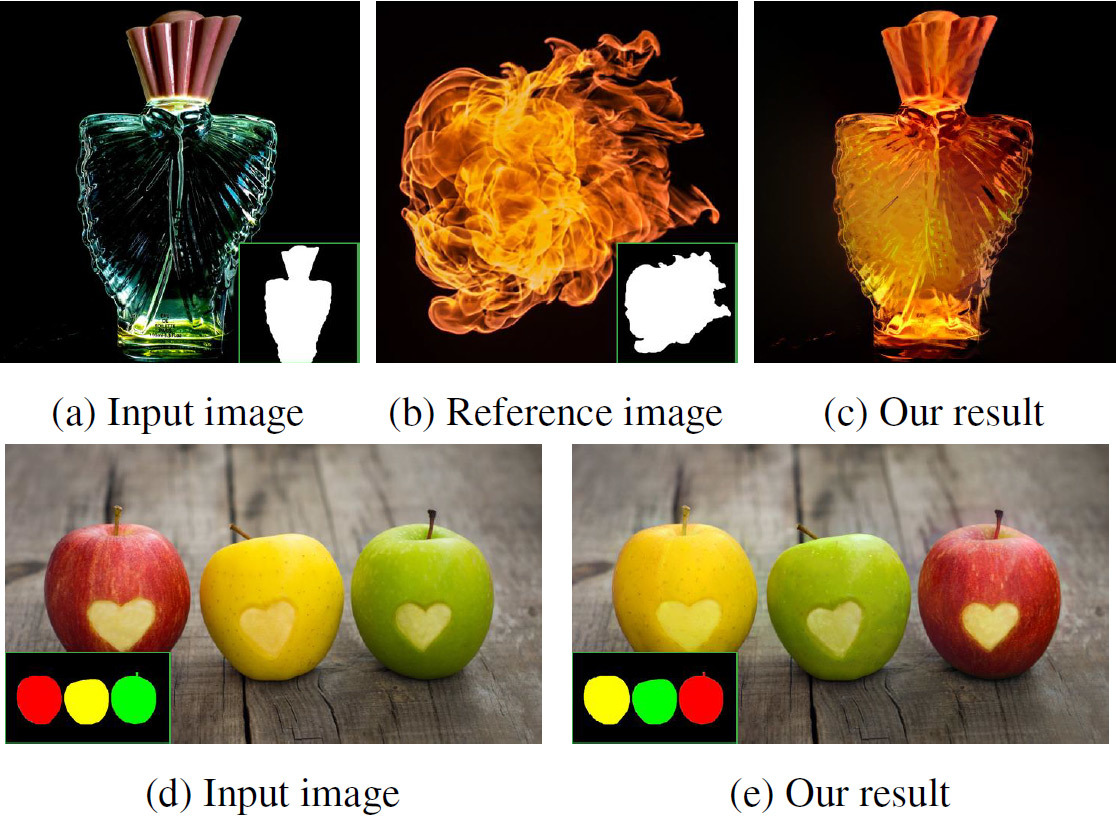

Le principe le plus clairement décrit se manifeste dans deux exemples spécialement sélectionnés.

Comme vous pouvez le voir, les limites des objets sont clairement préservées. La conversion n'a lieu que dans l'espace colorimétrique. Dans le premier cas, le style de feu est transféré dans le flacon de parfum, et dans le second cas, la texture des pommes change en fonction du motif.

Segmentation sémantique

La deuxième réalisation des auteurs du programme est de résoudre le problème du transfert du style entre des objets inappropriés dans la photo originale et l'échantillon de style. Cela se fait par segmentation sémantique. Par conséquent, les styles de maison sont transférés uniquement entre les maisons et le style du ciel affecte uniquement le ciel. Dans de nombreux cas, la segmentation sémantique fonctionne très efficacement, à condition que l'échantillon de style ait les mêmes objets sémantiques que dans l'image d'origine.

Deux des approches ci-dessus ont fourni une conversion photo extrêmement réaliste.

L'original

Motif de style

Image finale

Voici quelques exemples supplémentaires.

L'original

Motif de style

Image finale

L'original

Motif de style

Image finale

L'original

Motif de style

Image finale

L'original

Motif de style

Image finale

L'original

Motif de style

Image finale

L'original

Motif de style

Image finale

L'original

Motif de style

Image finale

L'original

Motif de style

Image finale

L'original

Motif de style

Image finale

L'original

Motif de style

Image finale

L'original

Motif de style

Image finale

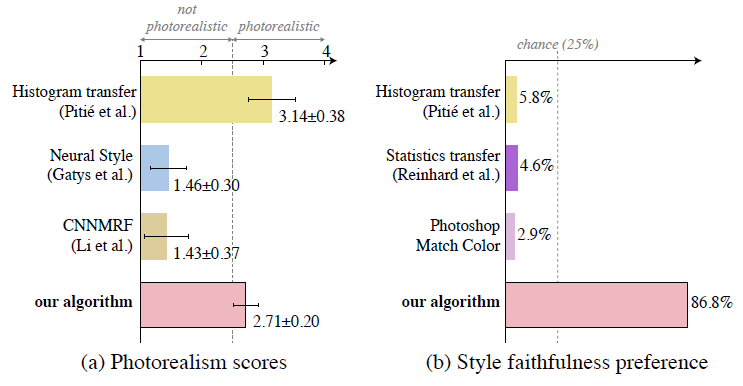

La qualité de cet algorithme ne peut être déterminée que par une enquête auprès des utilisateurs qui évaluent le photoréalisme et la fiabilité de la transmission du style. Une telle enquête serait menée. Il a montré qu'en termes de photoréalisme, Deep Photo Style Transfer surpasse considérablement les développements présentés précédemment de Neural Style et CNNMRF, mais inférieur au

système de rendu des

couleurs Pete . La fiabilité du transfert de style Deep Photo Style Transfer est bien meilleure que les autres méthodes.

Les auteurs des travaux scientifiques ont l'intention de poursuivre les recherches afin de surmonter les limitations existantes de la segmentation d'images. Ils considèrent également le traitement en temps réel des photos à l'aide d'un réseau neuronal pré-formé prometteur.