Application de la théorie de l'information à la recherche de signaux de civilisations extraterrestres

Si vous recherchez des signaux de civilisations extraterrestres, alors pourquoi ne pas vous exercer d'abord sur certains systèmes de transfert d'informations qui n'appartiennent pas aux humains qui existent sur notre planète? Avec les baleines, un système de communication mondial existe depuis des millions d'années - plus longtemps que l'Homo sapiens n'existe généralement. Les abeilles, communiquant entre elles en partie par la danse, ont tenu un débat démocratique sur les meilleurs endroits où creuser pendant des millions d'années avant que les gens ne parviennent à un système politique démocratique. Plein d'autres exemples. Aucune de mes connaissances qui a étudié le système de communication d'autres animaux, jamais après cela, n'a tiré la conclusion que cette espèce était plus bête qu'il ne le pensait.

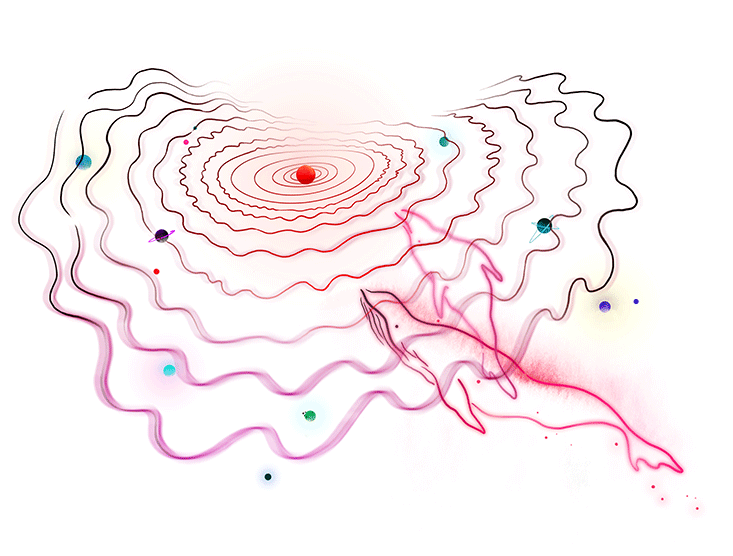

En étudiant les moyens de communication animale, mes collègues et moi avons développé un nouveau type de détecteur, un filtre de "communication intelligence" qui détermine si un signal provenant de l'espace appartient à une civilisation technologiquement avancée. La plupart des tentatives précédentes du projet SETI ont cherché des émissions radio dans une gamme de fréquences étroite ou des signaux optiques à scintillement rapide. A en juger par nos connaissances dans le domaine de l'astrophysique, de tels signaux seraient clairement artificiels, et leur découverte signifierait la présence de technologies capables de transmettre un signal à des distances interstellaires. Les SETI rejettent généralement les signaux radio à large bande et les impulsions optiques lentes, dont l'origine est moins évidente. Bien que ces signaux auraient pu être envoyés par des créatures intelligentes, ils peuvent provenir de sources naturelles d'ondes radio, telles que des nuages de gaz interstellaires, et nous n'avons toujours pas eu un bon moyen de les distinguer.

En termes simples, nous pouvions déjà recevoir un message de créatures intelligentes et le négliger, car il ne répondait pas à nos attentes quant à l'apparence d'un tel signal. C'est peut-être la raison pour laquelle, après 50 ans de recherches, nous n'avons trouvé aucune communication interstellaire.

Au cours de la dernière décennie et demie, mes collègues et moi avons trouvé une meilleure solution. Nous avons appliqué la

théorie de l'information aux systèmes de communication des personnes et des animaux, et maintenant nous pouvons dire avec certitude dans quel cas certains êtres vivants se transmettent des idées complexes, sans même savoir ce qu'ils disent. Nous utilisons le terme «système de communication» afin de ne pas décider à l'avance si d'autres espèces ont une langue au sens humain du terme. Les communications complexes obéissent aux règles générales de la syntaxe, d'où découle l'existence de ce que l'on peut appeler un «contenu raisonnable». Si nous avons un morceau de message suffisamment grand, nous pouvons évaluer le degré de complexité ou la structure des règles. Dans les mathématiques de la théorie de l'information, cette structure est appelée "

entropie d'information conditionnelle " et est composée de connexions mathématiques entre les unités élémentaires de communication, telles que les lettres et les

phonèmes . Dans le langage courant, nous considérons la grammaire comme une telle structure et, à un niveau plus basique, la compilation de mots et de phrases à partir de sons. Et pour la première fois au SETI Institute de Mountain View en Californie, nous avons commencé à rechercher de telles structures dans les données collectées par SETI.

Mes collègues, Brenda McCowan, Sean Hanser de l'Université de Californie à Davis, et moi avons décidé d'étudier des créatures, à la fois socialement complexes et très dépendantes de la communication acoustique, et utilisant des signaux sonores que nous pourrions classer. Par conséquent, nos trois premiers sujets étaient des grands

dauphins (Tursiops truncatus),

des singes écureuils communs (Saimiri sciureus) et

des baleines à bosse (Megaptera novaeangliae).

Un aspect de la linguistique humaine, qui se manifeste dans les premières études des mots, des lettres et des phonèmes, est connu sous le nom de

loi de Zipf , du nom du linguiste de Harvard

George Zipf . Dans les textes anglais, les lettres «e» sont plus que les lettres «t», les lettres «t» sont plus que les lettres «a», et ainsi de suite, jusqu'au «q» le plus rarement utilisé. Si vous construisez une liste de lettres de «e» à «q» en fréquence décroissante, et construisez la fréquence de leur utilisation sur un graphique logarithmique, alors ces valeurs s'installent sur une ligne droite inclinée à 45 degrés - c'est-à-dire sur une ligne droite avec une pente de -1 [En termes simples, la fréquence d'utilisation de la nième lettre est inversement proportionnelle à son numéro de série n / env. trad.]. Si vous faites de même avec un texte composé de caractères chinois, vous obtenez le même biais. Il en va de même pour les lettres, les mots ou les phonèmes pour les conversations en japonais, allemand, hindi et des dizaines d'autres langues. Et babble babble n'obéit pas à la loi de Zipf. Son biais est inférieur à -1, car il émet des sons presque par accident. Mais à mesure que vous apprenez la langue, le biais augmente progressivement et atteint -1 à l'âge de 24 mois.

Les linguistes mathématiques affirment que ce biais de -1 indique que la séquence de sons ou de symboles d'écriture contient suffisamment de complexité pour appartenir à la langue. Il s'agit d'une condition nécessaire mais non suffisante - c'est-à-dire qu'il s'agit du premier test de complexité, mais pas de la preuve de sa présence. Zipf lui-même pensait que la raison de ce biais de -1 résidait dans un compromis, qu'il a appelé le "principe du moindre effort". Il s'agit de l'équilibre entre la personne émettrice qui essaie d'utiliser moins d'énergie pour envoyer le signal et le destinataire qui souhaite obtenir plus de redondance pour s'assurer que le message entier est reçu.

L'essentiel dans l'application de la théorie de l'information est l'isolement des unités de signal. Par exemple, si nous traçons tous les points et tirets du code Morse sur le graphique, nous obtenons une pente Zipf de l'ordre de 0,2. Mais si nous prenons la séquence de points et de tirets - point, point, tiret, tiret, point et tiret, et des variations plus longues comme unités élémentaires - alors le biais changera en -1, reflétant comment les lettres de l'alphabet sont codées dans ce système. De cette façon, à l'aide de l'ingénierie inverse, les unités de sens d'origine peuvent être reconnues.

La plupart des linguistes ont suggéré que la loi de Zipf ne caractérise que les langues humaines. Nous avons découvert avec plaisir en traçant la fréquence des sifflements de grands dauphins adultes sur un graphique qu'ils obéissent également à la loi de Zipf! Plus tard, lorsque deux petits dauphins à gros nez sont nés à Sea World en Californie, nous avons enregistré leurs bébés siffleurs et avons découvert que pour eux la pente Zipf correspondait à celle des marmonnements de bébés humains. Il s'avère que les bébés dauphins marmonnent et sifflent, apprenant leur système de communication de la même manière que les bébés humains apprennent le langage. Lorsque les dauphins ont eu 12 mois, la fréquence de distribution des sons dans leur sifflet a atteint une pente de -1.

Bien que nous ayons encore à déchiffrer ce que disent les dauphins, nous avons constaté qu'eux et les baleines ont des systèmes de communication avec une complexité interne approchant le langage humain. Cette complexité rend la communication tolérante aux pannes. Toute créature échangeant des informations devrait être en mesure de le faire, malgré le bruit environnant, les obstacles et autres phénomènes perturbant la propagation du signal. Le langage humain est structuré pour fournir une redondance. Au niveau de base, cette structure détermine la probabilité d'une lettre donnée. Si je vous dis à quoi le mot est destiné, vous pouvez deviner que la première lettre de ce mot sera "t", puisque c'est la première lettre la plus populaire pour les mots en anglais. Votre intuition sera la plus probable, mais un peu informative. Nous pouvons dire que vous avez choisi la plus simple des options. Si vous vous étiez arrêté à la lettre «q» et deviniez, vous auriez reçu des informations plus précises sur le mot que j'avais conçu, si cela commençait vraiment par «q».

Continuons. Si je disais que je pensais à la deuxième lettre du mot, dont la première lettre est «q», vous devineriez immédiatement que cette lettre est «u». Pourquoi? Parce que vous [le lecteur anglais] savez que ces deux lettres en anglais apparaissent avec une probabilité de presque 100%. Pour deviner les informations manquantes, vous avez utilisé non seulement la probabilité d'apparition des lettres, mais également la probabilité conditionnelle associée aux deux lettres - la probabilité que le mot contienne la lettre «u» si l'on sait que la lettre «q» existe déjà. Notre cerveau utilise des probabilités conditionnelles lorsqu'il est nécessaire de corriger des erreurs dans la transmission d'informations - du texte flou sur une impression avec une cartouche épuisée, ou des mots mal distinguables dans un appel téléphonique bruyant.

En anglais, les probabilités conditionnelles peuvent être spécifiées jusqu'à neuf mots d'affilée. Si un mot manque, vous pouvez deviner de quel type de mot il s'agit. Si vous manquez deux mots d'affilée, vous pouvez toujours les restaurer à partir du contexte. Un petit exemple de phrase sans un seul mot: "Comment vous sentez-vous ___ aujourd'hui?". Il est facile de deviner que vous manquez. Considérons maintenant une phrase sans deux mots: "Comment ___ ___ vous-même aujourd'hui?" Il peut y avoir: "Comment se sent Innocent aujourd'hui?" Il peut y avoir d'autres options. De toute évidence, plus il manque de mots, plus il est difficile de les comprendre à partir du contexte, et moins leur probabilité conditionnelle. Pour la plupart des langues écrites de l'humanité, la probabilité conditionnelle disparaît lorsqu'environ neuf mots consécutifs sont manqués. S'il manque 10 mots, vous n'aurez aucune idée de ce que pourraient être ces mots. Dans le langage de la théorie de l'information, cela signifie que l'entropie du mot humain atteint le neuvième ordre.

Nous avons trouvé des probabilités conditionnelles similaires dans les systèmes de communication animale. Par exemple, nous avons enregistré les sons d'une baleine à bosse parlant dans le sud-est de l'Alaska avec Fred Sharp de l'Alaska Whale Foundation. Les baleines à bosse sont connues pour leurs chansons, qui sont généralement enregistrées lorsqu'elles s'approchent d'Hawaï pour se reproduire. En Alaska, leurs sons sont très différents: les sons destinés à conduire des poissons sur le net sont des glouglous et des cris sociaux, pas des chansons. Nous avons enregistré ces vocalisations en présence et en l'absence de bruit du bateau. Nous avons calculé dans quelle mesure l'océan fonctionne comme un statique dans une ligne téléphonique. Ensuite, nous avons utilisé la théorie de l'information pour quantifier combien de baleines auraient besoin pour ralentir leur vocalisation afin de recevoir des messages sans erreurs.

Comme prévu, en présence de bruit provenant du bateau, les baleines ont ralenti la vitesse de vocalisation, tout comme une personne ralentit une conversation téléphonique en présence de bruit. Mais ils n'ont ralenti que de 3/5 du montant qu'ils auraient théoriquement dû atteindre pour assurer la transmission des messages sans mauvaise interprétation. Comment ont-ils réussi à ralentir si légèrement alors que le bruit ambiant en demandait clairement plus? Nous y avons réfléchi pendant un certain temps, puis nous avons réalisé que la structure des règles dans leur système de communication était probablement telle que les deux cinquièmes restants du signal pouvaient être restaurés. Les baleines à bosse ont utilisé les probabilités conditionnelles de leur homologue de mots sonores. Ils n'avaient pas besoin de recevoir l'intégralité du message pour pouvoir remplir les espaces vides.

Nous avons trouvé la structure interne dans la communication des dauphins. La différence était que les dauphins avaient environ 50 signaux principaux et les baleines à bosse en avaient des centaines. Nous recueillons actuellement des informations pour déterminer quel est le degré d'entropie maximal dans un système de communication avec les baleines à bosse.

Pour tester la possibilité de notre approche pour séparer l'astrophysique des signaux raisonnables, nous sommes passés à des exemples de radioastronomie. Lorsque les astronomes Jocelyn Bell Burnel et Anthony Hewish ont découvert des pulsars stellaires en 1967, ils étaient surnommés «MZCH», c'est-à-dire «petits hommes verts» [LGM]. En raison de la périodicité claire de ces sources radio, certains scientifiques ont commencé à spéculer qu'elles pourraient être les balises des civilisations extraterrestres avancées. Avec l'aide de Simon Johnston de l'Australian National Radio Astronomy Society, nous avons analysé les impulsions

pulsar dans Sails et obtenu la pente Zipf de -0,3. Cela ne correspond à aucune des langues connues. De plus, nous n'avons trouvé pratiquement aucune structure de probabilité conditionnelle dans les signaux pulsar. Et en fait, on sait aujourd'hui que les pulsars sont les restes naturels des supernovae. Il s'avère que la théorie de l'information peut facilement distinguer un signal intelligent imaginaire d'une source naturelle.

Nous analysons actuellement les données micro-ondes obtenues à partir du réseau d'antennes Allen de l'Institut SETI, composé de 42 télescopes, visualisant dans la plage de 1 à 10 GHz. En plus du schéma habituel de recherche par ondes radioélectriques à bande étroite, nous commençons à appliquer des mesures issues de la théorie de l'information. Si, par exemple, nous trouvons des signaux obéissant à la loi de Zipf, cela nous incitera à continuer à travailler et à rechercher la structure syntaxique dans les signaux pour tenter de déterminer la complexité d'un message potentiel.

Pour transférer des connaissances, même une civilisation extraterrestre très avancée devra obéir aux règles de la théorie de l'information. Même si nous ne pouvons probablement pas déchiffrer un tel message en raison du manque de symboles communs (nous avons le même problème avec les baleines à bosse), nous pouvons avoir une idée de la complexité de leur système de communication - et, par conséquent, des processus de pensée. Si, par exemple, les probabilités conditionnelles du signal trouvé dans SETI sont du 20ème ordre, cela signifiera non seulement la nature artificielle du signal, mais aussi l'énorme complexité du langage par rapport à n'importe quel langage terrestre. Nous aurons une mesure quantitative de la complexité des processus de pensée qui transmettent des informations aux êtres extraterrestres.

Lawrence Doyle est directeur de l'Institut de métaphysique de la physique du Principle College, pc. Illinois, et organisateur du Quantum Astrophysics Group au SETI. Il était membre de la mission Kepler à la NASA et a dirigé l'équipe qui a découvert la première planète à orbite multiple (surnommée Tatooine).