Un groupe de chercheurs de Berkeley a publié deux vidéos cette année. Dans l'un d'eux, un cheval court derrière la clôture. Dans le second, elle obtient soudain un motif zébré noir et blanc. Le résultat n'est pas parfait, mais les bandes s'adaptent si clairement au cheval, comme si l'arbre généalogique de ces animaux était plongé dans le chaos. Une astuce similaire est un indicateur de la capacité évolutive des algorithmes d'apprentissage automatique à changer la réalité.

Certains autres chercheurs ont utilisé des réseaux de neurones pour

transformer des photos d'ours noirs en images crédibles de pandas, de pommes en oranges et de chats en chiens. Un utilisateur de Reddit a utilisé un autre algorithme d'apprentissage automatique pour éditer des vidéos porno et y a

inséré des visages de célébrités . La startup Lyrebird

synthétise un discours assez convaincant basé sur un enregistrement d'une minute de la voix d'une personne. Et les ingénieurs d'Adobe, développant la plateforme d'intelligence artificielle Sensei, introduisent

l'apprentissage automatique dans des outils innovants pour l'édition vidéo, photo et audio. Ces projets sont très différents dans leur origine et leurs objectifs, mais ils ont une chose en commun: ils synthétisent des images et des sons qui se révèlent étonnamment similaires aux vrais. Contrairement aux expériences précédentes, ces créations d'IA sont réalistes et semblent réalistes.

Les technologies qui sous-tendent ces changements nous pousseront bientôt vers de nouveaux domaines créatifs, augmentant les capacités des artistes contemporains et faisant des amateurs ordinaires des professionnels. Nous chercherons de nouvelles définitions du concept de créativité, qui élargiront son horizon et incluront les créations de machines. Mais ce boom aura un inconvénient. Une partie du contenu créé par l'intelligence artificielle sera utilisée pour tromper, générant la peur d'une avalanche sans fin de

fausses nouvelles . L'ancien débat sur la modification de l'image cédera la place à un nouveau - sur l'origine de tous les types de contenu, y compris le texte. Vous commencerez à vous demander: quel rôle les gens (le cas échéant) ont-ils joué dans la création de cet album / série / article?

Auparavant, il y avait deux façons de créer des fichiers audio ou vidéo similaires aux vrais. La première consiste à utiliser des caméras et des microphones pour enregistrer une scène de production. La seconde consiste à maximiser l'utilisation du talent humain, souvent pour beaucoup d'argent, pour créer une copie exacte. Désormais, les algorithmes d'apprentissage automatique offrent une troisième option, permettant à toute personne possédant des connaissances techniques minimales de modifier le contenu existant pour créer de nouveaux éléments.

La naissance de Vénus - version de Deep Dreams

La naissance de Vénus - version de Deep DreamsAu début, le contenu généré par les réseaux de neurones n'était pas orienté vers le réalisme. Deep Dreams de Google, publié en 2015, a été l'un des premiers exemples de l'apprentissage profond pour tamponner des paysages psychédéliques et des œuvres d'art grotesques aux yeux multiples. L'application à succès de 2016, Prisma, a utilisé l'apprentissage en profondeur pour améliorer les filtres photo, tels que le style des images avec des peintures Mondrian ou Munch. Cette technique est connue sous le nom de transfert de style: prenez le style d'une image (par exemple, «Scream») et appliquez-le à la deuxième image.

Maintenant, les algorithmes de transfert de style sont constamment améliorés. Prenons, par exemple, le

travail du laboratoire

de Kavita Bala de l'Université Cornell. Il montre comment l'apprentissage en profondeur peut transférer le style d'une photographie (une atmosphère nocturne scintillante) à l'image d'une métropole sombre - et tromper les critiques qui penseront que cet endroit est réel. Inspiré par le potentiel de l'intelligence artificielle pour reconnaître les propriétés esthétiques, le professeur Bala a cofondé

GrokStyle . Imaginez que vous aimez les oreillers décoratifs sur le canapé d'un ami ou une couverture dans un magazine. Montrez à l'algorithme GrokStyle cette image et il trouvera des images de choses dans le même style.

Le professeur Bala déclare: «Ce que j'aime dans ces technologies, c'est la manière dont elles démocratisent le design et le style. Je suis technologue: j'apprécie la beauté et le style, mais je ne peux même pas les créer de près. Et ce travail me permet de telles choses. Je suis également très heureux de pouvoir le mettre à la disposition des autres. Le fait que nous ne soyons pas doués dans ce domaine ne signifie pas que nous devons vivre dans un environnement ennuyeux. »

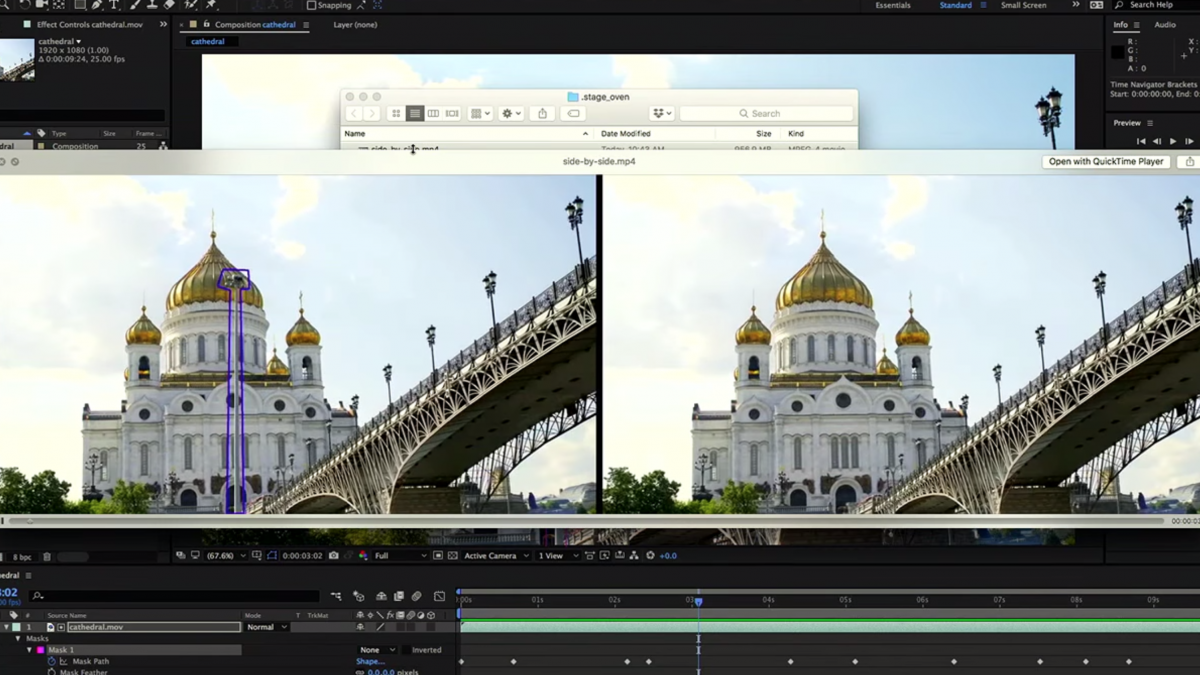

Chez Adobe, l'apprentissage automatique fait partie de la création de produits créatifs depuis plus d'une décennie, mais la société a récemment fait un grand pas en avant. En octobre, les ingénieurs travaillant sur Sensei ont présenté un outil de montage vidéo prometteur appelé Adobe Cloak. Il permet à l'utilisateur de retirer facilement, par exemple, un lampadaire d'un clip vidéo - une tâche qui serait terriblement pénible, même pour un éditeur expérimenté. Un autre projet, appelé Project Puppetron, applique un style artistique spécifique à la vidéo en temps réel. Il vous permet d'afficher une personne sous la forme d'une statue de bronze animée ou d'un personnage de dessin animé dessiné. «Vous pouvez simplement faire quelque chose devant la caméra et la transformer en animation en temps réel», explique John Brandt, scientifique principal et directeur d'Adobe Research.

L'apprentissage automatique rend ces projets possibles car il permet de distinguer les parties du visage et de voir la différence entre les arrière-plans avant et arrière mieux que les approches précédentes de la vision par ordinateur. Les outils Sensei permettent aux artistes de travailler non pas avec des matériaux, mais avec des concepts. "Photoshop fait un excellent travail de gestion des pixels, mais les gens essaient en fait de manipuler le contenu affiché par ces pixels", explique Brandt.

C'est une bonne partie de l'actualité. Lorsque les artistes n'ont plus besoin de passer du temps à dessiner des points individuels sur l'écran, leur productivité augmente. Selon Brandt, il est très heureux de la possibilité de l'émergence de nouvelles formes d'art et attend leur venue.

Démonstration d'Adobe Cloak

Démonstration d'Adobe CloakMais il n'est pas difficile d'imaginer comment cette explosion créative entraîne de très graves conséquences. Yanshun Yao, diplômé de l'Université de Chicago, a vu une fausse vidéo créée par AI et a décidé de lancer un projet explorant les dangers de l'apprentissage automatique. Dans la vidéo qu'il a vue, le Barack Obama généré a prononcé un discours. Yao voulait vérifier s'il était possible de lancer quelque chose de similaire avec du texte?

La structure du texte devrait être presque parfaite, de sorte que la plupart des lecteurs seront convaincus de son "origine humaine". Yao a commencé avec une tâche relativement simple: générer de fausses critiques pour Yelp et Amazon. Un tel texte ne peut comprendre que quelques phrases et les lecteurs ne s'attendent pas à un niveau élevé de maîtrise de la langue. Lui et ses collègues ont créé un

réseau de neurones, créant des textes sur le sujet de Yelp longueur de 5 phrases. Les critiques reçues comprenaient des déclarations telles que "Maintenant, c'est notre endroit préféré!" et "J'y suis allé avec mon frère, j'ai commandé des pâtes végétariennes - très savoureuses." De plus, Yao a demandé aux gens si ces textes étaient réels ou faux - et bien sûr, les gens se trompaient souvent.

Le coût de la rédaction de telles critiques varie de 10 $ à 50 $, et Yao affirme que ce n'est qu'une question de temps avant que quelqu'un essaie d'automatiser le processus en baissant les prix et en inondant le site de fausses critiques. Il a également exploré les capacités des réseaux de neurones à protéger Yelp contre les faux contenus - et a obtenu un certain succès. Son prochain objectif est de générer des articles crédibles.

Quant au contenu vidéo, la progression peut se déplacer encore plus rapidement. Hani Farid, un expert en détection de fausses photos et vidéos et professeur au Dartmouth College, s'inquiète de la rapidité avec laquelle le contenu viral se propage et de la longueur du processus de reconnaissance de son authenticité. Il admet que dans un proche avenir, il y aura une vidéo crédible où Donald Trump donne l'ordre d'une attaque nucléaire contre la Corée du Nord. Il deviendra viral et semera la panique - le même qu'il a

provoqué une émission de radio sur la «Guerre des mondes». «Je ne veux pas faire d'hypothèses hystériques, mais je ne pense pas que les craintes ne soient pas fondées», dit-il.

Cependant, les apparences générées par Trump marchent déjà sur le Web. Ils sont un produit de Lyrebird, une startup de synthétiseurs vocaux. Jose Sotelo, co-fondateur et PDG de l'entreprise, est convaincu que l'existence de cette technologie est inévitable, de sorte que lui et ses collègues continueront de la développer - sans oublier, bien sûr, l'éthique. Il est sûr que la meilleure défense pour aujourd'hui est de faire prendre conscience des possibilités de l'apprentissage automatique. Sotelo note: «Si vous voyez mes photos sur la lune, vous déciderez très certainement qu'elles sont faites dans un éditeur graphique. Mais si vous entendez un enregistrement audio où le meilleur ami parle de choses désagréables à votre sujet, vous serez probablement inquiet. Il s'agit véritablement d'une nouvelle technologie et elle présente à l'humanité de nouveaux défis. »

Il est peu probable que quelque chose puisse arrêter la vague de contenu généré par l'IA. Un scénario est possible dans lequel les fraudeurs et les politiciens malhonnêtes utiliseront la technologie pour créer des informations trompeuses.

Le côté positif est que le contenu généré par l'IA peut également fournir un énorme service à la société. Sotelo de Lyrebird rêve que sa technologie pourra retrouver la capacité de parler aux personnes qui ont perdu la voix à cause d'une sclérose latérale amyotrophique ou d'un cancer. Et la vidéo avec des chevaux et des zèbres, qui a été mentionnée au début, était un sous-produit du travail pour améliorer la vision des véhicules sans pilote. Le logiciel de ces machines est d'abord formé dans un environnement virtuel. Mais un monde comme Grand Theft Auto ressemble très éloigné à la réalité. L'algorithme de zébrification a été créé pour réduire l'écart entre l'environnement virtuel et le monde réel, et finalement rendre les véhicules sans pilote plus sûrs.