Armes autonomes - robots tueurs qui peuvent attaquer sans intervention humaine - c'est un outil très dangereux. Cela ne fait aucun doute. Comme indiqué dans sa

lettre ouverte à l'ONU, Ilon Musk, qui a signé sous lui, Mustava Suleiman [

co-fondateur de la société d'IA DeepMind / env. perev. ] et d'autres auteurs, les armes autonomes peuvent devenir "des armes d'intimidation, des armes que les tyrans et les terroristes peuvent utiliser contre une population innocente, des armes qui peuvent être piratées et utilisées de manière indésirable".

Mais cela ne signifie pas que l'ONU devrait introduire une interdiction préventive de poursuivre les recherches sur ces armes, comme le recommandent les auteurs de la lettre.

Premièrement, des outils parfois dangereux sont nécessaires pour atteindre des objectifs louables. Souvenez-vous du

génocide au Rwanda lorsque le monde est resté sans rien faire. Si des armes autonomes existaient en 1994, peut-être ne regarderions-nous pas de côté. Il semble probable que si le coût des interventions humanitaires ne pouvait être mesuré qu'avec de l'argent, il serait plus facile d'obtenir le soutien du public pour de telles interventions.

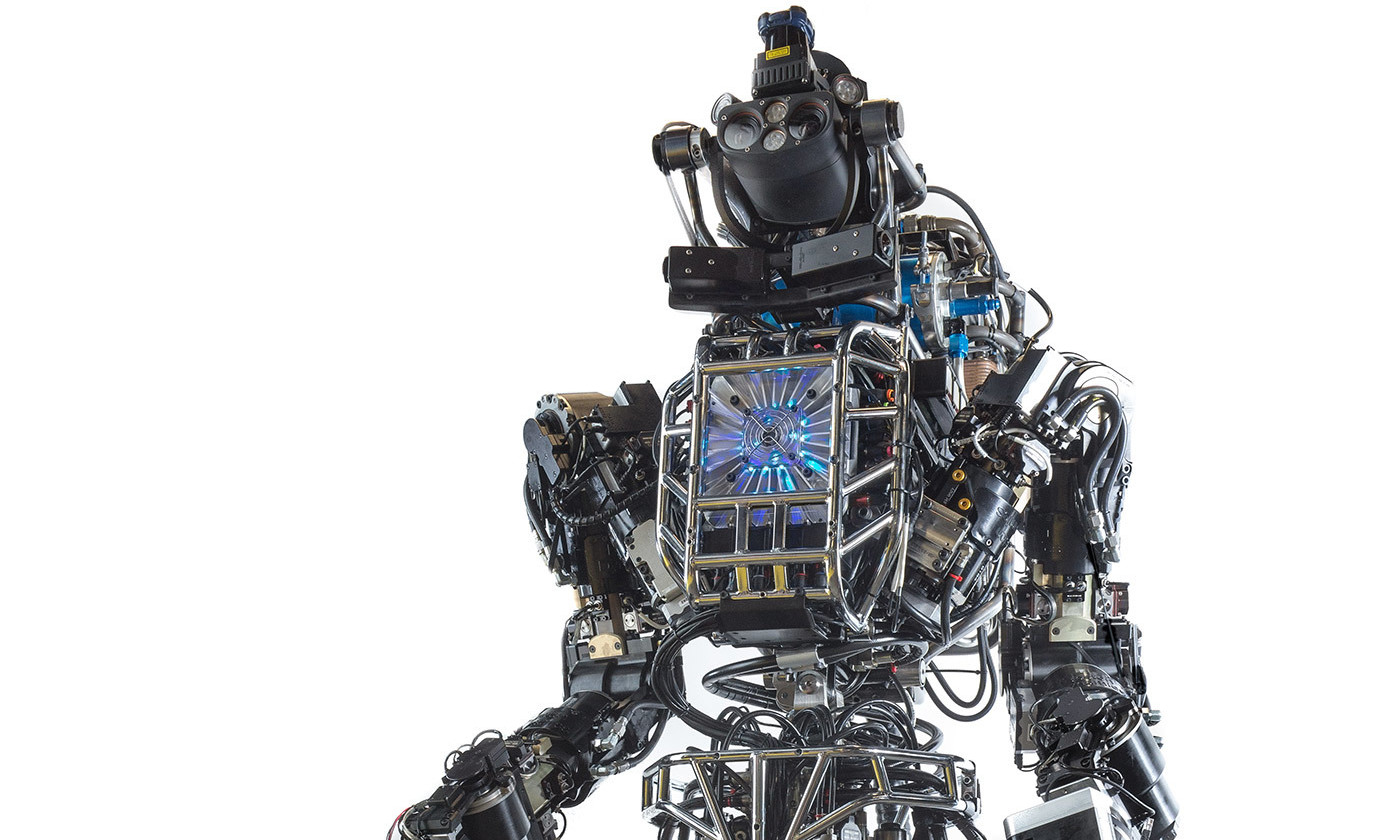

Deuxièmement, il est naïf de croire que nous pouvons profiter des avantages des récentes percées dans l'IA sans avoir à ressentir certaines de leurs lacunes. Supposons que l'ONU introduit une interdiction préventive de toute technologie d'armes autonomes. Nous supposons également - déjà assez optimistes - que toutes les armées du monde respecteront cette interdiction et annuleront le développement de programmes d'armes autonomes. Et même alors, nous devons encore nous en préoccuper. Un robot peut facilement être transformé en système d'arme autonome: au lieu de contourner les piétons, vous pouvez lui apprendre à les déplacer.

De manière générale, les technologies de l'IA sont extrêmement utiles et pénètrent déjà nos vies, même si parfois nous ne le voyons pas et ne pouvons pas le réaliser pleinement. Compte tenu de cette pénétration, il serait à courte vue de penser que l'abus de technologie pourrait être interdit simplement en interdisant le développement d'armes autonomes. Ce sont peut-être précisément les systèmes d'armes autonomes sophistiqués et fonctionnant de manière sélective développés par diverses armées du monde entier qui peuvent efficacement contrer les armes autonomes plus grossières qui sont faciles à développer en reprogrammant la technologie de l'IA apparemment pacifique, comme les mêmes robots.

De plus, l'idée d'une simple interdiction au niveau international donne une approche trop simplifiée de la prise en compte des armes autonomes. Un tel concept ne reconnaît pas la longue histoire des causes et des effets des actions et accords des différents pays entre eux et seuls, qui, à travers des milliers de petites actions et omissions, ont conduit au développement de ces technologies. Alors que le débat sur les armes autonomes se déroule principalement au niveau des Nations Unies, le citoyen moyen, le soldat ou le programmeur peut être pardonné de ne pas assumer d’obligations morales pour les dommages causés par les armes autonomes. Mais c'est une hypothèse très dangereuse, qui peut conduire à un désastre.

Toutes les personnes qui sont en quelque sorte liées aux technologies d'armes automatiques devraient faire preuve de diligence raisonnable, et chacun de nous doit soigneusement réfléchir à la contribution que son action ou son inaction apporte à la liste des dangers potentiels de cette technologie. Cela ne signifie pas que les pays et les agences internationales n'ont pas leur rôle important. Cela est souligné par le fait que si nous voulons éliminer le danger potentiel des armes automatiques, il est nécessaire de promouvoir l'éthique de la responsabilité personnelle, et cette propagande doit atteindre les niveaux les plus bas auxquels les décisions sont prises. Pour commencer, il est extrêmement important de parler en détail et complètement du développement des armes autonomes - y compris les conséquences des actions de tous ceux qui prennent des décisions à tous les niveaux.

Enfin, il est parfois avancé qu'une arme autonome est dangereuse non pas parce que cet outil est dangereux en soi, mais parce qu'il peut devenir indépendant et commencer à agir dans son propre intérêt. Il s'agit d'une erreur erronée et, en outre, l'interdiction de développer des armes autonomes n'aidera pas à prévenir ce danger. Si la superintelligence est une menace pour l'humanité, nous devons de toute urgence chercher des moyens de contrer efficacement cette menace, et ce, indépendamment du fait que la technologie des armes automatiques sera développée davantage.

Lettre ouverte à la Convention des Nations Unies sur certaines armes classiques

Alors que certaines entreprises créent des technologies liées à l'intelligence artificielle et à la robotique qui peuvent être redirigées vers le développement d'armes autonomes, nous nous sentons particulièrement responsables de sonner l'alarme. Nous saluons chaleureusement la décision de la conférence des Nations Unies sur l'adoption de la "Convention sur des types spécifiques d'armes classiques" concernant la nomination d'un

groupe d'experts gouvernementaux (Groupe d'experts gouvernementaux, GGE) sur les systèmes d'armes autonomes létales. Beaucoup de nos chercheurs et ingénieurs sont prêts à fournir des conseils technologiques pour résoudre ce problème.

Nous nous félicitons de la nomination de l'Ambassadeur Amandip Singh Gill de l'Inde à la présidence du GGE. Nous demandons aux Hautes Parties contractantes participant au GGE de travailler activement à trouver des moyens de prévenir ce type de course aux armements, de protéger les citoyens contre leur utilisation abusive et d'éviter les effets déstabilisateurs de ces technologies. Nous regrettons que la première réunion du GGE, prévue pour août 2017, ait été annulée en raison du fait que certains pays n'ont pas apporté de contribution financière à l'ONU. Nous exhortons les Hautes Parties contractantes à redoubler d'efforts lors de la première réunion du GGE qui se tiendra en novembre.

Des armes autonomes détaillées menacent de provoquer une troisième révolution dans les affaires militaires. Après son développement, il permettra de conduire des conflits militaires à une échelle sans précédent plus tôt, et dans des délais plus courts que ce qu'une personne peut percevoir. Il peut devenir une arme d'intimidation, une arme que les tyrans et les terroristes peuvent utiliser contre une population innocente, une arme qui peut être piratée et utilisée pour fonctionner de manière indésirable. Il nous reste peu de temps. Après avoir ouvert cette boîte de Pandore, il sera difficile de la fermer. Par conséquent, nous demandons aux Hautes Parties contractantes de trouver des moyens de nous protéger tous contre ces menaces.