Le bureau d'Intel à Nijni Novgorod, entre autres, développe des algorithmes de vision par ordinateur basés sur des réseaux de neurones profonds. Beaucoup de nos algorithmes sont publiés dans le référentiel

Open Model Zoo . La formation aux modèles nécessite un grand nombre de données balisées. Théoriquement, il existe de nombreuses façons de les préparer, mais la disponibilité de logiciels spécialisés accélère ce processus à plusieurs reprises. Ainsi, afin d'améliorer l'efficacité et la qualité du balisage, nous avons développé notre propre outil -

Computer Vision Annotation Tool (CVAT) .

Bien sûr, sur Internet, vous pouvez trouver beaucoup de données annotées, mais il y a quelques problèmes. Par exemple, de nouvelles tâches surgissent constamment pour lesquelles il n'existe tout simplement pas de telles données. Un autre problème est que toutes les données ne conviennent pas au développement de produits commerciaux, en raison de leurs accords de licence. Ainsi, en plus du développement et de la formation d'algorithmes, notre activité comprend également le balisage de données. Il s'agit d'un processus assez long et long, qui serait déraisonnable à mettre sur les épaules des développeurs. Par exemple, pour former l'un de nos algorithmes, environ 769 000 objets ont été balisés pendant plus de 3 100 heures-homme.

Il existe deux solutions au problème:

- La première consiste à transférer les données de balisage à des sociétés tierces, avec la spécialisation appropriée. Nous avons vécu une expérience similaire. Il convient de noter le processus complexe de validation et de re-partitionnement des données, ainsi que la présence de la bureaucratie.

- La seconde, plus pratique pour nous, est la création et le support de notre propre équipe d'annotation. La commodité réside dans la capacité à définir rapidement de nouvelles tâches, à gérer l'avancement de leur mise en œuvre et à faciliter l'équilibre entre prix et qualité. De plus, il est possible d'implémenter des algorithmes d'automatisation personnalisés et d'améliorer la qualité du balisage.

Initialement, l'outil d'annotation de vision par ordinateur a été développé spécifiquement pour notre équipe d'annotation.

Bien sûr, notre objectif n'était pas de créer la «15e norme». Dans un premier temps, nous avons utilisé une solution prête à l'emploi -

Vatic , mais dans le processus, les équipes d'annotation et d'algorithmique ont présenté de nouvelles exigences, dont la mise en œuvre a finalement conduit à une réécriture complète du code du programme.

Plus loin dans l'article:

- Informations générales (fonctionnalité, applications, avantages et inconvénients de l'outil)

- Histoire et évolution (une courte histoire sur la façon dont CVAT a vécu et développé)

- Périphérique interne (description de l'architecture de haut niveau)

- Directions de développement (un peu sur les objectifs que j'aimerais atteindre et les moyens possibles pour les atteindre)

Informations générales

L'outil d'annotation de vision par ordinateur (CVAT) est un outil open source pour le balisage d'images et de vidéos numériques. Sa tâche principale est de fournir à l'utilisateur des moyens pratiques et efficaces de marquer les ensembles de données. Nous créons CVAT en tant que service universel qui prend en charge différents types et formats de balisage.

Pour les utilisateurs finaux, CVAT est une application Web basée sur un navigateur. Il prend en charge divers scénarios de travail et peut être utilisé à la fois pour le travail personnel et en équipe. Les principales tâches de l'apprentissage automatique avec un enseignant dans le domaine du traitement d'image peuvent être divisées en trois groupes:

- Détection d'objets

- Classification d'image

- Segmentation d'image

La CVAT convient à tous ces scénarios.

Avantages:- Manque d'installation par les utilisateurs finaux. Pour créer une tâche ou annoter des données, ouvrez simplement un lien spécifique dans le navigateur.

- La capacité de travailler ensemble. Il est possible de mettre la tâche à la disposition du public et de paralléliser le travail sur celle-ci.

- Facile à déployer. L'installation de CVAT sur le réseau local est un couple de commandes via l'utilisation de Docker .

- Automatisation du processus de balisage. L'interpolation, par exemple, vous permet d'obtenir un balisage sur de nombreuses images, avec un travail réel uniquement sur certaines images clés.

- L'expérience des professionnels. L'outil a été développé avec la participation d'annotations et de plusieurs équipes algorithmiques.

- La capacité à s'intégrer. CVAT peut être intégré dans une plateforme plus large. Par exemple, Onepanel .

- Prise en charge facultative de divers outils:

- Deep Learning Deployment Toolkit (composant faisant partie d'OpenVINO)

- API de détection d'objets Tensorflow (API TF OD)

- Système d'analyse ELK (Elasticsearch + Logstash + Kibana)

- NVIDIA CUDA Toolkit

- Prise en charge de divers scénarios d'annotation.

- Open source sous une licence MIT simple et gratuite.

Inconvénients:- Prise en charge limitée du navigateur. Les performances de la partie client sont garanties uniquement dans le navigateur Google Chrome. Nous ne testons pas CVAT dans d'autres navigateurs, mais théoriquement, l'outil peut fonctionner dans Opera, Yandex Browser et autres avec le moteur Chromium.

- Le système de tests automatiques n'a pas été développé. Tous les contrôles de santé sont effectués manuellement, ce qui ralentit considérablement le développement. Cependant, nous travaillons déjà sur une solution à ce problème en collaboration avec les étudiants de l'UNN eux. Lobachevsky dans le cadre du projet IT Lab .

- Aucune documentation de code source disponible. S'impliquer dans le développement peut être assez difficile.

- Limitations de performances. Avec les demandes croissantes sur le volume de balisage, nous avons été confrontés à divers problèmes, tels que la limitation du Chrome Sandbox à l'utilisation de la RAM.

Bien entendu, ces listes ne sont pas exhaustives, mais contiennent des dispositions de base.

Comme mentionné précédemment, CVAT prend en charge un certain nombre de composants supplémentaires. Parmi eux:

Deep Learning Deployment Toolkit dans le cadre de l'

OpenVINO Toolkit - est utilisé pour accélérer le lancement du modèle d'API TF OD en l'absence d'un GPU. Nous travaillons sur quelques autres utilisations utiles de ce composant.

API Tensorflow Object Detection - utilisée pour marquer automatiquement les objets. Par défaut, nous utilisons le modèle Faster RCNN Inception Resnet V2, formé sur

COCO (80 classes), mais il ne devrait y avoir aucune difficulté à connecter d'autres modèles.

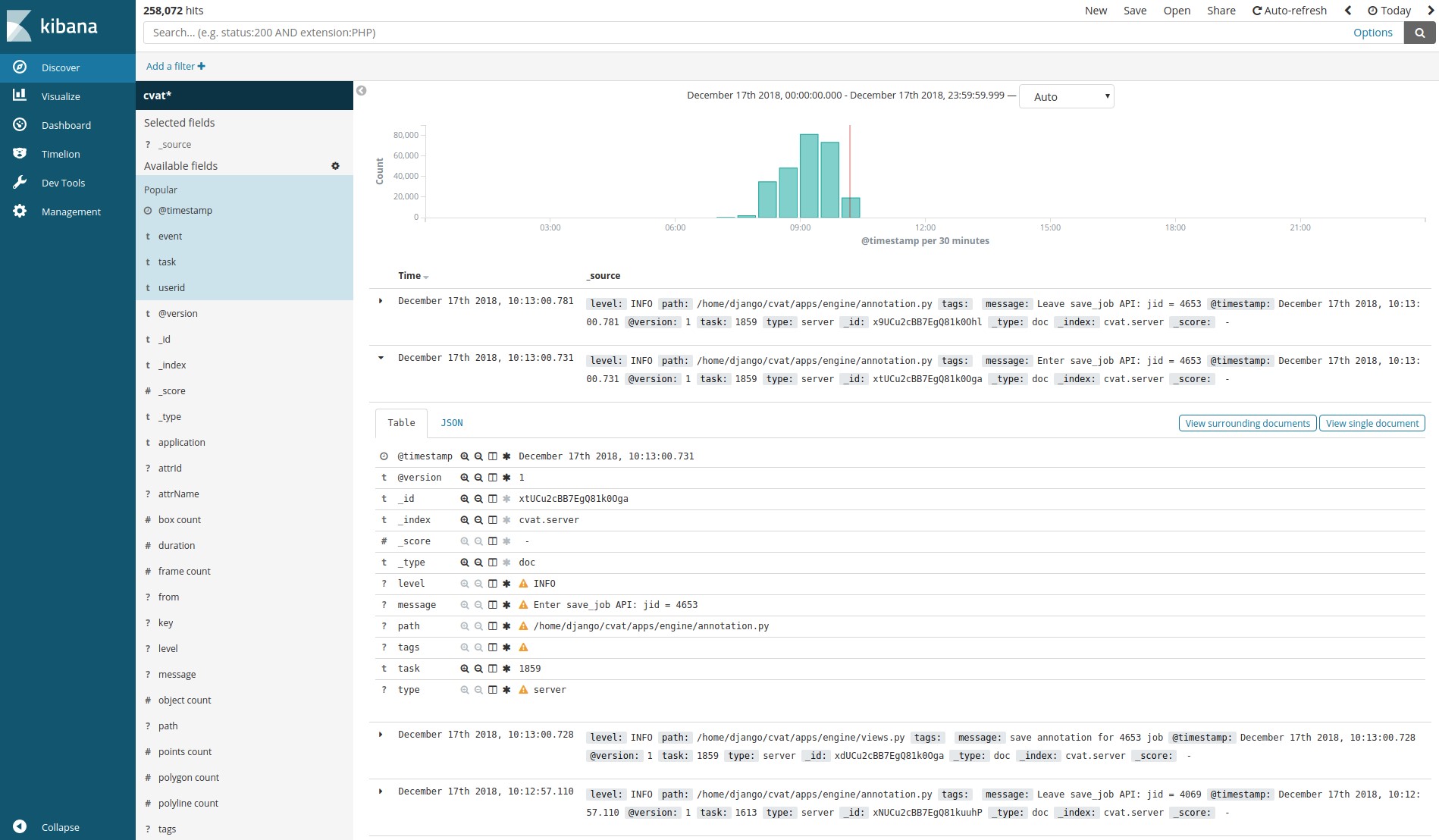

Logstash, Elasticsearch, Kibana - vous permettent de visualiser et d'analyser les journaux accumulés par les clients. Cela peut être utilisé, par exemple, pour surveiller le processus de balisage ou rechercher des erreurs et les causes de leur occurrence.

NVIDIA CUDA Toolkit

NVIDIA CUDA Toolkit - un ensemble d'outils pour effectuer des calculs sur le processeur graphique (GPU). Il peut être utilisé pour accélérer la mise en page automatique avec l'API TF OD ou dans d'autres modules complémentaires personnalisés.

Balisage des données

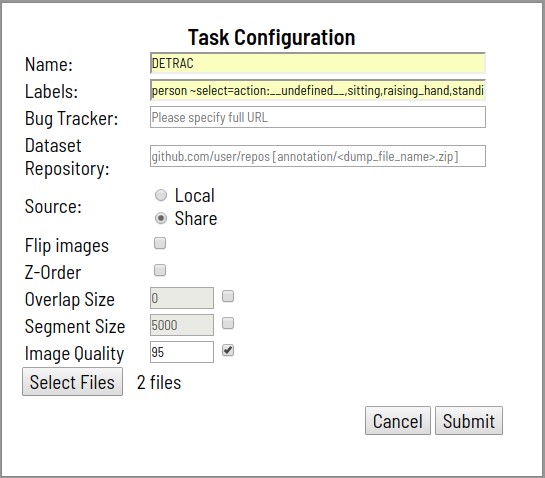

- Le processus commence par l'énoncé du problème de la mise en page. La mise en scène comprend:

- Spécification d'un nom de tâche

- Énumération des classes à baliser et de leurs attributs

- Spécification des fichiers à télécharger

- Les données sont téléchargées à partir du système de fichiers local ou d'un système de fichiers distribué monté dans un conteneur

- Une tâche peut contenir une archive avec des images, une vidéo, un ensemble d'images et même une structure de répertoire avec des images lors du téléchargement via le stockage distribué

- Définissez éventuellement:

- Lien vers les spécifications de balisage détaillées, ainsi que toute autre information supplémentaire (Bug Tracker)

- Lien vers un référentiel Git distant pour stocker des annotations (référentiel de jeux de données)

- Faire pivoter toutes les images de 180 degrés (Flip Images)

- Prise en charge des couches pour les tâches de segmentation (Z-Order)

- Taille de segment Une tâche téléchargeable peut être divisée en plusieurs sous-tâches pour un travail parallèle

- Zone d'intersection de segment (chevauchement). Utilisé en vidéo pour fusionner des annotations dans différents segments

- Niveau de qualité lors de la conversion d'images (Qualité d'image)

- Après avoir traité la demande, la tâche créée apparaîtra dans la liste des tâches.

- Chacun des liens de la section Emplois correspond à un segment. Dans ce cas, la tâche n'était pas segmentée auparavant. Un clic sur l'un des liens ouvre la page de balisage.

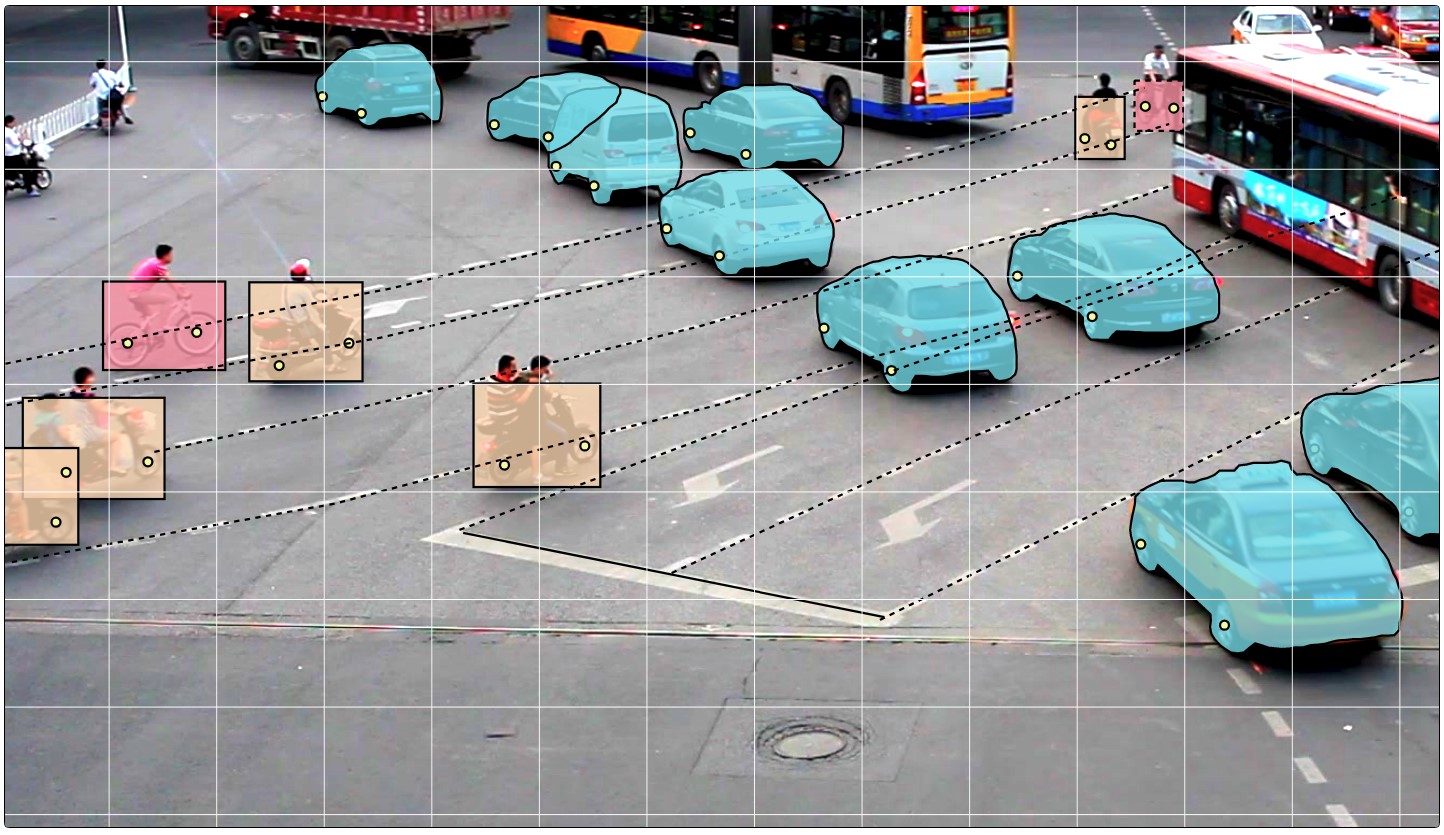

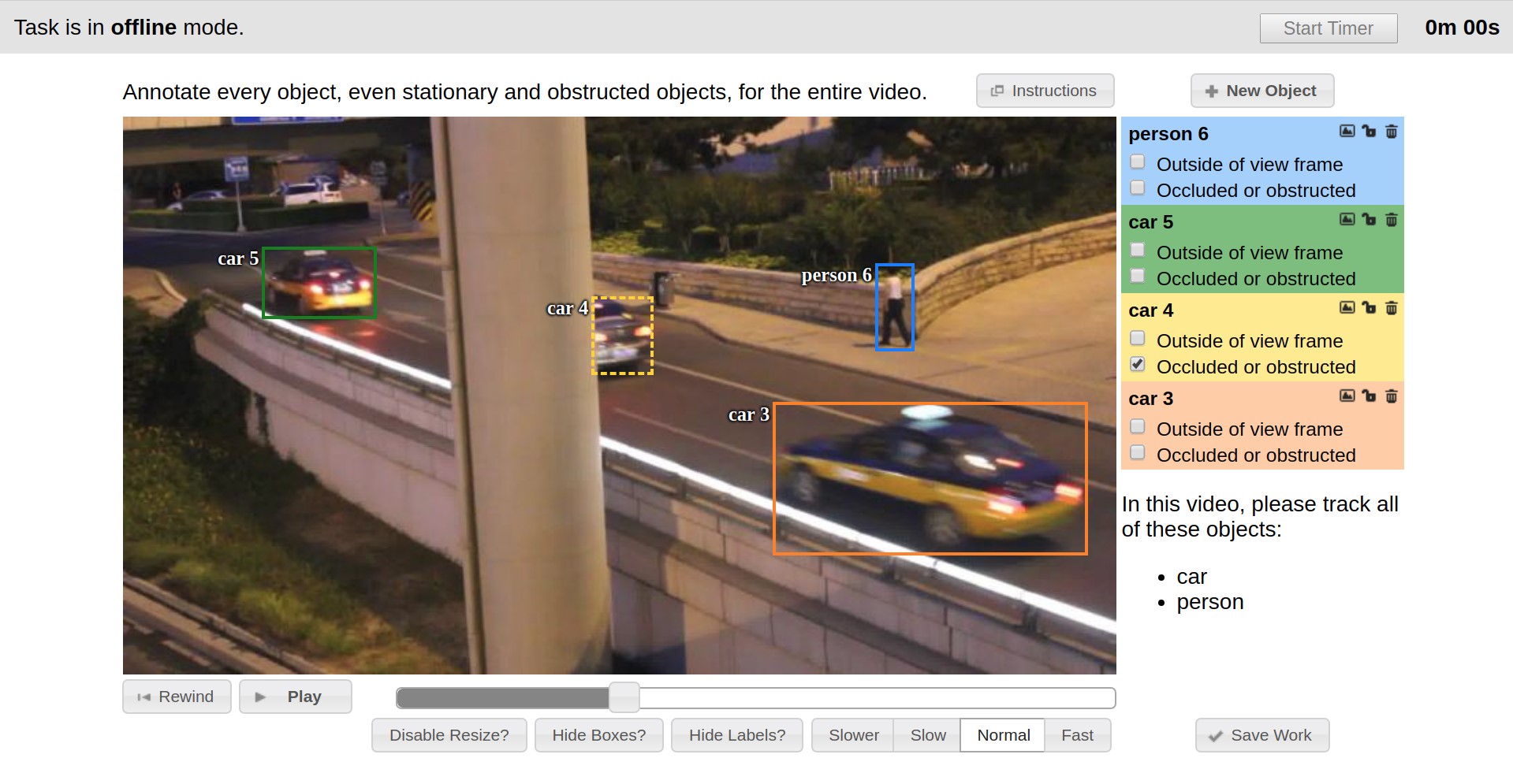

- Ensuite, les données sont directement balisées. Les rectangles, les polygones (principalement pour les tâches de segmentation), les polylignes (peuvent être utiles, par exemple, pour le marquage routier) et de nombreux points (par exemple, le marquage des repères de face ou l'estimation de la pose) sont fournis comme primitives.

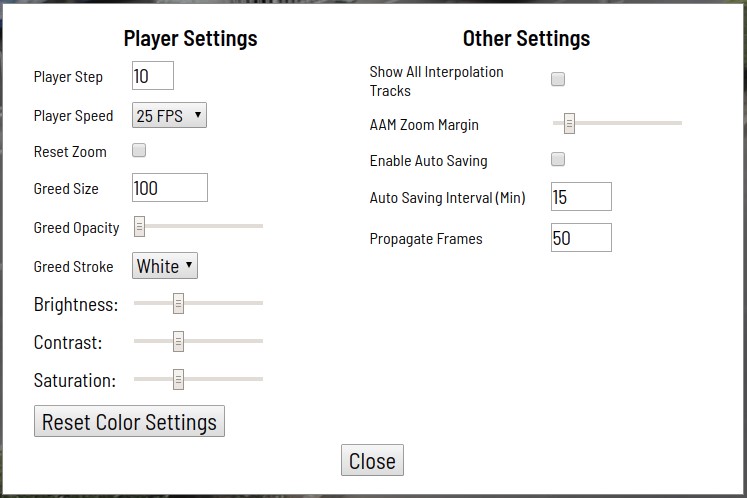

Divers outils d'automatisation sont également disponibles (copie, multiplication vers d'autres images, interpolation, marquage préliminaire avec TF OD API), paramètres visuels, nombreuses touches de raccourci, recherche, filtrage et autres fonctionnalités utiles. Dans la fenêtre des paramètres, vous pouvez modifier un certain nombre de paramètres pour un travail plus confortable.

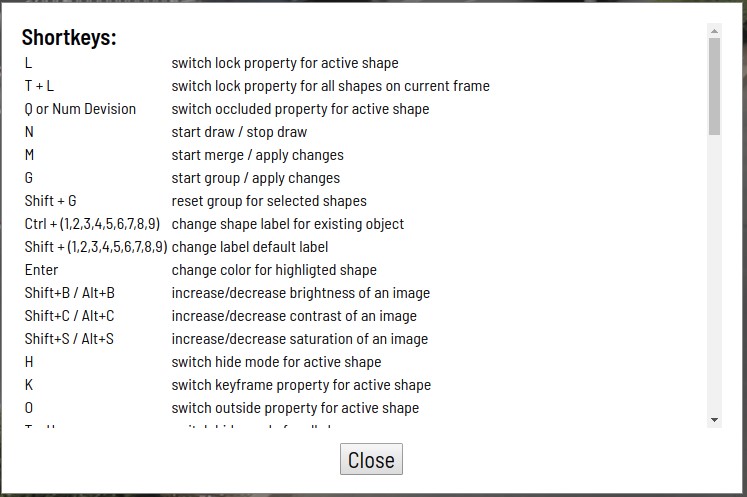

La boîte de dialogue d'aide contient de nombreux raccourcis clavier pris en charge et quelques autres conseils.

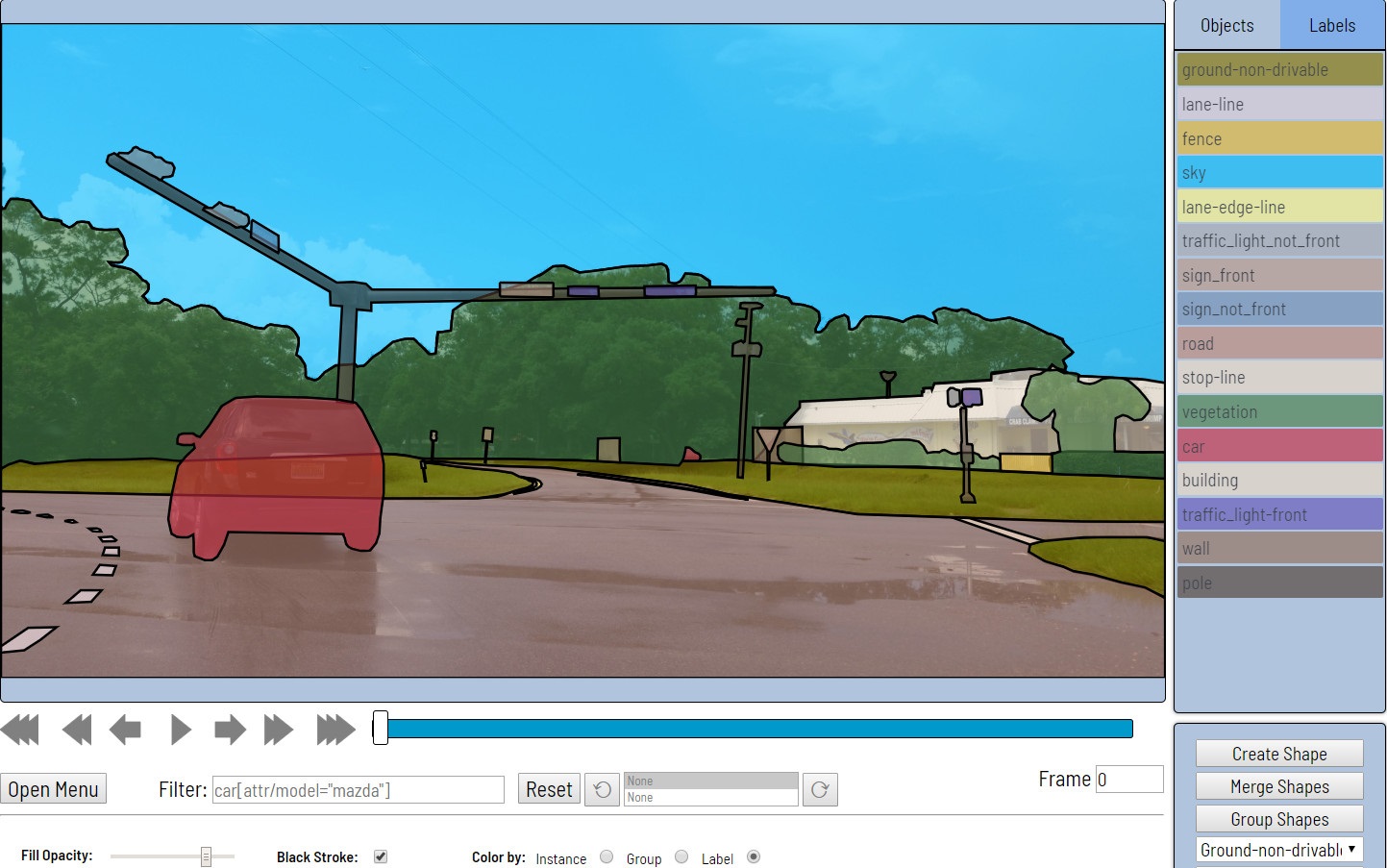

Le processus de balisage peut être vu dans les exemples ci-dessous.

CVAT peut interpoler linéairement des rectangles et des attributs entre des images clés dans une vidéo. Pour cette raison, l'annotation sur l'ensemble de cadres s'affiche automatiquement.

Le mode d'annotation d'attribut a été développé pour le scénario de classification, ce qui vous permet d'accélérer l'annotation d'attributs en concentrant le balisage sur une propriété spécifique. De plus, le balisage se produit ici grâce à l'utilisation de "touches de raccourci".

Les polygones prennent en charge les scripts de segmentation sémantique et de segmentation d'instance. Différents paramètres visuels facilitent le processus de validation.

- Recevoir une annotation

Le fait d'appuyer sur le bouton «Dump Annotation» lance le processus de préparation et de chargement des résultats de balisage dans un seul fichier. Un fichier d'annotation est un fichier .xml spécifié qui contient certaines métadonnées de tâche et l'annotation entière. Le balisage peut être téléchargé directement dans le référentiel Git, si ce dernier était connecté lors de la création de la tâche.

Histoire et évolution

Au début, nous n'avions pas d'unification, et chaque tâche de balisage a été réalisée avec ses propres outils, principalement écrits en C ++ à l'aide de la

bibliothèque OpenCV . Ces outils ont été installés localement sur les machines des utilisateurs finaux, il n'y avait pas de mécanisme de partage des données, un pipeline commun pour définir et marquer les tâches, beaucoup de choses devaient être faites manuellement.

Le point de départ de l'histoire de la CVAT peut être considéré fin 2016, lorsque le

Vatican a été présenté comme un outil de mise en page, dont l'interface est présentée ci-dessous. Vatic était open source et a introduit de grandes idées générales, telles que l'interpolation du balisage entre les images clés dans une architecture d'application vidéo ou client-serveur. Cependant, en général, il fournissait une fonctionnalité de balisage plutôt modeste, et nous avons fait beaucoup de travail par nous-mêmes.

Ainsi, par exemple, pour les six premiers mois, la possibilité d'annoter des images a été mise en œuvre, des attributs utilisateurs d'objets ont été ajoutés, une page a été développée avec une liste de tâches existantes et la possibilité d'en ajouter de nouvelles via l'interface Web.

Au cours du second semestre 2017, nous avons introduit l'API de détection d'objets Tensorflow comme méthode d'obtention d'un balisage préliminaire. Il y a eu de nombreuses améliorations mineures au client, mais à la fin nous avons été confrontés au fait que la partie client a commencé à fonctionner très lentement. Le fait était que la taille des tâches augmentait, le temps de leur ouverture augmentait proportionnellement au nombre de trames et de données marquées, l'interface utilisateur ralentissait en raison de la présentation inefficace des objets marqués, les progrès étaient souvent perdus au cours des heures de travail. La productivité a principalement fléchi sur les tâches avec des images, car la fondation de l'architecture de cette époque a été initialement conçue pour fonctionner avec la vidéo. Il y avait un besoin d'un changement complet de l'architecture client, avec lequel nous avons réussi à faire face. La plupart des problèmes de performances à ce moment-là avaient disparu. L'interface Web est devenue beaucoup plus rapide et plus stable. Le marquage de tâches plus importantes est devenu possible. Au cours de la même période, on a tenté d'introduire des tests unitaires pour assurer, dans une certaine mesure, l'automatisation des vérifications lors des modifications. Cette tâche n'a pas été résolue avec autant de succès. Nous avons configuré QUnit, Karma, Headless Chrome dans le conteneur Docker, écrit quelques tests, lancé tout cela sur CI. Cependant, une énorme partie du code est restée, et reste toujours, découverte par des tests. Une autre innovation a été un système de journalisation des actions des utilisateurs avec recherche et visualisation ultérieures basées sur ELK Stack. Il vous permet de surveiller le processus des annotateurs et de rechercher des scénarios d'action qui conduisent à des exceptions logicielles.

Au premier semestre 2018, nous avons étendu nos fonctionnalités client. Le mode d'annotation d'attributs a été ajouté, qui implémente un script efficace pour marquer les attributs, dont nous avons emprunté l'idée à nos collègues et généralisé; Vous pouvez maintenant filtrer les objets en fonction d'un certain nombre de signes, connecter un stockage commun pour télécharger des données lors de la définition des tâches en les visualisant via un navigateur, et bien d'autres. Les tâches sont devenues plus volumineuses et des problèmes de performances ont recommencé à se poser, mais cette fois, la partie serveur était le goulot d'étranglement. Le problème avec Vatic était qu'il contenait beaucoup de code auto-écrit pour des tâches qui pourraient être résolues plus facilement et plus efficacement en utilisant des solutions prêtes à l'emploi. Nous avons donc décidé de refaire le côté serveur. Nous avons choisi Django comme infrastructure de serveur, en grande partie en raison de sa popularité et de la disponibilité de nombreuses choses, comme on dit, prêtes à l'emploi. Après la modification de la partie serveur, alors qu'il ne restait plus rien de Vatic, nous avons décidé que nous avions déjà fait pas mal de travail, qui peut être partagé avec la communauté. Il a donc été décidé de passer à l'open source. Obtenir la permission pour cela au sein d'une grande entreprise est un processus plutôt épineux. Il existe une grande liste d'exigences pour cela. Y compris, il fallait trouver un nom. Nous avons esquissé des options et mené une série d'enquêtes auprès de nos collègues. En conséquence, notre outil interne a été nommé CVAT, et le 29 juin 2018, le code source a été publié sur

GitHub dans l'organisation OpenCV sous la licence MIT et avec la version initiale 0.1.0. La poursuite du développement a eu lieu dans un référentiel public.

Fin septembre 2018, la version majeure 0.2.0 est sortie. Il y a eu beaucoup de petits changements et corrections, mais l'objectif principal était de prendre en charge de nouveaux types d'annotations. Ainsi, un certain nombre d'outils pour marquer et valider la segmentation sont apparus, ainsi que la possibilité d'annoter avec des polylignes ou des points.

La prochaine version, tout comme un cadeau de Noël, est prévue pour le 31 décembre 2018. Les points les plus importants ici sont l'intégration facultative de la boîte à outils de déploiement Deep Learning dans le cadre d'OpenVINO, qui est utilisée pour accélérer le lancement de l'API TF OD en l'absence d'une carte graphique NVIDIA; système d'analyse des journaux d'utilisateurs qui n'était pas disponible auparavant dans la version publique; nombreuses améliorations côté client.

Nous avons résumé l'historique de la CVAT à ce jour (décembre 2018) et passé en revue les événements les plus importants. Vous pouvez toujours en savoir plus sur l'historique des modifications dans le

journal des modifications.

Dispositif interne

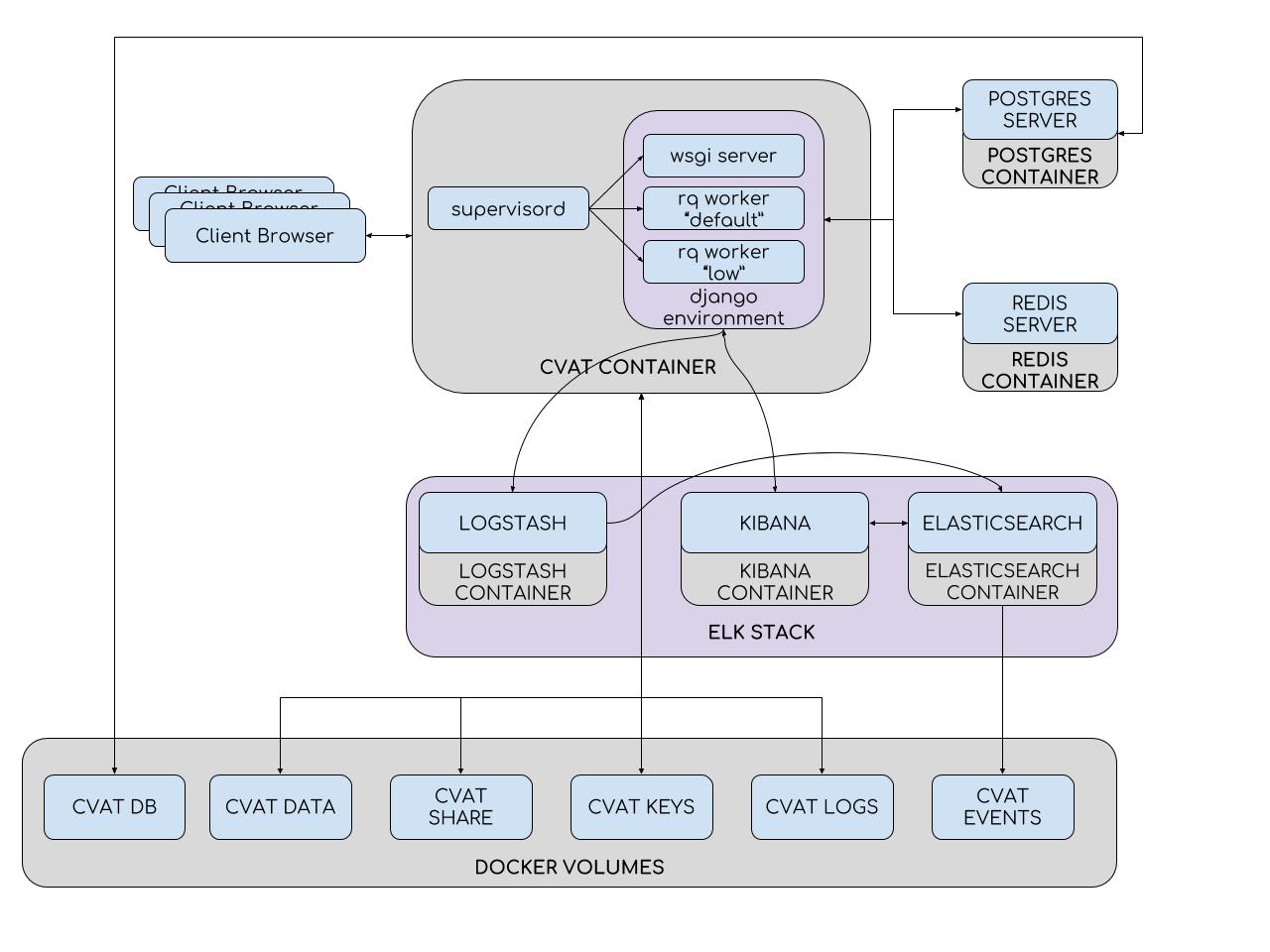

Pour simplifier l'installation et le déploiement, CVAT utilise des conteneurs Docker. Le système se compose de plusieurs conteneurs. Un processus de supervision est exécuté dans le conteneur CVAT, qui génère plusieurs processus Python dans l'environnement Django. L'un d'eux est le serveur wsgi, qui gère les demandes des clients. D'autres processus, rq workers, sont utilisés pour traiter les «longues» tâches des files d'attente Redis: par défaut et faible. Ces tâches incluent celles qui ne peuvent pas être traitées dans une seule demande utilisateur (définition d'une tâche, préparation d'un fichier d'annotation, balisage avec TF OD API, etc.). Le nombre de travailleurs peut être configuré dans le fichier de configuration de supervord.

L'environnement Django interagit avec deux serveurs de base de données. Le serveur Redis stocke l'état des files d'attente de tâches et la base de données CVAT contient toutes les informations sur les tâches, les utilisateurs, les annotations, etc. PostgreSQL (et SQLite 3 en cours de développement) est utilisé comme SGBD pour CVAT. Toutes les données sont stockées sur une partition enfichable (volume cvat db). Les sections sont utilisées lorsque cela est nécessaire pour éviter la perte de données lors de la mise à jour du conteneur. Ainsi, les éléments suivants sont montés dans le conteneur CVAT:

- Section avec vidéo et images (volume de données cvat)

- Section avec clés (volume des clés cvat)

- Section avec journaux (volume de journaux cvat)

- Stockage de fichiers partagé (volume partagé cvat)

Le système d'analyse se compose d'Elasticsearch, Logstash et Kibana emballés dans des conteneurs Docker. Lors de l'enregistrement du travail sur le client, toutes les données, y compris les journaux, sont transférées vers le serveur. Le serveur, à son tour, les envoie à Logstash pour filtrage. De plus, il est possible d'envoyer automatiquement des notifications par e-mail en cas d'erreur. Ensuite, les journaux tombent dans Elasticsearch. Ce dernier les enregistre sur une partition enfichable (volume d'événements cvat). Ensuite, l'utilisateur peut utiliser l'interface Kibana pour afficher les statistiques et les journaux. Dans le même temps, Kibana interagira activement avec Elasticsearch.

Au niveau source, CVAT comprend de nombreuses applications Django:

- authentification - authentification des utilisateurs dans le système (de base et LDAP)

- moteur - une application clé (modèles de base de données de base; chargement et enregistrement de tâches; chargement et déchargement d'annotations; interface client de balisage; interface serveur pour créer, modifier et supprimer des tâches)

- tableau de bord - interface client pour créer, modifier, rechercher et supprimer des tâches

- documentation - affichage de la documentation utilisateur dans l'interface client

- tf_annotation - annotation automatique avec l'API de détection d'objets Tensorflow

- log_viewer - envoi de journaux du client à Logstash lors de l'enregistrement d'une tâche

- log_proxy - Connexion proxy CVAT → Kibana

- git - Intégration du référentiel Git pour le stockage des annotations

Nous nous efforçons de créer un projet avec une structure flexible. Pour cette raison, les applications facultatives n'ont pas d'intégration de code dur. Malheureusement, bien que nous ne disposions pas d'un prototype idéal du système de plug-in, mais progressivement, avec le développement de nouvelles applications, la situation ici s'améliore.

La partie client est implémentée sur des modèles JavaScript et Django. JavaScript , , - ( ) model-view-controller. , (, , ) , . ( - UI), (, , : , , models, views controllers).

open source, . , . . , CVAT. , , . :

- CVAT , , , , . UI .

- . , .

- , . , .

- . deep learning , . , Deep Learning Deployment Toolkit OpenVINO - . , . , .

- demo- CVAT, , , . demo- Onepanel, CVAT .

- Amazon Mechanical Turk CVAT . SDK .

, . , , . open source . – , .

, PR . , ,

Gitter . , ! !

Les références