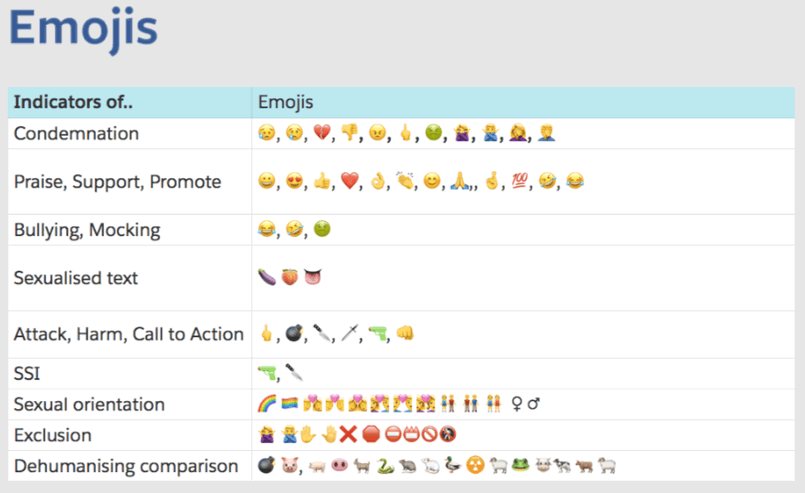

Le manuel explique quelles émoticônes peuvent être considérées comme des menaces ou, dans le contexte de groupes spécifiques, pour inciter à la haine.

Le manuel explique quelles émoticônes peuvent être considérées comme des menaces ou, dans le contexte de groupes spécifiques, pour inciter à la haine.Sous le feu des critiques, Facebook est contraint de prendre des mesures pour modérer le contenu. Mais cette tâche n'est pas aussi simple qu'il y paraît. Les médias ont un manuel interne pour les modérateurs de Facebook: ce sont plus de 1400 (!) Pages d'instructions, parfois très difficiles à comprendre,

écrit le NY Times .

Aujourd'hui, les politiciens et les organisations publiques accusent le réseau social d'incitation à la haine et à la désinformation. Pour Facebook, il s'agit principalement d'un problème financier, car de telles accusations créent un arrière-plan négatif et peuvent nuire au cours de l'action, ce qui signifie le bien-être des propriétaires et des employés de l'entreprise.

Facebook, qui gagne environ 5 milliards de dollars par trimestre, devrait démontrer à tous qu'il prend au sérieux la lutte contre les contenus malveillants. Mais comment suivre des milliards de messages par jour dans plus de 100 langues, tout en continuant d'élargir la base d'utilisateurs, qui est le fondement de l'entreprise? La décision de l'entreprise: un réseau de modérateurs guidés par un labyrinthe de diapositives PowerPoint expliquant le contenu interdit.

«Chaque mardi matin, plusieurs dizaines d'employés de Facebook se réunissent pour le petit déjeuner afin d'élaborer de nouvelles règles et de discuter de ce que deux milliards d'utilisateurs du site sont autorisés à dire», écrit le

NY Times . «Sur la base des résultats des réunions, les règles pertinentes sont envoyées à plus de 7500 modérateurs à travers le monde. Le journal compte plus de 1 400 pages de règlements. L'information a été fournie par l'un des employés qui est préoccupé par la modération excessive et trop d'erreurs que l'entreprise fait lors de la modération du contenu.

L'examen des documents a révélé de nombreuses lacunes, préjugés et erreurs évidentes. De toute évidence, les règles diffèrent selon les langues et les pays, de sorte que le discours de haine peut prospérer dans certaines régions et être inutilement supprimé dans d'autres. Par exemple, une fois que les modérateurs ont été invités à retirer les appels à la collecte de fonds pour les victimes du volcan en Indonésie, parce que l'un des organisateurs de la collecte de fonds était sur la liste noire des groupes Facebook interdits. En Inde, on a dit à tort aux modérateurs de supprimer les commentaires critiquant la religion. Au Myanmar, le groupe extrémiste a continué d'être actif pendant plusieurs mois en raison d'une erreur dans la documentation de Facebook.

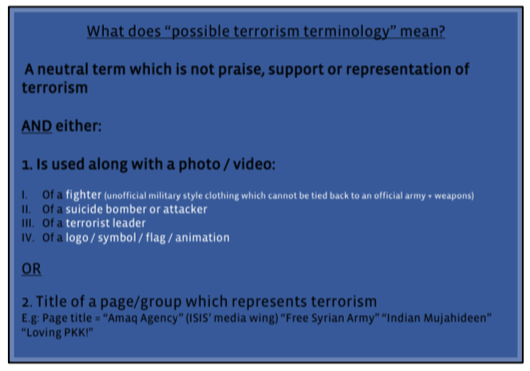

Capture d'écran du manuel Facebook pour les modérateurs

Capture d'écran du manuel Facebook pour les modérateursÀ en juger par la documentation contextuelle, Facebook essaie de formuler des principes pour les modérateurs sous la forme de règles simples oui ou non. Ensuite, la société transfère la modération réelle à des sociétés tierces. Ils attirent principalement des travailleurs non qualifiés, dont beaucoup travaillent dans des centres d'appels (le fameux «soutien indien» - ce sont les employés qui participent à la modération).

Les modérateurs comptent souvent sur Google Translate pour travailler. Les exigences de leurs performances sont telles qu'ils doivent en quelques secondes rappeler les innombrables règles et les appliquer aux centaines de messages qui apparaissent quotidiennement sur leur ordinateur de travail. Par exemple, pour rappeler rapidement les règles en présence desquelles émoticône la mention du jihad est interdite.

Une capture d'écran du manuel Facebook pour les modérateurs, qui explique les signes d'un discours de haine. Les modérateurs devraient identifier trois niveaux de «gravité» sur la base de six «comparaisons inhumaines», y compris une comparaison entre Juifs et rats. Guide de présentation générale de la haine 200 pages

Une capture d'écran du manuel Facebook pour les modérateurs, qui explique les signes d'un discours de haine. Les modérateurs devraient identifier trois niveaux de «gravité» sur la base de six «comparaisons inhumaines», y compris une comparaison entre Juifs et rats. Guide de présentation générale de la haine 200 pagesCertains modérateurs disent que les règles ne sont pas très efficaces et parfois dénuées de sens. Cependant, la direction de l'entreprise estime qu'il n'en va pas autrement: «Nous recevons des milliards de messages par jour et nous identifions de plus en plus de violations potentielles en utilisant nos systèmes techniques», explique Monika Bickert, directrice des politiques mondiales de Facebook. "Sur une telle échelle, même une précision de 99% laisse beaucoup d'erreurs."

Le manuel Facebook qui a frappé la presse ne ressemble pas à un guide clair. Il se compose de dizaines de présentations PowerPoint fragmentées et de feuilles de calcul Excel avec des titres bureaucratiques tels que «Les organisations et les individus haineux des Balkans occidentaux» ou «Violence explicite: normes de mise en œuvre». Il s'agit d'une sorte de "patchwork" des règles établies par les différents services de l'entreprise. Facebook a confirmé l'authenticité des documents, bien qu'il ait déclaré que certains d'entre eux avaient été mis à jour par rapport à la version entrée en possession du

NY Times . Facebook dit que les fichiers sont uniquement à des fins de formation, mais les modérateurs disent qu'ils sont en fait utilisés comme matériaux de référence dans le travail quotidien.