J'ai déjà cessé de trembler et de me demander quand le téléphone sonne et une voix dure et confiante sonne dans le récepteur: "Est-ce que le capitaine vous dérange (majeur tel ou tel), pouvez-vous répondre à quelques questions?" Pourquoi ne pas parler à votre propre police ...

Les questions sont toujours les mêmes. "Nous avons une vidéo avec le suspect, veuillez aider à restaurer le visage" ... "Aidez à augmenter le nombre du DVR" ... "Il n'y a pas de mains humaines ici, veuillez aider à augmenter" ... Et ainsi de suite dans la même veine.

Pour bien comprendre de quoi il s'agit, voici un exemple réel d'une vidéo hautement compressée envoyée où ils demandent de restaurer un visage flou (dont la taille équivaut à environ 8 pixels):

Et bien, seuls les oncles russes de Stepa dérangeraient, écrivent les Pinkertones occidentaux.

Voici, par exemple, une lettre de la police anglaise <***** @ *****. Fsnet.co.uk>:

J'ai utilisé vos filtres en privé pendant un certain temps pour sauver mes pauvres vidéos de vacances en famille mais je voudrais utiliser les filtres commerciaux pour mon travail. Je suis actuellement officier de police dans une petite force de police et nous recevons beaucoup de vidéos de vidéosurveillance, ce qui est parfois de très mauvaise qualité et je peux voir comment vos filtres feraient une réelle différence. Pouvez-vous me dire le coût et si je pouvais les utiliser.

Je vous remercie

La traductionJ'ai déjà utilisé vos filtres à des fins personnelles pour enregistrer mes mauvaises vidéos de vacances en famille. Mais je voudrais utiliser des filtres commerciaux dans mon travail. Je suis actuellement policier dans une petite unité. Nous obtenons un grand nombre de vidéos de caméras de vidéosurveillance, parfois de très mauvaise qualité, et vos filtres vous aideront vraiment. Pourriez-vous me dire leur coût et puis-je les utiliser?

Je vous remercie

Ou voici un policier australien écrit:

Salut

Je travaille pour la police de Victoria en Australie, dans l'unité de criminalistique vidéo et audio. Nous recevons occasionnellement des vidéos de caméras portatives ou montées sur véhicule. Souvent, ceux-ci capturent des images entrelacées d'événements rapides. En particulier, les images qui ont généralement le plus de "promesses" sont des images de plaques d'immatriculation de véhicules. Nous constatons souvent que le véhicule en question se sera déplacé de manière significative entre le premier et le dernier champ capturé. En conséquence, nous essayons de reconstruire l'ensemble du cadre à partir des deux champs, le second étant traduit, parfois tourné, et parfois la taille sera également différente (lorsque le véhicule s'éloigne ou se dirige vers la caméra). Marier ces deux champs , de préférence à une précision inférieure au pixel, et la reconstruction de la trame contenant la plaque d'immatriculation peut être difficile.

D'après ce que j'ai vu de vous désentrelacer des images, il se peut que votre filtre puisse faire une partie, sinon la totalité, de ce dont nous avons besoin. Pour être honnête, comme notre budget est plutôt petit, il est peu probable que nous puissions nous permettre une licence commerciale. Nous ne vendons pas le produit, bien sûr, nous l'utilisons comme preuve dans les affaires de police. En tout cas, j'ai pensé que j'écrirais un e-mail et demanderais quand même. Combien cela coûterait-il pour une licence? Est-il possible de tester le produit sur des images, pour voir s'il est approprié? Fait-il une partie de ce dont nous avons besoin? Enfin, l'algorithme a-t-il été publié? Travailler avec des algorithmes inconnus est une pratique dangereuse pour un tribunal. Si les preuves conduisent un homme à aller en prison pendant 20 ans, c'est une bonne pratique de savoir pourquoi!

Toute information que vous pourriez offrir serait appréciée.

Cordialement,

Chargé de dossier

Unité audiovisuelle

Département des services judiciaires de la police de Victoria

La traductionSalut

Je travaille pour la police de Victoria en Australie dans le département vidéo et audio médico-légale. De temps en temps, nous recevons des vidéos de caméras portatives et de DVR. Souvent, ces vidéos sont des prises de vue entrelacées d'objets en mouvement rapide. En particulier, le matériau le plus important est les plaques d'immatriculation des véhicules. On constate souvent que le véhicule en question se déplace fortement entre le premier et le dernier champ capturé. En conséquence, nous essayons de restaurer un cadre entier à partir de deux champs, le second étant décalé, parfois pivoté et parfois de taille différente (lorsque la voiture se déplace vers ou depuis la caméra). La combinaison de ces deux champs, de préférence à une précision d'un demi-pixel, et la restauration d'une trame entière contenant une plaque d'immatriculation peut être difficile.

Je vois comment vous appliquez le désentrelacement aux images, et peut-être que vos filtres peuvent faire quelque chose, sinon tout ce dont nous avons besoin. Honnêtement, nous ne pourrons peut-être pas nous permettre une licence commerciale, car notre budget est assez petit. Nous ne vendons pas le produit, bien sûr, nous l'utilisons comme preuve dans les affaires de police. En tout cas, je pensais que j'écrirais une lettre et demanderais toujours. Combien coûtera la licence? Est-il possible de tester le produit sur le matériau pour savoir s'il convient? Fait-il une partie de ce dont nous avons besoin? Enfin, l'algorithme a-t-il été publié? .. Travailler avec des algorithmes inconnus est une pratique dangereuse devant les tribunaux. Si les preuves conduisent une personne à aller en prison pendant 20 ans, il est utile de savoir pourquoi.

Nous serons reconnaissants pour toute information que vous pourriez nous fournir.

Cordialement

Enquêteur

Division audio et vidéo

Département médico-légal de la police de Victoria

Notez que la lettre est très réfléchie, une personne s'inquiète de la publication de l'algorithme et de la responsabilité d'une récupération incorrecte.

Parfois, ils n'admettent que par correspondance qu'ils appartiennent à la police. Par exemple, les carabiniers italiens voudraient de l’aide:

Dr. Vatolin

Merci pour la réponse.

La réponse vaut aussi pour les forces de police (enquête Carabinieri

scientifique pour PARMA ITALIE)?

À quel logiciel ils ont été associés à vos algorithmes.

Nous serions beaucoup.

La traductionDr. Batolin

Merci pour la réponse.

Est-ce approprié pour la police (unité d'enquête des carabiniers pour PARMA ITALIE)?

Sont-ils intéressés par le logiciel utilisé par vos algorithmes?

Nous vous en serons reconnaissants.

Et, bien sûr, de nombreux appels de gens ordinaires ...

Augmentez-le! Vous vous sentez désolé d'avoir appuyé sur le bouton droit?

Il est clair que tout ce flux d'appels n'apparaît pas de zéro.

«Blâmer» principalement les films et les émissions de télévision.

Par exemple, ici en 3 secondes, la trame de la vidéo compressée est augmentée de 50 fois et à partir de la réflexion dans les verres, ils voient des preuves:

Et il y a beaucoup de tels moments dans les films et séries modernes. Par exemple, dans cette vidéo, nous avons collecté de manière épique de tels épisodes dans un pack d'émissions télévisées, ne prenez pas deux minutes à regarder:

Et quand vous voyez cela dans chaque film, alors le dernier hérisson devient clair que tout ce dont vous avez besoin est d'avoir un génie informatique compétent, une combinaison d'algorithmes modernes, et il ne reste plus qu'à

"STOP!" et "Améliorez-le!" . Et le tour est joué! Un miracle va se produire!

Cependant, les scénaristes ne s'arrêtent pas à cette réception déjà galvaudée, et leur imagination débridée va plus loin. Voici un exemple très monstrueux. Des détectives galants à réfléchir dans l'élève de la victime ont reçu une photo du contrevenant. En effet, le reflet dans les verres était déjà là. C'est banal. Continuons! C’est juste que la résolution de la caméra CCTV dans la cage d’escalier s’est avérée assez aléatoire comme le télescope de Hubble:

Dans le "Prophète" (00:38:07):

Dans «Avatar» (1: 41: 04–1: 41: 05), l'algorithme de netteté est d'ailleurs quelque peu inhabituel par rapport à d'autres films: il affine d'abord à certains endroits, et après une fraction de seconde tire le reste de l'image, t .e. d'abord la moitié gauche de la bouche, puis la droite:

En général, dans les films très populaires qui sont regardés par des centaines de millions, la netteté de l'image se fait en un seul clic.

Tout le monde (dans les films) le fait! Alors pourquoi vous, ces experts intelligents, ne pouvez pas faire ça ???

"Je sais que c'est facile!" Et on m'a définitivement dit que tu fais ça! Êtes-vous trop paresseux pour appuyer sur ce bouton?

// Oh mon dieu ... Maudits scénaristes avec leur imagination débordante ...- Je comprends que vous êtes occupé, mais il s'agit de votre aide à l'Etat pour résoudre un crime important!

// Nous comprenons.- Peut-être que c'est pour l'argent? Combien devez-vous payer?

// Eh bien, comment expliquer brièvement que ce n'est pas que nous n'avons pas besoin d'argent ... Et puis encore et encore ...

Toute coïncidence des citations ci-dessus avec de vrais dialogues est complètement aléatoire, mais, en particulier, ce texte est écrit afin d'envoyer une personne à le lire attentivement en premier, puis à le rappeler.

Conclusion: Étant donné que la scène avec l'agrandissement des images des caméras de vidéosurveillance en un seul clic est devenue un cachet du cinéma moderne, un grand nombre de personnes sont sincèrement convaincues qu'il est très simple d'agrandir un fragment de la trame d'une caméra bon marché ou d'un enregistreur vidéo bon marché. L'essentiel est de savoir comment demander (enfin, ou commander, c'est la chance).

D'où poussent les jambes

Il est clair que tout ce flux d'appels n'est pas pris de zéro. Nous nous sommes vraiment engagés dans l'amélioration de la vidéo depuis environ 20 ans, y compris divers types de récupération vidéo (et il y en a plusieurs types, en passant), et nos exemples seront plus bas dans cette section.

Une augmentation «intelligente» de la résolution dans les articles scientifiques est généralement appelée Super Résolution (SR pour faire court). Google Scholar sur demande

Super Resolution trouve 2,9 millions d'articles, soit le sujet était, pour ainsi dire, assez bien déterré, et un grand nombre de personnes l'ont traité. Si vous suivez

le lien , alors il y a une mer de résultats, l'un plus beau que l'autre. Cependant, il vaut la peine de creuser plus profondément, l'image, comme d'habitude, ne devient pas si pastorale. Le thème SR a deux directions:

- Super résolution vidéo (0,4 million d'articles) - la restauration réelle en utilisant des images précédentes (et parfois ultérieures),

- Super résolution d'image (2,2 millions d'articles) - augmentation «intelligente» de la résolution en utilisant une seule image. Étant donné que dans le cas d'une image pour prendre des informations sur ce qui n'était réellement nulle part dans cet endroit, les algorithmes complètent d'une manière ou d'une autre l'image (ou, relativement parlant, «réfléchissez») à l'image - ce qui pourrait être là. Le critère principal est que le résultat soit aussi naturel que possible ou aussi proche que possible de l'original. Et il est clair que de telles méthodes ne conviennent pas pour restaurer ce qui était "vraiment", bien que l'agrandissement de l'image pour qu'elle soit plus belle, par exemple, lors de l'impression (lorsque vous avez une photo unique, mais il n'y a pas de version en résolution supérieure ) De telles méthodes sont très possibles.

Comme vous pouvez le voir, 0,4 million contre 2,2, c'est-à-dire 5 fois moins de personnes sont engagées dans la reprise réelle. Heureusement, le sujet «faites-le plus grand, tout simplement beau» est très demandé, y compris dans l'industrie (le fameux zoom numérique des smartphones et des porte-savons numériques). De plus, si vous plongez encore plus profondément, il devient rapidement clair qu'un nombre important d'articles sur la

super résolution vidéo est également une augmentation de la résolution vidéo sans récupération, car la récupération est difficile. En conséquence, nous pouvons dire que ceux qui «font magnifiquement» sont environ 10 fois plus que ceux qui essaient vraiment de restaurer. Soit dit en passant, une situation assez courante dans la vie.

Nous allons encore plus loin. Très souvent, les résultats de l'algorithme sont très bons, mais il a besoin, par exemple, de 20 images en avant et de 20 images en arrière, et la vitesse de traitement d'une image est d'environ

15 minutes lors de l'utilisation du GPU le plus avancé. C'est-à-dire pendant 1 minute, la vidéo a besoin de 450 heures (près de 19 jours). Oops-ss ... D'accord, ce n'est pas du tout comme l'instant "Zoomez-le!" des films. Il existe régulièrement des algorithmes qui fonctionnent plusieurs jours par image. Pour les articles, un meilleur résultat est généralement plus important que le temps de travail, car l'accélération est une tâche difficile distincte, et il est plus facile de manger un gros éléphant en plusieurs parties. C'est la différence entre la vie et le cinéma ...

La demande d'algorithmes fonctionnant sur la vidéo à une vitesse raisonnable a donné lieu à une direction distincte de la

super résolution vidéo rapide - 0,18 million d'articles, y compris des articles "lents" qui sont comparés à ceux "rapides", c'est-à-dire le nombre réel d'articles sur ces méthodes est surestimé. A noter que parmi les approches «rapides», le pourcentage de spéculation, c'est-à-dire sans réelle reprise, plus haut. En conséquence, le pourcentage de récupération honnête est plus faible.

L'image, vous voyez, devient claire. Mais cela, bien sûr, est loin d'être tout.

Quels autres points affectent de manière significative l'obtention d'un bon résultat?

Premièrement, le bruit est très influent. Voici un exemple d'une double restauration de la résolution dans une vidéo très bruyante:

Source: documents de l'auteurLe principal problème de ce fragment n'est même pas avec les bruits habituels, mais avec le

moiré coloré sur la chemise, qui est difficile à traiter. Certains pourraient dire que les gros bruits ne sont pas un problème aujourd'hui. Ce n'est pas le cas. Regardez les données des DVR de voiture et des caméras CCTV dans l'obscurité (juste au moment où elles sont plus demandées).

Cependant, le moiré peut également se produire sur des vidéos relativement «propres» en termes de bruit vidéo, comme la ville ci-dessous (les exemples ci-dessous sont

basés sur notre travail ):

Source: documents de l'auteur

Source: documents de l'auteurDeuxièmement, pour une récupération optimale, une prédiction proche de l'idéal du mouvement entre les images est nécessaire. Pourquoi cela est difficile est un grand sujet distinct, mais cela explique pourquoi les scènes avec un mouvement de caméra panoramique sont souvent très bien restaurées, et les scènes avec un mouvement relativement chaotique sont extrêmement difficiles à récupérer, mais avec elles, vous pouvez obtenir un assez bon résultat dans certaines situations:

Source: documents de l'auteurEt enfin, voici un exemple de récupération de texte:

Source: documents de l'auteurIci, l'arrière-plan se déplace assez facilement et l'algorithme a la possibilité de "se déplacer":

En particulier, si nous comparons une très petite inscription à droite de la main, y compris le grossissement avec

interpolation bicubique classique, alors la différence est très clairement visible:

On peut voir que pour l'interpolation bicubique, il est presque impossible de lire l'année, pour

Lanczos4 , qui est aimé par ceux qui changent semi-professionnellement la résolution vidéo pour la netteté, les bords sont plus clairs, bien sûr, mais il est toujours impossible de lire l'année. Nous ne commentons pas la topaze commerciale, mais nous lisons clairement l'inscription et vous pouvez voir que c'est probablement 1809.

Conclusions:

- Des milliers de chercheurs dans le monde sont engagés dans l'augmentation de la résolution, et des millions d'articles ont été publiés sur ce sujet. Pour cette raison, chaque smartphone dispose d'un «zoom numérique», qui est généralement objectivement meilleur que les algorithmes pour augmenter les programmes conventionnels, et chaque téléviseur FullHD peut afficher des vidéos SD, souvent même sans artefacts caractéristiques de changement de résolution.

- La récupération d'une image réelle à partir d'une vidéo représente bien moins de 10% de ceux impliqués dans la Super Résolution, de plus, la plupart des algorithmes de récupération sont extrêmement lents (jusqu'à plusieurs jours de calculs par image).

- Dans la plupart des cas, la récupération est conçue pour garantir que les hautes fréquences de la vidéo sont plus ou moins préservées et ne fonctionnent donc pas sur la vidéo avec des artefacts de compression importants. Et comme dans les paramètres des caméras de vidéosurveillance, le taux de compression est souvent choisi en fonction du désir de gagner plus d'heures (c'est-à-dire que la vidéo est compressée plus fortement et que les hautes fréquences sont «tuées»), il devient presque impossible de restaurer une telle vidéo.

À quoi ressemble SR dans l'industrie

Pour être honnête, nous notons qu'aujourd'hui tous les algorithmes d'augmentation de résolution (ou du moins achetés) sont disponibles pour tous les fabricants de téléviseurs (vous devez créer des images HD à partir d'images SD à la volée), pour tous les fabricants de smartphones (ce que l'on appelle le «zoom numérique» dans la publicité), etc. .d. Nous parlerons des résultats de Google (et pas seulement). Premièrement, parce que Google est très sympa et sans beaucoup de pathos et que le marketing décrit les résultats sur son blog - et c'est extrêmement sympa. Deuxièmement, parce que les fabricants de smartphones (par exemple, une entreprise coréenne très connue) n'hésitent pas à utiliser, disons, Photoshop pour la publicité de leurs technologies (quelle est la différence - les gens vont l'avaler quand même) - et c'est désagréable. En général, parlons de ceux qui décrivent leur technologie assez honnêtement.

En 2016, Google a publié des résultats assez intéressants de l'algorithme

RAISR (Rapid and Accurate Image Super Resolution) utilisé dans le smartphone Pixel 2. Sur les photos les plus réussies, le résultat était tout simplement génial:

Source: Google AI BlogL'algorithme était un ensemble de filtres appliqués après la classification ML et comparé à l'interpolation bicubique (garçon fouetté traditionnel), le résultat a plu:

Dans l'ordre: original, interpolation bicubique, RAISRMais c'était une interpolation d'une seule image, et sur des exemples «infructueux», comme le feuillage ci-dessous, l'image est devenue très désagréablement déformée - après l'agrandissement, l'image est devenue sensiblement «synthétique». Il a montré exactement l'effet pour lequel le zoom numérique des smartphones modernes n'est pas apprécié:

Le miracle, en fait, ne s'est pas produit, et Google a honnêtement et immédiatement publié un contre-exemple, à savoir a immédiatement souligné les limites de l'applicabilité de leur approche et a sauvé les gens d'attentes excessives (typiques du marketing conventionnel).

Cependant, moins de deux ans se sont écoulés depuis que la

poursuite des travaux utilisés dans Google Pixel 3 a

été publiée et améliore considérablement la qualité de sa prise de vue, qui est déjà une super résolution multi-images honnête, c'est-à-dire algorithme de récupération de résolution multi-trame:

Source: Google AI BlogL'image ci-dessus montre une comparaison des résultats de Pixel 2 et Pixel 3, et les résultats semblent très bons - l'image est vraiment devenue beaucoup plus claire et il est clairement vu que ce n'est pas «réfléchir», mais vraiment restaurer les détails. De plus, un lecteur professionnel attentif aura des questions sur deux tubes doubles verticaux sur la gauche. La résolution a clairement augmenté, tandis que l'étape de

repliement (signe d'une réelle résolution) semble étrangement proche. C'était quoi?

En résumé, nous analyserons l'algorithme. Les collègues sont passés de changer l'interpolation du

motif Bayer :

Le fait est que 2/3 des informations dans une image réelle sont en fait des informations interpolées. C'est-à-dire votre image est DÉJÀ floue et "floue", mais avec un vrai niveau de bruit ce n'est pas si important. Soit dit en passant, la possibilité d'utiliser des algorithmes d'interpolation plus complexes a rendu les programmes populaires de conversion RAW de la plus haute qualité pour les photographies (la différence entre l'algorithme simple intégré à chaque appareil photo et l'algorithme complexe d'un programme spécialisé est généralement perceptible à l'œil nu lorsque l'image est agrandie).

Des collègues de Google utilisent le fait que la grande majorité des photos de smartphones sont prises à la main, c'est-à-dire l'appareil photo tremblera légèrement:

Source: Google AI Blog (image multi-images alignée au niveau des pixels pour montrer le décalage sous-pixel)Par conséquent, si vous prenez quelques images et évaluez le décalage (et le fer, qui est capable de créer une carte d'estimation de mouvement avec une précision d'un quart de pixel, est dans n'importe quel smartphone avec prise en charge H.264), nous obtenons une carte de décalage. Fidèle à l'animation ci-dessus, il est clairement vu qu'avec un niveau de bruit réel, la construction d'une carte de déplacement avec une précision sous-pixel est une tâche très simple, mais de très bons algorithmes sont apparus dans ce domaine au cours des 20 dernières années. Bien sûr, parfois, et ils ont du mal. Par exemple, dans l'exemple ci-dessus, quelque chose clignote sur un cadre en haut de la rampe d'escalier. Et c'est toujours une scène statique, il n'y a pas d'objets en mouvement qui parfois ne se contentent pas de bouger, mais tournent, changent de forme, se déplacent rapidement, laissant de larges zones d'ouverture (dont la boucle ne doit pas être visible après traitement). L'exemple ci-dessous montre clairementce qui arrive aux objets en mouvement rapide, si vous désactivez le traitement spécial de ces cas (désactivé à gauche, activé à droite, si vous cliquez, les blocs de traitement sont clairement visibles): Source: Google AI Blog (recommandé de cliquer et de voir en haute résolution)Des exemples concrets sont les flammes, les ondulations, les reflets du soleil sur l'eau, etc. En général, même dans le problème «simple» de détermination du décalage, il existe de nombreux moments non triviaux qui compliquent considérablement la vie de l'algorithme. Cependant, maintenant ce n'est pas à ce sujet.Fait intéressant, même si la caméra est complètement immobile (par exemple, montée sur un trépied), vous pouvez faire bouger le capteur via le contrôle du module de stabilisation optique (OIS - Optical Image Stabilization). En conséquence, nous obtenons les décalages de sous-pixels souhaités. Dans Pixel 3, le support OIS est implémenté, et vous pouvez appuyer le téléphone contre la vitre et regarder avec intérêt comment OIS commence à déplacer l'image le long d'une ellipse (environ, comme ce lien), c'est-à-dire que même dans ce cas de montage sur trépied, difficile pour lui, la Super Résolution pourra travailler et améliorer la qualité. Cependant, la part du lion de la prise de vue à partir de smartphones est la prise de vue à main levée.En conséquence, nous avons des informations supplémentaires pour construire une photo à plus grande résolution:Comme mentionné ci-dessus, la conséquence directe de SR est une diminution significative du niveau de bruit, dans certains cas, elle est très perceptible:Source: Google AI BlogNotez que la récupération signifie également la restauration par le nombre de bits par composant.

Source: Google AI Blog (recommandé de cliquer et de voir en haute résolution)Des exemples concrets sont les flammes, les ondulations, les reflets du soleil sur l'eau, etc. En général, même dans le problème «simple» de détermination du décalage, il existe de nombreux moments non triviaux qui compliquent considérablement la vie de l'algorithme. Cependant, maintenant ce n'est pas à ce sujet.Fait intéressant, même si la caméra est complètement immobile (par exemple, montée sur un trépied), vous pouvez faire bouger le capteur via le contrôle du module de stabilisation optique (OIS - Optical Image Stabilization). En conséquence, nous obtenons les décalages de sous-pixels souhaités. Dans Pixel 3, le support OIS est implémenté, et vous pouvez appuyer le téléphone contre la vitre et regarder avec intérêt comment OIS commence à déplacer l'image le long d'une ellipse (environ, comme ce lien), c'est-à-dire que même dans ce cas de montage sur trépied, difficile pour lui, la Super Résolution pourra travailler et améliorer la qualité. Cependant, la part du lion de la prise de vue à partir de smartphones est la prise de vue à main levée.En conséquence, nous avons des informations supplémentaires pour construire une photo à plus grande résolution:Comme mentionné ci-dessus, la conséquence directe de SR est une diminution significative du niveau de bruit, dans certains cas, elle est très perceptible:Source: Google AI BlogNotez que la récupération signifie également la restauration par le nombre de bits par composant. C'est-à-dire

résolvant formellement le problème de l'augmentation de la résolution, le même moteur dans certaines conditions peut non seulement supprimer le bruit, mais aussi transformer la trame en HDR. Il est clair qu'aujourd'hui le HDR est rarement utilisé, mais cela, vous voyez, est un bon bonus.L'exemple ci-dessous montre une comparaison des images obtenues lors de la prise de vue sur le Pixel 2 et sur le Pixel 3 après SR avec une qualité de capteur comparable. La différence de bruit et la différence de clarté sont clairement visibles:Pour ceux qui aiment regarder les détails, il y a un album dans lequel la Super Resolution de Google (nom marketing Super Res Zoom) peut être appréciée dans toute sa splendeur dans le spectre de l'échelle de zoom d'image sur un smartphone (changement FoV ): Comment ils écrivent modestement - ils ont fait un pas de plus vers la qualité de prise de vue des smartphones à la qualité des caméras professionnelles. En toute justice, nous notons que les caméras professionnelles ne sont pas non plus immobiles. Une autre chose est qu'avec de plus petites ventes, les mêmes technologies coûteront plus cher à l'utilisateur. Cependant, SR apparaît déjà dans les caméras professionnelles. UPD: À titre d'exemple (le dernier lien est une comparaison):

- Testing Sony's New Pixel Shift Feature in the a7R III , 2 ( , ),

- Olympus E-M5 Mark II 16 40 ,

- Super Resolution Pentax K-1 ,

- : Pixel-Shift Shootout: Olympus vs. Pentax vs. Sony vs. Panasonic — Pentax K-1, Sony a7R III, Olympus OM-D E-M1 Mark II Panasonic Lumix DC-G9. , , , Pentax K-1.

:

- Super Resolution , , .

- SR: Image Super Resolution — ( ), .

- Les principaux avantages des algorithmes de récupération sont la réduction du bruit, le raffinement des détails, un HDR «plus honnête», une qualité d'image nettement plus visible sur les téléviseurs grand écran.

- Toute cette magnificence a été rendue possible grâce à une augmentation cardinale (d'environ 3 ordres de grandeur du nombre d'opérations) de la complexité des algorithmes de traitement photo, ou plus précisément - d'une image vidéo.

Résultats Yandex

Puisqu'ils demanderont toujours dans les commentaires, je dirai quelques mots sur Yandex, qui a publié sa version de Super Resolution l'année dernière:Source: https://yandex.ru/blog/company/oldfilmsEt voici quelques exemples de dessins animés:Source: https://yandex.ru/blog/company/soyuzmultfilmC'était quoi? Yandex a répété la

technologie de Google en 2016 ?

Sur

la page de

description de la technologie de Yandex (nom marketing DeepHD), les liens ne concernent que l'Image Super Resolution. Cela signifie qu'il existe évidemment des contre-exemples dans lesquels l'algorithme gâche l'image et ils sont plus courants que pour les algorithmes de récupération honnêtes. Mais environ 80% des articles sont consacrés au sujet et l'algorithme est plus facile à mettre en œuvre.

Cette technologie a

également été

décrite sur un hub (il est intéressant que l'auteur de l'article soit diplômé de notre laboratoire), mais, comme vous pouvez le voir dans les commentaires, les auteurs n'ont répondu à aucune de mes questions, alors qu'ils ont répondu aux autres. Et ce ne sont plutôt pas les auteurs des méchants, mais la politique de l'entreprise (dans d'autres postes, si vous regardez bien, il n'y a souvent pas non plus de réponses aux questions des experts). Pour les entreprises technologiques, les blogs hésitent à approfondir la discussion sur l'implémentation ou les détails technologiques. Surtout si cela crée une meilleure impression de la technologie / du produit. Ou les concurrents peuvent couper la même chose plus rapidement. Encore une fois, le marketing est responsable des publications, et c'est leur travail direct - créer une impression favorable des produits de l'entreprise, quelle que soit la qualité des produits eux-mêmes. D'où la méfiance fréquente à l'égard des informations provenant du marketing.

En général, il vaut la peine d'être très sceptique à propos des images des entreprises de la série «comment nous avons tout bien fait» pour les raisons suivantes:

- Les auteurs d'algorithmes de traitement savent très bien qu'il n'existe pratiquement aucun algorithme qui, dans certains cas, ne générerait pas d'artefacts. Et, en fait, l'une des tâches clés du développeur est de réduire le pourcentage de ces cas (ou la visibilité des artefacts dans de tels cas) tout en maintenant la qualité dans d'autres cas. Et très souvent cela ne réussit PAS:

- Ou les artefacts sont si forts et difficiles à réparer que toute l'approche est rejetée. En fait c'est le cas, peut-être (surprise-surprise!), De la majorité des articles. Des images divines dans certains cas (qui étaient au sol) et «ça ne marche pas du tout» dans le reste.

- Ou (et c'est une situation courante pour les entreprises de technologie pratique), vous devez sacrifier une certaine qualité en moyenne afin que les artefacts dans les pires cas puissent être tolérés.

En conséquence, lorsque de mauvais exemples ne sont pas publiés (classiques pour les entreprises) ou publiés de manière limitée et avec des défauts (classiques pour les articles) - c'est le cas le plus courant de tromper les gens sur les propriétés d'une technologie / d'un algorithme.

- Une autre idée fausse courante concernant les algorithmes de traitement est l'utilisation de paramètres (y compris les paramètres internes) de l'algorithme. Les algorithmes, il en est ainsi, ont des paramètres, et les utilisateurs - et c'est aussi la norme - aiment avoir au plus un bouton «activer». Et même s'il existe des paramètres, l'utilisateur de masse ne les utilise pas. C'est pourquoi, lors de l'achat de technologie, «arrêtez-vous cent fois», ils vous demandent encore: «Est-ce à coup sûr une machine complète? et demandez de nombreux exemples.

- En conséquence, une histoire courante est la publication d'un résultat obtenu avec certains paramètres. Heureusement, le développeur les connaît bien, et même quand il y en a cinquante (la situation réelle!), Il les prend très vite pour que l'image soit magique. Exactement, ces images sont souvent destinées à la publicité.

- De plus, le développeur peut même être contre. Le marketing voit les nouveaux exemples envoyés et dit: "rien n'est visible sur eux, dans la dernière présentation, vous aviez des exemples normaux!" Et puis ils peuvent essayer de leur expliquer que de nouveaux exemples sont ce que les gens voient vraiment, et dans la dernière présentation, des résultats potentiels ont été montrés qui peuvent être atteints par des études préliminaires du début du projet. Cela ne dérange personne. Les gens auront l'image "où vous pouvez voir". Dans certains cas, même les grandes entreprises utilisent Photoshop. Messing est servi, messieurs les gens! )

- De plus, en ce qui concerne la vidéo - cela ouvre simplement de grands espaces ouverts pour la

machine ... bon marketing! Car, en règle générale, les images sont disposées et la qualité de la vidéo compressée oscille toujours et dépend de la masse des paramètres. Encore une fois - plusieurs technologies peuvent être correctement appliquées, le temps de traitement, encore une fois, peut être différent. Et ce n'est pas tout, la portée est grande.

- La publicité Yandex indique que la technologie DeepHD fonctionne en temps réel, vous pouvez donc regarder les chaînes de télévision en l'utilisant aujourd'hui . Il a été expliqué ci-dessus que la vitesse de fonctionnement est le talon d'Achille de Super Resolution. L'avantage des réseaux de neurones, bien sûr, est qu'en étudiant pendant une longue période, ils peuvent fonctionner très rapidement dans certains cas, mais je chercherais (avec un grand intérêt professionnel) dans quelle résolution et qualité l'algorithme fonctionne en temps réel. Habituellement, plusieurs modifications de l'algorithme sont créées et à des résolutions élevées en temps réel, de nombreuses "puces" (essentielles pour la qualité) doivent être désactivées. Trop.

- Dans les exemples en noir et blanc , un examen plus approfondi révèle que la luminosité locale change. Étant donné que le SR correct ne modifie pas la luminosité, il semble qu'un autre algorithme ait fonctionné, peut-être pas un (les résultats montrent qu'il ne s'agit pas d'un traitement d'image unique, ou plutôt, il ne semble pas seulement). Si vous regardez une pièce plus grande (au moins 100 images), l'image sera claire. Cependant, la mesure de la qualité vidéo est un sujet très important.

Conclusions:

- Vous devez comprendre que les spécialistes du marketing utilisent souvent leurs astuces précisément parce que cela fonctionne (et comment!). L'écrasante majorité des gens

ne lisent pas le hub Ce qui conduit régulièrement à toutes sortes de distorsions. Je souhaite que tout le monde soit moins annoncé, surtout lorsque la narration est à son meilleur et que je veux vraiment croire en un miracle!

- Et, bien sûr, il est très bien que Yandex travaille également sur le sujet et crée sa propre SR (plus précisément, sa propre famille SR).

Perspectives

Revenons à notre point de départ. Que faire pour ceux qui veulent augmenter la vidéo compressée? Est-ce que tout est mauvais?

Comme décrit ci-dessus, même un léger changement de l'image dans la région, littéralement au niveau du bruit, est critique pour les algorithmes de récupération "honnête". Autrement dit, les hautes fréquences dans l'image et leur changement entre les images sont critiques.

Dans ce cas, la principale raison pour laquelle la compression vidéo est effectuée est la suppression du bruit entre les images. Dans l'exemple ci-dessous, la différence entre les images d'une vidéo bruyante avant la compensation de mouvement, après la compensation (avec une compression faible) et après la compression perceptible - ressentez la différence (le contraste est augmenté d'environ 6 fois pour que les détails soient visibles):

Source: conférences de l'auteur sur les algorithmes de compression

Source: conférences de l'auteur sur les algorithmes de compressionOn voit clairement que du point de vue du codec, la zone idéale est la zone dans laquelle le mouvement a été entièrement compensé et sur laquelle plus aucun bit ne doit être dépensé. Eh bien, un peu peut être dépensé, quelque chose de peu corrigé. Et il peut y avoir un certain nombre de ces domaines. Par conséquent, Super Resolution perd son «pain principal» - des informations sur ce qui se trouve à cet endroit dans d'autres images, en tenant compte du décalage de sous-pixels.

Si vous regardez les articles, même pour un JPEG relativement simple, la

restauration jpeg contient 26 mille résultats, et pour la

récupération jpeg - 52 mille, et ceci avec la restauration des fichiers cassés, etc. Pour la vidéo, la situation est pire que la

restauration MPEG - 22000, soit le travail est bien sûr en cours, mais l'échelle de l'échelle de travail sur la super résolution n'est pas comparable. Il y a environ un ordre de grandeur de moins de travail que la restauration de la résolution vidéo et deux ordres de grandeur de moins que la super résolution d'image. Deux commandes, c'est beaucoup. Nous avons également fait une approche du projectile (puisque nous faisons de la compression et du traitement depuis longtemps), il y a quelque chose à travailler, surtout si la qualité oscille ou utilise quelque chose comme M-JPEG (plus récemment, une image courante en vidéosurveillance). Mais ce seront tous des cas particuliers.

Les résultats des articles des liens ci-dessus montrent également que les résultats sont parfois très beaux, mais obtenus pour des cas très particuliers. C'est-à-dire demain, dans chaque smartphone, cette fonction, hélas, n'apparaîtra pas. Ce sont de mauvaises nouvelles. Bon - après-demain et sur un ordinateur avec un bon GPU - apparaîtra à coup sûr.

Raisons:

- Les dispositifs de stockage (cartes SD pour les bureaux d'enregistrement, disques pour les caméras de vidéosurveillance, etc.) sont de moins en moins chers et le débit binaire moyen pour l'enregistrement vidéo augmente.

- De plus, lors de la compression, ils basculent progressivement vers les standards des générations futures (par exemple, sur HEVC), ce qui signifie une amélioration notable de la qualité avec le même débit binaire. Les 2 derniers points signifient que progressivement la qualité vidéo sera de plus en plus élevée et, à partir d'un certain point, des algorithmes de super résolution vidéo bien développés commenceront à fonctionner.

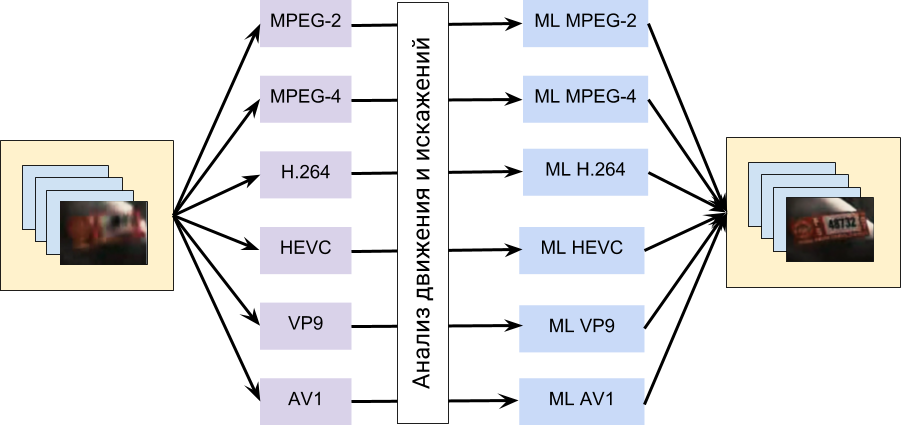

- Enfin, les algorithmes sont en cours d'amélioration. Les réalisations des algorithmes basés sur l'apprentissage automatique au cours des 4 dernières années sont particulièrement bonnes. À cet égard, avec une forte probabilité, nous pouvons nous attendre à quelque chose comme ceci:

C'est-à-dire l'algorithme utilisera explicitement les informations de mouvement reçues du codec, puis ces données seront transmises à un réseau neuronal formé pour récupérer des artefacts spécifiques à des codecs spécifiques. Un tel schéma semble actuellement tout à fait réalisable.

Mais dans tous les cas, vous devez clairement comprendre que la récupération actuelle est, en règle générale, une double augmentation de la résolution. Plus rarement, dans certains cas, lorsque le matériel source n'a pas été compressé ou presque pas compressé, nous pouvons parler de 3-4 fois. Comme vous pouvez le voir, ce n'est même pas près de 100 à 1000 fois le grossissement des films, lorsque 1,5 pixel d'un enregistrement nocturne bruyant se transforme en un numéro de voiture d'excellente qualité. Le genre de "science-fiction" devrait en effet se voir attribuer un pourcentage plus important de films et d'émissions de télévision.

Et, bien sûr, il y aura des tentatives pour faire quelque chose d'universel, dans le cadre de la tendance de la mode «l'essentiel est de couper plus de couches». Et ici, il convient de mettre en garde contre les réactions "cheers-cheers" aux documents publicitaires sur ce sujet. Pour les réseaux de neurones sont le cadre le plus pratique pour démontrer des miracles et toutes sortes de spéculations. L'essentiel est de choisir correctement l'échantillon de formation et les exemples finaux. Et le tour est joué! Voyez le miracle! D'ailleurs, c'est très pratique pour convaincre les investisseurs. Autrement dit, il est extrêmement important que l'efficacité des technologies soit confirmée par une personne indépendante sur un grand nombre d'exemples hétérogènes, ce qui est rarement démontré. Pour les entreprises, donner même un ou deux exemples lorsque la technologie ne fonctionne pas, est aujourd'hui assimilé à un exploit civil.

Eh bien, pour que la vie ne ressemble pas à du miel, je vous rappelle que le soi-disant transcodage est populaire aujourd'hui, alors qu'en fait vous devez travailler avec une vidéo qui a été à l'origine réduite par un algorithme, puis réduite par un autre, tandis que d'autres vecteurs de mouvement sont utilisés, les plus hauts sont détruits à nouveau fréquences etc. Et le fait qu'une personne y voit bien tout ne signifie pas que l'algorithme traitant une telle vidéo fera réellement des miracles. Il ne sera pas possible de restaurer des vidéos fortement pincées, bien qu'en général la Super Résolution se développera rapidement au cours des 10 prochaines années.

Conclusions:

- N'oubliez pas que ce que vous voyez dans les films et comment c'est dans la vraie vie est très différent. Et pas seulement en termes de récupération de vidéo hautement compressée!

- Les algorithmes généralement modernes augmentent les résolutions de 2 fois, moins souvent - un peu plus, c'est-à-dire pas 50 fois, familiers des films, doivent bientôt attendre.

- Le domaine de la super résolution est en plein essor et vous pouvez vous attendre à un développement actif de la restauration vidéo dans les années à venir, y compris la récupération après compression.

- Mais la première chose que nous verrons est toutes sortes de spéculations sur le sujet, lorsque les résultats démontrés exagéreront considérablement les capacités réelles des algorithmes. Faites attention!

À la fin de l'année dernière, nous avons donné une conférence «Réseaux de neurones dans le traitement vidéo - mythes et réalité». On va peut-être la mettre ici.

Restez à l'écoute!

Remerciements

Je remercie chaleureusement:

- Laboratoire d'infographie VMK Université d'État de Moscou MV Lomonosov pour la puissance de calcul et pas seulement

- nos collègues du groupe vidéo, grâce auxquels les algorithmes ci-dessus ont été créés, et en particulier Karen Simonyan, l'auteur de l'article dont les résultats ont été montrés ci-dessus et qui travaille maintenant dans Google DeepMind,

- personnellement Konstantin Kozhemyakov, qui a fait beaucoup pour rendre cet article meilleur et plus visuel,

- Google pour son excellent blog et ses descriptions relativement correctes des technologies créées, et Yandex pour sa très bonne concurrence sur un large front - Google est pratiquement le seul exemple réussi dans un pays où les services Google ne sont pas interdits,

- Habrovchan denisshabr , JamboJet et iMADik pour la pointe et les liens vers les caméras professionnelles SR multi-images,

- et enfin, un grand merci à Vyacheslav Napadovsky, Evgeny Kuptsov, Stanislav Grokholsky, Ivan Molodetsky, Alexei Soloviev, Evgeny Lyapustin, Yegor Sklyarov, Denis Kondranin, Alexandra Anzina, Roman Kazantsev et Gleb Ishelev pour cette grande quantité de remarques utiles mieux!