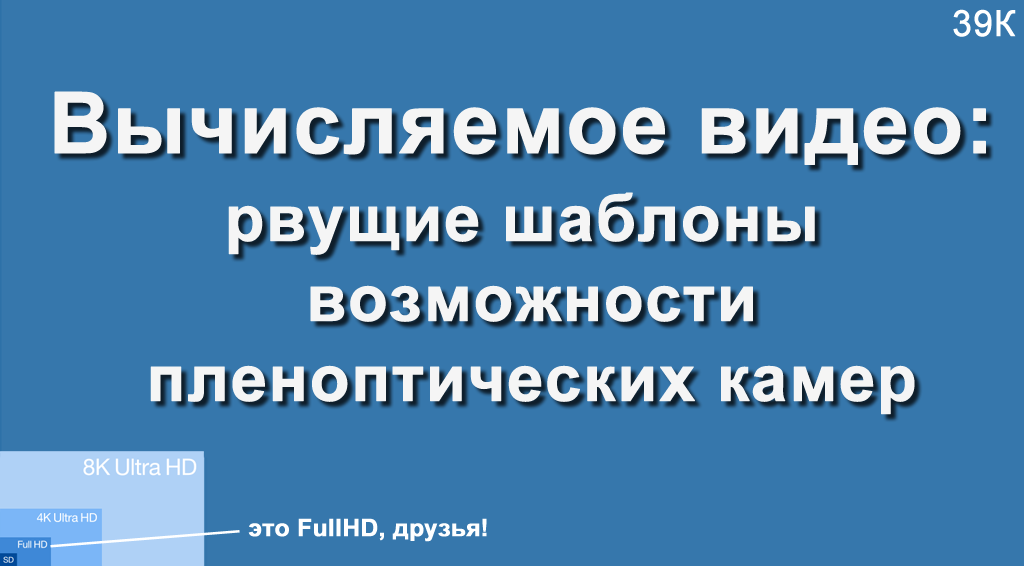

Il y a quelque temps, l'auteur a eu l'occasion de donner une conférence à VGIK, et il y avait beaucoup de gens de la maison de la caméra dans le public. On a demandé au public: "Avec quelle résolution maximale avez-vous tourné?", Et il s'est avéré qu'environ un troisième plan 4K ou 8 mégapixels, le reste - pas plus de 2K ou 2 mégapixels. C'était un défi! J'ai dû parler de l'appareil photo avec une résolution de 755 mégapixels (résolution brute, pour être précis, car il dispose d'un 4K final) et des possibilités enchanteresses que cela offre pour la prise de vue professionnelle.

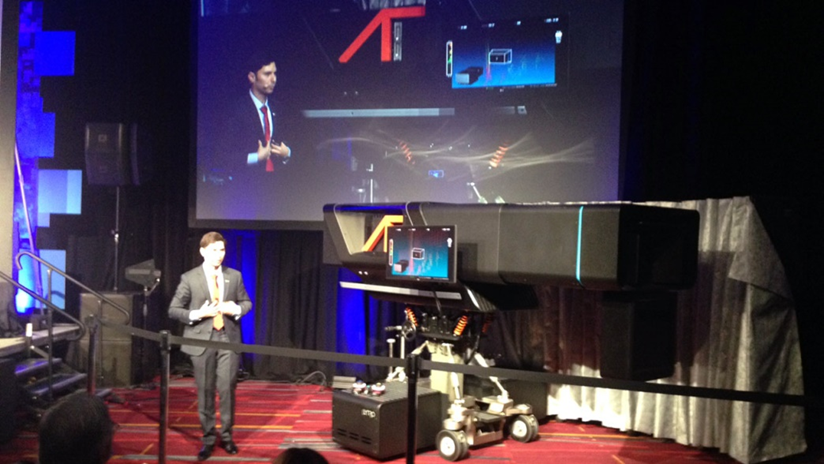

La caméra elle-même ressemble à ceci (une sorte de petit éléphant):

De plus, je vais ouvrir un terrible secret, afin de prendre cette photo, nous recherchions un meilleur angle et une personne plus grande. Il m'est arrivé de sentir cette caméra en direct, je dirai qu'elle a l'air

beaucoup plus grande. L'image ci-dessous avec Yon Karafin, avec qui nous sommes à peu près de la même taille, reflète plus précisément l'ampleur de la catastrophe:

Qui se soucie en principe des capacités de la vidéo calculée sur laquelle ils écrivent rarement - toute la vérité est sous le coup! )

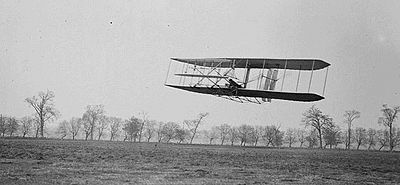

Les discussions sur les possibilités de la plénoptique me rappellent les discussions sur le premier avion:

Ce que les gens ont dit:

-

C'est très cher ...-

OUI!-

C'est complètement impraticable et maintenant ne paie pas ...-

OUI!-

Il est dangereux d'utiliser ...-

Merde, OUI!-

Ça a l'air misérable!-

Merde, oui, mais ça vole, tu vois, LE-TA-ET !!!

Après 50 ans, ces expériences ont donné naissance à un moyen fondamentalement nouveau, pratique et assez sûr de se déplacer à travers les océans (et pas seulement).

La situation est la même ici. Absolument la même chose! Maintenant, il nécessite des coûts déraisonnables, sacrément gênants à utiliser et a l'air misérable, mais il vole vraiment! Et pour être conscient des principes et des perspectives émergentes - c'est tout simplement au-delà de la croyance (au moins votre humble serviteur)!

Le monstre sur la photo ci-dessus rappelle quelque peu les premiers appareils photo, qui étaient également grands, avec un objectif énorme et tournés sur un cadre spécial:

Source: Tournage télévisé des Jeux olympiques de 1936 à l'aube de la télévision

Source: Tournage télévisé des Jeux olympiques de 1936 à l'aube de la télévisionIci, beaucoup de choses ressemblent, également un objectif énorme (car il n'y a pas assez de lumière), un appareil photo lourd avec une suspension spéciale, des tailles énormes:

Source: Lytro prêt à changer à jamais le cinéma

Source: Lytro prêt à changer à jamais le cinémaDe l'intéressant: la "valise" ci-dessous est un système de refroidissement liquide, en cas de panne dont l'appareil photo ne peut plus prendre de photos.

Le grand rectangle sous l'objectif (clairement visible sur la première photo ci-dessus) n'est pas le rétro-éclairage, mais le lidar - un télémètre laser qui fournit une scène en trois dimensions devant la caméra.

Un garrot noir épais en bas à gauche en arrière-plan est un faisceau de câbles à fibres optiques d'environ 4 centimètres de diamètre, à travers lequel la caméra envoie un flux d'informations monstrueux vers un stockage spécial.

Ceux qui sont dans le sujet ont déjà reconnu

Lytro Cinema , dont 3 pièces ont été créées. La première, qui apparaît généralement sur toutes les images, est facilement reconnaissable par un seul

lidar sous l'objectif. Après 1,5 an, une deuxième chambre a été créée avec des problèmes structurels corrigés du premier et des deux lidars (et, hélas, presque personne n'écrit à ce sujet). De plus, les progrès dans le développement, par exemple, des lidars en 1,5 an ont été si importants que deux lidars de la deuxième chambre ont donné 10 fois plus de points qu'un lidar de la première. Le troisième appareil photo était censé avoir approximativement les mêmes caractéristiques de résolution (pour satisfaire les exigences des cinéastes), mais être deux fois plus petit (ce qui est essentiel pour une utilisation pratique). Mais ... mais plus à ce sujet plus tard.

En tout cas, reconnaissant à tous égards le rôle exceptionnel que Lytro a joué dans la vulgarisation de la technologie de

prise de vue plénoptique , je voudrais noter que la lumière n'y a pas convergé. Un appareil similaire a été fabriqué à l'

Institut Fraunhofer ,

Raytrix , un producteur de caméras plénoptiques, existe en toute sécurité, et encore une fois je n'ai pas été autorisé à photographier Lytro Cinema, parce que j'avais très peur de plusieurs sociétés chinoises qui travaillaient activement dans ce sens (je n'ai pas pu trouver de nouvelles informations à leur sujet).

Par conséquent, notons tous les avantages de la plénoptique et sur lesquels ils n'écrivent presque pas. Mais précisément à cause de quoi il est garanti de réussir.

Au lieu d'introduire

Uniquement sur Habré et seul Lytro est mentionné

sur environ 300 pages , donc nous serons courts.

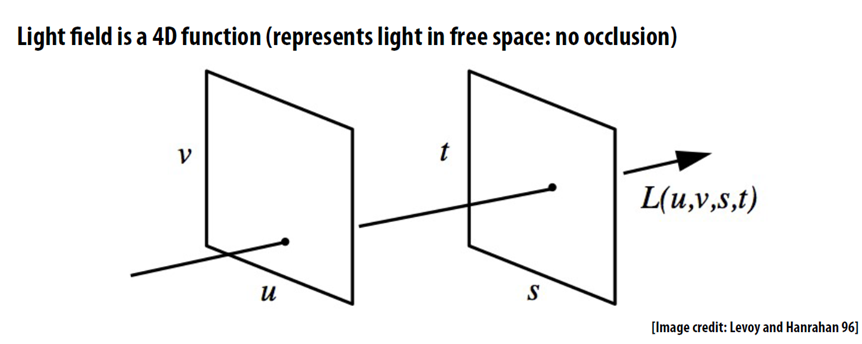

Le concept clé pour la prise de vue plénoptique est le champ lumineux, c'est-à-dire que nous ne fixons pas la couleur des pixels à chaque point, mais une matrice bidimensionnelle de pixels, transformant un cadre bidimensionnel misérable en un cadre quadridimensionnel normal (généralement avec très peu de résolution en t et s jusqu'à présent):

Dans

Wikipedia anglais ,

puis en russe dans des articles sur le champ lumineux, il est dit que "l'expression" champ lumineux "a été utilisée

par A. Gershun en ... 1936." En toute honnêteté, nous notons qu'il ne s'agissait pas par

hasard de «phrase utilisée», mais du nom d'un

petit livre de 178 pages , qui s'appelait «Light Field»:

Et même à cette époque, ces œuvres étaient tout à fait appliquées dans la nature et l'auteur 6 ans plus tard au plus fort de la guerre en 1942 a reçu le prix Staline du deuxième degré pour la méthode de black-out.

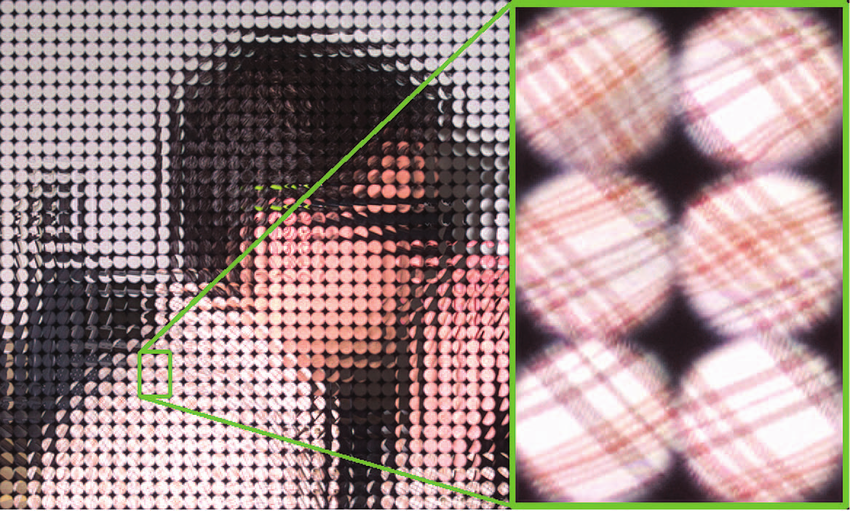

En pratique, la prise de vue d’une image en quatre dimensions du champ lumineux fournit un ensemble de microlentilles situées devant le capteur de la caméra:

Source: plenoptic.inf® (vous pouvez cliquer et voir en pleine résolution)

Source: plenoptic.inf® (vous pouvez cliquer et voir en pleine résolution)En fait, c'est précisément parce que nous avons un réseau de microlentilles avec une petite distance entre elles qui a permis de créer Lytro Cinema, dont le capteur a été assemblé à partir d'un réseau de capteurs dont les limites tombent sur le bord des lentilles. Un refroidissement liquide était nécessaire pour refroidir un massif très chaud.

Source: Utilisation de caméras plénoptiques focalisées pour une capture d'image riche

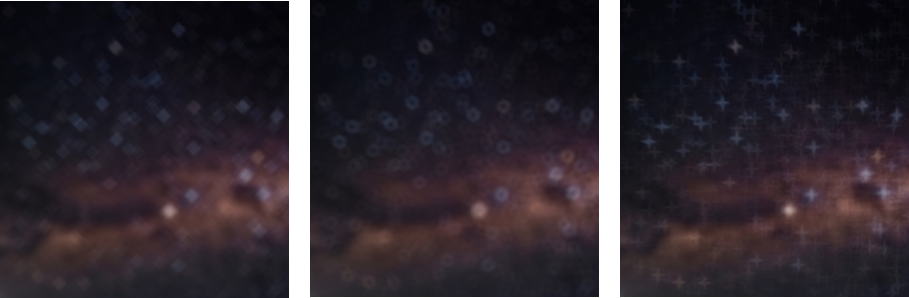

Source: Utilisation de caméras plénoptiques focalisées pour une capture d'image richeEn conséquence, nous obtenons la possibilité la plus célèbre de caméras plénoptiques, dont seuls les paresseux n'ont pas écrit - pour changer la distance de mise au point après la prise de vue (ces oiseaux mignons n'attendraient pas la mise au point):

Source: Lytro

Source: LytroEt peu de choses ont été écrites sur l'apparence des plénoptiques dans une résolution adaptée à un film (s'ouvre par clic):

Source: Regarder Lytro changer la cinématographie pour toujours

Source: Regarder Lytro changer la cinématographie pour toujoursJ'ouvre un autre secret: le foyer calculé est la pointe de l'iceberg de la plénoptique. Et les 90% d'opportunités restant en dessous du niveau d'intérêt des journalistes sont à mon avis encore plus intéressants. Beaucoup d'entre eux sont dignes d'articles séparés, mais corrigeons au moins l'injustice et appelons-les au moins. C'est parti!

Forme d'ouverture calculée

Puisque nous parlons de défocalisation, il convient de mentionner le soi-disant

effet bokeh , dans lequel l'éblouissement n'est pas nécessairement rond

Pour les photographes, le soi-disant

Kit Bokeh est sorti , ce qui vous permet d'obtenir des reflets de différentes formes:

Cela vous permet d'obtenir de jolies images et la photo ci-dessous montre clairement que les étincelles en forme de cœur ont même des pierres au premier plan, seuls les cœurs sont plus petits. Et il est clair qu'il est extrêmement difficile d'essayer de créer un flou naturel de la même manière dans Photoshop, au moins il est conseillé d'utiliser une carte de profondeur:

Dans le même temps, pour les plénoptiques de «calculer» une ouverture différente est une tâche relativement facile:

Alors! Nous avons calculé la distance de mise au point, calculé la forme de l'ouverture, sommes allés plus loin, c'est plus intéressant là-bas!

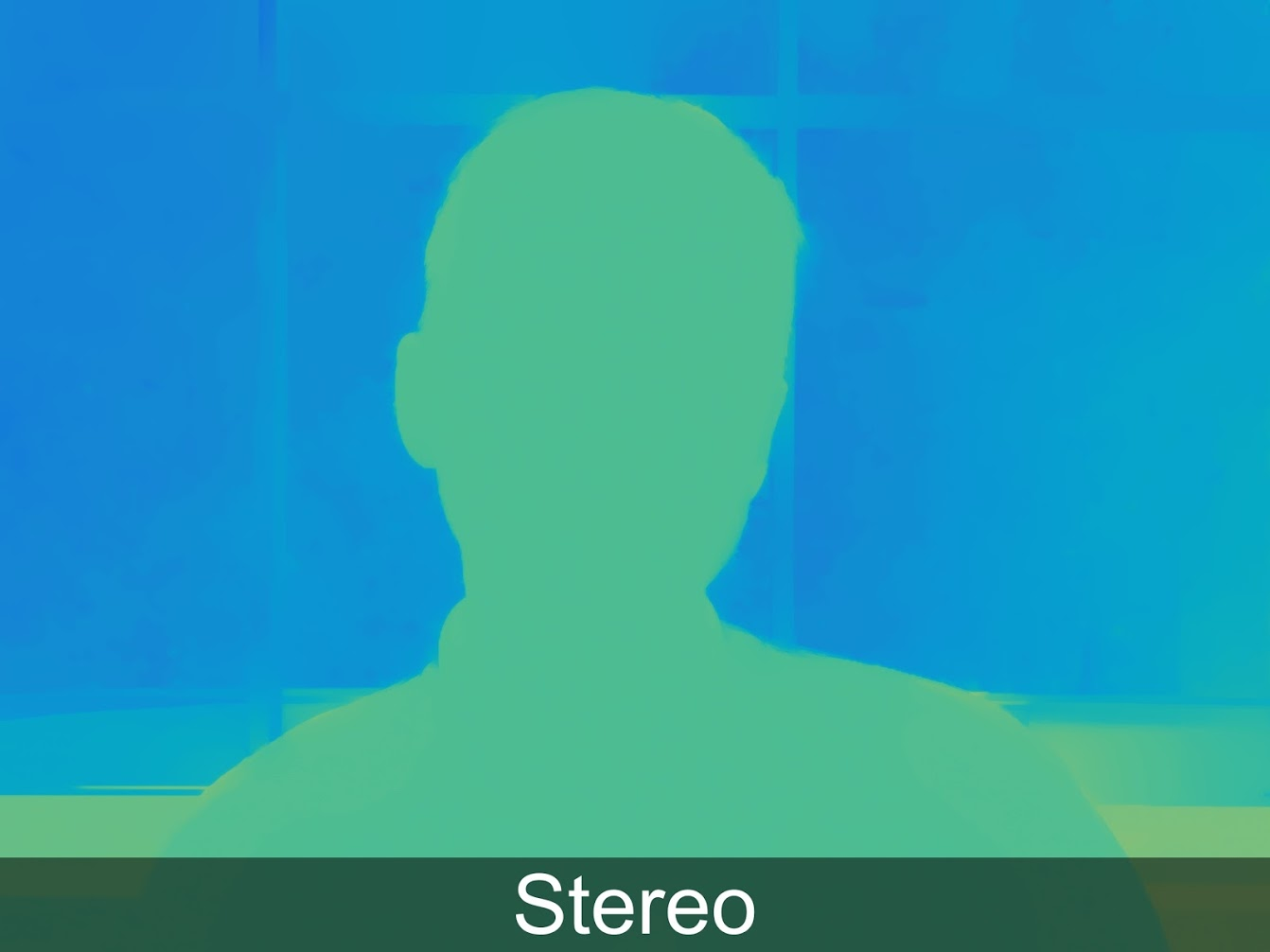

Stéréo calculée

Une caractéristique très utile du capteur plénoptique, dont presque personne ne parle, mais qui lui donne déjà une seconde vie, est la possibilité de calculer une image à partir de différents points. L'emplacement du point est en fait déterminé par la taille de la lentille. Si l'objectif est petit, le cadre peut légèrement se déplacer vers la gauche et la droite, comme dans cet exemple (que cette photo stéréo est visible si vous regardez la poitrine de l'oiseau le plus proche):

Source: Lytro

Source: LytroSi l'objectif est grand, comme par exemple Lytro Cinema, le point de prise de vue peut être décalé de 10 centimètres. Permettez-moi de vous rappeler qu'entre nos yeux, nous avons environ 6,5 centimètres, c'est-à-dire avec une distance maximale de 10 cm, vous pouvez photographier à la fois le plan général (et ce sera "en trois dimensions" que si vous regardez avec les yeux) et le gros plan (avec toute parallaxe sans inconfort). En fait, cela signifie que nous pouvons filmer une vidéo stéréo complète avec un seul objectif. De plus, ce ne sera pas seulement stéréo, mais stéréo avec une qualité parfaite et cela semble fantastique aujourd'hui - avec une distance variable entre les axes optiques des caméras virtuelles APRÈS la prise de vue. À la fois cela et un autre - des opportunités absolument impensables qui peuvent changer radicalement une situation avec le tournage stéréo à l'avenir.

Puisque l'avenir est en quelque sorte dans le tournage en trois dimensions, nous allons nous attarder sur ces deux points plus en détail. Ce n'est un secret pour personne qu'aujourd'hui la plupart des films 3D, en particulier les blockbusters, ne sont pas supprimés, mais convertis en 3D. Cela est dû au fait que lors de la prise de vue, une longue liste de problèmes survient (ci-dessous fait partie de la liste):

- Les images peuvent être tournées, déplacées verticalement ou agrandies les unes par rapport aux autres (ne dites pas que cela est facilement corrigé, voyez combien de fois ces images entrent dans les sorties de films - c'est une horreur silencieuse ... et un mal de tête). Ainsi - la stéréo plénoptique est parfaitement alignée, même si l'opérateur a décidé de zoomer sur le plan (en raison de la mécanique des deux caméras, il est extrêmement difficile de rendre l'approximation strictement synchrone).

- Les cadres peuvent varier en couleur , surtout si la prise de vue nécessite une petite distance entre les axes optiques des caméras et que vous devez utiliser un séparateur de faisceau (il y avait un article détaillé à ce sujet). Il s'avère que dans une situation où lors de la prise de vue de tout objet flare (la voiture en arrière-plan par une journée ensoleillée), nous sommes voués au divertissement en post-production avec la grande majorité des appareils photo, avec le plénum, nous aurons une image PARFAITE avec n'importe quel éblouissement. Ce sont des vacances!

- La netteté des images peut varier - encore une fois, un problème notable dans les séparateurs de faisceau, qui est complètement absent dans les plénoptiques. Avec quelle netteté est nécessaire, avec cela, nous allons calculer, absolument PARFAIT sous les angles.

- Les cadres peuvent flotter dans le temps . Des collègues qui ont travaillé avec le matériau Stalingrad ont parlé de l'écart entre les horodatages des pistes par 4 images, c'est pourquoi le cracker est toujours d'actualité. Nous avons trouvé plus de 500 scènes avec des décalages horaires dans 105 films. La différence de temps, malheureusement, est difficile à détecter, en particulier sur les scènes au ralenti, et en même temps, c'est l'artefact le plus douloureux selon nos mesures. Dans le cas des plénoptiques, nous aurons une synchronisation temporelle PARFAITE.

- Un autre mal de tête lors de la prise de vue en 3D est les parallaxes trop grandes qui provoquent une gêne lors de la visualisation sur un grand écran, lorsque vos yeux peuvent diverger sur les côtés pour les objets «au-delà de l'infini», ou trop converger pour certains objets de premier plan. Le calcul correct de la parallaxe est un sujet difficile distinct que les opérateurs doivent maîtriser, et un objet qui pénètre accidentellement dans le cadre peut ruiner la prise, ce qui le rend mal à l'aise. Avec les plénoptiques, nous choisissons nous-mêmes la parallaxe APRÈS la prise de vue, de sorte que toute scène peut être calculée avec la parallaxe PARFAITE, de plus, la même scène déjà prise peut être facilement calculée pour les grands écrans et les petits écrans. C'est ce que l'on appelle le changement de parallaxe, qui est généralement extrêmement difficile et coûteux à faire sans perte de qualité, surtout si vous avez des objets translucides ou des bordures au premier plan.

En général, la capacité de CALCULER la stéréo parfaite est la véritable base de la prochaine vague de popularité 3D, car au cours des 100 dernières années, 5 de ces ondes ont été distinguées. Et, à en juger par les progrès de la projection laser et du plénoptique, un maximum de 10 ans (lorsque les principaux brevets de Lytro expirent ou un peu plus tôt en Chine) nous attendent un nouveau fer et un nouveau niveau de films 3D de qualité.

Alors! Ils ont obtenu la stéréo parfaite calculée à partir d'un objectif (une chose impossible pour la plupart, au fait). Et ils ne l'ont pas seulement compris, mais ils ont également raconté la parallaxe après coup, même si l'objet n'est pas net au premier plan. Allons plus loin!

Point de prise de vue calculé

Changer le point de prise de vue a une application dans la vidéo 2D ordinaire.

Si vous étiez sur le plateau ou au moins avez vu des photos, vous avez probablement fait attention aux rails sur lesquels l'appareil photo se déplace. Souvent, pour une scène, vous devez les disposer dans plusieurs directions, ce qui prend un temps considérable. Les rails assurent le bon fonctionnement de la caméra. Oui, bien sûr, il y a un

steadicam , mais dans de nombreux cas, les rails, hélas, n'ont pas d'alternative.

La possibilité de changer le point de tir dans Lytro a été utilisée pour démontrer qu'il y a suffisamment de roues. En fait, lorsque la caméra bouge, nous formons un «tube» virtuel d'un diamètre de 10 cm dans l'espace, à l'intérieur duquel nous pouvons changer le point de prise de vue. Et cette pipe vous permet de compenser les petites fluctuations. Ceci est bien montré dans cette vidéo:

De plus, il faut parfois résoudre le problème inverse, c'est-à-dire ajouter des oscillations pendant le mouvement. Par exemple, il n'y avait pas assez de dynamique et le réalisateur a décidé de faire une explosion. Il ne faut pas longtemps pour appliquer un son, mais il est conseillé de secouer la caméra de manière synchrone, et il vaut mieux non seulement déplacer l'image à plat, elle sera visible, mais la secouer «honnêtement». Avec les plénoptiques, le point de prise de vue peut être complètement secoué «honnêtement» - avec un changement de point de prise de vue, d'angle, de flou de mouvement, etc. Il y aura une illusion complète que la caméra a tremblé violemment, qui a roulé doucement et en toute sécurité sur des roues. D'accord - une opportunité incroyable! Le steadicam de prochaine génération montrera des miracles.

Bien sûr, pour que cela devienne une réalité, vous devez attendre que la taille de la caméra plénoptique soit réduite à une taille raisonnable. Mais compte tenu de l'argent investi dans la miniaturisation et de l'augmentation de la résolution des capteurs pour smartphones et tablettes, il semble que l'attente ne soit pas si longue. Et il sera possible de créer une nouvelle caméra plénoptique! Chaque année, cela devient de plus en plus facile.

Alors! Le point de prise de vue a été calculé et, si nécessaire, déplacé, stabilisant ou déstabilisant l'appareil photo. Allons plus loin!

Éclairage calculé

Puisque nous parlons d'une explosion à proximité ...

Parfois, il devient nécessaire de modifier l'éclairage du sujet, par exemple, d'ajouter un flash de manière réaliste. Les studios de post-production savent bien à quel point ce problème est difficile, même si les vêtements de notre personnage sont relativement simples.

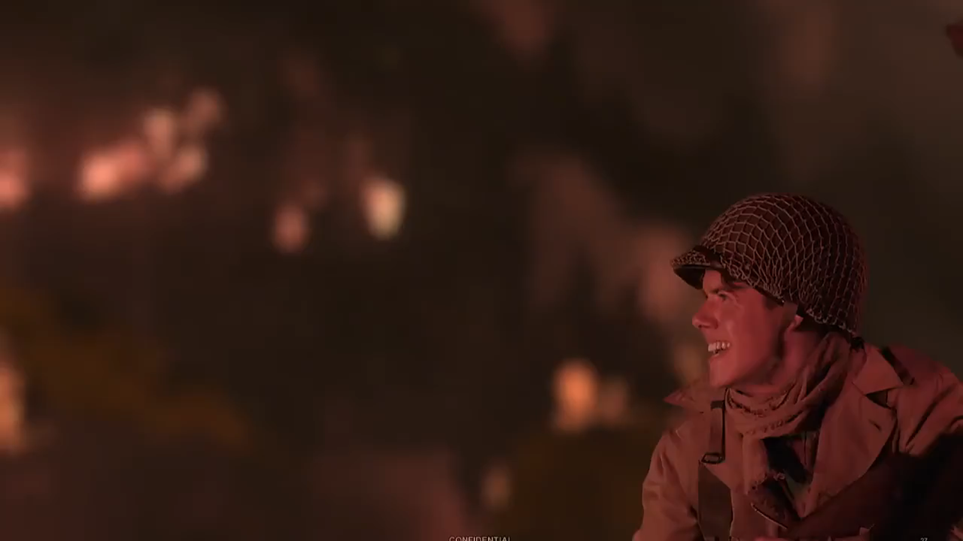

Voici un exemple de vidéo avec une superposition flash, prenant en compte les vêtements, leurs ombres, etc. (s'ouvre par clic):

Source: Entretien avec Yon Karafin

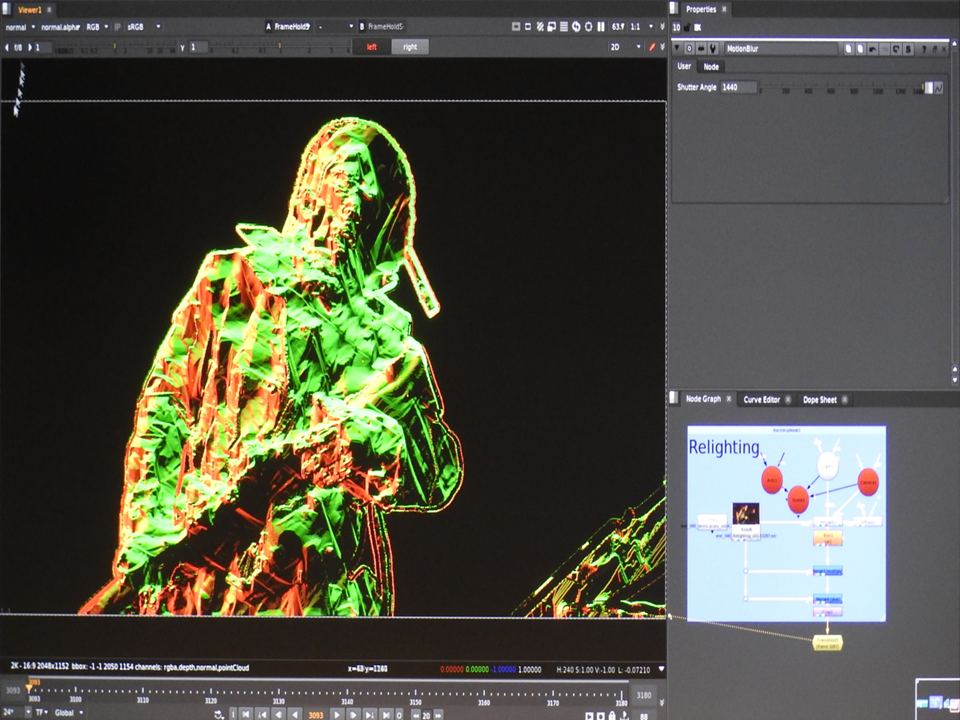

Source: Entretien avec Yon KarafinSous le capot, il ressemble à un plug-in pour Nuke, qui fonctionne avec un modèle tridimensionnel complet de l'acteur et met une nouvelle lumière dessus, en tenant compte de la carte normale, des matériaux, du flou de mouvement, etc.:

Source: Matériaux Lytro

Source: Matériaux LytroAlors! Le nouvel éclairage de l'objet déjà capturé a été calculé. Allons plus loin!

Résolution calculée

Ceux qui ont expérimenté le premier Lytro ont souvent noté - oui, le jouet est cool, mais la résolution est complètement insuffisante pour la photographie normale.

Dans

notre dernier article sur Habr, il a été décrit comment de petits décalages du point de prise de vue peuvent aider à augmenter considérablement la résolution. Question: Ces algorithmes sont-ils applicables aux plénoptiques? Réponse: oui! De plus, les algorithmes de super résolution sont plus faciles à travailler sur les images plénoptiques, car il existe une carte de profondeur, tous les pixels sont pris en même temps et les décalages sont connus de manière assez précise. Autrement dit, la situation des plénoptiques est tout simplement magique par rapport aux conditions dans lesquelles les algorithmes de super résolution fonctionnent en 2D ordinaire. Le résultat est correspondant:

Source: Restauration de cadre plénoptique naïf, intelligent et super résolution d' après le rapport technique d'Adobe «Superrésolution avec caméra Plenoptic 2.0»

Source: Restauration de cadre plénoptique naïf, intelligent et super résolution d' après le rapport technique d'Adobe «Superrésolution avec caméra Plenoptic 2.0»Le seul problème majeur (vraiment gros!) Est la quantité de données et la quantité de calcul nécessaires. Néanmoins, aujourd'hui, il est tout à fait réaliste de charger une ferme informatique la nuit et d'obtenir deux fois plus de résolution demain là où cela est nécessaire.

Donc - compris la résolution calculée! Allons plus loin!

Environnement calculé

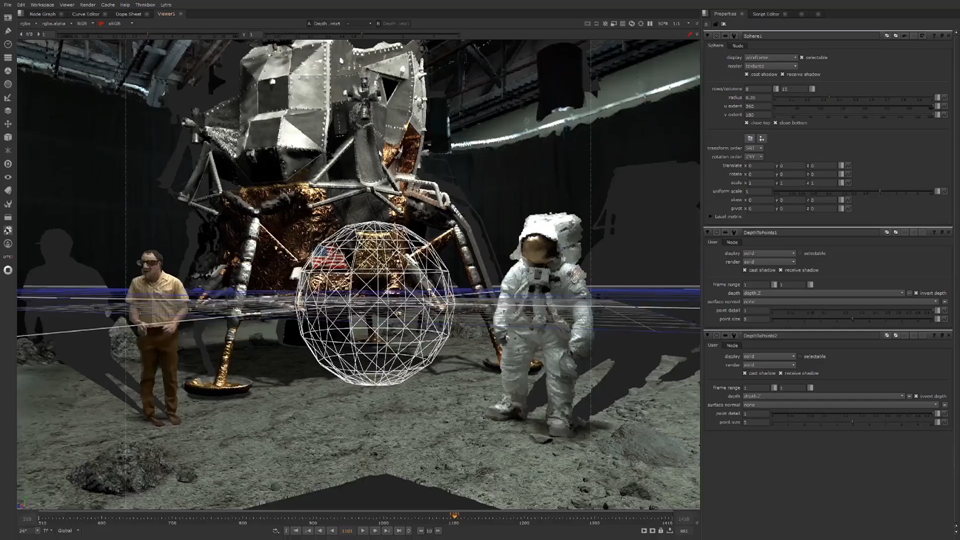

Une tâche distincte qui se pose au stade de la post-production, surtout s'il s'agit d'une sorte de projet fantastique ou fantastique, consiste à coller soigneusement les objets capturés dans une scène en trois dimensions. Globalement, il n'y a pas de gros problème. Aujourd'hui, la norme est le balayage tridimensionnel de la zone de prise de vue et il ne reste plus qu'à combiner soigneusement le modèle de prise de vue et la scène tridimensionnelle pour qu'il n'y ait pas de classiques du genre lorsque les jambes des acteurs tombent parfois légèrement dans le sol inégal peint (ce montant n'est pas très visible sur le petit écran, mais peut être clairement vu au cinéma, surtout quelque part dans IMAX).

Non sans humour, pour un exemple de fonctionnement de la caméra, la scène de prise de vue de l'alunissage a été utilisée (des «ombres tridimensionnelles» sont clairement visibles dans des endroits que la caméra ne voit pas):

Source: Lune | Lytro | VR Playhouse | Post-production de Lightfield

Source: Lune | Lytro | VR Playhouse | Post-production de LightfieldPuisqu'une vidéo multi-angle est filmée dans une caméra plénoptique par définition, la construction d'une carte de profondeur n'est pas un gros problème. Et si l'appareil photo est combiné avec le lidar - nous filmons immédiatement une scène en trois dimensions, ce qui simplifie catégoriquement la combinaison de la prise de vue réelle et des graphiques à l'étape suivante.

Nous avons donc compté la scène tridimensionnelle (combinant les données lidar et les données plénoptiques). Maintenant, vous l'aurez deviné, le rendu du levé lunaire sera encore meilleur! Allez-y.

Incrustation chromatique calculée

Mais ce n'est pas tout!

La technologie habituelle d'un plateau de tournage moderne est celle

des écrans verts , lorsque des endroits où un arrière-plan informatique est censé être placé sur des boucliers en contreplaqué vert ou des bannières vertes sont tirés. Ceci est fait de sorte qu'il n'y ait aucun problème au niveau des bordures translucides lorsque l'arrière-plan change. 4 — ( ) .

, , , , . , , :

:

: Lytro , (

- — !), ( challenge), , ( , , ):

, ? . , , ( ). ,

.

« », . . , 2D . .

, , !

— . , , , , . , «» .

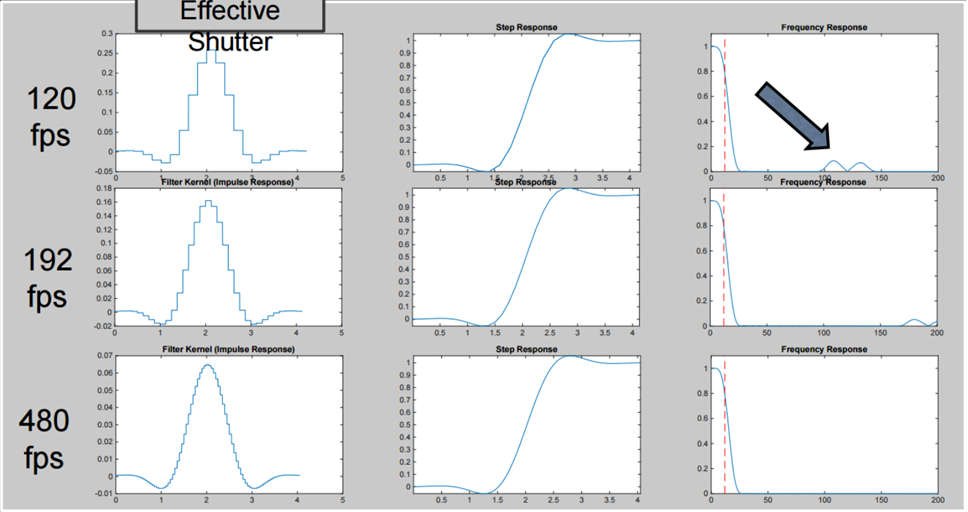

, «» «» , , , , , , ( Lytro Cinema 300 fps, , ):

«» , , , «» «» , ( , , ):

: https://vimeo.com/114743605

: https://vimeo.com/114743605, , :

: https://vimeo.com/114743605

: https://vimeo.com/114743605, . !

Habituellement, en ce qui concerne la plénoptique aujourd'hui, il y a des conversations typiques dans le style de

"Le patron est parti: le plâtre est retiré, le client s'en va!" Lytro a acheté Google à bon marché l'année dernière, les expériences de Pelican Imaging ne sont pas entrées en production de masse, et en général tout est resté juste une belle théorie ...

Source: Pelican Imaging: Modules de caméra plénoptique pour smartphone pour 20 dollars

Source: Pelican Imaging: Modules de caméra plénoptique pour smartphone pour 20 dollarsAlors voilà! Les rumeurs sur la mort des plénoptiques sont largement exagérées. Très fort!

Au contraire, des capteurs plénoptiques sont actuellement produits et utilisés à une échelle qui n'avait

jamais été auparavant dans l'histoire.

La célèbre société Google, sans trop de fanfare, a publié Google Pixel 2 et Google Pixel 3 avec des capteurs plénoptiques. Si vous regardez le téléphone, vous pouvez clairement voir que l'appareil photo a un appareil photo:

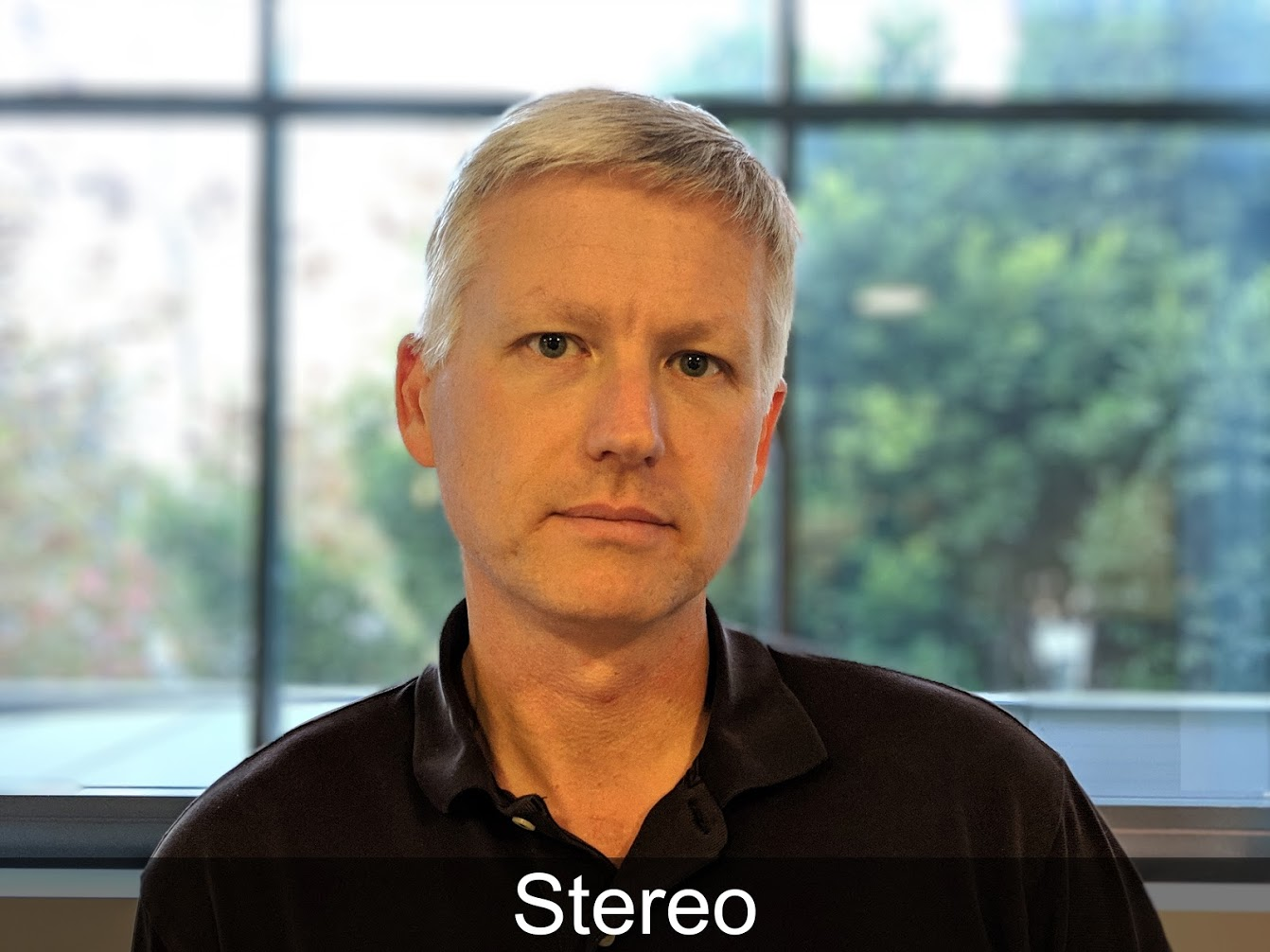

Cependant, en même temps, le téléphone fait un très bon flou de l'arrière-plan, en général, pas pire que ses collègues "à deux yeux", "à trois yeux" et "à quatre yeux" (convenez que la photo suivante bénéficie particulièrement de cet effet):

Source: AI Google Blog (vous pouvez cliquer et voir une taille plus grande, principalement sur les bordures de l'objet au premier plan)

Source: AI Google Blog (vous pouvez cliquer et voir une taille plus grande, principalement sur les bordures de l'objet au premier plan)Comment font-ils cela?!

Une source de miracles magiques, incontournable ces derniers temps, est utilisée - la magie enfantine des réseaux de neurones?

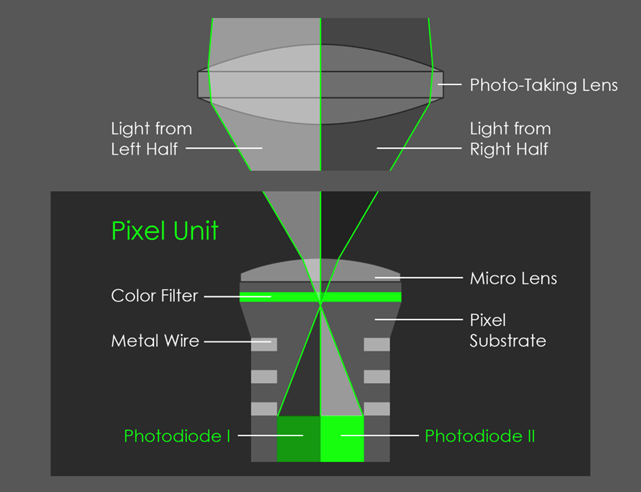

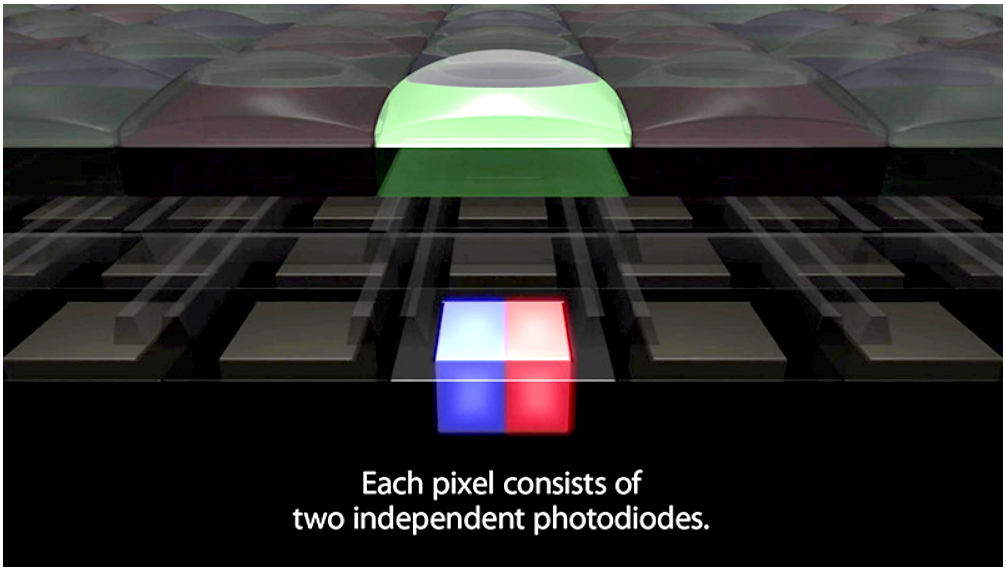

Les réseaux de neurones, en particulier dans Pixel 3, sont également activement utilisés dans cette tâche, mais plus à ce sujet plus tard. Et le secret de la qualité de l'effet est que le capteur du smartphone est plénoptique, bien que l'objectif ne couvre que deux pixels, comme le montre l'image:

Source: AI Google Blog

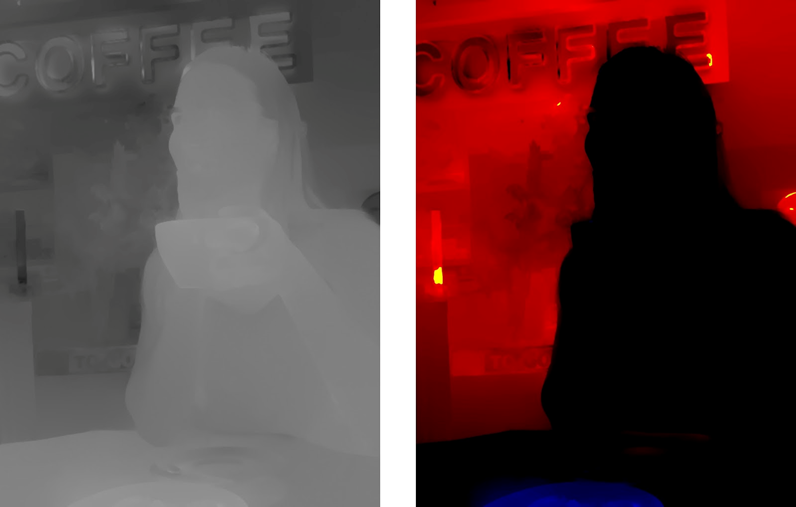

Source: AI Google BlogEn conséquence, nous obtenons une image micro-stéréo, ici un très léger décalage est visible dans le mouvement (la bonne image est animée et se déplace de haut en bas, car le téléphone était tenu de cette façon lors de la prise de vue):

Mais même ce décalage extrêmement petit suffit pour construire une carte de profondeur pour la photo prise (à propos de l'utilisation des décalages en sous-pixels

dans un article précédent ):

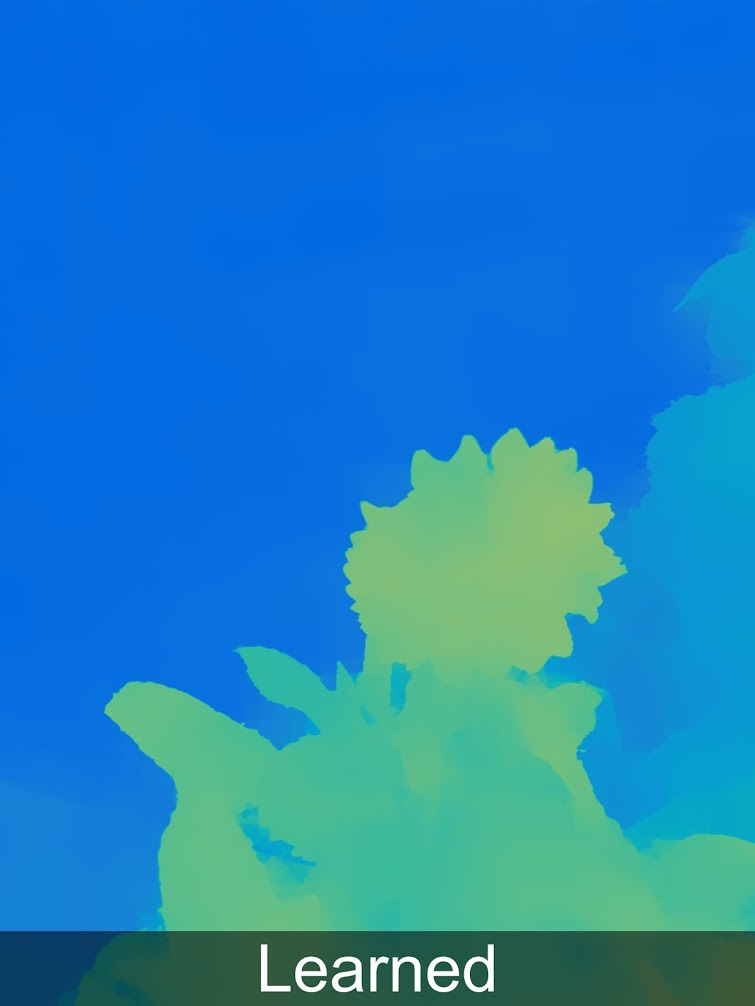

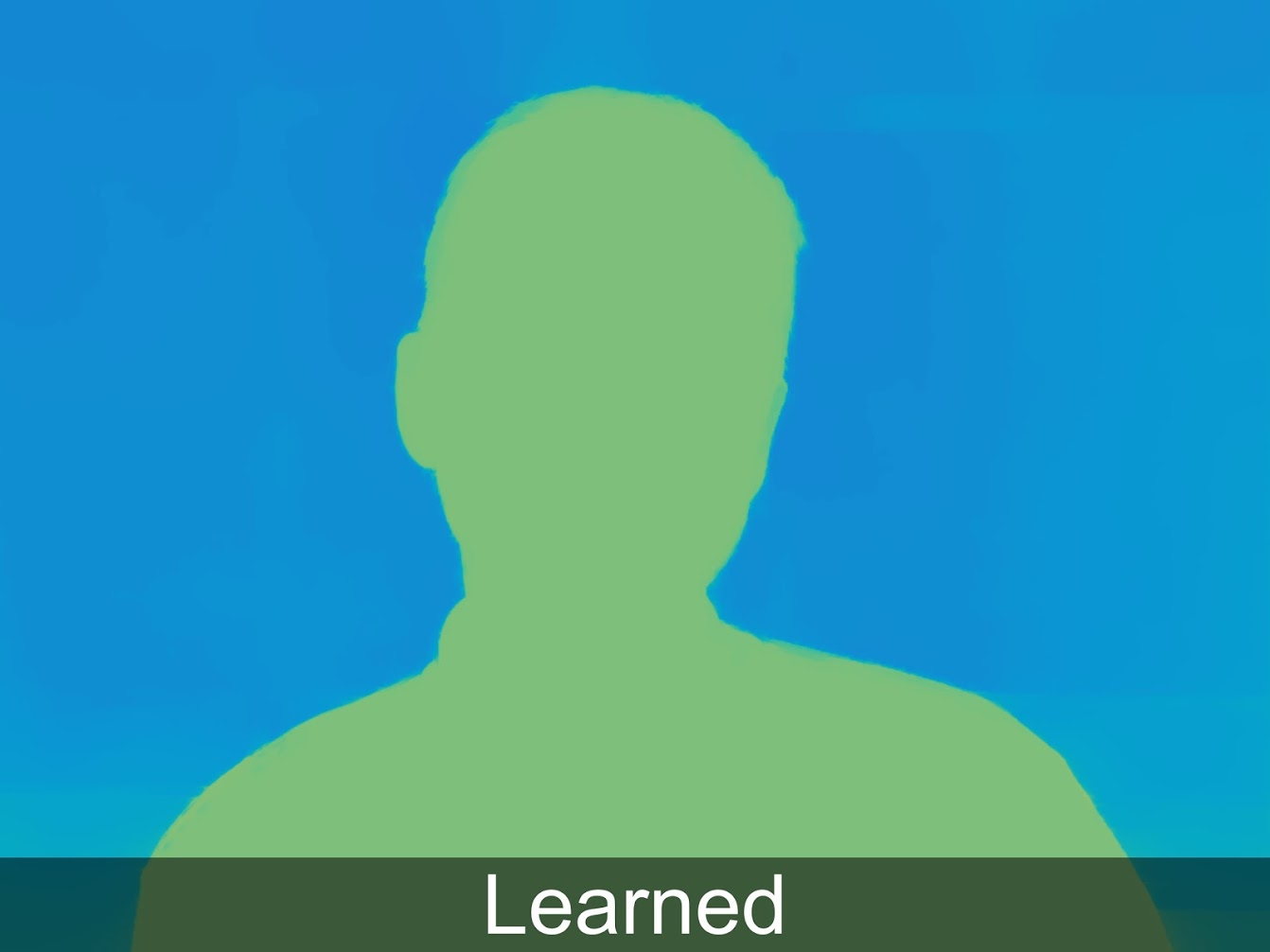

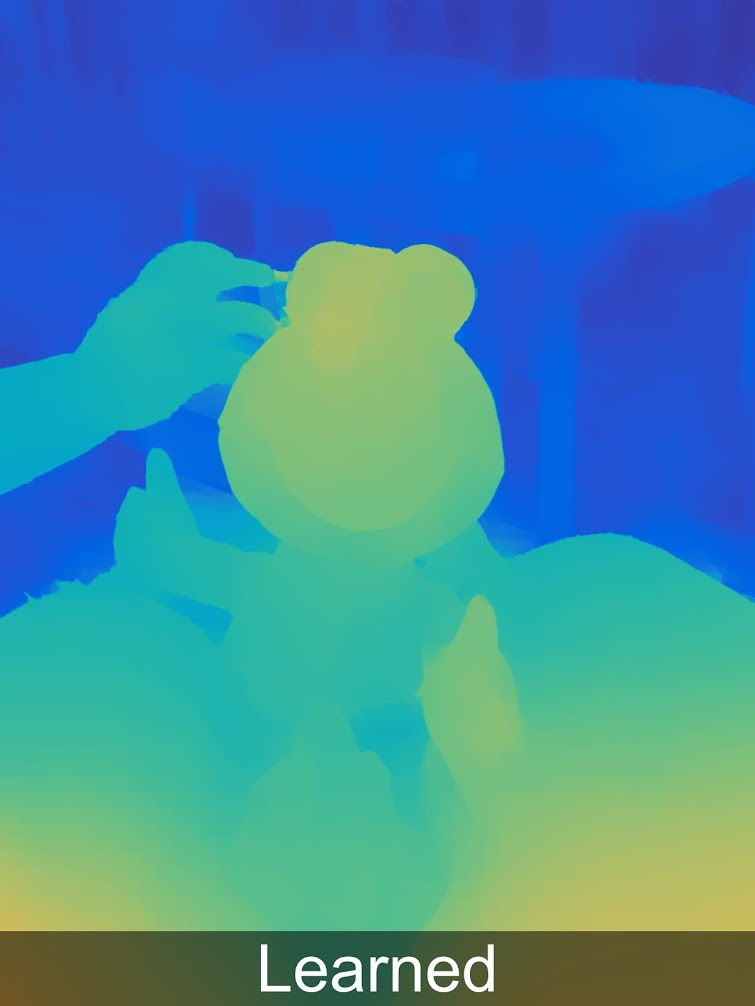

Dans le même temps, avec l'utilisation de l'apprentissage automatique, les résultats peuvent être considérablement améliorés et cela est déjà implémenté dans Pixel 3. Dans l'exemple ci-dessous, Learned signifie Stereo + Learned, plus à ce sujet, espérons-le, il y aura un article séparé:

Pour que les fans regardent la profondeur en pleine résolution, plus d'exemples

dans une galerie spéciale .

On voit clairement que tout n'est pas parfait, et nous avons des artefacts typiques qui sont typiques pour construire une carte de profondeur à partir de la stéréo (qui, soit dit en passant, sont également disponibles dans les collègues à deux yeux de Pixel), et un peu de parallaxe affecte. Mais il est déjà clair que la qualité de la profondeur est tout à fait suffisante pour segmenter l'image en fonction de la profondeur en toute confiance et imposer davantage d'effets différents, ajouter des objets à la scène avec plus de confiance, etc. Les résultats de la profondeur MESURÉE sont d'un ordre de grandeur meilleurs que les résultats basés sur diverses hypothèses (réseaux de neurones arbitraires).

Félicitations à tous ceux qui ont lu jusqu'à présent! Vous vivez pendant la sortie des caméras plénoptiques dans un produit grand public à succès, même si vous ne le savez même pas!

L'histoire ne s'arrête pas là, bien sûr:

- Premièrement, il est intéressant de noter que la plénoptique était "presque gratuite", car dans les appareils photo pour smartphones modernes, avec une miniaturisation du capteur et une augmentation de la résolution, il y a un manque catastrophique de flux lumineux, donc chaque pixel est recouvert d'une microlentille. Autrement dit, un tel capteur ne coûte pas plus cher (c'est très important!), Bien que nous sacrifions quelque peu une résolution que nous venons d'augmenter en raison d'une autre technologie . Grâce à l'application de deux technologies, le résultat devient meilleur en 2D (moins de bruit, une résolution plus élevée, HDR) et en même temps est complété par la profondeur mesurée, c'est-à-dire qu'il devient 3D. Le prix de l'émission est une augmentation spectaculaire du nombre de calculs par image. Mais pour les photos, cela est déjà possible aujourd'hui et fonctionne déjà dans de vrais smartphones.

- Deuxièmement, lors d'une conférence, un employé de Google a déclaré qu'il envisageait de couvrir 4 pixels avec un objectif, après quoi la qualité de la carte de profondeur sera considérablement plus élevée, car il y aura 2 paires stéréo avec une base stéréo 1,4 fois plus grande (deux diagonales), cela améliorera considérablement la qualité de la carte de profondeur, y compris de nombreux artefacts stéréo aux frontières. Les concurrents ne peuvent atteindre cette qualité qu'en plaçant au moins 3 caméras d'affilée. Une telle augmentation de la qualité est importante pour la RA.

- Troisièmement, Google n'est plus seul, voici un exemple de description d'une technologie similaire dans le Vivo V11 Pro, vous voyez, vous venez de voir une image similaire:

Source: Qu'est-ce que la technologie Dual Pixel?

Source: Qu'est-ce que la technologie Dual Pixel?Plenoptics est également utilisé dans la mise au point automatique d'appareils photo professionnels, par exemple avec

Canon (google

DPAF - Dual Pixel Auto Focus). Qui aurait pensé qu'une blague théorique d'il y a 30 ans - la possibilité de filmer en stéréo avec un objectif - serait la première application de masse de la plénoptique ...

En général - le sujet est allé aux produits!

Elle vole déjà! Vous voyez,

LE-TA-ET!

Pour résumer

Filmoptics au cinéma

Ci-dessus, nous avons examiné deux cas d'utilisation de la plénoptique - dans la production de films et dans les smartphones. Ce n'est pas une liste complète, par exemple, la plénoptique est très pertinente en

microscopie - vous pouvez faire

des micrographies stéréoscopiques calculées avec une grande profondeur de champ "honnête"; la plénoptique est pertinente pour les caméras industrielles, surtout si vous devez prendre des photos d'objets multiniveaux translucides, etc. Mais à ce sujet en quelque sorte une autre fois.

Rappelons que pour une utilisation dans la production de films sont pertinents:

- Distance de mise au point calculée

- Bokeh calculé

- Résolution calculée

- Stéréo parfaite calculée

- Point de prise de vue calculé

- Éclairage calculé

- Environnement calculé

- Écran vert calculé

- Obturateur calculé

Dans les années à venir, avec la miniaturisation et la résolution accrue des capteurs, la technologie peut être développée pour créer un appareil photo pratique et fondamentalement nouveau qui vous permet de supprimer du matériel pour appliquer des effets spéciaux plus rapidement (sans écran vert) et avec moins de prises (plus de points sont plus faciles à corriger). Les nouvelles fonctionnalités sont si intéressantes qu'au moment où le capteur plénoptique avec une résolution de film appropriée peut être rendu compact, ces caméras sont vouées au succès.

Quand un tel appareil photo peut-il apparaître?Une réponse prudente est dans les 10 prochaines années.

De quoi dépend le terme?De nombreux facteurs. Bonne question: quelle sera la situation avec la possibilité de concéder sous licence les brevets Lytro que Google possède maintenant? Cela peut être critique. Heureusement, les clés expireront dans 10 ans (ici nous ne nous souvenons pas poliment des collègues chinois de Lytro qui peuvent accélérer le processus). De plus, le travail avec des quantités colossales de données générées par la caméra plénoptique devrait être simplifié: avec les nuages modernes, cela devient plus facile et plus simple. Parmi les bonnes nouvelles - à une époque grâce à Lytro, dans un

programme de composition très populaire , qui est utilisé dans un grand nombre de studios pour le traitement stéréo, le format de données plénoptique a été pris en charge. Comme on dit, Lytro est mort, mais la possibilité d'écrire des plug-ins pour Nuke avec le support de la vidéo plénoptique est restée pour nous. Cela simplifie l '«entrée» sur ce marché avec un produit professionnel, car il est important que les studios puissent immédiatement travailler avec le format de nouvelles caméras sans formation de personnel et dans les mêmes programmes.

Plenoptika dans les smartphones

Si nous parlons de smartphones, alors tout semble encore mieux. Le plus pertinent pour cette industrie est la capacité de la caméra plénoptique à mesurer la profondeur avec un seul capteur (potentiellement rapidement) et cette fonctionnalité sera bientôt très demandée.

Quand un tel appareil photo peut-il apparaître?Existe déjà. Et demain, la technologie sera répétée par d'autres fabricants. De plus, le principal moteur de la prochaine étape sera

la réalité augmentée sur les smartphones et les tablettes, qui manque aujourd'hui de précision et de capacité à «voir» une scène en trois dimensions.

De quoi dépend le terme?La possibilité de mesurer la distance avec le capteur principal en temps réel devrait apparaître prochainement avec Google Pixel, puisque Google évolue depuis longtemps dans cette direction (voir

Projet Tango , qui est fermé, mais dont l'entreprise vit). Et

ARCore semble très prometteur, ainsi que l'

ARKit concurrent. Et la percée, comme vous le devinez maintenant, n'a pas à attendre longtemps, car la valeur du pixel du capteur diminue de façon exponentielle, ils appellent la vitesse moyenne 10 fois en 10 ans, et nous avons besoin d'une baisse de 2 fois. Alors comptez pour vous. Pas demain, mais pas pour longtemps.

Au lieu d'une conclusion

Rappelez-vous, au tout début, nous parlions d'une conférence à VGIK? Je dois dire que je ne m'attendais pas à la réaction à la fin. Pour le dire en un mot, c'était le deuil. Si en deux mots, alors le deuil universel. Et au début, je n'ai pas compris quel était le problème. L'opératrice qui est venue après la conférence m'a très bien expliqué la situation. Ce n'était même pas que l'art de la caméra diminuait. Bien qu'il y ait un excellent exemple: un fragment de film pendant environ 6 secondes, lorsqu'une personne s'approche de la porte de l'appartement, frappe, une autre personne ouvre la porte, salue et avance un peu, tandis que la caméra se concentre sur le couloir, puis sur l'encadrement de la porte, puis se concentre instantanément sur la personne qui l'a découvert, puis dans la pièce. Et l'opérateur doit parfaitement maîtriser l'appareil photo, de sorte qu'avec une

faible profondeur de champ de type cinéma, utilisez magistralement le zoom, en vous souvenant du rétro-éclairage, de la composition du cadre, du mal des transports lors de la prise de vue avec les mains et de 1000 autres petites choses importantes. Alors voilà. Ce n'est même pas que cela devient plus facile. C'est encore bon. Moins de prises seront gâchées, car l'opérateur quelque part n'a pas eu le temps ou n'a pas manqué. Il a raconté comment il avait récemment tourné une série en 4K pour la chaîne. Et le stock de résolution s'est avéré important. En conséquence, le réalisateur a coupé les images lors de la post-production, et à certains endroits, seuls des fragments de l'image ont été utilisés pour les interruptions. En conséquence, la composition était tout simplement horrible et cet opérateur voulait retirer son nom du générique.

Les caractéristiques des caméras décrites ci-dessus pour les cinéastes signifient le transfert de nombreux effets de la phase de prise de vue à la phase de post-production. Et il y aura une grande tristesse si ceux qui traiteront les scènes de tournage sont analphabètes en matière de composition, de contrôle de la distance de mise au point, etc. S'ils sont alphabétisés, ce sont de nouvelles opportunités fantastiques.

Nous souhaitons donc à chacun de nous plus de compétences, ce qui n'est pas toujours facile dans ce monde en mutation rapide!Et Carthage le fera ... toute la vidéo sera en trois dimensions d'ici la fin du siècle!Remerciements

Je remercie chaleureusement:

- Laboratoire d'infographie VMK Université d'État de Moscou MV Lomonosov pour sa contribution au développement de l'infographie en Russie et pas seulement

- Nos collègues du groupe vidéo, grâce auxquels vous avez vu cet article,

- personnellement Konstantin Kozhemyakov, qui a fait beaucoup pour rendre cet article meilleur et plus visuel,

- Jon Karafin quand il était responsable de la vidéo sur le champ lumineux de Lytro, grâce à quoi nous avons presque commencé à travailler sur l'amélioration de leur produit (et nous n'avons pas commencé pour des raisons indépendantes de notre volonté ou de notre part),

- Lytro pour leur contribution à la vulgarisation des champs lumineux et leurs capacités, Google, qui a pris le relais, et d'autres sociétés qui fabriquent des produits basés sur cette technologie intéressante,

- et enfin, un grand merci à Sergey Lavrushkin, Roman Kazantsev, Ivan Molodetsky, Evgeny Kuptsov, Yegor Sklyarov, Evgeny Lyapustin et Denis Kondranin pour un grand nombre de commentaires judicieux et de corrections qui ont rendu ce texte bien meilleur!