Ces dernières années, l'intérêt pour les modèles d'apprentissage automatique s'est accru, notamment pour la reconnaissance des images visuelles et des visages. Bien que la technologie soit loin d'être parfaite, elle vous permet déjà de calculer des criminels, de trouver des profils sur les réseaux sociaux, de suivre les changements et bien plus encore. Simen Thys et Wiebe Van Ranst ont prouvé qu'en n'apportant que des modifications mineures aux informations d'entrée du réseau neuronal convolutif, le résultat final peut être remplacé. Dans cet article, nous examinerons les correctifs visuels pour mener des attaques de reconnaissance.

Les premières attaques contre les systèmes de reconnaissance ont été de petits changements dans les pixels de l'image d'entrée pour tromper le classificateur et dériver la mauvaise classe.

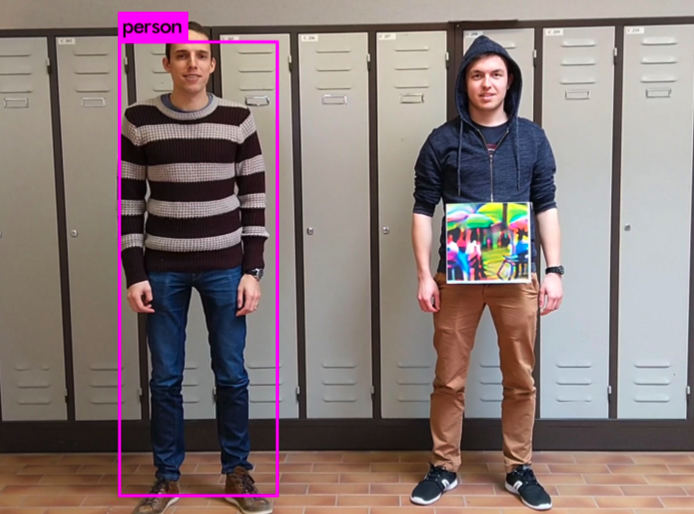

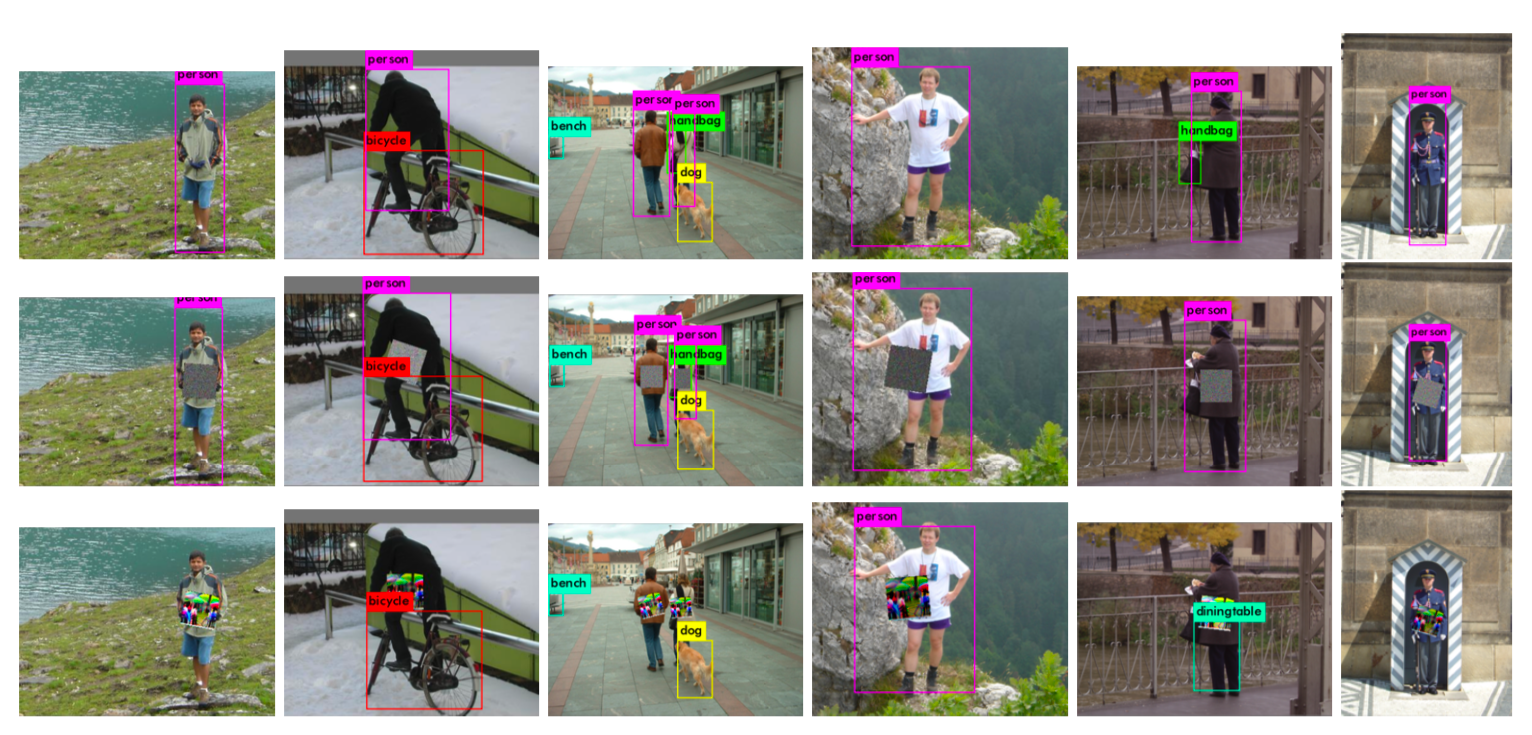

Le but était de créer un patch qui pourrait réussir à cacher une personne du détecteur. Le résultat a été un schéma d'attaque qui pourrait être utilisé, par exemple, pour contourner les systèmes de surveillance. Les attaquants peuvent se faufiler imperceptiblement, tenant devant eux une petite tablette en carton avec un «patch», visant la caméra de surveillance.

Le développement des

réseaux de neurones convolutifs (SNA) a conduit à un énorme succès dans le domaine de la vision par ordinateur. Un convoyeur de bout en bout basé sur les données dans lequel les SNA sont formés sur les images a montré les meilleurs résultats dans un large éventail de tâches de vision par ordinateur. En raison de la profondeur de ces architectures, les réseaux de neurones sont en mesure d'étudier les filtres les plus élémentaires au bas du réseau (où les données entrent) pour obtenir des fonctions abstraites de haut niveau au sommet. Pour cela, un SNA typique contient des millions de paramètres étudiés. Bien que cette approche conduise à des modèles très précis, l'interprétabilité est considérablement réduite.

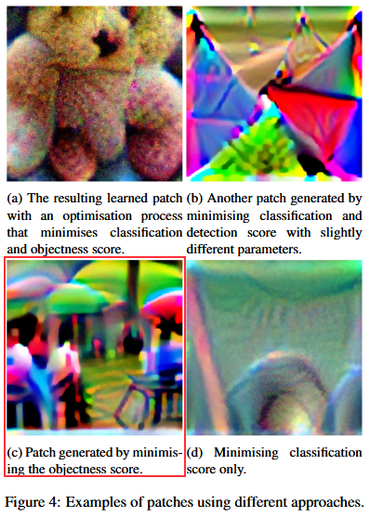

Dans la recherche, une variété d'images a été utilisée pour tromper les systèmes de surveillance, y compris le «bruit» abstrait et le flou.

Pour créer un patch, l'image d'origine a été utilisée, qui a subi les transformations suivantes:

- rotation de 20 degrés;

- superposition de bruit;

- flou

- modification de la luminosité;

- modification du contraste.

Les chercheurs ont effectué de nombreux

tests Inria pour déterminer la meilleure «dissimulation» d'une personne.

Pour obtenir l'effet souhaité, une image de 40x40 centimètres (indiquée par le mot patch dans le rapport d'expert) doit être située au milieu du boîtier de détection de la caméra et constamment dans son champ de vision. Bien sûr, cette méthode n'aidera pas une personne à cacher son visage, cependant, l'algorithme de détection de personnes ne sera en principe pas en mesure de détecter une personne dans le cadre, ce qui signifie que la reconnaissance ultérieure des traits du visage ne sera pas non plus lancée.

À titre de démonstration, les chercheurs ont publié une vidéo de démonstration des capacités des correctifs visuels:

Code de projet

GitHub .

Recherche .