Une étude réalisée en 2009 par How Much Information a montré que la quantité d'informations consommées par semaine a été multipliée par 5 depuis 1986. De 250 mille mots par semaine à 1,25 million! Depuis lors, ce chiffre a considérablement augmenté. Les indicateurs suivants sont stupéfiants: en 2018, le nombre d'utilisateurs d'Internet et des réseaux sociaux était de 4,021 milliards et 3,196 milliards. Une personne moderne analyse une quantité incroyable d'informations par jour, en utilisant divers plans et stratégies de traitement, pour prendre des décisions rentables. L'espèce humaine a généré 90% des informations dans ce monde au cours des deux dernières années. Maintenant, si vous arrondissez, nous produisons environ 2,5 quintillions d'octets (2,5 * 10 ^ 18 octets) de nouvelles informations par jour. Si vous divisez ce nombre par le nombre de personnes vivant actuellement, il s'avère qu'en moyenne, une personne crée 0,3 gigaoctets d'informations par jour.

Combien d'informations l'Homo sapiens prend-il? (ci-après dénommé Homo). Pour plus de simplicité en informatique, ils ont inventé un terme appelé bit. Le bit est la plus petite unité d'information. Un fichier avec ce travail prend plusieurs kilo-octets. Un tel document, il y a cinquante ans, occuperait toute la mémoire de l'ordinateur le plus puissant. Un livre moyen sous forme numérique occupe mille fois plus d'espace, ce qui représente des mégaoctets. Une photo de haute qualité sur un appareil photo puissant fait 20 mégaoctets. Un lecteur numérique est 40 fois plus grand. Des proportions intéressantes commencent par des gigaoctets. ADN humain, toutes les informations sur vous et moi sont d'environ 1,5 gigaoctets. Nous multiplions cela par sept milliards et obtenons 1,05x10 ^ 19 octets. En général, nous pouvons produire un tel volume d'informations dans des conditions modernes en 10 jours. Ce nombre de bits décrira toutes les personnes vivant actuellement.

Et ce ne sont que des données sur les gens eux-mêmes, sans interactions entre eux, sans interactions avec la nature et la culture, qu'une personne a créées pour elle-même. Dans quelle mesure ce chiffre augmentera-t-il si nous ajoutons les variables et les incertitudes de l'avenir? Chaos serait un bon mot.

L'information a une propriété incroyable. Même quand elle n'est pas là, elle l'est. Et ici, nous avons besoin d'un exemple. La biologie comportementale a une expérience célèbre. En face de l'autre, il y a deux cellules. Chez le 1er singe de haut rang. Mâle alpha. Dans la 2ème cage, un singe avec un statut inférieur, un mâle bêta. Les deux singes peuvent regarder leurs homologues. Ajoutez un facteur d'influence à l'expérience. Entre deux cellules, nous mettons une banane. Un mâle bêta n'osera pas prendre une banane s'il sait que le mâle alpha a également vu cette banane. Car il ressent immédiatement toute l'agression du mâle alpha. De plus, les conditions initiales de l'expérience sont légèrement modifiées. Une cellule mâle alpha est recouverte d'un tissu opaque pour le priver de vue. En répétant tout ce qui a été fait auparavant, l'image devient complètement différente. Le mâle bêta arrive et prend une banane sans aucun remords.

Tout dépend de sa capacité à analyser, il sait que le mâle alpha n'a pas vu comment mettre une banane et pour lui une banane n'existe tout simplement pas. Le mâle bêta a analysé le fait qu'il n'y avait aucun signal sur l'apparition d'informations sur la banane chez le mâle alpha et a profité de la situation. Un diagnostic spécifique est posé à un patient dans de nombreux cas lorsqu'il présente certains symptômes, mais un grand nombre de maladies, virus et bactéries peuvent même confondre un médecin expérimenté, comment peut-il déterminer un diagnostic précis sans passer de temps, ce qui peut être vital pour le patient? Tout est simple. Il analyse non seulement les symptômes du patient, mais aussi ceux qu'il n'a pas, ce qui réduit le temps de recherche de dizaines de fois. Si quelque chose ne donne pas tel ou tel signal, il véhicule également certaines informations - généralement de nature négative, mais pas toujours. Analysez non seulement les signaux d'information qui existent, mais aussi ceux qui n'existent pas.

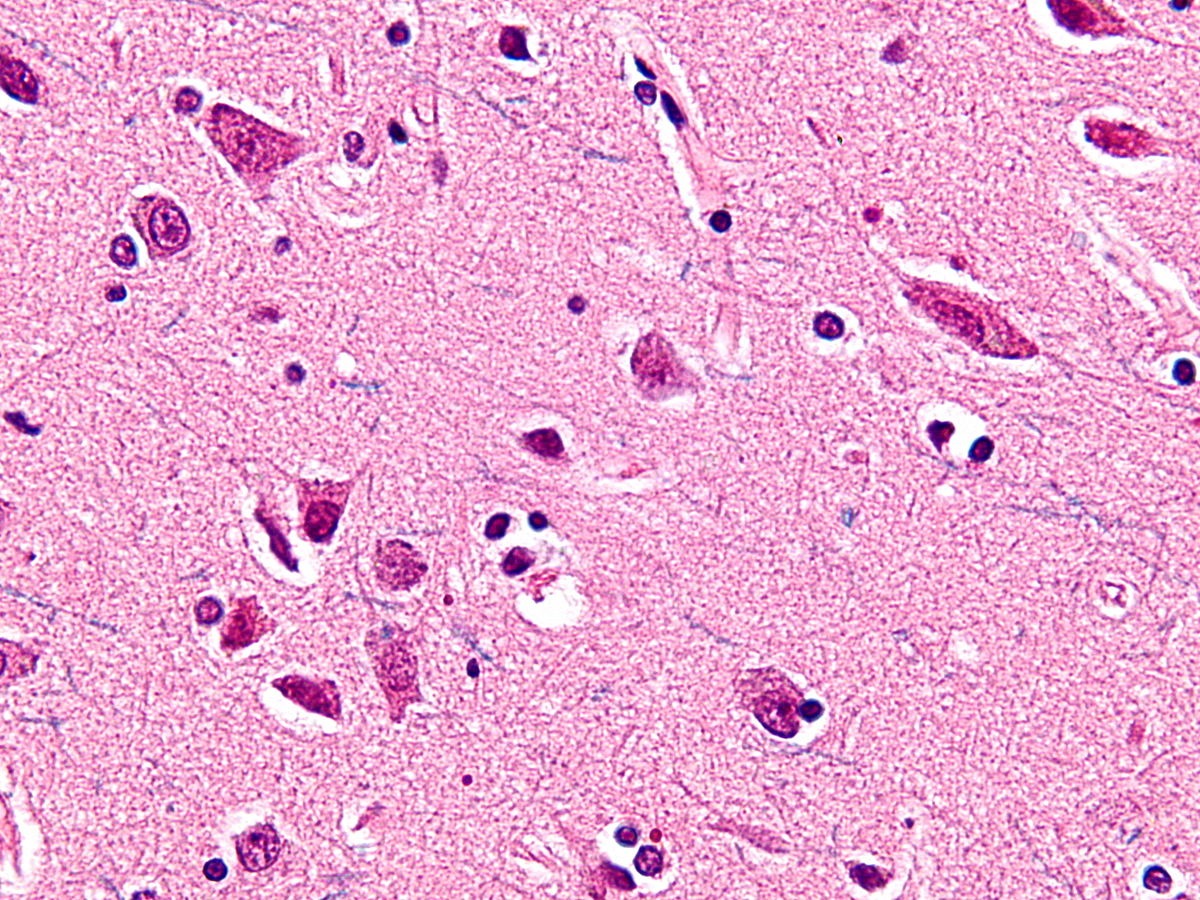

Ces exemples ajoutent des zéros et des uns aux nombres ci-dessus. En relation avec les chiffres et problèmes ci-dessus, un certain nombre de questions se posent. Comment? Comment avez-vous réussi à y parvenir? Le corps / la société est-il capable de fonctionner normalement dans de telles conditions? Comment l'information affecte les types de systèmes biologiques, économiques et autres. La quantité d'informations que nous percevons en 2019 semblera rare pour la postérité à partir de 2050. Déjà, la vue crée de nouveaux schémas et modèles de travail avec l'information, en étudiant ses propriétés et son impact. Phrase: «« J'ai vécu un million d'années en un an »n'est plus une blague et non une absurdité, mais une réalité. La quantité d'informations qu'une personne crée affecte la vie sociale, économique, culturelle et même biologique. En 1980, ils rêvaient de créer un ordinateur quantique pour augmenter la puissance de calcul. Rêve d'une vue. Les découvertes qui promettaient cette invention devaient anticiper une nouvelle ère. En 2018, IBM a lancé le premier ordinateur quantique commercial, mais personne ne l'a remarqué. La nouvelle a été discutée par un nombre incroyablement restreint de personnes. Elle vient de se noyer dans l'abondance d'informations dans laquelle nous existons maintenant. Le principal domaine de recherche de ces dernières années est devenu les neurosciences, les algorithmes, les modèles mathématiques, l'intelligence artificielle, ce qui indique généralement la recherche de la possibilité d'un fonctionnement normal dans un environnement enrichi d'informations. En 1929, des neurones von Economo ont été découverts, qui ne se trouvent que dans des groupes d'animaux très sociaux. Il existe une corrélation directe entre la taille du groupe et la taille du cerveau, plus le groupe d'animaux est grand, plus la taille de leur cerveau par rapport au corps est grande. Il n'est pas surprenant que les neurones von Economo ne se trouvent que chez les cétacés, les éléphants et les primates. Les neurones Von Economo sont responsables de la transmission de grandes quantités d'informations dans le cerveau.

tandis que A.G. Loukachenko ne leur a pas interdit de communiquer, regardez-les

tandis que A.G. Loukachenko ne leur a pas interdit de communiquer, regardez-lesCe type de neurone est une adaptation neuronale dans de très gros cerveaux, qui permet de traiter et de transmettre rapidement des informations sur des projections très spécifiques, qui ont évolué en relation avec de nouveaux comportements sociaux. La présence apparente de ces neurones spécialisés uniquement chez les mammifères hautement intelligents peut être un exemple d'évolution convergente. De nouvelles informations génèrent toujours de nouveaux modèles et relations qualitativement différents. Les modèles sont établis uniquement sur la base d'informations. Exemple, un primate frappe une pierre sur l'os d'un buffle mort. Un coup et l'os se brise en deux parties. Un coup de plus et une pause de plus. Le troisième coup et quelques fragments de plus. Le motif est clair. Une frappe osseuse et au moins un nouvel éclat. Les primates sont-ils aussi bons pour reconnaître les modèles? Nombreux rapports sexuels et accouchement retardé après neuf mois.

Combien de temps a-t-il fallu pour relier ces deux événements? Pendant longtemps, l'accouchement n'était pas du tout associé à des actes sexuels entre un homme et une femme. Dans la plupart des cultures et des religions, les dieux étaient responsables de la naissance d'une nouvelle vie. La date exacte de la découverte de ce modèle, malheureusement, n'a pas encore été établie. Cependant, il convient de noter qu'il existe encore des sociétés fermées de chasseurs-cueilleurs qui ne lient pas ces processus, et pour leur naissance, il existe des rituels spéciaux effectués par le chaman. La principale cause de mortalité infantile avant l'accouchement avant 1920 était les mains sales. Des mains propres et un enfant vivant sont également un exemple d'une régularité non évidente. Voici un autre exemple d'un schéma qui est resté implicite jusqu'en 1930. De quoi tu parles? À propos des groupes sanguins. En 1930, Landsteiner a reçu le prix Nobel pour cette découverte. Jusqu'à présent, la connaissance qu'une personne peut être transfusée avec un groupe sanguin qui correspond au donneur avec les nécessiteux n'était pas claire. Il existe des milliers d'exemples similaires. Il convient de noter que la recherche de modèles est ce que l'espèce fait tout le temps. Un homme d'affaires qui trouve un modèle dans le comportement ou les besoins des gens, puis gagne sur ce modèle pendant de nombreuses années. Recherche scientifique sérieuse qui permet de prédire le changement climatique, les migrations humaines, de trouver des lieux d'exploitation minière, des comètes cycliques, le développement de l'embryon, l'évolution des virus et comme la pointe, le comportement des neurones dans le cerveau. Bien sûr, tout peut s'expliquer par la structure de l'univers dans lequel nous vivons, et la deuxième loi de la thermodynamique selon laquelle l'entropie est en constante augmentation, mais ce niveau ne convient pas à des fins pratiques. Vous devez choisir plus proche de la vie. Le niveau de biologie et d'informatique.

Qu'est-ce que l'information? Selon les croyances populaires, l'information est une information quelle que soit la forme de sa présentation ou la solution au problème de l'incertitude. En physique, l'information est une mesure de l'ordre d'un système. En théorie de l'information, la définition de ce terme est la suivante: l'information est des données, des bits, des faits ou des concepts, un ensemble de valeurs. Tous ces concepts sont vagues et inexacts; de plus, je pense qu'ils sont un peu erronés.

Pour le prouver, nous avons avancé la thèse - l'information elle-même n'a pas de sens. Quel est le chiffre «3»? Ou quelle est la lettre «A»? Un symbole sans valeur assignée. Mais quel est le nombre «3» dans le graphique du groupe sanguin? C'est le sens qui sauvera une vie. Cela affecte déjà la stratégie comportementale. Un exemple porté au point d'absurdité, mais sans perdre sa signification. Douglas Adams a écrit le Guide de l'auto-stoppeur de la galaxie. Dans ce livre, l'ordinateur quantique créé était censé répondre à la question principale de la vie et de l'univers. Quel est le sens de la vie et de l'univers? La réponse a été reçue après sept millions et demi d'années d'informatique continue. L'ordinateur a conclu en vérifiant à plusieurs reprises l'exactitude de la valeur que la réponse était «42». Les exemples ci-dessus montrent clairement que les informations sans l'environnement externe dans lequel elles se trouvent (contexte) ne signifient rien. Le nombre «2» peut signifier le nombre d'unités monétaires, les patients atteints d'ebola, les enfants heureux, ou être un indicateur de l'érudition d'une personne dans une certaine affaire. Pour une preuve supplémentaire, passons au monde de la biologie: les feuilles des plantes ont souvent la forme d'un demi-cercle et se lèvent d'abord vers le haut, s'étendant, mais après un certain point de réfraction, elles s'étirent vers le bas, se rétrécissant. Dans l'ADN, comme dans les principaux vecteurs d'information ou de valeurs, il n'y a pas de gène qui code leur traction vers le bas après un certain point. Le fait que la feuille de la plante s'étire est un tour de force.

L'ADN lui-même, celui des plantes, celui des mammifères, celui de l'Homo Sapiens déjà mentionné, porte peu ou pas d'informations. L'ADN est un ensemble de significations dans un environnement particulier. L'ADN porte principalement des facteurs de transcription, quelque chose qui doit être activé par un certain environnement extérieur. Placez l'ADN végétal / humain dans un environnement avec une atmosphère ou une gravité différente, et le résultat sera un produit différent. Par conséquent, le transfert de notre ADN à des fins de recherche vers des formes de vie extraterrestres est une occupation plutôt stupide. Il est possible, au milieu d'eux, que l'ADN humain se transforme en quelque chose de plus horrible qu'un primate bipède en érection avec un pouce en saillie et des idées sur l'égalité. Les informations sont des valeurs / données / bits / matière sous quelque forme que ce soit et en connexion continue avec l'environnement, le système ou le contexte. L'information n'existe pas sans facteurs, systèmes ou contextes environnementaux. Ce n'est que inextricablement lié à ces conditions que les informations peuvent transmettre des significations. Dans le langage des mathématiques ou de la biologie, l'information n'existe pas sans un environnement externe ou des systèmes dont elle affecte les variables. L'information est toujours un appendice des circonstances dans lesquelles elle se déplace. Cet article abordera les principales idées de la théorie de l'information. Actes de l'activité intellectuelle de Claude Shannon, Richard Feynman.

Une caractéristique distinctive de l'espèce est la capacité de créer des abstractions et de construire des modèles. Représenter certains phénomènes à travers d'autres. Nous codons. Les photons sur la rétine créent des images, les vibrations de l'air sont converties en sons. Nous associons un certain son à une certaine image. L'élément chimique dans l'air, avec ses récepteurs dans le nez, nous interprétons comme une odeur. Grâce à des dessins, des images, des hiéroglyphes et des sons, nous pouvons relier des événements et transmettre des informations.

donc il encode réellement votre réalité

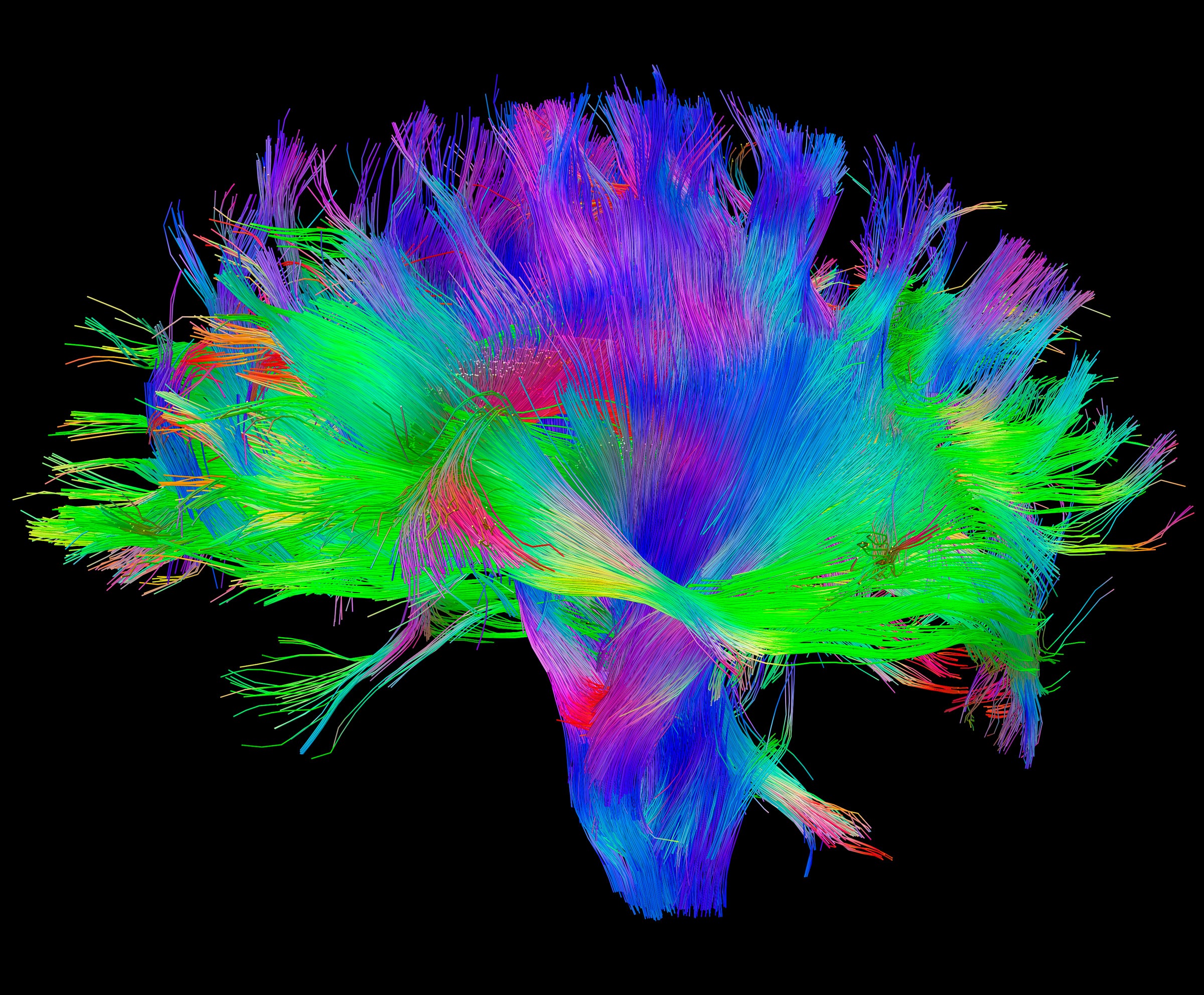

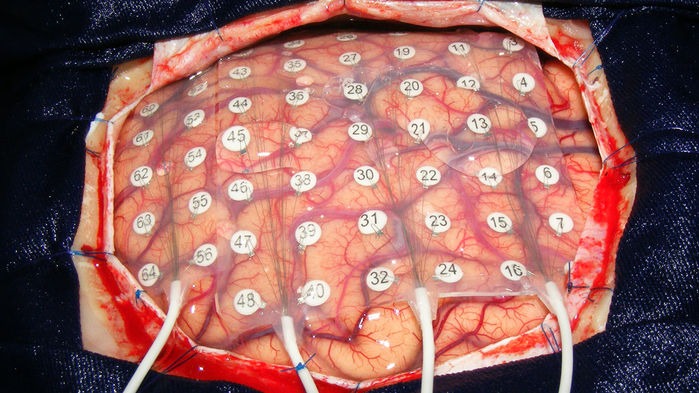

donc il encode réellement votre réalitéCe codage et ces abstractions ne doivent pas être sous-estimés, rappelez-vous simplement à quel point cela affecte les gens. Les encodages peuvent prévaloir sur les programmes biologiques, une personne pour le bien d'une idée (une image dans sa tête qui définit une stratégie de comportement) refuse de transférer davantage des copies de ses gènes. Ou souvenez-vous de la pleine puissance des formules physiques qui nous ont permis d'envoyer un représentant d'une espèce dans l'espace. Équations chimiques qui aident à traiter les gens, etc. De plus, nous pouvons encoder ce qui est déjà encodé. L'exemple le plus simple est une traduction d'une langue à une autre. Un code est présenté sous la forme d'un autre. La facilité de transformation, comme principal facteur de réussite de ce processus, vous permet de le rendre sans fin. Vous pouvez traduire l'expression du japonais au russe, du russe à l'espagnol, de l'espagnol au système binaire, de celui-ci au code Morse, puis le présenter en braille, puis sous la forme d'un code informatique, puis le mettre directement dans le cerveau sous la forme d'impulsions électriques où il décode le message. Récemment, ils ont procédé au processus inverse et décodé l'activité cérébrale en paroles.

mettez des électrodes dans l'image ci-dessus et considérez toute votre unicité

mettez des électrodes dans l'image ci-dessus et considérez toute votre unicitéIl y a quarante à vingt mille ans, les primitifs ont commencé à encoder activement des informations sous forme de codes de la parole ou des gestes, des peintures rupestres. Les gens modernes, observant les premières peintures rupestres, tentent de déterminer (décoder) leur signification, la recherche de significations est une autre caractéristique distinctive de l'espèce. En reconstruisant le contexte de certains marqueurs ou vestiges d'informations, les anthropologues modernes tentent de comprendre la vie des primitifs. La quintessence du processus de codage est incarnée sous forme d'écriture. L'écriture a résolu le problème de la perte d'informations lors de sa transmission non seulement dans l'espace mais aussi dans le temps. Les hiéroglyphes de nombres vous permettent d'encoder des calculs, des mots, des objets, etc. Cependant, si le problème est résolu avec plus de précision avec précision, si bien sûr les deux participants au processus de communication utilisent les mêmes accords conditionnels sur l'interprétation et le décodage des mêmes caractères (hiéroglyphes), alors l'écriture imprimée a échoué avec le temps et la vitesse de transmission. Pour résoudre le problème de vitesse, des systèmes de radio et de télécommunications ont été inventés. L'étape clé du développement du transfert d'informations peut être considérée comme deux idées. Le premier est les canaux de communication numériques, et le second est le développement de l'appareil mathématique. Les canaux de communication numériques ont résolu le problème de la vitesse de transfert de l'information et de l'appareil mathématique dans sa précision.

Tout canal présente un certain niveau de bruit et d'interférence, en raison duquel les informations sont associées à des interférences (un ensemble de valeurs et de caractères sont déformés, le contexte est perdu) ou ne viennent pas du tout. Avec le développement de la technologie, la quantité de bruit dans les canaux de communication numériques a diminué, mais n'a jamais été réduite à zéro. À mesure que la distance augmentait, elle augmentait généralement. Le problème clé qui doit être résolu lorsque des informations sont perdues dans les canaux de communication numériques a été

identifié et résolu par Claude Shannon en 1948, et il a également inventé le terme bit. Cela ressemble à ceci: - «Laissez la source du message avoir l'entropie (H) pendant une seconde, et (C) la bande passante du canal. Si H <C ou H = C, alors un tel codage des informations est possible dans lequel les données source seront transmises par le canal avec un nombre arbitrairement faible d'erreurs. "

mais ils ne vous ont pas appelé pour jouer à ce jeu

mais ils ne vous ont pas appelé pour jouer à ce jeuCette formulation du problème est à l'origine du développement rapide de la théorie de l'information. Les principaux problèmes qu'elle résout et essaie de résoudre sont que les canaux numériques, comme mentionné ci-dessus, ont du bruit. Ou nous le formulons comme suit - «il n'y a pas de fiabilité absolue du canal dans la transmission des informations». C'est-à-dire les informations peuvent être perdues, déformées, remplies d'erreurs en raison des influences environnementales sur le canal de transmission d'informations. Claude Shannon, a avancé un certain nombre de thèses, dont il s'ensuit que la capacité de transmettre des informations sans perte et sans modifications, c'est-à-dire avec une précision absolue, existe dans la plupart des canaux avec bruit. En fait, il a permis à Homo Sapiens de ne pas consacrer d'efforts à l'amélioration des canaux de communication. Au lieu de cela, il a proposé le développement de schémas de codage et de décodage plus efficaces pour l'information. Présentez les informations sous la forme de 0 et 1. L'idée peut être étendue aux abstractions mathématiques ou au codage linguistique. Démontrer l'efficacité de l'idée peut être un exemple. Le scientifique observe le comportement des quarks au collisionneur de hadrons, il saisit ses données dans un tableau et analyse, affiche la régularité sous forme de formules, formule les principales tendances sous forme d'équations ou écrit sous forme de modèles mathématiques, facteurs affectant le comportement des quarks. Il doit transférer ces données sans perte. Il fait face à une série de questions. Utiliser ou transmettre un canal de communication numérique via votre assistant ou appeler et tout dire personnellement? Le temps est extrêmement court et les informations doivent être transmises d'urgence, c'est pourquoi le courrier électronique est supprimé. L'assistant est un canal de communication absolument peu fiable avec une probabilité de bruit proche de l'infini.

En tant que canal de communication, il choisit d'appeler.Avec quelle précision peut-il reproduire les données du tableau? Si le tableau comporte une ligne et deux colonnes, il est assez précis. Et s'il y a dix mille lignes et cinquante colonnes? Au lieu de cela, il véhicule un modèle codé sous la forme d'une formule. S'il était dans une situation où il pouvait transférer la table sans pertes et était sûr qu'un autre participant au processus de communication en viendrait aux mêmes schémas, et si le temps n'était pas un facteur d'influence, alors la question n'aurait aucun sens. Cependant, la régularité déduite sous forme de formule réduit le temps de décodage, il est moins sensible aux transformations et au bruit lors de la transmission d'informations. Des exemples de tels encodages dans le cours seront donnés plusieurs fois. Un canal de communication peut être considéré comme un disque, une personne, du papier, une antenne parabolique, un téléphone, un câble à travers lequel les signaux transitent.L'encodage élimine non seulement le problème de la perte d'informations, mais aussi le problème de son volume. En utilisant le codage, vous pouvez réduire la dimension, réduire la quantité d'informations. Après lecture du livre, la probabilité de relire le livre sans perte d'information tend à zéro, en l'absence de syndrome savant. Après avoir codé (formulé) l'idée principale du livre sous la forme d'une certaine déclaration, nous présentons sa brève revue. La tâche principale du codage est de raccourcir la formulation du signal d'origine sans perte d'informations pour sa transmission sur une grande distance hors du temps à un autre participant à la communication, afin que le participant ait pu le décoder efficacement. Une page Web, une formule, une équation, un fichier texte, une image numérique, de la musique numérisée, une image vidéo sont autant d'exemples saisissants d'encodages.En utilisant le codage, vous pouvez réduire la dimension, réduire la quantité d'informations. Après lecture du livre, la probabilité de relire le livre sans perte d'information tend à zéro, en l'absence de syndrome savant. Après avoir codé (formulé) l'idée principale du livre sous la forme d'une certaine déclaration, nous présentons sa brève revue. La tâche principale du codage est de raccourcir la formulation du signal d'origine sans perte d'informations pour sa transmission sur une grande distance hors du temps à un autre participant à la communication, afin que le participant ait pu le décoder efficacement. Une page Web, une formule, une équation, un fichier texte, une image numérique, de la musique numérisée, une image vidéo sont autant d'exemples saisissants d'encodages.En utilisant le codage, vous pouvez réduire la dimension, réduire la quantité d'informations. Après lecture du livre, la probabilité de relire le livre sans perte d'information tend à zéro, en l'absence de syndrome savant. Après avoir codé (formulé) l'idée principale du livre sous la forme d'une certaine déclaration, nous présentons sa brève revue. La tâche principale du codage est de raccourcir la formulation du signal d'origine sans perte d'informations pour sa transmission sur une grande distance hors du temps à un autre participant à la communication, afin que le participant ait pu le décoder efficacement. Une page Web, une formule, une équation, un fichier texte, une image numérique, de la musique numérisée, une image vidéo sont autant d'exemples saisissants d'encodages.la probabilité de relire le livre sans perte d'information tend à zéro, en l'absence de syndrome savant. Après avoir codé (formulé) l'idée principale du livre sous la forme d'une certaine déclaration, nous présentons sa brève revue. La tâche principale du codage est de raccourcir la formulation du signal d'origine sans perte d'informations pour sa transmission sur une grande distance hors du temps à un autre participant à la communication, afin que le participant ait pu le décoder efficacement. Une page Web, une formule, une équation, un fichier texte, une image numérique, de la musique numérisée, une image vidéo sont autant d'exemples saisissants d'encodages.la probabilité de relire le livre sans perte d'information tend à zéro, en l'absence de syndrome savant. Après avoir codé (formulé) l'idée principale du livre sous la forme d'une certaine déclaration, nous présentons sa brève revue. La tâche principale du codage est de raccourcir la formulation du signal d'origine sans perte d'informations pour sa transmission sur une grande distance hors du temps à un autre participant à la communication, afin que le participant ait pu le décoder efficacement. Une page Web, une formule, une équation, un fichier texte, une image numérique, de la musique numérisée, une image vidéo sont autant d'exemples saisissants d'encodages.La tâche principale du codage est de raccourcir la formulation du signal d'origine sans perte d'informations pour sa transmission sur une grande distance hors du temps à un autre participant à la communication, afin que le participant ait pu le décoder efficacement. Une page Web, une formule, une équation, un fichier texte, une image numérique, de la musique numérisée, une image vidéo sont autant d'exemples saisissants d'encodages.La tâche principale du codage est de raccourcir la formulation du signal d'origine sans perte d'informations pour sa transmission sur une grande distance hors du temps à un autre participant à la communication, afin que le participant ait pu le décoder efficacement. Une page Web, une formule, une équation, un fichier texte, une image numérique, de la musique numérisée, une image vidéo sont autant d'exemples saisissants d'encodages.Les problèmes de précision de transmission, de distance, de temps et de processus de codage ont été résolus à un degré ou à un autre, ce qui a permis de créer des informations plusieurs fois plus qu'une personne n'est capable de percevoir, de trouver des modèles qui passeront inaperçus pendant longtemps. Il existe un certain nombre d'autres problèmes. Où stocker un tel volume d'informations? Comment conserver? Il s'est avéré que le codage et les appareils mathématiques modernes ne résolvent pas complètement les problèmes de stockage. Il y a une limite au raccourcissement des informations et une limite à leur codage, après quoi il n'est pas possible de décoder les valeurs en retour. Comme déjà mentionné ci-dessus, un ensemble de valeurs sans contexte ni environnement externe ne transporte plus d'informations. Cependant, il est possible de coder séparément des informations sur l'environnement externe et l'ensemble de valeurs, puis de les combiner sous forme de certains indices et de décoder les indices eux-mêmes,cependant, les valeurs d'origine sur l'ensemble de valeurs et l'environnement externe doivent encore être stockées quelque part. De merveilleuses idées ont été proposées, qui sont maintenant utilisées partout, mais elles seront examinées dans un autre article.Pour l'avenir, nous pouvons donner un exemple du fait qu'il n'est pas nécessaire de décrire tout l'environnement extérieur, nous ne pouvons que formuler les conditions de son existence sous forme de lois et de formules. Qu'est-ce que la science? La science est le plus haut degré de mimétisme sur la nature. Les réalisations scientifiques sont une incarnation abstraite de phénomènes réels. L'une des solutions au problème du stockage de l'information a été décrite dans un charmant article de Richard Feynman «Il y a beaucoup d'espace ci-dessous: une invitation à un nouveau monde de la physique». Cet article est souvent considéré comme le travail qui a jeté les bases du développement de la nanotechnologie. Dans ce document, le physicien suggère de prêter attention aux caractéristiques étonnantes des systèmes biologiques, en tant que dépositaires d'informations. Dans les systèmes miniatures et minuscules, une quantité incroyablement importante de données sur le comportement est contenue - la façon dont elles stockent et utilisent les informations ne peut que susciter l'admiration. Si nous parlons de la quantité de systèmes biologiques pouvant stocker des informations, le magazine Nature a estimé que toutes les informations, valeurs, données et modèles du monde peuvent être écrits dans un stockage d'ADN pesant jusqu'à un kilogramme. C'est toute la contribution à l'univers, un kilogramme de matière. L'ADN est une structure extrêmement efficace pour le stockage d'informations, qui vous permet de stocker et d'utiliser des ensembles de valeurs dans des volumes énormes. Si quelqu'un est intéressé, alors iciun article qui explique comment enregistrer des photos de chats et généralement toutes les informations dans un référentiel d'ADN, même des chansons scriptonites (utilisation extrêmement stupide de l'ADN). Il encode que vous écoutez les orduresFeynman attire l'attention sur la quantité d'informations codées dans les systèmes biologiques, que dans le processus d'existence, elles codent non seulement les informations, mais modifient également la structure de la matière sur la base de cela. Si jusqu'à présent toutes les idées proposées étaient basées uniquement sur le codage d'un ensemble de valeurs ou d'informations en tant que telles, alors après cet article, la question était déjà dans le codage de l'environnement externe au sein de molécules individuelles. Encodez et modifiez la matière au niveau atomique, enfermez-y des informations, etc. Par exemple, il suggère de créer des fils de connexion avec un diamètre de plusieurs atomes. Ceci, à son tour, augmentera le nombre de composants informatiques d'un facteur de millions, et une telle augmentation des éléments améliorera qualitativement la puissance de calcul des futures machines intelligentes. Feynman, en tant que créateur de l'électrodynamique quantique et de l'homme,qui a participé au développement de la bombe atomique, a parfaitement compris que l'encodage de la matière n'est pas quelque chose de fantastique, mais semble être un processus normal dans la réalité observée.Il souligne que la physique n'interdit pas la création d'objets atome par atome. Dans l'article, il recourt à comparer les activités de l'homme et de la machine, en faisant attention au fait que tout représentant de l'espèce peut facilement reconnaître les visages des personnes, contrairement aux ordinateurs, pour qui à l'époque c'était une tâche en dehors de la puissance de calcul. Il pose un certain nombre de questions importantes de "qu'est-ce qui empêche la création d'une copie ultra-petite de quelque chose?" à «la différence entre les ordinateurs et le cerveau humain uniquement dans le nombre d'éléments constitutifs?», il décrit également les mécanismes et les principaux problèmes de création de quelque chose de taille atomique.Les contemporains estimaient le nombre de neurones cérébraux à environ 86 milliards, naturellement, pas un seul ordinateur, alors et maintenant, approchait de cette valeur, car il s'est avéré que ce n'était pas nécessaire. Cependant, le travail de Richard Feynman a commencé à déplacer l'idée de l'information vers le bas, où il y a beaucoup d'espace. L'article a été publié en 1960, après la parution de l'œuvre d'Alan Turing «Computers and Mind» de l'une des œuvres les plus citées du genre. Par conséquent, une comparaison des activités humaines et des ordinateurs était une tendance qui se reflétait dans l'article de Richard Feynman.Grâce à la contribution directe du physicien, le coût du stockage des données diminue chaque année, les technologies cloud se développent à un rythme insensé, un ordinateur quantique a été créé, nous écrivons des données dans des stockages d'ADN et faisons du génie génétique, ce qui prouve une fois de plus que la matière peut être modifiée et encodée. Le prochain article parlera du chaos, de l'entropie, des ordinateurs quantiques, des araignées, des fourmis, des modèles de Markov cachés et de la théorie des catégories. Il y aura plus de mathématiques, de punk rock et d'adn. Suite ici dans cet article .

Il encode que vous écoutez les orduresFeynman attire l'attention sur la quantité d'informations codées dans les systèmes biologiques, que dans le processus d'existence, elles codent non seulement les informations, mais modifient également la structure de la matière sur la base de cela. Si jusqu'à présent toutes les idées proposées étaient basées uniquement sur le codage d'un ensemble de valeurs ou d'informations en tant que telles, alors après cet article, la question était déjà dans le codage de l'environnement externe au sein de molécules individuelles. Encodez et modifiez la matière au niveau atomique, enfermez-y des informations, etc. Par exemple, il suggère de créer des fils de connexion avec un diamètre de plusieurs atomes. Ceci, à son tour, augmentera le nombre de composants informatiques d'un facteur de millions, et une telle augmentation des éléments améliorera qualitativement la puissance de calcul des futures machines intelligentes. Feynman, en tant que créateur de l'électrodynamique quantique et de l'homme,qui a participé au développement de la bombe atomique, a parfaitement compris que l'encodage de la matière n'est pas quelque chose de fantastique, mais semble être un processus normal dans la réalité observée.Il souligne que la physique n'interdit pas la création d'objets atome par atome. Dans l'article, il recourt à comparer les activités de l'homme et de la machine, en faisant attention au fait que tout représentant de l'espèce peut facilement reconnaître les visages des personnes, contrairement aux ordinateurs, pour qui à l'époque c'était une tâche en dehors de la puissance de calcul. Il pose un certain nombre de questions importantes de "qu'est-ce qui empêche la création d'une copie ultra-petite de quelque chose?" à «la différence entre les ordinateurs et le cerveau humain uniquement dans le nombre d'éléments constitutifs?», il décrit également les mécanismes et les principaux problèmes de création de quelque chose de taille atomique.Les contemporains estimaient le nombre de neurones cérébraux à environ 86 milliards, naturellement, pas un seul ordinateur, alors et maintenant, approchait de cette valeur, car il s'est avéré que ce n'était pas nécessaire. Cependant, le travail de Richard Feynman a commencé à déplacer l'idée de l'information vers le bas, où il y a beaucoup d'espace. L'article a été publié en 1960, après la parution de l'œuvre d'Alan Turing «Computers and Mind» de l'une des œuvres les plus citées du genre. Par conséquent, une comparaison des activités humaines et des ordinateurs était une tendance qui se reflétait dans l'article de Richard Feynman.Grâce à la contribution directe du physicien, le coût du stockage des données diminue chaque année, les technologies cloud se développent à un rythme insensé, un ordinateur quantique a été créé, nous écrivons des données dans des stockages d'ADN et faisons du génie génétique, ce qui prouve une fois de plus que la matière peut être modifiée et encodée. Le prochain article parlera du chaos, de l'entropie, des ordinateurs quantiques, des araignées, des fourmis, des modèles de Markov cachés et de la théorie des catégories. Il y aura plus de mathématiques, de punk rock et d'adn. Suite ici dans cet article .