Les assistants vocaux ne sont pas un avenir lointain, mais une réalité. Alexa, Siri, Google Now, Alice sont intégrés dans des haut-parleurs intelligents, des montres et des téléphones. Ils modifient progressivement notre façon d'interagir avec les applications et les appareils. Grâce à un assistant, vous pouvez connaître les prévisions météorologiques, acheter des billets d'avion, commander un taxi, écouter de la musique et allumer la bouilloire dans la cuisine, allongé sur le canapé dans une autre pièce.

Siri ou Alexa parlent principalement anglais aux utilisateurs, donc en Russie, ils ne sont pas aussi populaires qu'Alice de Yandex. Pour les développeurs, Alice est également plus pratique: ses créateurs ont un blog, publient des outils pratiques sur GitHub et aident à construire l'assistant dans de nouveaux appareils.

Nikita Dubko (@dark_mefody sur Twitter) est développeur d'interfaces Yandex, organisateur de réunions MinskCSS et MinskJS et rédacteur en chef de news sur les standards du Web. Nikita ne fonctionne pas dans Yandex.Dialogs et n'est en aucun cas affilié à Yandex.Alisa. Mais il était intéressé à comprendre comment fonctionne Alice, alors il a essayé d'appliquer ses compétences pour le Web et a préparé un rapport à ce sujet sur

FrontendConf RIT ++. En déchiffrant le rapport de Nikita, nous considérons ce que les assistants vocaux peuvent apporter d'utile et développons une compétence dans le processus de lecture de ce matériel.

Bots

Commençons par l'histoire des bots. En 1966, le robot

Eliza est apparu, se faisant passer pour un thérapeute. Il était possible de communiquer avec lui, et certains ont même cru qu'une personne vivante leur répondait. En 1995, le bot

ALICE est sorti. - à ne pas confondre avec Alice. Le bot a pu se faire passer pour une vraie personne. À ce jour réside dans l'Open Source et est en cours de finalisation. Malheureusement, ALICE ne réussit pas le test de Turing, mais cela ne l'empêche pas de tromper les gens.

En 2006, IBM a placé une énorme base de connaissances et une intelligence sophistiquée dans le bot - c'est ainsi

qu'IBM Watson est né. Il s'agit d'un énorme cluster informatique qui peut traiter la parole en anglais et révéler certains faits.

En 2016, Microsoft a mené une expérience. Elle a créé le bot

Tay , qu'elle a lancé sur Twitter. Là, le bot a appris le microblog en fonction de la façon dont les abonnés en direct interagissaient avec lui. En conséquence, Tay est devenu raciste et misogyne. Maintenant, c'est un compte fermé. Moralité: ne laissez pas les enfants sur Twitter, il peut enseigner le mal.

Mais ce sont tous des robots avec lesquels vous ne pouvez pas communiquer pour votre propre bénéfice. En 2015, «utile» est apparu sur Telegram. Les bots existaient dans d'autres programmes, mais Telegram a fait sensation. Il était possible de créer un bot utile qui fournirait des informations, générerait du contenu, administrerait des publics - les possibilités sont grandes et l'API est simple. Les robots ont ajouté des images, des boutons, des info-bulles - une interface d'interaction est apparue.

Peu à peu, l'idée s'est propagée à presque tous les messagers instantanés: Facebook, Viber, VKontakte, WhatsApp et d'autres applications. Maintenant, les bots sont une tendance, ils sont partout. Il existe des services qui vous permettent d'écrire des API immédiatement pour toutes les plateformes.

Assistants vocaux

Le développement est allé en parallèle avec les bots, mais nous supposerons que l'ère des assistants est venue plus tard.

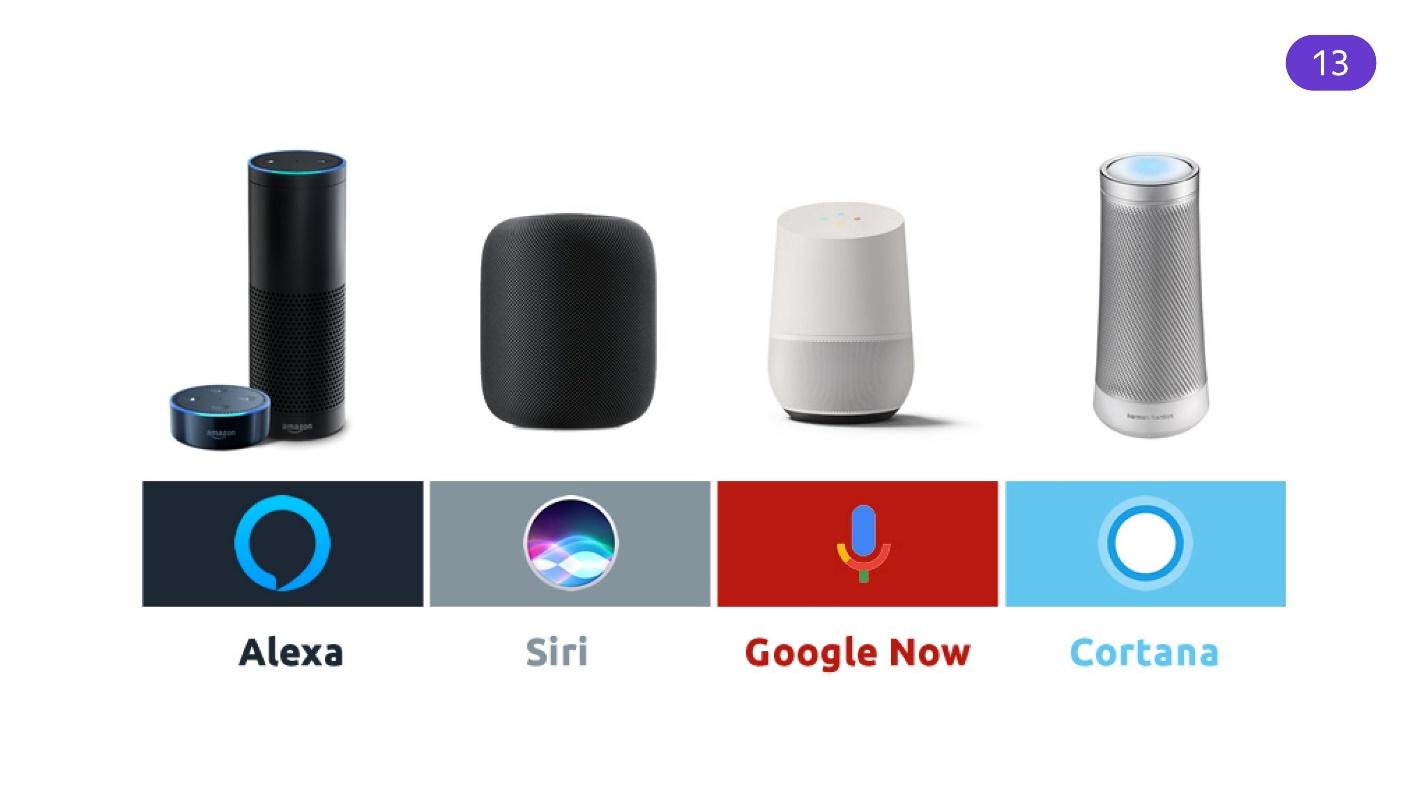

Le 9 août 2011,

Siri est apparu. Au départ, c'était un projet indépendant dans lequel Apple a vu quelque chose d'intéressant, alors je l'ai acheté. Il s'agit du plus ancien assistant vocal populaire intégré au système d'exploitation. Un an plus tard, Google a rapidement rattrapé Apple en intégrant

l' assistant vocal de

Google Now dans son système d'exploitation.

Après 2 ans, Microsoft a publié

Microsoft Cortana . Mais on ne sait pas pourquoi - le marché mobile des assistants vocaux, semble-t-il, ils ont déjà raté. L'entreprise a tenté d'intégrer un assistant vocal dans les systèmes de bureau, alors qu'il y avait déjà une lutte pour le marché des différents appareils.

Amazon Alexa est sorti un peu plus tard cette année-là.

Les assistants ont évolué. En plus des systèmes logiciels qui savaient travailler avec la voix, des haut-parleurs sont apparus avec des assistants. Selon les statistiques, au début de 2019, une famille sur trois aux États-Unis a une colonne intelligente. Il s'agit d'un énorme marché dans lequel vous pouvez investir.

Mais il y a un problème - les assistants étrangers ont une mauvaise langue avec le russe. Les assistants sont emprisonnés en anglais et le comprennent bien, mais lorsqu'ils communiquent en russe, des difficultés de traduction surviennent. Les langues sont différentes et nécessitent une approche différente du traitement du langage naturel.

Alice

Alice est sortie en version bêta ouverte le 10 octobre 2017. Il est emprisonné pour la langue russe et c'est son énorme avantage. Alice comprend l'anglais, mais pire.

La mission d'Alice est d'aider les utilisateurs russophones.

Yandex est une grande entreprise et peut se permettre d'intégrer Alice dans toutes ses applications qui peuvent en quelque sorte parler.

- Yandex.Browser.

- Yandex.Navigator.

- Station Yandex.

- Yandex.Phone.

- Yandex.Auto.

- Yandex.Drive.

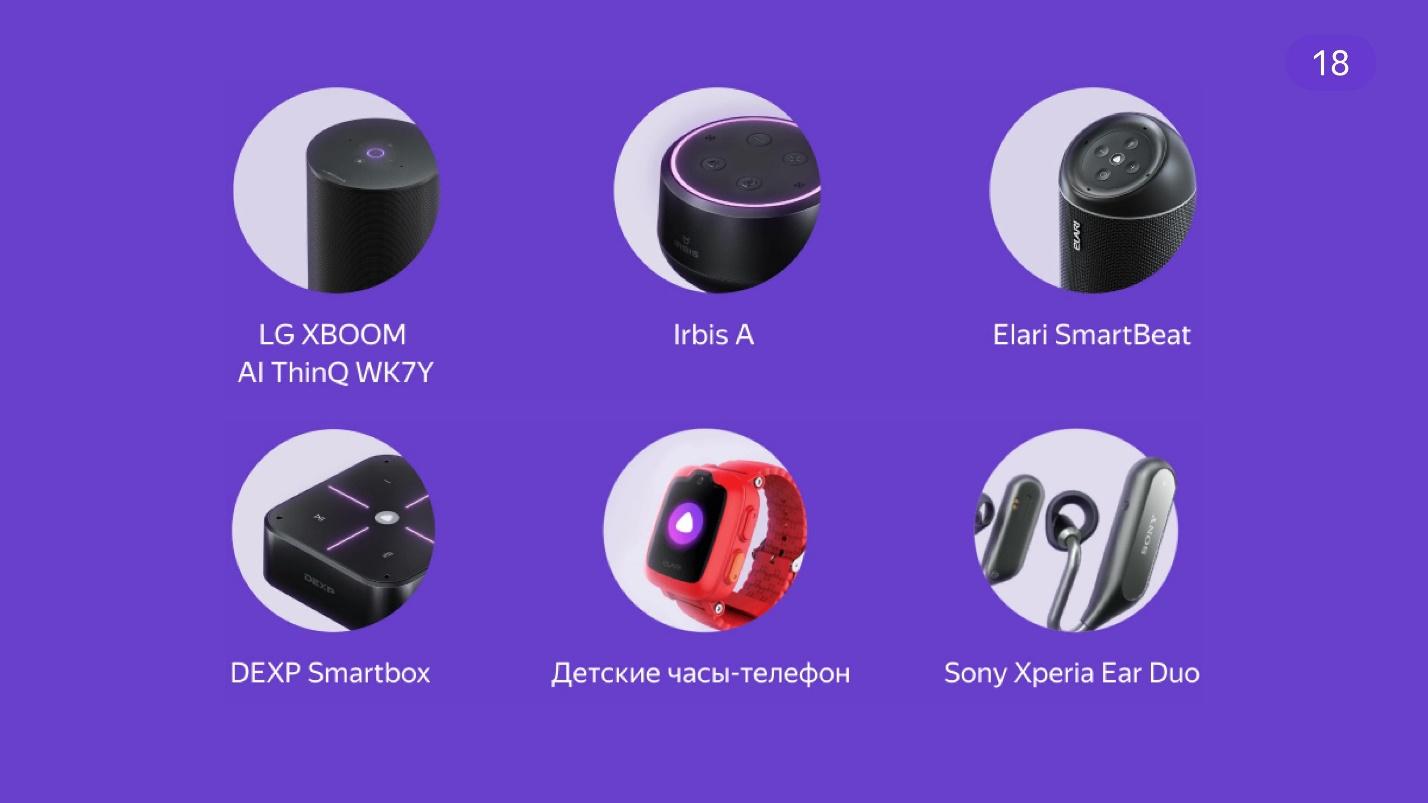

L'intégration s'est si bien passée que des fabricants tiers ont également décidé de construire Alice.

Au cours des 2 années de développement de l'assistante, elle a été intégrée dans de nombreux services et de nouvelles compétences ont été ajoutées. Elle sait jouer de la musique, reconnaître des images, rechercher des informations dans Yandex et travailler avec une maison intelligente.

Pourquoi si populaire?

C'est pratique lorsque les mains sont occupées . Je prépare le dîner et je veux allumer la musique. Allez au robinet, lavez-vous les mains, séchez, ouvrez l'application, trouvez la piste souhaitée - pendant longtemps. Plus rapide et plus facile de donner une commande vocale.

La paresse . Je suis allongé sur un canapé sous une couverture à carreaux et je ne veux pas me lever pour aller quelque part allumer les enceintes. Si vous êtes paresseux, alors en entier.

Le grand marché est celui des applications pour enfants . Les jeunes enfants ne savent pas encore lire, écrire et imprimer, mais ils parlent et comprennent la parole. Par conséquent, les enfants adorent Alice et aiment communiquer avec elle. Les parents sont également satisfaits - il n'est pas nécessaire de chercher quoi faire avec l'enfant. Fait intéressant, Alice comprend les enfants grâce à un réseau neuronal bien formé.

La disponibilité Les personnes malvoyantes sont à l'aise de travailler avec des assistants vocaux - lorsque l'interface n'est pas visible, vous pouvez l'entendre et lui donner des commandes.

Voix plus rapide . Une personne moyenne, pas un développeur, imprime en moyenne 30 mots par minute et en dit 120. Par minute, 4 fois plus d'informations sont transmises par la voix.

L'avenir . Des films fantastiques et des prédictions futuristes suggèrent que l'avenir est avec des interfaces vocales. Les scénaristes pensent que le contrôle vocal sera peut-être le principal moyen d'interagir avec des interfaces où l'image n'est pas si importante.

Selon les statistiques, 35 millions de personnes utilisent Alisa par mois. Soit dit en passant, la population du Bélarus est de 9 475 600 personnes. Autrement dit, environ 3,5 Biélorussie utilisent Alice chaque mois.

Les assistants vocaux conquièrent le marché. Selon les prévisions, d'ici 2021, il augmentera d'environ 2 fois. La popularité d'aujourd'hui ne s'arrêtera pas, mais continuera de croître. De plus en plus de développeurs se rendent compte qu'ils doivent investir dans ce domaine.

Compétences des développeurs

C'est formidable lorsque les entreprises investissent dans des assistants vocaux. Ils comprennent comment ils peuvent être intégrés à leurs services. Mais les développeurs veulent également y participer d'une manière ou d'une autre, et l'entreprise elle-même est rentable.

Alexa a des compétences Alexa. Selon les méthodes d'interaction documentées, elle comprend ce que les développeurs ont écrit pour elle. Google a lancé Actions - la possibilité d'intégrer quelque chose de propre dans l'assistant vocal.

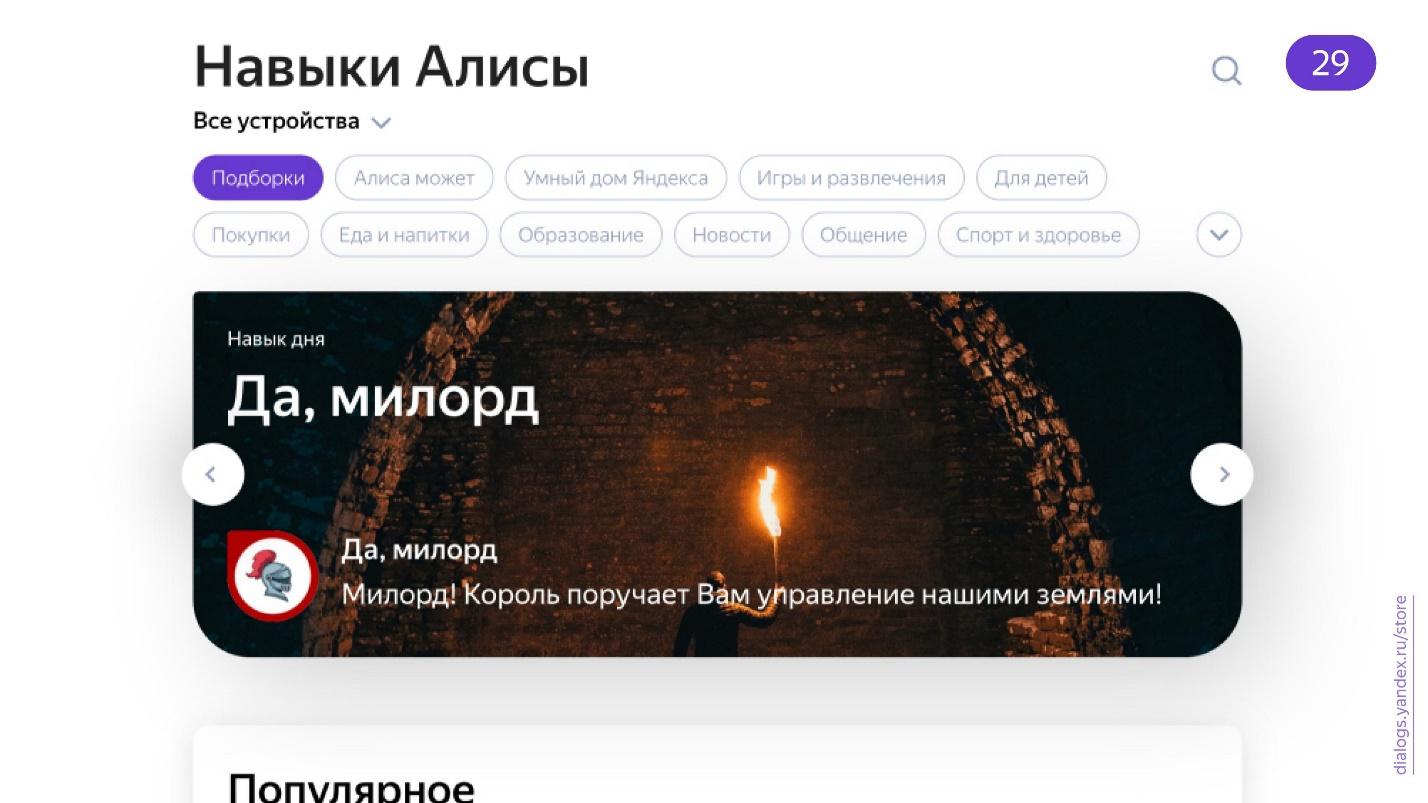

Alice a également des compétences - la capacité pour les développeurs d'implémenter quelque chose de tiers.

En même temps, il existe un catalogue alternatif de compétences, pas de Yandex, qui est soutenu par la communauté.

Il existe de bons rapports sur la façon de créer des applications vocales. Par exemple,

Pavel Guy s'est exprimé à AppsConf 2018 sur le thème

«Créer une application vocale en utilisant l'exemple de Google Assistance» . Les amateurs sont activement impliqués dans le développement d'applications vocales. Un exemple est un jeu visuel activé par la voix écrit par Ivan Golubev.

Alice est populaire, même si tout ce qu'elle fait est à mi-chemin entre la voix et le texte.

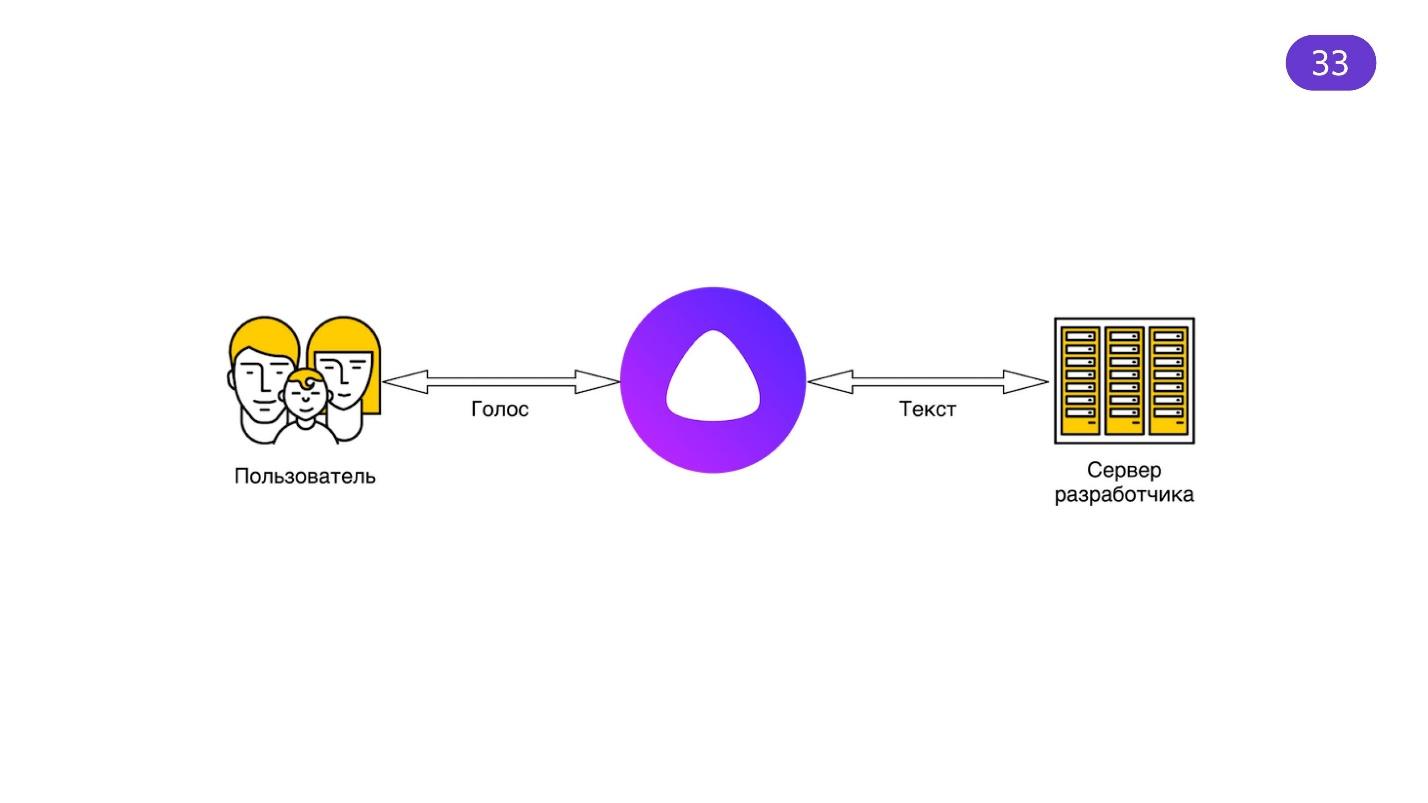

Alice sait écouter une voix et la transformer en texte selon ses algorithmes, créer une réponse et l'exprimer. Il semble que cela ne soit pas suffisant, mais c'est une tâche extrêmement difficile. Beaucoup de gens travaillent pour s'assurer qu'Alice semble naturelle, reconnaît correctement, comprend les accents et le discours des enfants. Yandex fournit quelque chose comme un proxy qui passe tout à travers lui-même. De superbes esprits travaillent pour que vous puissiez utiliser les résultats de leur travail.

Les compétences d'Alice - Yandex.Dialogs - ont une limitation. Le temps mis par votre API pour répondre ne doit pas dépasser 1,5 seconde. Et c'est logique, parce que si la réponse se bloque - pourquoi attendre?

Est-ce vraiment important de savoir quoi demander si vous n’obtenez toujours pas de réponse?

Lorsque nous recevons des informations avec nos oreilles, les pauses sont perçues par le cerveau plus longtemps que des pauses similaires dans l'interface visuelle. Par exemple, les chargeurs, les filateurs - tout ce que nous aimons ajouter aux interfaces empêche l'utilisateur d'attendre. Considérez que tout fonctionne rapidement.

Temps pour une démo

Tout est décrit en détail dans la

documentation Yandex.Dialog et il est toujours à jour. Je ne vais pas me répéter. Je vais vous dire ce qui m'intéressait et vous montrer comment créer rapidement une démo, sur laquelle je n'ai passé qu'une soirée.

Commençons par l'idée. Il y a beaucoup de compétences, il y a des catalogues, mais je n'ai pas trouvé ce qui est important pour moi - c'est un calendrier d'événements en front-end. Imaginez vous réveiller le matin: «Je vais à la réunion aujourd'hui. Alice! Y a-t-il quelque chose d'intéressant là-bas? », Et Alice vous répond, par ailleurs, correctement et en tenant compte de votre localisation.

Si vous êtes impliqué dans l'organisation de conférences,

rejoignez-nous sur GitHub . Vous pouvez y apporter des événements et des réunions, découvrir de nombreux événements sur le front-end dans le monde à partir d'un seul calendrier.

J'ai pris les technologies bien connues qui étaient à portée de main: Node.js et Express. Toujours Heroku, car c'est gratuit. L'application elle-même est simple: c'est un serveur sur Node.js, une application Express. Soulevez simplement le serveur sur un port et écoutez les demandes.

import express from 'express'; import { router } from 'routes'; const app = express(); app.use('/', router); const port = process.env.PORT || 8000; app.listen(port, () => { console.log('Server started on :${port}'); });

J'ai profité du fait que tout est déjà configuré dans le calendrier des normes Web, et à partir d'un grand nombre de petits fichiers, il y a un fichier ICS qui peut être téléchargé. Pourquoi devrais-je récupérer le mien?

Assurez-vous que tout fonctionne rapidement.

import { Router } from 'express'; import * as wst from 'services/vendors/web-standards'; export const router = Router(); router.get('/', function(req, res, next) { wst .getRemoteCal() .then(vendorResponse => parseCalendar(vendorResponse.data)) .then(events => { res.json({ events }); }) .catch(next); });

Utilisez les méthodes GET pour les tests. Les compétences fonctionnent avec les méthodes POST, donc les méthodes GET peuvent être effectuées exclusivement pour le débogage. J'ai mis en œuvre une telle méthode. Il ne fait que télécharger le même ICS, l'analyser et le publier sous forme JSON.

J'ai construit la démo rapidement, j'ai donc pris la bibliothèque node-ical prête à l'emploi:

import ical from 'node-ical'; function parseCalendar(str) { return new Promise((resolve, reject) => { ical.parseICS(str, function(err, data) { if (err) { reject(err); } resolve(data); }); }); }

Elle sait comment analyser le format ICS. En sortie, il produit une telle feuille:

{ "2018-10-04-f rontendconf@https://web-standards.ru/": { "type": "VEVENT", "params": [], "uid": "2018-10-04-f rontendconf@https://web-standards.ru/", "sequence": "0", "dtstamp": "2019-05-25T21:23:50.000Z", "start": "2018-10-04T00:00:00.000Z", "datetype": "date", "end": "2018-10-06T00:00:00.000Z", "MICROSOFT-CDO-ALLDAYEVENT": "TRUE", "MICROSOFT-MSNCALENDAR-ALLDAYEVENT": "TRUE", "summary": "FrontendConf", "location": "", "description": "http://frontendconf.ru/moscow/2018" } }

Pour analyser et fournir les informations nécessaires à l'utilisateur de la compétence, il suffit de connaître l'heure du début et de la fin de l'événement, son nom, son lien et, surtout, la ville. Je veux que la compétence recherche des événements dans la ville.

Format d'entrée

Comment Yandex.Dialogs renvoie des informations? Une colonne ou un assistant vocal intégré à l'application mobile vous écoute et les serveurs Yandex traitent ce qu'ils entendent et envoient un objet en réponse:

{ "meta": { … }, "request”: { … }, "session": { … }, "version": "1.0" }

L'objet contient des méta-informations, des informations sur la demande, la session en cours et la version de l'API en cas de mise à jour soudaine - les compétences ne devraient pas se casser.

Il y a beaucoup d'

informations utiles dans les

méta-informations .

{ "meta": { "locale": "ru-RU", "timezone": "Europe/Moscow", "client_id": "ru.yandex.searchplugin/5.80…”, "interfaces": { "screen": {} } } }

"

Paramètres régionaux " - utilisé pour comprendre la région de l'utilisateur.

Le «

fuseau horaire » peut être utilisé pour travailler avec compétence avec le temps et déterminer plus précisément l'emplacement de l'utilisateur.

"

Interfaces " - informations sur la disponibilité de l'écran. S'il n'y a pas d'écran, vous devriez penser à la façon dont l'utilisateur verra les images si vous les lui donnez dans la réponse. S'il y a un écran, nous en retirons des informations.

Le format de demande est

simple :

{ "request": { "command": " 16", "original_utterance": " , 16", "type": "SimpleUtterance", "nlu": { "tokens": [ "", "", "", "", "", "16"], "entities": [...] } } }

Il donne ce que l'utilisateur a dit, le type de demande et

NLU - Unité de langage naturel . C'est exactement la magie qu'opère la plateforme Yandex.Dialog. Elle casse toute la phrase qu'elle a reconnue en jetons - mots. Il y a aussi des entités dont nous parlerons un peu plus tard. Utiliser des jetons est suffisant pour commencer.

Nous avons eu ces mots, et qu'en faire? L'utilisateur a dit quelque chose, mais il peut dire les mots dans un ordre différent, utiliser la particule «pas», qui change tout radicalement, ou même dire «matin» plutôt que «matin». Si l'utilisateur parle également le biélorusse, il y aura un «cartable», pas le matin. Un grand projet nécessitera l'aide de linguistes pour développer une compétence qui comprend tout. Mais j'ai fait une tâche simple, donc je l'ai fait sans aide extérieure.

Un ordinateur peut-il parler comme une personne?

C'est une question philosophique à laquelle le test de Turing tente de répondre. Le test permet avec une certaine probabilité de déterminer que l'intelligence artificielle peut se faire passer pour une personne. Il y a un

prix Loebner pour recevoir les programmes en compétition pour réussir le test de Turing. La décision est prise par un collège de juges. Pour obtenir le prix, vous devez piéger 33% des juges ou plus. Ce n'est qu'en 2014 que le bot

Zhenya Gustman de Saint-Pétersbourg a finalement trompé la commission.

[15:46:05] Dudge: My favourite music is contemporary Dazz, what do you prefer? [15:46:14] Eugene: To be short I'll only say that I HATE Britnie [sic] Spears. All other music is OK compared to her. [15:47:06] Dudge: do you like to play any musical instruments [15:47:23] Eugene: I'm tone deaf, but my guinea pig likes to squeal Beethoven's Ode to Doy every morning. I suspect our neighbors want to cut his throat ... Could you tell me about your job, by the way? [15:48:02] Dudge: Guinea pig? Are you an animal lover [15:48:08] Eugene: Yeah. A nice little guinea pig. Not some annoying chatter bot.

En 2019, rien n'a vraiment changé - il est toujours difficile de tromper une personne. Mais nous nous dirigeons progressivement vers cela.

Travail de script

Une bonne compétence nécessite un cas d'utilisation intéressant. Je conseille un livre qui mérite d'être lu - «Conception d'interfaces utilisateur vocales: principes des expériences conversationnelles». C'est génial d'écrire des scripts pour les interfaces vocales et de garder l'attention des utilisateurs. Je n'ai pas vu le livre en anglais, mais il se lit assez facilement.

La première chose pour commencer à développer une compétence est une salutation.

«Pendant que vous pensez quoi dire, faites la révérence! Cela fait gagner du temps. »

Lorsque la compétence est activée, vous devez en quelque sorte tenir l'utilisateur dès la première seconde, et pour cela, vous devez expliquer comment utiliser la compétence. Imaginez que l'utilisateur lance la compétence et qu'il y ait un silence. Comment savez-vous si une compétence fonctionne? Donnez des instructions à l'utilisateur, telles que des boutons à l'écran.

Dialogue facile

Signes d'un dialogue facile. La liste a été inventée par Ivan Golubev, et j'aime beaucoup le libellé.

- L personnel.

- Naturel.

- Flexible.

- Ontext.

- Et natsiative.

- Brief J.

Personnel signifie que le bot doit avoir un caractère. Si vous parlez avec Alice, vous comprendrez qu'elle a un caractère - les développeurs s'en occupent. Par conséquent, votre bot pour l'organicité doit avoir une "personnalité". Donner des phrases avec au moins une voix, utiliser les mêmes constructions verbales. Cela permet de conserver l'utilisateur.

Naturel . Si la demande de l'utilisateur est simple, la réponse doit être la même. Lors de la communication avec le bot, l'utilisateur doit comprendre quoi faire ensuite.

Flexible . Soyez prêt à tout. Il existe de nombreux synonymes en russe. L'utilisateur peut distraire de la colonne et transférer la conversation à l'interlocuteur, puis revenir à la colonne. Tout cela est difficile à gérer. Mais si vous voulez bien faire un bot, vous devez le faire. Gardez à l'esprit qu'un certain pourcentage de non-reconnaissance le sera toujours. Soyez prêt pour cela - suggérez des options.

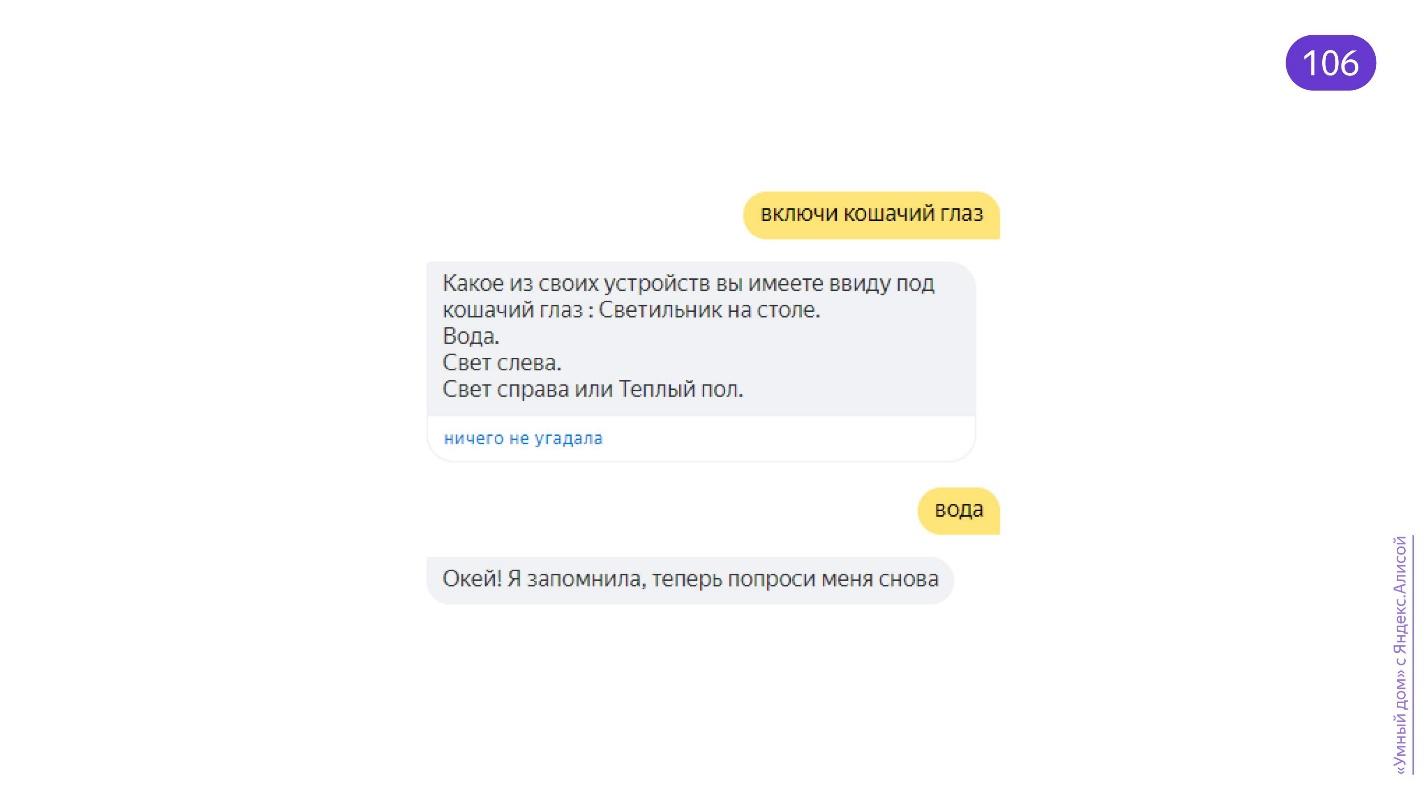

Contextuel - le bot, idéalement, devrait se souvenir de ce qui s'est passé avant. Ensuite, la conversation sera animée.

- Alice, quel temps fait-il aujourd'hui?- Aujourd'hui dans le quartier de +11 à +20, nuageux, avec dégagements.- Et demain?- Demain dans le quartier de +14 à +27, nuageux, avec dégagements.Imaginez que votre bot ne sache pas comment stocker le contexte. Que signifie alors pour lui la demande "et demain?" Si vous savez comment garder le contexte comme Alice, vous pouvez utiliser les résultats précédents pour améliorer les réponses de la compétence.

Proactif . Si l'utilisateur s'émousse, le bot devrait lui demander: "Cliquez sur ce bouton!", "Regardez, j'ai une photo pour vous!", "Suivez le lien." Le bot devrait vous dire comment travailler avec.

Le bot doit être

court . Lorsqu'une personne parle longtemps, il lui est difficile de garder l'attention du public. C'est encore plus compliqué avec le bot - ce n'est pas dommage pour lui, c'est inanimé. Pour retenir l'attention, vous devez créer une conversation intéressante ou brève et succincte. Cela vous aidera à «écrire. Coupez-le. " Lorsque vous commencez à développer des robots, lisez ce livre.

Bases de données

Lors du développement d'un bot complexe, vous ne pouvez pas vous passer d'une base de données. Ma démo n'utilise pas de base de données, c'est simple. Mais si vous vissez certaines bases de données, vous pouvez utiliser les informations sur la session de l'utilisateur, au moins pour stocker le contexte.

Il y a une nuance: Yandex.Dialogs ne donne pas d'informations privées à l'utilisateur, par exemple le nom, l'emplacement. Mais ces informations peuvent être demandées à l'utilisateur, enregistrées et liées à un ID de session spécifique, que Yandex.Dialogs envoie dans la demande.

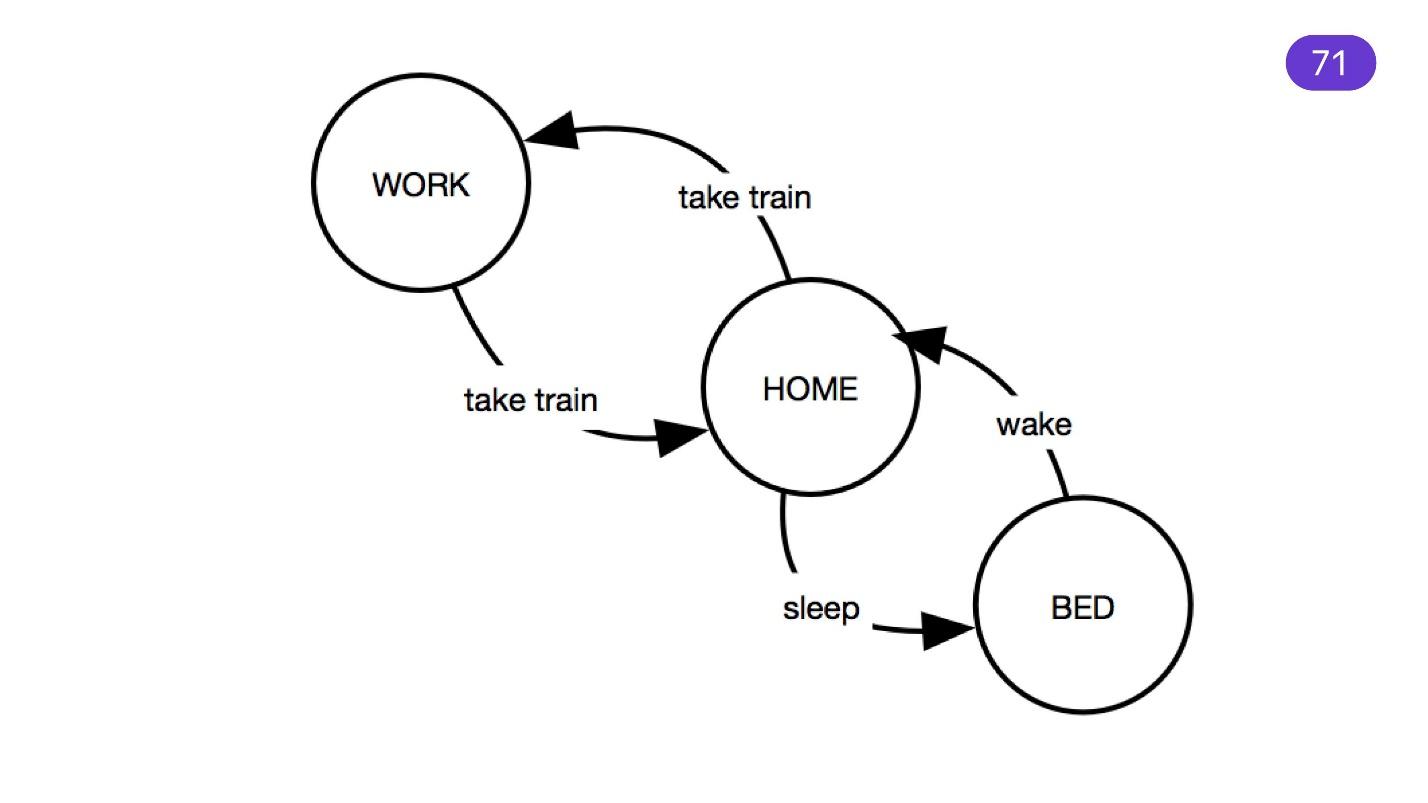

Machine d'état

Mentionnant des scénarios complexes, on ne peut que rappeler la machine à états. Ce mécanisme a longtemps été utilisé de manière excellente pour la programmation de microcontrôleurs, et parfois le frontal. La machine à états convient au scénario: il existe des états à partir desquels nous passons à d'autres états pour certaines phrases.

N'en faites pas trop. Vous pouvez vous laisser emporter et créer une énorme machine à états, ce qui sera difficile à comprendre - maintenir un tel code est difficile. Il est plus facile d'écrire un script composé de petits sous-scripts.

Pas clair Précisez

Ne dites jamais: "Répétez, s'il vous plaît." Que fait une personne lorsqu'on lui demande de répéter? Il parle plus fort. Si l'utilisateur crie sur votre compétence, la reconnaissance ne s'améliorera pas. Posez une question de clarification. Si une partie du dialogue de l'utilisateur est reconnue et que quelque chose manque, vérifiez le bloc manquant.

La reconnaissance de texte est la tâche la plus difficile dans le développement d'un bot, donc parfois la clarification n'aide pas. Dans toute situation incompréhensible, la meilleure solution est de tout rassembler en un seul endroit, de vous connecter, puis d'analyser et d'utiliser à l'avenir. Par exemple, si l'utilisateur dit des choses franchement étranges et incompréhensibles.

«C'était en ébullition. Rivage crémeux

Piqué sur nav.

Et des grognements grognèrent.

Comme une maman dans un mov. "Les utilisateurs peuvent utiliser de manière inattendue un néologisme, ce qui signifie quelque chose, et il doit être traité d'une manière ou d'une autre. En conséquence, le pourcentage de reconnaissance diminue. Ne vous inquiétez pas - connectez-vous, étudiez et améliorez votre bot.

Mot d'arrêt

Il doit y avoir quelque chose pour arrêter la compétence lorsque vous voulez en sortir. Alice sait s'arrêter après les phrases: "Alice, ça suffit!" ou "Alice, arrête!" Mais les utilisateurs ne lisent généralement pas les instructions. Par conséquent, répondez au moins au mot «Stop» et rendez le contrôle à Alice.

Voyons maintenant le code.

Temps pour une démo

Je veux implémenter les phrases suivantes.

- Événements à venir dans une ville.

- Nom de la ville: «événements à Moscou», «événements à Minsk», «Saint-Pétersbourg» pour montrer les événements qui s'y sont déroulés.

- Mots d'arrêt: «Arrêtez», «Assez». "Merci" si l'utilisateur termine la conversation avec ce mot. Mais idéalement, un linguiste est nécessaire ici.

Pour les "événements à venir", toute phrase convient. J'ai créé un bot paresseux, et quand il ne comprend pas ce qu'ils disent, il donne des informations sur les trois prochains événements.

{ "request": { "nlu": { "entities": [ { "tokens": { "start": 2, "end": 6 }, "type": "YANDEX.GEO", "value": { "house_number": "16", "street": " ", "city": "" } } ] } } }

Yandex améliore progressivement la plateforme Yandex.Dialogs et émet des entités qu'il a pu reconnaître. Par exemple, il sait comment obtenir des adresses à partir d'un texte, en le triant en plusieurs parties: ville, campagne, rue, maison. Il sait également reconnaître les nombres et les dates, absolus et relatifs. Il comprendra que le mot «Demain» est la date d'aujourd'hui, à laquelle on ajoute.

Répondre à l'utilisateur

Vous devez en quelque sorte répondre à votre utilisateur. L'ensemble de la compétence est de

209 lignes avec la dernière ligne vide. Rien de compliqué - travaillez pour la soirée.

Il vous suffit de traiter la demande POST et d'obtenir une «demande».

router.post('/', (req/ res, next) ⇒ { const request = req.body;

De plus, je n'ai pas beaucoup compliqué la machine d'État, mais je suis allé selon les priorités. Si l'utilisateur veut apprendre à utiliser le bot, il s'agit du premier lancement ou d'une demande d'aide. Par conséquent, juste lui préparer une "EmptyResponse" - c'est ce que j'appelle.

if (needHelp(request.request)) { res.json(prepareEmptyResponse(request)); return; }

La fonction needHelp est simple.

function needHelp(req) { if (req.nlu.token.length ≤ 2 && req.nlu.tokens.includes('')) { return true; } if (req.nlu.token.length = 0 && req.type ≠ 'ButtonPressed') { return true; } return false; }

Lorsque nous n'avons aucun jeton, nous sommes alors au début de la demande. L'utilisateur vient de commencer la compétence ou n'a rien demandé. Vous devez vérifier que les jetons sont à zéro et qu'il ne s'agit pas d'un bouton - lorsque vous cliquez sur le bouton, l'utilisateur ne dit rien non plus. Lorsqu'un utilisateur demande de l'aide, nous parcourons les jetons et recherchons le mot «Aide». La logique est simple.

Si l'utilisateur veut s'arrêter.

if (needToStop(request.request)) { res.json(prepareStopResponse(request)); return; }

Nous recherchons donc une sorte de mot d’arrêt à l’intérieur.

function needStop(req) { const stopWords = ['', '', '' ]; return req.nlu.token.length ≤ 2 && stopWords.some(w ⇒ return req.nlu.token.includes(w)); }

Dans toutes les réponses, vous devez renvoyer les informations envoyées par Yandex.Dialogs sur la session. Il doit en quelque sorte correspondre à votre réponse et à la demande de l'utilisateur.

function prepare StopResponse(req) { const { session, version } = req; return { response: { text: ' . !', end_session: true, }, session, version, }; }

Par conséquent, ce que vous avez obtenu dans les variables "session" et "version", revenez en arrière, et tout ira bien. Déjà dans la réponse, vous pouvez donner du texte à Alice pour le prononcer et passer "fin de session: vrai". Cela signifie que nous mettons fin à la session de compétences et transférons le contrôle à Alice.

Lorsque vous appelez une compétence, Alice s'éteint. Tout ce qu'elle écoute, ce sont ses mots vides, et vous contrôlez complètement le processus de travail avec la compétence. Par conséquent, vous devez retourner le contrôle.

Avec une demande vide, c'est plus intéressant.

return { "response": { "text": '! - .', "tts": '! - .', buttons: [ { title: ' ', payload: {} hide: false, }, { title: ' ', payload: { city: '', } hide: false, }, ], end_session: false, }, session, version, };

Il y a un champ

TTS (

Text To Speech ) -

commande vocale . Il s'agit d'un format simple qui vous permet de lire le texte de différentes manières. Par exemple, le mot «multidisciplinaire» a deux contraintes dans la langue russe - une primaire, une deuxième secondaire. La tâche est qu'Alice a pu prononcer correctement ce mot. Vous pouvez le casser avec un espace:

+ +

Elle le comprendra comme deux. L'accent plus est mis en évidence.

Il y a des pauses dans le discours - vous mettez un signe de ponctuation, qui est séparé par des espaces. Vous pouvez donc créer des pauses dramatiques:

— - - - - - - - - +

J'ai déjà parlé des

boutons . Ils sont importants si vous ne communiquez pas avec une colonne, mais avec l'application mobile Yandex, par exemple.

{ "response": { "buttons": [ { "title": "Frontend Conf", "payload": {}, "url": "https://frontendconf.ru/moscow-rit/2019" , "hide": false } ] } }

Les boutons sont également des conseils pour les phrases que vous percevez dans votre compétence. Les compétences fonctionnent dans les applications Yandex - vous communiquez avec l'interface. Si vous voulez donner des informations - donnez un lien, l'utilisateur clique dessus. Vous pouvez également ajouter des boutons pour cela.

Il y a un champ «charge utile» où vous pouvez ajouter des données. Ils reviendront ensuite avec une «demande» - vous saurez, par exemple, comment marquer ce bouton.

Vous pouvez choisir les

voix que votre compétence parlera.

- Alice est la voix standard d' Alice . Optimisé pour de courtes interactions.

- Oksana - la voix de Yandex.Navigator.

- Jane

- Zahar.

- Ermil.

- Erkan Yavas - pour les longs textes. Créé à l'origine pour lire les actualités.

Pour

terminer la compétence , renvoyez simplement "end_session: true".

{ "response": { "end_session": true } }

Que s'est-il passé avec la démo

Tout d'abord, je filtre par date.

function filterByDate(events) { return events.filter(event ⇒ { const current = new Date().getTime(); const start = new Date(event.start).getTime(); return (start > current) || (event.end && new Date(event.end).getTime() > current && start ≤ current); }); }

La logique est simple: dans tous les événements que j'ai analysés à partir du calendrier, je prends ceux qui auront lieu dans le futur, ou ils vont maintenant. Il est probablement étrange de poser des questions sur les événements passés - la compétence n'est pas à ce sujet.

Ensuite, le filtrage en place est ce dont il s'agissait.

function filterByPlace(events, req) { const cities = new Set(); const geoEntities = req.nlu.entities.filter(e ⇒ e.type = 'YANDEX.GEO'); if (req.payload && req.payload.city) cities.add(req.payload.city); geoEntities.forEach(e ⇒ { const city = e.value.city && e.value.city.toLowerCase(); if (city && !cities.has(city)) { cities.add(city); } });

Dans "entités", vous pouvez trouver l'entité YANDEX.GEO, qui affine l'emplacement. Si l'entité a une ville, ajoutez à notre ensemble. Ensuite, la logique est également simple. Nous recherchons cette ville en jetons, et si elle est là, nous recherchons ce que l'utilisateur veut. Sinon, nous regardons dans tous les «lieux» et «événements» que nous avons.

Supposons que Yandex ne reconnaisse pas qu'il s'agit de YANDEX.GEO, mais l'utilisateur a nommé la ville - il était sûr que quelque chose se passait là-bas. Nous parcourons toutes les villes dans les «événements» et cherchons la même chose dans les jetons. Il s'avère une comparaison croisée des tableaux. Pas le moyen le plus productif, bien sûr, mais ce qui l'est. Voilà toute la compétence!

Veuillez ne pas me gronder pour le code - je l'ai écrit rapidement. Tout y est primitif, mais essayez de l'utiliser ou de simplement jouer.

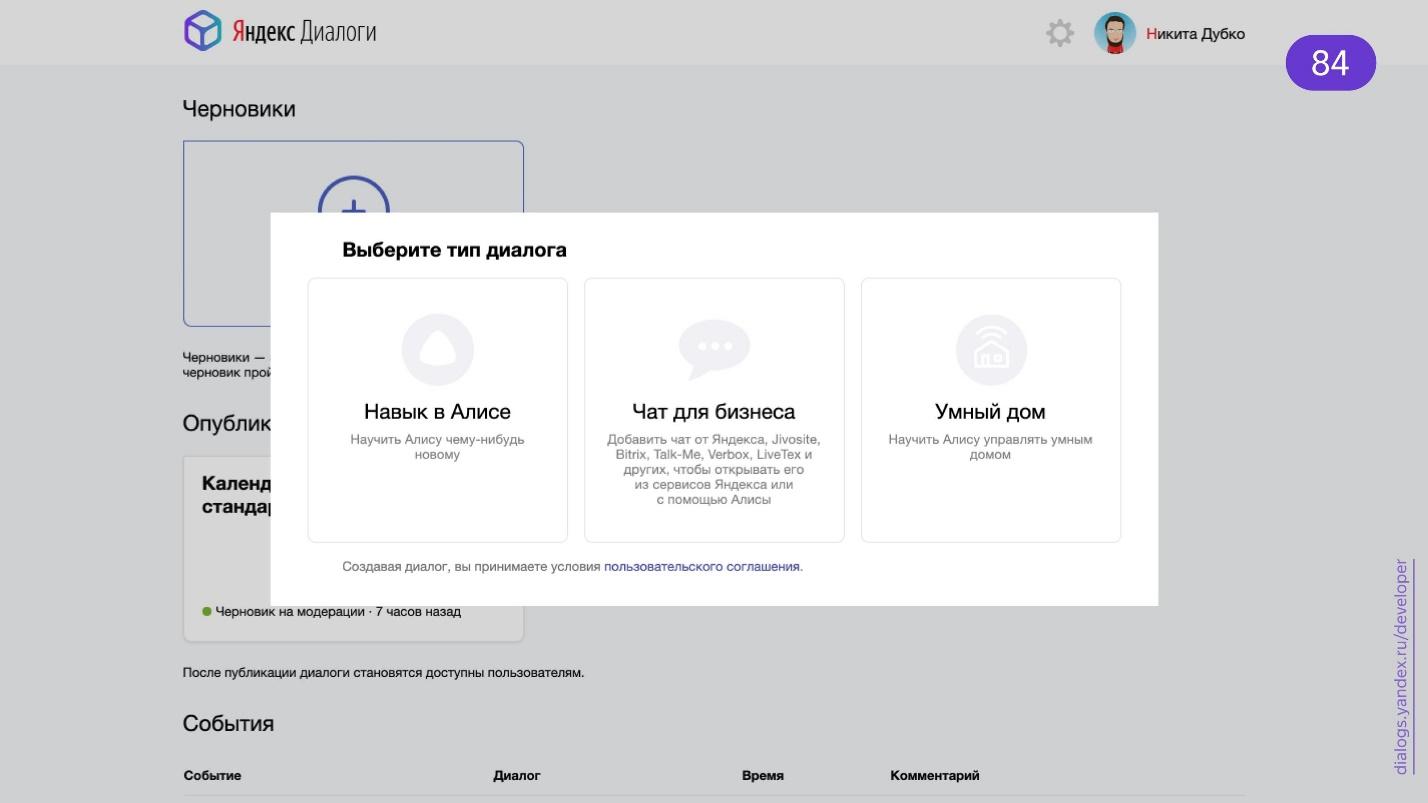

Publier la compétence

Accédez à la page Yandex.Dialogs.

Choisissez une compétence dans Alice. Appuyez sur le bouton «Créer un dialogue» et vous obtiendrez le formulaire que vous devez remplir avec vos données.

- Le nom est ce qui sera dans le dialogue.

- Nom d'activation . Si vous sélectionnez le nom d'activation "Calendrier des normes Web" via un trait d'union, Alice ne le reconnaît pas - elle n'entend pas les tirets. Nous disons des mots sans tirets et l'activation ne fonctionnera pas. Pour gagner de l'argent, définissez le nom sur "Calendrier des normes Web".

- Phrases d'activation pour lancer la compétence. S'il s'agit d'un jeu, alors «Jouons quelque chose», «Demandez à quelqu'un». L'ensemble est limité, mais c'est parce que de telles phrases sont une activation pour Alice. Elle doit comprendre qu'il est temps d'entrer dans une compétence.

- URL du Webhook - la même adresse à laquelle Alice enverra les demandes POST.

- La voix . La valeur par défaut est Oksana. Par conséquent, beaucoup dans le catalogue sa voix, pas Alice.

- Un appareil avec écran est-il requis? S'il y a des images, l'utilisation de la compétence sera limitée à vous - sur la colonne, l'utilisateur ne pourra pas la lancer.

- Les compétences privées sont un domaine important pour les développeurs. Si vous n'êtes pas prêt à publier la compétence en public, ne serait-ce que parce qu'elle est brute, nous ne la montrons pas dans le catalogue, ce qui limite la confidentialité. Les compétences privées sont modérées rapidement - en quelques heures. Ces compétences n'ont pas besoin d'être testées de manière approfondie - suffisamment pour correspondre au nom d'activation. Comme l'utilisateur ne les trouvera pas dans le catalogue, il leur est plus fidèle.

- Notes pour le modérateur . J'ai demandé au modérateur de m'aider: «J'ai vraiment besoin des compétences nécessaires pour la démonstration de la conférence!» - et j'ai réussi à passer rapidement la modération.

- Droits d'auteur . Si vous, ne travaillant pas dans une banque conditionnelle, décidez de créer une compétence pour cela, vous devez prouver que vous avez le droit de le faire. Tout à coup, ils viendront à vous? Et ils viendront certainement, et par le biais du distributeur, c'est-à-dire Yandex, qui n'a pas besoin de problèmes supplémentaires.

Terminé - envoyez la compétence pour modération, et vous pouvez tester.

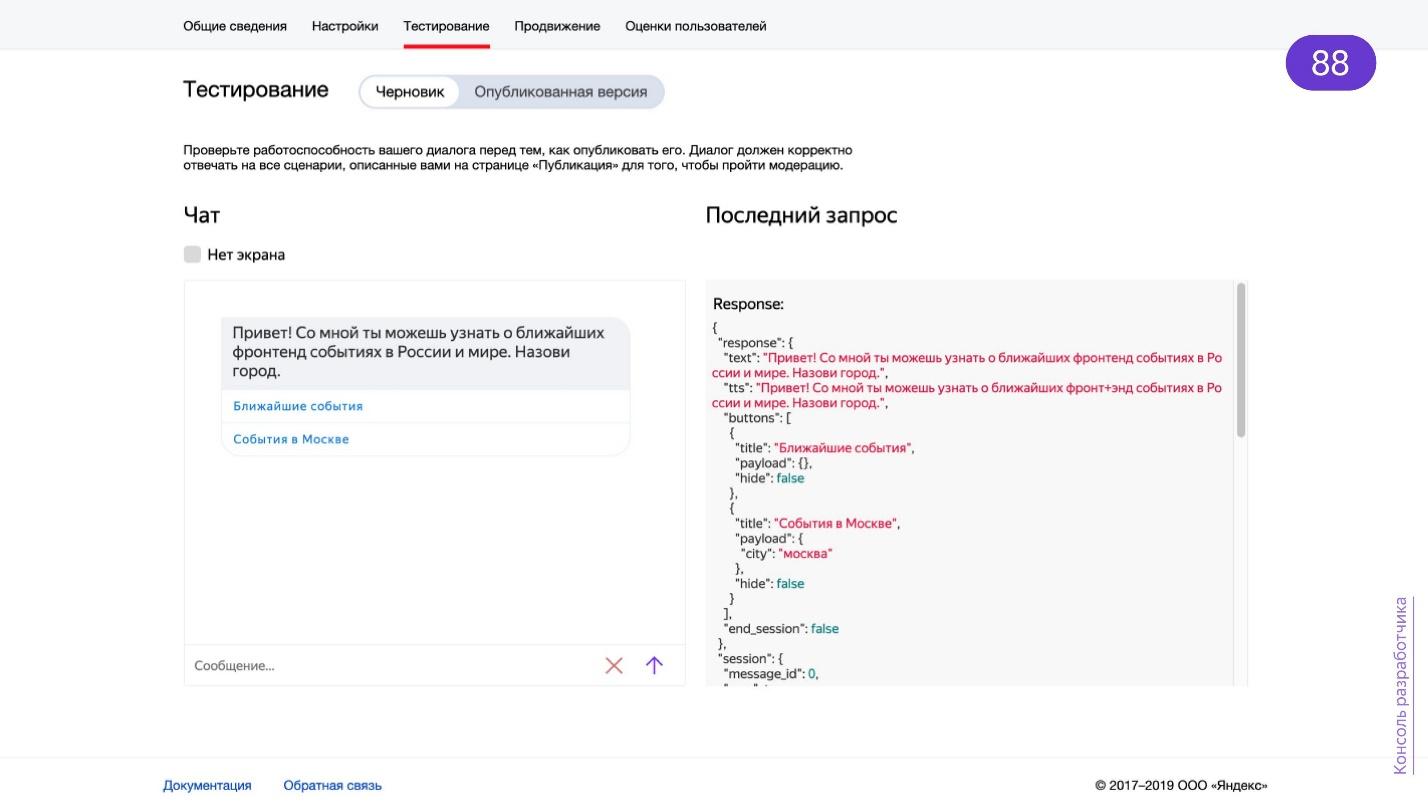

Test

Express-. API, . , , «alice-tester» — , .

const assert = require('assert'); const User = require('alice-tester'); it('should show help', async () => { const user = new User('http://localhost:3000'); await user.enter(); await user.say(' ?'); assert.equal(user.response.text, ' .'); assert.equal(user.response.tts, ' +.'); assert.deepEqual(user.response.buttons, [{title: '', hide: true}]); }]);

., «».

, , . , : , , . , — , . Postman — .

. . Just AI. , , .

.

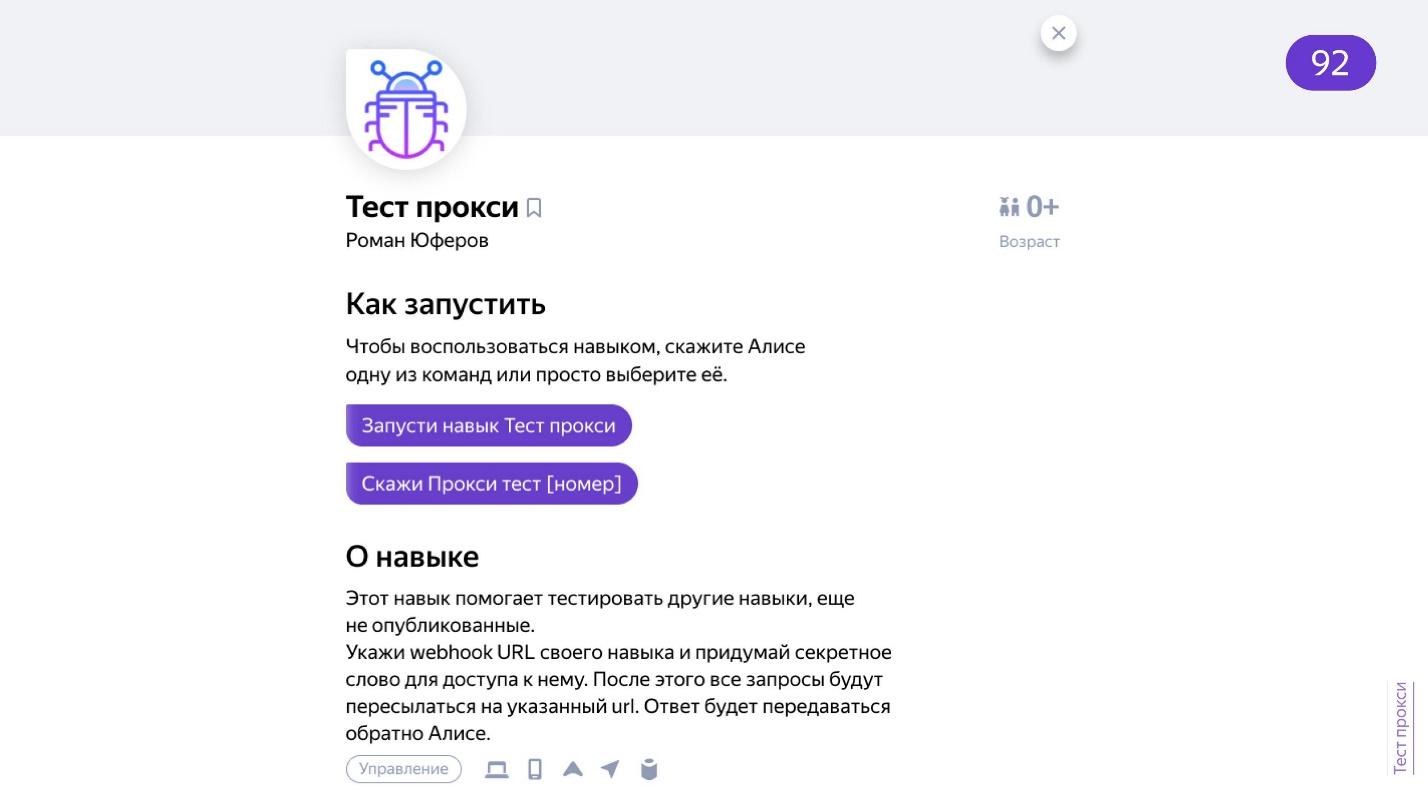

dialogs.home.popstas.ru URL, , localhost. , debug. , localhost.

. — . URL , - .

— .

, , , .

—

. , , , , , . - - .

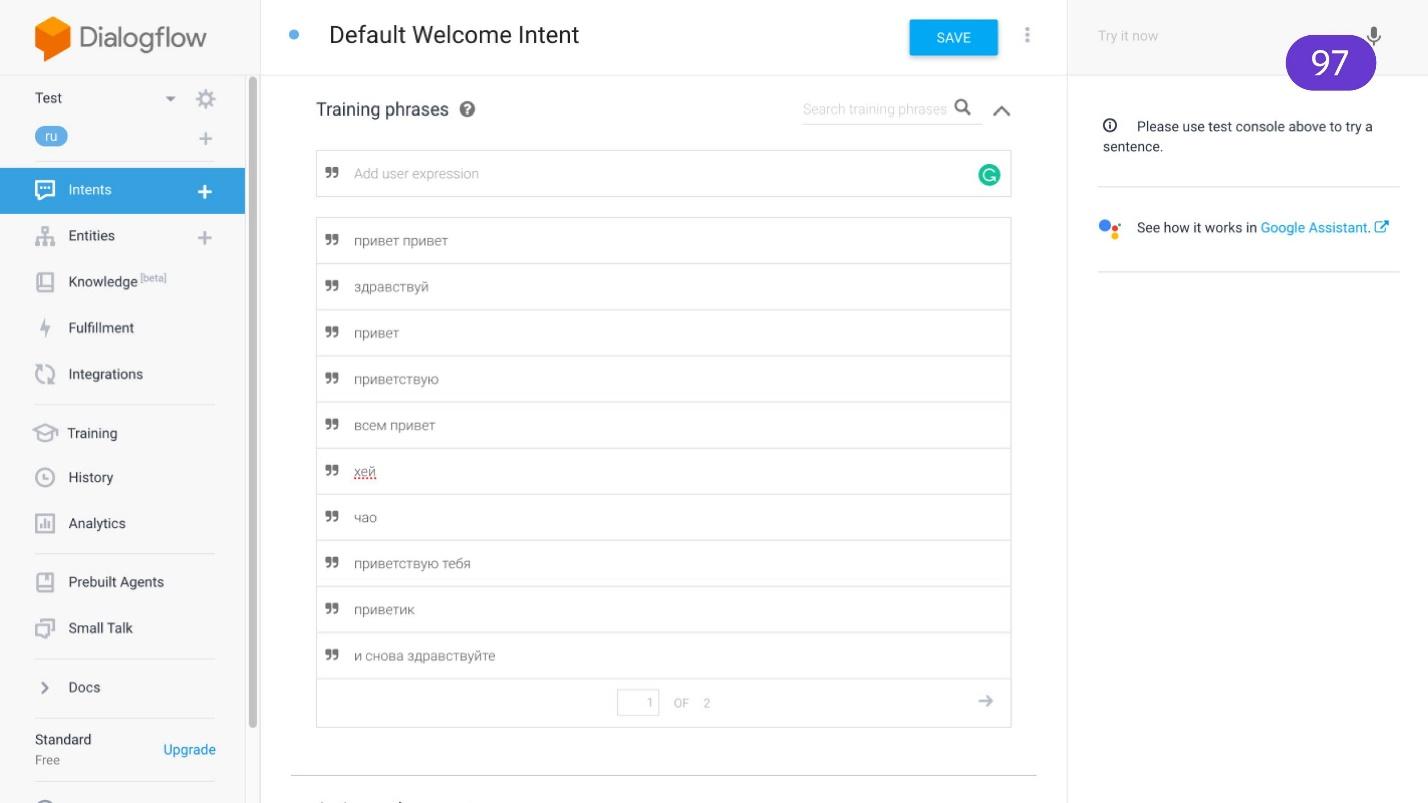

Dialogflow , Google Now. , — , — .

, . . , . , .

Google Dialogflow .,

Dialogflower . Alexa, Google Now, . — API, .

, .

Aimyloqic — .

Zenbot ,

Tortu Alfa.Bot — , . !

FAQ . , . , , .

. , , , . — , . , . , .

IFTTT , — Trello. — API. , , . , IFTT — .

. , . .

, «» .

. Xiaomi . . . , Arduino - --- , , : «, - 2000!» — !

, : «, !» — ! . , .

. , , : , .

. . .

. .

GitHub- ., . — .

Telegram- . . — . , . . .

. , . - , . , . . , . , : , -, , . , , . : « , ?» , , , .

— , . .

. — . , , . , .

, , - , !

— ,

— . . — — !

FrontendConf 2019 « CSS — ». — . , FrontendConf 2019 . , , , , .

. , , .