Nous continuons de traiter avec l'API Android CAMERA2.

Dans l'article précédent, nous avons maîtrisé l'appareil photo pour prendre des photos en utilisant la nouvelle API. Prenons maintenant une vidéo. En général, au départ, mon objectif principal était de diffuser des vidéos en direct à partir d'une caméra Android à l'aide de Media Codec, mais il s'est avéré qu'au début, Media Recorder est entré en scène et a voulu partager avec le public le plus respectable comment il peut enregistrer des clips vidéo. Par conséquent, nous diffuserons la prochaine fois, mais pour l'instant, nous allons voir comment ajouter Media Recorder à la nouvelle API. Le post sur lui s'est avéré assez banal, donc seuls les débutants et les théières parfaites peuvent regarder sous le chat.

So Media Recorder

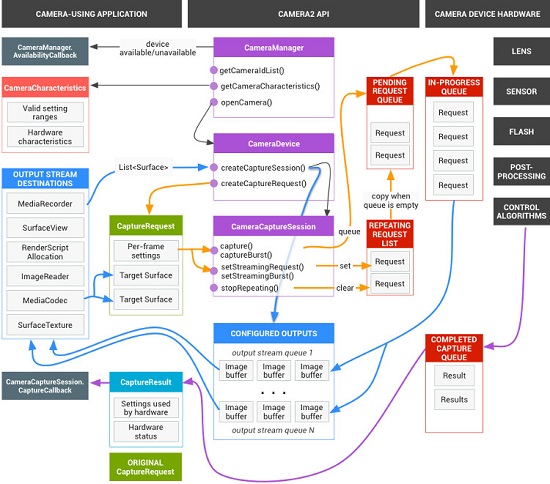

Comme nous pouvons le voir d'après le nom même de la classe et l'image ci-dessus, nous avons besoin de Media Recorder pour prendre quelque part la source de l'audio ou de la vidéo ou tous ensemble et enregistrer à la fin, le tout dans un fichier dans le format souhaité et le plus important accessible.

Dans notre cas, la tâche est simple, nous prenons la vidéo et l'audio de la caméra et du microphone et écrivons dans un fichier au format MPEG_4. Certains pervers glissaient une prise réseau pour Media Recorder au lieu d'un fichier afin de pouvoir piloter une vidéo sur le réseau, mais heureusement, ces temps de grotte sont déjà dans le passé. Nous ferons de même dans le prochain article, mais pour cela, nous prenons le Media Codec déjà civilisé.

Comme tout le monde se souvient de la précédente API Camera

de 2011 , la connexion de MediaRecorder n'a pas été difficile. Il est agréable de noter qu'aucune difficulté ne se pose maintenant. Et ne soyons pas effrayés par l'image du schéma complet de la caméra.

Nous avons juste besoin de fixer l'enregistreur multimédia à la surface de surface sur laquelle l'image de la caméra est affichée, puis il fera tout lui-même. Avec l'audio, c'est encore plus trivial, il suffit de définir les formats souhaités, et Media Recorder le trouvera par lui-même sans nous ennuyer avec toutes sortes de rappels.

Rappelez-vous combien surpris l'ami japonais du dernier message:

L'une des raisons pour lesquelles Camera2 est perplexe est le nombre de rappels que vous devez utiliser pour prendre une seule photo.

Et ici, au contraire, il est surprenant de constater que

peu de rappels sont nécessaires pour enregistrer un fichier vidéo. Seulement deux. Comme Zemfira chante: "J'ai le moins besoin de vos rappels."

Et maintenant nous allons les écrireEn tant que source, nous prenons le code de l'article précédent et jetons tout ce qui concerne la photographie et ne laissons, en fait, que la résolution et l'initialisation de l'appareil photo. Nous ne laissons également qu'une seule caméra - l'avant.

private CameraManager mCameraManager = null; private final int CAMERA1 = 0; protected void onCreate(Bundle savedInstanceState) { super.onCreate(savedInstanceState); setContentView(R.layout.activity_main); Log.d(LOG_TAG, " "); if (checkSelfPermission(Manifest.permission.CAMERA) != PackageManager.PERMISSION_GRANTED || (ContextCompat.checkSelfPermission(MainActivity.this, Manifest.permission.WRITE_EXTERNAL_STORAGE) != PackageManager.PERMISSION_GRANTED) || (ContextCompat.checkSelfPermission(MainActivity.this, Manifest.permission.RECORD_AUDIO) != PackageManager.PERMISSION_GRANTED) ) { requestPermissions(new String[]{Manifest.permission.CAMERA, Manifest.permission.WRITE_EXTERNAL_STORAGE, Manifest.permission.RECORD_AUDIO}, 1); } mCameraManager = (CameraManager) getSystemService(Context.CAMERA_SERVICE); try {

Comme nous pouvons le voir, l'option RECORD_AUDIO a été ajoutée aux autorisations. Sans lui, Media Recorder ne peut enregistrer que des vidéos nues sans son. Et si nous essayons toujours de spécifier des formats sonores sans autorisation, cela ne démarrera pas du tout. Par conséquent, nous autorisons l'enregistrement du son et des trucs, en se rappelant, bien sûr, que dans le vrai code dans le flux principal, de telles choses ne sont pas bonnes à faire, mais bonnes uniquement dans la démo.

Ensuite, initialisez le Media Recorder lui-même dans une méthode distincte private void setUpMediaRecorder() { mMediaRecorder = new MediaRecorder(); mMediaRecorder.setAudioSource(MediaRecorder.AudioSource.MIC); mMediaRecorder.setVideoSource(MediaRecorder.VideoSource.SURFACE); mMediaRecorder.setOutputFormat(MediaRecorder.OutputFormat.MPEG_4); mCurrentFile = new File(Environment.getExternalStoragePublicDirectory(Environment.DIRECTORY_DCIM), "test"+count+".mp4"); mMediaRecorder.setOutputFile(mCurrentFile.getAbsolutePath()); CamcorderProfile profile = CamcorderProfile.get(CamcorderProfile.QUALITY_480P); mMediaRecorder.setVideoFrameRate(profile.videoFrameRate); mMediaRecorder.setVideoSize(profile.videoFrameWidth, profile.videoFrameHeight); mMediaRecorder.setVideoEncodingBitRate(profile.videoBitRate); mMediaRecorder.setVideoEncoder(MediaRecorder.VideoEncoder.H264); mMediaRecorder.setAudioEncoder(MediaRecorder.AudioEncoder.AAC); mMediaRecorder.setAudioEncodingBitRate(profile.audioBitRate); mMediaRecorder.setAudioSamplingRate(profile.audioSampleRate); try { mMediaRecorder.prepare(); Log.i(LOG_TAG, " "); } catch (Exception e) { Log.i(LOG_TAG, " "); } }

Ici aussi, tout est clair et compréhensible et aucune explication n'est requise.

Vient ensuite l'étape la plus cruciale - l'ajout de Media Recorder à Surface. Dans le dernier article, nous avons affiché l'image de la caméra sur la Surface et pris une photo avec celle-ci à l'aide d'Image Reader. Pour ce faire, nous avons simplement spécifié les deux composants dans la liste Surface.

Arrays.asList(surface,mImageReader.getSurface())

Voici la même chose, seulement au lieu d'ImageReader nous spécifions:

(Arrays.asList(surface, mMediaRecorder.getSurface()).

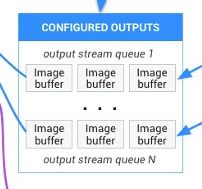

Là, en général, vous pouvez sculpter n'importe quoi avec une virgule, tous les composants que vous utilisez et même Media Codec. Autrement dit, vous pouvez prendre des photos dans une seule fenêtre, filmer une vidéo et la diffuser. Bonne surface - permet. Certes, est-il possible de tout faire en même temps? En théorie, à en juger par l'image de la caméra, vous le pouvez.

Il devrait, comme, simplement se disperser sur différents flux. Il y a donc un champ d'expérimentation.

Mais revenons à Media RecorderPresque nous avons tout fait. Contrairement à la photographie, nous n'avons pas besoin de demandes de prise de vue supplémentaires, nous n'avons pas besoin d'analogue d'ImageSaver - notre enregistreur assidu fait tout par lui-même. Et c’est bien.

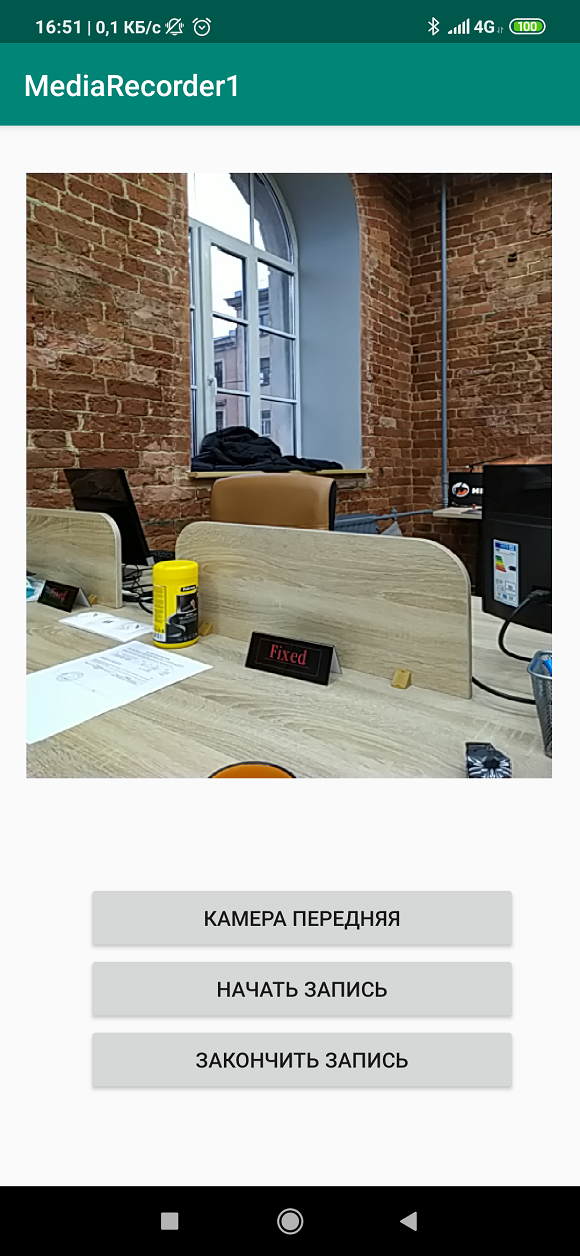

En conséquence, le programme prend un look complètement minimaliste.

package com.example.mediarecorder1; import androidx.appcompat.app.AppCompatActivity; import androidx.core.content.ContextCompat; import android.Manifest; import android.content.Context; import android.content.pm.PackageManager; import android.graphics.SurfaceTexture; import android.hardware.camera2.CameraAccessException; import android.hardware.camera2.CameraCaptureSession; import android.hardware.camera2.CameraDevice; import android.hardware.camera2.CameraManager; import android.hardware.camera2.CaptureRequest; import android.media.CamcorderProfile; import android.os.Bundle; import android.media.MediaRecorder; import android.os.Environment; import android.os.Handler; import android.os.HandlerThread; import android.util.Log; import android.view.Surface; import android.view.TextureView; import android.view.View; import android.widget.Button; import java.io.File; import java.util.Arrays; public class MainActivity extends AppCompatActivity { public static final String LOG_TAG = "myLogs"; CameraService[] myCameras = null; private CameraManager mCameraManager = null; private final int CAMERA1 = 0; private int count =1; private Button mButtonOpenCamera1 = null; private Button mButtonRecordVideo = null; private Button mButtonStopRecordVideo = null; public static TextureView mImageView = null; private HandlerThread mBackgroundThread; private Handler mBackgroundHandler = null; private File mCurrentFile; private MediaRecorder mMediaRecorder = null; private void startBackgroundThread() { mBackgroundThread = new HandlerThread("CameraBackground"); mBackgroundThread.start(); mBackgroundHandler = new Handler(mBackgroundThread.getLooper()); } private void stopBackgroundThread() { mBackgroundThread.quitSafely(); try { mBackgroundThread.join(); mBackgroundThread = null; mBackgroundHandler = null; } catch (InterruptedException e) { e.printStackTrace(); } } protected void onCreate(Bundle savedInstanceState) { super.onCreate(savedInstanceState); setContentView(R.layout.activity_main); Log.d(LOG_TAG, " "); if (checkSelfPermission(Manifest.permission.CAMERA) != PackageManager.PERMISSION_GRANTED || (ContextCompat.checkSelfPermission(MainActivity.this, Manifest.permission.WRITE_EXTERNAL_STORAGE) != PackageManager.PERMISSION_GRANTED) || (ContextCompat.checkSelfPermission(MainActivity.this, Manifest.permission.RECORD_AUDIO) != PackageManager.PERMISSION_GRANTED) ) { requestPermissions(new String[]{Manifest.permission.CAMERA, Manifest.permission.WRITE_EXTERNAL_STORAGE, Manifest.permission.RECORD_AUDIO}, 1); } mButtonOpenCamera1 = findViewById(R.id.button1); mButtonRecordVideo = findViewById(R.id.button2); mButtonStopRecordVideo = findViewById(R.id.button3); mImageView = findViewById(R.id.textureView); mButtonOpenCamera1.setOnClickListener(new View.OnClickListener() { @Override public void onClick(View v) { if (myCameras[CAMERA1] != null) { if (!myCameras[CAMERA1].isOpen()) myCameras[CAMERA1].openCamera(); } } }); mButtonRecordVideo.setOnClickListener(new View.OnClickListener() { @Override public void onClick(View v) { if ((myCameras[CAMERA1] != null) & mMediaRecorder != null) { mMediaRecorder.start(); } } }); mButtonStopRecordVideo.setOnClickListener(new View.OnClickListener() { @Override public void onClick(View v) { if ((myCameras[CAMERA1] != null) & (mMediaRecorder != null)) { myCameras[CAMERA1].stopRecordingVideo(); } } }); mCameraManager = (CameraManager) getSystemService(Context.CAMERA_SERVICE); try {

ajouter à cela <?xml version="1.0" encoding="utf-8"?> <androidx.constraintlayout.widget.ConstraintLayout xmlns:android="http://schemas.android.com/apk/res/android" xmlns:app="http://schemas.android.com/apk/res-auto" xmlns:tools="http://schemas.android.com/tools" android:layout_width="match_parent" android:layout_height="match_parent" tools:context=".MainActivity"> <TextureView android:id="@+id/textureView" android:layout_width="356dp" android:layout_height="410dp" android:layout_marginTop="32dp" app:layout_constraintEnd_toEndOf="parent" app:layout_constraintHorizontal_bias="0.49" app:layout_constraintStart_toStartOf="parent" app:layout_constraintTop_toTopOf="parent" /> <LinearLayout android:layout_width="292dp" android:layout_height="145dp" android:layout_marginStart="16dp" android:orientation="vertical" app:layout_constraintBottom_toBottomOf="parent" app:layout_constraintEnd_toEndOf="parent" app:layout_constraintStart_toStartOf="parent" app:layout_constraintTop_toBottomOf="@+id/textureView" app:layout_constraintVertical_bias="0.537"> <Button android:id="@+id/button1" android:layout_width="match_parent" android:layout_height="wrap_content" android:text=" " /> <Button android:id="@+id/button2" android:layout_width="match_parent" android:layout_height="wrap_content" android:text=" " /> <Button android:id="@+id/button3" android:layout_width="match_parent" android:layout_height="wrap_content" android:text=" " /> </LinearLayout> </androidx.constraintlayout.widget.ConstraintLayout>

Et un petit ajout au manifeste

Et un petit ajout au manifeste <uses-permission android:name="android.permission.RECORD_AUDIO"/>

Tout fonctionne et écrit avec succès des fichiers.

La seule chose est qu'il n'y a aucune protection contre le fou, et donc, s'il est déraisonnable de pousser les boutons à l'écran dans un ordre aléatoire, vous pouvez tout casser.