Lors du développement d'une infrastructure réseau, ils envisagent généralement l'informatique locale ou le cloud computing. Mais ces deux options et leurs combinaisons sont peu nombreuses. Par exemple, que dois-je faire si je ne peux pas refuser le cloud computing, mais que je n'ai pas assez de bande passante ou que le trafic est trop cher?

Ajoutez un lien intermédiaire qui effectuera une partie des calculs à la limite du réseau local ou du processus de production. Ce concept périphérique est appelé Edge Computing. Le concept complète le modèle cloud actuel d'utilisation des données, et dans cet article, nous examinerons l'équipement nécessaire et des exemples de tâches pour cela.

Niveaux de calcul Edge

Supposons que vous ayez tout un tas de capteurs installés dans votre maison: un thermomètre, un hygromètre, un capteur de lumière, des fuites, etc. Le contrôleur logique traite les informations reçues de leur part, implémente des scénarios d'automatisation, envoie la télémétrie traitée au service cloud et en reçoit des scripts d'automatisation mis à jour et un nouveau micrologiciel. Ainsi, les calculs locaux sont effectués directement sur le site, mais l'équipement est surveillé à partir d'un nœud qui combine de nombreux appareils de ce type.

Ceci est un exemple d'un système très simple de calcul des limites, mais les trois niveaux de calcul des bords y sont déjà visibles:

- Appareils IoT: générez des «données brutes» et transmettez-les via différents protocoles.

- Nœuds périphériques: traitent les données à proximité immédiate des sources d'information et agissent comme des magasins de données temporaires.

- Services cloud: offrent des fonctions de gestion pour les périphériques et les objets connectés, effectuent un stockage et une analyse des données à long terme. De plus, ils prennent en charge l'intégration avec d'autres systèmes d'entreprise.

Le concept informatique Edge lui-même fait partie d'un vaste écosystème qui optimise le flux de processus. Il comprend à la fois du matériel (serveurs en rack et périphériques) et des composants réseau et logiciels (par exemple, la plate-forme

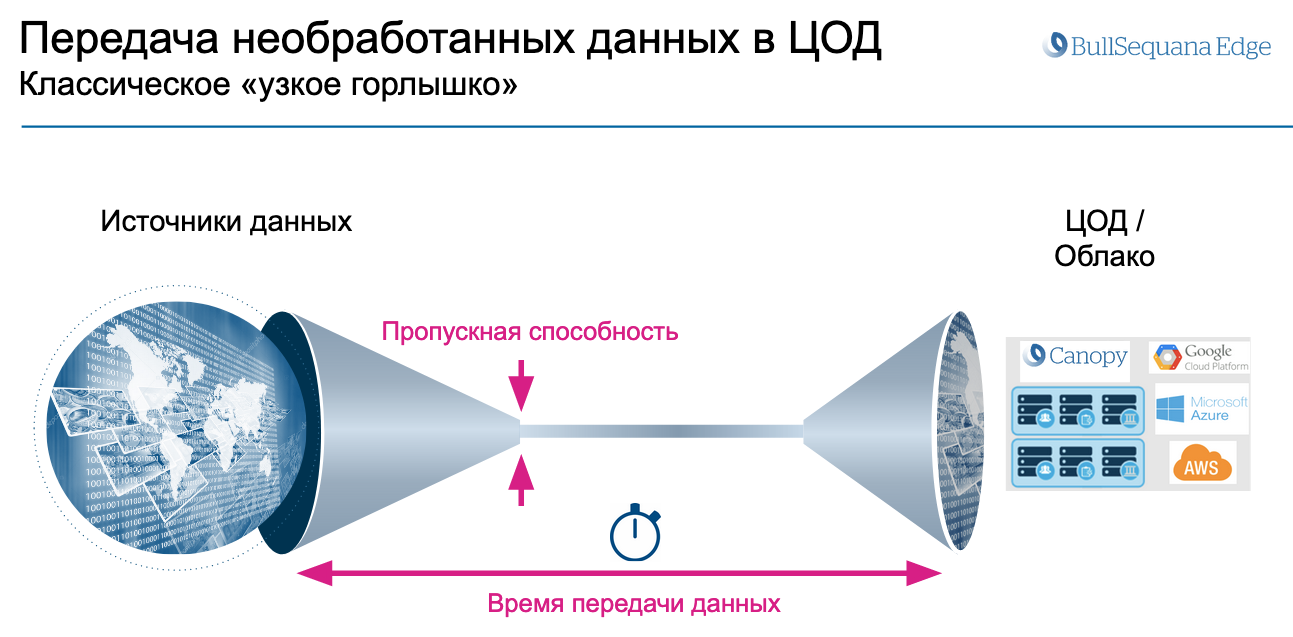

Codex AI Suite pour développer des algorithmes d'IA). Le "goulot d'étranglement" pouvant se former lors de la création, du transfert et du traitement des "big data" et limiter les performances de l'ensemble du système, ces pièces doivent être compatibles entre elles.

Caractéristiques du serveur Edge

Au niveau du nœud périphérique, Edge Computing utilise des serveurs de périphérie, qui sont installés directement là où les informations sont produites. Il s'agit généralement de salles de production ou techniques dans lesquelles vous ne pouvez pas installer de rack de serveur et garantir la propreté. Ainsi, les serveurs de périphérie sont exécutés dans des boîtiers compacts résistants à la poussière et à l'humidité avec une plage de température étendue; ils ne peuvent pas être montés en rack. Oui, un tel serveur peut facilement s'accrocher

à des ancres de

ruban adhésif

double face quelque part sous les escaliers ou dans l'arrière-salle.

Étant donné que les serveurs Edge sont placés en dehors des centres de données sécurisés, ils ont des exigences de sécurité physique plus élevées. Des conteneurs de protection leur sont fournis:

Au niveau de l'utilisation des données dans les serveurs de limites, le chiffrement du disque et le chargement sécurisé sont fournis. Le chiffrement lui-même occupe 2 à 3% de la puissance de calcul, mais les serveurs périphériques utilisent généralement des processeurs Xeon D avec un module d'accélération AES intégré qui minimise la perte de puissance.

Lorsque les serveurs Edge sont utilisés

Avec Edge Computing, seules les données impossibles ou traitées de manière irrationnelle différemment sont envoyées au centre de données pour traitement. Ainsi, les serveurs de périphérie sont utilisés en cas de besoin:

- Une approche flexible de la sécurité, car dans le cas de Edge Computing, vous pouvez configurer le transfert vers le centre de données central des informations prétraitées et préparées;

- Protection contre la perte d'informations, car en cas de perte de communication avec le centre, les nœuds locaux accumuleront des informations;

- Économisant sur le trafic, il est réalisé en traitant la majeure partie des informations en place.

Edge computing pour économiser du trafic

La société danoise Maersk, l'un des principaux transporteurs mondiaux de marchandises, a décidé de réduire la consommation de carburant de ses navires et de réduire la pollution atmosphérique.

Pour résoudre ce problème, la technologie

Siemens EcoMain Suite a été utilisée, des capteurs sur les moteurs et les principaux composants du navire, ainsi qu'un serveur local BullSequana Edge pour l'informatique sur site.

Grâce aux capteurs, le système EcoMain Suite surveille en permanence l'état des nœuds critiques du navire et leur écart par rapport à la norme précédemment calculée. Cela vous permet de diagnostiquer rapidement un défaut et de le localiser jusqu'au nœud du problème. La télémétrie étant constamment transmise «au centre», le technicien de maintenance peut effectuer l'analyse à distance et faire des recommandations à l'équipe de bord. Et la question principale ici est de savoir combien de données et combien transmettre au centre de données central.

Étant donné que la connexion d'un Internet câblé bon marché à un porte-conteneurs maritime est très problématique, le transfert d'une grande quantité de données brutes vers un serveur central est trop coûteux. Sur le serveur central du BullSequana S200, le modèle logique général du navire est calculé, et le traitement des données et le contrôle direct sont transférés au serveur local. En conséquence, la mise en œuvre de ce système a porté ses fruits en trois mois.

Edge computing pour économiser les ressources

Un autre exemple de calcul des limites est l'analyse vidéo. Ainsi, l'une des tâches locales du cycle de production chez le fabricant d'équipements pour les gaz techniques Air Liquide est le contrôle qualité de la peinture des bouteilles de gaz. Elle a été réalisée manuellement et était d'environ 7 minutes par cylindre.

Pour accélérer ce processus, la personne a été remplacée par un bloc de 7 caméras haute résolution. Les caméras prennent le ballon de plusieurs côtés, générant environ 1 Go de vidéo par minute. La vidéo est envoyée au serveur frontalier BullSequana Edge avec Nvidia T4 à bord, sur lequel le réseau neuronal, formé à la recherche de défauts, analyse le flux en ligne. En conséquence, le temps d'inspection moyen est passé de quelques minutes à quelques secondes.

Edge computing en analytique

Les attractions de Disneyland sont non seulement amusantes, mais aussi un objet technique complexe. Ainsi, sur le "Roller Coaster" installé environ 800 capteurs différents. Ils envoient constamment des données sur le fonctionnement de l'attraction au serveur, et le serveur local traite ces données, calcule la probabilité d'échec de l'attraction et la signale au centre de données central.

Sur la base de ces données, la probabilité d'une défaillance technique est déterminée et la réparation préventive est lancée. L'attraction continue de fonctionner jusqu'à la fin de la journée de travail et, dans l'intervalle, un ordre de réparation a déjà été émis et les travailleurs réparent rapidement l'attraction la nuit.

BullSequana Edge

Les serveurs BullSequana Edge font partie d'une grande infrastructure pour travailler avec des "big data", ils sont déjà testés avec Microsoft Azure et Siemens MindSphere, VMware WSX et ont des certificats NVidia NGC / EGX. Ces serveurs sont conçus spécifiquement pour le calcul des limites et sont disponibles dans des boîtiers de facteur de forme U2 pour une installation dans un rack standard, sur un rail DIN, sur un mur et dans une version au sol.

BullSequana Edge est construit sur une carte mère propriétaire et un processeur Intel Xeon D-2187NT. Ils prennent en charge l'installation de jusqu'à 512 Go de RAM, 2 SSD de 960 Go ou 2 HDD de 8 ou 14 To. Vous pouvez également installer 2 GPU Nvidia T4 16 Go pour travailler avec la vidéo; Modules Wi-Fi, LoRaWAN et 4G; jusqu'à 2 modules SFP 10 gigabits. Dans les serveurs eux-mêmes, un capteur d'ouverture de capot est déjà installé, qui est connecté au BMC, qui contrôle le module IPMI. Il peut être configuré pour couper automatiquement l'alimentation lorsque le capteur est déclenché.

Les spécifications techniques complètes des serveurs BullSequana Edge sont disponibles

ici . Si vous êtes intéressé par les détails, nous serons heureux de répondre à nos questions dans les commentaires.