Contrôler ses pensées avec autre chose que ses propres membres est un domaine fascinant. Il est toujours intéressant d'imaginer un avenir dans lequel nous pourrons interagir avec Internet non seulement avec nos doigts, notre bouche, nos yeux et nos oreilles.

Si vous y réfléchissez, l'ordinateur et le téléphone sont des interfaces terriblement inefficaces pour obtenir les informations nécessaires. Vous savez exactement ce que vous voulez savoir: par exemple, le taux de change actuel du rouble contre le dollar. Utilisez vos doigts pour cliquer sur certaines zones de l'écran du téléphone avec des lettres, en visant les bons points à chaque fois, puis voyez la réponse.

Ce serait beaucoup plus beau de dire mentalement «Bonjour Igor!», De formuler mentalement une question et d'obtenir une réponse d'une oreille / d'un œil / d'une autre manière. Ou envoyez un message à un ami de la même manière rapide. En général, connectez Internet au cerveau.

Comme cela peut être essayé dans la pratique maintenant, cela vaut la peine de gérer quelque chose, de voir à quel point c'est pratique et de tirer des conclusions. Une vidéo avec les résultats se trouve à la fin de l'article.

1. Idée d'entrée2. Ce qui est nécessaire3. Assembler4. Nous essayons une fois5. Essayez deux6. Trois7. Pensées du week-endIdée

Le plan est sorti simple:

Étape 1. Prenez un

appareil EEG qui lit l'activité cérébrale.

Étape 2. Nous formons un algorithme qui nous permet de déterminer les commandes mentales avec une précision suffisante. Nous essayons plusieurs types de commandes mentales (plus à ce sujet plus tard).

Étape 3. Connectez-vous à tout objet en mouvement.

Étape 4. Nous essayons d'effectuer une tâche simple, par exemple, conduire du point A au point B.

Étape 5. Nous tirons des conclusions de tout cela, s'il est temps. Sinon, répétez les étapes 2 et 4.

Oui, des expériences similaires ont déjà été réalisées par un certain nombre d'experts: il existe de nombreux tests de

l'approche P300 , qui vous permettent de taper des pensées (cela sort très précisément,

mais pendant longtemps ), de contrôler diverses prothèses et autres appareils. Rien de nouveau d'un point de vue scientifique ne se passe dans l'expérience actuelle, le but est d'essayer le contrôle du cerveau en personne et de tirer quelques conclusions des sentiments et des pensées sur le BCI (interface cerveau-ordinateur).

Ce qui est nécessaire

Nous prenons

Emotiv Insight comme un appareil EEG. Loin de l'appareil le plus précis avec une faible résolution d'une carte électromagnétique montée, mais suffisant pour nos besoins. Cela coûte

299 $ , il y a presque toujours des réductions sur ce modèle, mais le problème est avec la livraison en Russie: ce n'est pas le cas. Cela s'explique moins par la logistique que par les problèmes législatifs: les appareils EEG sont des dispositifs médicaux du point de vue des règles douanières de la Fédération de Russie (avec les conséquences correspondantes).

Il est également impossible de venir chercher quelque part dans le monde, il ne reste donc qu'à commander aux pays proches de la Russie qui ont l'option de livraison: la Pologne, Israël ou quelque chose comme ça. La rumeur veut qu'il soit vendu à Moscou sous le plancher, mais avec des marges appropriées.

Les appareils Emotiv sont également bons du point de vue du logiciel: il est propriétaire, mais il peut faire beaucoup de choses, et, important pour les besoins de notre expérience, il dispose d'outils intégrés pour travailler avec des commandes mentales.

En tant que robot, nous prenons la plateforme

Hicat.Livera . Construit sur la base d'Arduino. En fait, c'est tout, seulement avec un appareil photo, des roues, un laser et des modifications mineures au logiciel. Cela coûte environ

100 $ à 150 $ , il est probablement plus pratique de commander via AliExpress, mais nous avons commandé directement via le site, bien qu'il n'y ait eu aucun problème de livraison.

Assembler

Aux points, le processus de tout connecter à un banc d'essai ressemblait à ceci:

1. Installez ici le logiciel nécessaire pour Emotiv . De l'ensemble, nous avons besoin d'un connecteur et

Emotiv BCI .

2. Connectez Insight à l'ordinateur et testez la connexion.

3. Installez Node-RED . C'est une chose merveilleuse qui vous permet de traiter facilement les données et les signaux. À l'aide d'un grand nombre de modules, vous pouvez compiler une sorte d'utilitaire en quelques minutes: envoyez-vous une alerte de la pluie à venir dans les télégrammes, traitez un tas de données brutes et tout ça.

4. Ajoutez à la boîte à

outils Node-RED Emotiv en tant que module.

Ici, il est

décrit ce que c'est. Effectuez quelques clics.

5. Nous collectons Hicat.Livera. Ça va comme ça: si tout est fait selon les instructions, la batterie tombera constamment, l'une des vis autotaraudeuses bloque les rotations de la caméra et ainsi de suite. Ici, vous avez besoin d'un peu de créativité.

6. Connectez le robot à l'ordinateur. Pour cela, vous n'avez besoin d'aucun logiciel supplémentaire, il est contrôlé via WebSocket, il suffit d'être sur le même réseau Wi-Fi. Certes, ici aussi, ce n'est pas si simple: il s'est avéré que tous les fichiers n'ont pas été écrits sur la carte mémoire par le fabricant, j'ai donc dû démonter, télécharger à partir du

référentiel et écraser. En général, la splendeur classique et la pauvreté des projets

kickstarter .

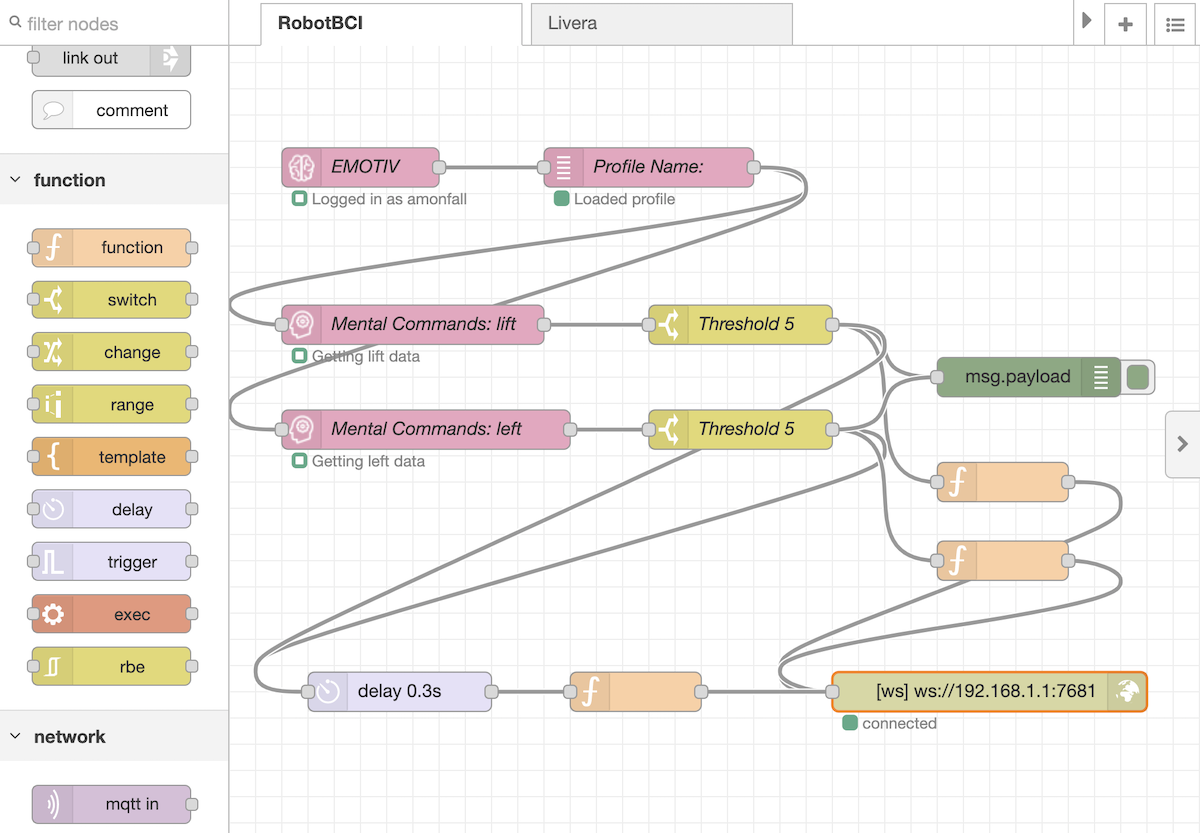

7. Flux maître dans Node-RED. Nous prenons les signaux des équipes formées dans Emotiv BCI, les éliminons du bruit sur le seuil et envoyons la valeur de puissance reçue au robot. Un tiers de seconde après chaque signal, nous réinitialisons la tension sur les moteurs. Il s'est avéré comme ceci:

La carte elle-même pour Node-RED peut être téléchargée à

partir d'ici et importée dans votre Flow.

De plus, il ne reste plus qu'à pratiquer et essayer.

Essayez une fois

Le robot peut avancer / reculer, faire tourner séparément chaque roue, soulever / abaisser la caméra et allumer / éteindre le laser. Il est difficile de s'entraîner en même temps pour 6-8 actions, donc la première tentative impliquait trois actions: aller de l'avant, tourner à gauche et tourner à droite.

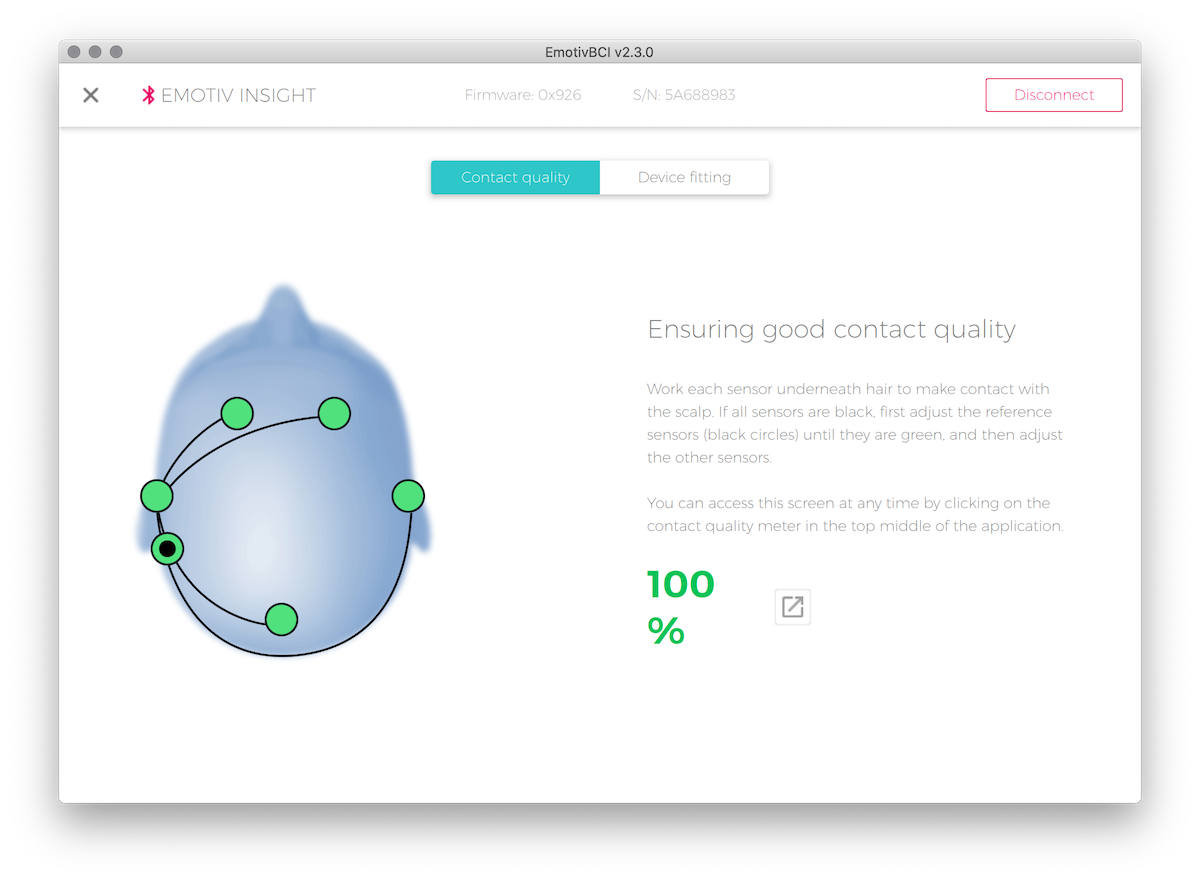

Qualité de connexion Les cérébras sont visibles sur un moniteur pratique. Dans le cas d'Insight, il est important que le capteur principal derrière l'oreille soit très serré contre le cuir chevelu: s'il y a des interférences, il n'y aura pas de signal des six autres capteurs.

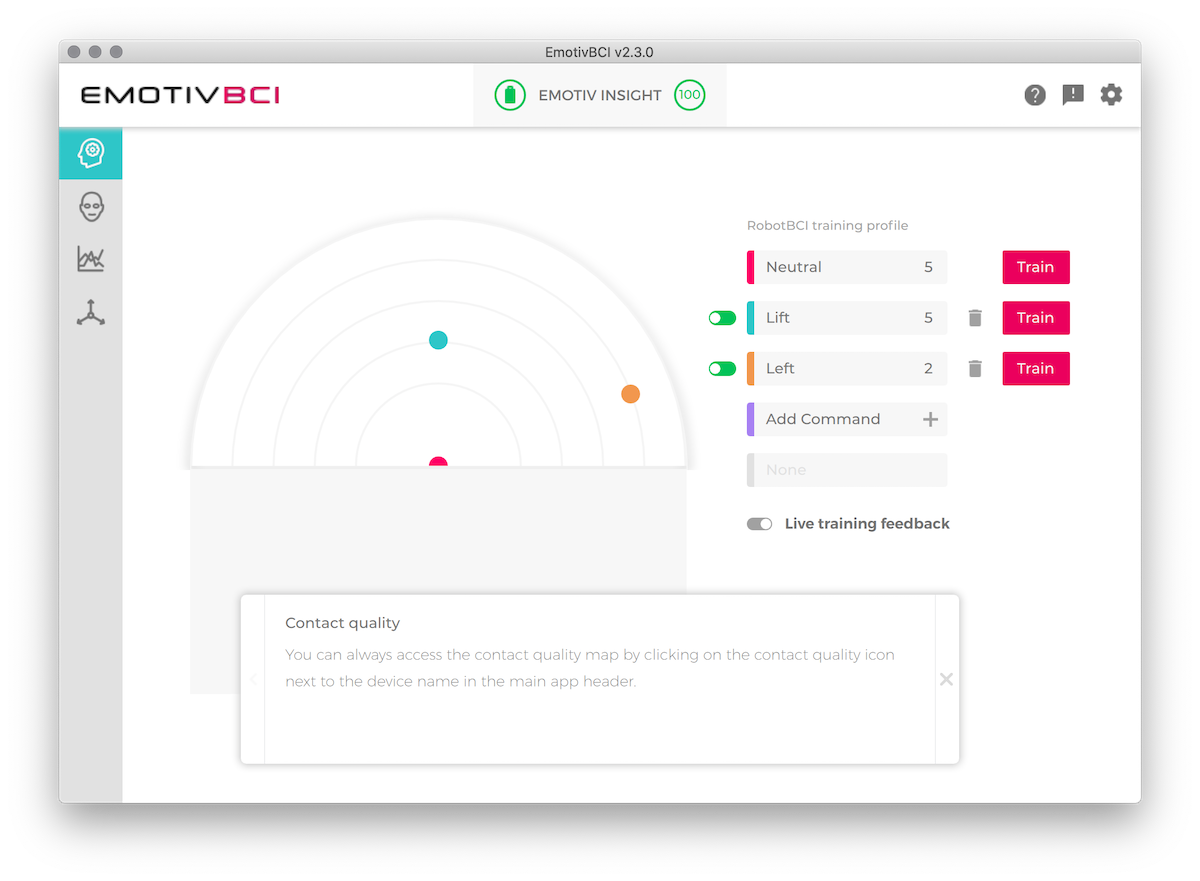

Vient ensuite la formation. Premièrement, la chose la plus difficile est d'enregistrer un état de conscience calme et normal, sans stimuli ni pensées externes. Qui sait que les pratiques méditatives sont toujours n'importe où, mais juste comme ça, ce n'est pas du tout facile de penser à quoi que ce soit. L'algorithme prendra cet enregistrement en arrière-plan et recherchera les différences entre les états de commande et ceux par défaut.

Après cela - formation de chaque équipe. Les deux ou trois premières inscriptions sont prises sans condition comme base de formation. Ensuite, l'algorithme détermine à chaque fois dans quelle mesure votre enregistrement est similaire au précédent. Si la différence est trop importante, il est suggéré de ne pas considérer cette session dans la formation. De toute évidence, avec des états de conscience trop divers, la formation est inutile.

Chaque session de formation suivante clarifie l'état du modèle, l'équipe de suivi. Sur la carte de ce modèle, vous pouvez voir à quel point les équipes diffèrent entre elles: si la similitude est trop grande (les points sur le radar sont à proximité), l'algorithme comprendra à peine ce que vous aviez en tête dans chaque cas.

La question principale pendant la formation est qu'en fait, quoi penser? Avec le cerveau, nous pouvons faire deux choses: contrôler les muscles et penser. Le fait est que le cortex moteur, responsable des mouvements musculaires, provoque de très fortes interférences du point de vue de l'EEG. Autrement dit, si, en équipe, vous essayez de bouger vos membres, de les forcer ou d'imaginer qu'ils fonctionnent, cela générera un bruit indiscernable continu avec une précision générale telle que le modèle Insight.

Reste à réfléchir. Il y a une grande étendue: parler mentalement des mots, penser à une sorte de sensation, s'imaginer quelque part, imaginer le robot se déplacer dans la bonne direction, etc.

Pour commencer, une direction verbale a été choisie: prononcer une phrase spécifique pour chaque équipe avec une voix interne.

Les résultats de cette approche se sont révélés insatisfaisants: oui, les commandes ont été définitivement exécutées avec différents réglages de sensibilité, mais il s'est avéré complètement impossible de les contrôler. Il y a une distinction claire entre essayer d'exécuter des commandes et leur absence: dans le premier cas, le robot fait quelque chose, dans le second il n'y a pratiquement rien, mais il n'a pas été possible de le forcer à aller au moins dans la direction approximative.

Essayez deux

De plus, l'idée est venue d'essayer les domaines suivants:

- Pour penser à un moment lumineux, par exemple, vous vous allongez sur la plage et le soleil se réchauffe chaudement.

- Écoutez différents signaux sonores / extraits musicaux.

- Représente le froid / la chaleur dans certaines parties de certains membres.

- Essayez d'imiter la bonne humeur et la mauvaise humeur.

- Écoutez les commandes vocales de différentes personnes sous différents angles (pour augmenter la différenciation des signaux en ajoutant une sensation spatiale).

Les résultats ont été intéressants: par exemple, la voix d'une personne à côté du sujet de l'expérience a conduit au mouvement du robot dans un sens et de l'autre dans l'autre. Peu importait ce que ces gens disaient.

Mais en général, la précision s'est avérée tout aussi triste: gérer avec une qualité qui vous permet d'effectuer une séquence stricte de commandes n'a pas fonctionné.

Trois

Pour augmenter la précision du contrôle, il a été décidé de réduire le nombre d'équipes de trois à deux: avancer et tourner en place dans une direction. Cela suffit pour se déplacer dans l'avion, et la reconnaissance de seulement deux équipes devrait être plus facile.

Le résultat est le suivant:

Il est si facile de se rendre du point A au point B, mais après une série de formations, il y a un résultat approximatif.

Pensées de fin de semaine

BCI sous forme de commandes mentales abstraites est plutôt une chose impossible d'un point de vue pratique. Oui, vous pouvez implanter des électrodes dans une partie spécifique du cerveau, vous entraîner pendant longtemps et, par conséquent, apprendre à contrôler le curseur ou un bras robotique, comme le vôtre. Ceci est bien adapté pour résoudre des problèmes de handicap et d'autres problèmes, mais dans chaque cas, cette solution est individuelle pour une personne en particulier, car le cerveau a besoin d'une période relativement longue de construction de nouvelles connexions neuronales.

En tant qu'interface de masse: je l'ai achetée, tirée sur ma tête et utilisée - cela ne fonctionne pas. Certains d'entre nous ont immédiatement réussi à réaliser une mise en œuvre claire des commandes, tandis que d'autres n'ont pas réussi à faire quoi que ce soit, même après de longues formations. Le processus est trop individuel et trop compliqué à expliquer dans le mode d'emploi. De plus, le lendemain d'une gestion réussie, il est difficile de répéter la même chose: l'état de conscience est déjà quelque peu différent.

Il est beaucoup plus efficace, à mon avis, d'utiliser des appareils qui lisent la voix intérieure à travers des changements dans les potentiels des muscles de la mâchoire inférieure et du cou pour un contrôle «mental». Lorsque nous nous parlons, des signaux nerveux sont transmis aux muscles de l'appareil vocal,

ils se déplacent très légèrement . S'ils sont surveillés par des capteurs sensibles, puis presque sans formation, vous pouvez dicter le texte avec votre voix intérieure.

Il existe de nombreux appareils similaires, l'un des derniers est le projet

AlterEgo des chercheurs du MIT. En cours de développement, mais dans les démonstrations vidéo, vous pouvez voir que cela fonctionne toujours assez bien.

En substance, cependant, c'est le même contrôle de la parole, mais sans son. Le problème avec toutes les interfaces vocales est le manque de compréhension de la palette de commandes. Si nous regardons un site Web ou une application, nous voyons des boutons, des signatures et nous savons où piquer. Dans le cas d'un assistant vocal, comprendre ce qui peut être demandé exactement ne l'est pas, les commandes possibles doivent être apprises par cœur ou à chaque fois en écoutant de longues listes de sujets de dialogue possibles. Tout cela, associé à une reconnaissance vocale non idéale, conduit au fait que nous utilisons maintenant uniquement l'ensemble standard de commandes de l'assistant vocal: appelez Sophocle, réglez une minuterie pendant cinq cents ans, rappelez-vous de vous arrêter pour travailler.

Donc, pour le moment, nous avons ce qui suit: a) si vous gérez quelque chose pour que ça a l'air cool, mais en même temps ça marche, alors ce n'est que la lecture de la voix interne (il faudra faire une expérience ici aussi) et b) la concurrence pour l'interface graphique jusqu'à présent même pas proche.

Concernant le deuxième point, il existe des technologies dans le domaine de la

stimulation magnétique transcrânienne . En bref: si vous concentrez quelque chose comme un micro-ondes sur le cortex visuel, alors nous verrons des phosphènes - des points lumineux et des effets que l'œil ne voit pas. De tels appareils peuvent dessiner des caractères assez précis, par exemple des lettres dans l'espace. Ces procédures, en règle générale, provoquent de graves maux de tête et des nausées, ne sont pas très recommandées pour les expériences, mais en théorie, il est possible de dessiner une interface face à un homme de fer sans lentilles ni lunettes. Certes, vous pouvez utiliser des lentilles et des lunettes, mais plus à ce sujet, peut-être une autre fois.

En couverture, une photo prise par Road to VR pour un article sur les expériences BCI de Valve.